GraphRAG を理解する (1): RAG の課題

RAG (リスク評価グリッド) は、外部知識ソースを使用して既存の大規模言語モデル (LLM) を強化し、コンテキストにより関連性の高い回答を提供する方法です。 RAG では、取得コンポーネントは追加情報を取得し、応答は特定のソースに基づいて、LLM の応答がこの情報に基づくように、この情報を LLM プロンプトにフィードします (拡張フェーズ)。 RAG は、トリミングなどの他の技術と比較して経済的です。また、この情報に基づいて追加のコンテキストを提供することで幻覚を軽減するという利点もあります (拡張段階)。RAG は、今日の LLM タスク (レコメンデーション、テキスト抽出、センチメント分析など) のワークフロー メソッドになります。

このアイデアをユーザーの意図に基づいてさらに細分化すると、通常はベクトルのデータベースにクエリを実行します。ベクトル データベースは、連続ベクトル空間を使用して、近接ベースの検索を使用して 2 つの概念間の関係をキャプチャします。

ベクトル データベースの概要

ベクトル空間では、テキスト、画像、音声、その他の種類の情報が変換されます。ベクトルに変換します。ベクトルは、高次元空間におけるデータの数値表現です。各次元はデータの特徴に対応し、各次元の値はその特徴の強さまたは存在を反映します。 ベクトル表現を通じて、データに対して数学的演算、距離計算、類似性比較などを実行できます。さまざまな寸法に対応する値は、特徴の強さや存在を反映します。 テキスト データを例にとると、各ドキュメントはベクトルとして表すことができ、各次元はドキュメント内の単語の頻度を表します。このようにして、2 つのドキュメントは、ベクトル間の距離を計算し、別のベクトルを使用してこれらのデータベースにクエリを実行し、ベクトルを検索することにより、データベース内で近接ベースの検索を実行できます。それはベクトル空間ではそれに「近い」ということです。ベクトル間の近接性は、通常、ユークリッド距離、コサイン類似度、マンハッタン距離などの距離尺度によって決定されます。ベクトル間の近接性は、通常、ユークリッド距離、コサイン類似度、マンハッタン距離などの距離尺度によって決定されます。

データベースへの検索を実行するときは、システムがベクトルに変換するクエリを指定します。次にデータベースは、このクエリ ベクトルとデータベースに既に格納されているベクトルの間の距離または類似性を計算します。 (選択したメトリックに従って) クエリ ベクトルに近いベクトルが、最も関連性の高い結果とみなされます。 (選択したメトリックに基づいて) クエリ ベクトルに最も近いこれらのベクトルが、最も関連性の高い結果とみなされます。

近接ベースの検索は、ベクトル データベースで特に強力であり、推奨システム、情報検索、異常検出などのタスクに適しています。

このアプローチにより、表面的な一致だけに依存するのではなく、データのコンテキストと深い意味を理解することで、システムがより直観的に動作し、ユーザーのクエリに効果的に応答できるようになります。

ただし、高度な検索のためにデータベースに接続するアプリケーションには、データ品質、動的な知識の処理能力、透明性などの制限があります。

RAG の制限

RAG はドキュメントのサイズに応じて、大きく 3 つのカテゴリに分類されます。ドキュメントが小さい場合は、ドキュメントが非常に大きい (または複数のドキュメントがある) 場合は、クエリ時にインデックス付けされて使用される小さなチャンクが生成されます。

RAG には成功にもかかわらず、いくつかの欠点があります。

RAG のパフォーマンスを測定する 2 つの主な指標は、混乱と幻覚です。混乱は、テキスト生成プロセスで同様に考えられる次の単語の選択肢の数を表します。つまり、言語モデルがその選択においてどの程度「混乱」しているかということです。幻覚は、AI によって行われる虚偽の発言または想像上の発言です。

RAG は幻覚を軽減しますが、幻覚をなくすことはできません。小さくて簡潔な文書がある場合は、(LLM のオプションが少ないため) 混乱を減らし、(文書の内容だけを尋ねる場合) 幻覚を減らすことができます。もちろん、裏を返せば、1 つの小さな文書からは簡単なアプリケーションが作成されるということです。より複雑なアプリケーションの場合は、より多くのコンテキストを提供する方法が必要です。

たとえば、「樹皮」という単語について考えてみましょう。少なくとも 2 つの異なるコンテキストがあります:

木のコンテキスト: 「オークの原皮」 「樹皮が寒さから守ってくれます。」

##犬の文脈: 「誰かが家を通るたびに、近所の犬が大声で吠えます。」

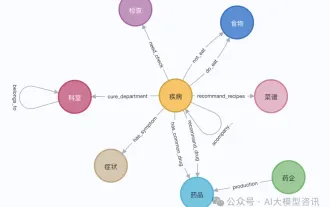

##Oneより多くのコンテキストを提供するには、RAG とナレッジ グラフ (GRAPHRAG) を組み合わせます。ナレッジ グラフでは、これらの単語は、関連するコンテキストや意味と関連付けられています。たとえば、「樹皮」は「木」と「犬」を表すノードに接続されます。他の関連性は、共通の行動 (例: 木の「保護」、犬の「騒音」) または特性 (例: 木の「荒さ」、犬の「うるささ」) を示す場合があります。この構造化された情報により、言語モデルは文内の他の単語または会話の全体的なトピックに基づいて適切な意味を選択できます。

次のセクションでは、RAG の制限と、GRAPHRAG がそれらにどのように対処するかを見ていきます。 元のタイトル: GraphRAG を理解する – 1: RAG の課題 原著者: ajitjaokar

以上がGraphRAG を理解する (1): RAG の課題の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7514

7514

15

15

1378

1378

52

52

79

79

11

11

19

19

64

64

Groq Llama 3 70B をローカルで使用するためのステップバイステップ ガイド

Jun 10, 2024 am 09:16 AM

Groq Llama 3 70B をローカルで使用するためのステップバイステップ ガイド

Jun 10, 2024 am 09:16 AM

翻訳者 | Bugatti レビュー | Chonglou この記事では、GroqLPU 推論エンジンを使用して JanAI と VSCode で超高速応答を生成する方法について説明します。 Groq は AI のインフラストラクチャ側に焦点を当てているなど、誰もがより優れた大規模言語モデル (LLM) の構築に取り組んでいます。これらの大型モデルがより迅速に応答するためには、これらの大型モデルからの迅速な応答が鍵となります。このチュートリアルでは、GroqLPU 解析エンジンと、API と JanAI を使用してラップトップ上でローカルにアクセスする方法を紹介します。この記事では、これを VSCode に統合して、コードの生成、コードのリファクタリング、ドキュメントの入力、テスト ユニットの生成を支援します。この記事では、独自の人工知能プログラミングアシスタントを無料で作成します。 GroqLPU 推論エンジン Groq の概要

Rag と Sem-Rag を使用したコンテキスト拡張 AI コーディング アシスタント

Jun 10, 2024 am 11:08 AM

Rag と Sem-Rag を使用したコンテキスト拡張 AI コーディング アシスタント

Jun 10, 2024 am 11:08 AM

検索強化生成およびセマンティック メモリを AI コーディング アシスタントに組み込むことで、開発者の生産性、効率、精度を向上させます。 JanakiramMSV 著者の EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG から翻訳。基本的な AI プログラミング アシスタントは当然役に立ちますが、ソフトウェア言語とソフトウェア作成の最も一般的なパターンに関する一般的な理解に依存しているため、最も適切で正しいコードの提案を提供できないことがよくあります。これらのコーディング アシスタントによって生成されたコードは、彼らが解決する責任を負っている問題の解決には適していますが、多くの場合、個々のチームのコーディング標準、規約、スタイルには準拠していません。これにより、コードがアプリケーションに受け入れられるように修正または調整する必要がある提案が得られることがよくあります。

カリフォルニア工科大学の中国人がAIを使って数学的証明を覆す!タオ・ゼシュアンの衝撃を5倍にスピードアップ、数学的ステップの80%が完全に自動化

Apr 23, 2024 pm 03:01 PM

カリフォルニア工科大学の中国人がAIを使って数学的証明を覆す!タオ・ゼシュアンの衝撃を5倍にスピードアップ、数学的ステップの80%が完全に自動化

Apr 23, 2024 pm 03:01 PM

テレンス・タオなど多くの数学者に賞賛されたこの正式な数学ツール、LeanCopilot が再び進化しました。ちょうど今、カリフォルニア工科大学のアニマ・アナンドクマール教授が、チームが LeanCopilot 論文の拡張版をリリースし、コードベースを更新したと発表しました。イメージペーパーのアドレス: https://arxiv.org/pdf/2404.12534.pdf 最新の実験では、この Copilot ツールが数学的証明ステップの 80% 以上を自動化できることが示されています。この記録は、以前のベースラインのイソップよりも 2.3 倍優れています。そして、以前と同様に、MIT ライセンスの下でオープンソースです。写真の彼は中国人の少年、ソン・ペイヤンです。

「人間 + RPA」から「人間 + 生成 AI + RPA」へ、LLM は RPA と人間とコンピューターのインタラクションにどのような影響を与えるのでしょうか?

Jun 05, 2023 pm 12:30 PM

「人間 + RPA」から「人間 + 生成 AI + RPA」へ、LLM は RPA と人間とコンピューターのインタラクションにどのような影響を与えるのでしょうか?

Jun 05, 2023 pm 12:30 PM

画像出典@visualchinesewen|Wang Jiwei 「人間 + RPA」から「人間 + 生成 AI + RPA」へ、LLM は RPA の人間とコンピューターのインタラクションにどのような影響を与えますか?別の観点から見ると、人間とコンピューターの相互作用の観点から、LLM は RPA にどのような影響を与えるのでしょうか?プログラム開発やプロセス自動化における人間とコンピューターの対話に影響を与える RPA も、LLM によって変更される予定ですか? LLM は人間とコンピューターの相互作用にどのような影響を与えますか?生成 AI は RPA と人間とコンピューターのインタラクションをどのように変えるのでしょうか?詳細については、次の記事をご覧ください: 大規模モデルの時代が到来し、LLM に基づく生成 AI が RPA の人間とコンピューターのインタラクションを急速に変革しています。生成 AI は人間とコンピューターのインタラクションを再定義し、LLM は RPA ソフトウェア アーキテクチャの変化に影響を与えています。 RPA がプログラム開発と自動化にどのような貢献をしているかを尋ねると、答えの 1 つは人間とコンピューターの相互作用 (HCI、h) を変えたことです。

Plaud、NotePin AI ウェアラブル レコーダーを 169 ドルで発売

Aug 29, 2024 pm 02:37 PM

Plaud、NotePin AI ウェアラブル レコーダーを 169 ドルで発売

Aug 29, 2024 pm 02:37 PM

Plaud Note AI ボイスレコーダー (Amazon で 159 ドルで購入可能) を開発した企業 Plaud が新製品を発表しました。 NotePin と呼ばれるこのデバイスは AI メモリ カプセルとして説明されており、Humane AI Pin と同様にウェアラブルです。ノートピンは

GenAI および LLM の技術面接に関する 7 つのクールな質問

Jun 07, 2024 am 10:06 AM

GenAI および LLM の技術面接に関する 7 つのクールな質問

Jun 07, 2024 am 10:06 AM

AIGC について詳しくは、51CTOAI.x コミュニティ https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou を参照してください。これらの質問は、インターネット上のどこでも見られる従来の質問バンクとは異なります。既成概念にとらわれずに考える必要があります。大規模言語モデル (LLM) は、データ サイエンス、生成人工知能 (GenAI)、および人工知能の分野でますます重要になっています。これらの複雑なアルゴリズムは人間のスキルを向上させ、多くの業界で効率とイノベーションを推進し、企業が競争力を維持するための鍵となります。 LLM は、自然言語処理、テキスト生成、音声認識、推奨システムなどの分野で幅広い用途に使用できます。 LLM は大量のデータから学習することでテキストを生成できます。

ナレッジグラフ検索用に強化された GraphRAG (Neo4j コードに基づいて実装)

Jun 12, 2024 am 10:32 AM

ナレッジグラフ検索用に強化された GraphRAG (Neo4j コードに基づいて実装)

Jun 12, 2024 am 10:32 AM

Graph Retrieval Enhanced Generation (GraphRAG) は徐々に普及しており、従来のベクトル検索方法を強力に補完するものとなっています。この方法では、グラフ データベースの構造的特徴を利用してデータをノードと関係の形式で編成し、それによって取得された情報の深さと文脈の関連性が強化されます。グラフには、相互に関連する多様な情報を表現および保存するという自然な利点があり、異なるデータ型間の複雑な関係やプロパティを簡単に把握できます。ベクトル データベースはこの種の構造化情報を処理できず、高次元ベクトルで表される非構造化データの処理に重点を置いています。 RAG アプリケーションでは、構造化グラフ データと非構造化テキスト ベクトル検索を組み合わせることで、両方の利点を同時に享受できます。これについてこの記事で説明します。構造

FAISS ベクトル空間を視覚化し、RAG パラメータを調整して結果の精度を向上させます

Mar 01, 2024 pm 09:16 PM

FAISS ベクトル空間を視覚化し、RAG パラメータを調整して結果の精度を向上させます

Mar 01, 2024 pm 09:16 PM

オープンソースの大規模言語モデルのパフォーマンスが向上し続けるにつれて、コードの作成と分析、推奨事項、テキストの要約、および質問と回答 (QA) ペアのパフォーマンスがすべて向上しました。しかし、QA に関しては、LLM はトレーニングされていないデータに関連する問題に対応していないことが多く、多くの内部文書はコンプライアンス、企業秘密、またはプライバシーを確保するために社内に保管されています。これらの文書がクエリされると、LLM は幻覚を起こし、無関係なコンテンツ、捏造されたコンテンツ、または矛盾したコンテンツを生成する可能性があります。この課題に対処するために考えられる手法の 1 つは、検索拡張生成 (RAG) です。これには、生成の品質と精度を向上させるために、トレーニング データ ソースを超えた信頼できるナレッジ ベースを参照して応答を強化するプロセスが含まれます。 RAG システムには、コーパスから関連する文書断片を取得するための検索システムが含まれています。