sphinx 源码阅读之 分词,压缩索引,倒排

前言 sphinx 在创建索引前需要做下面几件事:有数据源(pSource),有分词器(pTokenizer),有停止词Stopword 和 字典(pDict),索引引擎。 我们假设 数据源是 mysql, 分词器是 utf8 分词器。 索引前背景介绍 第一步是准备数据源。 这里采用 mysql 数据源。 mysq

前言

sphinx 在创建索引前需要做下面几件事:有数据源(pSource),有分词器(pTokenizer),有停止词Stopword 和 字典(pDict),索引引擎。

我们假设 数据源是 mysql, 分词器是 utf8 分词器。

索引前背景介绍

第一步是准备数据源。

这里采用 mysql 数据源。

mysql 数据的特点是一行一个记录。

每个记录有相同的字段。

每个字段可能代表数字,字符串,时间,二进制等信息,我们都可以按字符串处理即可。

<code>//数据源 CSphSource_MySQL * pSrcMySQL = new CSphSource_MySQL (); CSphSource * pSource = pSrcMySQL; </code>

第二步准备分词器和字典。

这里不多说分词器,以后会专门写一篇记录来讲解分词器。

分词器依靠字典,可以把一个字符串分割为一些词语(word)。

然后根据这些词语,我们可以把mysql的每条记录每个字段都分割为若干词语,这里成为分词。

分割后这个分词需要保留几个信息:什么分词,属于哪个记录,属于哪个字段,在字段中的位置。

分词我们会hash (crc32) 成一个数字,冲突了就当做一个词了。

记录标示就是用自增整数ID.

字段一般不会很多,我们假设最多255个,使用8位可以表示。

字段的位置不确定,但是一个字段的内容也不会很多,我们用24位表示足够了。

所以哪个字段和字段的哪个位置就可以用一个32位整数代替了。

这样一个分词就可以用三个整数

<code>//分词器 pTokenizer = sphCreateUTF8Tokenizer (); pSource->SetTokenizer ( pTokenizer ); //字典 CSphDict_CRC32 * pDict = new CSphDict_CRC32 ( iMorph ); pSource->SetDict ( pDict ); </code>

一个分词称为一个hit, 数据结构如下

<code>struct CSphWordHit {

DWORD m_iDocID; //文档ID, 唯一代表一个记录

DWORD m_iWordID; //单词ID, 对单词的hash值,可以理解为唯一标示

DWORD m_iWordPos; //储存两个信息:字段位置(高8位)和分词的位置(低24位)

};

</code>我们一条记录一条记录的把所有的记录都分词了,就得到一个分词列表了。

由于这个列表很大,我们需要分成多块储存,这里假设最多16块吧。

对于每块,储存前先排序一下,这样我们就得到 16 个 有序的数组了。

然后我们就可以创建索引了。

<code>//索引 CSphIndex * pIndex = sphCreateIndexPhrase ( sIndexPath ); //开始创建索引 pIndex->Build ( pDict, pSource, iMemLimit ) </code>

其中 一切准备完毕后进入 Build 函数。

build 函数创建搜索

进入 build 函数后先准备内容。

在执行 build 函数时 ,先逐条读取记录,然后对每条记录的每个字段会进行分词(Next函数),存在 hit 数据结构中。

而且会把 hit 数据按指定块大小排序后压缩储存在 *.spr 文件中。

块信息储存在 bins 数组中,块数最多16块, 块数用 iRawBlocks 表示。

接下来就是关键的创建压缩索引了。

首先创建索引对象。

<code>cidxCreate() //打开索引文件,先写入 m_tHeader 信息 和 cidxPagesDir 信息。 fdIndex = new CSphWriter_VLN ( ".spi" ); fdIndex->PutRawBytes ( &m_tHeader, sizeof(m_tHeader) ); //cidxPagesDir 数组全是 -1 fdIndex->PutBytes ( cidxPagesDir, sizeof(cidxPagesDir) ); //打开压缩数据文件,先写入一个开始符 bDummy fdData = new CSphWriter_VLN ( ".spd" ); BYTE bDummy = 1; fdData->PutBytes ( &bDummy, 1 ); </code>

外部排序

现在我们的背景是有16个已经排序的数据存在磁盘上。

由于数据量很大,我们不能一次性全部读进来。

我们的目标是依次挑出最小的hit,然后交给索引引擎处理。

sphinx 使用了 CSphHitQueue 这个数据结构。

CSphHitQueue 你猜是什么? 队列? 恭喜你,猜错了。

CSphHitQueue 是一个最小堆。

且 堆的最大个数是 iRawBlocks。

由于 iRawBlocks 个 hits 数组已经排序,所以我们只需要得到 已排序的hits数组的第一个元素,就可以用堆得到最小的那个元素了。

然后我们把最小的这个元素建索引压缩储存,删除最小元素,并取出最小元素所在 hits数组中下一个元素,扔到堆中。

这样就可以从小到大取出所有的元素,并逐个建立索引压缩储存了。

这段话看不懂的话,可以看下面的图。

创建索引压缩储存

其中创建索引压缩储存主要依靠这个函数

<code>cidxHit ( tQueue.m_pData ); </code>

其中 tQueue.m_pData 的数据结构如下

<code>/// fat hit, which is actually stored in VLN index

struct CSphFatHit{

DWORD m_iDocID; ///</code>hit 是先按 m_iWordID 排序, 相等了再按 m_iDocID 排序, 最后才按 m_iWordPos 排序的。

现在我们先不考虑上面的堆,我们假设所有的 hit 已经在一个数组中了,且按上面的规则排序了。

现在我们想做的是对这个 hit 数组创建索引,并压缩储存。

我们现在来看看这个久等的代码吧。

<code>void CSphIndex_VLN::cidxHit ( CSphFatHit * hit ){

// next word

if ( m_tLastHit.m_iWordID!=hit->m_iWordID ){

// close prev hitlist, if any

if ( m_tLastHit.m_iWordPos ){

fdData->ZipInt ( 0 );

m_tLastHit.m_iWordPos = 0;

}

// flush prev doclist, if any

if ( m_dDoclist.GetLength() ){

// finish writing wordlist entry

fdIndex->ZipOffset ( fdData->m_iPos - m_iLastDoclistPos );

fdIndex->ZipInt ( m_iLastWordDocs );

fdIndex->ZipInt ( m_iLastWordHits );

m_iLastDoclistPos = fdData->m_iPos;

m_iLastWordDocs = 0;

m_iLastWordHits = 0;

// write doclist

fdData->ZipOffsets ( &m_dDoclist );

fdData->ZipInt ( 0 );

m_dDoclist.Reset ();

// restart doclist deltas

m_tLastHit.m_iDocID = 0;

m_iLastHitlistPos = 0;

}

if ( !hit->m_iWordPos ){

fdIndex->ZipInt ( 0 );

return;

}

DWORD iPageID = hit->m_iWordID >> SPH_CLOG_BITS_PAGE;

if ( m_iLastPageID!=iPageID ){

// close wordlist

fdIndex->ZipInt ( 0 );

m_tLastHit.m_iWordID = 0;

m_iLastDoclistPos = 0;

// next map page

m_iLastPageID = iPageID;

cidxPagesDir [ iPageID ] = fdIndex->m_iPos;

}

fdIndex->ZipInt ( hit->m_iWordID - m_tLastHit.m_iWordID );

m_tLastHit.m_iWordID = hit->m_iWordID;

}

// next doc

if ( m_tLastHit.m_iDocID!=hit->m_iDocID ){

if ( m_tLastHit.m_iWordPos ){

fdData->ZipInt ( 0 );

m_tLastHit.m_iWordPos = 0;

}

m_dDoclist.Add ( hit->m_iDocID - m_tLastHit.m_iDocID );

m_dDoclist.Add ( hit->m_iGroupID ); // R&D: maybe some delta-coding would help here too

m_dDoclist.Add ( hit->m_iTimestamp );

m_dDoclist.Add ( fdData->m_iPos - m_iLastHitlistPos );

m_tLastHit.m_iDocID = hit->m_iDocID;

m_iLastHitlistPos = fdData->m_iPos;

// update per-word stats

m_iLastWordDocs++;

}

// the hit

// add hit delta

fdData->ZipInt ( hit->m_iWordPos - m_tLastHit.m_iWordPos );

m_tLastHit.m_iWordPos = hit->m_iWordPos;

m_iLastWordHits++;

}

</code>上面的代码主要做了这个几件事。

第一,根据 m_iWordID 将分词分为 2014 块。

并使用 cidxPagesDir 记录块的偏移量(还记得索引文件第二个写入的数据吗)。

第二,对于每一块,我们按分词分组,并在索引文件 spi 中储存每个词组的信息。

具体储存的信息如下

- 和上一个分词(wordID)的偏差

- 这个分词组在 spd 文件内的长度

- 这个分词记录的变化次数

- 这个分词的 hit 数量

第三,对于每个hit,我们存两部分信息。

- 位置(pos)偏移量信息

- 文档(docId)偏移量的信息

上面的三部分信息都储存后,我们就可以快速的解析出来。

模拟索引数据与还原数据

比如对于下面的数据

| wordId | docId | pos |

|---|---|---|

| 1 | 1 | 2 |

| 1 | 1 | 3 |

| 1 | 2 | 3 |

| 1 | 3 | 4 |

| 2 | 1 | 1 |

在 spd 文件中,我们可以得到下面的序列

<code>2 1 0 3 0 4 0 1 1 1 0 1 1 1 3 1 1 1 2 0 1 </code>

其中 2 1 0 3 0 4 0 我们很容易看出来。

当 wordId 和 docId 不变时,每条 hit 会储存一个 pos 的偏差。

当 wordId 不变, docId 改变时,我们会先储存一个0, 然后偏差重新开始计算。

当 wordId 改变时, 把存在 m_dDoclist 中的关于 docId 变化的信息储存起来。

一个变化储存四条元信息:docId 变化偏差, m_iGroupID,m_iTimestamp, spi 文件内的偏差。

在 spi 文件中,我们可以得到下面的序列

<code>1 7 3 4 1 </code>

这里的代码实际上也分为两部分。

第一部分是 wordId 的偏差。 然后三个元信息是这个 wordId 的信息, 上面已经提过了,这里就不说了

依次扫面这个 2 1 0 3 0 4 0, 我们可以恢复 pos 字段 2 3 3 4.

而且 2 3 的 wordId 和 docID 相同。

| wordId | docId | pos |

|---|---|---|

| 2 | ||

| 3 | ||

| 3 | ||

| 4 |

根据 索引信息 1 7 3 4 得到这样的信息: wordId 偏移1,长度偏移数7 ,记录变化数3, hit数4.

于是先决定前四个 wordId。

| wordId | docId | pos |

|---|---|---|

| 1 | 2 | |

| 1 | 3 | |

| 1 | 3 | |

| 1 | 4 |

长度偏移数7 信息可以知道接下来的数据就是数据的第二部分了。

又由于之前遇到 3 个0, 所以有三组数据:, ,

根据 我们可以知道前两个 docId 了。

| wordId | docId | pos |

|---|---|---|

| 1 | 1 | 2 |

| 1 | 1 | 3 |

| 1 | 3 | |

| 1 | 4 |

然后根据 可以知道第三个 docId。 偏移为1, 加上上个 docId 的值,就是 docId = 2 了。

| wordId | docId | pos |

|---|---|---|

| 1 | 1 | 2 |

| 1 | 1 | 3 |

| 1 | 2 | 3 |

| 1 | 4 |

最后就是 决定第四个 docId 是 3 了。

| wordId | docId | pos |

|---|---|---|

| 1 | 1 | 2 |

| 1 | 1 | 3 |

| 1 | 2 | 3 |

| 1 | 3 | 4 |

看到这里,大家发现最后一个信息没有储存或者储存不完整,也不能解析出来。

所以在最后 sphinx 会调用 一个 下面的代码

<code>//加入结束符 CSphFatHit tFlush; tFlush.m_iDocID = 0; tFlush.m_iGroupID = 0; tFlush.m_iWordID = 0; tFlush.m_iWordPos =0; cidxHit ( &tFlush ); //填充 m_tHeader 和 cidxPagesDir 信息。 cidxDone (); </code>

然后我们实际的输出时这个样子:

<code>data: 2 1 0 3 0 4 0 1 1 1 0 1 1 1 3 1 1 1 2 0 1 0 1 1 1 20 0 index: 1 7 3 4 1 15 1 1 0 </code>

接着上面的输出就是 索引是 0 1 0 1 1 1 20, 数据时 1 15 1 1.

0 是 分词的间隔,所以从第二个开始。

决定 了 pos 值为 1.

决定了 wordId 值为 1 + 1 = 2.

决定了 docId 值为 1.

| wordId | docId | pos |

|---|---|---|

| 1 | 1 | 2 |

| 1 | 1 | 3 |

| 1 | 2 | 3 |

| 1 | 3 | 4 |

| 2 | 1 | 1 |

最后还有一个0.

决定了解析索引结束。

| wordId | docId | pos |

|---|---|---|

| 1 | 1 | 2 |

| 1 | 1 | 3 |

| 1 | 2 | 3 |

| 1 | 3 | 4 |

| 2 | 1 | 1 |

| 0 | 0 | 0 |

测试代码可以参考这里 .

推理 - 搜索信息

假设我们又上面的压缩的信息了。

我们要搜索一个词时,会如何工作呢?

假设我们已经得到这个词的 wordId 了,只需要二分一下,就可以再 O(log(1024)) 的时间内得到 wordId 在那个块内。

找到一个块内,出现一个问题,我们不能再次二分查找来找到对应的分词列表。 因为这个 index 储存的是和上一个分词的相对偏移量,那只好全部读入内存,扫描一遍对偏移量求和,然后才能找到对应的词。

这个过程中我们进行了两次 IO 操作。

第一次读取块列表信息 cidxPagesDir。

第二次读取选中的那一块的所有数据。

虽然储存偏移量节省了一些磁盘储存,但是却是用扫描整块数据为代价的。我们本来可以直接二分整块数据的。

不管怎样,我们在索引中找到了需要查找的那个分词的位置。

然后我们可以在数据文件内读取对应的信息,然后得到对应记录的id了。

当然,上面这个只是我的推理,下面我们来看看 sphinx 是怎么搜索的吧。

sphinx 搜索方法

看 sphinx 的搜索方法,只需要看 CSphIndex_VLN 的 QueryEx 函数即可。

首先对查询的语句进行分词,然后读取索引头 m_tHeader, 读取分块信息 cidxPagesDir。

然后就对分词进行搜索了。

为了防止相同的分词重复查找,这里采用二层循环,先来判断这个分词之前是否搜索过,搜索过就记下搜索过的那个词的位置。

没搜索过,就搜索。

核心代码

<code>// lookup this wordlist page

// offset might be -1 if page is totally empty

SphOffset_t iWordlistOffset = cidxPagesDir [ qwords[i].m_iWordID >> SPH_CLOG_BITS_PAGE ];

if ( iWordlistOffset>0 ){

// set doclist files

qwords[i].m_rdDoclist.SetFile ( tDoclist.m_iFD );

qwords[i].m_rdHitlist.SetFile ( tDoclist.m_iFD );

// read wordlist

rdIndex.SeekTo ( iWordlistOffset );

// restart delta decoding

wordID = 0;

SphOffset_t iDoclistOffset = 0;

for ( ;; ){

// unpack next word ID

DWORD iDeltaWord = rdIndex.UnzipInt();

if ( !iDeltaWord ) break;// wordlist chunk is over

wordID += iDeltaWord;

// unpack next offset

SphOffset_t iDeltaOffset = rdIndex.UnzipOffset ();

iDoclistOffset += iDeltaOffset;

assert ( iDeltaOffset );

// unpack doc/hit count

int iDocs = rdIndex.UnzipInt ();

int iHits = rdIndex.UnzipInt ();

assert ( iDocs );

assert ( iHits );

// break on match or list end

if ( wordID>=qwords[i].m_iWordID ){

if ( wordID==qwords[i].m_iWordID ){

qwords[i].m_rdDoclist.SeekTo ( iDoclistOffset );

qwords[i].m_iDocs = iDocs;

qwords[i].m_iHits = iHits;

}

break;

}

}

}

</code>看了这个代码,和我想的有点出入,但是总体思路还是一样的。

它是把所有的 cidxPagesDir 全储存起来了,这样直接定位到指定的位置了。少了一个二分搜索。

定位到某个块之后, 果然采用暴力循环来一个一个的增加偏移,然后查找对应的分词。

找到了记录对应的位置的四大元信息。

再然后由于数据量已经很小了,就把匹配的数据取出来即可。

当然,取数据的时候会进行布尔操作,而且会加上权值计算,这样就搜索满足条件的前若干条了。

原文地址:sphinx 源码阅读之 分词,压缩索引,倒排, 感谢原作者分享。

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7652

7652

15

15

1393

1393

52

52

91

91

11

11

73

73

19

19

37

37

110

110

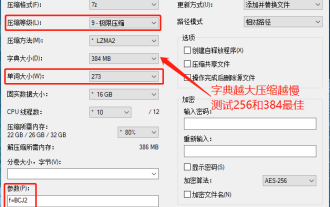

7-zip 최대 압축률 설정, 7zip을 최소로 압축하는 방법

Jun 18, 2024 pm 06:12 PM

7-zip 최대 압축률 설정, 7zip을 최소로 압축하는 방법

Jun 18, 2024 pm 06:12 PM

특정 다운로드 사이트에서 다운로드한 압축 패키지는 압축을 푼 후 원본 압축 패키지보다 용량이 더 커지는 것을 확인했습니다. 그 차이는 수십 Kb, 수십 Mb 정도입니다. 클라우드 디스크나 유료 공간에 업로드해도 상관없습니다. 파일이 작을 경우, 파일이 많을 경우 저장 비용이 크게 증가합니다. 나는 그것에 대해 약간의 조사를 했으며 필요하다면 배울 수 있습니다. 압축 수준: 9급 압축 사전 크기: 256 또는 384, 사전을 많이 압축할수록 속도가 느려집니다. 256MB 이전에는 압축률 차이가 더 크고, 384MB 이후에는 압축률 차이가 없습니다. 단어 크기: 최대 273 매개변수: f=BCJ2, 테스트 및 추가 매개변수 압축률이 높아집니다.

Oracle 인덱스 유형은 무엇입니까?

Nov 16, 2023 am 09:59 AM

Oracle 인덱스 유형은 무엇입니까?

Nov 16, 2023 am 09:59 AM

Oracle 인덱스 유형은 다음과 같습니다. 1. B-트리 인덱스, 3. 함수 인덱스, 5. 역방향 키 인덱스, 7. 도메인 인덱스, 비트맵 연결 인덱스 10. 복합 인덱스. 세부 소개: 1. B-트리 인덱스는 동시 작업을 효율적으로 지원할 수 있는 자체 균형 트리 데이터 구조입니다. Oracle 데이터베이스에서 B-트리 인덱스는 가장 일반적으로 사용되는 인덱스 유형입니다. 2. 비트 그래프 인덱스는 인덱스 유형 기반입니다. 비트맵 알고리즘 등에 관한 것입니다.

win10 화면 녹화 파일 크기를 줄이는 팁

Jan 04, 2024 pm 12:05 PM

win10 화면 녹화 파일 크기를 줄이는 팁

Jan 04, 2024 pm 12:05 PM

많은 친구들이 업무를 위해 화면을 녹화하거나 파일을 전송해야 하는데 때로는 파일이 너무 커서 문제가 많이 발생하는 경우가 있습니다. 다음은 너무 큰 파일의 문제에 대한 해결 방법을 살펴보겠습니다. win10 화면 녹화 파일이 너무 큰 경우 수행할 작업: 1. 소프트웨어 Format Factory를 다운로드하여 파일을 압축합니다. 다운로드 주소 >> 2. 메인 페이지에 들어가서 "Video-MP4" 옵션을 클릭하세요. 3. 변환 형식 페이지에서 "파일 추가"를 클릭하고 압축할 MP4 파일을 선택하세요. 4. 페이지에서 "출력 구성"을 클릭하여 출력 품질에 따라 파일을 압축합니다. 5. 드롭다운 구성 목록에서 "낮은 품질 및 크기"를 선택하고 "확인"을 클릭합니다. 6. "확인"을 클릭하면 비디오 파일 가져오기가 완료됩니다. 7. "시작"을 클릭하여 변환을 시작하세요. 8. 완료 후 다음을 수행할 수 있습니다.

몰입형 리더와 함께 Microsoft Reader Coach를 사용하는 방법

Mar 09, 2024 am 09:34 AM

몰입형 리더와 함께 Microsoft Reader Coach를 사용하는 방법

Mar 09, 2024 am 09:34 AM

이 기사에서는 Windows PC의 몰입형 리더에서 Microsoft Reading Coach를 사용하는 방법을 보여줍니다. 읽기 지도 기능은 학생이나 개인이 읽기를 연습하고 읽고 쓰는 능력을 개발하는 데 도움이 됩니다. 지원되는 애플리케이션에서 구절이나 문서를 읽는 것부터 시작하고, 이를 기반으로 Reading Coach 도구를 통해 읽기 보고서가 생성됩니다. 읽기 보고서에는 읽기 정확도, 읽는 데 걸린 시간, 분당 올바른 단어 수, 읽으면서 가장 어려웠던 단어가 표시됩니다. 또한 단어를 연습할 수 있어 전반적인 읽기 능력을 개발하는 데 도움이 됩니다. 현재 Office 또는 Microsoft365(웹용 OneNote 및 We용 Word 포함)만

PHP 코드의 소스 코드를 해석 및 실행하지 않고 브라우저에 표시하는 방법은 무엇입니까?

Mar 11, 2024 am 10:54 AM

PHP 코드의 소스 코드를 해석 및 실행하지 않고 브라우저에 표시하는 방법은 무엇입니까?

Mar 11, 2024 am 10:54 AM

PHP 코드의 소스 코드를 해석 및 실행하지 않고 브라우저에 표시하는 방법은 무엇입니까? PHP는 동적 웹 페이지를 개발하는 데 일반적으로 사용되는 서버 측 스크립팅 언어입니다. 서버에서 PHP 파일이 요청되면 서버는 그 안에 있는 PHP 코드를 해석하고 실행한 후 최종 HTML 콘텐츠를 브라우저에 보내 표시합니다. 그러나 때때로 PHP 파일의 소스 코드를 실행하는 대신 브라우저에 직접 표시하고 싶을 때가 있습니다. 이 기사에서는 PHP 코드의 소스 코드를 해석 및 실행하지 않고 브라우저에 표시하는 방법을 소개합니다. PHP에서는 다음을 사용할 수 있습니다.

폴더를 압축하여 wps로 보내는 방법

Mar 20, 2024 pm 12:58 PM

폴더를 압축하여 wps로 보내는 방법

Mar 20, 2024 pm 12:58 PM

직장인들은 직장에서 wps 소프트웨어를 매우 자주 사용합니다. 때로는 하루에 여러 개의 파일을 입력한 후 리더나 지정된 위치로 보냅니다. 그렇다면 wps 소프트웨어는 어떻게 폴더를 압축하고 패키지로 보내야 할까요? . 이 작업 단계. 먼저 보내려는 파일과 폴더를 동일한 폴더에 정리하세요. 파일이 많은 경우에는 보낼 때 쉽게 식별할 수 있도록 각 파일의 이름을 지정하는 것이 좋습니다. 두 번째 단계에서는 이번에는 이 큰 폴더를 클릭한 다음 마우스 오른쪽 버튼을 클릭합니다. "아카이브에 추가"를 선택하십시오. 3단계: 이제 소프트웨어가 자동으로 파일을 패키지하는 데 도움을 줍니다. "XX.zip으로 압축"을 선택한 다음 지금 압축을 클릭하세요.

![[Python NLTK] 튜토리얼: 자연어 처리를 쉽게 시작하고 재미있게 즐겨보세요.](https://img.php.cn/upload/article/000/465/014/170882721469561.jpg?x-oss-process=image/resize,m_fill,h_207,w_330) [Python NLTK] 튜토리얼: 자연어 처리를 쉽게 시작하고 재미있게 즐겨보세요.

Feb 25, 2024 am 10:13 AM

[Python NLTK] 튜토리얼: 자연어 처리를 쉽게 시작하고 재미있게 즐겨보세요.

Feb 25, 2024 am 10:13 AM

1. NLTK 소개 NLTK는 Steven Bird와 Edward Loper가 2001년에 만든 Python 프로그래밍 언어용 자연어 처리 도구 키트입니다. NLTK는 텍스트 전처리, 단어 분할, 품사 태깅, 구문 분석, 의미 분석 등 광범위한 텍스트 처리 도구를 제공하여 개발자가 자연어 데이터를 쉽게 처리하는 데 도움을 줍니다. 2.NLTK 설치 NLTK는 다음 명령을 통해 설치할 수 있습니다: fromnltk.tokenizeimportWord_tokenizetext="Hello, world!Thisisasampletext."tokens=word_tokenize(te

소스 코드를 온라인으로 볼 수 있는 웹사이트

Jan 10, 2024 pm 03:31 PM

소스 코드를 온라인으로 볼 수 있는 웹사이트

Jan 10, 2024 pm 03:31 PM

브라우저의 개발자 도구를 사용하여 웹사이트의 소스 코드를 볼 수 있습니다. Google Chrome 브라우저에서: 1. Chrome 브라우저를 열고 소스 코드를 보려는 웹사이트를 방문합니다. 2. 웹의 아무 곳이나 마우스 오른쪽 버튼으로 클릭합니다. 페이지에서 "검사"를 선택하거나 단축키 Ctrl + Shift + I를 눌러 개발자 도구를 엽니다. 3. 개발자 도구의 상단 메뉴 표시줄에서 "요소" 탭을 선택합니다. 4. HTML 및 CSS 코드를 확인합니다. 웹사이트의.