200개 이상의 관련 연구를 집대성한 대형 모델 '평생 학습'의 최신 리뷰는 여기

AIxiv 칼럼은 본 사이트에 학술적, 기술적인 내용을 게재하는 칼럼입니다. 지난 몇 년 동안 이 사이트의 AIxiv 칼럼에는 전 세계 주요 대학 및 기업의 최고 연구실을 대상으로 한 2,000개 이상의 보고서가 접수되어 학술 교류 및 보급을 효과적으로 촉진하고 있습니다. 공유하고 싶은 훌륭한 작품이 있다면 자유롭게 기여하거나 보고를 위해 연락주시기 바랍니다. 제출 이메일: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com

논문 제목: 대형 언어 모델의 평생 학습을 향하여: 설문조사 기관: 중국 남부 공과대학 대학 논문 주소: https://arxiv.org/abs/2406.06391 프로젝트 주소: https://github .com/ qianlima-lab/awesome-lifelong-learning-methods-for-llm

소설 분류: 소개 평생 학습에 관한 광범위한 문헌을 12가지 시나리오로 나누는 상세한 구조적 프레임워크가 개발되었습니다. 보편적 기법: 모든 평생 학습 상황에 대한 공통 기법이 식별되어 존재합니다. 각 시나리오의 기술 그룹 향후 방향: LLM 이전 시대에는 덜 탐구되었던 모델 확장 및 데이터 선택과 같은 일부 새로운 기술에 중점을 둡니다.

내부 지식은 지속적인 사전 훈련 및 지속적인 미세 조정을 포함한 전체 또는 부분 훈련을 통해 모델 매개변수에 새로운 지식을 흡수하는 것을 의미합니다. -

외부 지식이란 검색 기반 평생학습, 평생학습 도구 등 모델 매개변수를 업데이트하지 않고 위키피디아나 응용 프로그램 인터페이스 등 외부 리소스의 새로운 지식을 모델에 통합하는 것을 말합니다.

- 지속적인 수직 도메인 사전 훈련: 특정 수직 분야(예: 금융, 의료 등)용.

- 지속적 언어 영역 사전 학습: 자연어 및 코드 언어에 대한 지속적인 사전 학습입니다.

- 지속적인 시간 영역 사전 학습: 시간 관련 데이터(예: 시계열 데이터)에 대한 지속적인 사전 학습입니다.

- 특정 작업:

- 지속적인 텍스트 분류: 텍스트 분류 작업을 위한 지속적인 미세 조정입니다.

- 지속적인 명명된 엔터티 인식: 명명된 엔터티 인식 작업을 위한 지속적인 미세 조정입니다.

- 지속적 관계 추출: 관계 추출 작업을 위한 지속적인 미세 조정입니다.

- 지속적인 기계 번역: 기계 번역 작업을 위한 지속적인 미세 조정입니다.

- 작업 불가지론:

- 지속적인 학습 조정: 모델의 지속적인 학습은 학습 미세 조정을 통해 이루어집니다.

- 지속적인 지식 편집: 지식 업데이트를 위한 지속적인 학습입니다.

- 지속적 정렬: 새로운 작업에 모델을 정렬하기 위한 지속적인 학습입니다.

- 전체 측정: 평균 정확도(AA) 및 평균 포함 증분 정확도(AIA). AA는 모든 작업을 학습한 후 모델의 평균 성능을 의미하고, AIA는 각 작업을 학습한 후 과거 변화를 고려합니다.

- 안정성 측정: FGT(망각 측정) 및 BWT(역방향 전송) 포함. FGT는 이전 작업의 평균 성능 저하를 평가하고, BWT는 이전 작업의 평균 성능 변화를 평가합니다.

- 가소성 측정: 새로운 작업에 대한 모델 성능의 평균 향상인 순방향 전달(FWD)을 포함합니다.

의미: 이 방법은 새 작업을 훈련할 때 사용됩니다. 이전 작업의 데이터를 재생하여 모델의 오래된 작업 기억. 일반적으로 재생된 데이터는 버퍼에 저장되어 현재 작업의 데이터와 함께 학습에 사용됩니다. 주로 다음을 포함합니다:

– 경험 재생: 이전 작업의 데이터 샘플 중 일부를 저장하고 새로운 작업 발생을 훈련할 때 이러한 데이터를 훈련에 재사용하여 망각을 줄입니다.

– 생성적 재생: 이전 데이터를 저장하는 것과 달리 이 방법은 생성 모델을 사용하여 의사 샘플을 생성함으로써 이전 작업에 대한 지식을 새 작업 학습에 도입합니다.

그림 3은 Task t-1에서 Task t까지의 과정을 보여줍니다. , 버퍼에 있는 이전 데이터(입력 t-1 )가 사용됩니다.

- 의미: 이 방법은 모델 매개변수에 정규화 제약 조건을 적용하여 새 작업을 학습할 때 모델이 이전 작업 매개변수를 과도하게 조정하는 것을 방지합니다. 정규화 제약 조건은 모델이 이전 작업의 메모리를 유지하는 데 도움이 될 수 있습니다. 주로 다음을 포함합니다:

- 그림 3은 Task

t-1에서 Task t까지의 과정을 보여줍니다. , Task t-1의 성능을 유지하기 위해 매개변수 정규화를 사용합니다.

(c) 아키텍처 기반 방법:

- 의미: 이 접근 방식은 이전에 학습한 지식과의 간섭을 최소화하면서 새로운 작업을 원활하게 통합하기 위해 모델 구조를 조정하는 데 중점을 둡니다. 여기에는 주로 그림 4의 6가지 방법이 포함됩니다.

- –(a) 프롬프트 조정: 모델 입력 앞에 "소프트 프롬프트"를 추가하여 모델 생성 또는 분류 작업을 안내합니다. 이 방법은 모델의 백본 구조를 변경하지 않고 소수의 매개변수(예: 프롬프트 단어)만 조정하면 됩니다.

–(b) 접두사 조정: 훈련된 조정 가능한 매개변수를 입력 시퀀스의 접두사 부분에 추가합니다. 이러한 매개변수는 모델이 상황별 정보를 더 잘 캡처하는 데 도움이 되도록 Transformer 레이어의 self-attention 메커니즘에 삽입됩니다.

–(c) Low-Rank Adaptation(LoRA, Low-Rank Adaptation): LoRA는 대형 모델의 주요 가중치를 변경하지 않고 특정 수준에 하위 행렬을 추가하여 새로운 작업에 적응합니다. 이 접근 방식은 모델 성능을 유지하면서 매개변수 조정 횟수를 크게 줄입니다.

–(d) 어댑터: 어댑터는 모델의 여러 레이어 사이에 삽입된 학습 가능한 모듈입니다. 이러한 모듈은 원래 모델 가중치를 변경하지 않고 소수의 추가 매개변수로 적응할 수 있습니다. 일반적으로 FFN(Feed Forward Network) 및 MHA(Multi-Head Attention) 부분에 적용됩니다.

–(e) 전문가 혼합: 모델의 특정 계층 또는 하위 네트워크일 수 있는 특정 "전문가" 모듈을 선택적으로 활성화하여 다양한 입력을 처리합니다. 라우터 모듈은 활성화해야 할 전문가 모듈을 결정하는 역할을 담당합니다.

–(f) 모델 확장: 원본 레이어(Old Layer)를 유지하면서 새 레이어(New Layer)를 추가하여 모델의 용량을 확장합니다. 이 접근 방식을 통해 모델은 보다 복잡한 작업 요구 사항을 수용할 수 있도록 용량을 점진적으로 늘릴 수 있습니다.

그림: 그림 3은 Task t-1에서 Task t까지의 과정을 보여줍니다. 모델이 새로운 작업을 학습하면 일부 매개변수가 동결됩니다. 새로 추가된 모듈은 새로운 작업을 훈련하는 데 사용됩니다(Trainable).

의미: 이 방법은 지식 증류를 통해 이전 모델의 지식을 새 모델로 전달합니다. 새 작업을 훈련할 때 새 모델은 현재 작업의 데이터를 학습할 뿐만 아니라 이전 작업에 대해 이전 모델의 출력을 모방하여 이전 작업에 대한 지식을 유지합니다. 주로 다음을 포함합니다:

그림: 그림 3은 작업 t-1에서 작업 t으로의 전환을 보여줍니다. 프로세스에서 모델이 새로운 작업을 훈련할 때 이전 모델의 예측 결과를 모방하여 이전 작업에 대한 지식을 유지합니다.

예: CorpusBrain++는 백본 어댑터 아키텍처와 경험 재생 전략을 사용하여 실제 지식 집약적인 언어 작업을 처리합니다. 예: Med-PaLM은 소수의 예를 사용하여 의료 분야의 지시 프롬프트 튜닝을 도입합니다.

예: ELLE 기존 사전 학습된 언어 모델의 폭과 깊이를 유연하게 확장하여 지식 획득 및 통합의 효율성을 높이기 위해 기능 보존 모델 확장 전략을 채택합니다. 예: LLaMA Pro는 Transformer 블록을 확장하고 새로운 코퍼스로 미세 조정하여 일반 사용, 프로그래밍 및 수학 작업에 탁월합니다.

-

예: Gupta et al.이 제안한 전략은 새로운 데이터 세트를 도입할 때 학습률을 조정하여 장기 훈련 중에 학습률이 너무 낮아지는 것을 방지함으로써 새로운 데이터 세트에 대한 적응 효과를 향상시킵니다.

예: RHO -1은 훈련 프로세스에 더 큰 영향을 미치는 토큰의 우선순위를 지정하는 SLM(선택적 언어 모델)로 훈련됩니다. 예: EcomGPT-CT는 반구조화된 전자상거래 데이터를 사용하여 도메인별 작업에 대한 모델 성능을 향상합니다.

예: Yadav 등은 교사 강제 메커니즘을 도입하여 새로운 작업에 대한 모델의 미세 조정을 안내하는 프롬프트 세트를 생성하여 프롬프트 조정을 개선합니다. 예: ModuleFormer와 Lifelong-MoE는 전문가 혼합(MoE) 접근 방식을 사용하여 모듈화 및 동적으로 모델 용량 증가를 통해 LLM의 효율성과 적응성을 향상합니다.

-

예: Ibrahim et al.이 제안한 재가열 방법은 새로운 데이터를 훈련할 때 학습 속도를 일시적으로 높여 모델이 새로운 언어에 더 빠르게 적응하도록 돕습니다.

예: 지속적인 텍스트 분류 작업은 변화하는 분류 요구 사항에 적응할 수 있도록 새로운 분류 범주(예: 의도: 전송 -> 의도: 신용 점수 -> 의도: 재미있는 사실)를 점진적으로 도입하여 모델을 교육합니다.

예 : 지속적인 명명된 엔터티 인식 작업은 특정 엔터티를 인식하면서 새로운 엔터티 유형(예: 운동선수 -> 스포츠팀 -> 정치인)을 점진적으로 도입하는 방법을 보여 주므로 모델은 새로운 엔터티 능력을 인식하면서 이전 엔터티에 대한 인식을 계속 유지할 수 있습니다. .

예: 지속적인 관계 추출 작업은 새로운 관계 유형(예: 관계: 설립자 -> 관계: 출생지 또는 도 -> 관계: 본사 국가)을 지속적으로 도입하여 모델이 관계 추출 기능을 점진적으로 확장하는 방법을 보여줍니다.

예: 지속적인 지식 편집 작업을 통해 모델의 지식 기반(예: 미국 대통령은 누구입니까? -> 크리스티아누 호날두가 현재 어느 클럽에서 뛰고 있습니까? -> 지난 겨울은 어디였습니까?)을 지속적으로 업데이트하여 최신 사실에 정확하게 답할 수 있습니다. 올림픽 개최?).

예: 지속적인 기계 번역 작업은 모델의 번역 기능을 다양한 언어(예: 영어 -> 중국어, 영어 -> 스페인어, 영어 -> 프랑스어)로 점진적으로 확장하여 다국어 환경에서 모델의 적응성을 보여줍니다.

예: 지속적인 지침 미세 조정 작업은 새로운 지침 유형(예: 요약 -> 스타일 전송 -> 수학)을 점진적으로 도입하여 여러 작업 유형에서 모델의 성능 능력을 훈련합니다.

예: 연속 정렬 작업은 새로운 정렬 목표(예: 유용하고 무해함 -> 간결하고 조직적 -> 긍정적인 감정)를 도입하여 다양한 도덕적 및 행동 표준 하에서 모델의 지속적인 학습 기능을 보여줍니다.

はじめに: 世界中の情報が増え続ける中、スケールアップと進化過去のデータに基づいてトレーニングされた静的モデルはすぐに古くなり、新しい開発に関するコンテンツを理解したり生成したりできなくなります。検索ベースの生涯学習は、大規模な言語モデルが外部ソースから最新の知識を取得して吸収するという重要なニーズに対応し、モデルは必要に応じてこれらの外部リソースを取得することで知識ベースを補完または更新します。これらの外部リソースは、現在の大規模な知識ベースを提供し、事前トレーニングされた LLM の静的特性を強化するための重要な補完的な資産を提供します。 例: 図内のこれらの外部リソースは、モデルからアクセスおよび取得できます。ウィキペディア、書籍、データベースなどの外部情報ソースにアクセスすることで、モデルは知識を更新し、新しい情報に遭遇したときに適応することができます。

はじめに: ツールベースの生涯学習は、その機能を静的な知識を超えて拡張し、環境と動的に対話できるようにする必要性から生まれました。実際のアプリケーションでは、モデルは多くの場合、直接的なテキストの生成や解釈を超える操作を含むタスクを実行する必要があります。 例: 図のモデルは、これらのツールを使用して自身の機能を拡張および更新し、外部ツールとの対話を通じて生涯学習を可能にします。たとえば、モデルはアプリケーション プログラミング インターフェイスを通じてリアルタイム データを取得したり、物理ツールを通じて外部環境と対話して特定のタスクを完了したり、新しい知識を取得したりできます。

壊滅的な忘却: これは生涯学習の中核的な課題の 1 つであり、新しい情報の導入により上書きされる可能性があります。モデルが以前に学習したこと。 可塑性と安定性のジレンマ: モデルの学習能力と安定性の維持の間のバランスを見つけることが非常に重要であり、これはモデルが新しい知識を保持しながら新しい知識を獲得する能力に直接影響します。幅広い一般的な能力。 高額な計算コスト: 大規模な言語モデルを完全に微調整するための計算要件は非常に高くなる可能性があります。 モデルの重みや事前トレーニングされたデータが利用できない: プライバシー、独自の制限、または商用ライセンスのため、生のトレーニング データやモデルの重みは、さらなる改善のために利用できないことがよくあります。

特定のタスクから一般的なタスクへ: 研究は、特定のタスク (テキスト分類、固有表現認識など) から、命令調整、知識編集などのより広範囲の一般的なタスクに徐々に移行していきます。 完全な微調整から部分的な微調整へ: 完全な微調整、部分的な微調整戦略 (アダプター層、プロンプト チューニング、 LoRA) の人気はますます高まっています。 内部知識から外部知識へ: 頻繁な内部更新の制限を克服するために、検索拡張生成やツールなどの外部知識ソースを使用する戦略が増えています。学習によりモデルが可能になります。現在の外部データに動的にアクセスして活用します。

マルチモーダル生涯学習: テキストを超えた複数のモダリティ (画像、ビデオ、オーディオ、時系列データ、ナレッジ グラフなど) を生涯学習に統合し、より包括的で適応性のある性モデルを開発します。 効率的な生涯学習: 研究者たちは、モデルの枝刈り、モデルの結合、モデルの拡張、その他の方法など、モデルのトレーニングと更新の計算要件を管理するためのより効率的な戦略の開発に取り組んでいます。 普遍的な生涯学習: 最終的な目標は、大規模な言語モデルが、静的なデータセットのみに依存することなく、新しい知識を積極的に獲得し、環境との動的な相互作用を通じて学習できるようにすることです。

위 내용은 200개 이상의 관련 연구를 집대성한 대형 모델 '평생 학습'의 최신 리뷰는 여기의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7909

7909

15

15

1652

1652

14

14

1411

1411

52

52

1303

1303

25

25

1248

1248

29

29

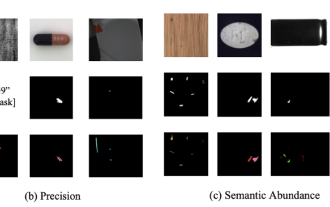

'Defect Spectrum'은 기존 결함 감지의 경계를 뛰어넘어 초고정밀 및 풍부한 의미론적 산업 결함 감지를 최초로 달성합니다.

Jul 26, 2024 pm 05:38 PM

'Defect Spectrum'은 기존 결함 감지의 경계를 뛰어넘어 초고정밀 및 풍부한 의미론적 산업 결함 감지를 최초로 달성합니다.

Jul 26, 2024 pm 05:38 PM

현대 제조업에서 정확한 결함 검출은 제품 품질을 보장하는 열쇠일 뿐만 아니라 생산 효율성을 향상시키는 핵심이기도 합니다. 그러나 기존 결함 감지 데이터세트는 실제 적용에 필요한 정확성과 의미론적 풍부함이 부족한 경우가 많아 모델이 특정 결함 카테고리나 위치를 식별할 수 없게 됩니다. 이 문제를 해결하기 위해 광저우 과학기술대학교와 Simou Technology로 구성된 최고 연구팀은 산업 결함에 대한 상세하고 의미론적으로 풍부한 대규모 주석을 제공하는 "DefectSpectrum" 데이터 세트를 혁신적으로 개발했습니다. 표 1에서 볼 수 있듯이, 다른 산업 데이터 세트와 비교하여 "DefectSpectrum" 데이터 세트는 가장 많은 결함 주석(5438개의 결함 샘플)과 가장 상세한 결함 분류(125개의 결함 카테고리)를 제공합니다.

NVIDIA 대화 모델 ChatQA는 버전 2.0으로 발전했으며 컨텍스트 길이는 128K로 언급되었습니다.

Jul 26, 2024 am 08:40 AM

NVIDIA 대화 모델 ChatQA는 버전 2.0으로 발전했으며 컨텍스트 길이는 128K로 언급되었습니다.

Jul 26, 2024 am 08:40 AM

오픈 LLM 커뮤니티는 백개의 꽃이 피어 경쟁하는 시대입니다. Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 등을 보실 수 있습니다. 훌륭한 연기자. 그러나 GPT-4-Turbo로 대표되는 독점 대형 모델과 비교하면 개방형 모델은 여전히 많은 분야에서 상당한 격차를 보이고 있습니다. 일반 모델 외에도 프로그래밍 및 수학을 위한 DeepSeek-Coder-V2, 시각 언어 작업을 위한 InternVL과 같이 핵심 영역을 전문으로 하는 일부 개방형 모델이 개발되었습니다.

수백만 개의 결정 데이터로 훈련하여 결정학적 위상 문제를 해결하는 딥러닝 방법인 PhAI가 Science에 게재되었습니다.

Aug 08, 2024 pm 09:22 PM

수백만 개의 결정 데이터로 훈련하여 결정학적 위상 문제를 해결하는 딥러닝 방법인 PhAI가 Science에 게재되었습니다.

Aug 08, 2024 pm 09:22 PM

Editor |KX 오늘날까지 단순한 금속부터 큰 막 단백질에 이르기까지 결정학을 통해 결정되는 구조적 세부 사항과 정밀도는 다른 어떤 방법과도 비교할 수 없습니다. 그러나 가장 큰 과제인 소위 위상 문제는 실험적으로 결정된 진폭에서 위상 정보를 검색하는 것입니다. 덴마크 코펜하겐 대학의 연구원들은 결정 위상 문제를 해결하기 위해 PhAI라는 딥러닝 방법을 개발했습니다. 수백만 개의 인공 결정 구조와 그에 상응하는 합성 회절 데이터를 사용하여 훈련된 딥러닝 신경망은 정확한 전자 밀도 맵을 생성할 수 있습니다. 연구는 이 딥러닝 기반의 순순한 구조 솔루션 방법이 단 2옹스트롬의 해상도로 위상 문제를 해결할 수 있음을 보여줍니다. 이는 원자 해상도에서 사용할 수 있는 데이터의 10~20%에 해당하는 반면, 기존의 순순한 계산은

Google AI가 IMO 수학 올림피아드 은메달을 획득하고 수학적 추론 모델 AlphaProof가 출시되었으며 강화 학습이 다시 시작되었습니다.

Jul 26, 2024 pm 02:40 PM

Google AI가 IMO 수학 올림피아드 은메달을 획득하고 수학적 추론 모델 AlphaProof가 출시되었으며 강화 학습이 다시 시작되었습니다.

Jul 26, 2024 pm 02:40 PM

AI의 경우 수학 올림피아드는 더 이상 문제가 되지 않습니다. 목요일에 Google DeepMind의 인공 지능은 AI를 사용하여 올해 국제 수학 올림피아드 IMO의 실제 문제를 해결하는 위업을 달성했으며 금메달 획득에 한 걸음 더 다가섰습니다. 지난 주 막 끝난 IMO 대회에는 대수학, 조합론, 기하학, 수론 등 6개 문제가 출제됐다. 구글이 제안한 하이브리드 AI 시스템은 4문제를 맞혀 28점을 얻어 은메달 수준에 이르렀다. 이달 초 UCLA 종신 교수인 테렌스 타오(Terence Tao)가 상금 100만 달러의 AI 수학 올림피아드(AIMO Progress Award)를 추진했는데, 예상외로 7월 이전에 AI 문제 해결 수준이 이 수준으로 향상됐다. IMO에서 동시에 질문을 해보세요. 가장 정확하게 하기 어려운 것이 IMO인데, 역사도 가장 길고, 규모도 가장 크며, 가장 부정적이기도 합니다.

PRO | MoE 기반의 대형 모델이 더 주목받는 이유는 무엇인가요?

Aug 07, 2024 pm 07:08 PM

PRO | MoE 기반의 대형 모델이 더 주목받는 이유는 무엇인가요?

Aug 07, 2024 pm 07:08 PM

2023년에는 AI의 거의 모든 분야가 전례 없는 속도로 진화하고 있다. 동시에 AI는 구체화된 지능, 자율주행 등 핵심 트랙의 기술적 한계를 지속적으로 확장하고 있다. 멀티모달 추세 하에서 AI 대형 모델의 주류 아키텍처인 Transformer의 상황이 흔들릴까요? MoE(Mixed of Experts) 아키텍처를 기반으로 한 대형 모델 탐색이 업계에서 새로운 트렌드가 된 이유는 무엇입니까? 대형 비전 모델(LVM)이 일반 비전 분야에서 새로운 돌파구가 될 수 있습니까? ...지난 6개월 동안 공개된 본 사이트의 2023 PRO 회원 뉴스레터에서 위 분야의 기술 동향과 산업 변화에 대한 심층 분석을 제공하여 새로운 환경에서 귀하의 목표 달성에 도움이 되는 10가지 특별 해석을 선택했습니다. 년. 준비하세요. 이 해석은 2023년 50주차에 나온 것입니다.

대형 모델에 대한 새로운 과학적이고 복잡한 질문 답변 벤치마크 및 평가 시스템을 제공하기 위해 UNSW, Argonne, University of Chicago 및 기타 기관이 공동으로 SciQAG 프레임워크를 출시했습니다.

Jul 25, 2024 am 06:42 AM

대형 모델에 대한 새로운 과학적이고 복잡한 질문 답변 벤치마크 및 평가 시스템을 제공하기 위해 UNSW, Argonne, University of Chicago 및 기타 기관이 공동으로 SciQAG 프레임워크를 출시했습니다.

Jul 25, 2024 am 06:42 AM

편집자 |ScienceAI 질문 응답(QA) 데이터 세트는 자연어 처리(NLP) 연구를 촉진하는 데 중요한 역할을 합니다. 고품질 QA 데이터 세트는 모델을 미세 조정하는 데 사용될 수 있을 뿐만 아니라 LLM(대형 언어 모델)의 기능, 특히 과학적 지식을 이해하고 추론하는 능력을 효과적으로 평가하는 데에도 사용할 수 있습니다. 현재 의학, 화학, 생물학 및 기타 분야를 포괄하는 과학적인 QA 데이터 세트가 많이 있지만 이러한 데이터 세트에는 여전히 몇 가지 단점이 있습니다. 첫째, 데이터 형식이 비교적 단순하고 대부분이 객관식 질문이므로 평가하기 쉽지만 모델의 답변 선택 범위가 제한되고 모델의 과학적 질문 답변 능력을 완전히 테스트할 수 없습니다. 이에 비해 개방형 Q&A는

정확도는 60.8%에 달합니다. Transformer를 기반으로 한 Zhejiang University의 화학적 역합성 예측 모델은 Nature 저널에 게재되었습니다.

Aug 06, 2024 pm 07:34 PM

정확도는 60.8%에 달합니다. Transformer를 기반으로 한 Zhejiang University의 화학적 역합성 예측 모델은 Nature 저널에 게재되었습니다.

Aug 06, 2024 pm 07:34 PM

Editor | KX 역합성은 약물 발견 및 유기 합성에서 중요한 작업이며, 프로세스 속도를 높이기 위해 AI가 점점 더 많이 사용되고 있습니다. 기존 AI 방식은 성능이 만족스럽지 못하고 다양성이 제한적입니다. 실제로 화학 반응은 종종 반응물과 생성물 사이에 상당한 중복이 발생하는 국지적인 분자 변화를 일으킵니다. 이에 영감을 받아 Zhejiang University의 Hou Tingjun 팀은 단일 단계 역합성 예측을 분자 문자열 편집 작업으로 재정의하고 표적 분자 문자열을 반복적으로 정제하여 전구체 화합물을 생성할 것을 제안했습니다. 그리고 고품질의 다양한 예측이 가능한 편집 기반 역합성 모델 EditRetro를 제안합니다. 광범위한 실험을 통해 이 모델은 표준 벤치마크 데이터 세트 USPTO-50 K에서 60.8%의 상위 1 정확도로 탁월한 성능을 달성하는 것으로 나타났습니다.

자연의 관점: 의학 분야의 인공지능 테스트는 혼란에 빠졌습니다. 어떻게 해야 할까요?

Aug 22, 2024 pm 04:37 PM

자연의 관점: 의학 분야의 인공지능 테스트는 혼란에 빠졌습니다. 어떻게 해야 할까요?

Aug 22, 2024 pm 04:37 PM

Editor | ScienceAI 제한된 임상 데이터를 기반으로 수백 개의 의료 알고리즘이 승인되었습니다. 과학자들은 누가 도구를 테스트해야 하며 최선의 방법은 무엇인지에 대해 토론하고 있습니다. 데빈 싱(Devin Singh)은 응급실에서 오랜 시간 치료를 기다리던 중 심장마비를 겪는 소아환자를 목격했고, 이를 계기로 대기시간을 단축하기 위해 AI 적용을 모색하게 됐다. SickKids 응급실의 분류 데이터를 사용하여 Singh과 동료들은 잠재적인 진단을 제공하고 테스트를 권장하는 일련의 AI 모델을 구축했습니다. 한 연구에 따르면 이러한 모델은 의사 방문 속도를 22.3% 단축하여 의료 검사가 필요한 환자당 결과 처리 속도를 거의 3시간 단축할 수 있는 것으로 나타났습니다. 그러나 인공지능 알고리즘의 연구 성공은 이를 입증할 뿐이다.