커피 한잔 사주세요😄

*메모:

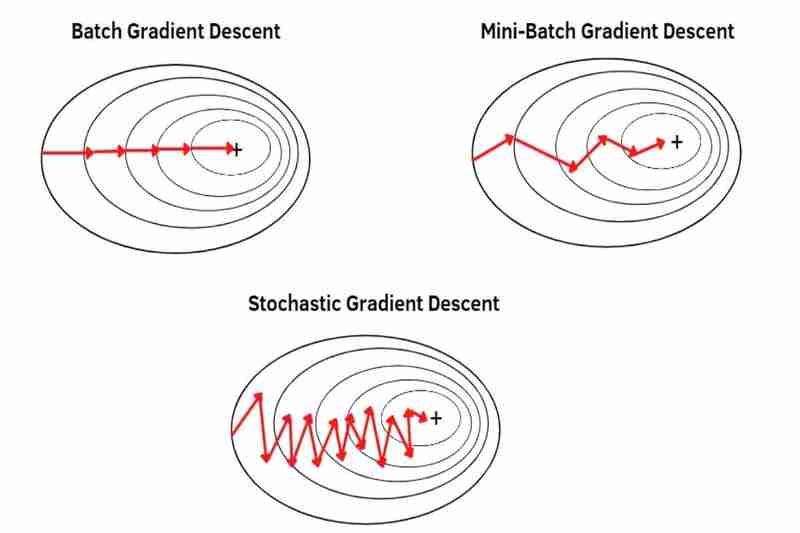

배치 경사하강법(BGD), 미니배치 경사하강법(MBGD), 확률적 경사하강법(SGD)이 있는데 데이터세트에서 데이터를 가져오는 방법으로 경사하강을 수행하는 방법입니다. Adam(), SGD(), RMSprop(), Adadelta(), Adagrad() 등과 같은 최적화 프로그램 파이토치.

*메모:

(1) 배치 경사하강법(BGD):

(2) 미니 배치 경사하강법(MBGD):

전체 데이터 세트에서 분할된 각 소규모 배치의 평균을 사용하므로 각 샘플이 BDG보다 더 눈에 띕니다(더 강조). *전체 데이터 세트를 더 작은 배치로 분할하면 각 샘플이 더욱 눈에 띄게 될 수 있습니다(점점 더 강조됨). 결과적으로 수렴은 BGD보다 덜 안정적이고(더 변동적) BGD보다 잡음(잡음이 많은 데이터)이 덜 강하여 BGD보다 오버슈팅이 더 많이 발생하고 로컬 최소값에 걸리지 않더라도 BGD보다 덜 정확한 모델을 생성하지만 MBGD는 이전에 말했듯이 수렴이 BGD보다 덜 안정적이고(더 변동성이 높음) MBGD가 과적합을 덜 쉽게 유발하기 때문에 BGD보다 로컬 최소점 또는 안장점을 더 쉽게 탈출합니다. 앞서 말했듯 각 샘플이 BGD보다 더 눈에 띄기(더 강조하기) 때문이죠.

의 장점:

의 단점:

(3) 확률적 경사하강법(SGD):

전체 데이터 세트의 모든 단일 샘플 하나의 샘플을 하나의 샘플로 사용하지만 평균은 사용하지 않으므로 각 샘플이 MBGD보다 더 눈에 띕니다(더 강조). 결과적으로 수렴은 MBGD보다 덜 안정적이고(더 변동적) MBGD보다 잡음(잡음이 있는 데이터)이 덜 강하여 MBGD보다 오버슈팅이 더 많이 발생하고 로컬 최소값에 갇히지 않더라도 MBGD보다 덜 정확한 모델을 생성하지만 이전에 말했듯이 SGD는 MBGD보다 수렴이 MBGD보다 덜 안정적이고(더 변동성이 높음) SGD가 과적합을 덜 쉽게 유발하기 때문에 MBGD보다 로컬 최소값 또는 안장점을 더 쉽게 탈출합니다. 앞서 말했듯 MBGD보다 각 샘플이 더 눈에 띄기(더 강조하기) 때문이죠.

의 장점:

의 단점:

위 내용은 배치, 미니 배치 및 확률적 경사하강법의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!