웹 스크래핑 및 외국어 데이터 분석

최근에 저는 빠른 웹 스크래핑 및 데이터 분석 프로젝트를 수행하고 싶다고 결정했습니다. 내 두뇌는 많은 시간이 걸리는 큰 아이디어를 생각해내는 것을 좋아하기 때문에 나는 몇 시간 안에 실행 가능하게 수행할 수 있는 간단한 것을 생각해 내도록 도전하기로 결정했습니다.

제가 생각해낸 내용은 다음과 같습니다.

제 학부 학위가 원래 외국어(프랑스어와 스페인어) 전공이었기 때문에 웹에서 언어 관련 데이터를 스크랩해 보는 것도 재미있겠다는 생각이 들었습니다. 나는 정적 HTML을 구문 분석할 수 있지만 전체 데이터 세트를 표시하기 위해 onclick 이벤트가 필요한 동적 웹 페이지를 처리할 수 없는 BeautifulSoup 라이브러리를 사용하고 싶었습니다(예: 페이지가 페이지가 매겨져 있는 경우 데이터의 다음 페이지 클릭).

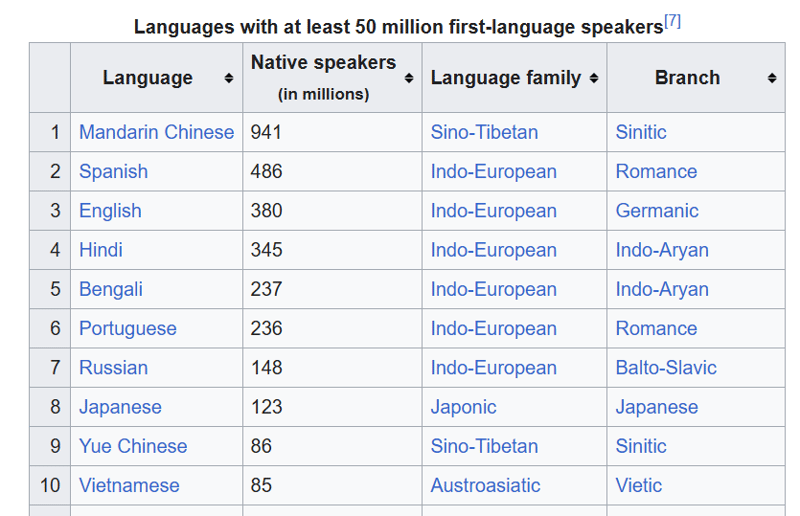

가장 일반적으로 사용되는 언어가 포함된 Wikipedia 페이지를 선택했습니다.

저는 다음을 하고 싶었습니다:

- 페이지의 HTML을 가져와 .txt 파일로 출력

- Beautiful Soup을 사용하여 HTML 파일을 구문 분석하고 테이블 데이터를 추출합니다

- 테이블을 .csv 파일에 쓰기

- 데이터 분석을 사용하여 이 데이터세트에 대해 답변하고 싶은 질문 10개를 생각해 보세요

- Pandas와 Jupyter Notebook을 사용하여 이러한 질문에 답하세요

관심을 분리하기 위해 프로젝트를 이러한 단계로 나누기로 결정했지만, 스크립트를 다시 실행하여 Wikipedia에서 HTML을 가져오기 위해 불필요한 여러 요청을 하는 것을 피하고 싶었습니다. html 파일을 저장한 다음 별도의 스크립트에서 작업하면 이미 데이터가 있으므로 데이터를 계속 다시 요청할 필요가 없습니다.

프로젝트 링크

이 프로젝트에 대한 내 github 저장소 링크는 다음과 같습니다: https://github.com/gabrielrowan/Foreign-Languages-Analytic

HTML 가져오기

먼저 html을 검색해서 출력했습니다. C#과 C로 작업한 후에는 Python 코드가 얼마나 짧고 간결한지 항상 새롭습니다.

1 2 3 4 5 6 7 |

|

HTML 파싱

Beautiful Soup으로 HTML을 구문 분석하고 관심 있는 테이블을 선택하기 위해 다음을 수행했습니다.

1 2 3 4 5 |

|

그런 다음 Pandas 데이터 프레임의 열 이름을 가져오기 위한 테이블 헤더 텍스트를 얻었습니다.

1 2 3 |

|

그런 다음 데이터 프레임을 만들고, 열 이름을 설정하고, 각 테이블 행을 검색하고, 각 행을 데이터 프레임에 썼습니다.

1 2 3 4 5 6 7 8 9 10 11 12 |

|

참고 - Strip()을 사용하지 않으면 텍스트에 필요하지 않은 n개의 문자가 있었습니다.

마지막으로 데이터 프레임을 .csv에 썼습니다.

데이터 분석

미리 데이터를 통해 답하고 싶은 질문을 생각해 냈습니다.

- 데이터세트에 포함된 모든 언어의 총 원어민 수는 몇 명입니까?

- 어족에는 몇 가지 유형이 있나요?

- 언어족당 총 원어민 수는 몇 명인가요?

- 가장 일반적인 언어군 상위 3개는 무엇입니까?

- 가장 일반적인 상위 3개 언어군을 보여주는 원형 차트 만들기

- 가장 일반적으로 발생하는 언어군 - 분기 쌍은 무엇입니까?

- 표에 있는 중국-티베트어는 어떤 언어인가요?

- 모든 로망스어 및 게르만어 원어민의 막대형 차트 표시

- 전체 원어민 중 상위 5개 언어가 차지하는 비율은 얼마나 되나요?

- 원어민이 가장 많은 부서와 가장 적은 부서는 어디입니까?

결과

이 모든 질문에 답하기 위해 코드를 다루지는 않지만 차트와 관련된 두 가지 질문에 대해 살펴보겠습니다.

모든 로망스어 및 게르만어 원어민의 막대 차트를 표시합니다.

먼저 분기 이름이 'Romance' 또는 'Germanic'인 행만 포함하는 데이터 프레임을 만들었습니다

1 2 3 4 5 6 7 |

|

그런 다음 차트에 원하는 x축, y축 및 막대 색상을 지정했습니다.

1 2 3 4 5 |

|

다음이 생성되었습니다:

가장 많이 사용되는 상위 3개 언어군을 표시하는 원형 차트 만들기

원형 차트를 만들기 위해 가장 일반적인 언어군 상위 3개를 검색하여 데이터 프레임에 넣었습니다.

이 코드 그룹은 언어군별 원어민의 총합을 구해 내림차순으로 정렬한 후 상위 3개 항목을 추출합니다.

1 2 3 |

|

그런 다음 '원어민'의 y축과 범례를 지정하여 데이터를 원형 차트에 넣습니다. 그러면 차트에 표시된 각 언어군에 대해 색상으로 구분된 레이블이 생성됩니다.

1 2 3 4 5 6 7 8 9 10 11 12 |

|

나머지 질문에 대한 코드와 응답은 여기에서 확인할 수 있습니다. 질문과 답변을 노트에 마크다운을 이용해 작성했습니다.

다음번:

다음번 웹 스크래핑 및 데이터 분석 프로젝트에서는 다음을 사용하여 상황을 더 복잡하게 만들고 싶습니다.

- 클릭/스크롤 시 더 많은 데이터가 표시되는 동적 페이지를 웹 스크래핑

- 훨씬 더 큰 데이터 세트 분석(분석 전에 약간의 데이터 정리 작업이 필요할 수 있음)

최종 생각

빠른 작업이었지만 이번 프로젝트를 하면서 즐거웠습니다. 실무 담당자를 확보하는 데 짧고 관리 가능한 프로젝트가 얼마나 유용할 수 있는지 상기시켜 주었습니다. 게다가 인터넷에서 데이터를 추출하고, 그로부터 차트를 만드는 것도 작은 데이터셋으로도 재미있죠?

위 내용은 웹 스크래핑 및 외국어 데이터 분석의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

Python vs. C : 응용 및 사용 사례가 비교되었습니다

Apr 12, 2025 am 12:01 AM

Python vs. C : 응용 및 사용 사례가 비교되었습니다

Apr 12, 2025 am 12:01 AM

Python은 데이터 과학, 웹 개발 및 자동화 작업에 적합한 반면 C는 시스템 프로그래밍, 게임 개발 및 임베디드 시스템에 적합합니다. Python은 단순성과 강력한 생태계로 유명하며 C는 고성능 및 기본 제어 기능으로 유명합니다.

2 시간의 파이썬 계획 : 현실적인 접근

Apr 11, 2025 am 12:04 AM

2 시간의 파이썬 계획 : 현실적인 접근

Apr 11, 2025 am 12:04 AM

2 시간 이내에 Python의 기본 프로그래밍 개념과 기술을 배울 수 있습니다. 1. 변수 및 데이터 유형을 배우기, 2. 마스터 제어 흐름 (조건부 명세서 및 루프), 3. 기능의 정의 및 사용을 이해하십시오. 4. 간단한 예제 및 코드 스 니펫을 통해 Python 프로그래밍을 신속하게 시작하십시오.

파이썬 : 게임, Guis 등

Apr 13, 2025 am 12:14 AM

파이썬 : 게임, Guis 등

Apr 13, 2025 am 12:14 AM

Python은 게임 및 GUI 개발에서 탁월합니다. 1) 게임 개발은 Pygame을 사용하여 드로잉, 오디오 및 기타 기능을 제공하며 2D 게임을 만드는 데 적합합니다. 2) GUI 개발은 Tkinter 또는 PYQT를 선택할 수 있습니다. Tkinter는 간단하고 사용하기 쉽고 PYQT는 풍부한 기능을 가지고 있으며 전문 개발에 적합합니다.

Python vs. C : 학습 곡선 및 사용 편의성

Apr 19, 2025 am 12:20 AM

Python vs. C : 학습 곡선 및 사용 편의성

Apr 19, 2025 am 12:20 AM

Python은 배우고 사용하기 쉽고 C는 더 강력하지만 복잡합니다. 1. Python Syntax는 간결하며 초보자에게 적합합니다. 동적 타이핑 및 자동 메모리 관리를 사용하면 사용하기 쉽지만 런타임 오류가 발생할 수 있습니다. 2.C는 고성능 응용 프로그램에 적합한 저수준 제어 및 고급 기능을 제공하지만 학습 임계 값이 높고 수동 메모리 및 유형 안전 관리가 필요합니다.

파이썬과 시간 : 공부 시간을 최대한 활용

Apr 14, 2025 am 12:02 AM

파이썬과 시간 : 공부 시간을 최대한 활용

Apr 14, 2025 am 12:02 AM

제한된 시간에 Python 학습 효율을 극대화하려면 Python의 DateTime, Time 및 Schedule 모듈을 사용할 수 있습니다. 1. DateTime 모듈은 학습 시간을 기록하고 계획하는 데 사용됩니다. 2. 시간 모듈은 학습과 휴식 시간을 설정하는 데 도움이됩니다. 3. 일정 모듈은 주간 학습 작업을 자동으로 배열합니다.

Python vs. C : 성능과 효율성 탐색

Apr 18, 2025 am 12:20 AM

Python vs. C : 성능과 효율성 탐색

Apr 18, 2025 am 12:20 AM

Python은 개발 효율에서 C보다 낫지 만 C는 실행 성능이 높습니다. 1. Python의 간결한 구문 및 풍부한 라이브러리는 개발 효율성을 향상시킵니다. 2.C의 컴파일 유형 특성 및 하드웨어 제어는 실행 성능을 향상시킵니다. 선택할 때는 프로젝트 요구에 따라 개발 속도 및 실행 효율성을 평가해야합니다.

파이썬 : 자동화, 스크립팅 및 작업 관리

Apr 16, 2025 am 12:14 AM

파이썬 : 자동화, 스크립팅 및 작업 관리

Apr 16, 2025 am 12:14 AM

파이썬은 자동화, 스크립팅 및 작업 관리가 탁월합니다. 1) 자동화 : 파일 백업은 OS 및 Shutil과 같은 표준 라이브러리를 통해 실현됩니다. 2) 스크립트 쓰기 : PSUTIL 라이브러리를 사용하여 시스템 리소스를 모니터링합니다. 3) 작업 관리 : 일정 라이브러리를 사용하여 작업을 예약하십시오. Python의 사용 편의성과 풍부한 라이브러리 지원으로 인해 이러한 영역에서 선호하는 도구가됩니다.

Python Standard Library의 일부는 무엇입니까? 목록 또는 배열은 무엇입니까?

Apr 27, 2025 am 12:03 AM

Python Standard Library의 일부는 무엇입니까? 목록 또는 배열은 무엇입니까?

Apr 27, 2025 am 12:03 AM

Pythonlistsarepartoftsandardlardlibrary, whileraysarenot.listsarebuilt-in, 다재다능하고, 수집 할 수있는 반면, arraysarreprovidedByTearRaymoduledlesscommonlyusedDuetolimitedFunctionality.