텍스트 분류를위한 미세 조정 라마 3.1

이 튜토리얼은 정신 건강 감정 분석을위한 LLAMA 3.1-8B-IT 모델을 미세 조정하는 것을 보여줍니다. 텍스트 데이터에서 환자의 정신 건강 상태를 예측하고 어댑터를 기본 모델과 병합하고 Hugging Face Hub에 전체 모델을 배포하기 위해 모델을 사용자 정의합니다.

저자에 의한 이미지

이해

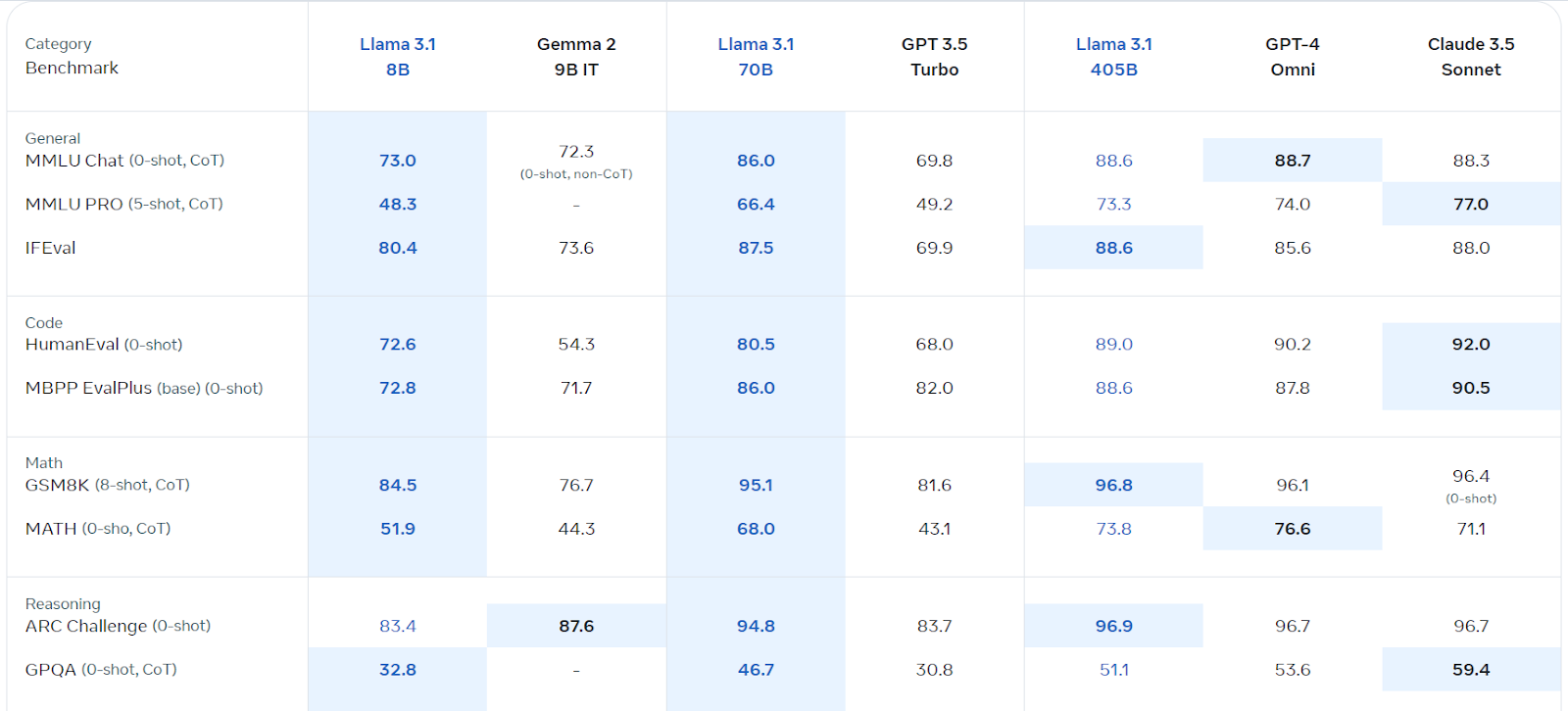

Meta AI의 다국어 대형 언어 모델 (LLM)은 언어 이해와 세대에 탁월합니다. 8b, 70b 및 405b 매개 변수 버전으로 제공되는이 제품은 최적화 된 변압기를 갖춘 자동 재조정 아키텍처를 기반으로합니다. 다양한 공개 데이터에 대해 교육을받은 8 개 언어를 지원하며 128K 컨텍스트 길이를 자랑합니다. 상업용 라이센스는 쉽게 액세스 할 수 있으며 다양한 벤치 마크에서 여러 경쟁 업체를 능가합니다.

출처 : llama 3.1 (meta.com)

Meta.com에 등록 (Kaggle 이메일 사용)

설정 : llama 3.1로 새로운 Kaggle 노트북을 시작하고 필수 패키지를 설치하고 (, , , , )를 설치하고 "정신 건강에 대한 감정 분석"데이터 세트를 추가하십시오. 가중치 및 바이어스 (API 키 사용)를 구성하십시오

모델 로딩 : 메모리 효율을 위해 4 비트 양자화를 사용하여 LLAMA-3.1-8B 비 구역 모델을로드하십시오. 토큰 화기를로드하고 패드 토큰 ID를 설정하십시오

미세 조정 : 미세 조정 후 모델의 성능을 재평가하십시오

Kaggle에서 llama 3.1에 액세스하고 사용하는

Kaggle에서 llama 3.1에 액세스하고 사용하는

위 내용은 텍스트 분류를위한 미세 조정 라마 3.1의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7878

7878

15

15

1649

1649

14

14

1409

1409

52

52

1301

1301

25

25

1245

1245

29

29

창의적인 프로젝트를위한 최고의 AI 아트 발전기 (무료 & amp; 유료)

Apr 02, 2025 pm 06:10 PM

창의적인 프로젝트를위한 최고의 AI 아트 발전기 (무료 & amp; 유료)

Apr 02, 2025 pm 06:10 PM

이 기사는 최고의 AI 아트 생성기를 검토하여 자신의 기능, 창의적인 프로젝트에 대한 적합성 및 가치에 대해 논의합니다. Midjourney를 전문가에게 최고의 가치로 강조하고 고품질의 사용자 정의 가능한 예술에 Dall-E 2를 추천합니다.

Meta Llama 3.2- 분석 Vidhya를 시작합니다

Apr 11, 2025 pm 12:04 PM

Meta Llama 3.2- 분석 Vidhya를 시작합니다

Apr 11, 2025 pm 12:04 PM

메타의 라마 3.2 : 멀티 모달 및 모바일 AI의 도약 Meta는 최근 AI에서 강력한 비전 기능과 모바일 장치에 최적화 된 가벼운 텍스트 모델을 특징으로하는 AI의 상당한 발전 인 Llama 3.2를 공개했습니다. 성공을 바탕으로 o

최고의 AI 챗봇 비교 (Chatgpt, Gemini, Claude & amp; more)

Apr 02, 2025 pm 06:09 PM

최고의 AI 챗봇 비교 (Chatgpt, Gemini, Claude & amp; more)

Apr 02, 2025 pm 06:09 PM

이 기사는 Chatgpt, Gemini 및 Claude와 같은 최고의 AI 챗봇을 비교하여 고유 한 기능, 사용자 정의 옵션 및 자연어 처리 및 신뢰성의 성능에 중점을 둡니다.

컨텐츠 생성을 향상시키기 위해 AI를 쓰는 최고 AI 작문

Apr 02, 2025 pm 06:11 PM

컨텐츠 생성을 향상시키기 위해 AI를 쓰는 최고 AI 작문

Apr 02, 2025 pm 06:11 PM

이 기사는 Grammarly, Jasper, Copy.ai, Writesonic 및 Rytr와 같은 최고의 AI 작문 조수에 대해 논의하여 콘텐츠 제작을위한 독특한 기능에 중점을 둡니다. Jasper는 SEO 최적화가 뛰어나고 AI 도구는 톤 구성을 유지하는 데 도움이된다고 주장합니다.

직원에게 AI 전략 판매 : Shopify CEO의 선언문

Apr 10, 2025 am 11:19 AM

직원에게 AI 전략 판매 : Shopify CEO의 선언문

Apr 10, 2025 am 11:19 AM

Shopify CEO Tobi Lütke의 최근 메모는 AI 숙련도가 모든 직원에 대한 근본적인 기대를 대담하게 선언하여 회사 내에서 중요한 문화적 변화를 표시합니다. 이것은 도망가는 트렌드가 아닙니다. 그것은 p에 통합 된 새로운 운영 패러다임입니다

10 생성 AI 코드의 생성 AI 코딩 확장 대 코드를 탐색해야합니다.

Apr 13, 2025 am 01:14 AM

10 생성 AI 코드의 생성 AI 코딩 확장 대 코드를 탐색해야합니다.

Apr 13, 2025 am 01:14 AM

이봐, 코딩 닌자! 하루 동안 어떤 코딩 관련 작업을 계획 했습니까? 이 블로그에 더 자세히 살펴보기 전에, 나는 당신이 당신의 모든 코딩 관련 문제에 대해 생각하기를 원합니다. 완료? - ’

AV 바이트 : Meta ' S Llama 3.2, Google의 Gemini 1.5 등

Apr 11, 2025 pm 12:01 PM

AV 바이트 : Meta ' S Llama 3.2, Google의 Gemini 1.5 등

Apr 11, 2025 pm 12:01 PM

이번 주 AI 환경 : 발전의 회오리 바람, 윤리적 고려 사항 및 규제 토론. OpenAi, Google, Meta 및 Microsoft와 같은 주요 플레이어

최고의 AI 음성 생성기 선택 : 최고 옵션 검토

Apr 02, 2025 pm 06:12 PM

최고의 AI 음성 생성기 선택 : 최고 옵션 검토

Apr 02, 2025 pm 06:12 PM

이 기사는 Google Cloud, Amazon Polly, Microsoft Azure, IBM Watson 및 Destript와 같은 최고의 AI 음성 생성기를 검토하여 기능, 음성 품질 및 다양한 요구에 대한 적합성에 중점을 둡니다.