DeepSeek R1 vs Openai O1 : 어느 것이 더 낫습니까?

.

Deepseek R1 : 독창성과 효율성에 대한 증거

DeepSeek r1을 게임 체인저로 만드는 것?

- DeepSeek R1에 대한 개요

- Deepseek R1의 최소 성능을 제공하는 방법? 비교

- deepseek r1 vs openai o1 : 다른 벤치 마크 비교

- ollama를 사용하여 DeepSeek r1에 액세스하는 방법?

- Google Colab에서 DeepSeek R1을 사용하는 방법?

deepseek r1 : 독창성과 효율성에 대한 증거 단지 - $ 6 백만의 예산으로 DeepSeek은 10 억 달러 규모의 투자를 가진 회사가해야 할 일을 달성했습니다. 그들이 한 방법은 다음과 같습니다.

- 예산 효율성 :

는 OpenAi의 추정- $ 60 억 투자와 비교하여 에 R1을 구축했습니다. 리소스 최적화 : 2.78 백만 GPU 시간 로 결과를 달성했으며, 비슷한 규모 모델의 경우 Meta의 벤치 마크 우수성 : r1은 주요 작업에서 Openai O1과 일치하며 일부 명확한 성과 영역이 있습니다.

DeepSeek R1은 오픈 소스 연구의 집단 작업을 기반으로하지만 효율성과 성과는 - 가 대규모 기술의 대규모 예산에 어떻게 경쟁 할 수 있는지 보여줍니다.

DeepSeek R1을 게임 체인저로 만드는 이유는 무엇입니까? 인상적인 기술 기능을 넘어서 DeepSeek R1은 비즈니스 및 개발자에게 최고의 선택을 제공하는 주요 기능을 제공합니다. -

Open Weights & MIT 라이센스 :

- 완전히 개방적이고 상업적으로 사용 가능하며 비즈니스에 라이센스 제약 조건없이 구축 할 수있는 유연성을 제공합니다.

증류 된 모델 : 작은 미세 조정 된 버전 (Qwen 및 Llama와 유사 함), 다양한 응용 프로그램에 대한 효율성을 유지하면서 뛰어난 성능을 제공합니다.

API 액세스 : API 액세스 : API를 통해 또는 플랫폼에서 직접 액세스 할 수 있습니다.

비용 효율성 : 다른 주요 AI 모델과 비교하여 비용의 일부가 그 어느 때보 다 고급 AI에 더 접근하기 쉽게 만듭니다.

Deepseek R1은 흥미로운 질문을 제기합니다. 우리는 큰 아이디어를 가진 작은 팀이 업계를 방해하고 10 억 달러 규모의 거인을 능가 할 수있는 새로운 AI 시대의 새벽을 목격하고 있습니까? AI 환경이 발전함에 따라 DeepSeek의 성공은 혁신, 효율성 및 적응성 - 가 얇은 재무만큼 강력 할 수 있다고 강조합니다.

Deepseek R1 의 개요 deepseek r1 모델은 아키텍처를 자랑하며 deepseek v3 base - 모델에서 훈련을 받았습니다. 사고 체인 (COT) 추론 에 중점을두면 고급 이해력과 추론이 필요한 작업에 대한 강력한 경쟁자가됩니다. 흥미롭게도, 매개 변수의 큰 수는 Deepseek R1은 단순한 모 놀리 식 모델이 아닙니다. 생태계에는 DeepSeek R1 자체에서 파생 된 합성 데이터에 대해 미세 조정 된 6 개의 증류 모델 가 포함됩니다. 이 작은 모델은 크기와 대상 특정 사용 사례가 다양하므로 인상적인 성능을 유지하면서 가볍고 빠른 모델이 필요한 개발자에게 솔루션을 제공합니다.

증류 된 모델 라인업 이 증류 모델은 로컬 배치 및 API 사용을 모두 충족시키는 유연성을 가능하게합니다. 특히, table.has-fixed-layout { border-collapse: collapse; width: 100%; } table.has-fixed-layout, table.has-fixed-layout th, table.has-fixed-layout td { border: 1px solid black; padding: 8px; text-align: left; } 는 증류 변이체의 강도를 강조하여 여러 벤치 마크에서 O1 미니를 능가합니다. Model Base Model Download DeepSeek-R1-Distill-Qwen-1.5B Qwen2.5-Math-1.5B ? HuggingFace DeepSeek-R1-Distill-Qwen-7B Qwen2.5-Math-7B ? HuggingFace DeepSeek-R1-Distill-Llama-8B Llama-3.1-8B ? HuggingFace DeepSeek-R1-Distill-Qwen-14B Qwen2.5-14B ? HuggingFace DeepSeek-R1-Distill-Qwen-32B Qwen2.5-32B ? HuggingFace DeepSeek-R1-Distill-Llama-70B Llama-3.3-70B-Instruct ? HuggingFace 모델 #total params #Activated Params 컨텍스트 길이 다운로드 Deepseek-R1-Zero 671b 37b 128k ? huggingface deepseek-r1 671b 37b 128k ? huggingface 당신은 여기에서 OpenAi O1에 관한 모든 것을 찾을 수 있습니다. Deepseek R1이 최소한의 비용으로 무적의 성능을 제공하는 방법? 최소한의 비용으로 DeepSeek R1의 인상적인 성능은 교육 및 최적화 프로세스의 몇 가지 주요 전략과 혁신에 기인 할 수 있습니다. 다음은 : 를 달성 한 방법입니다 1. 강력한 감독 미세 조정 대신 강화 학습

대부분의 전통적인 LLM (GPT, LLAMA 등)은 감독 된 미세 조정에 크게 의존하며, 이는 인간 주석기에 의해 큐 레이션 된 광범위한 라벨링 된 데이터 세트가 필요합니다. DeepSeek r1은 다른 접근법 : 를 취했습니다

Deepseek-R1-Zero :

순수 강화 학습 (rl)감독 학습 대신 .

로 만들 수 있습니다.모델은 자기 진화 를 통해 훈련을 받았으며, 인간의 개입없이 추론 능력을 반복적으로 개선 할 수있게 해주었다. rl은 시행 착오를 기반으로 정책을 최적화하는 데 도움이되며, 모델을 감독 훈련과 비교하여 모델을 더 많은 비용 효율적인 -

Deepseek-R1 (콜드 스타트 전략) :

rl 전용 모델 (일관성 응답과 같은)에서 일반적인 문제를 피하기 위해 - 소형 고품질 감독 데이터 세트 를 "콜드 스타트"에 도입했습니다.

이를 통해 모델은 처음부터 더 나은 부트 스트랩을 가능하게하여 강력한 추론 능력을 유지하면서 인간과 같은 유창성 및 가독성 를 보장했습니다.

- 충격 :

-

2. 효율 및 스케일링을위한 증류

DeepSeek이 사용하는 또 다른 게임 변화 접근법은 더 큰 R1 모델에서 다음과 같은 작은 모델로 추론 기능의 증류 입니다.

rl 교육은 데이터 주석 비용을 크게 줄였습니다 자기 진화는 모델이 문제 해결 전략을 자율적으로 발견 할 수있게 해주었다 -

Deepseek-R1 (콜드 스타트 전략) :

-

- 주요 증류 혜택 :

-

-

계산 비용 절감 :

- 소규모 모델은 추론 시간과 메모리가 줄어 듭니다. 확장 성 : 에지 장치 또는 비용에 민감한 클라우드 환경에 증류 모델을 배포하는 것이 더 쉽습니다. 강력한 성능 유지 : r1의 증류 버전은 여전히 벤치 마크에서 경쟁적으로 순위를 매기고 있습니다. 3. 벤치 마크 성능 및 최적화 초점

-

DeepSeek R1은 다음과 같은 특정 고 충격 벤치 마크에 대한 최적화에 중점을 두었습니다. AIME 2024 : 79.8%로 SOTA 성능을 달성하는 것 Math-500 : 97.3% 정확도로 추론 개선

코드 포스 (경쟁 프로그래밍) : - 상위 3.7%내에서 순위 mmlu (일반 지식) : 는 90.8%로 경쟁력이 있지만 일부 모델보다 약간 뒤떨어져 있지만 여전히 인상적입니다. 일반 목적 챗봇 대신 DeepSeek R1은

작업에 더 중점을 두어 더 나은 리소스 할당 및 모델 효율성을 보장합니다.

4. 효율적인 아키텍처 및 훈련 기술Deepseek는 여러 건축 및 교육 최적화의 혜택을받을 수 있습니다 - 희소주의 메커니즘 :

-

는 계산 비용이 낮은 더 긴 컨텍스트를 처리 할 수 있습니다 전문가 혼합 (MOE) : - . 효율적인 교육 파이프 라인 : 과도한 노이즈가없는 잘 정리 된 도메인 별 데이터 세트에 대한 교육

- 5. 전략적 모델 설계 선택

-

Deepseek의 접근 방식은 비용과 성능의 균형을 잡는 데 매우 전략적입니다.

-

초점 도메인 전문 지식 (수학, 코드, 추론)

- 일반 목적 NLP 작업 대신. 최적화 된 리소스 활용 덜 중요한 NLP 기능보다 추론 작업을 우선시하려면. 스마트 트레이드 오프 필요한 경우 가장 잘 작동하고 최소한의 미세 조정이있는 곳에서 RL을 사용하는 것을 좋아합니다.

- 강화 학습으로 인해 값 비싼 감독 데이터 세트의 필요성 효율적인 증류 는 소규모 모델에서 최상위 추론 성능을 보장합니다 일반적인 NLP 작업보다는 추론 벤치 마크에 대한 대상 교육 초점

- . 더 나은 계산 효율을 위해 아키텍처 최적화

왜 비용 효율적인가?

는 모델의 일부만 동적으로 활성화하여 효율적인 추론을 초래할 수 있습니다. 강화 학습 단계를위한 합성 데이터 사용 강화 학습, 선택적 미세 조정 및 전략적 증류를 결합하여 -

deepseek r1은 대부분의 평가에서 OpenAi O1과 비교하여 점수를 얻고 특정 경우에도 그 점수를 높입니다. 이 높은 수준의 성능은 접근성으로 보완됩니다. DeepSeek R1은 DeepSeek 채팅 플랫폼에서 를 무료로 사용할 수 있으며 저렴한 API 가격을 제공합니다. 비용 비교는 다음과 같습니다. - DeepSeek R1 API : 입력의 경우 55 센트, 출력 $ 2.19 (1 백만 토큰) Openai O1 API : 입력의 경우 $ 15, 출력 $ 60 (1 백만 토큰)

-

API는 chatgpt보다 96.4% 저렴합니다

DeepSeek R1의 저렴한 비용 및 무료 채팅 플랫폼 액세스는 확장 가능한 AI 솔루션을 찾고있는 예산 의식 개발자 및 기업에 매력적인 옵션이됩니다. Qwen 32b벤치마킹 및 신뢰성 DeepSeek 모델은 신뢰할 수있는 벤치마킹을 지속적으로 입증했으며 R1 모델은 이러한 명성을지지합니다. DeepSeek R1은 성능 메트릭과 채팅 환경 설정과의 강력한 정렬을 갖춘 OpenAI O1 및 기타 주요 모델과의 경쟁자로 잘 알려져 있습니다. 및 llama 33.7b 와 같은 증류 모델도 인상적인 벤치 마크를 제공하여 비슷한 크기 범주에서 경쟁 업체를 능가합니다.

- Deepseek 채팅 플랫폼 : 기본 모델에 대한 무료 액세스 API Access : 대규모 배포를위한 저렴한 가격 로컬 배치 : Qwen 8B 또는 Qwen 32B와 같은 소규모 모델은 VM 설정을 통해 로컬로 사용할 수 있습니다. LLAMA 변형과 같은 일부 모델은 아직 AMA에 나타나지 않지만 곧 출시 될 것으로 예상되어 배포 옵션이 더 확장됩니다.

를 유지하면서 다른 SOTA 모델에 비해 상당히 낮은 비용

를 유지하면서 최상위 성능을 제공합니다.Deepseek r1 vs. Openai O1 : 가격 비교 실용적 사용 및 접근성 Deepseek R1 및 증류 변형은 여러 플랫폼을 통해 쉽게 사용할 수 있습니다. Deepseek R1 vs Openai O1 : 다른 벤치 마크 비교 -

- 이 벤치 마크는 도전적인 수학 콘테스트 인 AMERICAL AMERICAL MATHEMATICS EXASTION (AIME)의 성과를 평가합니다. DeepSeek-R1은 OpenAI-O1-1217을 0.6%로 약간 능가하며, 이러한 유형의 수학 문제를 해결하는 데 약간 더 나은 것을 의미합니다.

- 2. 코드포 (백분위 수) Deepseek-R1 : 96.3% Openai O1-1217 : 96.6%

-

설명 :

Codeforces는 인기있는 경쟁 프로그래밍 플랫폼이며 백분위 수 순위는 모델이 다른 사람들에 비해 얼마나 잘 수행되는지를 보여줍니다. OpenAi-O1-1217은 약간 더 좋으며 (0.3%) - 는 알고리즘 및 코딩 문제를 처리하는 데 약간의 이점이있을 수 있습니다.

- 3. GPQA 다이아몬드 (Pass@1) Deepseek-R1 : 71.5%

- 4. Math-500 (Pass@1) DeepSeek-R1 :

- 97.3% Openai o1-1217 : 96.4% 설명 :

-

이 벤치 마크는 광범위한 주제에 걸쳐 수학 문제 해결 기술을 측정합니다.

DeepSeek-R1 점수는 0.9%증가했으며, 고급 수학 문제에 대한 정밀도와 추론이 더 좋을 수 있음을 보여줍니다.

- 5. MMLU (Pass@1) Deepseek-R1 : 90.8%

- 6. Swe-Bench 확인 (해결)

- Deepseek-R1 : 49.2% Openai O1-1217 : 48.9%

- 설명 :

이 벤치 마크는 소프트웨어 엔지니어링 작업을 해결할 때 모델의 성능을 평가합니다.

DeepSeek-R1은 약간의 0.3%의 이점을 가지고 있으며,

- 는 작은 리드로 비슷한 수준의 코딩 능력을 나타냅니다.

Benchmark DeepSeek-R1 (%) OpenAI o1-1217 (%) Verdict AIME 2024 (Pass@1) 79.8 79.2 DeepSeek-R1 wins (better math problem-solving) Codeforces (Percentile) 96.3 96.6 OpenAI-o1-1217 wins (better competitive coding) GPQA Diamond (Pass@1) 71.5 75.7 OpenAI-o1-1217 wins (better general QA performance) MATH-500 (Pass@1) 97.3 96.4 DeepSeek-R1 wins (stronger math reasoning) MMLU (Pass@1) 90.8 91.8 OpenAI-o1-1217 wins (better general knowledge understanding) SWE-bench Verified (Resolved) 49.2 48.9 DeepSeek-R1 wins (better software engineering task handling) 전반적인 평결 :

Deepseek-R1 강점 :- 수학 관련 벤치 마크 (AIME 2024, MATH-500) 및 소프트웨어 엔지니어링 작업 (SWE-BENCH VERIFIED).

Openai O1-1217 강점 :

- 경쟁 프로그래밍 (코드 포스), 일반 목적 Q & A (GPQA 다이아몬드) 및 일반 지식 작업 (MMLU).

두 모델은 수학 및 소프트웨어 작업에서 DeepSeek-R1이 전반적으로 유사하게 수행되는 반면, OpenAi O1-1217은 일반적인 지식과 문제 해결이 탁월합니다.수학적 추론 및 소프트웨어 엔지니어링에 초점을 맞추면 DeepSeek-R1은 더 나은 선택 일 수 있습니다. 일반 목적 작업 및 프로그래밍 경쟁의 경우 Openai O1-1217 - 가 우위에있을 수 있습니다.

Ollama를 사용하여 DeepSeek R1에 액세스하는 방법? 첫째, Ollama 를 설치하십시오 ollama

터미널에서 다음 명령을 실행하십시오 그런 다음 모델을 실행합니다 여기에 Deepseek R1의 Ollama가 있습니다. Ollama Run Deepseek-R1

명령을 복사하십시오 : Ollama Run Deepseek-r1나는 Ollama Run Deepseek-R1 : 1.5b를 로컬에서 실행하고 있으며 모델을 다운로드하는 데 몇 분이 걸립니다.

프롬프트 : Fibonacci nth 시리즈에 대한 코드를 제공하십시오

- 출력

DeepSeek-R1 : 1.5B의 출력 품질은 Solid curl -fsSL https://ollama.com/install.sh | sh, 몇 가지 긍정적 인 측면과 잠재적 개선 영역이 있습니다. 긍정적 인 측면 - 논리적 사고 과정

-

모델은 재귀 적 접근과 반복적 인 접근법을 모두 고려하여 명확한 단계별 추론 프로세스 를 나타냅니다. 그것은 일반적인 함정 (예 : 재귀의 비 효율성)을 포착하고 반복적 인 방법의 선택을 정당화합니다. . -

코드의 정확성

-

최종 반복 솔루션이 정확하고 기본 사례를 올바르게 처리합니다. 테스트 케이스 FIB (5)는 올바른 출력을 생성합니다 설명 깊이 - 세부적이고 초보자 친화적 인 입니다.

코드의 제공된 분류는 -

-

- 효율 고려

- .

설명은 시간 복잡성 ($ o (n) $)를 강조하고이를 재귀와 대조하여 알고리즘 효율에 대한 이해를 잘 보여줍니다. -

이 명령은 3 개의 Python 라이브러리를 설치합니다 :

변압기 : 미리 훈련 된 언어 모델로 작업하기위한 얼굴을 포옹하여 라이브러리.

<:> 가속 : Pytorch 모델에 대한 교육 및 추론을 최적화하고 속도를 높이는 라이브러리.

토치 : 딥 러닝 프레임 워크 인 Pytorch Library. -

이것은 메시지 목록을 정의합니다. 여기서 각 메시지는 역할 (예 : "사용자") 및 내용 (메시지의 실제 텍스트)이있는 사전입니다. 이 형식은 종종 대화 모델에서 사용됩니다.

이것은 DeepSeek-AI/DeepSeek-Distill-QWEN-7B 모델을 사용하여 텍스트 생성 파이프 라인을 만듭니다. 파이프 라인 기능은 모델 및 토큰 화제로드를 자동으로 처리합니다.

이것은 메시지 목록을 파이프 라인으로 전달하여 입력을 기반으로 응답을 생성합니다. 출력 OpenAi o1 의 코드 구현

출력

이것은 변압기 라이브러리에서 파이프 라인 기능을 가져옵니다. 파이프 라인 기능은 텍스트 생성, 분류 등과 같은 작업에 미리 훈련 된 모델을 사용하는 프로세스를 단순화하는 고급 API입니다. 최종 판결 deepseek r1은보다 효율적이고 다재다능한 솔루션을 제공하여 전반적으로 더 나은 선택입니다. 에지 케이스를 올바르게 처리하고 추가 사용을 위해 값을 반환하는 함수를 제공하며 자세한 설명이 포함되어 있습니다. 이것은 실제 응용 프로그램과 교육 목적 모두에 적합합니다. . 추천 : 효율적이고 재사용 가능한 솔루션이 필요한 경우 DeepSeek r1의

접근 방식으로 이동하십시오. Fibonacci 시퀀스를 간단한 방식으로 이해하려면openai o1의 접근 방식을 사용하십시오.

요구에 대한 이상적인 AI 모델 선택 프로젝트에 올바른 AI 모델을 선택하려면 기술 사양, 예산 제한 및 운영 요구와 같은 여러 요소를 평가해야합니다. 아래에서, 우리는 당신이 정보에 입각 한 결정을 내리는 데 도움이되는 다른 모델의 강점과 이상적인 사용 사례를 탐구합니다. DeepSeek-R1 : 타의 추종을 불허하는 유연성 및 비용 효율성 DeepSeek-R1은 특정 응용 프로그램, 특히 경제성과 적응성 우선 순위를 정하는 사람들의 최고 경쟁자로 두드러집니다. 프로젝트에 완벽하게 맞는 이유는 다음과 같습니다. 예산 친화적 인 솔루션 기존 모델에 비해 운영 비용이 5%로 낮은 DeepSeek-R1은 신생 기업, 학업 연구 및 재정 자원이 제한된 프로젝트에 이상적입니다.

사용자 정의 및 오픈 소스 우위오픈 소스 프레임 워크를 통해 팀은 모델을 고유 한 요구에 맞게 조정하거나 기존 시스템과 원활하게 통합하거나 특수 도메인을 위해 최적화 할 수 있습니다. 이 유연성은 특히 틈새 기술 요구 사항이있는 조직에 유익합니다.

우수한 수학적 기능

Math-500 벤치 마크에서 97.3% 정확도를 자랑하는 DeepSeek-R1은 복잡한 계산, 통계 분석 또는 수학적 모델링이 필요한 응용 프로그램에서 탁월합니다. 이것은 금융, 엔지니어링 및 과학 연구와 같은 분야에 대한 강력한 선택입니다.-

OpenAi의 O1 : 신뢰성 및 고급 성능 OpenAI의 O1 시리즈는 신뢰성, 보안 및 고급 추론이 가장 중요한 엔터프라이즈 수준의 응용 프로그램을 위해 설계되었습니다. 여기에 빛나는 곳이 있습니다 : -

엔터프라이즈 등급 보안 및 규정 준수

-

강력한 안전 프로토콜 및 준수 조치를 통해 O1은 민감한 데이터를 처리하거나 엄격한 규제 프레임 워크에서 운영하는 산업에 이상적입니다. 탁월한 프로그래밍 및 추론 기술 -

Codeforces (2061 등급) 및 GPQA 다이아몬드 (75.7%)에 대한 모델의 인상적인 성능은 복잡한 응용 프로그램 또는 고급 추론 작업을 다루는 소프트웨어 개발 팀을위한 선택입니다.

미션 크리티컬 애플리케이션에 대한 입증 된 실적

-

엄격한 테스트 및 검증 프로세스는 O1이 일관되고 신뢰할 수있는 성능을 제공하여 실패가 옵션이 아닌 미션 크리티컬 작업에 적합합니다. - 결론 DeepSeek R1

openai o1 mit-licensed 대안을 제공합니다. 인상적인 벤치 마크와 증류 변형을 통해 개발자와 연구원에게 다재다능하고 성능이 높은 솔루션을 제공합니다.

-

- 추론, 사고 체인 (COT) 작업 및 AI 이해력 에서 탁월하며 Openai O1과 경쟁하는 비용 효율적인 성능을 제공합니다. 경제성과 효율성은 챗봇부터 연구 프로젝트에 이르기까지 다양한 응용 프로그램에 이상적입니다. 테스트에서 응답 품질은 Openai O1과 일치하여 심각한 경쟁자로 입증되었습니다.

Deepseek r1 vs Openai o1

- 대결은 경제성과 접근성을 강조합니다. 독점 모델과 달리 DeepSeek R1은 확장 가능하고 예산 친화적 인 접근 방식으로 AI를 민주화하여 강력하면서도 비용 효율적인 AI 솔루션을 찾는 사람들에게 최고의 선택입니다.

- 오늘 Deepseek부터 시작하십시오! “DeepSeek”과정에서 AI 및 기계 학습에 대한 DeepSeek의 기능을 활용하는 방법을 알아보십시오. 지금 등록하고 기술을 다음 단계로 끌어!

deepseek r1은 -

이것은 메시지 목록을 정의합니다. 여기서 각 메시지는 역할 (예 : "사용자") 및 내용 (메시지의 실제 텍스트)이있는 사전입니다. 이 형식은 종종 대화 모델에서 사용됩니다.

이것은 DeepSeek-AI/DeepSeek-Distill-QWEN-7B 모델을 사용하여 텍스트 생성 파이프 라인을 만듭니다. 파이프 라인 기능은 모델 및 토큰 화제로드를 자동으로 처리합니다.

변수 업데이트 복잡성 분석 Google Colab에서 DeepSeek R1을 사용하는 방법? 변압기 사용

지식을 증류함으로써, 그들은 QWQ-32B와 같은 일부 최첨단 (SOTA) 모델을 능가하는 작은 모델 (예 : 14B)을 만들 수있었습니다. 이 프로세스는 본질적으로 높은 수준의 추론 능력을 소규모 아키텍처로 이전하여 많은 정확성을 희생하지 않고 매우 효율적입니다. 1. AIME 2024 (Pass@1)

Deepseek-R1 : Openai O1-1217 :- 설명 :

GPQA 다이아몬드는 복잡한 범용 질문에 답변하는 모델의 능력을 평가합니다. OpenAi-O1-1217은 4.2%만큼 더 잘 수행되며,이 범주에서 더 강력한 일반적인 질문 응답 기능을 나타냅니다.

MMLU (대규모 멀티 태스킹 언어 이해) 역사, 과학 및 사회 연구와 같은 주제에 대한 모델의 일반적인 지식을 테스트합니다. OpenAi-O1-1217은 1% 더 우수하며

는 다양한 주제에 대한 더 넓거나 깊은 이해를 가질 수 있음을 의미합니다.

위 내용은 DeepSeek R1 vs Openai O1 : 어느 것이 더 낫습니까?의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7792

7792

15

15

1644

1644

14

14

1401

1401

52

52

1298

1298

25

25

1234

1234

29

29

창의적인 프로젝트를위한 최고의 AI 아트 발전기 (무료 & amp; 유료)

Apr 02, 2025 pm 06:10 PM

창의적인 프로젝트를위한 최고의 AI 아트 발전기 (무료 & amp; 유료)

Apr 02, 2025 pm 06:10 PM

이 기사는 최고의 AI 아트 생성기를 검토하여 자신의 기능, 창의적인 프로젝트에 대한 적합성 및 가치에 대해 논의합니다. Midjourney를 전문가에게 최고의 가치로 강조하고 고품질의 사용자 정의 가능한 예술에 Dall-E 2를 추천합니다.

Meta Llama 3.2- 분석 Vidhya를 시작합니다

Apr 11, 2025 pm 12:04 PM

Meta Llama 3.2- 분석 Vidhya를 시작합니다

Apr 11, 2025 pm 12:04 PM

메타의 라마 3.2 : 멀티 모달 및 모바일 AI의 도약 Meta는 최근 AI에서 강력한 비전 기능과 모바일 장치에 최적화 된 가벼운 텍스트 모델을 특징으로하는 AI의 상당한 발전 인 Llama 3.2를 공개했습니다. 성공을 바탕으로 o

최고의 AI 챗봇 비교 (Chatgpt, Gemini, Claude & amp; more)

Apr 02, 2025 pm 06:09 PM

최고의 AI 챗봇 비교 (Chatgpt, Gemini, Claude & amp; more)

Apr 02, 2025 pm 06:09 PM

이 기사는 Chatgpt, Gemini 및 Claude와 같은 최고의 AI 챗봇을 비교하여 고유 한 기능, 사용자 정의 옵션 및 자연어 처리 및 신뢰성의 성능에 중점을 둡니다.

chatgpt 4 o를 사용할 수 있습니까?

Mar 28, 2025 pm 05:29 PM

chatgpt 4 o를 사용할 수 있습니까?

Mar 28, 2025 pm 05:29 PM

ChatGpt 4는 현재 이용 가능하고 널리 사용되며 ChatGpt 3.5와 같은 전임자와 비교하여 상황을 이해하고 일관된 응답을 생성하는 데 상당한 개선을 보여줍니다. 향후 개발에는보다 개인화 된 인터가 포함될 수 있습니다

컨텐츠 생성을 향상시키기 위해 AI를 쓰는 최고 AI 작문

Apr 02, 2025 pm 06:11 PM

컨텐츠 생성을 향상시키기 위해 AI를 쓰는 최고 AI 작문

Apr 02, 2025 pm 06:11 PM

이 기사는 Grammarly, Jasper, Copy.ai, Writesonic 및 Rytr와 같은 최고의 AI 작문 조수에 대해 논의하여 콘텐츠 제작을위한 독특한 기능에 중점을 둡니다. Jasper는 SEO 최적화가 뛰어나고 AI 도구는 톤 구성을 유지하는 데 도움이된다고 주장합니다.

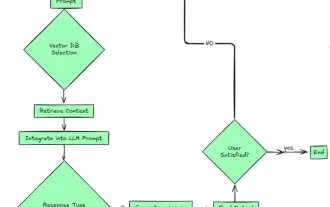

AI 에이전트를 구축하기위한 상위 7 개의 에이전트 래그 시스템

Mar 31, 2025 pm 04:25 PM

AI 에이전트를 구축하기위한 상위 7 개의 에이전트 래그 시스템

Mar 31, 2025 pm 04:25 PM

2024는 콘텐츠 생성에 LLM을 사용하는 것에서 내부 작업을 이해하는 것으로 바뀌는 것을 목격했습니다. 이 탐사는 AI 요원의 발견으로 이어졌다 - 자율 시스템을 처리하는 과제와 최소한의 인간 개입으로 결정을 내렸다. buildin

AV 바이트 : Meta ' S Llama 3.2, Google의 Gemini 1.5 등

Apr 11, 2025 pm 12:01 PM

AV 바이트 : Meta ' S Llama 3.2, Google의 Gemini 1.5 등

Apr 11, 2025 pm 12:01 PM

이번 주 AI 환경 : 발전의 회오리 바람, 윤리적 고려 사항 및 규제 토론. OpenAi, Google, Meta 및 Microsoft와 같은 주요 플레이어

직원에게 AI 전략 판매 : Shopify CEO의 선언문

Apr 10, 2025 am 11:19 AM

직원에게 AI 전략 판매 : Shopify CEO의 선언문

Apr 10, 2025 am 11:19 AM

Shopify CEO Tobi Lütke의 최근 메모는 AI 숙련도가 모든 직원에 대한 근본적인 기대를 대담하게 선언하여 회사 내에서 중요한 문화적 변화를 표시합니다. 이것은 도망가는 트렌드가 아닙니다. 그것은 p에 통합 된 새로운 운영 패러다임입니다