hadoop에서 hdfs의 역할은 무엇입니까?

hadoop에서 hdfs의 역할은 대용량 데이터를 위한 스토리지를 제공하고 높은 처리량의 데이터 액세스를 제공하는 것입니다. HDFS는 높은 내결함성을 가지며 저렴한 하드웨어에 배포되도록 설계되었으며 애플리케이션 데이터에 액세스하기 위한 높은 처리량을 제공합니다. 매우 큰 데이터 세트가 있는 애플리케이션에 적합합니다.

Hadoop은 Apache Foundation에서 개발한 분산 시스템 인프라입니다. 사용자는 배포의 기본 세부 사항을 이해하지 않고도 분산 프로그램을 개발할 수 있습니다. 고속 컴퓨팅 및 스토리지를 위해 클러스터의 기능을 최대한 활용하세요.

Hadoop은 분산 파일 시스템(Hadoop Distributed File System)을 구현하며, 해당 구성 요소 중 하나는 HDFS입니다.

HDFS는 내결함성이 뛰어나고 저가형 하드웨어에 배포되도록 설계되었으며, 애플리케이션 데이터에 액세스하기 위한 높은 처리량을 제공하므로 매우 큰 데이터 세트(대형 데이터 세트) 애플리케이션에 적합합니다. HDFS는 POSIX 요구 사항을 완화하고 파일 시스템의 데이터에 대한 스트리밍 액세스를 허용합니다.

Hadoop 프레임워크의 핵심 디자인은 HDFS와 MapReduce입니다. HDFS는 대용량 데이터에 대한 스토리지를 제공하고 MapReduce는 대용량 데이터에 대한 계산을 제공합니다.

HDFS

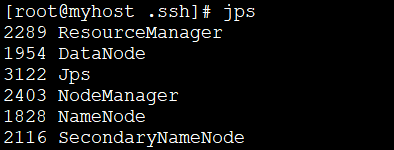

외부 클라이언트에게 HDFS는 전통적인 계층적 파일 시스템처럼 보입니다. 파일을 생성, 삭제, 이동하거나 이름을 바꾸는 등의 작업을 수행할 수 있습니다. 그러나 HDFS의 아키텍처는 고유한 특성에 따라 결정되는 특정 노드 집합(그림 1 참조)을 기반으로 구축됩니다. 이러한 노드에는 HDFS 내에서 메타데이터 서비스를 제공하는 NameNode(단 하나)와 HDFS에 스토리지 블록을 제공하는 DataNode가 포함됩니다. NameNode가 하나만 존재하기 때문에 이는 HDFS 1.x 버전의 단점(단일 실패 지점)입니다. Hadoop 2.x 버전에서는 두 개의 NameNode가 존재할 수 있어 단일 노드 오류 문제를 해결합니다.

HDFS에 저장된 파일은 블록으로 나누어지고 이 블록은 여러 컴퓨터(DataNode)에 복사됩니다. 이는 기존 RAID 아키텍처와 매우 다릅니다. 블록 크기(기본값은 1.x의 경우 64MB, 2.x의 경우 128MB)와 복사된 블록 수는 파일이 생성될 때 클라이언트에 의해 결정됩니다. NameNode는 모든 파일 작업을 제어합니다. HDFS 내의 모든 통신은 표준 TCP/IP 프로토콜을 기반으로 합니다.

더 많은 관련 지식을 보려면 PHP 중국어 웹사이트를 방문하세요!

위 내용은 hadoop에서 hdfs의 역할은 무엇입니까?의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7488

7488

15

15

1377

1377

52

52

77

77

11

11

51

51

19

19

19

19

39

39

Java 오류: Hadoop 오류, 처리 및 방지 방법

Jun 24, 2023 pm 01:06 PM

Java 오류: Hadoop 오류, 처리 및 방지 방법

Jun 24, 2023 pm 01:06 PM

Java 오류: Hadoop 오류, 처리 및 방지 방법 Hadoop을 사용하여 빅 데이터를 처리할 때 작업 실행에 영향을 미치고 데이터 처리 실패를 유발할 수 있는 Java 예외 오류가 자주 발생합니다. 이 기사에서는 몇 가지 일반적인 Hadoop 오류를 소개하고 이를 처리하고 방지하는 방법을 제공합니다. Java.lang.OutOfMemoryErrorOutOfMemoryError는 Java 가상 머신의 메모리 부족으로 인해 발생하는 오류입니다. 하둡이 있을 때

hdfs 명령이 무엇입니까?

Mar 14, 2023 pm 03:51 PM

hdfs 명령이 무엇입니까?

Mar 14, 2023 pm 03:51 PM

hdfs 명령은 Hadoop hdfs 시스템의 명령을 나타냅니다. 1. ls 명령, 3. rm 명령, 6. cp 명령; .copyFromLocal 명령; 8. get 명령; 9. copyToLocal 명령 등

빅 데이터 저장 및 쿼리를 위해 Beego에서 Hadoop 및 HBase 사용

Jun 22, 2023 am 10:21 AM

빅 데이터 저장 및 쿼리를 위해 Beego에서 Hadoop 및 HBase 사용

Jun 22, 2023 am 10:21 AM

빅데이터 시대가 도래하면서 데이터의 처리와 저장이 더욱 중요해지고 있으며, 대용량 데이터를 어떻게 효율적으로 관리하고 분석할 것인가가 기업의 과제가 되었습니다. Apache Foundation의 두 가지 프로젝트인 Hadoop과 HBase는 빅데이터 저장 및 분석을 위한 솔루션을 제공합니다. 이 기사에서는 빅데이터 저장 및 쿼리를 위해 Beego에서 Hadoop 및 HBase를 사용하는 방법을 소개합니다. 1. Hadoop 및 HBase 소개 Hadoop은 오픈 소스 분산 스토리지 및 컴퓨팅 시스템입니다.

빅데이터 처리에 PHP와 Hadoop을 사용하는 방법

Jun 19, 2023 pm 02:24 PM

빅데이터 처리에 PHP와 Hadoop을 사용하는 방법

Jun 19, 2023 pm 02:24 PM

데이터의 양이 지속적으로 증가함에 따라 기존의 데이터 처리 방식으로는 더 이상 빅데이터 시대가 가져온 과제를 처리할 수 없습니다. 하둡(Hadoop)은 빅데이터 처리 시 단일 노드 서버로 인해 발생하는 성능 병목 현상을 분산 저장 및 대용량 데이터 처리를 통해 해결하는 오픈소스 분산 컴퓨팅 프레임워크이다. PHP는 웹 개발에 널리 사용되는 스크립팅 언어로 개발 속도가 빠르고 유지 관리가 쉽다는 장점이 있습니다. 이 글에서는 빅데이터 처리를 위해 PHP와 Hadoop을 사용하는 방법을 소개합니다. 하둡이란 무엇인가Hadoop이란

빅 데이터 분야에서 Java 적용 살펴보기: Hadoop, Spark, Kafka 및 기타 기술 스택에 대한 이해

Dec 26, 2023 pm 02:57 PM

빅 데이터 분야에서 Java 적용 살펴보기: Hadoop, Spark, Kafka 및 기타 기술 스택에 대한 이해

Dec 26, 2023 pm 02:57 PM

Java 빅데이터 기술 스택: Hadoop, Spark, Kafka 등 빅데이터 분야에서 Java의 응용을 이해합니다. 데이터의 양이 지속적으로 증가함에 따라 오늘날 인터넷 시대에 빅데이터 기술이 화두가 되고 있습니다. 빅데이터 분야에서 우리는 하둡(Hadoop), 스파크(Spark), 카프카(Kafka) 등의 기술 이름을 자주 듣습니다. 이러한 기술은 매우 중요한 역할을 하며, 널리 사용되는 프로그래밍 언어인 Java는 빅데이터 분야에서도 큰 역할을 합니다. 이 기사에서는 Java의 대규모 애플리케이션에 중점을 둘 것입니다.

PHP를 사용하여 Hadoop, Spark, Flink 등 대규모 데이터 처리를 수행합니다.

May 11, 2023 pm 04:13 PM

PHP를 사용하여 Hadoop, Spark, Flink 등 대규모 데이터 처리를 수행합니다.

May 11, 2023 pm 04:13 PM

데이터의 양이 지속적으로 증가함에 따라 대규모 데이터 처리는 기업이 직면하고 해결해야 할 문제가 되었습니다. 기존의 관계형 데이터베이스는 더 이상 이러한 요구를 충족할 수 없습니다. 대규모 데이터의 저장 및 분석을 위해서는 Hadoop, Spark 및 Flink와 같은 분산 컴퓨팅 플랫폼이 최선의 선택이 되었습니다. 데이터 처리 도구를 선택하는 과정에서 PHP는 개발 및 유지 관리가 쉬운 언어로 개발자들 사이에서 점점 인기를 얻고 있습니다. 이 기사에서는 대규모 데이터 처리에 PHP를 활용하는 방법과 방법을 살펴보겠습니다.

리눅스에 하둡을 설치하는 방법

May 18, 2023 pm 08:19 PM

리눅스에 하둡을 설치하는 방법

May 18, 2023 pm 08:19 PM

1: JDK1을 설치합니다. 다음 명령을 실행하여 JDK1.8 설치 패키지를 다운로드합니다. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2 다음 명령을 실행하여 다운로드한 JDK1.8 설치 패키지의 압축을 풉니다. . tar-zxvfjdk-8u151-linux-x64.tar.gz3. JDK 패키지를 이동하고 이름을 바꿉니다. mvjdk1.8.0_151//usr/java84. Java 환경 변수를 구성합니다. 에코'

PHP의 데이터 처리 엔진(Spark, Hadoop 등)

Jun 23, 2023 am 09:43 AM

PHP의 데이터 처리 엔진(Spark, Hadoop 등)

Jun 23, 2023 am 09:43 AM

현재 인터넷 시대에 대용량 데이터의 처리는 모든 기업과 기관이 직면한 문제입니다. 널리 사용되는 프로그래밍 언어인 PHP는 데이터 처리 속도도 따라잡아야 합니다. 대용량 데이터를 보다 효율적으로 처리하기 위해 PHP 개발에는 Spark 및 Hadoop과 같은 몇 가지 빅 데이터 처리 도구가 도입되었습니다. Spark는 대규모 데이터 세트의 분산 처리에 사용할 수 있는 오픈 소스 데이터 처리 엔진입니다. Spark의 가장 큰 특징은 빠른 데이터 처리 속도와 효율적인 데이터 저장입니다.