대규모 언어 모델에 대한 포괄적인 이해를 위한 읽기 목록은 다음과 같습니다.

현대 대규모 언어 모델의 디자인, 제약 조건 및 진화를 이해하려면 이 기사의 읽기 목록을 따라가세요.

대규모 언어 모델이 대중의 관심을 끌었으며 불과 5년 만에 Transforme과 같은 모델이 자연어 처리 분야를 거의 완전히 변화시켰습니다. 또한 그들은 컴퓨터 비전 및 컴퓨터 생물학과 같은 분야에 혁명을 일으키기 시작했습니다.

Transformers가 모든 사람의 연구 과정에 큰 영향을 미친다는 점을 고려하여 이 기사에서는 기계 학습 연구자 및 실무자가 시작하는 데 도움이 되는 짧은 읽기 목록을 소개합니다.

다음 목록은 주로 일부 학술 연구 논문을 중심으로 연대순으로 확장되었습니다. 물론 그 밖에도 유용한 리소스가 많이 있습니다. 예:

- "The Illustrated Transformer" 작성자: Jay Alammar

- "The Transformer Family" 작성자: Lilian Weng

- "Transformer 모델: 소개 및 카탈로그 — 2023 Edition" 작성자: Xavier Amatriain

- nanoGPT 작성자: Andrej Karpathy Library

주요 아키텍처 및 작업 이해

Transformers 및 대규모 언어 모델을 처음 사용하는 경우 이 기사가 가장 적합합니다.

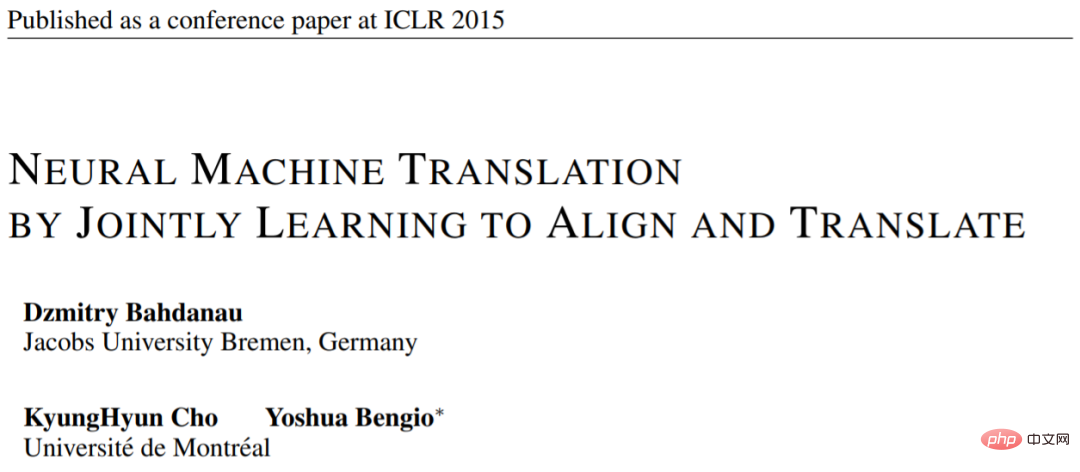

논문 1: "정렬 및 번역을 공동 학습하여 신경 기계 번역"

논문 주소: https://arxiv.org/pdf/1409.0473.pdf

이 기사에서는 순환 신경 네트워크(RNN) 주의 메커니즘은 모델의 장거리 시퀀스 모델링 기능을 향상시킵니다. 이를 통해 RNN은 더 긴 문장을 더 정확하게 번역할 수 있습니다. 이는 원래 Transformer 아키텍처 개발의 동기입니다.

이미지 출처: https://arxiv.org/abs/1409.0473

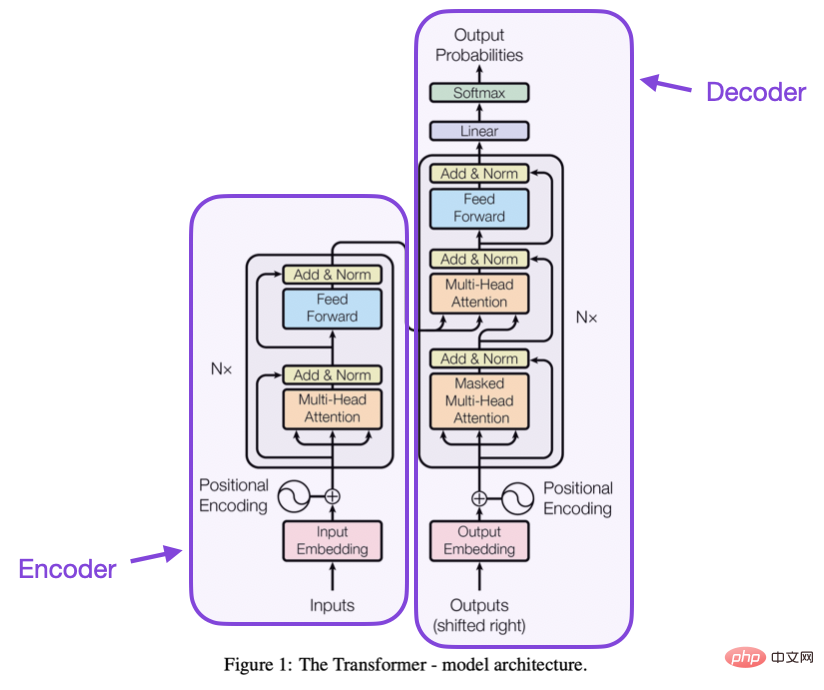

문서 2: "Attention is All You Need"

문서 주소: https://arxiv.org /abs/1706.03762

이 기사에서는 인코더와 디코더로 구성된 원래의 Transformer 아키텍처를 소개합니다. 이러한 부분은 향후 별도의 모듈로 소개될 예정입니다. 또한 이 기사에서는 여전히 현대 Transformers의 기초가 되는 스케일링 내적 주의 메커니즘, 다중 헤드 주의 블록 및 위치 입력 인코딩과 같은 개념을 소개합니다.

이미지 출처: https://arxiv.org/abs/1706.03762

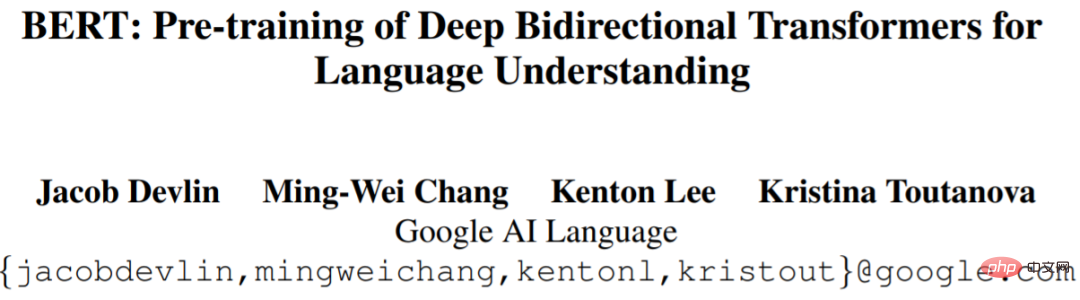

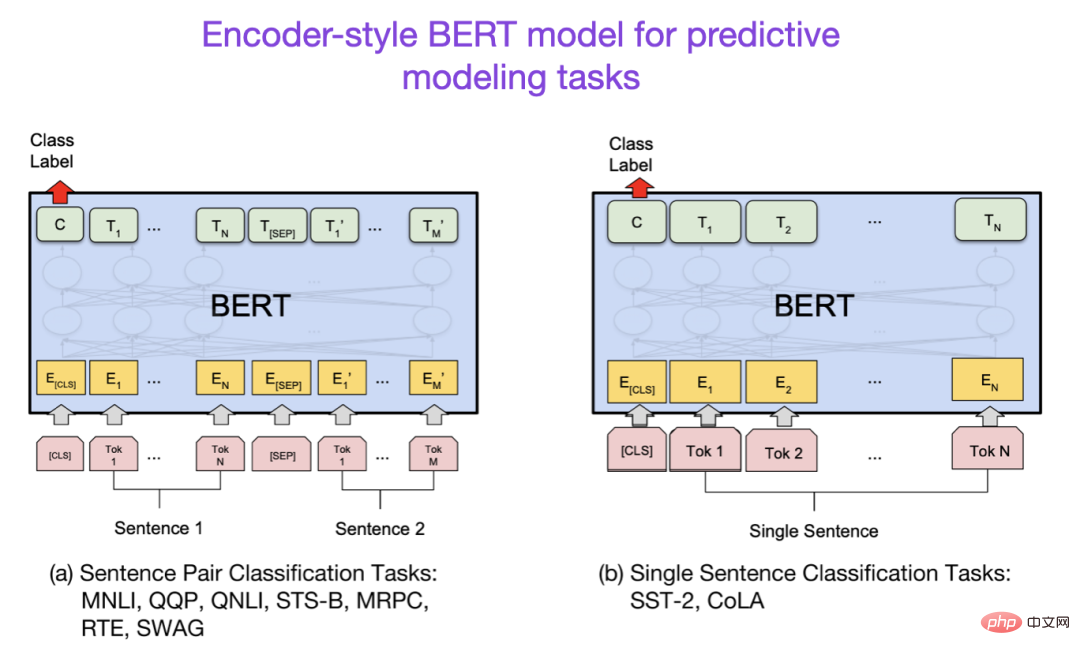

논문 3: "BERT: 언어 이해를 위한 심층 양방향 변환기 사전 훈련"

논문 주소 : https://arxiv.org/abs/1810.04805

대규모 언어 모델 연구는 초기 Transformer 아키텍처를 따랐으며 이후 두 가지 방향으로 확장되기 시작했습니다. 예측 모델링 작업(예: 텍스트 분류)을 위한 Transformer와 생성을 위한 Transformer 번역, 요약 및 기타 형태의 텍스트 생성과 같은 모듈식 작업을 위한 Transformer입니다.

BERT 논문은 마스크된 언어 모델링의 원래 개념을 소개합니다. 이 연구 분야에 관심이 있다면 사전 학습 목표를 단순화하는 RoBERTa를 따라갈 수 있습니다.

이미지 출처: https://arxiv.org/abs/1810.04805

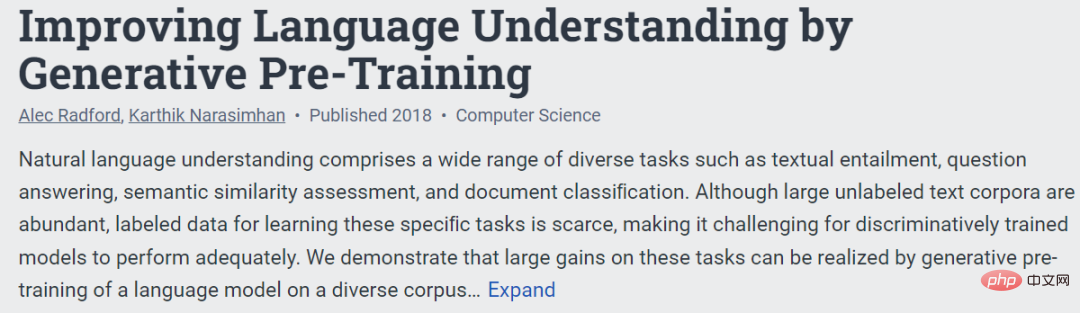

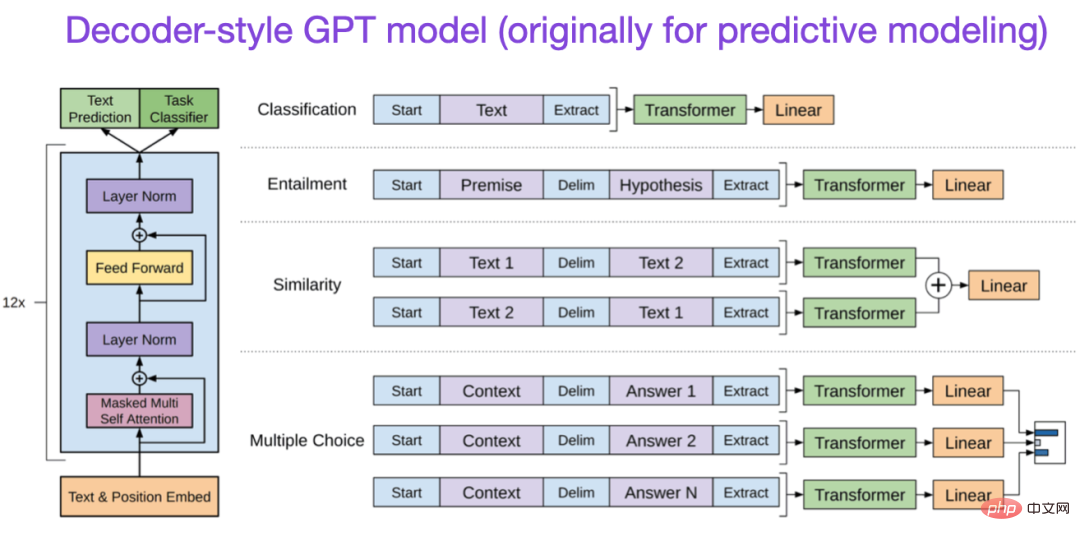

논문 4: "생성 사전 훈련을 통한 언어 이해 향상"

논문 주소: https:// www.semanticscholar.org/paper/Improving-Language-Understanding-by-Generative-Radford-Narasimhan/cd18800a0fe0b668a1cc19f2ec95b5003d0a5035

원본 GPT 논문에서는 인기 있는 디코더 스타일 아키텍처와 다음 단어 예측을 통한 사전 훈련을 소개했습니다. BERT는 마스크된 언어 모델 사전 학습 목표로 인해 양방향 변환기로 간주될 수 있는 반면, GPT는 단방향 자동 회귀 모델입니다. GPT 임베딩을 분류에 사용할 수도 있지만 GPT 방법은 ChatGPT와 같은 오늘날 가장 영향력 있는 LLM의 핵심입니다.

이 연구 분야에 관심이 있다면 GPT-2 및 GPT-3 논문에 대한 후속 조치를 취할 수 있습니다. 또한, 이 글에서는 InstructGPT 방법을 나중에 별도로 소개하겠습니다.

문서 5: "BART: 자연어 생성, 번역 및 이해를 위한 시퀀스-시퀀스 사전 훈련"

논문 주소 https://arxiv.org/abs/1910.13461.

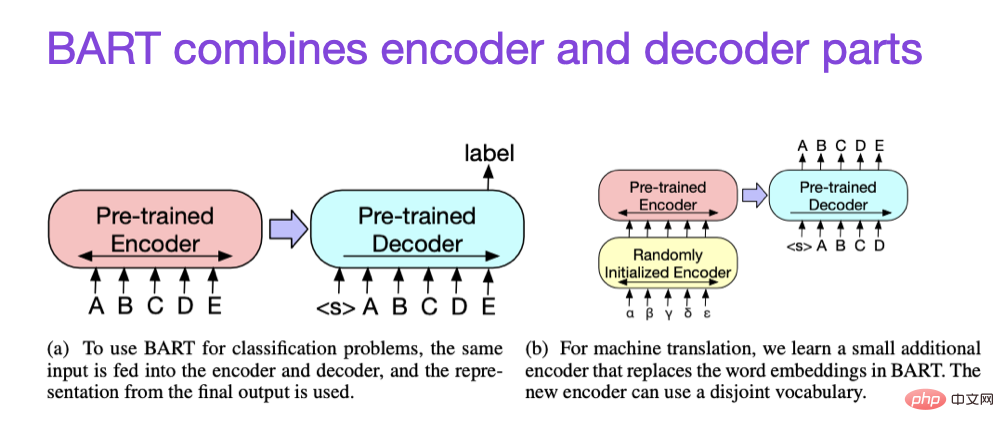

위에서 언급했듯이 일반적으로 예측 모델링 작업에는 BERT 유형 인코더 스타일 LLM이 선호되는 반면, 텍스트 생성에는 GPT 유형 디코더 스타일 LLM이 더 좋습니다. 두 가지 장점을 모두 활용하기 위해 위의 BART 문서는 인코더와 디코더 부분을 결합합니다.

팽창법칙과 효율향상

트랜스포머의 효율을 높이는 기술에 대해 더 알고 싶다면 다음 논문을 참고하세요

- 제1편 "트랜스포머의 효율적인 훈련에 관한 조사"

- 논문 주소: https://arxiv.org/abs/2302.01107

- 논문 2: "FlashAttention: IO 인식을 통한 빠르고 메모리 효율적인 정확한 주의"

- 논문 주소: https:// arxiv.org /abs/2205.14135

- 문서 3: "Cramming: 하루 만에 단일 GPU에서 언어 모델 훈련"

- 문서 주소: https://arxiv.org/abs/2212.14034

- 문서 4: "컴퓨팅 최적의 대형 언어 모델 교육"

- 논문 주소: https://arxiv.org/abs/2203.15556

또한 "컴퓨팅 최적화 교육"이라는 논문도 있습니다. Large Language Models"

논문 주소: https://arxiv.org/abs/2203.15556

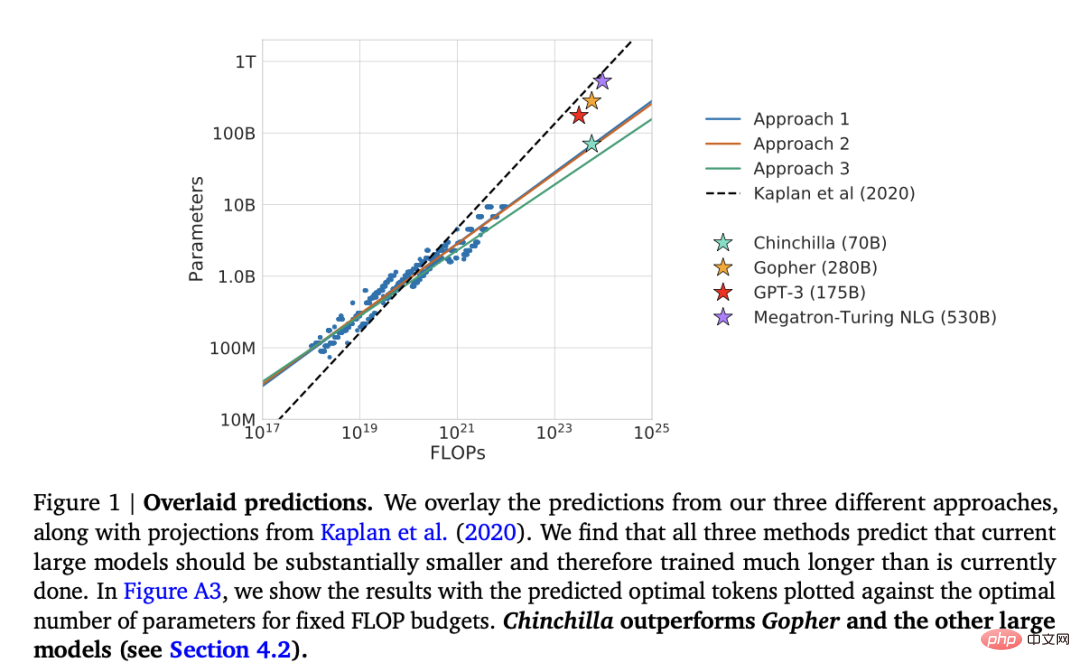

이 문서에서는 생성 모델링 작업에서 인기 있는 1,750억 매개변수 GPT-3 모델보다 뛰어난 700억 매개변수 Chinchilla 모델을 소개합니다. 그러나 가장 중요한 점은 현대의 대규모 언어 모델이 심각하게 훈련이 부족하다는 것입니다.

이 문서에서는 대규모 언어 모델 훈련을 위한 선형 확장 법칙을 정의합니다. 예를 들어 Chinchilla는 크기가 GPT-3의 절반이지만 1조 4천억 개(3천억 개가 아닌) 토큰으로 훈련되었기 때문에 GPT-3보다 성능이 뛰어납니다. 즉, 훈련 토큰의 개수는 모델 크기만큼 중요합니다.

정렬 - 원하는 목표와 관심 사항을 향해 대규모 언어 모델 조정

최근에는 실제 텍스트를 생성할 수 있는 상대적으로 강력한 대규모 언어 모델이 많이 등장했습니다(GPT-3 및 Chinchilla 등). 일반적으로 사용되는 사전 훈련 패러다임으로는 상한선에 도달한 것으로 보입니다.

언어 모델을 인간에게 더 유용하게 만들고 잘못된 정보와 나쁜 언어를 줄이기 위해 연구자들은 다음 논문을 포함하여 사전 훈련된 기본 모델을 미세 조정하기 위한 추가 훈련 패러다임을 설계했습니다.

- 논문 1: "사람의 피드백으로 지침을 따르도록 언어 모델 훈련"

- 논문 주소: https://arxiv.org/abs/2203.02155

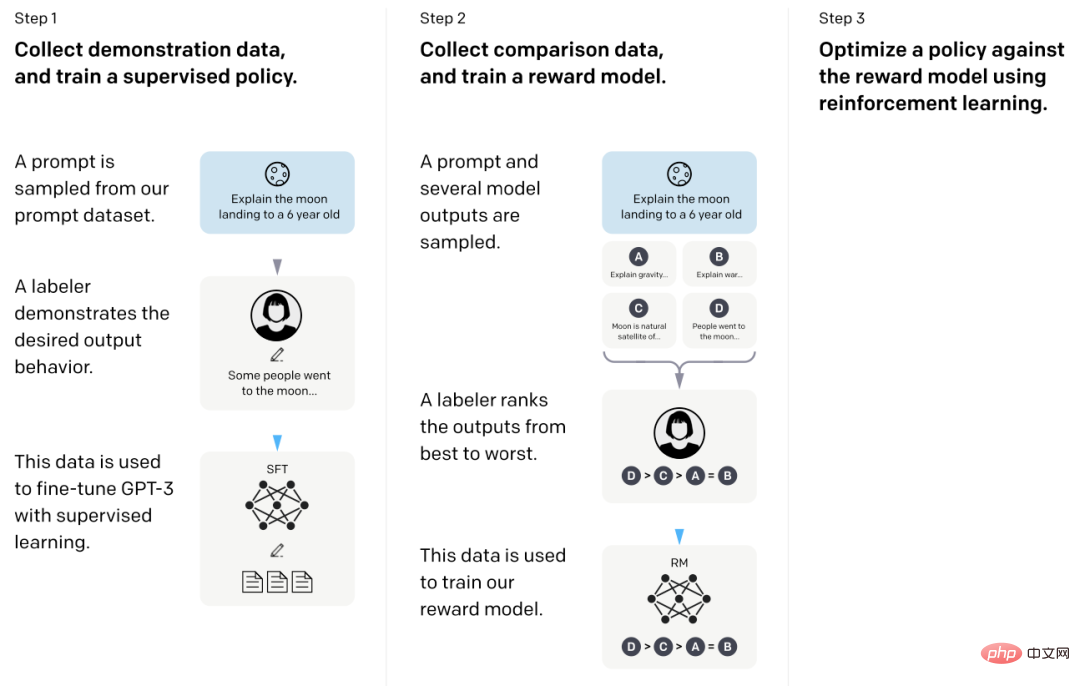

이 소위 InstructGPT 논문에서 연구자들은 RLHF(Reinforcement Learning)를 사용했습니다. 인간 피드백에서). 그들은 사전 훈련된 GPT-3 기본 모델로 시작하여 지도 학습(1단계)을 사용하여 인간이 생성한 큐-응답 쌍에서 이를 더욱 미세 조정했습니다. 다음으로 보상 모델을 훈련하기 위해 모델 출력의 순위를 매기도록 인간에게 요청했습니다(2단계). 마지막으로 보상 모델을 사용하여 근위 정책 최적화를 통한 강화 학습을 사용하여 사전 훈련되고 미세 조정된 GPT-3 모델을 업데이트합니다(3단계).

그런데 이 논문은 ChatGPT의 아이디어를 설명하는 논문으로도 알려져 있습니다. 최근 소문에 따르면 ChatGPT는 더 큰 데이터 세트에서 미세 조정된 InstructGPT의 확장 버전입니다.

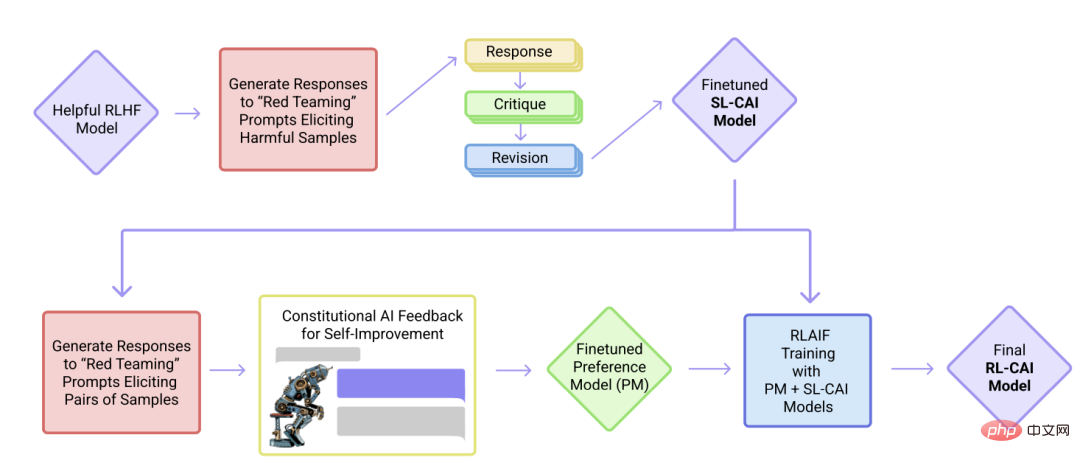

- 논문 2: "헌법적 AI: AI 피드백의 무해함"

- 논문 주소: https://arxiv.org/abs/2212.08073

이 논문에서 연구자들은 정렬 아이디어를 더욱 발전시키고 A 훈련을 제안합니다. "무해한" AI 시스템을 만드는 메커니즘. 연구자들은 인간의 직접적인 감독이 아닌 (인간이 제공한) 규칙 목록을 기반으로 한 자가 훈련 메커니즘을 제안했습니다. 위에서 언급한 InstructGPT 논문과 유사하게 제안하는 방법은 강화학습 방법을 사용합니다.

요약

이 글은 위의 테이블 배열을 최대한 단순하고 아름답게 유지하려고 노력합니다. 현대 대규모의 디자인, 한계 및 진화를 이해하려면 처음 10개의 논문에 집중하는 것이 좋습니다. 언어 모델.

더 깊게 읽고 싶다면 위 논문의 참고문헌을 참고하는 것이 좋습니다. 또는 독자가 추가로 조사할 수 있는 추가 리소스는 다음과 같습니다.

GPT에 대한 오픈 소스 대안

- 논문 1: "BLOOM: 176B 매개변수 개방형 액세스 다국어 모델"

- 논문 주소: https: / /arxiv.org/abs/2211.05100

- 문서 2: "OPT: 사전 훈련된 Transformer 언어 모델 열기"

- 문서 주소: https://arxiv.org/abs/2205.01068

대안 to ChatGPT

- 문서 1 "LaMDA: 대화 상자 응용 프로그램을 위한 언어 모델"

- 문서 주소: https://arxiv.org/abs/2201.08239

- 문서 2: "대화 정렬 개선" 에이전트 목표로 삼은 인간 판단을 통해》

- 논문 주소: https://arxiv.org/abs/2209.14375

- 논문 3: "BlenderBot 3: 책임감 있게 참여하는 방법을 지속적으로 학습하는 배포된 대화 에이전트"

- 논문 주소 : https://arxiv.org/abs/2208.03188

전산 생물학의 대규모 언어 모델

- 논문 1: "ProtTrans: 자기 지도 학습을 통해 생명 코드의 언어 해독을 향하여"

- 논문 주소: https://arxiv.org/abs/2007.06225

- 논문 2: "AlphaFold를 이용한 매우 정확한 단백질 구조 예측"

- 논문 주소: https://www.nature.com/articles/s41586 -021-03819-2

- 논문 3: "대규모 언어 모델은 다양한 가족에 걸쳐 기능성 단백질 서열을 생성합니다"

- 논문 주소: https://www.nature.com/articles/s41587-022- 01618 -2

위 내용은 대규모 언어 모델에 대한 포괄적인 이해를 위한 읽기 목록은 다음과 같습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7695

7695

15

15

1640

1640

14

14

1393

1393

52

52

1287

1287

25

25

1229

1229

29

29

Web3 Trading Platform Ranking_Web3 글로벌 교환 상위 10 개 요약

Apr 21, 2025 am 10:45 AM

Web3 Trading Platform Ranking_Web3 글로벌 교환 상위 10 개 요약

Apr 21, 2025 am 10:45 AM

Binance는 Global Digital Asset Trading Ecosystem의 대 군주이며, 그 특성에는 다음이 포함됩니다. 1. 평균 일일 거래량은 1,500 억 달러를 초과하여 주류 통화의 98%를 차지하며 500 개의 거래 쌍을 지원합니다. 2. 혁신 매트릭스는 파생 상품 시장, Web3 레이아웃 및 교육 시스템을 포함합니다. 3. 기술적 이점은 밀리 초에 일치하는 엔진이며, 최고 처리량은 초당 140 만 건의 트랜잭션입니다. 4. 규정 준수 진행 상황은 15 개국 라이센스를 보유하고 있으며 유럽과 미국에 준수 엔티티를 설립합니다.

Worldcoin (WLD) 가격 예측 2025-2031 : WLD가 2031 년까지 4 달러에 도달 할 것인가?

Apr 21, 2025 pm 02:42 PM

Worldcoin (WLD) 가격 예측 2025-2031 : WLD가 2031 년까지 4 달러에 도달 할 것인가?

Apr 21, 2025 pm 02:42 PM

Worldcoin (WLD)은 Cryptocurrency 시장에서 고유 한 생체 인정 및 개인 정보 보호 메커니즘으로 눈에 띄고 많은 투자자의 관심을 끌고 있습니다. WLD는 혁신적인 기술, 특히 OpenAi 인공 지능 기술과 함께 Altcoins에서 뛰어난 성과를 거두었습니다. 그러나 향후 몇 년 안에 디지털 자산은 어떻게 행동 할 것인가? WLD의 미래 가격을 함께 예측합시다. 2025 WLD 가격 예측은 2025 년 WLD에서 상당한 성장을 달성 할 것으로 예상됩니다. 시장 분석에 따르면 평균 WLD 가격은 최대 $ 1.36로 $ 1.31에 도달 할 수 있습니다. 그러나 곰 시장에서 가격은 약 $ 0.55로 떨어질 수 있습니다. 이러한 성장 기대는 주로 WorldCoin2에 기인합니다.

통화에서 레버리지 교환 순위 순위 서클 통화 서클에서 상위 10 개의 레버리지 거래소의 최신 권장 사항

Apr 21, 2025 pm 11:24 PM

통화에서 레버리지 교환 순위 순위 서클 통화 서클에서 상위 10 개의 레버리지 거래소의 최신 권장 사항

Apr 21, 2025 pm 11:24 PM

2025 년에 레버리지 거래, 보안 및 사용자 경험에서 뛰어난 성능을 보이는 플랫폼은 다음과 같습니다. 1. OKX, 고주파 거래자에게 적합하여 최대 100 배의 레버리지를 제공합니다. 2. Binance, 전 세계의 다중 통화 거래자에게 적합하며 125 배 높은 레버리지를 제공합니다. 3. Gate.io, 전문 파생 상품 플레이어에게 적합하며 100 배의 레버리지를 제공합니다. 4. 초보자 및 소셜 트레이더에게 적합한 Bitget, 최대 100 배의 레버리지를 제공합니다. 5. 크라켄은 꾸준한 투자자에게 적합하며 5 배의 레버리지를 제공합니다. 6. Bybit, Altcoin Explorers에 적합하며 20 배의 레버리지를 제공합니다. 7. 저비용 거래자에게 적합한 Kucoin, 10 배의 레버리지를 제공합니다. 8. 비트 피 넥스, 시니어 플레이에 적합합니다

크로스 체인 거래는 무엇을 의미합니까? 크로스 체인 거래는 무엇입니까?

Apr 21, 2025 pm 11:39 PM

크로스 체인 거래는 무엇을 의미합니까? 크로스 체인 거래는 무엇입니까?

Apr 21, 2025 pm 11:39 PM

크로스 체인 거래를 지원하는 교환 : 1. Binance, 2. Uniswap, 3. Sushiswap, 4. Curve Finance, 5. Thorchain, 6. 1inch Exchange, 7. DLN 거래,이 플랫폼은 다양한 기술을 통해 다중 체인 자산 거래를 지원합니다.

'Black Monday Sell'은 Cryptocurrency 업계의 힘든 날입니다.

Apr 21, 2025 pm 02:48 PM

'Black Monday Sell'은 Cryptocurrency 업계의 힘든 날입니다.

Apr 21, 2025 pm 02:48 PM

cryptocurrency 시장의 급락으로 인해 투자자들 사이에 공황이 발생했으며 Dogecoin (Doge)은 가장 어려운 지역 중 하나가되었습니다. 가격은 급격히 하락했으며 분산 금융 (DEFI) (TVL)의 총 가치 잠금 장치도 크게 감소했습니다. "Black Monday"의 판매 물결은 cryptocurrency 시장을 휩쓸었고 Dogecoin은 처음으로 타격을 받았습니다. DefitVl은 2023 년 수준으로 떨어졌고 지난 달 통화 가격은 23.78% 하락했습니다. Dogecoin의 Defitvl은 주로 SOSO 가치 지수의 26.37% 감소로 인해 272 만 달러로 떨어졌습니다. 지루한 Dao 및 Thorchain과 같은 다른 주요 Defi 플랫폼도 TVL도 각각 24.04% 및 20으로 떨어졌습니다.

가상 통화 가격의 상승 또는 하락은 왜입니까? 가상 통화 가격의 상승 또는 하락은 왜입니까?

Apr 21, 2025 am 08:57 AM

가상 통화 가격의 상승 또는 하락은 왜입니까? 가상 통화 가격의 상승 또는 하락은 왜입니까?

Apr 21, 2025 am 08:57 AM

가상 통화 가격 상승의 요인은 다음과 같습니다. 1. 시장 수요 증가, 2. 공급 감소, 3. 긍정적 인 뉴스, 4. 낙관적 시장 감정, 5. 거시 경제 환경; 감소 요인에는 다음이 포함됩니다. 1. 시장 수요 감소, 2. 공급 증가, 3. 부정적인 뉴스의 파업, 4. 비관적 시장 감정, 5. 거시 경제 환경.

Binance 전체 프로세스 전략에 대한 커널 에어 드롭 보상을받는 방법

Apr 21, 2025 pm 01:03 PM

Binance 전체 프로세스 전략에 대한 커널 에어 드롭 보상을받는 방법

Apr 21, 2025 pm 01:03 PM

암호 화폐의 번화 한 세계에서는 새로운 기회가 항상 나타납니다. 현재 Kerneldao (Kernel) 에어 드롭 활동은 많은 관심을 끌고 많은 투자자들의 관심을 끌고 있습니다. 그렇다면이 프로젝트의 기원은 무엇입니까? BNB 보유자는 어떤 이점을 얻을 수 있습니까? 걱정하지 마십시오. 다음은 당신을 위해 하나씩 공개 할 것입니다.

Aavenomics는 AAVE 프로토콜 토큰을 수정하고 쿼럼 수의 사람들에게 도달 한 토큰 재구매를 소개하는 권장 사항입니다.

Apr 21, 2025 pm 06:24 PM

Aavenomics는 AAVE 프로토콜 토큰을 수정하고 쿼럼 수의 사람들에게 도달 한 토큰 재구매를 소개하는 권장 사항입니다.

Apr 21, 2025 pm 06:24 PM

Aavenomics는 AAVE 프로토콜 토큰을 수정하고 Aavedao의 쿼럼을 구현 한 Token Repos를 소개하는 제안입니다. AAVE 프로젝트 체인 (ACI)의 설립자 인 Marc Zeller는 X에서 이것을 발표하여 계약의 새로운 시대를 표시한다고 지적했습니다. AAVE 체인 이니셔티브 (ACI)의 설립자 인 Marc Zeller는 AAVENOMICS 제안서에 AAVE 프로토콜 토큰 수정 및 토큰 리포지션 도입이 포함되어 있다고 X에서 AAVEDAO에 대한 쿼럼을 달성했다고 발표했습니다. Zeller에 따르면, 이것은 계약의 새로운 시대를 나타냅니다. Aavedao 회원국은 수요일에 주당 100 인 제안을지지하기 위해 압도적으로 투표했습니다.