VAE 표현 학습 문제를 해결하기 위해 홋카이도 대학은 새로운 생성 모델 GWAE를 제안했습니다.

고차원 데이터의 저차원 표현을 학습하는 것은 비지도 학습의 기본 작업입니다. 이러한 표현을 통해 데이터의 본질을 간결하게 포착하고 저차원 입력을 기반으로 다운스트림 작업을 수행할 수 있기 때문입니다. VAE(Variational Autoencoder)는 중요한 표현 학습 방법이지만 객관적인 제어로 인해 표현 학습은 여전히 어려운 작업입니다. VAE의 증거 하한(ELBO) 목표는 생성적으로 모델링되지만 학습 표현은 이 목표를 직접적으로 목표로 삼지 않으며, 이는 얽힘 풀기와 같은 표현 학습 작업에 대한 특정 수정이 필요합니다. 이러한 수정은 때때로 모델에 암시적이고 바람직하지 않은 변경을 초래하여 제어된 표현 학습을 어려운 작업으로 만듭니다.

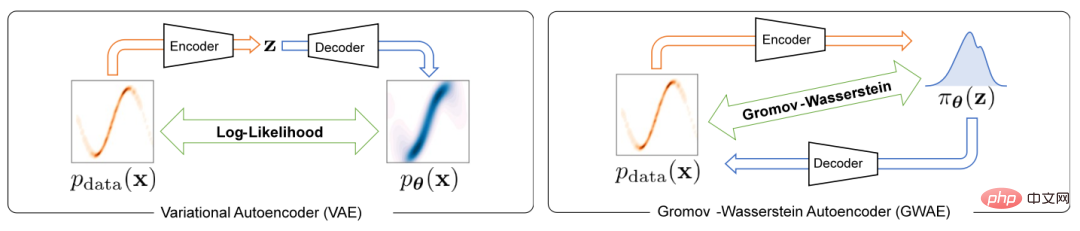

Variational Autoencoder의 표현 학습 문제를 해결하기 위해 본 논문에서는 Gromov-Wasserstein Autoencoders(GWAE)라는 새로운 생성 모델을 제안합니다. GWAE는 VAE(Variational Autoencoder) 모델 아키텍처를 기반으로 표현 학습을 위한 새로운 프레임워크를 제공합니다. 데이터 변수의 생성 모델링을 위한 기존 VAE 기반 표현 학습 방법과 달리 GWAE는 데이터와 잠재 변수 간의 최적 전송을 통해 유익한 표현을 얻습니다. Gromov-Wasserstein(GW) 측정법은 고려 중인 변수의 거리 구조에 초점을 맞춘 비교할 수 없는 변수(예: 서로 다른 차원을 가진 변수) 간의 최적의 전송을 가능하게 합니다. ELBO 목표를 GW 메트릭으로 대체함으로써 GWAE는 변형 자동 인코더의 표현 학습을 직접 목표로 데이터와 잠재 공간 간의 비교를 수행합니다(그림 1). 표현 학습의 이러한 공식화를 통해 학습된 표현은 메타 우선순위라고 불리는 유익한 것으로 간주되는 특정 속성(예: 분해성)을 가질 수 있습니다.

그림 1 VAE와 GWAE의 차이점

이 연구는 ICLR 2023에서 승인되었습니다.

- 논문 링크: https://arxiv.org/abs/2209.07007

- 코드 링크: https://github.com/ganmodokix/gwae

방법 소개

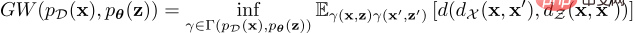

데이터 분포와 잠재적 사전 분포 간의 GW 목표는 다음과 같이 정의됩니다.

이 최적 전송 비용 공식은 비교할 수 없는 공간에서 분포의 불일치를 측정할 수 있지만 연속 분포의 경우 모든 커플링의 하한은 하한이므로 정확한 GW 값을 계산하는 것은 비현실적입니다. 이 문제를 해결하기 위해 GWAE는 자동 미분을 통해 기울기를 계산할 수 있는 GW 추정기를 추정하고 최소화하기 위해 완화된 최적화 문제를 해결합니다. 완화 목표는 추정된 GW 메트릭과 세 가지 정규화 손실의 합이며, 이는 모두 PyTorch와 같은 미분 가능한 프로그래밍 프레임워크에서 구현될 수 있습니다. 이 완화 목표는 주요 손실과 세 가지 정규화 손실, 즉 주요 추정 GW 손실, WAE 기반 재구성 손실, 병합된 충분 조건 손실 및 엔트로피 정규화 손실로 구성됩니다.

이 체계는 사전 분포를 유연하게 맞춤 설정하여 저차원 표현에 유익한 기능을 도입할 수도 있습니다. 구체적으로 이 문서에서는 세 가지 사전 모집단, 즉 다음을 소개합니다.

Neural Prior(NP) NP가 있는 GWAE에서는 완전히 연결된 신경망을 사용하여 사전 샘플링 장치를 구성합니다. 이 사전 분포군은 기본 변수에 대해 더 적은 가정을 하며 일반적인 상황에 적합합니다.

Factorized Neural Prior(FNP) FNP를 사용하는 GWAE에서 샘플러는 로컬로 연결된 신경망을 사용하여 구축되며, 여기서 각 잠재 변수에 대한 항목은 독립적으로 생성됩니다. 이 샘플러는 인수분해된 사전 표현과 용어 독립적 표현을 생성하며, 이는 대표 메타 우선, 분리를 위한 탁월한 방법입니다.

Gaussian Mixture Prior(GMP) GMP에서는 여러 가우시안 분포의 혼합으로 정의되며, Heavy 매개변수화 기술과 Gumbel-Max 기술을 사용하여 해당 샘플러를 구현할 수 있습니다. GMP를 사용하면 사전의 각 가우스 구성 요소가 클러스터를 캡처할 것으로 예상되는 표현에서 클러스터를 가정할 수 있습니다.

실험 및 결과

이 연구는 두 가지 주요 메타 우선순위인 분리 및 클러스터링을 사용하여 GWAE를 경험적으로 평가합니다.

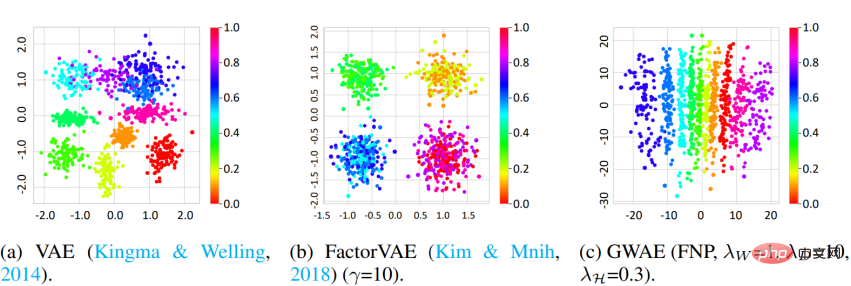

Disentanglement 이 연구에서는 3D Shapes 데이터 세트와 DCI 측정법을 사용하여 GWAE의 분리 기능을 측정했습니다. 결과는 FNP를 사용하는 GWAE가 단일 축에서 물체 색상 요소를 학습할 수 있음을 보여 주며, 이는 GWAE의 분리 기능을 보여줍니다. 정량적 평가는 또한 GWAE의 분리 성능을 보여줍니다.

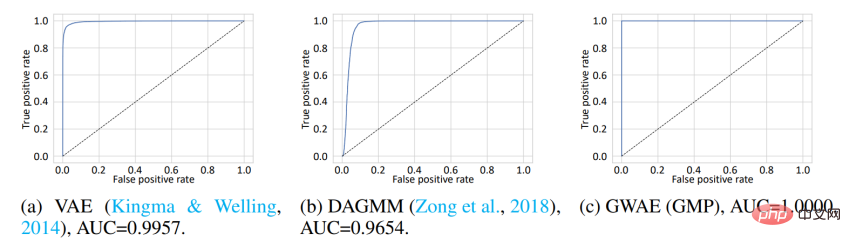

클러스터링 클러스터링 메타 우선순위를 기반으로 얻은 표현을 평가하기 위해 본 연구에서는 OoD(Out-of-Distribution) 탐지를 수행했습니다. MNIST 데이터세트는 ID(In-Distribution) 데이터로 사용되며 Omniglot 데이터세트는 OoD 데이터로 사용됩니다. MNIST에는 손으로 쓴 숫자가 포함되어 있지만 Omniglot에는 다양한 문자가 포함된 손으로 쓴 문자가 포함되어 있습니다. 본 실험에서 ID와 OoD 데이터 세트는 손으로 쓴 이미지의 도메인을 공유하지만 서로 다른 문자를 포함합니다. 모델은 ID 데이터에 대해 교육을 받은 다음 학습된 표현을 사용하여 ID 또는 OoD 데이터를 감지합니다. VAE 및 DAGMM에서 OoD 감지에 사용되는 변수는 사전 로그 우도이고, GWAE에서는 칸토로비치 전위입니다. GWAE의 이전 버전은 MNIST 클러스터를 캡처하기 위해 GMP를 사용하여 구성되었습니다. ROC 곡선은 모델의 OoD 감지 성능을 보여 주며 세 가지 모델 모두 거의 완벽한 성능을 달성했지만 GMP를 사용하여 구축된 GWAE는 AUC(곡선 아래 면적) 측면에서 가장 좋은 성능을 보였습니다.

또한 본 연구에서는 GWAE의 생성 능력을 평가했습니다.

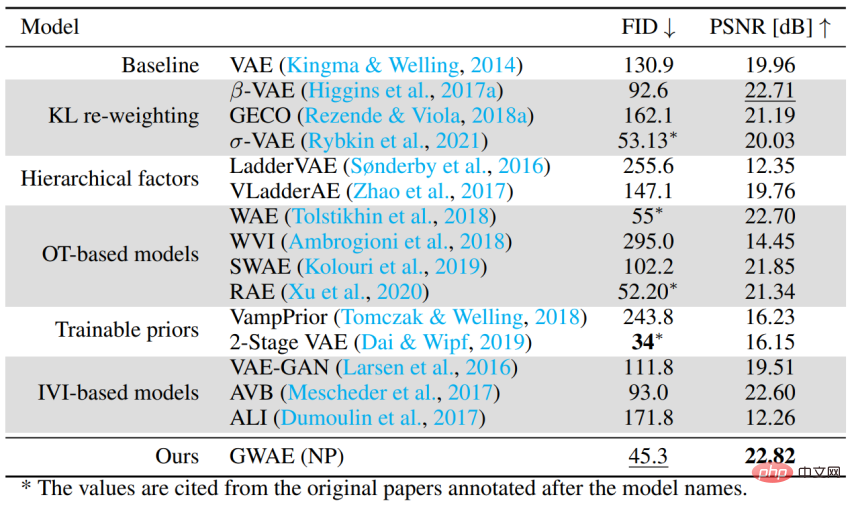

오토인코더 기반 생성 모델로서의 성능 특정 메타 우선 순위 없이 일반적인 사례를 처리하는 GWAE의 능력을 평가하기 위해 CelebA 데이터 세트를 사용하여 생성 성능을 평가했습니다. 실험에서는 FID를 사용하여 모델의 생성 성능을 평가하고 PSNR을 사용하여 자동 인코딩 성능을 평가합니다. GWAE는 NP를 사용하여 두 번째로 좋은 생성 성능과 최고의 자동 인코딩 성능을 달성하여 모델에서 데이터 분포를 캡처하고 표현에서 데이터 정보를 캡처하는 능력을 입증했습니다.

Summary

- GWAE는 Gromov-Wasserstein 메트릭을 기반으로 구축된 Varial Autoencoder 생성 모델로 표현 학습을 직접 수행하도록 설계되었습니다.

- 사전에는 미분 가능한 샘플만 필요하므로 다양한 사전 분포 설정을 구성하여 메타 우선 순위(표현의 이상적인 속성)를 가정할 수 있습니다.

- 일차 메타 우선순위와 변형 자동 인코더로서의 성능 평가에 대한 실험은 GWAE 공식화의 유연성과 GWAE의 표현 학습 기능을 보여줍니다.

- 제1저자 Nao Nakagawa 개인 홈페이지: https://ganmodokix.com/note/cv

- 홋카이도대학 멀티미디어 연구소 홈페이지: https://www-lmd.ist.hokudai. /

위 내용은 VAE 표현 학습 문제를 해결하기 위해 홋카이도 대학은 새로운 생성 모델 GWAE를 제안했습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7554

7554

15

15

1382

1382

52

52

83

83

11

11

59

59

19

19

22

22

96

96

AI 스타트업들이 집단적으로 OpenAI로 직무를 전환했고, Ilya가 떠난 후 보안팀이 재편성되었습니다!

Jun 08, 2024 pm 01:00 PM

AI 스타트업들이 집단적으로 OpenAI로 직무를 전환했고, Ilya가 떠난 후 보안팀이 재편성되었습니다!

Jun 08, 2024 pm 01:00 PM

지난주 내부 사퇴와 외부 비판의 물결 속에서 OpenAI는 대내외적 난관에 봉착했다. - 미망인 여동생의 침해로 글로벌 열띤 논의가 촉발됐다. - '대군주 조항'에 서명한 직원들이 잇달아 폭로됐다. - 네티즌들은 울트라맨의 '' 일곱 가지 대죄" ” 소문 파기: Vox가 입수한 유출된 정보와 문서에 따르면 Altman을 포함한 OpenAI의 고위 경영진은 이러한 지분 회수 조항을 잘 알고 있었고 이에 서명했습니다. 또한 OpenAI가 직면한 심각하고 시급한 문제인 AI 보안이 있습니다. 최근 가장 눈에 띄는 직원 2명을 포함해 보안 관련 직원 5명이 퇴사하고, '슈퍼얼라인먼트' 팀이 해체되면서 OpenAI의 보안 문제가 다시 한 번 주목을 받고 있다. 포춘지는 OpenA가

Java 프레임워크에 대한 상용 지원의 비용 효율성을 평가하는 방법

Jun 05, 2024 pm 05:25 PM

Java 프레임워크에 대한 상용 지원의 비용 효율성을 평가하는 방법

Jun 05, 2024 pm 05:25 PM

Java 프레임워크에 대한 상용 지원의 비용/성능 평가에는 다음 단계가 포함됩니다. 필요한 보증 수준과 SLA(서비스 수준 계약) 보장을 결정합니다. 연구지원팀의 경험과 전문성. 업그레이드, 문제 해결, 성능 최적화와 같은 추가 서비스를 고려하십시오. 위험 완화 및 효율성 향상을 기준으로 비즈니스 지원 비용을 평가합니다.

70B 모델은 몇 초 안에 1,000개의 토큰을 생성하고 코드 재작성은 OpenAI가 투자한 코드 아티팩트인 Cursor 팀의 GPT-4o를 능가합니다.

Jun 13, 2024 pm 03:47 PM

70B 모델은 몇 초 안에 1,000개의 토큰을 생성하고 코드 재작성은 OpenAI가 투자한 코드 아티팩트인 Cursor 팀의 GPT-4o를 능가합니다.

Jun 13, 2024 pm 03:47 PM

70B 모델에서는 1000개의 토큰을 몇 초 만에 생성할 수 있으며 이는 거의 4000자로 변환됩니다! 연구진은 Llama3를 미세 조정하고 가속 알고리즘을 도입하여 기본 버전과 비교하여 속도가 13배 빨라졌습니다. 속도가 빠를 뿐만 아니라 코드 재작성 작업 성능도 GPT-4o를 능가합니다. 이 성과는 인기 있는 AI 프로그래밍 아티팩트인 Cursor를 개발한 팀과 OpenAI도 투자에 참여한 anysphere에서 이루어졌습니다. 빠른 추론 가속 프레임워크로 잘 알려진 Groq에서는 70BLlama3의 추론 속도가 초당 300개 토큰이 조금 넘는다는 사실을 아셔야 합니다. Cursor의 속도 덕분에 거의 즉각적인 완전한 코드 파일 편집이 가능하다고 할 수 있습니다. 어떤 사람들은 좋은 사람이라고 커스를 넣으면

PHP 프레임워크의 학습 곡선은 다른 언어 프레임워크와 어떻게 비교됩니까?

Jun 06, 2024 pm 12:41 PM

PHP 프레임워크의 학습 곡선은 다른 언어 프레임워크와 어떻게 비교됩니까?

Jun 06, 2024 pm 12:41 PM

PHP 프레임워크의 학습 곡선은 언어 숙련도, 프레임워크 복잡성, 문서 품질 및 커뮤니티 지원에 따라 달라집니다. PHP 프레임워크의 학습 곡선은 Python 프레임워크에 비해 높고 Ruby 프레임워크에 비해 낮습니다. Java 프레임워크에 비해 PHP 프레임워크는 학습 곡선이 적당하지만 시작하는 데 걸리는 시간이 더 짧습니다.

PHP 프레임워크의 경량 옵션은 애플리케이션 성능에 어떤 영향을 줍니까?

Jun 06, 2024 am 10:53 AM

PHP 프레임워크의 경량 옵션은 애플리케이션 성능에 어떤 영향을 줍니까?

Jun 06, 2024 am 10:53 AM

경량 PHP 프레임워크는 작은 크기와 낮은 리소스 소비를 통해 애플리케이션 성능을 향상시킵니다. 그 특징은 다음과 같습니다: 작은 크기, 빠른 시작, 낮은 메모리 사용량, 향상된 응답 속도 및 처리량, 리소스 소비 감소 실제 사례: SlimFramework는 500KB에 불과한 REST API를 생성하며 높은 응답성과 높은 처리량을 제공합니다.

차이나모바일 : 인류가 4차 산업혁명을 맞이하며 '3대 계획' 공식 발표

Jun 27, 2024 am 10:29 AM

차이나모바일 : 인류가 4차 산업혁명을 맞이하며 '3대 계획' 공식 발표

Jun 27, 2024 am 10:29 AM

26일 뉴스에 따르면 2024년 상하이 세계이동통신회의(MWC 상하이) 개막식에서 양지에 차이나모바일 회장이 연설을 했다. 그는 현재 인류사회는 정보가 지배하고 정보와 에너지가 깊이 융합되는 4차 산업혁명, 즉 '디지털·지능 혁명'에 진입하고 있으며, 새로운 생산력의 형성이 가속화되고 있다고 말했다. Yang Jie는 증기기관이 주도하는 '기계화 혁명'부터 전기와 내연기관이 주도하는 '전기화 혁명', 컴퓨터와 인터넷이 주도하는 '정보 혁명'에 이르기까지 모든 산업 혁명이 다음을 기반으로 한다고 믿습니다. "정보"와 "에너지"가 주력으로 생산성 향상을 가져옵니다

다양한 애플리케이션 시나리오에 가장 적합한 golang 프레임워크를 선택하는 방법

Jun 05, 2024 pm 04:05 PM

다양한 애플리케이션 시나리오에 가장 적합한 golang 프레임워크를 선택하는 방법

Jun 05, 2024 pm 04:05 PM

애플리케이션 시나리오를 기반으로 최고의 Go 프레임워크를 선택하세요. 애플리케이션 유형, 언어 기능, 성능 요구 사항 및 생태계를 고려하세요. Common Go 프레임워크: Gin(웹 애플리케이션), Echo(웹 서비스), Fiber(높은 처리량), gorm(ORM), fasthttp(속도). 실제 사례: REST API(Fiber) 구축 및 데이터베이스(gorm)와 상호 작용. 프레임워크를 선택하세요. 주요 성능을 위해서는 fasthttp를 선택하고, 유연한 웹 애플리케이션을 위해서는 Gin/Echo를, 데이터베이스 상호작용을 위해서는 gorm을 선택하세요.

구글 검색 알고리즘의 비하인드 스토리가 공개되고, 실명이 포함된 2,500페이지의 문서가 유출됐다! 검색 순위 거짓말 노출

Jun 11, 2024 am 09:14 AM

구글 검색 알고리즘의 비하인드 스토리가 공개되고, 실명이 포함된 2,500페이지의 문서가 유출됐다! 검색 순위 거짓말 노출

Jun 11, 2024 am 09:14 AM

최근 구글 내부 문서 2,500페이지가 유출되면서 '인터넷의 가장 강력한 중재자'인 검색이 어떻게 작동하는지가 드러났다. SparkToro의 공동 창립자이자 CEO는 익명의 사람입니다. 그는 자신의 개인 웹사이트에 "익명의 사람이 SEO 담당자 모두가 읽어야 할 수천 페이지의 유출된 Google 검색 API 문서를 나와 공유했습니다"라고 주장했습니다. ! "RandFishkin은 수년 동안 SEO(검색 엔진 최적화, 검색 엔진 최적화) 분야의 최고 대변인으로 활동해 왔으며 "웹사이트 권한"(DomainRating) 개념을 제안했습니다. RandFishkin은 이 분야에서 매우 존경받는 인물이기 때문에