AI 안전을 보장하는 방법에 대한 OpenAI 게시물: 정부 규제가 필요합니다

미국 현지 시간 4월 6일 수요일, OpenAI는 보안 평가 수행, 출시 후 보호 조치 개선 등 AI의 안전을 보장하는 방법을 자세히 설명하는 게시물을 게시했습니다. , 아동 보호 및 사생활 존중 등 회사는 AI 시스템이 안전하게 구축, 배포 및 사용되도록 보장하는 것이 사명을 달성하는 데 중요하다고 말했습니다.

OpenAI 게시물 전문은 다음과 같습니다.

OpenAI는 가능한 한 많은 사람들에게 혜택을 줄 수 있는 강력한 AI 보안을 보장하기 위해 최선을 다하고 있습니다. 우리는 AI 도구가 오늘날 사람들에게 많은 도움을 제공한다는 것을 알고 있습니다. 전 세계 사용자들은 ChatGPT가 생산성을 향상하고 창의성을 향상하며 맞춤형 학습 경험을 제공하는 데 도움이 된다고 말했습니다. 그러나 우리는 모든 기술과 마찬가지로 이러한 도구와 관련된 실제 위험이 있다는 점도 인식하고 있습니다. 따라서 우리는 모든 시스템 수준에서 보안을 보장하기 위해 열심히 노력하고 있습니다.

더 안전한 AI 시스템

새로운 AI 시스템을 출시하기 전에 엄격한 테스트를 실시하고 외부 전문가의 의견을 수렴하며 수동으로 피드백 강화 학습과 같은 기술을 사용합니다. 모델 성능을 향상시킵니다. 동시에 우리는 광범위한 보안 및 모니터링 시스템도 구축했습니다.

최신 모델인 GPT-4를 예로 들어보겠습니다. 교육을 마친 후 공개 출시 전에 더욱 안전하고 신뢰할 수 있는지 확인하기 위해 최대 6개월 동안 전사적 테스트를 실시했습니다.

우리는 강력한 인공 지능 시스템이 엄격한 보안 평가를 거쳐야 한다고 믿습니다. 이러한 관행이 널리 채택되도록 하려면 규제가 필요합니다. 따라서 우리는 정부와 적극적으로 협력하여 최선의 규제 형태를 논의합니다.

실제 사용 사례를 통해 배우고 안전 장치를 개선하세요

시스템 배포 전에 예측 가능한 위험을 방지하기 위해 최선을 다하지만 실험실에서의 학습은 항상 제한됩니다. 우리는 광범위하게 연구하고 테스트하지만 사람들이 우리 기술을 어떻게 사용하거나 오용할지 예측할 수 없습니다. 따라서 우리는 실제 사용을 통해 학습하는 것이 점점 더 안전한 AI 시스템을 만들고 출시하는 데 중요한 구성 요소라고 믿습니다.

우리는 실질적인 보호 장치를 갖춘 새로운 AI 시스템을 점진적으로 대중에게 신중하게 출시하고, 우리가 배운 교훈을 바탕으로 지속적으로 개선하고 있습니다.

우리는 개발자가 기술을 자신의 애플리케이션에 직접 통합할 수 있도록 자체 서비스와 API에서 가장 강력한 모델을 제공합니다. 이를 통해 우리는 학대를 모니터링하고 이에 대한 조치를 취하고 대응책을 개발할 수 있습니다. 이렇게 하면 우리는 어떻게 해야 할지 이론적으로 상상하기보다는 실제적인 조치를 취할 수 있습니다.

실제 사용 경험을 통해 우리는 사람들에게 실제 위험을 초래하는 행동을 해결하는 동시에 기술을 보다 유익한 방식으로 사용할 수 있도록 점점 더 세분화된 정책을 개발하게 되었습니다.

우리는 사회가 점점 더 강력해지는 인공 지능에 적응하려면 더 많은 시간이 필요하며, 이에 영향을 받는 모든 사람이 인공 지능의 발전에 발언권을 가져야 한다고 믿습니다. 반복적 배포는 다양한 이해관계자가 AI 기술에 대한 대화에 보다 효과적으로 참여하는 데 도움이 되며 이러한 도구를 직접 사용하는 경험을 갖는 것이 중요합니다.

어린이 보호

우리 안전 작업의 초점 중 하나는 어린이 보호입니다. 인공 지능 도구를 사용하는 사람은 18세 이상이거나 부모의 동의가 있는 13세 이상이어야 합니다. 현재 검증 기능을 개발 중입니다.

우리는 증오, 괴롭힘, 폭력 또는 성인용 콘텐츠를 생성하는 데 우리의 기술을 사용하는 것을 허용하지 않습니다. 최신 GPT-4는 GPT-3.5에 비해 제한된 콘텐츠 요청에 응답할 가능성이 82% 낮습니다. 우리는 남용을 모니터링하기 위한 강력한 시스템을 갖추고 있습니다. GPT-4는 이제 ChatGPT Plus 구독자에게 제공되며 시간이 지남에 따라 더 많은 사람들이 이를 경험할 수 있기를 바랍니다.

우리는 모델이 어린이에게 유해한 콘텐츠를 제작할 가능성을 최소화하기 위해 중요한 조치를 취했습니다. 예를 들어, 사용자가 이미지 생성 도구에 아동에게 안전한 학대 자료를 업로드하려고 시도하면 당사는 이를 차단하고 해당 문제를 미국 국립실종착취아동센터에 신고합니다.

기본 보안 보호 외에도 비영리 단체인 Khan Academy와 같은 개발 조직과 협력하여 보안 조치를 맞춤화합니다. 칸아카데미(Khan Academy)는 학생을 위한 가상 교사, 교사를 위한 교실 조교 역할을 할 수 있는 인공지능 조수를 개발했습니다. 또한 개발자가 모델 출력에 대해 더 엄격한 표준을 설정하여 이러한 기능이 필요한 개발자와 사용자를 더 효과적으로 지원할 수 있는 기능을 개발 중입니다.

개인 정보 보호

당사의 대규모 언어 모델은 공개적으로 사용 가능한 콘텐츠, 라이선스가 부여된 콘텐츠, 검토자가 생성한 콘텐츠를 포함한 광범위한 텍스트 모음에 대해 훈련되었습니다. 우리는 이 데이터를 서비스나 광고 판매에 사용하지 않으며 프로필 작성에도 사용하지 않습니다. 우리는 사람들과 더 많은 대화를 함으로써 ChatGPT를 더욱 지능적으로 만드는 등 사람들을 돕는 모델을 개선하기 위해 이 데이터를 사용합니다.

교육 데이터의 대부분에는 공개 웹에서 사용할 수 있는 개인 정보가 포함되어 있지만, 우리는 모델이 개인이 아닌 세계 전체에 대해 학습하기를 원합니다. 따라서 당사는 가능한 경우 교육 데이터 세트에서 개인 정보를 제거하고 모델을 미세 조정하여 개인 정보에 대한 쿼리 요청을 거부하고 당사 시스템에서 개인 정보를 삭제하려는 개인의 요청에 응답하기 위해 최선을 다하고 있습니다. 이러한 조치는 우리 모델이 개인 정보가 포함된 응답을 생성할 가능성을 최소화합니다.

사실적 정확성 향상

오늘날의 대규모 언어 모델은 이전 패턴과 사용자가 입력한 텍스트를 기반으로 다음에 사용될 가능성이 높은 단어를 예측할 수 있습니다. 그러나 어떤 경우에는 다음으로 가능성이 가장 높은 단어가 실제로는 사실이 아닐 수도 있습니다.

사실의 정확성을 높이는 것은 OpenAI 및 기타 여러 AI 연구 조직의 초점 중 하나이며 우리는 진전을 이루고 있습니다. 기본 데이터 소스로 잘못된 것으로 표시된 ChatGPT 출력에 대한 사용자 피드백을 활용하여 GPT-4의 사실적 정확성을 향상했습니다. GPT-3.5와 비교하여 GPT-4는 40% 향상된 사실적 콘텐츠를 생성할 가능성이 더 높습니다.

ChatGPT에서 잘못된 응답을 방지하기 위해 사용자가 도구를 사용하기 위해 가입할 때 최대한 투명하게 하기 위해 노력하고 있습니다. 그러나 우리는 오해 가능성을 더욱 줄이고 이러한 AI 도구의 현재 한계에 대해 대중에게 교육하기 위해 수행해야 할 작업이 더 많다는 것을 인식했습니다.

지속적인 연구 및 참여

AI 보안 문제를 해결하는 실용적인 방법은 효과적인 완화 및 보정 기술에 더 많은 시간과 자원을 투자하고 이러한 기술이 오용될 수 있는 실제 상황을 대상으로 테스트를 수행하는 것이라고 믿습니다. .

중요하게, 우리는 AI의 안전성과 역량 향상이 동시에 이루어져야 한다고 믿습니다. 현재까지 우리의 최고의 보안 작업은 가장 유능한 모델을 사용하여 작업한 결과입니다. 사용자의 지침을 더 잘 따르고 이를 활용하거나 "안내"하기가 더 쉽기 때문입니다.

우리는 더 많은 주의를 기울여 더 많은 유능한 모델을 만들고 배포할 것이며 AI 시스템이 발전함에 따라 안전 예방 조치를 계속 강화할 것입니다.

GPT-4의 기능, 이점 및 위험을 더 잘 이해하기 위해 배포하는 데 6개월 이상을 기다렸지만 때로는 AI 시스템의 보안을 개선하는 데 더 오랜 시간이 걸릴 수 있습니다. 따라서 정책 입안자와 AI 개발자는 누구도 앞서가기 위해 지름길을 택하지 않도록 AI의 개발 및 배포가 전 세계적으로 효과적으로 규제되도록 해야 합니다. 이는 기술적, 제도적 혁신이 필요한 어려운 도전이지만, 우리는 기꺼이 기여하고 싶습니다.

AI 안전 문제를 해결하려면 AI 시스템의 작동 방식에 대한 경계 설정을 포함하여 광범위한 토론, 실험 및 참여가 필요합니다. 우리는 보다 안전한 AI 생태계를 만들기 위해 이해관계자들 간의 협력과 열린 대화를 계속해서 장려해 왔으며 앞으로도 그럴 것입니다.

위 내용은 AI 안전을 보장하는 방법에 대한 OpenAI 게시물: 정부 규제가 필요합니다의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7716

7716

15

15

1641

1641

14

14

1396

1396

52

52

1289

1289

25

25

1232

1232

29

29

이제 ChatGPT를 사용하면 무료 사용자가 일일 한도가 있는 DALL-E 3를 사용하여 이미지를 생성할 수 있습니다.

Aug 09, 2024 pm 09:37 PM

이제 ChatGPT를 사용하면 무료 사용자가 일일 한도가 있는 DALL-E 3를 사용하여 이미지를 생성할 수 있습니다.

Aug 09, 2024 pm 09:37 PM

DALL-E 3는 이전 모델보다 대폭 개선된 모델로 2023년 9월 공식 출시되었습니다. 복잡한 디테일의 이미지를 생성할 수 있는 현재까지 최고의 AI 이미지 생성기 중 하나로 간주됩니다. 그러나 출시 당시에는 제외되었습니다.

Spring Boot가 OpenAI를 만났을 때 새로운 프로그래밍 패러다임

Feb 01, 2024 pm 09:18 PM

Spring Boot가 OpenAI를 만났을 때 새로운 프로그래밍 패러다임

Feb 01, 2024 pm 09:18 PM

2023년에는 AI 기술이 화두가 되면서 다양한 산업, 특히 프로그래밍 분야에 큰 영향을 미치고 있다. 사람들은 AI 기술의 중요성을 점점 더 인식하고 있으며 Spring 커뮤니티도 예외는 아닙니다. GenAI(일반 인공 지능) 기술이 지속적으로 발전함에 따라 AI 기능을 갖춘 애플리케이션 생성을 단순화하는 것이 중요하고 시급해졌습니다. 이러한 배경에서 AI 기능 애플리케이션 개발 프로세스를 단순화하고 간단하고 직관적이며 불필요한 복잡성을 피하는 것을 목표로 하는 "SpringAI"가 등장했습니다. 'SpringAI'를 통해 개발자는 AI 기능이 포함된 애플리케이션을 더욱 쉽게 구축할 수 있어 사용 및 운영이 더욱 쉬워진다.

데이터에 가장 적합한 임베딩 모델 선택: OpenAI와 오픈 소스 다국어 임베딩 비교 테스트

Feb 26, 2024 pm 06:10 PM

데이터에 가장 적합한 임베딩 모델 선택: OpenAI와 오픈 소스 다국어 임베딩 비교 테스트

Feb 26, 2024 pm 06:10 PM

OpenAI는 최근 최신 세대 임베딩 모델 embeddingv3의 출시를 발표했습니다. 이는 더 높은 다국어 성능을 갖춘 가장 성능이 뛰어난 임베딩 모델이라고 주장합니다. 이 모델 배치는 더 작은 text-embeddings-3-small과 더 강력하고 더 큰 text-embeddings-3-large의 두 가지 유형으로 나뉩니다. 이러한 모델이 어떻게 설계되고 학습되는지에 대한 정보는 거의 공개되지 않으며 모델은 유료 API를 통해서만 액세스할 수 있습니다. 그렇다면 오픈소스 임베딩 모델이 많이 있습니다. 그러나 이러한 오픈소스 모델은 OpenAI 폐쇄소스 모델과 어떻게 비교됩니까? 이 기사에서는 이러한 새로운 모델의 성능을 오픈 소스 모델과 실증적으로 비교할 것입니다. 데이터를 만들 계획입니다.

휴대폰에 chatgpt를 설치하는 방법

Mar 05, 2024 pm 02:31 PM

휴대폰에 chatgpt를 설치하는 방법

Mar 05, 2024 pm 02:31 PM

설치 단계: 1. ChatGTP 공식 웹사이트 또는 모바일 스토어에서 ChatGTP 소프트웨어를 다운로드합니다. 2. 이를 연 후 설정 인터페이스에서 언어를 중국어로 선택합니다. 3. 게임 인터페이스에서 인간-기계 게임을 선택하고 설정합니다. 4. 시작한 후 채팅 창에 명령을 입력하여 소프트웨어와 상호 작용합니다.

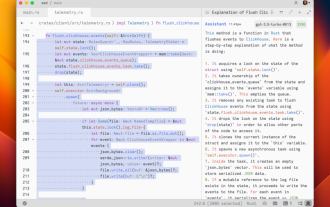

Rust 기반 Zed 편집기는 OpenAI 및 GitHub Copilot에 대한 기본 지원을 포함하여 오픈 소스로 제공되었습니다.

Feb 01, 2024 pm 02:51 PM

Rust 기반 Zed 편집기는 OpenAI 및 GitHub Copilot에 대한 기본 지원을 포함하여 오픈 소스로 제공되었습니다.

Feb 01, 2024 pm 02:51 PM

작성자丨컴파일: TimAnderson丨제작: Noah|51CTO Technology Stack(WeChat ID: blog51cto) Zed 편집기 프로젝트는 아직 출시 전 단계에 있으며 AGPL, GPL 및 Apache 라이선스에 따라 오픈 소스로 제공됩니다. 이 편집기는 고성능과 다양한 AI 지원 옵션을 제공하지만 현재는 Mac 플랫폼에서만 사용할 수 있습니다. Nathan Sobo는 게시물에서 GitHub의 Zed 프로젝트 코드 베이스에서 편집기 부분은 GPL에 따라 라이선스가 부여되고 서버 측 구성 요소는 AGPL에 따라 라이선스가 부여되며 GPUI(GPU Accelerated User) 인터페이스) 부분은 GPL에 따라 라이선스가 부여된다고 설명했습니다. Apache2.0 라이센스. GPUI는 Zed 팀에서 개발한 제품입니다.

OpenAI Super Alignment Team의 사후 작업: 두 개의 대형 모델이 게임을 하고 출력이 더 이해하기 쉬워졌습니다.

Jul 19, 2024 am 01:29 AM

OpenAI Super Alignment Team의 사후 작업: 두 개의 대형 모델이 게임을 하고 출력이 더 이해하기 쉬워졌습니다.

Jul 19, 2024 am 01:29 AM

AI 모델이 내놓은 답변이 전혀 이해하기 어렵다면 감히 사용해 보시겠습니까? 기계 학습 시스템이 더 중요한 영역에서 사용됨에 따라 우리가 그 결과를 신뢰할 수 있는 이유와 신뢰할 수 없는 경우를 보여주는 것이 점점 더 중요해지고 있습니다. 복잡한 시스템의 출력에 대한 신뢰를 얻는 한 가지 가능한 방법은 시스템이 인간이나 다른 신뢰할 수 있는 시스템이 읽을 수 있는 출력 해석을 생성하도록 요구하는 것입니다. 즉, 가능한 오류가 발생할 수 있는 지점까지 완전히 이해할 수 있습니다. 설립하다. 예를 들어, 사법 시스템에 대한 신뢰를 구축하기 위해 우리는 법원이 자신의 결정을 설명하고 뒷받침하는 명확하고 읽기 쉬운 서면 의견을 제공하도록 요구합니다. 대규모 언어 모델의 경우 유사한 접근 방식을 채택할 수도 있습니다. 그러나 이 접근 방식을 사용할 때는 언어 모델이 다음을 생성하는지 확인하세요.

OpenAI를 기다리지 말고 Open-Sora가 완전한 오픈 소스가 될 때까지 기다리십시오.

Mar 18, 2024 pm 08:40 PM

OpenAI를 기다리지 말고 Open-Sora가 완전한 오픈 소스가 될 때까지 기다리십시오.

Mar 18, 2024 pm 08:40 PM

얼마 전 OpenAISOra는 놀라운 비디오 생성 효과로 빠르게 인기를 얻었으며 많은 문학적 비디오 모델들 사이에서 눈에 띄었고 전 세계의 관심의 초점이 되었습니다. Colossal-AI 팀은 2주 전 46% 비용 절감으로 Sora 훈련 추론 재현 프로세스를 출시한 데 이어 세계 최초의 Sora 유사 아키텍처 비디오 생성 모델 "Open-Sora1.0"을 완전 오픈 소스화했습니다. 데이터 처리, 모든 훈련 세부 사항 및 모델 가중치를 포함한 훈련 프로세스를 다루고, 글로벌 AI 애호가들과 협력하여 비디오 제작의 새로운 시대를 촉진합니다. 미리보기로 Colossal-AI 팀이 공개한 'Open-Sora1.0' 모델이 생성한 번화한 도시의 영상을 살펴보겠습니다. 오픈소라1.0

Embedding 서비스의 로컬 실행 성능은 OpenAI Text-Embedding-Ada-002를 능가하므로 매우 편리합니다!

Apr 15, 2024 am 09:01 AM

Embedding 서비스의 로컬 실행 성능은 OpenAI Text-Embedding-Ada-002를 능가하므로 매우 편리합니다!

Apr 15, 2024 am 09:01 AM

Ollama는 Llama2, Mistral, Gemma와 같은 오픈 소스 모델을 로컬에서 쉽게 실행할 수 있는 매우 실용적인 도구입니다. 이번 글에서는 Ollama를 사용하여 텍스트를 벡터화하는 방법을 소개하겠습니다. Ollama를 로컬에 설치하지 않은 경우 이 문서를 읽을 수 있습니다. 이 기사에서는 nomic-embed-text[2] 모델을 사용합니다. 짧은 컨텍스트 및 긴 컨텍스트 작업에서 OpenAI text-embedding-ada-002 및 text-embedding-3-small보다 성능이 뛰어난 텍스트 인코더입니다. o를 성공적으로 설치한 후 nomic-embed-text 서비스를 시작하십시오.