Google 팀은 파노라마 분할 솔루션을 최적화하기 위해 새로운 Transformer를 출시했습니다.

최근 Google AI 팀은 Transformer 및 DETR에서 영감을 받아 Mask Transformer를 사용하여 파노라마 분할을 위한 엔드 투 엔드 솔루션을 제안했습니다.

전체 이름은 주로 분할 MaskTransformer 아키텍처의 확장을 생성하는 데 사용되는 마스크 변환기를 사용한 팬옵틱 분할을 위한 엔드 투 엔드 솔루션입니다.

이 솔루션은 픽셀 특징을 추출하기 위한 픽셀 경로(컨벌루션 신경망 또는 시각적 Transformer로 구성), 메모리 특징을 추출하기 위한 메모리 경로(Transformer 디코더 모듈로 구성), 연결을 위한 이중 경로 Transformer를 사용합니다. 픽셀 기능과 메모리 대화형 기능 사이.

그러나 교차 어텐션을 활용하는 이중 경로 변환기는 원래 입력 순서가 수백 단어로 구성된 언어 작업을 위해 설계되었습니다.

비전 작업, 특히 분할 문제의 경우 입력 시퀀스는 수만 개의 픽셀로 구성됩니다. 이는 입력 규모의 크기가 훨씬 더 클 뿐만 아니라 언어 단어에 비해 낮은 수준의 임베딩을 나타냅니다.

파노라마 분할은 이제 많은 응용 프로그램에서 핵심 작업이 된 컴퓨터 비전 문제입니다.

의미론적 분할과 인스턴스 분할의 두 부분으로 나뉩니다.

의미론적 분할은 "사람", "하늘"과 같은 이미지의 각 픽셀에 의미론적 라벨을 할당하는 것과 같습니다.

인스턴스 분할은 "보행자", "자동차" 등 그래프에서 셀 수 있는 개체만 식별하고 분할한 다음 이를 여러 하위 작업으로 나눕니다.

각 하위 작업은 개별적으로 처리되며, 각 하위 작업 단계의 결과를 병합하기 위해 추가 모듈이 적용됩니다.

이 프로세스는 복잡할 뿐만 아니라 하위 작업을 처리하고 다양한 하위 작업의 결과를 통합할 때 인위적으로 설계된 사전 설정을 많이 도입합니다.

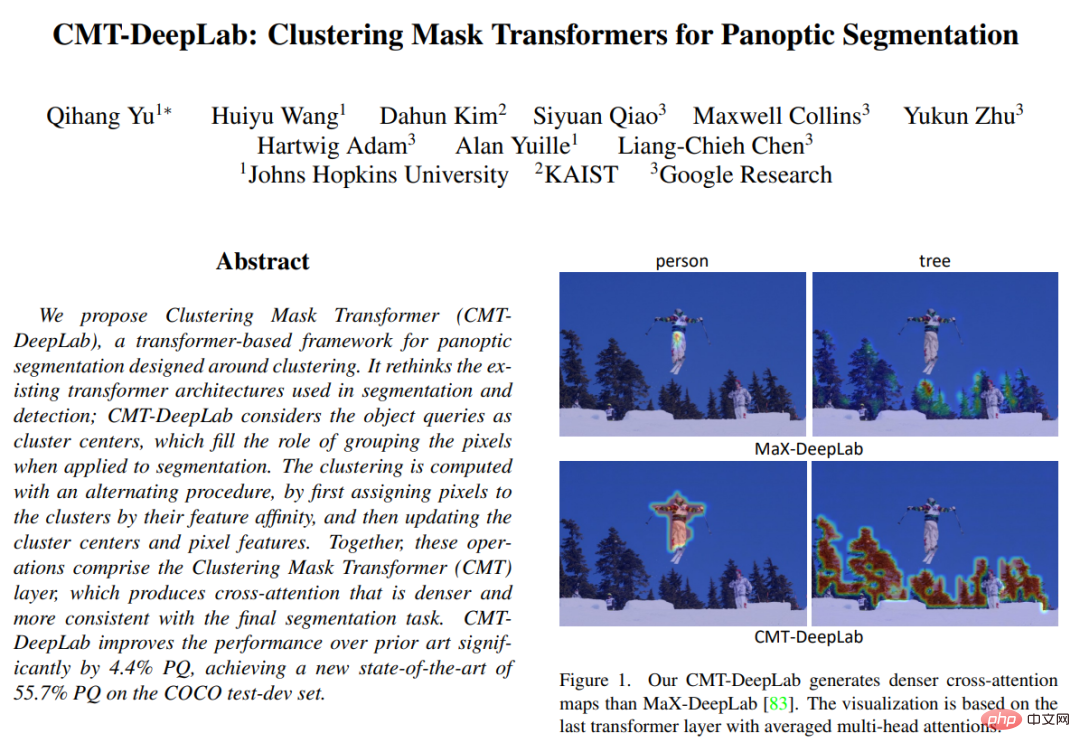

CVPR 2022에서 발표된 "CMT-DeepLab: Clustering Mask Transformers for Panoptic Segmentation"에서 기사는 교차 주목을 클러스터링의 관점에서 재해석하고 재설계할 것을 제안합니다(즉, 동일한 의미 레이블을 픽셀로 그룹화하는 것). 함께) 비전 작업에 더 적합합니다.

CMT-DeepLab은 기존의 최첨단 방식인 MaX-DeepLab을 기반으로 픽셀 클러스터링 방식을 채택하여 교차 어텐션을 수행함으로써 더 조밀하고 합리적인 어텐션 맵을 생성합니다.

kMaX-DeepLab은 활성화 함수를 간단히 변경하여 k-평균 클러스터링 알고리즘과 유사하도록 교차 관심을 더욱 재설계합니다.

구조적 개요

연구원들은 수정 없이 시각적 작업에 교차 주의를 직접 적용하는 대신 클러스터링의 관점에서 재해석하게 됩니다.

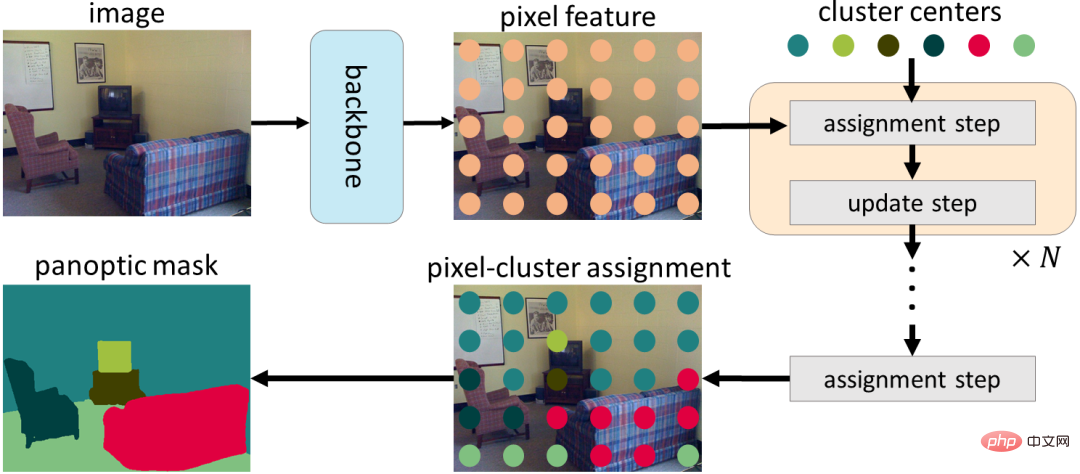

구체적으로 그들은 Mask Transformer 객체 쿼리가 클러스터 중심(동일한 의미 라벨을 사용하여 픽셀을 그룹화하는 것을 목표로 함)으로 생각할 수 있다는 점에 주목합니다.

교차 주의 프로세스는 k-평균 클러스터링 알고리즘과 유사합니다. (1) 픽셀을 클러스터 중심에 할당하는 반복 프로세스로, 여러 픽셀이 단일 클러스터 중심에 할당될 수 있으며 일부 클러스터 중심은 없을 수 있습니다. (2) 동일한 클러스터 중심에 할당된 픽셀을 평균하여 클러스터 중심을 업데이트합니다. 할당된 픽셀이 없으면 클러스터 중심은 업데이트되지 않습니다.

CMT-DeepLab 및 kMaX-DeepLab에서는 반복적인 클러스터 할당 및 클러스터 업데이트 단계를 포함하는 클러스터링 관점에서 교차 관심을 재구성합니다.

k-평균 클러스터링 알고리즘을 고려하여 CMT-DeepLab의 인기도 , 그들은 공간 측면 소프트맥스 연산(즉, 이미지의 공간 해상도를 따라 적용되는 소프트맥스 연산)이 실제로 클러스터 중심 애플리케이션을 따라 반대쪽 픽셀에 클러스터 중심을 할당하도록 교차 주의를 재설계했습니다.

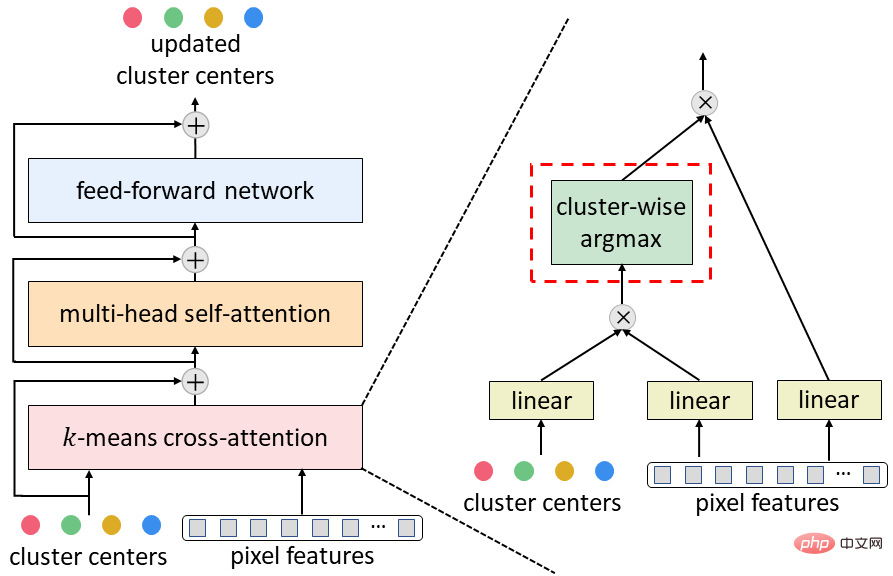

kMaX-DeepLab에서는 공간적 소프트맥스를 클러스터별 argmax로 더욱 단순화합니다(즉, 클러스터 중심을 따라 argmax 작업을 적용합니다).

그들은 argmax 연산이 k-평균 클러스터링 알고리즘에 사용되는 하드 할당(즉, 하나의 픽셀이 하나의 클러스터에만 할당됨)과 동일하다는 점에 주목합니다.

클러스터링 관점에서 MaskTransformer의 교차 관심을 재구성하면 분할 성능이 크게 향상되고 복잡한 MaskTransformer 파이프라인이 단순화되어 해석이 쉬워집니다.

먼저, 인코더-디코더 구조는 입력 이미지에서 픽셀 특징을 추출하는 데 사용됩니다. 그런 다음 픽셀은 클러스터 중심 세트를 사용하여 그룹화되며 클러스터 할당에 따라 추가로 업데이트됩니다. 마지막으로 클러스터 할당 및 업데이트 단계가 반복적으로 수행되며 마지막 할당은 분할 예측으로 직접 사용될 수 있습니다.

일반적인 MaskTransformer 디코더(Cross-Attention, Multi-Head Self-Attention 및 Feed-Forward 네트워크로 구성)를 위에서 제안한 k-평균 Cross-Attention으로 변환하려면 공간적으로 현명한 소프트맥스만 사용하면 됩니다. 클러스터 모드 최대 매개변수로 대체되었습니다.

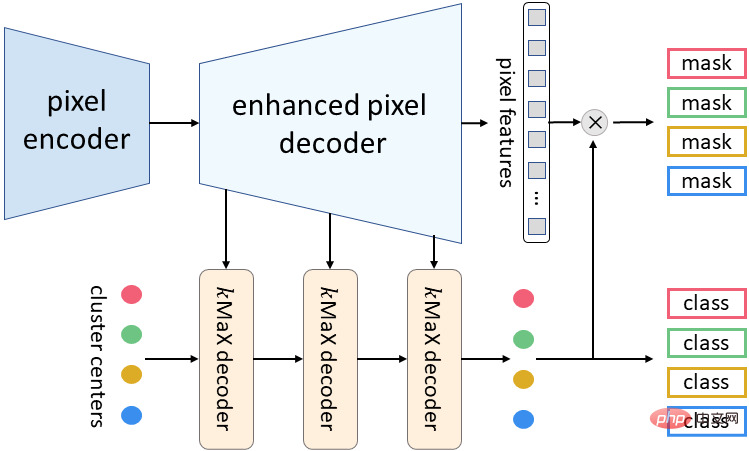

이번에 제안한 kMaX-DeepLab의 메타 아키텍처는 픽셀 인코더, 향상된 픽셀 디코더, kMaX 디코더의 세 가지 구성 요소로 구성됩니다.

픽셀 인코더는 모든 네트워크의 백본이며 이미지 특징을 추출하는 데 사용됩니다.

향상된 픽셀 디코더에는 픽셀 기능을 향상시키는 변환기 인코더와 더 높은 해상도 기능을 생성하는 업샘플링 레이어가 포함되어 있습니다.

kMaX 디코더 시리즈는 클러스터 중심을 (1) 예측 마스크를 생성하기 위해 픽셀 특징과 곱해지는 마스크 임베딩 벡터와 (2) 각 마스크에 대한 클래스 예측으로 변환합니다.

kMaX-DeepLab의 메타 아키텍처

연구 결과

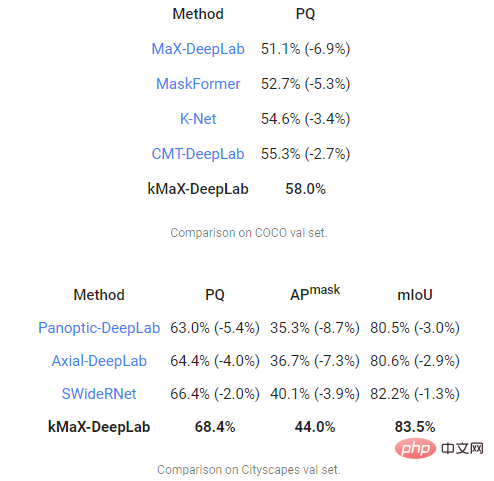

마지막으로 연구팀은 파노라마 품질(PQ) 지표를 사용하여 CMT-DeepLab과 kMaX-DeepLab을 평가하고 MaX-DeepLab을 다른 상태와 비교했습니다. - 최첨단 방법.

그 중 CMT-DeepLab은 상당한 성능 향상을 달성했으며, kMaX-DeepLab은 수정을 단순화했을 뿐만 아니라 더욱 개선했습니다. COCO Val 세트의 PQ는 58.0%, PQ는 68.4%, 마스크 평균입니다. 정확도는 테스트 시간 확대나 외부 데이터 세트 사용 없이 Cityscapes 검증 세트에서 AP ) 44.0%, 평균 교차점(mIoU) 83.5%였습니다.

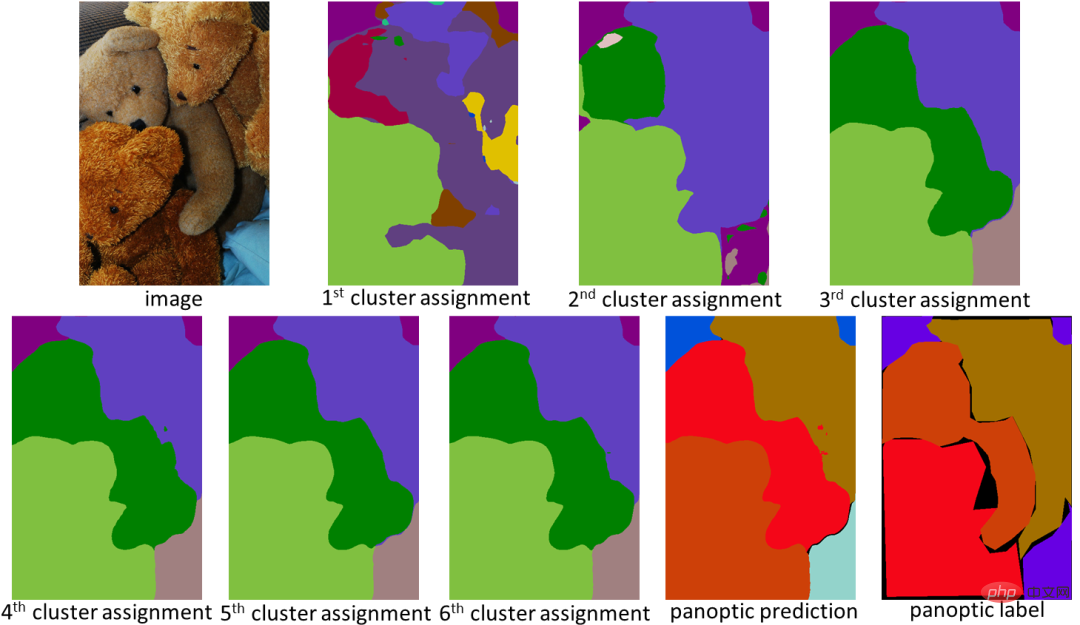

클러스터링 관점에서 설계된 kMaX-DeepLab은 더 높은 성능을 제공할 뿐만 아니라 Attention Map을 보다 합리적으로 시각화하여 작동 메커니즘을 이해할 수 있습니다.

아래 예에서 kMaX-DeepLab은 클러스터 할당 및 업데이트를 반복적으로 수행하여 점차적으로 마스크 품질을 향상시킵니다.

kMaX-DeepLab의 어텐션 맵은 파노라마 분할로 직접 시각화될 수 있어 모델 작동 메커니즘을 더욱 합리적으로 만듭니다.

결론

이 연구는 비전 작업에서 MaskTransformer를 더 잘 설계하는 방법을 보여줍니다.

간단한 수정으로 CMT-DeepLab과 kMaX-DeepLab은 교차 관심을 재구성하여 클러스터링 알고리즘에 더 가깝게 만듭니다.

따라서 제안된 모델은 COCO 및 Cityscapes 데이터 세트에서 최첨단 성능을 달성합니다.

연구팀은 DeepLab2 라이브러리에 있는 kMaX-DeepLab의 오픈 소스 버전이 시각적 Transformer 아키텍처 설계에 대한 향후 연구에 기여할 수 있기를 희망한다고 밝혔습니다.

위 내용은 Google 팀은 파노라마 분할 솔루션을 최적화하기 위해 새로운 Transformer를 출시했습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7752

7752

15

15

1643

1643

14

14

1398

1398

52

52

1293

1293

25

25

1234

1234

29

29

참깨 오픈 도어 교환 웹 페이지 등록 링크 게이트 트레이딩 앱 등록 웹 사이트 최신

Feb 28, 2025 am 11:06 AM

참깨 오픈 도어 교환 웹 페이지 등록 링크 게이트 트레이딩 앱 등록 웹 사이트 최신

Feb 28, 2025 am 11:06 AM

이 기사에서는 GATE.IO (GATE.IO) 웹 버전의 등록 프로세스와 GATE 트레이딩 앱의 등록 프로세스를 소개합니다. 웹 등록 또는 앱 등록이든, 공식 웹 사이트 또는 App Store를 방문하여 Genuine 앱을 다운로드 한 다음 사용자 이름, 암호, 이메일, 휴대 전화 번호 및 기타 정보, 완전한 이메일 또는 휴대 전화 확인을 작성해야합니다.

참깨 오픈 도어 교환 웹 페이지 로그인 최신 버전 GATEIO 공식 웹 사이트 입구

Mar 04, 2025 pm 11:48 PM

참깨 오픈 도어 교환 웹 페이지 로그인 최신 버전 GATEIO 공식 웹 사이트 입구

Mar 04, 2025 pm 11:48 PM

로그인 단계 및 암호 복구 프로세스를 포함하여 참깨 오픈 exchange 웹 버전의 로그인 작업에 대한 자세한 소개는 로그인 실패, 페이지를 열 수 없으며 플랫폼에 부드럽게 로그인 할 수없는 일반적인 문제에 대한 솔루션을 제공합니다.

Bybit Exchange 링크를 직접 다운로드하고 설치할 수없는 이유는 무엇입니까?

Feb 21, 2025 pm 10:57 PM

Bybit Exchange 링크를 직접 다운로드하고 설치할 수없는 이유는 무엇입니까?

Feb 21, 2025 pm 10:57 PM

Bybit Exchange 링크를 직접 다운로드하고 설치할 수없는 이유는 무엇입니까? Bybit은 사용자에게 거래 서비스를 제공하는 암호 화폐 거래소입니다. Exchange의 모바일 앱은 다음과 같은 이유로 AppStore 또는 GooglePlay를 통해 직접 다운로드 할 수 없습니다. 1. App Store Policy는 Apple과 Google이 App Store에서 허용되는 응용 프로그램 유형에 대한 엄격한 요구 사항을 갖지 않도록 제한합니다. Cryptocurrency Exchange 응용 프로그램은 금융 서비스가 포함되며 특정 규정 및 보안 표준이 필요하기 때문에 이러한 요구 사항을 충족하지 않습니다. 2. 법률 및 규정 준수 준수 많은 국가에서 암호 화폐 거래와 관련된 활동이 규제되거나 제한됩니다. 이러한 규정을 준수하기 위해 BYBIT 응용 프로그램은 공식 웹 사이트 또는 기타 공인 채널을 통해서만 사용할 수 있습니다.

Crypto Digital Asset Trading App (2025 Global Ranking)에 권장되는 상위 10 개

Mar 18, 2025 pm 12:15 PM

Crypto Digital Asset Trading App (2025 Global Ranking)에 권장되는 상위 10 개

Mar 18, 2025 pm 12:15 PM

이 기사에서는 Binance, OKX, Gate.io, Bitflyer, Kucoin, Bybit, Coinbase Pro, Kraken, Bydfi 및 Xbit DencentRalized Exchanges를 포함하여주의를 기울여야 할 상위 10 개의 Cryptocurrency 거래 플랫폼을 권장합니다. 이 플랫폼은 거래 통화 수량, 거래 유형, 보안, 규정 준수 및 특수 기능 측면에서 고유 한 이점이 있습니다. 예를 들어 Binance는 전 세계 최대의 거래량과 풍부한 기능으로 유명합니다. 적절한 플랫폼을 선택하려면 자체 거래 경험, 위험 허용 범위 및 투자 선호도를 기반으로 포괄적 인 고려 사항이 필요합니다. 이 기사가 자신에게 가장 적합한 것을 찾는 데 도움이되기를 바랍니다.

참깨 오픈 도어 트레이딩 플랫폼 다운로드 모바일 버전 게이트 오리오 트레이딩 플랫폼 다운로드 주소

Feb 28, 2025 am 10:51 AM

참깨 오픈 도어 트레이딩 플랫폼 다운로드 모바일 버전 게이트 오리오 트레이딩 플랫폼 다운로드 주소

Feb 28, 2025 am 10:51 AM

앱을 다운로드하고 계정의 안전을 보장하기 위해 공식 채널을 선택하는 것이 중요합니다.

Binance Binance 공식 웹 사이트 최신 버전 로그인 포털

Feb 21, 2025 pm 05:42 PM

Binance Binance 공식 웹 사이트 최신 버전 로그인 포털

Feb 21, 2025 pm 05:42 PM

Binance 웹 사이트 로그인 포털의 최신 버전에 액세스하려면 다음을 수행하십시오. 공식 웹 사이트로 이동하여 오른쪽 상단의 "로그인"버튼을 클릭하십시오. 기존 로그인 방법을 선택하십시오. 새 사용자 인 경우 "등록하십시오. 등록 된 휴대폰 번호 또는 이메일 및 비밀번호를 입력하고 완전한 인증 (예 : 모바일 확인 코드 또는 Google 인증 자). 성공적인 확인 후 Binance 공식 웹 사이트 로그인 포털의 최신 버전에 액세스 할 수 있습니다.

Bitget Trading Platform 공식 앱 다운로드 및 설치 주소

Feb 25, 2025 pm 02:42 PM

Bitget Trading Platform 공식 앱 다운로드 및 설치 주소

Feb 25, 2025 pm 02:42 PM

이 안내서는 Android 및 iOS 시스템에 적합한 공식 Bitget Exchange 앱에 대한 자세한 다운로드 및 설치 단계를 제공합니다. 이 안내서는 공식 웹 사이트, App Store 및 Google Play를 포함한 여러 권위있는 소스의 정보를 통합하고 다운로드 및 계정 관리 중 고려 사항을 강조합니다. 사용자는 App Store, 공식 웹 사이트 APK 다운로드 및 공식 웹 사이트 Jump, 완전한 등록, 신원 확인 및 보안 설정을 포함한 공식 채널에서 앱을 다운로드 할 수 있습니다. 또한 가이드는 자주 묻는 질문과 다음과 같은 고려 사항을 다룹니다.

2025 년 Bitget의 최신 다운로드 주소 : 공식 앱을 얻는 단계

Feb 25, 2025 pm 02:54 PM

2025 년 Bitget의 최신 다운로드 주소 : 공식 앱을 얻는 단계

Feb 25, 2025 pm 02:54 PM

이 안내서는 Android 및 iOS 시스템에 적합한 공식 Bitget Exchange 앱에 대한 자세한 다운로드 및 설치 단계를 제공합니다. 이 안내서는 공식 웹 사이트, App Store 및 Google Play를 포함한 여러 권위있는 소스의 정보를 통합하고 다운로드 및 계정 관리 중 고려 사항을 강조합니다. 사용자는 App Store, 공식 웹 사이트 APK 다운로드 및 공식 웹 사이트 Jump, 완전한 등록, 신원 확인 및 보안 설정을 포함한 공식 채널에서 앱을 다운로드 할 수 있습니다. 또한 가이드는 자주 묻는 질문과 다음과 같은 고려 사항을 다룹니다.