메타 연구진, 로봇이 시각적으로 작동할 수 있는 인공 시각 피질 개발

Meta의 AI 연구 부서 연구원들은 최근 로봇 적응 기술 조정 및 시각 피질 복제의 주요 진전을 발표하는 발표를 발표했습니다. 그들은 이러한 발전을 통해 AI 기반 로봇이 현실 세계에서 데이터를 얻을 필요 없이 비전을 통해 현실 세계에서 작동할 수 있다고 말합니다.

그들은 이것이 인간의 개입 없이 현실 세계와 상호 작용할 수 있는 범용 "체화된 AI" 로봇을 만드는 데 있어 큰 발전이라고 주장합니다. 연구원들은 또한 전 세계 수천 명의 연구 참가자들의 일상 활동을 비디오로 기록하는 Ego4D 데이터 세트를 기반으로 훈련된 "VC-1"이라는 인공 시각 피질을 만들었다고 말했습니다.

연구원들이 이전에 게시한 블로그 게시물에서 설명했듯이 시각 피질은 유기체가 시각을 움직임으로 변환할 수 있게 하는 뇌의 영역입니다. 따라서 인공 시각 피질을 갖는 것은 앞에 있는 장면을 기반으로 작업을 수행해야 하는 로봇의 핵심 요구 사항입니다.

"VC-1'의 인공 시각 피질은 다양한 환경에서 다양한 감각 운동 작업을 잘 수행해야 하기 때문에 Ego4D 데이터 세트에는 카메라가 매일 수천 시간의 비디오를 기록하므로 특히 중요한 역할을 합니다. 요리, 청소, 운동, 공예 등을 포함한 활동.

연구원들은 다음과 같이 말했습니다. "생물학적 유기체에는 우리가 찾고 있는 표상 에이전트인 보편적인 시각 피질이 있습니다. 따라서 우리는 Ego4D를 핵심 데이터 세트로 사용하여 여러 작업에서 잘 수행되는 데이터 세트를 만들고 개선하기 시작했습니다. Ego4D는 주로 요리, 정원 가꾸기, 공예와 같은 일상 활동에 중점을 두기 때문에 주택과 아파트를 탐색하는 자기 중심적인 비디오 데이터 세트도 채택했습니다.”

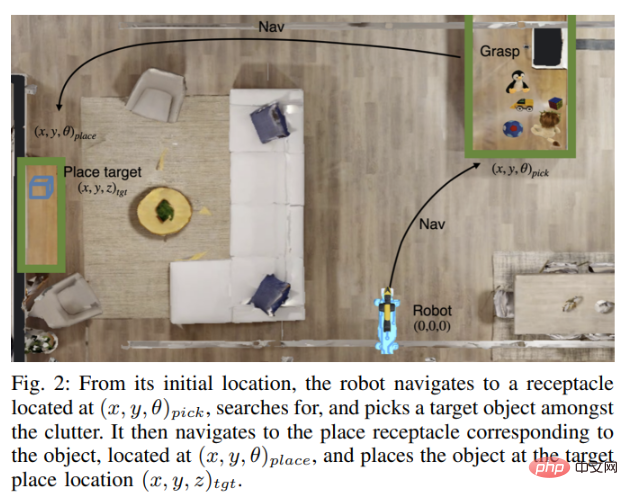

그러나 비전은 단지 하나의 요소일 뿐입니다. 로봇이 현실 세계에서 완전히 자율적으로 작동하려면 현실 세계의 물체도 조작할 수 있어야 합니다. 로봇이 탐색하고, 물체를 찾아 운반하고, 다른 위치로 이동한 다음 올바르게 배치하려면 시각이 필요합니다. 모든 작업은 보고 듣는 내용을 기반으로 자율적으로 수행됩니다.

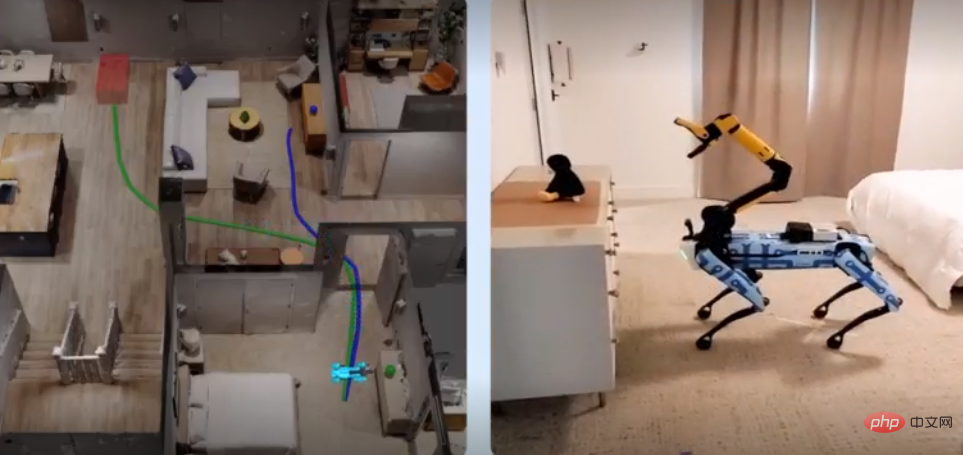

이 문제를 해결하기 위해 Meta의 AI 전문가는 Georgia Institute of Technology의 연구원과 협력하여 로봇이 시뮬레이션하고 훈련하는 데 사용하는 ASC(Adaptive Skill Coordination)라는 새로운 기술을 개발했습니다. 이러한 기술은 실제 로봇에 복제됩니다.

Meta는 Boston Dynamics와도 협력하여 ASC 기술의 효율성을 입증했습니다. 두 회사는 ASC 기술을 Boston Dynamics의 Spot 로봇과 결합하여 로봇에 강력한 감지, 탐색 및 조작 기능을 제공했지만 상당한 인간 개입도 필요했습니다. 예를 들어, 물체를 선택하려면 누군가가 로봇 태블릿에 표시된 물체를 클릭해야 합니다.

연구원들은 기사에서 다음과 같이 썼습니다. "우리의 목표는 Boston Dynamics API를 통해 온보드 감지 및 모터 명령으로 세상을 인식할 수 있는 AI 모델을 구축하는 것입니다."

Spot 로봇은 Habitat 시뮬레이터를 사용하여 테스트되었습니다. 시뮬레이션 환경은 1,000개 이상의 주택에 대한 실내 3D 스캔 데이터가 포함된 HM3D 및 ReplicaCAD 데이터 세트를 사용하여 구축되었습니다. 그런 다음 스팟 로봇은 이전에 본 적이 없는 집 주위를 이동하고 물건을 운반하고 적절한 위치에 배치하도록 훈련되었습니다. 훈련된 스팟 로봇이 얻은 지식과 정보는 현실 세계에서 작동하는 스팟 로봇에 복제되며, 집 구조에 대한 지식을 바탕으로 동일한 작업을 자동으로 수행합니다.

연구원들은 다음과 같이 썼습니다. “우리는 매우 다른 두 가지 실제 환경, 즉 185제곱미터의 가구가 완비된 아파트와 65제곱미터의 대학 실험실을 사용하여 Spot 로봇을 테스트했습니다. 전반적으로 ASC 기술이 적용된 스팟 로봇은 60번의 테스트 중 59번의 성공, 하드웨어 불안정성, 픽업 실패, 이동 장애물이나 경로 차단과 같은 적대적 간섭을 극복하는 등 거의 완벽하게 수행되었습니다."라고 말했습니다. 또한 VC-1 모델의 소스 코드를 공개하고 모델 크기, 데이터 세트 크기 등을 확장하는 방법에 대한 세부 정보를 다른 논문에서 공유했다고 합니다. 그 동안 팀의 다음 초점은 VC-1을 ASC와 통합하여 보다 인간과 유사한 표현형 AI 시스템을 만드는 것입니다.

위 내용은 메타 연구진, 로봇이 시각적으로 작동할 수 있는 인공 시각 피질 개발의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7471

7471

15

15

1377

1377

52

52

77

77

11

11

48

48

19

19

19

19

30

30

Laravel 's geospatial : 대화식지도의 최적화 및 많은 양의 데이터

Apr 08, 2025 pm 12:24 PM

Laravel 's geospatial : 대화식지도의 최적화 및 많은 양의 데이터

Apr 08, 2025 pm 12:24 PM

7 백만 레코드를 효율적으로 처리하고 지리 공간 기술로 대화식지도를 만듭니다. 이 기사는 Laravel과 MySQL을 사용하여 7 백만 개 이상의 레코드를 효율적으로 처리하고 대화식지도 시각화로 변환하는 방법을 살펴 봅니다. 초기 챌린지 프로젝트 요구 사항 : MySQL 데이터베이스에서 7 백만 레코드를 사용하여 귀중한 통찰력을 추출합니다. 많은 사람들이 먼저 프로그래밍 언어를 고려하지만 데이터베이스 자체를 무시합니다. 요구 사항을 충족시킬 수 있습니까? 데이터 마이그레이션 또는 구조 조정이 필요합니까? MySQL이 큰 데이터로드를 견딜 수 있습니까? 예비 분석 : 주요 필터 및 속성을 식별해야합니다. 분석 후, 몇 가지 속성만이 솔루션과 관련이 있음이 밝혀졌습니다. 필터의 타당성을 확인하고 검색을 최적화하기위한 제한 사항을 설정했습니다. 도시를 기반으로 한지도 검색

MySQL을 해결하는 방법을 시작할 수 없습니다

Apr 08, 2025 pm 02:21 PM

MySQL을 해결하는 방법을 시작할 수 없습니다

Apr 08, 2025 pm 02:21 PM

MySQL 시작이 실패하는 데는 여러 가지 이유가 있으며 오류 로그를 확인하여 진단 할 수 있습니다. 일반적인 원인에는 포트 충돌 (포트 점유 체크 및 구성 수정), 권한 문제 (서비스 실행 사용자 권한 실행), 구성 파일 오류 (파라미터 설정 확인), 데이터 디렉토리 손상 (데이터 복원 또는 테이블 공간 재건), IBDATA 테이블 공간 문제 (IBDATA1 파일 확인), 플러그로드 (확인 오류 로그)가 포함됩니다. 문제를 해결할 때 오류 로그를 기반으로 문제를 분석하고 문제의 근본 원인을 찾고 문제를 방지하고 해결하기 위해 정기적으로 데이터를 백업하는 습관을 개발해야합니다.

설치 후 MySQL을 사용하는 방법

Apr 08, 2025 am 11:48 AM

설치 후 MySQL을 사용하는 방법

Apr 08, 2025 am 11:48 AM

이 기사는 MySQL 데이터베이스의 작동을 소개합니다. 먼저 MySQLworkBench 또는 명령 줄 클라이언트와 같은 MySQL 클라이언트를 설치해야합니다. 1. MySQL-Uroot-P 명령을 사용하여 서버에 연결하고 루트 계정 암호로 로그인하십시오. 2. CreateABase를 사용하여 데이터베이스를 작성하고 데이터베이스를 선택하십시오. 3. CreateTable을 사용하여 테이블을 만들고 필드 및 데이터 유형을 정의하십시오. 4. InsertInto를 사용하여 데이터를 삽입하고 데이터를 쿼리하고 업데이트를 통해 데이터를 업데이트하고 DELETE를 통해 데이터를 삭제하십시오. 이러한 단계를 마스터하고 일반적인 문제를 처리하는 법을 배우고 데이터베이스 성능을 최적화하면 MySQL을 효율적으로 사용할 수 있습니다.

MySQL이 JSON을 반환 할 수 있습니다

Apr 08, 2025 pm 03:09 PM

MySQL이 JSON을 반환 할 수 있습니다

Apr 08, 2025 pm 03:09 PM

MySQL은 JSON 데이터를 반환 할 수 있습니다. json_extract 함수는 필드 값을 추출합니다. 복잡한 쿼리의 경우 where 절을 사용하여 JSON 데이터를 필터링하지만 성능 영향에주의하십시오. JSON에 대한 MySQL의 지원은 지속적으로 증가하고 있으며 최신 버전 및 기능에주의를 기울이는 것이 좋습니다.

다운로드 후 MySQL을 설치할 수 없습니다

Apr 08, 2025 am 11:24 AM

다운로드 후 MySQL을 설치할 수 없습니다

Apr 08, 2025 am 11:24 AM

MySQL 설치 실패의 주된 이유는 다음과 같습니다. 1. 권한 문제, 관리자로 실행하거나 Sudo 명령을 사용해야합니다. 2. 종속성이 누락되었으며 관련 개발 패키지를 설치해야합니다. 3. 포트 충돌, 포트 3306을 차지하는 프로그램을 닫거나 구성 파일을 수정해야합니다. 4. 설치 패키지가 손상되어 무결성을 다운로드하여 확인해야합니다. 5. 환경 변수가 잘못 구성되었으며 운영 체제에 따라 환경 변수를 올바르게 구성해야합니다. 이러한 문제를 해결하고 각 단계를 신중하게 확인하여 MySQL을 성공적으로 설치하십시오.

원격 선임 백엔드 엔지니어 (플랫폼)에는 원이 필요합니다

Apr 08, 2025 pm 12:27 PM

원격 선임 백엔드 엔지니어 (플랫폼)에는 원이 필요합니다

Apr 08, 2025 pm 12:27 PM

원격 선임 백엔드 엔지니어 구직 회사 : 원 위치 : 원격 사무실 직무 유형 : 전임 급여 : $ 130,000- $ 140,000 직무 설명 전체 소프트웨어 개발 라이프 사이클을 다루는 Circle Mobile 애플리케이션 및 공개 API 관련 기능의 연구 및 개발에 참여합니다. 주요 책임은 독립적으로 Rubyonrails를 기반으로 개발 작업을 완료하고 React/Redux/Relay 프론트 엔드 팀과 협력합니다. 웹 애플리케이션의 핵심 기능 및 개선을 구축하고 기능 설계 프로세스 전반에 걸쳐 설계자 및 리더십과 긴밀히 협력하십시오. 긍정적 인 개발 프로세스를 촉진하고 반복 속도를 우선시하십시오. 6 년 이상의 복잡한 웹 애플리케이션 백엔드가 필요합니다.

산성 특성 이해 : 신뢰할 수있는 데이터베이스의 기둥

Apr 08, 2025 pm 06:33 PM

산성 특성 이해 : 신뢰할 수있는 데이터베이스의 기둥

Apr 08, 2025 pm 06:33 PM

데이터베이스 산 속성에 대한 자세한 설명 산 속성은 데이터베이스 트랜잭션의 신뢰성과 일관성을 보장하기위한 일련의 규칙입니다. 데이터베이스 시스템이 트랜잭션을 처리하는 방법을 정의하고 시스템 충돌, 전원 중단 또는 여러 사용자의 동시 액세스가 발생할 경우에도 데이터 무결성 및 정확성을 보장합니다. 산 속성 개요 원자력 : 트랜잭션은 불가분의 단위로 간주됩니다. 모든 부분이 실패하고 전체 트랜잭션이 롤백되며 데이터베이스는 변경 사항을 유지하지 않습니다. 예를 들어, 은행 송금이 한 계정에서 공제되지만 다른 계정으로 인상되지 않은 경우 전체 작업이 취소됩니다. BeginTransaction; updateAccountssetBalance = Balance-100WH

마스터 SQL 한계 절 항의 : 쿼리의 행 수 제어

Apr 08, 2025 pm 07:00 PM

마스터 SQL 한계 절 항의 : 쿼리의 행 수 제어

Apr 08, 2025 pm 07:00 PM

sqllimit 절 : 쿼리 결과의 행 수를 제어하십시오. SQL의 한계 절은 쿼리에서 반환 된 행 수를 제한하는 데 사용됩니다. 이것은 대규모 데이터 세트, 페이지 진화 디스플레이 및 테스트 데이터를 처리 할 때 매우 유용하며 쿼리 효율성을 효과적으로 향상시킬 수 있습니다. 구문의 기본 구문 : SelectColumn1, Collect2, ... Fromtable_namelimitnumber_of_rows; 번호_of_rows : 반환 된 행 수를 지정하십시오. 오프셋이있는 구문 : SelectColumn1, Column2, ... Fromtable_namelimitOffset, number_of_rows; 오프셋 : skip