기계 학습 결정 트리 실습

번역가 | Zhu Xianzhong

리뷰어 | Sun Shujuan

머신러닝의 결정 트리

현대 머신러닝 알고리즘이 우리의 일상을 바꾸고 있습니다. 예를 들어 BERT와 같은 대규모 언어 모델은 Google 검색을 지원하고 GPT-3는 많은 고급 언어 애플리케이션을 지원합니다.

반면에 복잡한 기계 학습 알고리즘을 구축하는 것은 그 어느 때보다 훨씬 쉬워졌습니다. 그러나 기계 학습 알고리즘이 아무리 복잡하더라도 모두 다음 학습 범주 중 하나에 속합니다.

- 지도 학습

- 비지도 학습

- 준지도 학습

- 강화 학습

사실 의사결정 트리는 가장 오래된 지도 머신러닝 알고리즘 중 하나이며 광범위한 실제 문제를 해결할 수 있습니다. 연구에 따르면 의사결정 트리 알고리즘의 최초 발명은 1963년으로 거슬러 올라갑니다.

다음으로, 이 알고리즘의 세부 사항을 자세히 살펴보고 이러한 유형의 알고리즘이 오늘날에도 여전히 인기가 있는 이유를 살펴보겠습니다.

의사결정 트리란 무엇인가요?

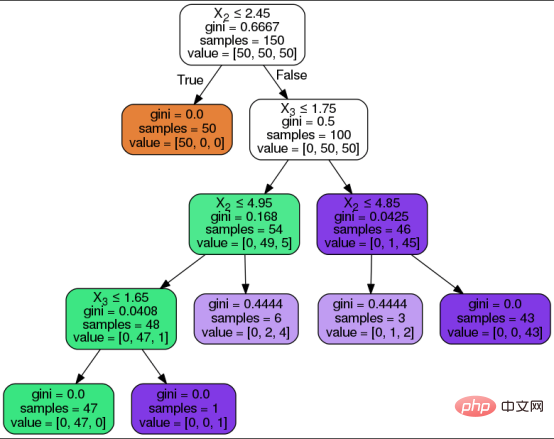

의사결정 트리 알고리즘은 복잡한 데이터 세트를 처리하는 상대적으로 간단한 방법 때문에 널리 사용되는 지도 기계 학습 알고리즘입니다. 의사결정 트리는 트리 구조와 유사하기 때문에 이름이 붙여졌습니다. 트리 구조는 노드와 가장자리 형태의 뿌리, 가지, 잎과 같은 여러 구성 요소로 구성됩니다. 이는 결정이 원하는 예측을 생성하는 if-else 기반 결정 흐름 차트와 유사한 결정 분석에 사용됩니다. 의사결정 트리는 if-else 의사결정 규칙을 학습하여 데이터 세트를 분할하고 최종적으로 트리와 같은 데이터 모델을 생성할 수 있습니다.

분류 문제에 대한 이산 결과 예측과 회귀 문제에 대한 연속 수치 결과 예측에 결정 트리가 적용되었습니다. 수년에 걸쳐 과학자들은 CART, C4.5와 같은 다양한 알고리즘과 랜덤 포레스트 및 그래디언트 부스트 트리와 같은 앙상블 알고리즘을 개발했습니다.

의사결정 트리의 다양한 구성요소 분석

의사결정 트리 알고리즘의 목표는 입력 데이터 세트의 결과를 예측하는 것입니다. 트리 데이터 세트는 속성, 속성값, 예측 유형의 세 가지 형태로 구분됩니다. 지도 학습 알고리즘과 마찬가지로 데이터 세트는 훈련 세트와 테스트 세트의 두 가지 유형으로 나뉩니다. 그 중 훈련 세트는 알고리즘이 학습하여 테스트 세트에 적용하는 결정 규칙을 정의합니다.

의사결정 트리 알고리즘의 단계를 모으기 전에 먼저 의사결정 트리의 구성요소를 이해하겠습니다.

- 루트 노드: 의사결정 트리 상단에 있는 시작 노드이며 모든 속성을 포함합니다. 가치. 루트 노드는 알고리즘이 학습한 결정 규칙을 기반으로 결정 노드로 나뉩니다.

- 분기: 분기는 속성 값에 해당하는 노드 사이의 커넥터입니다. 이진 분할에서 분기는 참 경로와 거짓 경로를 나타냅니다.

- 결정 노드/내부 노드: 내부 노드는 결정 규칙 및 해당 응답 경로에 해당하는 루트 노드와 리프 노드 사이의 결정 노드입니다. 노드는 질문을 나타내고 분기는 해당 질문을 기반으로 관련 답변에 대한 경로를 표시합니다.

- 리프 노드: 리프 노드는 목표 예측을 나타내는 터미널 노드입니다. 이러한 노드는 더 이상 분할되지 않습니다.

다음은 의사 결정 트리와 위 구성 요소를 시각적으로 표현한 것입니다. 의사 결정 트리 알고리즘은 다음 단계를 거쳐 원하는 예측에 도달합니다.

- 알고리즘은 모든 루트 노드에서 시작됩니다. 속성 값.

- 루트 노드는 훈련 세트에서 알고리즘이 학습한 결정 규칙을 기반으로 결정 노드로 나뉩니다.

- 질문과 답변 경로를 기반으로 분기/에지를 통해 내부 결정 노드를 전달합니다.

- 리프 노드에 도달하거나 모든 속성이 사용될 때까지 이전 단계를 계속합니다.

각 노드에서 가장 좋은 속성을 선택하기 위해 분할은 다음 두 가지 속성 선택 측정 방법 중 하나를 기반으로 합니다.

- Gini index (Gini index) 는 Gini Impurity(Gini Impurity)를 측정하여 알고리즘이 무작위 클래스 레이블을 잘못 분류할 가능성을 나타냅니다.

- 정보 이득은 예측 클래스의 50/50 분할을 피하기 위해 분할 후 엔트로피 개선을 측정합니다. 엔트로피는 주어진 데이터 샘플의 불순도를 수학적으로 측정한 것입니다. 의사결정 트리의 혼돈 상태 는 50/50에 가까운 파티션 으로 표시됩니다. 결정 트리 알고리즘을 이용한 꽃 분류 사례

데이터 세트에 대한 간략한 설명

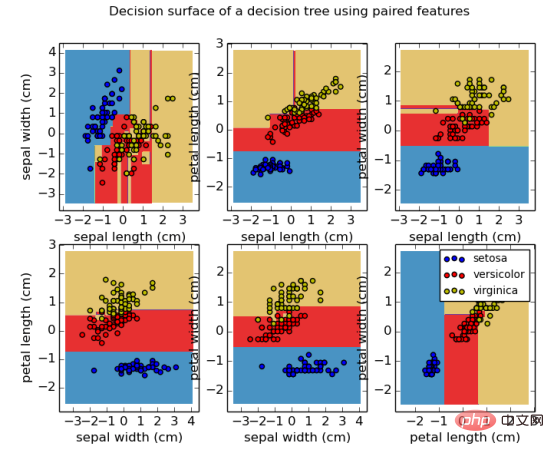

이 튜토리얼의 데이터 세트는 붓꽃 데이터 세트입니다. 이 데이터 세트는 이미 Scikit 오픈 소스 라이브러리에 내장되어 있으므로 개발자는 이를 외부에서 로드할 필요가 없습니다. 이 데이터 세트에는 총 4개의 붓꽃 속성과 해당 속성 값이 포함되어 있으며, 이는 세 가지 유형의 붓꽃 중 하나를 예측하기 위해 모델에 입력됩니다.

- 데이터세트의 속성/특징: 꽃받침 길이, 꽃받침 너비, 꽃잎 길이, 꽃잎 너비.

- 데이터세트의 예측 라벨/꽃 유형: Setosis, Versicolor, Virginica.

라이브러리 가져오기

먼저 다음 코드를 통해 의사결정 트리 구현을 실행하는 데 필요한 라이브러리를 가져옵니다.import pandas as pd

import numpy as np

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.tree import DecisionTreeClassifier

data_set = load_iris()

print('Iris plant classes to predict: ', data_set.target_names)

print('Four features of iris plant: ', data_set.feature_names)

별도의 속성과 태그

별도의 속성과 태그

#提取花的特性和类型信息

X_att = data_set.data

y_label = data_set.target

print('数据集中总的样本数:', X_att.shape[0])

data_view=pd.DataFrame({

'sepal length':X_att[:,0],

'sepal width':X_att[:,1],

'petal length':X_att[:,2],

'petal width':X_att[:,3],

'species':y_label

})

data_view.head()

#数据集拆分为训练集和测试集两部分

X_att_train, X_att_test, y_label_train, y_label_test = train_test_split(X_att, y_label, random_state = 42, test_size = 0.25)

DecisionTreeClassifier 함수를 사용하여 분류 모델을 생성하여 결정 트리를 구현합니다. 표준 "엔트로피" way로 설정합니다. 표준 을 사용하면 이 속성 선택 측정항목을 정보 이득(정보 이득)으로 설정할 수 있습니다. 그런 다음 코드는 모델을 속성 및 레이블의 훈련 세트와 일치시킵니다.

#应用决策树分类器 clf_dt = DecisionTreeClassifier(criterion = 'entropy') clf_dt.fit(X_att_train, y_label_train)

计算模型精度

下面的代码负责计算并打印决策树分类模型在训练集和测试集上的准确性。为了计算准确度分数,我们使用了predict函数。测试结果是:训练集和测试集的准确率分别为100%和94.7%。

print('Training data accuracy: ', accuracy_score(y_true=y_label_train, y_pred=clf_dt.predict(X_att_train)))

print('Test data accuracy: ', accuracy_score(y_true=y_label_test, y_pred=clf_dt.predict(X_att_test)))真实世界中的决策树应用程序

当今社会,机器学习决策树在许多行业的决策过程中都得到广泛应用。其中,决策树的最常见应用首先是在金融和营销部门,例如可用于如下一些子领域:

- 贷款批准

- 支出管理

- 客户流失预测

- 新产品的可行性分析,等等。

如何改进决策树?

作为本文决策树主题讨论的总结,我们有充分的理由安全地假设:决策树的可解释性仍然很受欢迎。决策树之所以容易理解,是因为它们可以被人类以可视化方式展现并便于解释。因此,它们是解决机器学习问题的直观方法,同时也能够确保结果是可解释的。机器学习中的可解释性是我们过去讨论过的一个小话题,它也与即将到来的人工智能伦理主题存在密切联系。

与任何其他机器学习算法一样,决策树自然也可以加以改进,以避免过度拟合和出现过于偏向于优势预测类别。剪枝和ensembling技术是克服决策树算法缺点方案最常采用的方法。决策树尽管存在这些缺点,但仍然是决策分析算法的基础,并将在机器学习领域始终保持重要位置。

译者介绍

朱先忠,51CTO社区编辑,51CTO专家博客、讲师,潍坊一所高校计算机教师,自由编程界老兵一枚。

原文标题:An Introduction to Decision Trees for Machine Learning,作者:Stylianos Kampakis

위 내용은 기계 학습 결정 트리 실습의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7563

7563

15

15

1385

1385

52

52

84

84

11

11

61

61

19

19

28

28

99

99

15가지 추천 오픈 소스 무료 이미지 주석 도구

Mar 28, 2024 pm 01:21 PM

15가지 추천 오픈 소스 무료 이미지 주석 도구

Mar 28, 2024 pm 01:21 PM

이미지 주석은 이미지 콘텐츠에 더 깊은 의미와 설명을 제공하기 위해 이미지에 레이블이나 설명 정보를 연결하는 프로세스입니다. 이 프로세스는 비전 모델을 훈련하여 이미지의 개별 요소를 보다 정확하게 식별하는 데 도움이 되는 기계 학습에 매우 중요합니다. 이미지에 주석을 추가함으로써 컴퓨터는 이미지 뒤의 의미와 맥락을 이해할 수 있으므로 이미지 내용을 이해하고 분석하는 능력이 향상됩니다. 이미지 주석은 컴퓨터 비전, 자연어 처리, 그래프 비전 모델 등 다양한 분야를 포괄하여 차량이 도로의 장애물을 식별하도록 지원하는 등 광범위한 애플리케이션을 보유하고 있습니다. 의료영상인식을 통한 질병진단. 이 기사에서는 주로 더 나은 오픈 소스 및 무료 이미지 주석 도구를 권장합니다. 1.마케센스

이 기사에서는 SHAP: 기계 학습을 위한 모델 설명을 이해하도록 안내합니다.

Jun 01, 2024 am 10:58 AM

이 기사에서는 SHAP: 기계 학습을 위한 모델 설명을 이해하도록 안내합니다.

Jun 01, 2024 am 10:58 AM

기계 학습 및 데이터 과학 분야에서 모델 해석 가능성은 항상 연구자와 실무자의 초점이었습니다. 딥러닝, 앙상블 방법 등 복잡한 모델이 널리 적용되면서 모델의 의사결정 과정을 이해하는 것이 특히 중요해졌습니다. explainable AI|XAI는 모델의 투명성을 높여 머신러닝 모델에 대한 신뢰와 확신을 구축하는 데 도움이 됩니다. 모델 투명성을 향상시키는 것은 여러 복잡한 모델의 광범위한 사용은 물론 모델을 설명하는 데 사용되는 의사 결정 프로세스와 같은 방법을 통해 달성할 수 있습니다. 이러한 방법에는 기능 중요도 분석, 모델 예측 간격 추정, 로컬 해석 가능성 알고리즘 등이 포함됩니다. 특성 중요도 분석은 모델이 입력 특성에 미치는 영향 정도를 평가하여 모델의 의사결정 과정을 설명할 수 있습니다. 모델 예측 구간 추정

학습 곡선을 통해 과적합과 과소적합 식별

Apr 29, 2024 pm 06:50 PM

학습 곡선을 통해 과적합과 과소적합 식별

Apr 29, 2024 pm 06:50 PM

이 글에서는 학습 곡선을 통해 머신러닝 모델에서 과적합과 과소적합을 효과적으로 식별하는 방법을 소개합니다. 과소적합 및 과적합 1. 과적합 모델이 데이터에 대해 과도하게 훈련되어 데이터에서 노이즈를 학습하는 경우 모델이 과적합이라고 합니다. 과적합된 모델은 모든 예를 너무 완벽하게 학습하므로 보이지 않거나 새로운 예를 잘못 분류합니다. 과대적합 모델의 경우 완벽/거의 완벽에 가까운 훈련 세트 점수와 형편없는 검증 세트/테스트 점수를 얻게 됩니다. 약간 수정됨: "과적합의 원인: 복잡한 모델을 사용하여 간단한 문제를 해결하고 데이터에서 노이즈를 추출합니다. 훈련 세트로 사용되는 작은 데이터 세트는 모든 데이터를 올바르게 표현하지 못할 수 있기 때문입니다."

투명한! 주요 머신러닝 모델의 원리를 심층적으로 분석!

Apr 12, 2024 pm 05:55 PM

투명한! 주요 머신러닝 모델의 원리를 심층적으로 분석!

Apr 12, 2024 pm 05:55 PM

일반인의 관점에서 보면 기계 학습 모델은 입력 데이터를 예측된 출력에 매핑하는 수학적 함수입니다. 보다 구체적으로, 기계 학습 모델은 예측 출력과 실제 레이블 사이의 오류를 최소화하기 위해 훈련 데이터로부터 학습하여 모델 매개변수를 조정하는 수학적 함수입니다. 기계 학습에는 로지스틱 회귀 모델, 의사결정 트리 모델, 지원 벡터 머신 모델 등 다양한 모델이 있습니다. 각 모델에는 적용 가능한 데이터 유형과 문제 유형이 있습니다. 동시에, 서로 다른 모델 간에는 많은 공통점이 있거나 모델 발전을 위한 숨겨진 경로가 있습니다. 연결주의 퍼셉트론을 예로 들면, 퍼셉트론의 은닉층 수를 늘려 심층 신경망으로 변환할 수 있습니다. 퍼셉트론에 커널 함수를 추가하면 SVM으로 변환할 수 있다. 이 하나

우주탐사 및 인간정주공학 분야 인공지능의 진화

Apr 29, 2024 pm 03:25 PM

우주탐사 및 인간정주공학 분야 인공지능의 진화

Apr 29, 2024 pm 03:25 PM

1950년대에는 인공지능(AI)이 탄생했다. 그때 연구자들은 기계가 사고와 같은 인간과 유사한 작업을 수행할 수 있다는 것을 발견했습니다. 이후 1960년대에 미국 국방부는 인공 지능에 자금을 지원하고 추가 개발을 위해 실험실을 설립했습니다. 연구자들은 우주 탐사, 극한 환경에서의 생존 등 다양한 분야에서 인공지능의 응용 분야를 찾고 있습니다. 우주탐험은 지구를 넘어 우주 전체를 포괄하는 우주에 대한 연구이다. 우주는 지구와 조건이 다르기 때문에 극한 환경으로 분류됩니다. 우주에서 생존하려면 많은 요소를 고려해야 하며 예방 조치를 취해야 합니다. 과학자와 연구자들은 우주를 탐험하고 모든 것의 현재 상태를 이해하는 것이 우주가 어떻게 작동하는지 이해하고 잠재적인 환경 위기에 대비하는 데 도움이 될 수 있다고 믿습니다.

C++에서 기계 학습 알고리즘 구현: 일반적인 과제 및 솔루션

Jun 03, 2024 pm 01:25 PM

C++에서 기계 학습 알고리즘 구현: 일반적인 과제 및 솔루션

Jun 03, 2024 pm 01:25 PM

C++의 기계 학습 알고리즘이 직면하는 일반적인 과제에는 메모리 관리, 멀티스레딩, 성능 최적화 및 유지 관리 가능성이 포함됩니다. 솔루션에는 스마트 포인터, 최신 스레딩 라이브러리, SIMD 지침 및 타사 라이브러리 사용은 물론 코딩 스타일 지침 준수 및 자동화 도구 사용이 포함됩니다. 실제 사례에서는 Eigen 라이브러리를 사용하여 선형 회귀 알고리즘을 구현하고 메모리를 효과적으로 관리하며 고성능 행렬 연산을 사용하는 방법을 보여줍니다.

당신이 모르는 머신러닝의 5가지 학교

Jun 05, 2024 pm 08:51 PM

당신이 모르는 머신러닝의 5가지 학교

Jun 05, 2024 pm 08:51 PM

머신 러닝은 명시적으로 프로그래밍하지 않고도 컴퓨터가 데이터로부터 학습하고 능력을 향상시킬 수 있는 능력을 제공하는 인공 지능의 중요한 분야입니다. 머신러닝은 이미지 인식, 자연어 처리, 추천 시스템, 사기 탐지 등 다양한 분야에서 폭넓게 활용되며 우리의 삶의 방식을 변화시키고 있습니다. 기계 학습 분야에는 다양한 방법과 이론이 있으며, 그 중 가장 영향력 있는 5가지 방법을 "기계 학습의 5개 학교"라고 합니다. 5개 주요 학파는 상징학파, 연결주의 학파, 진화학파, 베이지안 학파, 유추학파이다. 1. 상징주의라고도 알려진 상징주의는 논리적 추론과 지식 표현을 위해 상징을 사용하는 것을 강조합니다. 이 사고 학교는 학습이 기존을 통한 역연역 과정이라고 믿습니다.

설명 가능한 AI: 복잡한 AI/ML 모델 설명

Jun 03, 2024 pm 10:08 PM

설명 가능한 AI: 복잡한 AI/ML 모델 설명

Jun 03, 2024 pm 10:08 PM

번역기 | 검토자: Li Rui | Chonglou 인공 지능(AI) 및 기계 학습(ML) 모델은 오늘날 점점 더 복잡해지고 있으며 이러한 모델에서 생성되는 출력은 이해관계자에게 설명할 수 없는 블랙박스입니다. XAI(Explainable AI)는 이해관계자가 이러한 모델의 작동 방식을 이해할 수 있도록 하고, 이러한 모델이 실제로 의사 결정을 내리는 방식을 이해하도록 하며, AI 시스템의 투명성, 이 문제를 해결하기 위한 신뢰 및 책임을 보장함으로써 이 문제를 해결하는 것을 목표로 합니다. 이 기사에서는 기본 원리를 설명하기 위해 다양한 설명 가능한 인공 지능(XAI) 기술을 살펴봅니다. 설명 가능한 AI가 중요한 몇 가지 이유 신뢰와 투명성: AI 시스템이 널리 수용되고 신뢰되려면 사용자가 의사 결정 방법을 이해해야 합니다.