최근 Li Feifei가 이끄는 Stanford HAI Institute는 "Generative AI"에 대한 전망 보고서를 발표했습니다.

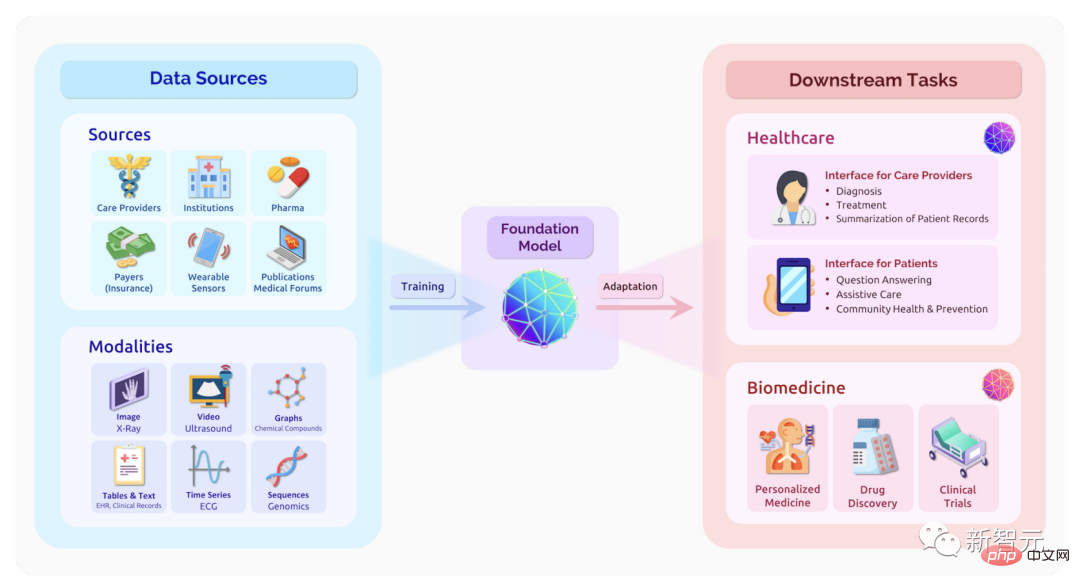

보고서는 대부분의 최신 생성 인공 지능이 기본 모델에 의해 구동된다고 지적합니다.

이 모델이 우리 삶, 지역 사회 및 사회에 가져오는 기회는 엄청나지만 위험도 큽니다.

한편으로 생성 AI는 인간을 더욱 생산적이고 창의적으로 만들 수 있습니다. 반면에 사회적 편견을 증폭시키고 정보에 대한 신뢰를 약화시킬 수도 있습니다.

우리는 이러한 기술이 우리 모두에게 이익이 되도록 하려면 여러 분야 간의 협력이 필수적이라고 믿습니다. 다음은 의학, 과학, 공학, 인문학, 사회 과학 분야의 리더들이 "생성 인공 지능"이 해당 분야와 세계에 어떤 영향을 미칠지에 대해 말하는 내용입니다.

이 기사에서는 현재 생성 AI에 대한 Li Feifei와 Percy Liang의 통찰력을 선택했습니다.

전체 의견 보고서는 다음을 참조하세요.

https://hai.stanford.edu/generative-ai-perspectives-stanford-hai

Stanford HAI의 공동 이사인 Li Feifei는 "인공 지능의 위대한 전환점"이라고 썼습니다.

인간의 두뇌는 세상의 모든 패턴을 인식하고 이를 기반으로 모델을 만들거나 개념을 생성할 수 있습니다. 여러 세대의 인공지능 과학자들의 꿈은 기계에 이러한 생성 능력을 부여하는 것이며, 그들은 생성 모델 알고리즘 개발 분야에서 오랫동안 열심히 노력해 왔습니다.

1966년 MIT 연구원들은 기술을 사용하여 시각 시스템의 중요한 부분을 효과적으로 구축하는 것을 목표로 "Summer Vision Project"(Summer Vision 프로젝트)를 시작했습니다. 이것이 컴퓨터 비전 및 이미지 생성 분야 연구의 시작이었습니다.

최근 딥러닝과 빅데이터의 긴밀한 관계 덕분에 인간은 기계에 언어, 이미지, 오디오 등의 생성 능력을 부여하는 중요한 변곡점에 도달한 것 같습니다.

컴퓨터 비전의 영감은 인간이 볼 수 있는 것을 볼 수 있는 AI를 구축하는 것이지만, 이 분야의 목표는 이를 훨씬 뛰어넘는 것입니다. 미래에 구축될 AI는 인간이 볼 수 없는 것을 볼 수 있어야 합니다. 보세요.

생성 인공 지능을 사용하여 인간의 시력을 향상시키는 방법은 무엇입니까?

예를 들어, 의료 실수로 인한 사망은 미국에서 걱정스러운 문제입니다. 생성적 AI는 의료 서비스 제공자가 잠재적인 문제를 파악하는 데 도움을 줄 수 있습니다.

드물게 오류가 발생하는 경우 생성 AI는 유사한 데이터의 시뮬레이션 버전을 생성하여 AI 모델을 추가로 훈련하거나 의료진에게 훈련을 제공할 수 있습니다.

새로운 생성 도구 개발을 시작하기 전에 사람들이 도구에서 얻고자 하는 것이 무엇인지에 집중해야 합니다.

최근 로봇 작업을 벤치마킹하는 프로젝트에서 연구팀은 작업을 시작하기 전에 대규모 사용자 연구를 실시하여 사람들에게 특정 작업을 로봇이 수행하면 얼마나 많은 이점이 있는지 물었습니다. 사람이 프로젝트의 중심이 됩니다.

생성 인공 지능이 창출하는 중요한 기회를 포착하려면 관련 위험도 합리적으로 평가해야 합니다.

Joy Buolamwini는 "Gender Shading"이라는 연구를 이끌었고 AI가 종종 여성과 유색인종을 식별하는 데 문제가 있다는 사실을 발견했습니다. 과소대표된 집단에 대한 유사한 편견은 생성 AI에서도 계속해서 나타날 것입니다.

AI를 이용해 그림이 생성되었는지 판단하는 것도 매우 중요한 능력입니다. 인간 사회는 시민권에 대한 신뢰를 바탕으로 구축되어 있으며, 이러한 능력이 없으면 우리의 신뢰감은 약화될 것입니다.

기계 생성 기능의 발전은 인간이 볼 수 없는 것을 AI가 볼 수 있는 잠재력과 마찬가지로 매우 흥미롭습니다.

그러나 이러한 역량이 우리의 일상 생활과 환경을 파괴하고 세계 시민으로서의 역할을 훼손할 수 있다는 사실을 경계해야 합니다.

스탠포드 대학 인간 중심 인공 지능 연구소 소장이자 컴퓨터 과학 부교수인 Percy Liang이 기사를 게재했습니다. "신캄브리아기: 과학의 설렘과 불안" 불안"

인류 역사에서 새로운 것을 창조하는 것은 언제나 어려웠고, 이 능력은 거의 전문가만이 소유하고 있습니다.

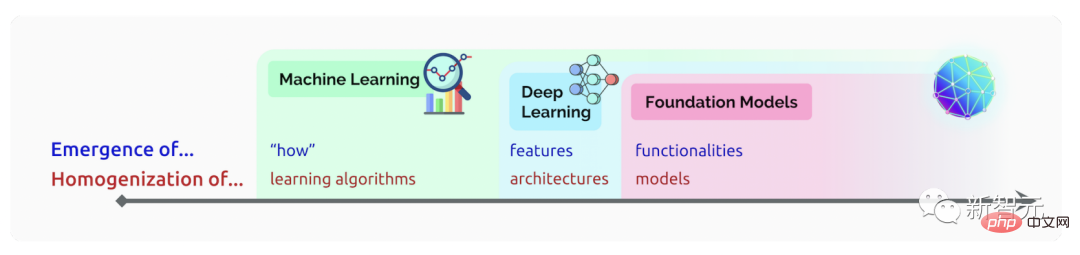

하지만 최근 기본모델의 발전으로 인공지능의 '캄브리아기 폭발'이 일어나고 있고, 인공지능은 영상부터 단백질, 코드까지 무엇이든 만들 수 있게 될 것입니다.

이 능력은 창작의 문턱을 낮추지만, 현실을 인식하는 능력도 박탈합니다.

심층 신경망과 자기 지도 학습을 기반으로 한 기본 모델은 수십 년 동안 존재해 왔습니다. 그러나 최근에는 이러한 모델을 훈련할 수 있는 엄청난 양의 데이터로 인해 모델 기능이 급속히 발전했습니다.

2021년에 발표된 논문에서는 기본 모델의 기회와 위험에 대해 자세히 설명합니다. 이러한 새로운 기능은 "과학계에 대한 흥분의 원천"이 될 것이며 "의도하지 않은 결과"로 이어질 수도 있습니다.

동질성 문제도 논문에서 논의됩니다. 동일한 몇 가지 모델이 많은 응용 프로그램의 기초로 재사용되므로 연구자는 소규모 모델 세트에 집중할 수 있습니다. 그러나 중앙화는 또한 이러한 모델을 단일 실패 지점으로 만들어 많은 다운스트림 애플리케이션에 잠재적인 피해를 줄 수 있습니다.

연구자들이 기본 모델의 성능과 단점을 더 잘 이해하고 보다 합리적인 개발 전략을 세울 수 있도록 기본 모델을 벤치마킹하는 것도 매우 중요합니다.

HELM(언어 모델의 전체적 평가)은 이러한 목적으로 개발되었습니다. HELM은 정확성, 견고성, 공정성과 같은 다양한 지표를 사용하여 일련의 시나리오에서 30개 이상의 잘 알려진 언어 모델의 성능을 평가합니다.

새로운 모델, 새로운 적용 시나리오, 새로운 평가 지표가 계속 등장할 예정입니다. HELM 개발에 기여하는 모든 분들을 환영합니다.

위 내용은 Li Feifei는 AIGC|Stanford HAI 관점 보고서에 대해 다음과 같은 견해를 가지고 있습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!