ConvNeXt V2는 가장 간단한 컨볼루션 아키텍처만을 사용하여 Transformer보다 성능이 열등하지 않습니다.

수십년 간의 기초 연구 끝에 시각적 인식 분야는 대규모 시각적 표현 학습의 새로운 시대를 열었습니다. 사전 훈련된 대규모 비전 모델은 기능 학습 및 비전 애플리케이션을 위한 필수 도구가 되었습니다. 시각적 표현 학습 시스템의 성능은 모델의 신경망 아키텍처, 네트워크 훈련에 사용되는 방법, 훈련 데이터라는 세 가지 주요 요소에 의해 크게 영향을 받습니다. 각 요인의 개선은 전체 모델 성능의 개선에 기여합니다.

신경망 아키텍처 설계의 혁신은 표현 학습 분야에서 항상 중요한 역할을 해왔습니다. ConvNet(컨벌루션 신경망 아키텍처)은 컴퓨터 비전 연구에 큰 영향을 미쳤으며, 수동으로 구현된 기능 엔지니어링에 의존하지 않고도 다양한 시각적 인식 작업에서 범용 기능 학습 방법을 사용할 수 있게 되었습니다. 최근 몇 년 동안 원래 자연어 처리를 위해 개발된 변환기 아키텍처는 다양한 크기의 모델 및 데이터 세트에 대한 적합성으로 인해 다른 딥러닝 분야에서도 널리 사용되고 있습니다.

ConvNeXt 아키텍처의 출현은 기존 ConvNet을 현대화하여 순수 컨볼루션 모델이 모델 및 데이터 세트 크기의 변화에도 적응할 수 있음을 입증합니다. 그러나 신경망 아키텍처의 설계 공간을 탐색하는 가장 일반적인 방법은 여전히 ImageNet에서 지도 학습 성능을 벤치마킹하는 것입니다.

또 다른 아이디어는 시각적 표현 학습의 초점을 레이블 지정 지도 학습에서 자기 지도 사전 학습으로 전환하는 것입니다. 자기 지도 알고리즘은 마스크된 언어 모델링을 시야에 도입했으며 빠르게 시각적 표현 학습을 위한 인기 있는 방법이 되었습니다. 그러나 자기 지도 학습은 일반적으로 지도 학습용으로 설계된 아키텍처를 사용하며 아키텍처가 고정되어 있다고 가정합니다. 예를 들어 MAE(Masked Autoencoder)는 시각적 변환기 아키텍처를 사용합니다.

한 가지 방법은 이러한 아키텍처를 자기 지도 학습 프레임워크와 결합하는 것이지만 몇 가지 특정한 문제에 직면하게 됩니다. 예를 들어 ConvNeXt와 MAE를 결합하면 다음 문제가 발생합니다. MAE는 변환기의 시퀀스 처리 기능에 최적화된 특정 인코더-디코더 설계를 가지고 있어 계산 집약적인 인코더가 눈에 보이는 패치에 집중하게 하여 사전 훈련을 줄입니다. 소송 비용. 그러나 이 디자인은 조밀한 슬라이딩 윈도우를 사용하는 표준 ConvNet과 호환되지 않을 수 있습니다. 더욱이 아키텍처와 교육 목표 간의 관계를 고려하지 않으면 최적의 성과를 달성할 수 있는지 여부가 불분명합니다. 실제로 기존 연구에서는 마스크 기반 자기 지도 학습으로 ConvNet을 훈련시키는 것이 어렵다는 것을 보여주고 있으며, 실험적 증거에 따르면 Transformer와 ConvNet은 특징 학습에서 서로 다를 수 있으며 이는 최종 표현의 품질에 영향을 미칠 수 있습니다. ㅋㅋㅋ 이 프레임워크의 목적은 마스크 기반 자기 지도 학습을 ConvNeXt 모델에 적용하고 변환기와 비슷한 결과를 얻을 수 있도록 하는 것입니다. ㅋㅋㅋ , 희소 컨볼루션은 보이는 부분을 처리하는 데 사용됩니다. 이 아이디어는 대규모 3D 포인트 클라우드를 처리할 때 희소 컨볼루션을 사용하는 것에서 영감을 얻었습니다. 구체적으로, 이 연구에서는 희소 컨볼루션을 사용하여 ConvNeXt를 구현한 다음 미세 조정 중에 특별한 처리 없이 가중치를 표준 밀집 네트워크 계층으로 다시 변환할 수 있다고 제안합니다. 사전 훈련 효율성을 더욱 향상시키기 위해 이 연구에서는 변환기 디코더를 단일 ConvNeXt로 대체하여 전체 디자인을 완전히 컨벌루션으로 만듭니다. 연구원들은 이러한 변경 사항을 추가한 후 학습된 기능이 유용하고 기본 결과를 개선했지만 미세 조정된 성능은 여전히 변환기 기반 모델보다 열등하다는 것을 관찰했습니다.

그런 다음 연구에서는 다양한 학습 구성을 사용하여 ConvNeXt의 기능 공간을 분석했습니다. 연구원들은 마스킹된 입력에 대해 ConvNeXt를 직접 훈련할 때 MLP 계층에서 잠재적인 기능 붕괴 문제를 발견했습니다. 본 연구에서는 이러한 문제를 해결하기 위해 전역 응답 정규화 계층(Global Response Normalization layer)을 추가하여 채널 간 특성 경쟁을 강화하는 것을 제안합니다. 이 개선 사항은 마스크된 자동 인코더를 사용하여 모델을 사전 훈련할 때 가장 효과적입니다. 이는 지도 학습의 고정 아키텍처 설계를 재사용하는 것이 최선의 접근 방식이 아닐 수 있음을 시사합니다.

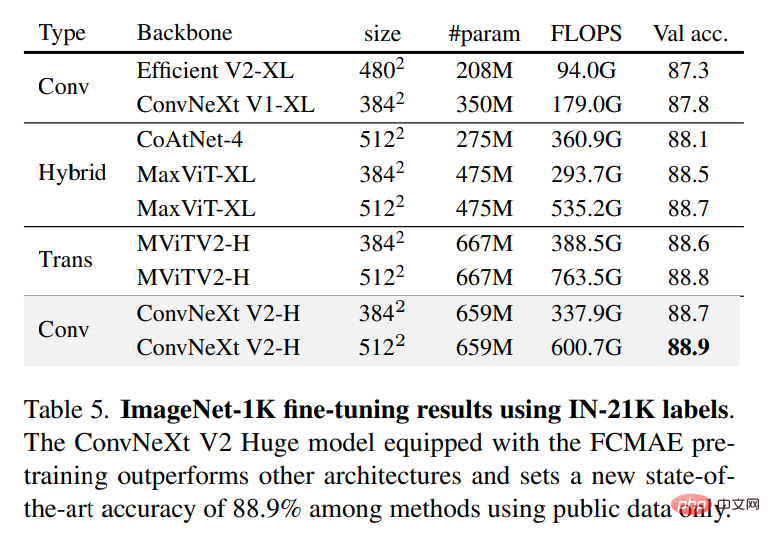

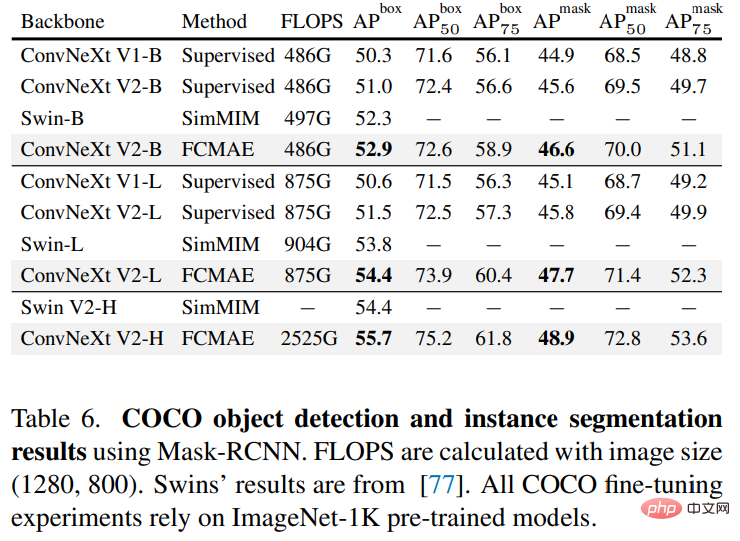

위의 개선 사항을 바탕으로 본 연구에서는 Masked Autoencoder와 결합 시 더 나은 성능을 보이는 ConvNeXt V2를 제안합니다. 동시에 연구원들은 ConvNeXt V2가 ImageNet의 분류 작업, COCO의 대상 탐지, ADE20K의 의미론적 분할을 포함한 다양한 다운스트림 작업에서 순수 ConvNet에 비해 상당한 성능 향상을 보인다는 사실을 발견했습니다.

방법 소개

Full Convolutional Masked Autoencoder

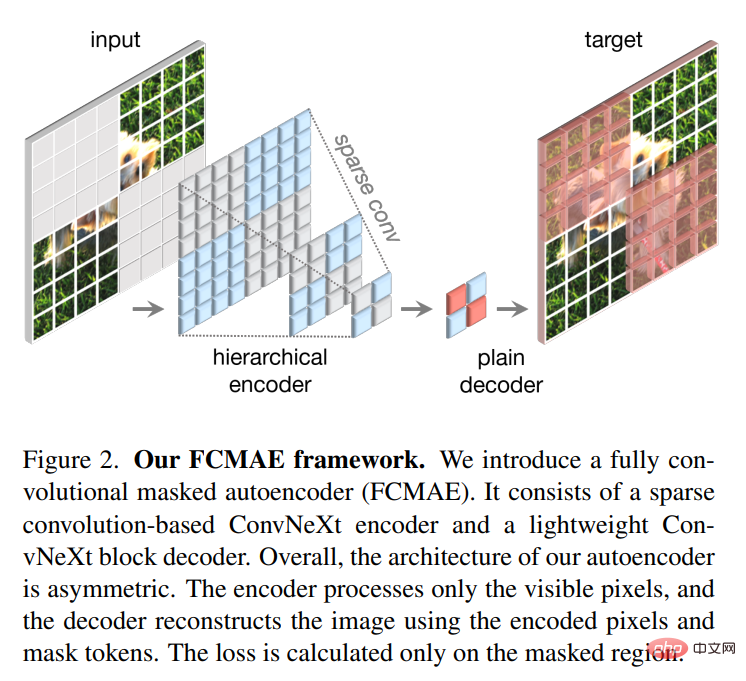

본 연구에서 제안하는 방법은 개념적으로 간단하며 전체 컨볼루션 방식을 기반으로 작동합니다. 학습 신호는 원본 시각적 입력을 높은 마스크 비율로 무작위로 마스킹한 다음 모델이 나머지 컨텍스트를 기반으로 누락된 부분을 예측하도록 하여 생성됩니다. 전체적인 프레임워크는 아래 그림과 같습니다.

프레임워크는 희소 컨볼루션 기반 ConvNeXt 인코더와 경량 ConvNeXt 디코더로 구성되며, 여기서 자동 인코더의 구조는 비대칭입니다. 인코더는 눈에 보이는 픽셀만 처리하는 반면, 디코더는 인코딩된 픽셀과 마스크 토큰을 사용하여 이미지를 재구성합니다. 동시에 손실은 마스크된 영역에서만 계산됩니다.

전역 반응 정규화

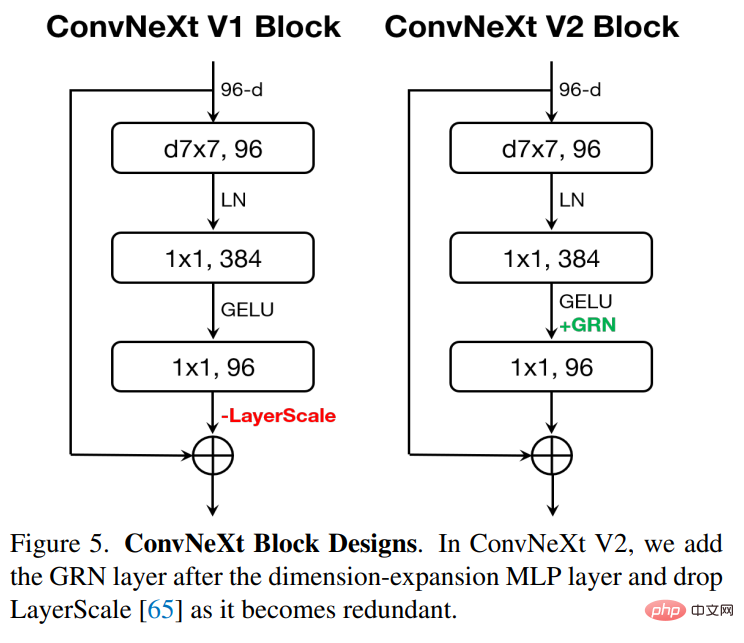

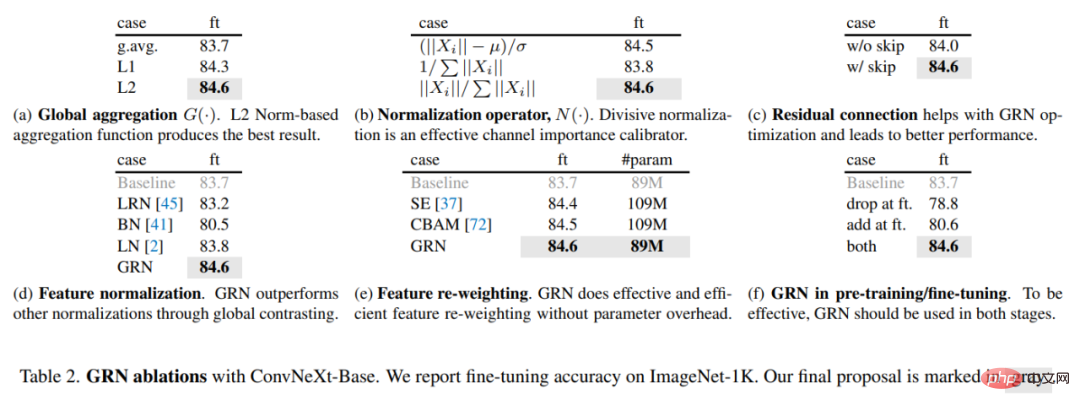

뇌에는 신경 다양성을 촉진하는 많은 메커니즘이 있습니다. 예를 들어, 측면 억제는 활성화된 뉴런의 반응을 향상시켜 자극에 대한 개별 뉴런의 대비와 선택성을 높이는 동시에 전체 뉴런 집단의 반응 다양성을 증가시키는 데 도움이 될 수 있습니다. 딥러닝에서는 이러한 형태의 측면 억제가 반응 정규화를 통해 달성될 수 있습니다. 이 연구에서는 채널 간의 대비와 선택성을 높이는 것을 목표로 하는 GRN(Global Response Normalization)이라는 새로운 응답 정규화 계층을 소개합니다. GRN 단위는 1) 전역 기능 집계, 2) 기능 정규화, 3) 기능 보정의 세 단계로 구성됩니다. 아래 그림과 같이 GRN 레이어를 원래 ConvNeXt 블록에 병합할 수 있습니다.

연구원들은 실험을 통해 GRN 적용 시 LayerScale이 필요하지 않고 삭제될 수 있다는 사실을 발견했습니다. 이 새로운 블록 설계를 활용하여 연구에서는 경량(Atto)에서 계산 집약적(Huge)에 이르기까지 ConvNeXt V2 모델 제품군이라고 하는 다양한 효율성과 용량을 갖춘 여러 모델을 만들었습니다.

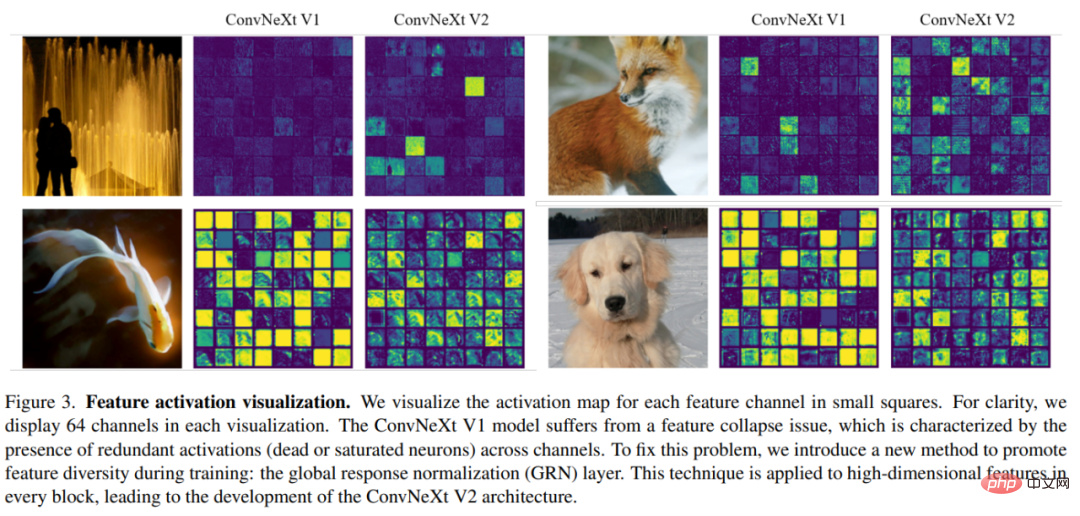

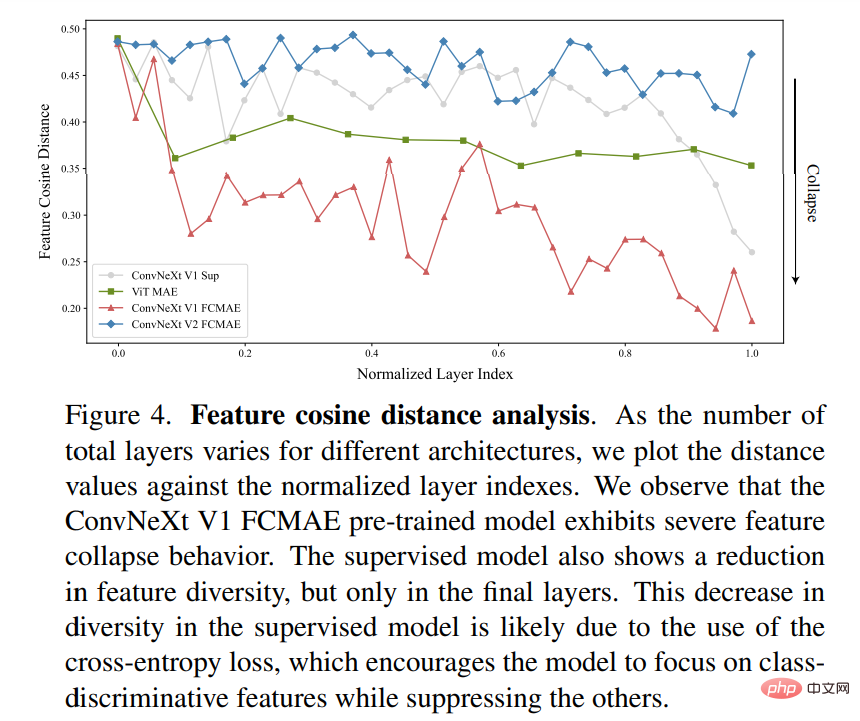

GRN의 역할을 평가하기 위해 이 연구에서는 FCMAE 프레임워크를 사용하여 ConvNeXt V2를 사전 훈련했습니다. 아래 그림 3의 시각적 디스플레이와 그림 4의 코사인 거리 분석을 통해 ConvNeXt V2가 기능 붕괴 문제를 효과적으로 완화한다는 것을 알 수 있습니다. 코사인 거리 값은 지속적으로 높으며, 이는 네트워크 계층 전송 중에 특징의 다양성이 유지될 수 있음을 나타냅니다. 이는 MAE를 사용하여 사전 훈련된 ViT 모델과 유사합니다. 이는 ConvNeXt V2의 학습 동작이 유사한 마스크 이미지 사전 학습 프레임워크에서 ViT와 유사하다는 것을 보여줍니다.

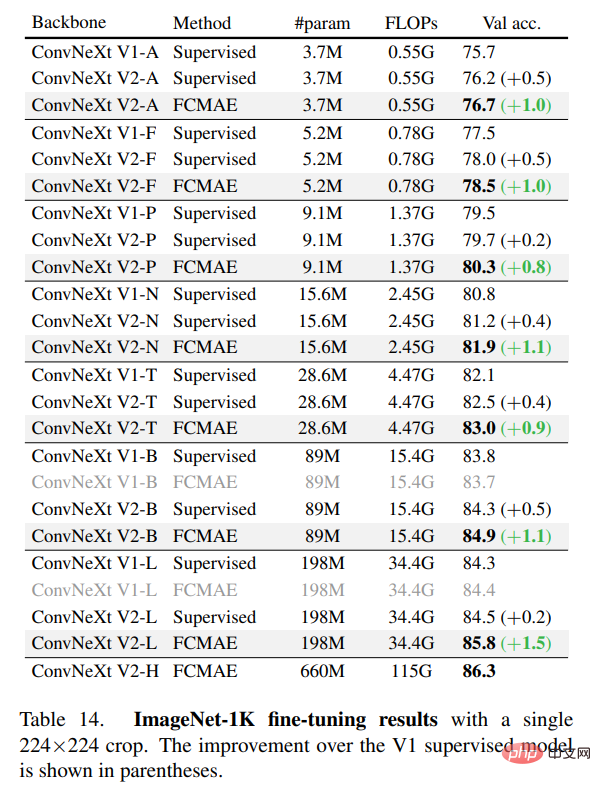

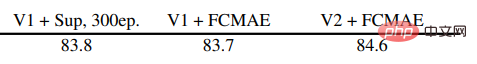

연구에서는 미세 조정 성능을 추가로 평가했으며 그 결과는 아래 표에 나와 있습니다.

GRN을 장착하면 FCMAE 사전 훈련된 모델이 300 에포크를 사용하여 훈련된 지도 모델보다 훨씬 뛰어난 성능을 발휘할 수 있습니다. GRN은 마스크 기반 사전 훈련에 중요하고 ConvNeXt V1 모델에는 없는 기능 다양성을 향상하여 표현 품질을 향상시킵니다. 매개변수 오버헤드를 추가하거나 FLOPS를 늘리지 않고도 이러한 개선이 달성된다는 점은 주목할 가치가 있습니다.

마지막으로 이 연구에서는 사전 훈련 및 미세 조정에서 GRN의 중요성도 조사했습니다. 아래 표 2(f)에서 볼 수 있듯이 미세 조정에서 GRN을 제거하거나 미세 조정 중에 새로 초기화된 GRN을 추가하면 성능이 크게 떨어지므로 사전 훈련과 미세 조정 모두에서 GRN이 중요함을 나타냅니다.

관심 있는 독자는 논문의 원문을 읽고 더 많은 연구 세부 사항을 알아볼 수 있습니다.

위 내용은 ConvNeXt V2는 가장 간단한 컨볼루션 아키텍처만을 사용하여 Transformer보다 성능이 열등하지 않습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7691

7691

15

15

1639

1639

14

14

1393

1393

52

52

1287

1287

25

25

1229

1229

29

29

세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. 중국의 기능은 GPT-4와 비슷하며 가격은 GPT-4-Turbo의 거의 1%에 불과합니다.

May 07, 2024 pm 04:13 PM

세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. 중국의 기능은 GPT-4와 비슷하며 가격은 GPT-4-Turbo의 거의 1%에 불과합니다.

May 07, 2024 pm 04:13 PM

기존 컴퓨팅을 능가할 뿐만 아니라 더 낮은 비용으로 더 효율적인 성능을 달성하는 인공 지능 모델을 상상해 보세요. 이것은 공상과학 소설이 아닙니다. DeepSeek-V2[1], 세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. DeepSeek-V2는 경제적인 훈련과 효율적인 추론이라는 특징을 지닌 전문가(MoE) 언어 모델의 강력한 혼합입니다. 이는 236B 매개변수로 구성되며, 그 중 21B는 각 마커를 활성화하는 데 사용됩니다. DeepSeek67B와 비교하여 DeepSeek-V2는 더 강력한 성능을 제공하는 동시에 훈련 비용을 42.5% 절감하고 KV 캐시를 93.3% 줄이며 최대 생성 처리량을 5.76배로 늘립니다. DeepSeek은 일반 인공지능을 연구하는 회사입니다.

AI가 수학적 연구를 전복시킨다! 필즈상 수상자이자 중국계 미국인 수학자, Terence Tao가 좋아하는 11개 논문 발표 |

Apr 09, 2024 am 11:52 AM

AI가 수학적 연구를 전복시킨다! 필즈상 수상자이자 중국계 미국인 수학자, Terence Tao가 좋아하는 11개 논문 발표 |

Apr 09, 2024 am 11:52 AM

AI는 실제로 수학을 변화시키고 있습니다. 최근 이 문제에 주목하고 있는 타오저쉬안(Tao Zhexuan)은 '미국수학회지(Bulletin of the American Mathematical Society)' 최신호를 게재했다. '기계가 수학을 바꿀 것인가?'라는 주제를 중심으로 많은 수학자들이 그들의 의견을 표현했습니다. 저자는 필즈상 수상자 Akshay Venkatesh, 중국 수학자 Zheng Lejun, 뉴욕대학교 컴퓨터 과학자 Ernest Davis 등 업계의 유명 학자들을 포함해 강력한 라인업을 보유하고 있습니다. AI의 세계는 극적으로 변했습니다. 이 기사 중 상당수는 1년 전에 제출되었습니다.

Google은 열광하고 있습니다. JAX 성능이 Pytorch와 TensorFlow를 능가합니다! GPU 추론 훈련을 위한 가장 빠른 선택이 될 수 있습니다.

Apr 01, 2024 pm 07:46 PM

Google은 열광하고 있습니다. JAX 성능이 Pytorch와 TensorFlow를 능가합니다! GPU 추론 훈련을 위한 가장 빠른 선택이 될 수 있습니다.

Apr 01, 2024 pm 07:46 PM

Google이 추진하는 JAX의 성능은 최근 벤치마크 테스트에서 Pytorch와 TensorFlow를 능가하여 7개 지표에서 1위를 차지했습니다. 그리고 JAX 성능이 가장 좋은 TPU에서는 테스트가 이루어지지 않았습니다. 개발자들 사이에서는 여전히 Tensorflow보다 Pytorch가 더 인기가 있습니다. 그러나 앞으로는 더 큰 모델이 JAX 플랫폼을 기반으로 훈련되고 실행될 것입니다. 모델 최근 Keras 팀은 기본 PyTorch 구현을 사용하여 세 가지 백엔드(TensorFlow, JAX, PyTorch)와 TensorFlow를 사용하는 Keras2를 벤치마킹했습니다. 첫째, 그들은 주류 세트를 선택합니다.

안녕하세요, 일렉트릭 아틀라스입니다! 보스턴 다이나믹스 로봇 부활, 180도 이상한 움직임에 겁먹은 머스크

Apr 18, 2024 pm 07:58 PM

안녕하세요, 일렉트릭 아틀라스입니다! 보스턴 다이나믹스 로봇 부활, 180도 이상한 움직임에 겁먹은 머스크

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas가 공식적으로 전기 로봇 시대에 돌입했습니다! 어제 유압식 Atlas가 역사의 무대에서 "눈물을 흘리며" 물러났습니다. 오늘 Boston Dynamics는 전기식 Atlas가 작동 중이라고 발표했습니다. 상업용 휴머노이드 로봇 분야에서는 보스턴 다이내믹스가 테슬라와 경쟁하겠다는 각오를 다진 것으로 보인다. 새 영상은 공개된 지 10시간 만에 이미 100만 명이 넘는 조회수를 기록했다. 옛 사람들은 떠나고 새로운 역할이 등장하는 것은 역사적 필연이다. 올해가 휴머노이드 로봇의 폭발적인 해라는 것은 의심의 여지가 없습니다. 네티즌들은 “로봇의 발전으로 올해 개막식도 인간처럼 생겼고, 자유도도 인간보다 훨씬 크다. 그런데 정말 공포영화가 아닌가?”라는 반응을 보였다. 영상 시작 부분에서 아틀라스는 바닥에 등을 대고 가만히 누워 있는 모습입니다. 다음은 입이 떡 벌어지는 내용이다

MLP를 대체하는 KAN은 오픈소스 프로젝트를 통해 컨볼루션으로 확장되었습니다.

Jun 01, 2024 pm 10:03 PM

MLP를 대체하는 KAN은 오픈소스 프로젝트를 통해 컨볼루션으로 확장되었습니다.

Jun 01, 2024 pm 10:03 PM

이달 초 MIT와 기타 기관의 연구자들은 MLP에 대한 매우 유망한 대안인 KAN을 제안했습니다. KAN은 정확성과 해석성 측면에서 MLP보다 뛰어납니다. 그리고 매우 적은 수의 매개변수로 더 많은 수의 매개변수를 사용하여 실행되는 MLP보다 성능이 뛰어날 수 있습니다. 예를 들어 저자는 KAN을 사용하여 더 작은 네트워크와 더 높은 수준의 자동화로 DeepMind의 결과를 재현했다고 밝혔습니다. 구체적으로 DeepMind의 MLP에는 약 300,000개의 매개변수가 있는 반면 KAN에는 약 200개의 매개변수만 있습니다. KAN은 MLP와 같이 강력한 수학적 기반을 가지고 있으며, KAN은 Kolmogorov-Arnold 표현 정리를 기반으로 합니다. 아래 그림과 같이 KAN은

시계열 예측 + NLP 대규모 모델에 대한 새로운 작업: 시계열 예측을 위한 암시적 프롬프트 자동 생성

Mar 18, 2024 am 09:20 AM

시계열 예측 + NLP 대규모 모델에 대한 새로운 작업: 시계열 예측을 위한 암시적 프롬프트 자동 생성

Mar 18, 2024 am 09:20 AM

오늘 저는 시계열 예측 성능을 향상시키기 위해 잠재 공간에서 시계열 데이터를 대규모 자연어 처리(NLP) 모델과 정렬하는 방법을 제안하는 코네티컷 대학의 최근 연구 작업을 공유하고 싶습니다. 이 방법의 핵심은 잠재 공간 힌트(프롬프트)를 사용하여 시계열 예측의 정확성을 높이는 것입니다. 논문 제목: S2IP-LLM: SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting 다운로드 주소: https://arxiv.org/pdf/2403.05798v1.pdf 1. 큰 문제 배경 모델

FisheyeDetNet: 어안 카메라를 기반으로 한 최초의 표적 탐지 알고리즘

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 어안 카메라를 기반으로 한 최초의 표적 탐지 알고리즘

Apr 26, 2024 am 11:37 AM

표적 탐지는 자율주행 시스템에서 상대적으로 성숙한 문제이며, 그 중 보행자 탐지는 가장 먼저 배포되는 알고리즘 중 하나입니다. 대부분의 논문에서 매우 포괄적인 연구가 수행되었습니다. 그러나 서라운드 뷰를 위한 어안 카메라를 사용한 거리 인식은 상대적으로 덜 연구되었습니다. 큰 방사형 왜곡으로 인해 표준 경계 상자 표현은 어안 카메라에서 구현하기 어렵습니다. 위의 설명을 완화하기 위해 확장된 경계 상자, 타원 및 일반 다각형 디자인을 극/각 표현으로 탐색하고 인스턴스 분할 mIOU 메트릭을 정의하여 이러한 표현을 분석합니다. 제안된 다각형 형태의 모델 fisheyeDetNet은 다른 모델보다 성능이 뛰어나며 동시에 자율 주행을 위한 Valeo fisheye 카메라 데이터 세트에서 49.5% mAP를 달성합니다.

공장에서 일하는 테슬라 로봇, 머스크 : 올해 손의 자유도가 22도에 달할 것!

May 06, 2024 pm 04:13 PM

공장에서 일하는 테슬라 로봇, 머스크 : 올해 손의 자유도가 22도에 달할 것!

May 06, 2024 pm 04:13 PM

테슬라의 로봇 옵티머스(Optimus)의 최신 영상이 공개됐는데, 이미 공장에서 작동이 가능한 상태다. 정상 속도에서는 배터리(테슬라의 4680 배터리)를 다음과 같이 분류합니다. 공식은 또한 20배 속도로 보이는 모습을 공개했습니다. 작은 "워크스테이션"에서 따고 따고 따고 : 이번에 출시됩니다. 영상에는 옵티머스가 공장에서 이 작업을 전 과정에 걸쳐 사람의 개입 없이 완전히 자율적으로 완료하는 모습이 담겨 있습니다. 그리고 Optimus의 관점에서 보면 자동 오류 수정에 중점을 두고 구부러진 배터리를 집어 넣을 수도 있습니다. NVIDIA 과학자 Jim Fan은 Optimus의 손에 대해 높은 평가를 했습니다. Optimus의 손은 세계의 다섯 손가락 로봇 중 하나입니다. 가장 능숙합니다. 손은 촉각적일 뿐만 아니라