2023년 첫날, ChatGPT의 연말정산을 확인해보세요!

ChatGPT의 출현은 비록 가장 기술적인 것은 아닐지라도 2022년 하반기 가장 눈길을 끄는 AI 혁신이 될 수 있습니다.

얼마 전 뉴올리언스에서 열린 2022 NeurIPS에서는 GPT-4에 대한 소문이 끊이지 않았으며, 동시에 OpenAI도 뉴스 매체의 초점이 되었습니다.

OpenAI는 AI 대규모 언어 모델인 GPT-3 시리즈의 새로운 모델인 text-davinci-003을 발표했습니다. 성능을 향상시키기 위해 더 높은 품질의 긴 형식의 콘텐츠를 생성합니다.

새로운 모델은 InstructGPT를 기반으로 구축되었으며 인간의 피드백과 함께 강화 학습을 사용하여 언어 모델을 인간의 지시에 더 잘 맞춥니다.

Da Vinci-003은 인간 시연과 고득점 모델 샘플에 대한 감독 미세 조정을 사용하여 생성 품질을 향상시키는 진정한 인간 피드백 강화 학습(RLHF) 모델입니다. "

"GPT-3.5 시리즈"의 또 다른 부분으로 OpenAI는 ChatGPT의 초기 시연을 공개했습니다. 회사는 이 대화형 대화 모델이 수많은 후속 질문에 답할 수 있을 뿐만 아니라 실수를 인정하고, 잘못된 질문 전제에 질문하고, 부적절한 질문 요청을 거부합니다.

OpenAI는 블로그 게시물에서 ChatGPT의 연구 릴리스가 "점점 더 안전하고 유용한 AI 시스템을 반복적으로 배포하는 OpenAI의 최신 단계"라고 말했습니다. 이는 GPT-3 및 Codex Many와 같은 이전 모델 배포에서 가져온 것입니다. RLHF(Reinforcement Learning with Human Feedback)를 활용하면 학습된 교훈, 해롭고 비현실적인 출력 결과가 크게 줄어듭니다.

또한 ChatGPT는 교육에서 기계 학습 모델임을 강조하므로 논란을 피하기 위한 것일 수도 있습니다. 얼마 전 구글의 챗봇 LaMDA로 인해 발생한 'AI가 의식이 있는지'에 대한 논란이 일었다.

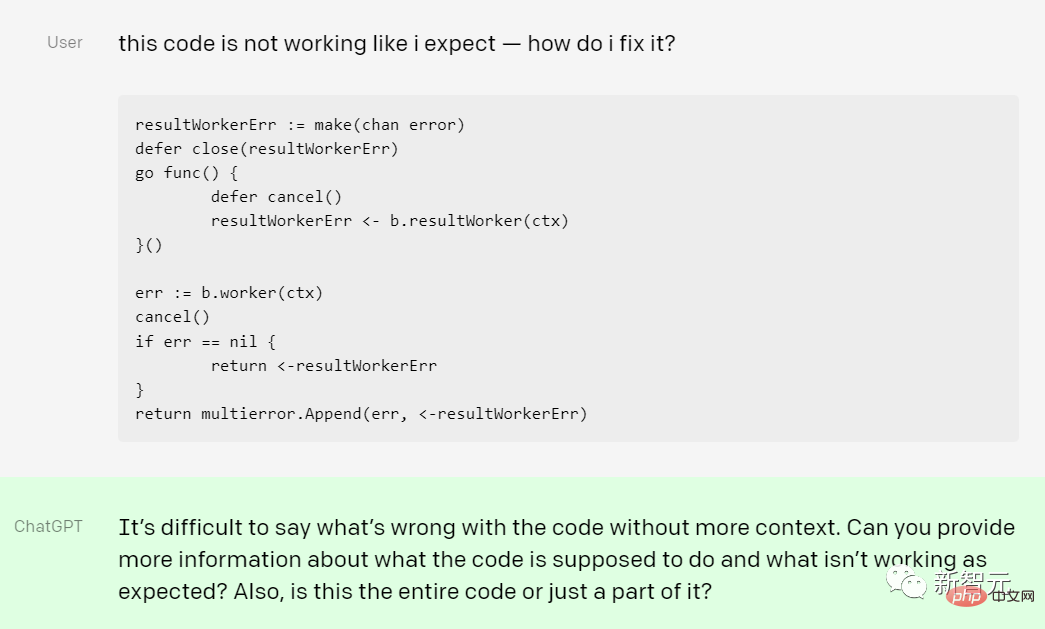

물론 ChatGPT에도 한계가 있습니다.

블로그 게시물에서 OpenAI는 때로는 답변이 합리적으로 들리지만 실제로는 부정확하거나 무의미하다는 사실을 포함하여 제한 사항을 자세히 설명합니다.

"이 문제를 해결하는 것은 매우 어렵습니다. 왜냐하면 (1) 현재 강화 학습 훈련 중에 신뢰할 수 있는 소스에 대한 보장이 없기 때문입니다. (2) 훈련 모델은 더 조심스럽고 문제가 맞을 수 있는 답변을 거부합니다. ( 3) 이상적인 답변은 인간 시연자가 아는 것이 아니라 모델이 아는 것에 달려 있기 때문에 지도 학습은 모델을 오도할 수 있습니다. "

Open AI는 ChatGPT가 "때때로 유해한 지시에 반응하거나 편향된 행동을 보입니다. 우리는 안전하지 않은 특정 콘텐츠 유형을 경고하거나 차단하기 위해 API를 사용하고 있지만 현재로서는 일부 거짓 부정과 긍정이 있을 것으로 예상하고 있으며, 이 모델을 개선하기 위한 지속적인 작업에 도움이 되도록 사용자 피드백을 수집하는 데 큰 관심을 갖고 있습니다. ".

ChatGPT에는 아직 개선이 필요한 문제가 많이 남아있을 수 있지만 GPT-4가 출시되기 이전에는 ChatGPT가 여전히 최고 수준의 대규모 언어 모델이라는 사실을 부인할 수 없습니다.

하지만 최근 커뮤니티에는 모든 사람의 토론 열정에 불을 붙인 새로운 모델이 있습니다. 가장 중요한 것은 오픈 소스라는 것입니다.

이번 주 Meta의 Make-A-Video를 포함한 비공개 소스 AI 시스템 리버스 엔지니어링을 담당하는 개발자 Philip Wang이 ChatGPT처럼 작동하는 텍스트 생성 모델인 PaLM+RLHF를 출시했습니다.

코드 주소: https://github.com/lucidrains/PaLM-rlhf-pytorch

이 시스템은 Google의 대규모 언어 모델 PaLM과 강화 학습을 인간 피드백(RLHF) 기술과 결합하여 만들어졌습니다. 이메일 초안 작성 및 컴퓨터 코드 제안을 포함하여 ChatGPT에서 거의 모든 작업을 수행할 수 있는 시스템입니다.

PaLm + RLHF의 힘

ChatGPT는 출시 이후 인간과 유사한 고화질 텍스트를 생성하고 사용자 질문에 대화식으로 응답하는 능력으로 기술 세계에 파장을 일으켰습니다. 폭풍.

이는 챗봇 개발 초기 단계의 큰 진전이지만 인공 지능 분야의 많은 팬들은 ChatGPT의 폐쇄적 성격에 대해 우려를 표명했습니다.

현재까지 ChatGPT 모델은 독점 상태로 유지됩니다. 즉, 기본 코드를 대중이 볼 수 없습니다. OpenAI만이 그것이 어떻게 작동하고 어떤 데이터를 처리하는지 실제로 알고 있습니다. 이러한 투명성 부족은 광범위한 결과를 초래할 수 있으며 장기적으로 사용자 신뢰에 영향을 미칠 수 있습니다.

많은 개발자들이 오픈 소스 대안을 구축하기 위해 노력해 왔으며 이제 마침내 출시되었습니다. PaLM+RLHF는 Python 언어용으로 특별히 제작되었으며 PyTorch용으로 구현될 수 있습니다.

개발자는 자동 회귀 변환기만큼 쉽게 PaLM을 교육한 다음 인간의 피드백을 사용하여 보상 모델을 교육할 수 있습니다.

ChatGPT와 마찬가지로 PaLM + RLHF는 본질적으로 단어를 예측하기 위한 통계 도구입니다. PaLM+RLHF는 Reddit의 게시물, 뉴스 기사, 전자책 등 교육 데이터에서 수많은 예제를 입력하면 주변 텍스트의 의미론적 맥락과 같은 패턴을 기반으로 단어가 발생할 가능성이 얼마나 되는지 학습합니다.

정말 너무 완벽하죠?

물론, 이상과 현실 사이에는 여전히 큰 격차가 있습니다. PaLM + RLHF는 완벽해 보이지만 다양한 문제도 있습니다. 가장 큰 문제는 사람들이 아직 그것을 사용할 수 없다는 것입니다.

PaLM + RLHF를 실행하려면 사용자는 블로그, 소셜 미디어, 뉴스 기사, 전자책 등 다양한 소스에서 얻은 기가바이트의 텍스트를 컴파일해야 합니다.

이 데이터는 여러 가지 응답을 생성하는 미세 조정된 PaLm 모델에 공급됩니다. 예를 들어, 모델에게 "경제학의 기본 지식은 무엇입니까?"라고 질문하면 PaLm은 "경제학은 연구하는 사회과학입니다..."라고 대답합니다.

이후 개발자는 사람들에게 모델에서 생성된 답변을 최고부터 최악까지 순위를 매기도록 요청하고 보상 모델을 만듭니다. 마지막으로 순위는 원래 모델의 응답을 가져와 선호도에 따라 정렬하고 주어진 프롬프트에 대한 최상의 답변을 필터링하는 "보상 모델"을 교육하는 데 사용됩니다.

그러나 이는 비용이 많이 드는 과정입니다. 훈련 데이터를 수집하고 모델 자체를 훈련시키는 것은 비용이 많이 들지 않습니다. PaLM에는 5,400억 개의 매개변수가 있으며, 이는 언어 모델이 훈련 데이터에서 학습하는 것입니다. 2020년 연구에 따르면 15억 개의 매개변수만으로 텍스트 생성 모델을 개발하는 데 최대 160만 달러의 비용이 소요되는 것으로 나타났습니다.

올해 7월, Hugging Face 연구진은 1,760억 개의 매개변수로 오픈소스 모델 Bloom을 훈련시키기 위해 3개월을 투자하고 384개의 NVIDIA A100 GPU를 사용했습니다. A100 한 대의 가격은 수천 달러인데, 이는 일반 사용자가 감당할 수 있는 비용이 아닙니다.

또한 모델을 학습시킨 후에도 PaLM + RLHF 크기의 모델을 실행하는 것은 쉽지 않습니다. Bloom은 8개의 A100 GPU를 갖춘 전용 PC를 보유하고 있으며 OpenAI의 텍스트 생성 GPT-3(약 1,750억 개의 매개변수 포함)을 실행하는 데 연간 약 87,000달러가 소요됩니다.

AI 연구원 Sebastian Raschka는 PaLM + RLHF에 대한 기사에서 필요한 개발 워크플로를 확장하는 것도 어려울 수 있다고 지적합니다.

"누군가가 이 모델을 훈련하기 위해 500개의 GPU를 제공하더라도 여전히 인프라를 처리하고 이를 처리할 수 있는 소프트웨어 프레임워크가 있어야 합니다."라고 그는 말했습니다. "이것이 가능하긴 하지만 현재로서는 많은 노력이 필요합니다."

차세대 오픈소스 ChatGPT

높은 비용과 엄청난 규모는 자금이 충분한 기업이나 개인이 없다는 것을 보여줍니다. , 모델 훈련에 어려움을 겪고 있는 PaLM + RLHF는 현재 ChatGPT를 대체할 수 있는 기능이 없습니다.

아직까지 PaLM + RLHF의 정확한 출시일이 없습니다. 참고로 Hugging Face는 Bloom을 훈련하는데 3개월이 걸렸습니다. 이에 비해 5,400억 개의 매개변수가 있는 PaLM + RLHF는 의미 있는 버전을 생성하려면 6~8개월을 기다려야 할 수도 있습니다.

좋은 소식은 지금까지 ChatGPT에 대한 이 오픈 소스 대안을 작업하는 것으로 알려진 세 명의 플레이어가 있다는 것입니다. 야닉 킬처

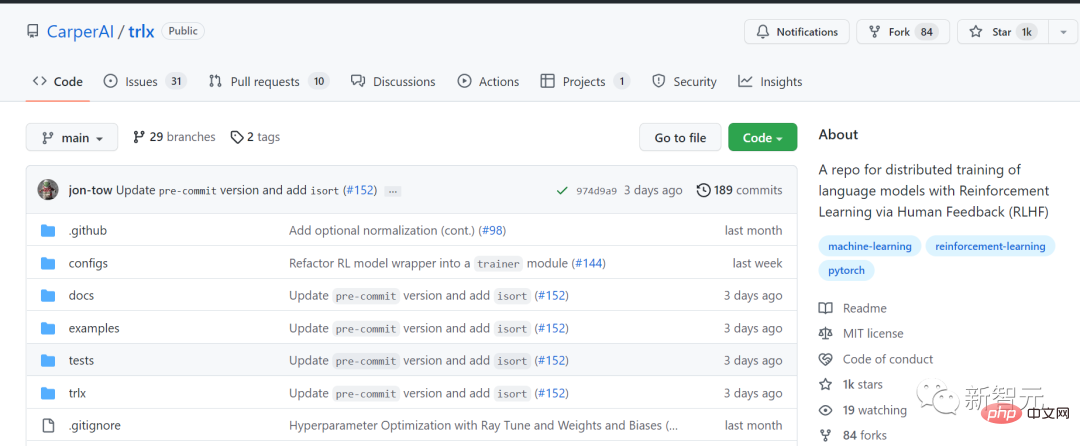

- CarperAI는 EleutherAI 및 스타트업인 Scale AI 및 Hugging Face와 파트너십을 맺고 인간 피드백으로 훈련된 최초의 즉시 실행 가능한 ChatGPT와 유사한 AI 모델을 출시할 계획입니다.

- 코드 주소: https://github.com/CarperAI/trlx

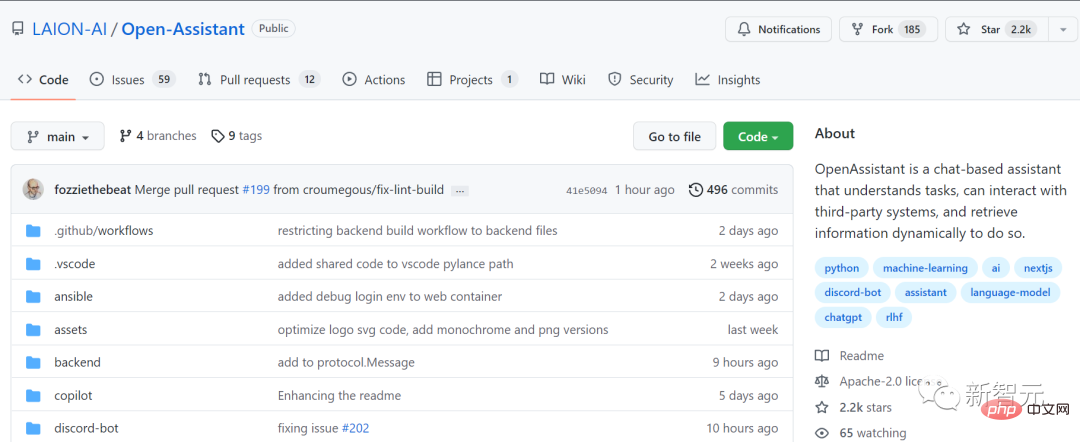

LAION은 Stable Diffusion의 초기 데이터 세트를 제공한 비영리 단체이기도 합니다. Project를 사용하여 최신 기계 학습 기술로 ChatGPT를 복제하세요.

코드 주소 : https://github.com/LAION-AI/Open-Assistant

LAION은 이메일 작성과 지원만 할 수 있는 '미래 도우미'를 만드는 것을 목표로 합니다. "의미 있는 작업 수행, API 사용, 동적인 정보 검색 등"을 수행할 수도 있습니다. 초기 단계이지만 관련 리소스가 포함된 프로젝트가 몇 주 전에 GitHub에 게시되었습니다.

그리고 유튜브 셀럽이자 AI 연구자인 Yannic Kilcher가 만든 GPT-4chan은 "진흙에서 나와 더러워지는" 욕설 전문가에 가깝습니다.

이 모델의 "4chan"은 미국 온라인 익명 포럼입니다. 네티즌의 신원이 익명이기 때문에 많은 사람들이 두려움을 모르고 온갖 정치적으로 잘못된 발언을 합니다. Kilcher는 모델을 훈련하기 위해 공식적으로 4chan의 게시물을 사용했으며 결과는 예측 가능합니다.

포럼의 일반적인 어조와 마찬가지로 GPT-4chan의 답변은 인종차별, 성차별, 반유대주의로 가득 차 있었습니다. 뿐만 아니라 Kilcher는 다른 사람들이 다운로드할 수 있도록 기본 모델을 Hugging Face에 게시했습니다. 그러나 많은 AI 연구자들의 비난으로 인해 관계자들은 신속하게 네티즌들의 모델 접근을 제한했습니다.

더 많은 오픈 소스 언어 모델의 출현을 기대하는 동안, 지금 우리가 할 수 있는 일은 기다리는 것뿐입니다. 물론, ChatGPT를 무료로 계속 사용하는 것도 좋은 생각입니다.

오픈 소스 버전이 공식적으로 출시되기 전에 OpenAI가 아직 개발에서 훨씬 앞서 있다는 점은 주목할 가치가 있습니다. 2023년 GPT-4는 의심할 여지없이 전 세계 AI 애호가들이 기대하는 것입니다.

수많은 AI 거인들이 이에 대해 나름대로 예측을 내렸습니다. 이러한 예측은 좋을 수도 있고 나쁠 수도 있지만, OpenAI COO인 Sam Altman이 말했듯이 "일반 인공지능의 완성은 대부분의 사람들이 상상하는 것보다 더 어려울 것입니다. 대부분의 사람들이 상상하는 모든 것이 바뀔 것입니다."

위 내용은 2023년 첫날, ChatGPT의 연말정산을 확인해보세요!의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7543

7543

15

15

1381

1381

52

52

83

83

11

11

55

55

19

19

21

21

87

87

데비안 메일 서버 방화벽 구성 팁

Apr 13, 2025 am 11:42 AM

데비안 메일 서버 방화벽 구성 팁

Apr 13, 2025 am 11:42 AM

데비안 메일 서버의 방화벽 구성은 서버 보안을 보장하는 데 중요한 단계입니다. 다음은 iptables 및 방화구 사용을 포함하여 일반적으로 사용되는 여러 방화벽 구성 방법입니다. iptables를 사용하여 iptables를 설치하도록 방화벽을 구성하십시오 (아직 설치되지 않은 경우) : sudoapt-getupdatesudoapt-getinstalliptablesview 현재 iptables 규칙 : sudoiptables-l configuration

데비안 메일 서버 SSL 인증서 설치 방법

Apr 13, 2025 am 11:39 AM

데비안 메일 서버 SSL 인증서 설치 방법

Apr 13, 2025 am 11:39 AM

Debian Mail 서버에 SSL 인증서를 설치하는 단계는 다음과 같습니다. 1. OpenSSL 툴킷을 먼저 설치하십시오. 먼저 OpenSSL 툴킷이 이미 시스템에 설치되어 있는지 확인하십시오. 설치되지 않은 경우 다음 명령을 사용하여 설치할 수 있습니다. 개인 키 및 인증서 요청 생성 다음에 다음, OpenSSL을 사용하여 2048 비트 RSA 개인 키 및 인증서 요청 (CSR)을 생성합니다.

Debian OpenSSL을 사용하여 디지털 서명 검증을 수행하는 방법

Apr 13, 2025 am 11:09 AM

Debian OpenSSL을 사용하여 디지털 서명 검증을 수행하는 방법

Apr 13, 2025 am 11:09 AM

Debian 시스템에서 Digital Signature Verification에 OpenSSL을 사용하면 다음을 수행 할 수 있습니다. OpenSSL 설치 준비 : Debian 시스템이 OpenSSL이 설치되어 있는지 확인하십시오. 설치되지 않은 경우 다음 명령을 사용하여 설치할 수 있습니다. Sudoaptupdatesudoaptinstallopenssl 공개 키를 얻으려면 : 디지털 서명 검증에는 서명자의 공개 키가 필요합니다. 일반적으로 공개 키는 public_key.pe와 같은 파일 형태로 제공됩니다.

Centos Shutdown 명령 줄

Apr 14, 2025 pm 09:12 PM

Centos Shutdown 명령 줄

Apr 14, 2025 pm 09:12 PM

CentOS 종료 명령은 종료이며 구문은 종료 [옵션] 시간 [정보]입니다. 옵션은 다음과 같습니다. -H 시스템 중지 즉시 옵션; -P 종료 후 전원을 끕니다. -R 다시 시작; -대기 시간. 시간은 즉시 (현재), 분 (분) 또는 특정 시간 (HH : MM)으로 지정할 수 있습니다. 추가 정보는 시스템 메시지에 표시 될 수 있습니다.

데비안 하프 로그 관리를 수행하는 방법

Apr 13, 2025 am 10:45 AM

데비안 하프 로그 관리를 수행하는 방법

Apr 13, 2025 am 10:45 AM

Debian에서 Hadoop 로그 관리하면 다음 단계 및 모범 사례를 따라갈 수 있습니다. 로그 집계 로그 집계 : Yarn-site.xml 파일에서 Ture에서 True로 설정 할 수 있도록 설정 : 로그 집계를 활성화하십시오. 로그 보유 정책 구성 : 172800 초 (2 일)와 같이 로그의 유지 시간을 정의하기 위해 yarn.log-aggregation.retain-seconds를 설정하십시오. 로그 저장 경로를 지정하십시오 : Yarn.n을 통해

Sony는 PS5 Pro에서 특수 GPU를 사용하여 AMD로 AI를 개발할 가능성을 확인합니다.

Apr 13, 2025 pm 11:45 PM

Sony는 PS5 Pro에서 특수 GPU를 사용하여 AMD로 AI를 개발할 가능성을 확인합니다.

Apr 13, 2025 pm 11:45 PM

Sonyinteractiveent intustionment (SIE, Sony Interactive Entertainment)의 최고 건축가 인 Mark Cerny는 성능 업그레이드 된 AMDRDNA2.X 아키텍처 GPU 및 AMD와 함께 기계 학습/인공 지능 프로그램 코드 "Amethylst"를 포함하여 차세대 호스트 PlayStation5Pro (PS5PRO)에 대한 더 많은 하드웨어 세부 정보를 발표했습니다. PS5PRO 성능 향상의 초점은 여전히 강력한 GPU, Advanced Ray Tracing 및 AI 구동 PSSR Super-Resolution 기능을 포함하여 세 가지 기둥에 있습니다. GPU는 Sony가 RDNA2.x라는 맞춤형 AMDRDNA2 아키텍처를 채택하며 RDNA3 아키텍처가 있습니다.

Debian OpenSSL에서 HTTPS 서버를 구성하는 방법

Apr 13, 2025 am 11:03 AM

Debian OpenSSL에서 HTTPS 서버를 구성하는 방법

Apr 13, 2025 am 11:03 AM

데비안 시스템에서 HTTPS 서버를 구성하려면 필요한 소프트웨어 설치, SSL 인증서 생성 및 SSL 인증서를 사용하기 위해 웹 서버 (예 : Apache 또는 Nginx)를 구성하는 등 여러 단계가 포함됩니다. 다음은 Apacheweb 서버를 사용하고 있다고 가정하는 기본 안내서입니다. 1. 필요한 소프트웨어를 먼저 설치하고 시스템이 최신 상태인지 확인하고 Apache 및 OpenSSL을 설치하십시오 : Sudoaptupdatesudoaptupgradesudoaptinsta

Centos에서 Gitlab의 백업 방법은 무엇입니까?

Apr 14, 2025 pm 05:33 PM

Centos에서 Gitlab의 백업 방법은 무엇입니까?

Apr 14, 2025 pm 05:33 PM

CentOS 시스템 하에서 Gitlab의 백업 및 복구 정책 데이터 보안 및 복구 가능성을 보장하기 위해 CentOS의 Gitlab은 다양한 백업 방법을 제공합니다. 이 기사는 완전한 GITLAB 백업 및 복구 전략을 설정하는 데 도움이되는 몇 가지 일반적인 백업 방법, 구성 매개 변수 및 복구 프로세스를 자세히 소개합니다. 1. 수동 백업 gitlab-rakegitlab : 백업 : 명령을 작성하여 수동 백업을 실행하십시오. 이 명령은 gitlab 저장소, 데이터베이스, 사용자, 사용자 그룹, 키 및 권한과 같은 주요 정보를 백업합니다. 기본 백업 파일은/var/opt/gitlab/backups 디렉토리에 저장됩니다. /etc /gitlab을 수정할 수 있습니다