이미지를 관찰할 때 이미지의 어떤 내용에 먼저 주의를 기울이나요? 또는 이미지의 어떤 영역에 먼저 주의를 끌까요? 기계가 이러한 형태의 인간 주의를 학습할 수 있나요? Google의 연구에 따르면 오픈 소스 주의 센터 모델이 바로 그러한 일을 할 수 있습니다. 그리고 이 모델은 JPEG XL 이미지 형식으로 사용할 수 있습니다.

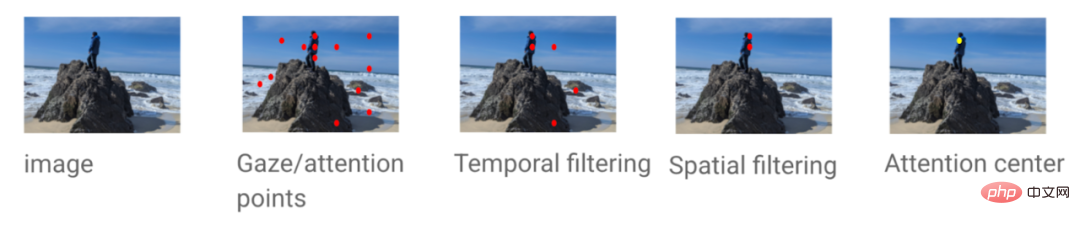

예를 들어 아래 그림은 주의 중심 모델의 일부 예측 예입니다. 여기서 녹색 점은 이미지의 예측된 주의 중심점입니다.

이미지는 Kodak 이미지 데이터세트에서 가져온 것입니다: http://r0k.us/graphics/kodak/

주의 센터 모델 크기는 2MB이고 형식은 TensorFlow Lite입니다. RGB 이미지를 입력으로 사용하고 이미지에서 예측된 관심 중심 지점인 2D 지점을 출력합니다.

주의 센터를 예측하는 모델을 훈련하려면 먼저 주의 센터의 실제 데이터가 필요합니다. 이미지가 주어지면 시선 추적기를 사용하여 일부 주의 사항을 수집하거나 마우스로 이미지를 클릭하여 접근할 수 있습니다. 본 연구에서는 먼저 이러한 주의점에 대해 시간적 필터링을 수행하고 초기 주의점만 유지한 다음 공간적 필터링을 적용하여 노이즈를 제거합니다. 마지막으로 나머지 주의점의 중심을 지상실제주의중심으로 계산한다. 진리값을 구하는 과정의 예시는 아래와 같습니다.

프로젝트 주소: https://github.com/google/attention-center

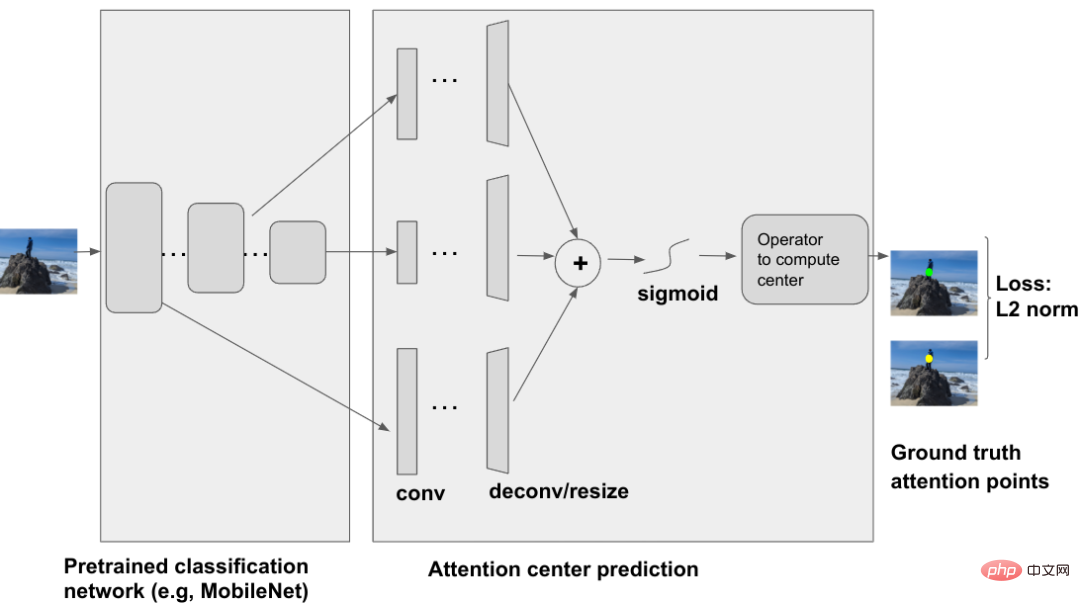

주의 센터 모델은 이미지가 있는 심층 신경망입니다. 가 입력으로 사용되고 ResNet 및 MobileNet과 같은 사전 훈련된 분류 네트워크가 백본으로 사용됩니다. 백본 네트워크에서 출력된 여러 중간 계층은 주의 중심 예측 모듈에 대한 입력으로 사용됩니다. 이러한 서로 다른 중간 레이어에는 서로 다른 정보가 포함됩니다. 예를 들어 얕은 레이어에는 일반적으로 강도/색상/질감과 같은 낮은 수준의 정보가 포함되고, 더 깊은 레이어에는 일반적으로 모양/객체와 같은 더 높고 더 의미 있는 정보가 포함됩니다.

주의 중심 예측은 집계 및 시그모이드 함수와 결합된 컨볼루션 및 디컨볼루션 조정 연산자를 사용하여 주의 중심의 가중치 맵을 생성합니다. 그런 다음 연산자(예: Einstein 합계 연산자)를 사용하여 가중치 그래프에서 중심을 계산할 수 있습니다. 예측된 주의 중심과 실제 주의 중심 사이의 L2 표준이 훈련 손실로 사용됩니다.

또한 JPEG XL은 사용자가 흥미로운 부분이 먼저 표시되는 방식으로 이미지를 인코딩할 수 있는 새로운 이미지 형식입니다. 이것의 장점은 사용자가 온라인으로 이미지를 검색할 때 이미지의 매력적인 부분, 즉 사용자가 먼저 보는 부분이 먼저 표시될 수 있다는 것입니다. 이상적으로는 사용자가 이미지의 나머지 부분을 보면 이미지의 일부가 됩니다. 이미지가 먼저 표시됩니다. 다른 부분이 이미 배치되어 있고 디코딩되었습니다.

JPEG XL에서 이미지는 일반적으로 256 x 256 크기의 행렬로 나뉘며 JPEG XL 인코더는 이미지에서 시작 그룹을 선택한 다음 해당 그룹 주위에 동심원 사각형을 생성합니다. Chrome은 버전 107부터 JPEG XL 이미지의 점진적인 디코딩을 추가했습니다. 현재 JPEG XL은 아직 실험적인 제품이며 chrome://flags에서 jxl을 검색하여 활성화할 수 있습니다.

JPEG XL 이미지의 프로그레시브 로딩 효과를 이해하려면 다음 URL을 방문하여 볼 수 있습니다.

https://google.github.io/attention-center/

위 내용은 사진이 오랫동안 로딩이 안되고 모자이크로 되어있나요? Google의 오픈소스 모델은 이미지의 가장 흥미로운 부분을 우선적으로 표시합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!