Gary Marcus는 Hinton과 Musk에게 공개적으로 외쳤습니다. 딥 러닝이 벽에 부딪혔습니다. 10만 달러를 걸겠습니다.

“만약 누군가가 (딥 러닝이) 벽에 부딪쳤다고 말한다면 그들이 해야 할 일은 딥 러닝이 할 수 없는 일의 목록을 만드는 것뿐입니다. 5년 안에 우리는 딥 러닝이 그것을 해낸다는 것을 증명할 수 있을 것입니다.

6 3월 1일, 은둔 생활을 하고 있는 Geoffrey Hinton이 UC Berkeley 교수 Pieter Abbeel의 팟캐스트에 게스트로 출연했습니다. 두 사람은 Masked Auto-Encoders, AlexNet, Spiking Neural Network 등에 관해 90분간 대화를 나눴습니다.

쇼에서 힌튼은 "딥러닝이 벽에 부딪쳤다"는 견해에 대해 분명히 의문을 제기했습니다.

"딥 러닝이 벽에 부딪혔다"는 말은 유명한 AI 학자 게리 마커스(Gary Marcus)가 지난 3월에 쓴 글에서 나온 것입니다. 정확히 말하면 '순수한 엔드투엔드 딥러닝'은 거의 종말에 이르렀고 AI 분야 전체가 새로운 탈출구를 찾아야 한다고 본다.

출구는 어디인가요? Gary Marcus에 따르면 기호 처리에는 큰 미래가 있습니다. 그러나 이 견해는 커뮤니티에서 심각하게 받아들여진 적이 없습니다. Hinton은 이전에도 "기호 처리 방법에 대한 투자는 큰 실수입니다."라고 말했습니다.

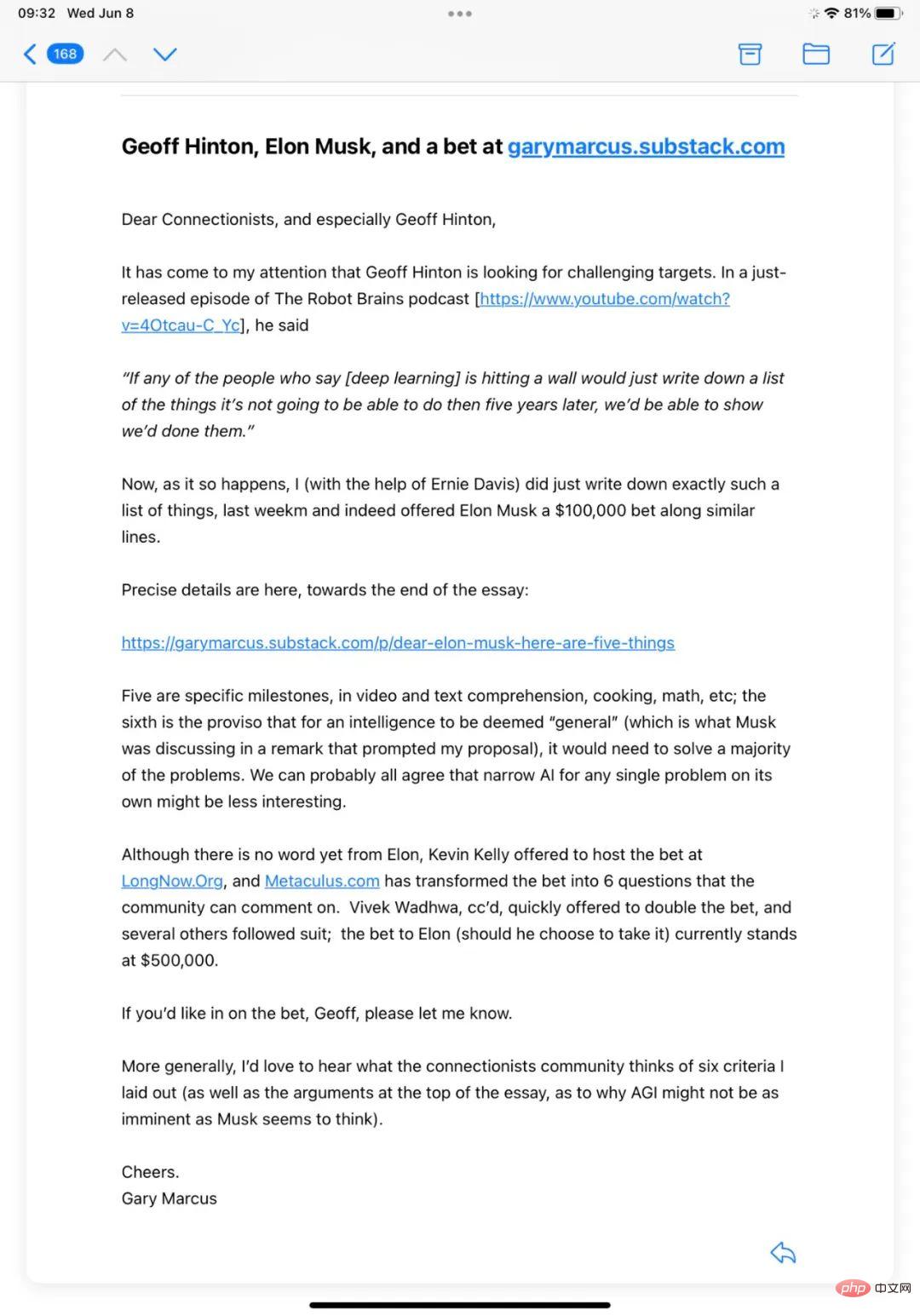

Hinton의 팟캐스트 공개 "반박"은 분명히 Gary Marcus의 관심을 끌었습니다.

12시간 전에 Gary Marcus는 Twitter에서 Geoffrey Hinton에게 공개 서한을 보냈습니다.

편지에는 다음과 같이 적혀 있었습니다. "저는 Geoffrey Hinton이 도전적인 직업을 찾고 있다는 것을 알았습니다. 목표. 저는 실제로 그런 글을 썼습니다. Ernie Davis의 도움으로 목록에 올랐고 지난주에 Musk에 100,000달러를 베팅했습니다. "

여기 Musk에 무슨 일이 일어나고 있나요? 그 이유는 5월 말 트윗에서 시작된다.

머스크와의 $100,000 내기

오랫동안 사람들은 AGI를 A Space Odyssey(HAL) 및 Iron Man(JARVIS)과 같은 영화에 묘사된 일종의 AI로 이해해 왔습니다. 특정 작업을 위해 훈련된 현재 AI와 달리 AGI는 인간의 두뇌와 유사하게 작업을 완료하는 방법을 학습할 수 있습니다.

대부분의 전문가는 AGI가 달성하는 데 수십 년이 걸릴 것이라고 믿는 반면, 일부 전문가는 이 목표가 결코 달성되지 않을 것이라고 믿습니다. 해당 분야 전문가를 대상으로 한 조사에서는 2099년까지 AGI 달성 확률이 50%로 추정됐다.

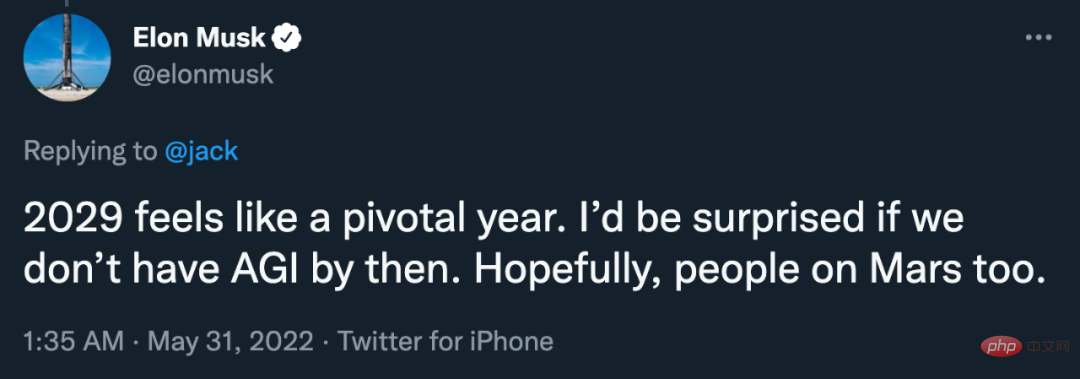

반면에 머스크는 더욱 낙관적인 모습을 보이며 트위터에 공개적으로 다음과 같이 표현했습니다. "2029년은 중요한 해입니다. 그때까지 AGI를 달성하지 못했다면 놀랄 것입니다. 화성 사람들도 그러기를 바랍니다." ."

동의하지 않는 게리 마커스는 재빠르게 "얼마나 베팅할 의향이 있나요?"라고 물었다.

머스크는 이 질문에 답하지 않았지만 게리 마커스는 계속해서 "당신은 설정할 수 있습니다. Long Bets의 게임이고 금액은 $100,000입니다.

Gary Marcus의 견해에 따르면 머스크의 관련 견해는 신뢰할 수 없습니다. “예를 들어, 당신은 2015년에 완전 자율주행차를 달성하는 데 2년이 걸릴 것이라고 말했고 그 이후로 거의 매년 같은 말을 했습니다. , 완전 자율주행은 아직 실현되지 않았습니다."

AGI가 내기로 실현될 수 있는지 테스트하기 위한 다섯 가지 기준도 다음과 같이 적었습니다.

- 2029년에는 AI가 영화를 이해하고 이야기를 정확하게 전달할 수 없게 됩니다. 당신에게 무슨 일이 일어나고 있는지(인물이 누구인지, 그들의 갈등과 동기는 무엇인지 등)

- 2029년에는 AI가 소설을 읽을 수 없으며 줄거리, 인물, 갈등, 동기 등에 대한 질문에 확실하게 대답할 수 없습니다. 2029년 AI는 어떤 주방에서도 유능한 요리사가 될 수 없습니다.

- 2029년 AI는 자연어 사양이나 비전문가 사용자와의 상호 작용을 통해 10,000줄이 넘는 버그 없는 코드(기존 라이브러리의 코드 결합)를 안정적으로 구축할 수 없습니다.

- 2029년에는 AI가 자연어로 작성된 수학적 문서에서 증거를 임의로 가져와 기호 검증에 적합한 기호 형식으로 변환할 수 없게 됩니다. ” 이를 추구하면서 베팅 금액은 $500,000로 늘어났습니다. 그러나 머스크는 현재까지 아무런 반응을 보이지 않고 있다.

Gary Marcus: AGI는 당신이 생각하는 것만큼 "우리 가까이" 있지 않습니다.

6월 6일 Gary Marcus는 Scientific American에 기사를 게재하여 자신의 관점을 반복했습니다. AGI는 가까이 있지 않습니다.

일반인이 보기에는 인공지능 분야에서 엄청난 발전이 이루어지고 있는 것처럼 보입니다. 언론 보도 중: OpenAI의 DALL-E 2는 모든 텍스트를 이미지로 변환할 수 있는 것으로 보이며, GPT-3는 전지하며, 5월에 출시된 DeepMind의 Gato 시스템은 모든 작업에서 좋은 성능을 발휘합니다... DeepMind의 한 고위 임원은 심지어 시작했다고 자랑하기도 했습니다. 인공일반지능(AGI)을 향한 탐구, 인간과 같은 수준의 지능을 갖춘 AI...

속지 마세요. 기계는 언젠가는 인간만큼 똑똑해질 수도 있고, 어쩌면 더 똑똑해질 수도 있지만, 오늘날에는 그렇지 않습니다. 현실 세계를 진정으로 이해하고 추론하는 기계를 만들기 위해서는 아직 해야 할 일이 많습니다. 지금 우리에게 정말로 필요한 것은 자세를 낮추고 보다 기초적인 연구를 하는 것입니다.

확실히 AI는 일부 영역에서 실제로 진전을 보이고 있습니다. 합성 이미지는 점점 더 사실적으로 보이고, 음성 인식은 시끄러운 환경에서도 작동할 수 있습니다. 하지만 보편적인 인간 수준의 AI에는 아직 갈 길이 멀습니다. 예를 들어, 인공지능은 아직 기사와 영상의 진정한 의미를 이해하지 못하며 예상치 못한 장애물과 방해를 처리하지도 못합니다. 우리는 AI를 신뢰할 수 있게 만드는 AI가 수년 동안 겪어온 과제에 여전히 직면해 있습니다.

가토를 예로 들면, 야구를 던지는 투수의 이미지에 제목을 추가하는 작업이 주어지면 시스템은 "야구장에서 공을 던지는 야구선수", "야구장에 공을 던지는 남자"라는 세 가지 답변을 반환합니다. 야구장 위의 공'' 투수가 야구공을 던진다', '야구경기에서 야구선수가 배트와 포수를 친다'. 첫 번째 대답은 정확하지만 나머지 두 개에는 이미지에 표시되지 않는 추가 플레이어가 포함된 것 같습니다. 이는 Gato 시스템이 이미지에 실제로 무엇이 있는지 알지 못하고 대략 유사한 이미지의 전형적인 것이 무엇인지 알 수 있음을 의미합니다. 야구 팬이라면 누구나 이것이 방금 공을 던진 투수라는 것을 알 수 있습니다. 우리는 포수와 타자가 근처에 있을 것으로 예상하지만 이미지에는 눈에 띄게 없습니다.

마찬가지로 DALL-E 2는 "파란색 큐브 위에 빨간색 큐브"와 "빨간색 큐브 위에 파란색 큐브"라는 두 가지 위치 관계를 혼동합니다. 마찬가지로 구글이 지난 5월 공개한 이미지젠(Imagen) 모델은 '말을 탄 우주비행사'와 '말을 탄 우주비행사'를 구분하지 못했다.

DALL-E와 같은 시스템이 잘못되면 여전히 약간 웃기다고 생각할 수 있지만, 잘못되면 매우 심각한 문제를 일으킬 수 있는 일부 AI 시스템이 있습니다. 예를 들어, 자율주행 Tesla는 최근 도로 중앙에 정지 신호를 들고 있는 작업자를 향해 직접 운전하여 차량 속도를 늦추기 위해 인간 운전자의 개입이 필요했습니다. 자율주행 시스템은 스스로 사람을 인식하고 정지 신호도 감지할 수 있었지만, 이 둘의 특이한 조합을 만나면 속도를 늦추지 못했다.

그래서 안타깝게도 AI 시스템은 여전히 신뢰할 수 없으며 새로운 환경에 빠르게 적응하는 데 어려움을 겪고 있습니다.

Gato는 DeepMind에서 보고한 모든 작업을 잘 수행하지만 다른 최신 시스템만큼 잘 수행하는 경우는 거의 없습니다. GPT-3는 유창한 산문을 쓰는 경우가 많지만, 여전히 기본적인 산수를 익히는 데 어려움을 겪고 있으며, 현실에 대한 이해가 너무 부족합니다. "어떤 전문가들은 양말을 먹으면 뇌의 상태를 바꾸는 데 도움이 된다고 믿습니다. " .

이 뒤에 있는 문제는 인공 지능 분야의 최대 연구팀이 더 이상 학술 기관이 아니라 대규모 기술 기업이라는 것입니다. 대학과 달리 기업은 공정하게 경쟁할 유인이 없습니다. 이들의 새 논문은 학문적 검토 없이 언론을 통해 발표되어 언론에 보도되고 동료 검토를 회피하게 되었습니다. 우리가 얻는 정보는 회사 자체가 우리에게 알리고 싶어하는 정보일 뿐입니다.

소프트웨어 업계에서는 이러한 사업 전략을 나타내는 특별한 단어인 '데모웨어(demoware)'가 있는데, 이는 소프트웨어의 디자인이 디스플레이에는 적합하지만 반드시 현실 세계에는 적합하지 않다는 의미입니다.

그리고 이렇게 판매되는 AI 제품은 원활하게 출시되지 않거나 현실이 엉망이 됩니다.

딥 러닝은 데이터 패턴을 식별하는 기계의 능력을 향상시키지만 세 가지 주요 결함이 있습니다. 학습된 패턴은 개념적이지 않고 피상적이며 생성된 결과는 해석하기 어렵고 일반화하기 어렵습니다. 하버드 컴퓨터 과학자 Les Valiant가 지적했듯이 "미래의 핵심 과제는 AI 학습과 추론의 형태를 통합하는 것입니다."

현재 기업은 새로운 아이디어를 창출하기보다는 벤치마크 초과를 추구하고 있습니다. . 더 근본적인 문제에 대해 고민하기보다는 작은 개선을 해보세요.

화려한 제품 디스플레이를 추구하기보다 '학습과 추론을 동시에 할 수 있는 시스템을 구축하는 방법'과 같은 기본적인 질문을 하는 사람들이 더 많아야 합니다.

AGI에 관한 이 논쟁은 아직 끝나지 않았고, 다른 연구자들도 동참했습니다. 연구원 Scott Alexander는 자신의 블로그에서 Gary Marcus는 전설이며 그가 지난 몇 년 동안 쓴 내용은 어느 정도 완전히 정확하지만 여전히 가치가 있다고 지적했습니다.

예를 들어, Gary Marcus는 이전에 GPT-2의 몇 가지 문제를 비판한 적이 있었습니다. 8개월 후 GPT-3이 탄생했을 때 이러한 문제는 해결되었습니다. 그러나 Gary Marcus는 GPT-3에 자비를 베풀지 않았고 심지어 "OpenAI의 언어 생성기는 그것이 무엇을 말하는지 모릅니다."라는 기사를 썼습니다.

기본적으로 현재로서는 한 가지 관점이 정확합니다: "Gary Marcus는 큰 언어 모델을 비웃는 속임수이지만, 이러한 모델은 점점 더 좋아질 것이며, 이러한 추세가 계속된다면 곧 AGI가 구현될 것입니다."

위 내용은 Gary Marcus는 Hinton과 Musk에게 공개적으로 외쳤습니다. 딥 러닝이 벽에 부딪혔습니다. 10만 달러를 걸겠습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7486

7486

15

15

1377

1377

52

52

77

77

11

11

51

51

19

19

19

19

38

38

SQL에서 새 열을 추가하는 방법

Apr 09, 2025 pm 02:09 PM

SQL에서 새 열을 추가하는 방법

Apr 09, 2025 pm 02:09 PM

Alter Table 문을 사용하여 SQL의 기존 테이블에 새 열을 추가하십시오. 특정 단계에는 다음이 포함됩니다. 테이블 이름 및 열 정보 결정, Alter Table 문 작성 및 진술 실행. 예를 들어, 고객 테이블에 이메일 열을 추가하십시오 (Varchar (50)) : Alter Table 고객 이메일 추가 Varchar (50);

SQL에서 열을 추가하기위한 구문은 무엇입니까?

Apr 09, 2025 pm 02:51 PM

SQL에서 열을 추가하기위한 구문은 무엇입니까?

Apr 09, 2025 pm 02:51 PM

SQL에서 열을 추가하기위한 구문은 Alter Table_Name ADD CORMEN_NAME DATY_TYPE [NOT NULL] [DEFAULT DEFAULT_VALUE]; 여기서 table_name은 테이블 이름이고 column_name은 새 열 이름, data_type는 데이터 유형이며 NULL은 NULL 값이 허용되는지 여부를 지정하고 기본값 기본값을 지정합니다.

SQL 클리어 테이블 : 성능 최적화 팁

Apr 09, 2025 pm 02:54 PM

SQL 클리어 테이블 : 성능 최적화 팁

Apr 09, 2025 pm 02:54 PM

SQL 테이블 개선 성능을 개선하기위한 팁 : 삭제 대신 Truncate 테이블을 사용하고 공간을 확보하고 ID 열을 재설정하십시오. 계단식 삭제를 방지하기 위해 외국의 주요 제약 조건을 비활성화하십시오. 트랜잭션 캡슐화 작업을 사용하여 데이터 일관성을 보장합니다. 배치는 빅 데이터를 삭제하고 한계를 통해 행 수를 제한합니다. 쿼리 효율성을 향상시키기 위해 지우고 지수를 재구성하십시오.

SQL에서 열을 추가 할 때 기본값을 설정하는 방법

Apr 09, 2025 pm 02:45 PM

SQL에서 열을 추가 할 때 기본값을 설정하는 방법

Apr 09, 2025 pm 02:45 PM

새로 추가 된 열에 대한 기본값을 설정하고 Alter Table 문을 사용하십시오. 문 : 열 추가를 지정하고 기본값을 설정하십시오. Alter Table_Name Add Column_name Data_Type Default_value; 구속 조건 조항을 사용하여 기본값을 지정하십시오. ALTER TABLE TABLE_NAME CORMENT CORMEN_NAME DATA DATA DATA DATA DATA DATA DATA DATAY_TYPE 제한 DEFAULT_COSSTRANT DEFAULT DEFAULT_VALUE;

삭제 명령문을 사용하여 SQL 테이블을 지우십시오

Apr 09, 2025 pm 03:00 PM

삭제 명령문을 사용하여 SQL 테이블을 지우십시오

Apr 09, 2025 pm 03:00 PM

예, 삭제 명령문은 SQL 테이블을 지우는 데 사용될 수 있습니다. 단계는 다음과 같습니다. 삭제 명령문 사용 : table_name에서 삭제; TABLE_NAME을 제거 할 테이블 이름으로 바꾸십시오.

Redis 메모리 조각화를 처리하는 방법?

Apr 10, 2025 pm 02:24 PM

Redis 메모리 조각화를 처리하는 방법?

Apr 10, 2025 pm 02:24 PM

Redis 메모리 조각화는 할당 된 메모리에 재 할당 할 수없는 작은 자유 영역의 존재를 말합니다. 대처 전략에는 다음이 포함됩니다. REDIS를 다시 시작하십시오 : 메모리를 완전히 지우지 만 인터럽트 서비스. 데이터 구조 최적화 : Redis에 더 적합한 구조를 사용하여 메모리 할당 및 릴리스 수를 줄입니다. 구성 매개 변수 조정 : 정책을 사용하여 최근에 가장 적게 사용 된 키 값 쌍을 제거하십시오. 지속 메커니즘 사용 : 데이터를 정기적으로 백업하고 Redis를 다시 시작하여 조각을 정리하십시오. 메모리 사용 모니터링 : 적시에 문제를 발견하고 조치를 취하십시오.

phpmyadmin은 데이터 테이블을 만듭니다

Apr 10, 2025 pm 11:00 PM

phpmyadmin은 데이터 테이블을 만듭니다

Apr 10, 2025 pm 11:00 PM

phpmyadmin을 사용하여 데이터 테이블을 만들려면 다음 단계가 필수적입니다. 데이터베이스에 연결하고 새 탭을 클릭하십시오. 테이블의 이름을 지정하고 저장 엔진을 선택하십시오 (InnoDB 권장). 열 이름, 데이터 유형, NULL 값 허용 여부 및 기타 속성을 포함하여 열 추가 버튼을 클릭하여 열 디테일을 추가하십시오. 기본 키로 하나 이상의 열을 선택하십시오. 저장 버튼을 클릭하여 테이블과 열을 만듭니다.

Redis Exporter 서비스로 Redis 액 적을 모니터링하십시오

Apr 10, 2025 pm 01:36 PM

Redis Exporter 서비스로 Redis 액 적을 모니터링하십시오

Apr 10, 2025 pm 01:36 PM

Redis 데이터베이스의 효과적인 모니터링은 최적의 성능을 유지하고 잠재적 인 병목 현상을 식별하며 전반적인 시스템 신뢰성을 보장하는 데 중요합니다. Redis Exporter Service는 Prometheus를 사용하여 Redis 데이터베이스를 모니터링하도록 설계된 강력한 유틸리티입니다. 이 튜토리얼은 Redis Exporter Service의 전체 설정 및 구성을 안내하여 모니터링 솔루션을 원활하게 구축 할 수 있도록합니다. 이 자습서를 연구하면 완전히 작동하는 모니터링 설정을 달성 할 수 있습니다.