GPU는 ChatGPT 볼륨 모델을 실행하며 ControlNet은 AI 그리기를 위한 또 다른 아티팩트입니다.

카탈로그

TransFormer 모델: 소개 및 카탈로그

- 드리프트 인식 동적 신경망이 포함된 단일 GPUMPORAL DMAIN을 갖춘 대규모 언어 모델의 고도로 처리된 세대

- 대규모의 물리적으로 정확한 모델링 딥 러닝을 갖춘 실제 양성자 교환막 연료 전지

- 사전 훈련된 기초 모델에 대한 종합 조사: BERT에서 ChatGPT까지의 역사

- 텍스트-이미지 확산 모델에 조건부 제어 추가

- EVA3D: 구성 3D 2D 이미지 컬렉션의 Human Generation

- ArXiv Weekly Radiostation: NLP, CV, ML 더 많은 선택된 논문(오디오 포함)

- 문서 1: 트랜스포머 모델: 소개 및 카탈로그

저자: Xavier Amatriain

- 논문 주소: https://arxiv.org/pdf/2302.07730.pdf

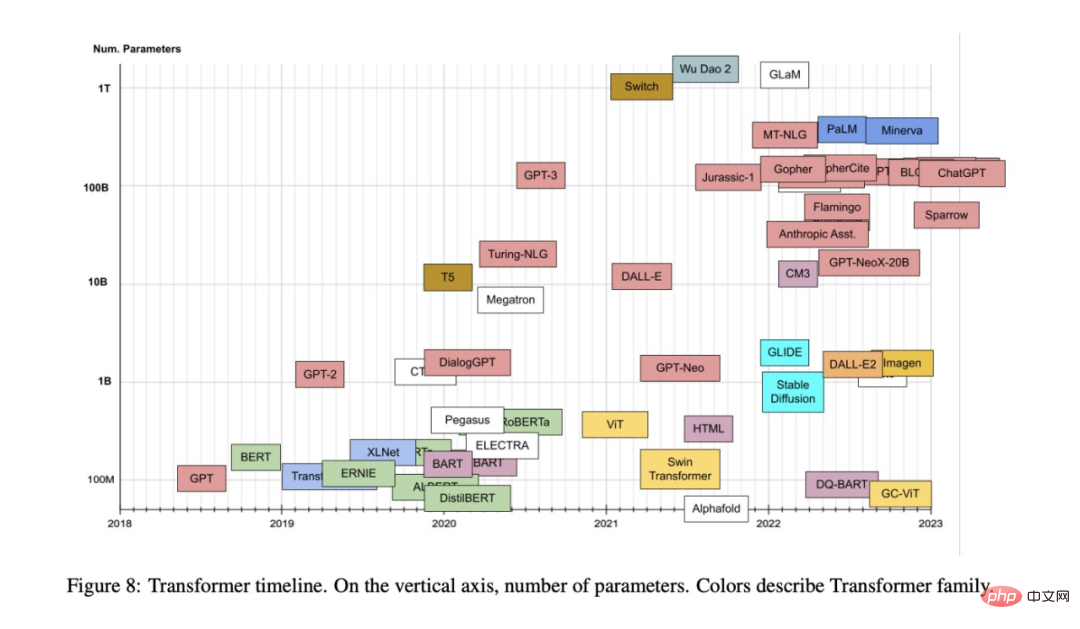

- Abstract: 2016년 출시 이후, Transformer 모델은 시연 자연어 처리, 컴퓨터 비전 등 다른 분야에서도 전례 없는 강점을 보이며 ChatGPT와 같은 기술적 혁신을 촉발한 사람들도 원본 모델을 기반으로 다양한 변형을 제안했습니다.

트랜스포머 어텐션 메커니즘을 기반으로 학계와 업계가 계속해서 새로운 모델을 제안함에 따라 이 방향을 요약하기 어려울 때가 있습니다. 최근 LinkedIn의 AI 제품 전략 책임자인 Xavier Amatriain의 포괄적인 기사가 이 문제를 해결하는 데 도움이 될 수 있습니다.

권장 사항:

이 기사의 목표는 가장 인기 있는 Transformer 모델의 비교적 포괄적이지만 간단한 카탈로그와 분류를 제공하는 것입니다. 또한 Transformer 모델의 가장 중요한 측면과 혁신을 소개합니다.

논문 2: 단일 GPU를 사용한 대규모 언어 모델의 전체적 생성 추론

저자: Ying Sheng 외

- 논문 주소: https://github.com / FMInference/FlexGen/blob/main/docs/paper.pdf

- 요약: 전통적으로 LLM(대형 언어 모델) 추론의 높은 계산 및 메모리 요구 사항으로 인해 여러 고급 AI를 사용해야 했습니다. 훈련용 가속기. 이 연구에서는 LLM 추론 요구 사항을 소비자 등급 GPU로 줄이고 실용적인 성능을 달성하는 방법을 탐구합니다. ,

최근 Stanford University, UC Berkeley, ETH Zurich, Yandex, Moscow State Higher School of Economics, Meta, Carnegie Mellon University 및 기타 기관의 새로운 연구에서는 제한된 A 처리량 세대를 실행하는 방법인 FlexGen을 제안했습니다. GPU 메모리의 LLM용 엔진. 아래 그림은 아래 그림 (b)와 같이 블록 스케줄링을 사용하여 가중치를 재사용하고 I/O를 계산과 겹치는 FlexGen의 설계 아이디어를 보여 주는 반면, 다른 기본 시스템은 다음과 같이 비효율적인 행별 스케줄링을 사용합니다. 아래 그림 (a)에 나와 있습니다.

권장 사항:ChatGPT 볼륨 모델을 실행하고 지금부터는 GPU 하나만 필요합니다. 여기에 이를 100배 가속하는 방법이 있습니다.

문서 3: 드리프트 인식 동적 신경망을 사용한 임시 도메인 일반화

저자: Guangji Bai 외

- 논문 주소: https://arxiv.org/pdf/ 2205.106 64 .pdf

- 요약: 도메인 일반화(DG) 작업에서 도메인 분포가 환경에 따라 지속적으로 변경되는 경우 변경 사항과 모델에 미치는 영향을 정확하게 포착하는 것이 매우 중요합니다. 하지만 이는 매우 어려운 문제이기도 합니다.

- 저자: Ying Da Wang 외

- 논문 주소: https:/ / www.nature.com/articles/s41467-023-35973-8

- 저자: Ce Zhou et al

- 문서 주소: https://arxiv. org /pdf/2302.09419.pdf

- 저자: Lvmin Zhang 외

- 논문 주소: https://arxiv.org/pdf / 2302.05543.pdf

- 저자: Fangzhou Hong 외

- 논문 주소: https://arxiv.org/abs/ 2210.0 4888

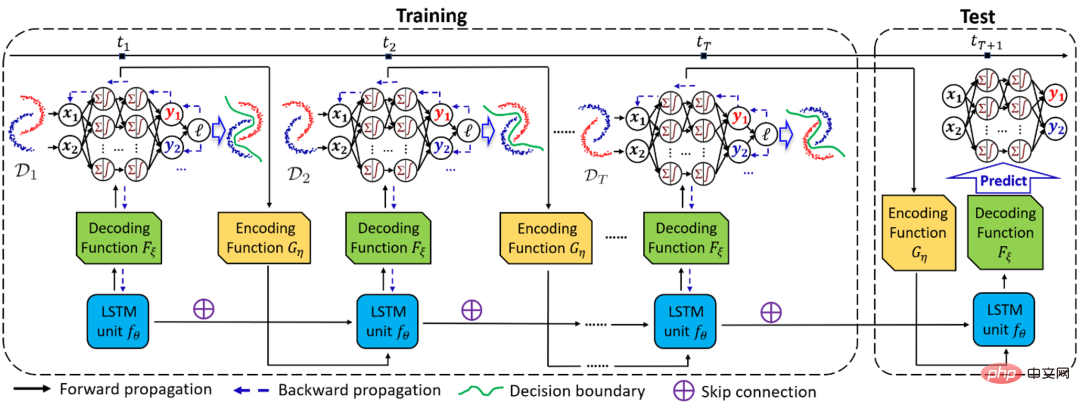

이를 위해 에모리 대학교 Zhao Liang 교수팀은 베이지안 이론을 기반으로 하는 시간 영역 일반화 프레임워크 DRAIN을 제안했으며, 재귀 네트워크를 사용하여 시간 차원 영역 분포의 드리프트를 학습하는 동시에 동적 신경망과 그래프 생성을 사용했습니다. 기술의 결합으로 모델의 표현력을 극대화하고, 향후 미지의 분야에 대한 모델 일반화 및 예측을 실현합니다.

이 작품은 ICLR 2023 Oral(게재 논문 중 상위 5%)에 선정되었습니다. 다음은 DRAIN의 전체 프레임워크에 대한 개략도입니다.

권장: 드리프트 인식 동적 신경망 축복인 새로운 시간 도메인 일반화 프레임워크는 도메인 일반화 및 적응 방법을 훨씬 능가합니다.

논문 4: 딥 러닝을 이용한 실제 양성자 교환막 연료전지의 물리적으로 정확한 대규모 모델링

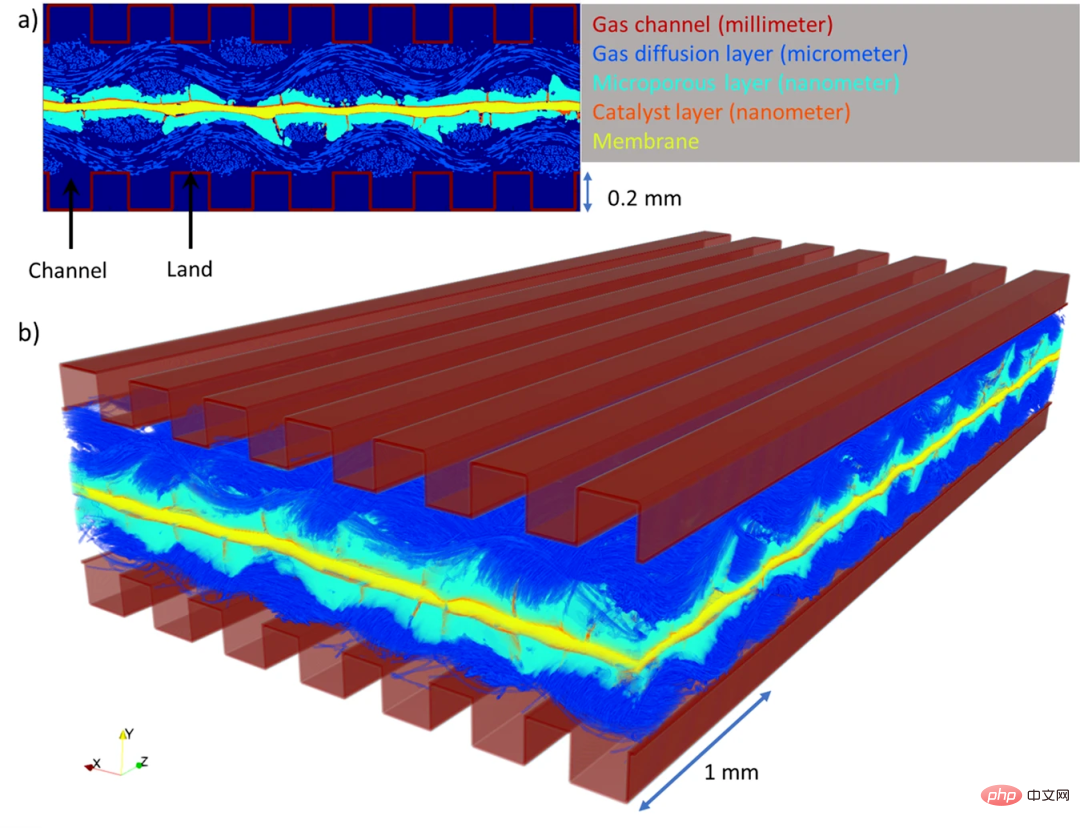

요약: 에너지 공급을 확보하고 기후 변화에 대처하기 위해 사람들의 관심은 화석 연료에서 깨끗하고 재생 가능한 에너지로 옮겨졌습니다. 수소는 높은 에너지 밀도와 청정, 저탄소 에너지 특성을 갖고 있어 에너지 전환에서 중요한 역할을 할 수 있습니다. 수소 연료 전지, 특히 양성자 교환막 연료 전지(PEMFC)는 높은 에너지 변환 효율과 배출 제로 작동으로 인해 이러한 녹색 혁명의 핵심입니다.

PEMFC는 전기화학 공정을 통해 수소를 전기로 변환하며, 반응의 유일한 부산물은 순수한 물입니다. 그러나 물이 셀 밖으로 제대로 흘러나오지 못하고 결과적으로 시스템이 "넘치는" 경우 PEMFC는 비효율적이 될 수 있습니다. 지금까지 연료전지는 너무 작고 복잡하기 때문에 엔지니어들이 연료전지 내부에 물이 배수되거나 축적되는 정확한 방식을 이해하는 것이 어려웠습니다.

최근 시드니 뉴사우스웨일스대학교 연구팀은 PEMFC의 내부 상태에 대한 이해를 높이고 저해상도 X선에서 고해상도 이미지를 생성할 수 있는 딥러닝 알고리즘(DualEDSR)을 개발했습니다. 마이크로컴퓨터 단층촬영 스캔. 해상도 모델링 이미지. 이 프로세스는 단일 수소 연료 전지에서 테스트되었으며 내부를 정확하게 모델링하고 잠재적으로 효율성을 향상시킬 수 있습니다. 아래 그림은 본 연구에서 생성된 PEMFC 도메인을 보여줍니다.

추천: 딥 러닝은 연료 전지 내부의 대규모 물리적이고 정확한 모델링을 수행하여 배터리 성능을 향상시키는 데 도움을 줍니다.

문서 5: 사전 훈련된 기초 모델에 대한 종합 설문조사: BERT에서 ChatGPT까지의 역사

요약: 약 100페이지에 달하는 이 리뷰는 사전 훈련된 기본 모델의 진화 역사를 샅샅이 뒤져 ChatGPT가 어떻게 단계별로 성공했는지 확인할 수 있습니다.

추천: BERT부터 ChatGPT까지, 사전 훈련된 대형 모델의 진화 역사를 엮은 100페이지 분량의 리뷰입니다.

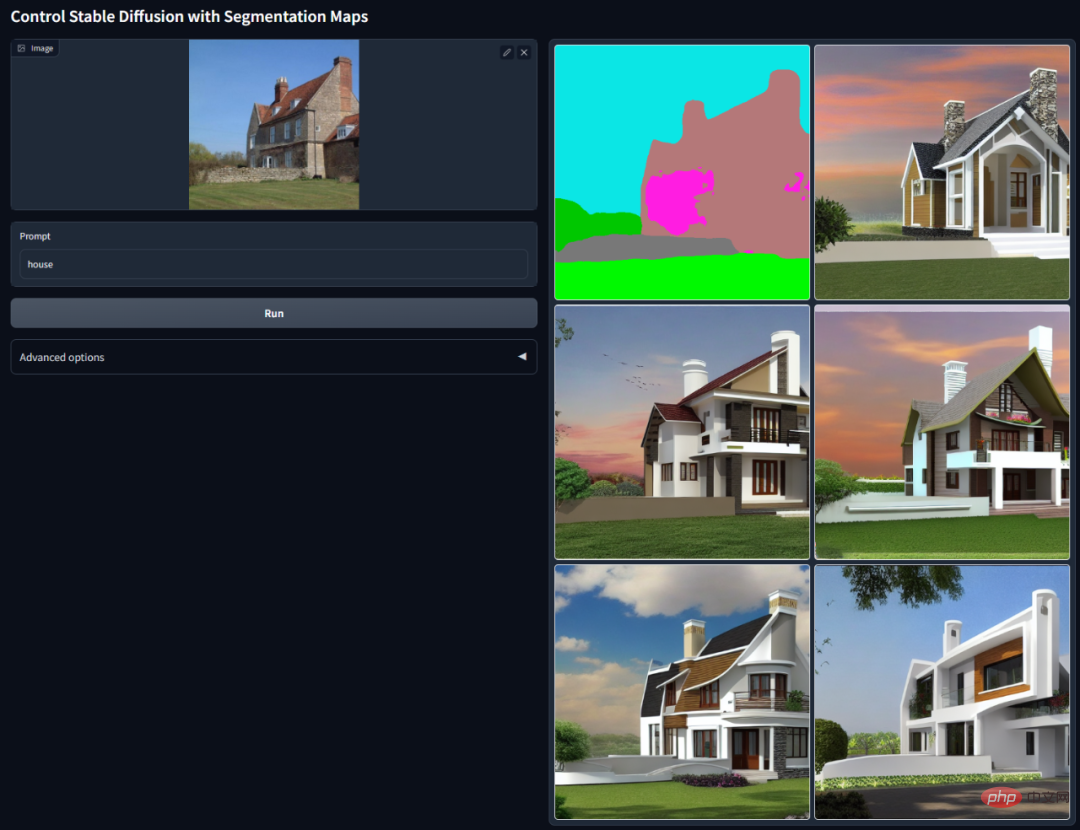

문서 6: 텍스트-이미지 확산 모델에 조건부 제어 추가

요약: 본 논문에서는 그래프 생성 성능을 향상시키기 위해 추가 조건을 추가하여 확산 모델(예: Stable Diffusion)을 제어할 수 있는 엔드 투 엔드 신경망 아키텍처 ControlNet을 제안합니다. 효과는 선화에서 풀 컬러 이미지를 생성하고 동일한 깊이 구조의 이미지를 생성하며 손 키 포인트를 통해 손 생성을 최적화할 수 있습니다.

추천: AI는 인간 화가를 물리칠 수 있도록 차원을 줄이고 Vincentian 그래프에 ControlNet을 도입하며 깊이와 가장자리 정보를 완전히 재사용합니다.

문서 7: EVA3D: 2D 이미지 컬렉션의 구성적 3D 인간 생성

요약: ICLR 2023에서 난양기술대학교-SenseTime 공동연구센터 S-Lab 팀은 다양한 자료 모음에서 고해상도 3차원 인체 생성을 학습하는 최초의 방법인 EVA3D를 제안했습니다. 2차원 이미지. NeRF가 제공하는 미분 가능 렌더링 덕분에 최근 3D 생성 모델은 정지된 물체에 대해 놀라운 결과를 얻었습니다. 그러나 인체와 같이 더 복잡하고 변형 가능한 범주에서 3D 생성은 여전히 큰 과제를 안고 있습니다.

이 논문은 초해상도 모델을 사용하지 않고도 고해상도(512x256) 3D 인체 생성을 달성하는 인체의 효율적인 결합 NeRF 표현을 제안합니다. EVA3D는 4개의 대규모 인체 데이터 세트에서 기존 솔루션을 크게 능가했으며 코드는 오픈 소스였습니다.

추천: ICLR 2023 스포트라이트 | 2D 이미지 브레인스토밍 3D 인체, 어떤 옷을 입어도 움직임을 바꿀 수 있습니다.

ArXiv Weekly Radiostation

Heart of Machine은 Chu Hang, Luo Ruotian, Mei Hongyuan이 시작한 ArXiv Weekly Radiostation과 협력하여 NLP, CV, ML 등 7개 논문을 바탕으로 이번 주에 더 중요한 논문을 선정합니다. 선정된 논문 10개 각 분야별로 논문 요약 소개를 오디오 형식으로 제공합니다.

7 NLP Papers

이번 주 NLP 선정 논문 10편은

1. 대규모 언어 모델을 위한 사고 사슬을 통한 능동적 프롬프트(Tong Zhang 제공)

2. 운율 기능은 문장 분할 및 구문 분석을 향상시킵니다(Emmanuel Dupoux 제공). . 코로나19 환자의 우울증 조기 발견을 위한 소셜 미디어 탐색(Jie Yang 제공)

5. 연합 인접 이웃 기계 번역(Enhong Chen 제공)

6. 그래프주의 용어 (Michael Moortgat)

7. 10개의 CV 선정 논문은 다음과 같습니다.

1. MERF: 무한 장면의 실시간 보기 합성을 위한 메모리 효율적인 방사 필드(Richard Szeliski, Andreas Geiger 작성)

2. 텍스트-이미지 모델(Daniel Cohen-Or)

3. 10까지 세기 CLIP 교육(Michal Irani) 4. 현실적인 단기 (Wesi Lin에서)

5. 컨볼루션 신경망을 사용한 섬유 리프팅 로프의 실시간 손상 감지(Moncef Gabbouj에서)

6. 가벼운 이미지 향상(Chen Change Loy에서)

7. 제로샷 텍스트 기반 이미지 편집을 위한 지역 인식 확산. (Xu Changsheng에서)

8. 개방형 어휘 의미론적 분할을 위한 측면 어댑터 네트워크. (샹바이에서)

9. VoxFormer: 카메라 기반 3D 시맨틱 장면 완성을 위한 희소 복셀 변환기. (Sanja Fidler에서)

10. 객체 역학 및 상호 작용의 분리를 통한 객체 중심 비디오 예측. (Sven Behnke에서)

10 ML Papers

本周 10 篇 ML 精选论文是:

1. norflows: 흐름 정규화를 위한 PyTorch 패키지입니다. (Bernhard Schölkopf에서)

2. 해석 가능한 다중 에이전트 강화 학습을 위한 개념 학습. (카티아 시카라에서)

3. 무작위 교사는 좋은 교사입니다. (토마스 호프만에서)

4. 인간의 피드백을 사용하여 텍스트-이미지 모델 정렬. (Craig Boutilier, Pieter Abbeel 중에서)

5. 변화는 어렵다: 하위 모집단 변화에 대한 면밀한 조사. (디나 카타비 중에서)

6. AlpaServe: 딥 러닝 제공을 위한 모델 병렬성을 사용한 통계적 다중화. (Zhifeng Chen에서)

7. 구조화된 행동 공간을 위한 다양한 정책 최적화. (자홍원에서)

8. 혼합성의 기하학. (로버트 C. 윌리엄슨에서)

9. 딥러닝은 추상화를 배우나요? 체계적인 조사 프레임워크. (정 난닝에서)

10. 순차적인 반사실적 위험 최소화. (Julien Mairal에서)

위 내용은 GPU는 ChatGPT 볼륨 모델을 실행하며 ControlNet은 AI 그리기를 위한 또 다른 아티팩트입니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7466

7466

15

15

1376

1376

52

52

77

77

11

11

45

45

19

19

18

18

19

19

Laravel 's geospatial : 대화식지도의 최적화 및 많은 양의 데이터

Apr 08, 2025 pm 12:24 PM

Laravel 's geospatial : 대화식지도의 최적화 및 많은 양의 데이터

Apr 08, 2025 pm 12:24 PM

7 백만 레코드를 효율적으로 처리하고 지리 공간 기술로 대화식지도를 만듭니다. 이 기사는 Laravel과 MySQL을 사용하여 7 백만 개 이상의 레코드를 효율적으로 처리하고 대화식지도 시각화로 변환하는 방법을 살펴 봅니다. 초기 챌린지 프로젝트 요구 사항 : MySQL 데이터베이스에서 7 백만 레코드를 사용하여 귀중한 통찰력을 추출합니다. 많은 사람들이 먼저 프로그래밍 언어를 고려하지만 데이터베이스 자체를 무시합니다. 요구 사항을 충족시킬 수 있습니까? 데이터 마이그레이션 또는 구조 조정이 필요합니까? MySQL이 큰 데이터로드를 견딜 수 있습니까? 예비 분석 : 주요 필터 및 속성을 식별해야합니다. 분석 후, 몇 가지 속성만이 솔루션과 관련이 있음이 밝혀졌습니다. 필터의 타당성을 확인하고 검색을 최적화하기위한 제한 사항을 설정했습니다. 도시를 기반으로 한지도 검색

Vue Axios의 시간 초과를 설정하는 방법

Apr 07, 2025 pm 10:03 PM

Vue Axios의 시간 초과를 설정하는 방법

Apr 07, 2025 pm 10:03 PM

vue axios의 타임 아웃을 설정하려면 axios 인스턴스를 생성하고 시간 초과 옵션을 지정할 수 있습니다. 글로벌 설정에서 : vue.prototype. $ axios = axios.create ({timeout : 5000}); 단일 요청 : this. $ axios.get ( '/api/user', {timeout : 100000}).

설치 후 MySQL을 사용하는 방법

Apr 08, 2025 am 11:48 AM

설치 후 MySQL을 사용하는 방법

Apr 08, 2025 am 11:48 AM

이 기사는 MySQL 데이터베이스의 작동을 소개합니다. 먼저 MySQLworkBench 또는 명령 줄 클라이언트와 같은 MySQL 클라이언트를 설치해야합니다. 1. MySQL-Uroot-P 명령을 사용하여 서버에 연결하고 루트 계정 암호로 로그인하십시오. 2. CreateABase를 사용하여 데이터베이스를 작성하고 데이터베이스를 선택하십시오. 3. CreateTable을 사용하여 테이블을 만들고 필드 및 데이터 유형을 정의하십시오. 4. InsertInto를 사용하여 데이터를 삽입하고 데이터를 쿼리하고 업데이트를 통해 데이터를 업데이트하고 DELETE를 통해 데이터를 삭제하십시오. 이러한 단계를 마스터하고 일반적인 문제를 처리하는 법을 배우고 데이터베이스 성능을 최적화하면 MySQL을 효율적으로 사용할 수 있습니다.

MySQL을 해결하는 방법을 시작할 수 없습니다

Apr 08, 2025 pm 02:21 PM

MySQL을 해결하는 방법을 시작할 수 없습니다

Apr 08, 2025 pm 02:21 PM

MySQL 시작이 실패하는 데는 여러 가지 이유가 있으며 오류 로그를 확인하여 진단 할 수 있습니다. 일반적인 원인에는 포트 충돌 (포트 점유 체크 및 구성 수정), 권한 문제 (서비스 실행 사용자 권한 실행), 구성 파일 오류 (파라미터 설정 확인), 데이터 디렉토리 손상 (데이터 복원 또는 테이블 공간 재건), IBDATA 테이블 공간 문제 (IBDATA1 파일 확인), 플러그로드 (확인 오류 로그)가 포함됩니다. 문제를 해결할 때 오류 로그를 기반으로 문제를 분석하고 문제의 근본 원인을 찾고 문제를 방지하고 해결하기 위해 정기적으로 데이터를 백업하는 습관을 개발해야합니다.

원격 선임 백엔드 엔지니어 (플랫폼)에는 원이 필요합니다

Apr 08, 2025 pm 12:27 PM

원격 선임 백엔드 엔지니어 (플랫폼)에는 원이 필요합니다

Apr 08, 2025 pm 12:27 PM

원격 선임 백엔드 엔지니어 구직 회사 : 원 위치 : 원격 사무실 직무 유형 : 전임 급여 : $ 130,000- $ 140,000 직무 설명 전체 소프트웨어 개발 라이프 사이클을 다루는 Circle Mobile 애플리케이션 및 공개 API 관련 기능의 연구 및 개발에 참여합니다. 주요 책임은 독립적으로 Rubyonrails를 기반으로 개발 작업을 완료하고 React/Redux/Relay 프론트 엔드 팀과 협력합니다. 웹 애플리케이션의 핵심 기능 및 개선을 구축하고 기능 설계 프로세스 전반에 걸쳐 설계자 및 리더십과 긴밀히 협력하십시오. 긍정적 인 개발 프로세스를 촉진하고 반복 속도를 우선시하십시오. 6 년 이상의 복잡한 웹 애플리케이션 백엔드가 필요합니다.

MySQL이 JSON을 반환 할 수 있습니다

Apr 08, 2025 pm 03:09 PM

MySQL이 JSON을 반환 할 수 있습니다

Apr 08, 2025 pm 03:09 PM

MySQL은 JSON 데이터를 반환 할 수 있습니다. json_extract 함수는 필드 값을 추출합니다. 복잡한 쿼리의 경우 where 절을 사용하여 JSON 데이터를 필터링하지만 성능 영향에주의하십시오. JSON에 대한 MySQL의 지원은 지속적으로 증가하고 있으며 최신 버전 및 기능에주의를 기울이는 것이 좋습니다.

MySQL 설치 후 데이터베이스 성능을 최적화하는 방법

Apr 08, 2025 am 11:36 AM

MySQL 설치 후 데이터베이스 성능을 최적화하는 방법

Apr 08, 2025 am 11:36 AM

MySQL 성능 최적화는 설치 구성, 인덱싱 및 쿼리 최적화, 모니터링 및 튜닝의 세 가지 측면에서 시작해야합니다. 1. 설치 후 innodb_buffer_pool_size 매개 변수와 같은 서버 구성에 따라 my.cnf 파일을 조정해야합니다. 2. 과도한 인덱스를 피하기 위해 적절한 색인을 작성하고 Execution 명령을 사용하여 실행 계획을 분석하는 것과 같은 쿼리 문을 최적화합니다. 3. MySQL의 자체 모니터링 도구 (showprocesslist, showstatus)를 사용하여 데이터베이스 건강을 모니터링하고 정기적으로 백업 및 데이터베이스를 구성하십시오. 이러한 단계를 지속적으로 최적화함으로써 MySQL 데이터베이스의 성능을 향상시킬 수 있습니다.

MySQL의 주요 키는 Null 일 수 있습니다

Apr 08, 2025 pm 03:03 PM

MySQL의 주요 키는 Null 일 수 있습니다

Apr 08, 2025 pm 03:03 PM

기본 키는 데이터베이스의 각 행을 고유하게 식별하는 키 속성이기 때문에 MySQL 기본 키는 비어있을 수 없습니다. 기본 키가 비어 있으면 레코드를 고유하게 식별 할 수 없으므로 데이터 혼동으로 이어질 수 있습니다. 자체 점수 정수 열 또는 UUID를 기본 키로 사용하는 경우 효율성 및 우주 점유와 같은 요소를 고려하고 적절한 솔루션을 선택해야합니다.