100년 된 밈도 분명해요! Microsoft의 다중 모드 'Universe'는 단 16억 개의 매개변수만으로 IQ 테스트를 처리합니다.

대형 모델의 볼륨, 잠을 자지 않고도 진행을 따라갈 수가 없어요...

아니요, 마이크로소프트 아시아 연구소에서 방금 멀티모달 대형 언어 모델(MLLM)을 출시했습니다 - KOSMOS -1.

논문 주소: https://arxiv.org/pdf/2302.14045.pdf

논문 제목 Language Is Not All You Need는 유명한 속담에서 따왔습니다.

기사에 "나의 언어의 한계는 나의 세계의 한계이다. - 오스트리아 철학자 루드비히 비트겐슈타인"이라는 문장이 있습니다.

그러면 질문이 옵니다.. . ...

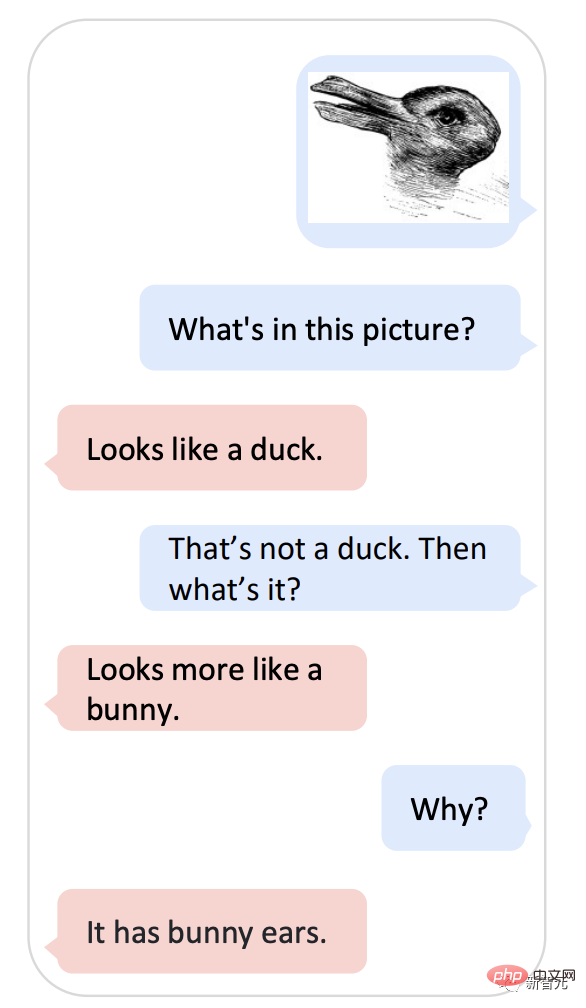

사진을 찍고 KOSMOS-1에게 "오리인지 토끼인지 알아낼 수 있나요?"라고 물어보세요. 100년이 넘는 역사를 가진 이 밈으로는 Google AI를 고칠 수 없습니다.

1899년 미국 심리학자 Joseph Jastrow는 처음으로 "오리와 토끼 다이어그램"을 사용하여 인식이 사람들이 보는 것뿐만 아니라 정신 활동이기도 함을 보여주었습니다.

이제 KOSMOS-1은 이러한 인식 모델과 언어 모델을 결합할 수 있습니다.

-사진에는 무엇이 있나요?

-오리같아.

- 오리가 아니면 뭐죠?

-토끼에 더 가깝네요.

-왜요?

-토끼 귀가 있어요.

KOSMOS-1은 실제로 Microsoft의 ChatGPT 버전과 약간 비슷합니다.

Kosmos-1은 그뿐만 아니라 이미지, 텍스트, 텍스트가 포함된 이미지, OCR, 이미지 캡션, 시각적 QA도 이해할 수 있습니다.

IQ 테스트도 문제가 되지 않습니다.

"우주"는 전능하다

코스모스는 "우주"를 의미하는 그리스어 코스모스에서 유래되었습니다.

논문에 따르면 최신 Kosmos-1 모델은 다중 모드 대규모 언어 모델입니다.

백본은 Transformer를 기반으로 한 인과 언어 모델로, 텍스트 외에도 비전, 오디오 등의 다른 양식을 모델에 내장할 수 있습니다.

Transformer 디코더는 다중 모드 입력을 위한 범용 인터페이스 역할을 하므로 일반 모드를 인식하고 상황 학습을 수행하며 지침을 따를 수 있습니다.

Kosmos-1은 텍스트 지침이 포함된 이미지 인식, 시각적 질문 응답, 다중 모드 대화를 포함하여 미세 조정 없이 언어 및 다중 모드 작업에서 인상적인 성능을 달성합니다.

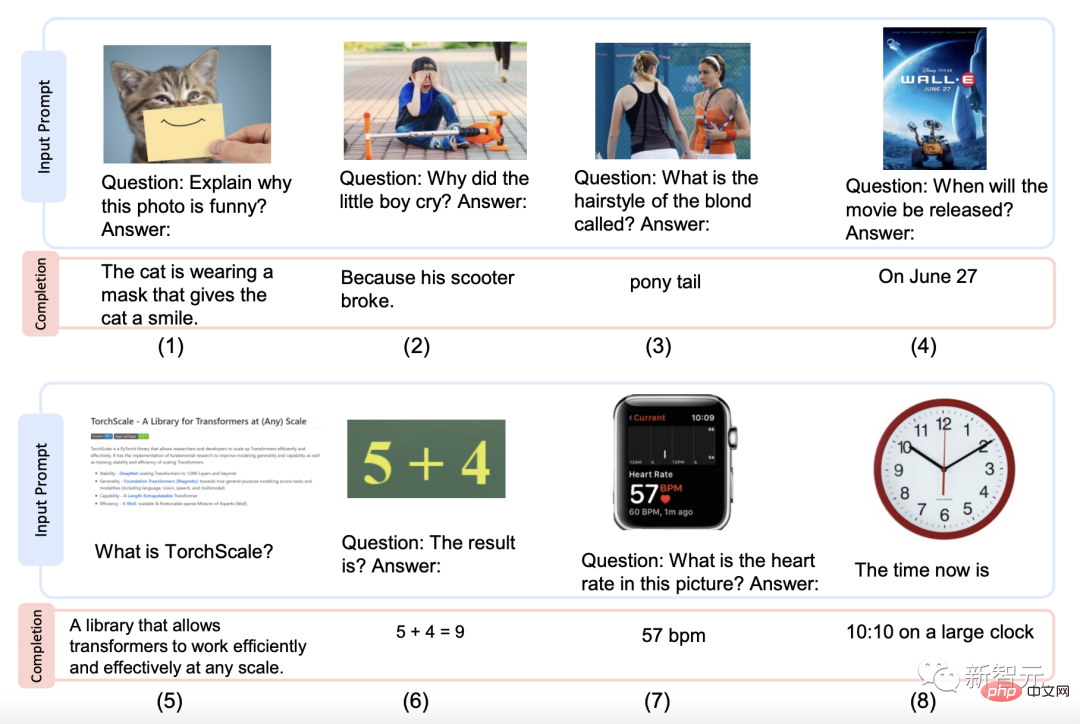

다음은 Kosmos-1에서 생성된 스타일의 예입니다.

그림 해석, 그림 Q&A, 웹 페이지 질문 답변, 간단한 숫자 공식, 숫자 인식.

그렇다면 Kosmos-1은 어떤 데이터 세트에 사전 훈련되어 있나요?

텍스트 말뭉치, 이미지-자막 쌍, 이미지 및 텍스트 교차 데이터 세트를 포함하여 교육에 사용되는 데이터베이스입니다.

텍스트 자료는 The Pile and Common Crawl(CC)에서 가져왔습니다.

이미지 캡션 쌍의 소스는 영어 LAION-2B, LAION-400M, COYO-700M 및 개념 캡션입니다. ;

텍스트 교차 데이터세트의 소스는 Common Crawl 스냅샷입니다.

이제 데이터베이스를 사용할 수 있으므로 다음 단계는 모델을 사전 훈련하는 것입니다.

MLLM 구성 요소에는 24개의 레이어, 2,048개의 숨겨진 차원, 8,192개의 FFN 및 32개의 주의 헤드가 있어 약 13억 개의 매개 변수가 생성됩니다.

최적화의 안정성을 보장하기 위해 더 빠른 수렴을 위해 Magneto 초기화가 사용되며, 이미지 표현은 1024개 기능 차원을 갖춘 사전 훈련된 CLIP ViT-L/14 모델에서 얻습니다. 훈련 과정에서 이미지는 224×224 해상도로 전처리되며, CLIP 모델의 매개변수는 마지막 레이어를 제외하고 고정됩니다.

KOSMOS-1의 전체 매개변수 수는 약 16억 개입니다.

KOSMOS-1이 명령어와 더 잘 일치하도록 하기 위해 언어 전용 명령어 조정[LHV+23, HSLS22]이 이루어졌습니다. 즉, 명령어 데이터를 사용하여 모델을 계속 학습합니다. 그리고 명령 데이터는 일부 언어 데이터가 훈련 코퍼스와 혼합되어 있습니다.

언어 모델링 방법에 따라 튜닝 과정이 진행되며, 선택된 명령어 데이터 세트는 Unnatural Instructions [HSLS22] 및 FLANv2 [LHV+23]입니다.

결과는 명령 추종 능력의 향상이 모드 간에도 전달될 수 있음을 보여줍니다.

간단히 말하면, MLLM은 지식을 언어에서 다중 양식으로 또는 그 반대로 전환하여 이익을 얻을 수 있습니다.

5개의 주요 범주와 10개의 작업을 모두 마스터했습니다.

모델인지 여부 잘 작동하는지 아닌지는 꺼내서 가지고 다니면서 판단할 수 있습니다.

연구팀은 KOSMOS-1의 성능을 평가하기 위해 5개 카테고리 10개 과제를 포함해 다각도에서 실험을 진행했다.

1 언어 과제(언어 이해, 언어 생성, OCR 없는 텍스트 분류) )

2 다중 모드 전달(상식 추론)

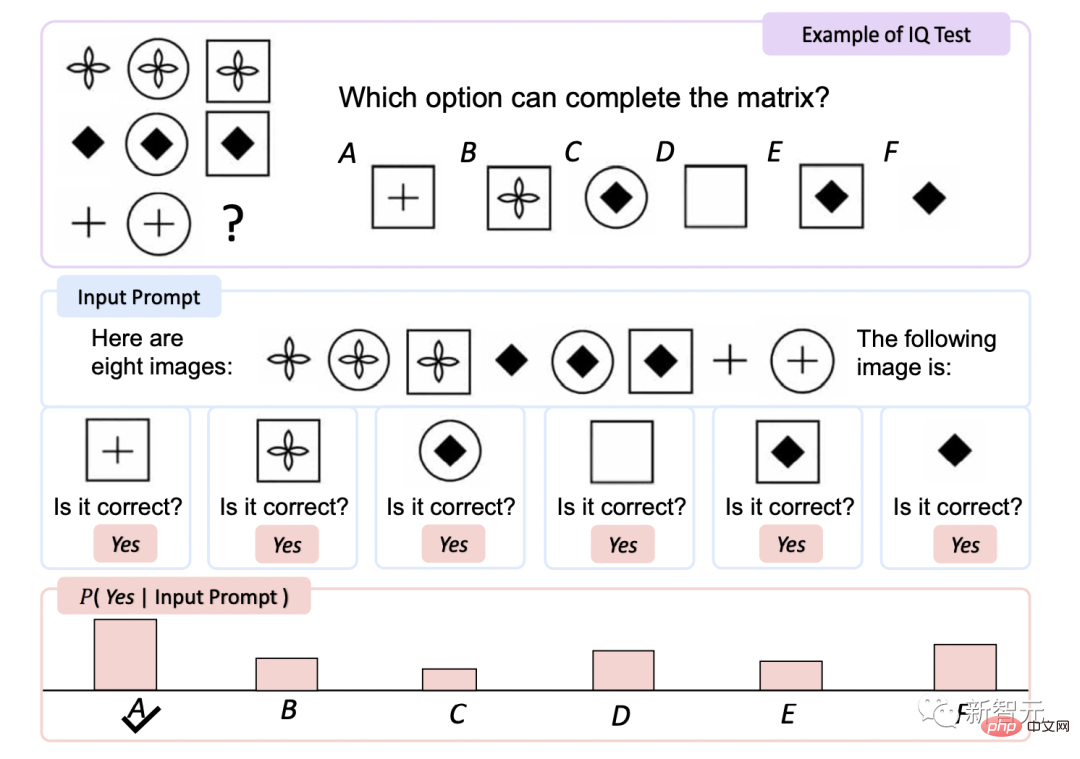

3 비언어적 추론(IQ 테스트)

4 지각-언어적 작업(이미지 설명, 시각적 질문 및 답변, 웹페이지 질문과 답변) )

5가지 비전 작업(제로샷 이미지 분류, 설명 포함 제로샷 이미지 분류)

OCR 없는 텍스트 분류

광학 문자에 의존하지 않는 방법입니다. 인식(OCR)은 텍스트 및 이미지 이해 작업에 중점을 둡니다.

HatefulMemes 및 Rendered SST-2 테스트 세트에서 KOSMOS-1의 정확도는 다른 모델보다 높습니다.

Flamingo는 명시적으로 OCR 텍스트를 프롬프트에 제공하지만 KOSMOS-1은 외부 도구나 리소스에 액세스할 수 없습니다. 이는 렌더링된 이미지의 텍스트를 읽고 이해하는 KOSMOS-1의 고유한 능력을 보여줍니다.

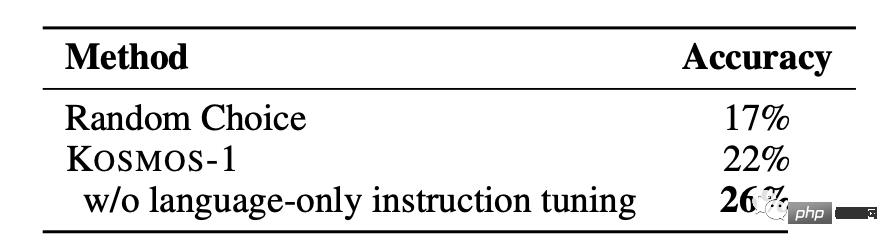

IQ 테스트

Raven 지능 테스트는 비언어적 평가에 가장 일반적으로 사용되는 테스트 중 하나입니다.

KOSMOS-1은 미세 조정을 하지 않은 무작위 선택에 비해 정확도가 5.3%, 미세 조정 후에는 9.3% 향상되어 비언어적 언어에서도 추상적 개념 패턴을 인식하는 능력이 있음을 나타냅니다. 환경.

모델이 제로샷 Raven 테스트를 완료할 수 있었던 것은 이번이 처음이며, 인식 모델과 언어 모델을 결합하여 제로샷 비언어적 추론을 위한 MLLM의 잠재력을 입증했습니다.

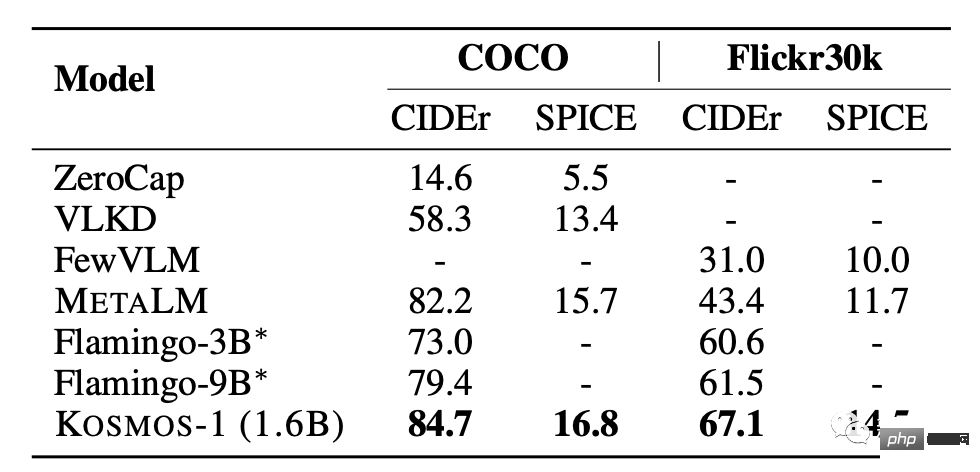

이미지 설명

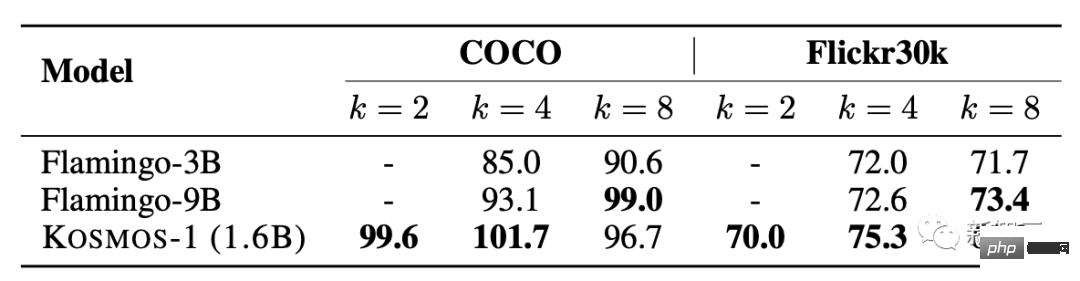

KOSMOS-1은 COCO 및 Flickr30k 테스트 모두에서 우수한 제로 샘플 성능을 보이지만 매개 변수 수를 사용합니다. 더 작습니다.

소표본 성능 테스트에서는 k 값이 증가할수록 점수가 증가합니다.

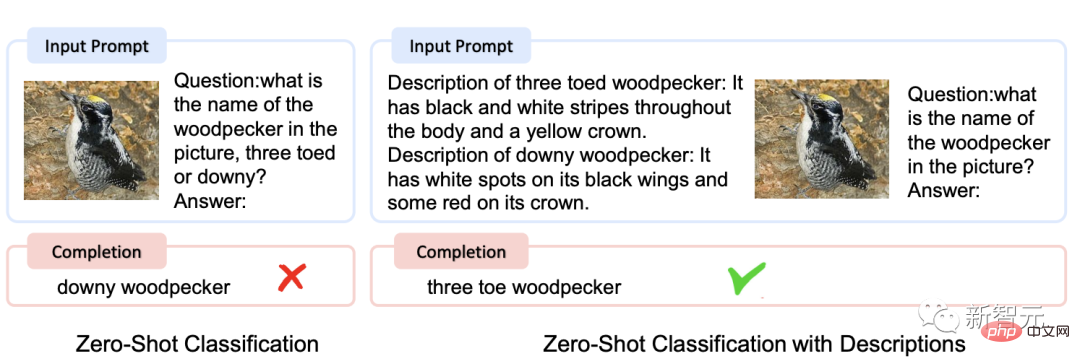

제로샷 이미지 분류

입력 이미지가 주어지면 "The photo of the"라는 메시지와 함께 이미지를 연결합니다. 그런 다음 모델에 피드를 제공하여 이미지의 클래스 이름을 가져옵니다.

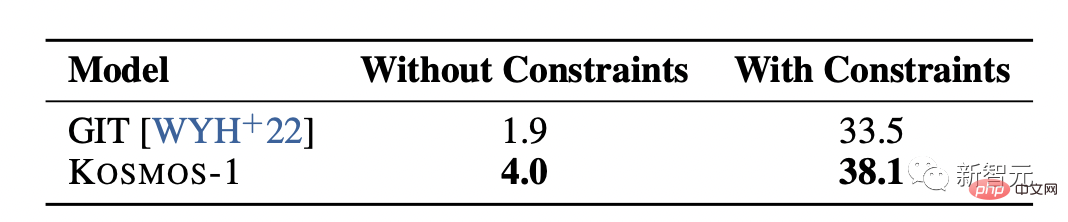

ImageNet [DDS+09]에서 모델을 평가한 결과, 제약 조건과 비제약 조건에서 KOSMOS-1의 이미지 분류 효과가 GIT [WYH+ 22]보다 훨씬 우수하여 강력한 성능을 보여줍니다. 시각적 작업을 완료하는 능력.

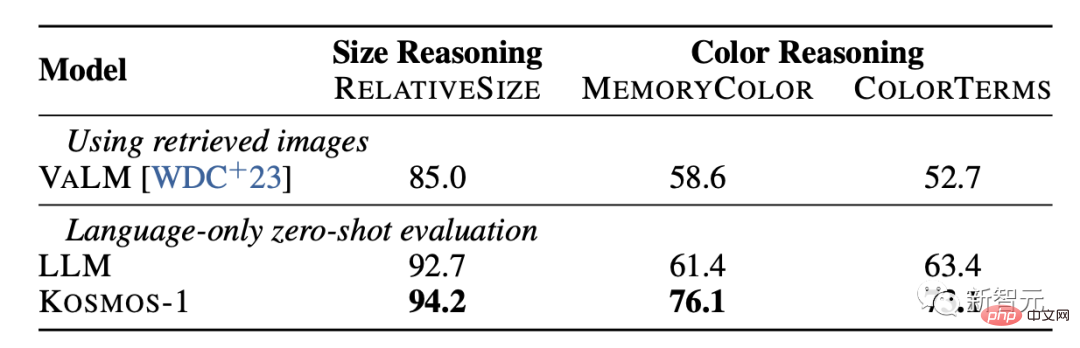

상식추론

시각적 상식 추론 작업에서는 모델이 실제 세계에 있는 일상적인 개체의 속성(예: 색상, 크기, 모양)을 이해해야 합니다. 이러한 작업에는 텍스트보다 개체 속성에 대한 더 많은 정보가 필요할 수 있기 때문에 어렵습니다.

결과에 따르면 KOSMOS-1의 추론 능력은 크기와 색상 모두에서 LLM 모델보다 훨씬 우수합니다. 이는 주로 KOSMOS-1이 LLM과 같은 추론을 위해 텍스트 지식과 단서에 의존하지 않고도 시각적 지식을 언어 작업에 적용할 수 있는 다중 모드 전송 기능을 갖추고 있기 때문입니다.

네티즌들은 앞으로 5년 안에 인터넷을 검색하고 시각적 수단을 통해서만 인간의 텍스트 입력을 기반으로 작업하는 고급 로봇을 볼 수 있다고 칭찬했습니다. 정말 흥미로운 시간이었습니다.

위 내용은 100년 된 밈도 분명해요! Microsoft의 다중 모드 'Universe'는 단 16억 개의 매개변수만으로 IQ 테스트를 처리합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7563

7563

15

15

1385

1385

52

52

84

84

11

11

61

61

19

19

28

28

99

99

세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. 중국의 기능은 GPT-4와 비슷하며 가격은 GPT-4-Turbo의 거의 1%에 불과합니다.

May 07, 2024 pm 04:13 PM

세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. 중국의 기능은 GPT-4와 비슷하며 가격은 GPT-4-Turbo의 거의 1%에 불과합니다.

May 07, 2024 pm 04:13 PM

기존 컴퓨팅을 능가할 뿐만 아니라 더 낮은 비용으로 더 효율적인 성능을 달성하는 인공 지능 모델을 상상해 보세요. 이것은 공상과학 소설이 아닙니다. DeepSeek-V2[1], 세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. DeepSeek-V2는 경제적인 훈련과 효율적인 추론이라는 특징을 지닌 전문가(MoE) 언어 모델의 강력한 혼합입니다. 이는 236B 매개변수로 구성되며, 그 중 21B는 각 마커를 활성화하는 데 사용됩니다. DeepSeek67B와 비교하여 DeepSeek-V2는 더 강력한 성능을 제공하는 동시에 훈련 비용을 42.5% 절감하고 KV 캐시를 93.3% 줄이며 최대 생성 처리량을 5.76배로 늘립니다. DeepSeek은 일반 인공지능을 연구하는 회사입니다.

MLP를 대체하는 KAN은 오픈소스 프로젝트를 통해 컨볼루션으로 확장되었습니다.

Jun 01, 2024 pm 10:03 PM

MLP를 대체하는 KAN은 오픈소스 프로젝트를 통해 컨볼루션으로 확장되었습니다.

Jun 01, 2024 pm 10:03 PM

이달 초 MIT와 기타 기관의 연구자들은 MLP에 대한 매우 유망한 대안인 KAN을 제안했습니다. KAN은 정확성과 해석성 측면에서 MLP보다 뛰어납니다. 그리고 매우 적은 수의 매개변수로 더 많은 수의 매개변수를 사용하여 실행되는 MLP보다 성능이 뛰어날 수 있습니다. 예를 들어 저자는 KAN을 사용하여 더 작은 네트워크와 더 높은 수준의 자동화로 DeepMind의 결과를 재현했다고 밝혔습니다. 구체적으로 DeepMind의 MLP에는 약 300,000개의 매개변수가 있는 반면 KAN에는 약 200개의 매개변수만 있습니다. KAN은 MLP와 같이 강력한 수학적 기반을 가지고 있으며, KAN은 Kolmogorov-Arnold 표현 정리를 기반으로 합니다. 아래 그림과 같이 KAN은

공장에서 일하는 테슬라 로봇, 머스크 : 올해 손의 자유도가 22도에 달할 것!

May 06, 2024 pm 04:13 PM

공장에서 일하는 테슬라 로봇, 머스크 : 올해 손의 자유도가 22도에 달할 것!

May 06, 2024 pm 04:13 PM

테슬라의 로봇 옵티머스(Optimus)의 최신 영상이 공개됐는데, 이미 공장에서 작동이 가능한 상태다. 정상 속도에서는 배터리(테슬라의 4680 배터리)를 다음과 같이 분류합니다. 공식은 또한 20배 속도로 보이는 모습을 공개했습니다. 작은 "워크스테이션"에서 따고 따고 따고 : 이번에 출시됩니다. 영상에는 옵티머스가 공장에서 이 작업을 전 과정에 걸쳐 사람의 개입 없이 완전히 자율적으로 완료하는 모습이 담겨 있습니다. 그리고 Optimus의 관점에서 보면 자동 오류 수정에 중점을 두고 구부러진 배터리를 집어 넣을 수도 있습니다. NVIDIA 과학자 Jim Fan은 Optimus의 손에 대해 높은 평가를 했습니다. Optimus의 손은 세계의 다섯 손가락 로봇 중 하나입니다. 가장 능숙합니다. 손은 촉각적일 뿐만 아니라

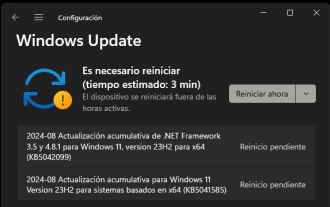

마이크로소프트, 보안 강화, 잠금 화면 최적화 등 Win11 8월 누적 업데이트 출시

Aug 14, 2024 am 10:39 AM

마이크로소프트, 보안 강화, 잠금 화면 최적화 등 Win11 8월 누적 업데이트 출시

Aug 14, 2024 am 10:39 AM

8월 14일 이 사이트의 소식에 따르면 오늘 8월 패치 화요일 이벤트 당일 마이크로소프트는 22H2와 23H2용 KB5041585 업데이트, 21H2용 KB5041592 업데이트를 포함해 윈도우 11 시스템용 누적 업데이트를 출시했다. 위 장비가 8월 누적 업데이트로 설치된 후, 본 사이트에 첨부된 버전번호 변경 사항은 다음과 같습니다. 21H2 장비 설치 후, 장비 설치 후 버전번호가 Build22000.314722H2로 증가되었습니다. Windows 1121H2용 KB5041585 업데이트의 주요 내용은 다음과 같습니다.

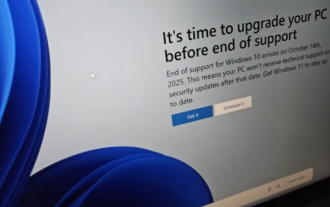

Microsoft의 전체 화면 팝업은 Windows 10 사용자에게 서둘러 Windows 11로 업그레이드하도록 촉구합니다.

Jun 06, 2024 am 11:35 AM

Microsoft의 전체 화면 팝업은 Windows 10 사용자에게 서둘러 Windows 11로 업그레이드하도록 촉구합니다.

Jun 06, 2024 am 11:35 AM

6월 3일자 뉴스에 따르면, 마이크로소프트는 모든 윈도우 10 사용자에게 적극적으로 전체 화면 알림을 보내 윈도우 11 운영체제로의 업그레이드를 독려하고 있다. 이 이동에는 하드웨어 구성이 새 시스템을 지원하지 않는 장치가 포함됩니다. 2015년부터 Windows 10은 거의 70%의 시장 점유율을 차지하며 Windows 운영 체제로서의 지배력을 확고히 자리 잡았습니다. 하지만 시장점유율은 82%를 훨씬 웃돌며, 2021년 출시 예정인 윈도우 11보다 시장점유율이 훨씬 높다. Windows 11이 출시된 지 거의 3년이 지났지만 시장 침투 속도는 여전히 느립니다. Microsoft는 Windows 10에 대한 기술 지원을 2025년 10월 14일 이후 종료한다고 발표했습니다.

DPO를 완전히 능가함: Chen Danqi 팀은 단순 선호도 최적화 SimPO를 제안하고 가장 강력한 8B 오픈 소스 모델도 개선했습니다.

Jun 01, 2024 pm 04:41 PM

DPO를 완전히 능가함: Chen Danqi 팀은 단순 선호도 최적화 SimPO를 제안하고 가장 강력한 8B 오픈 소스 모델도 개선했습니다.

Jun 01, 2024 pm 04:41 PM

대규모 언어 모델(LLM)을 인간의 가치와 의도에 맞추려면 인간의 피드백을 학습하여 유용하고 정직하며 무해한지 확인하는 것이 중요합니다. LLM 정렬 측면에서 효과적인 방법은 인간 피드백 기반 강화 학습(RLHF)입니다. RLHF 방법의 결과는 훌륭하지만 몇 가지 최적화 문제가 있습니다. 여기에는 보상 모델을 훈련한 다음 해당 보상을 극대화하기 위해 정책 모델을 최적화하는 것이 포함됩니다. 최근 일부 연구자들은 더 간단한 오프라인 알고리즘을 탐구했는데, 그 중 하나가 직접 선호 최적화(DPO)입니다. DPO는 RLHF의 보상 기능을 매개변수화하여 선호도 데이터를 기반으로 직접 정책 모델을 학습하므로 명시적인 보상 모델이 필요하지 않습니다. 이 방법은 간단하고 안정적입니다.

OpenAI 데이터가 필요하지 않습니다. 대규모 코드 모델 목록에 참여하세요! UIUC, StarCoder-15B-Instruct 출시

Jun 13, 2024 pm 01:59 PM

OpenAI 데이터가 필요하지 않습니다. 대규모 코드 모델 목록에 참여하세요! UIUC, StarCoder-15B-Instruct 출시

Jun 13, 2024 pm 01:59 PM

소프트웨어 기술의 선두에 있는 UIUC Zhang Lingming 그룹은 BigCode 조직의 연구원들과 함께 최근 StarCoder2-15B-Instruct 대규모 코드 모델을 발표했습니다. 이 혁신적인 성과는 코드 생성 작업에서 획기적인 발전을 이루었으며 CodeLlama-70B-Instruct를 성공적으로 능가하고 코드 생성 성능 목록의 최상위에 올랐습니다. StarCoder2-15B-Instruct의 독창성은 순수한 자체 정렬 전략에 있습니다. 전체 훈련 프로세스는 개방적이고 투명하며 완전히 자율적이고 제어 가능합니다. 이 모델은 값비싼 수동 주석에 의존하지 않고 StarCoder-15B 기본 모델을 미세 조정한 것에 대한 응답으로 StarCoder2-15B를 통해 수천 개의 명령을 생성합니다.

LLM이 모두 완료되었습니다! OmniDrive: 3D 인식 및 추론 계획 통합(NVIDIA 최신)

May 09, 2024 pm 04:55 PM

LLM이 모두 완료되었습니다! OmniDrive: 3D 인식 및 추론 계획 통합(NVIDIA 최신)

May 09, 2024 pm 04:55 PM

위에 작성됨 및 저자의 개인적 이해: 이 문서는 자율 주행 애플리케이션에서 현재 다중 모드 대형 언어 모델(MLLM)의 주요 과제를 해결하는 데 전념하고 있습니다. 이는 MLLM을 2D 이해에서 3D 공간으로 확장하는 문제입니다. 자율주행차(AV)가 3D 환경에 대해 정확한 결정을 내려야 하기 때문에 이러한 확장은 특히 중요합니다. 3D 공간 이해는 정보에 입각한 결정을 내리고 미래 상태를 예측하며 환경과 안전하게 상호 작용하는 차량의 능력에 직접적인 영향을 미치기 때문에 AV에 매우 중요합니다. 현재 다중 모드 대형 언어 모델(예: LLaVA-1.5)은 시각적 인코더의 해상도 제한, LLM 시퀀스 길이 제한으로 인해 저해상도 이미지 입력(예:)만 처리할 수 있는 경우가 많습니다. 하지만 자율주행 애플리케이션에는