Nginx 로드 밸런싱 구성 예시 분석

【구현 기능】

1. 세 개의 서버를 구성합니다

2. 동일한 서비스 코드를 세 개의 서버에 각각 배포합니다.

3. nginx를 사용하여 로드 밸런싱을 구현합니다

【구현 아이디어】

us 로드 밸런서는 대화형 서버에 배포되고 다른 두 서버와의 연결을 구성하며 모든 요청은 nginx 서비스 인터페이스에 직접 액세스한 다음 nginx 로드 밸런서는 자체적으로 실제 호출 서버 포트를 선택합니다.

[개발 및 배포 환경]

개발 환경: windows 7 x64 sp1 영문 버전

visualstudio 2017

배포 환경: Alibaba Cloud ecs 인스턴스 windows server 2012 x64

iis 7.0

【필요기술】

asp.net webapi2

【구현 과정】

asp.net webapi2를 사용하여 단순히 json을 반환하는 인터페이스를 작성합니다. 서로 다른 서버에서 인터페이스를 호출하고 있음을 보여주기 위해 디지털 형식으로 세 가지 인터페이스를 생성합니다. . 인터페이스 서비스를 제공하고 각각 3개의 서버 iis에 배포됩니다.

public ihttpactionresult gettest()

{

//throw new exception_dg_internationalization(1001);

string ip = request.getipaddressfromrequest();

return ok("test api . client ip address is -> "+ip+" the server is ===== 333 =====");

}내가 배포한 세 서버 뒤에 있는 숫자는 각각 111, 222, 333입니다.

참고: return ok는 내 사용자 정의 반환 형식입니다. 특정 단순 코드의 경우 json();

request.getipaddressfromrequest( ) ; IP 주소를 얻는 확장된 방법입니다. 상황에 맞게 구현해 보세요.

【시스템 테스트】

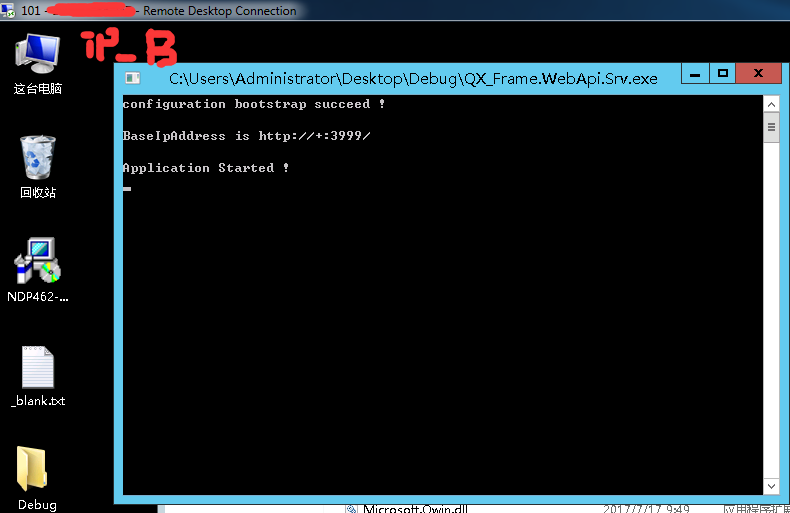

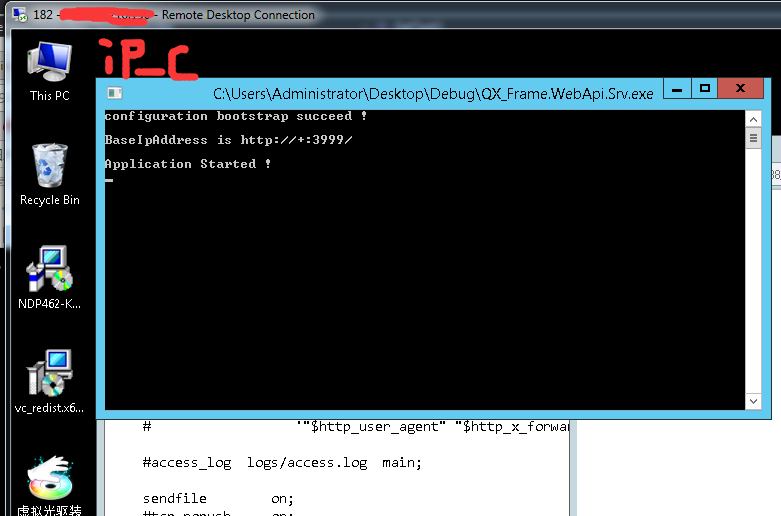

3개의 배경 코드를 생성하여 각각 3개의 서버에 배포했습니다.

서버 정보를 기밀로 유지하기 위해 아래의 모든 IP 주소는 ip_a, ip_b, ip_c로 식별됩니다.

세 번째는 nginx를 배포할 서버입니다:

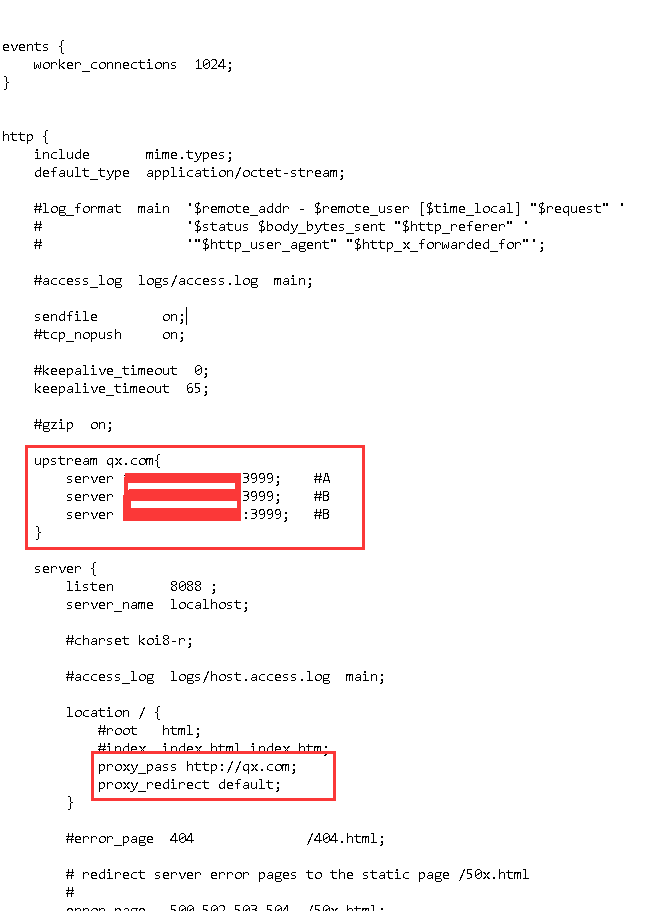

배포 후 nginx를 구성합니다.

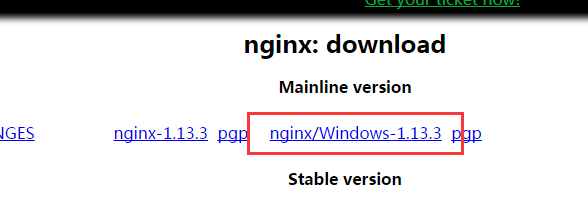

nginx 다운로드:

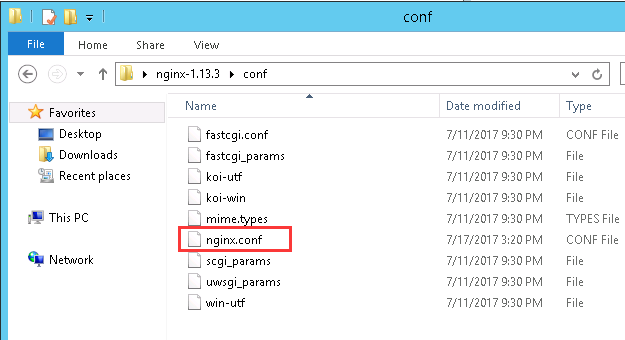

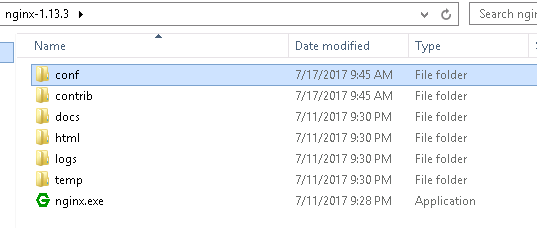

그런 다음 ip_c 서버에 압축을 풀고 conf 폴더에서 nginx.conf를 엽니다

편집된 내용은 다음과 같습니다

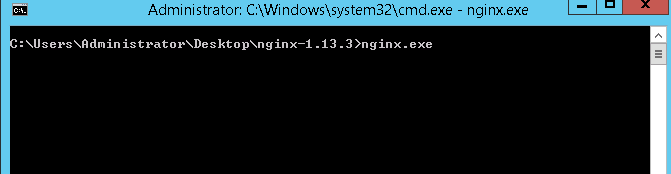

그런 다음 서비스를 시작합니다.

cmd 명령을 사용하여 nginx

이런 식으로 서비스가 시작되더라도... 불만 사항, 서비스가 성공적으로 시작되었다고 말하지 않겠습니까? ... 글쎄요, 그건 인간적이지 않아요!

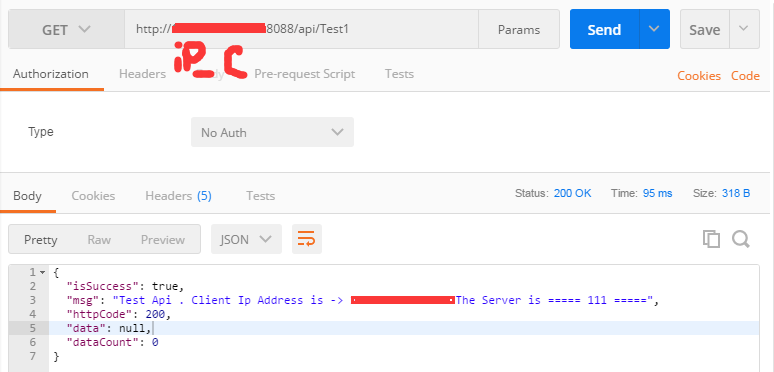

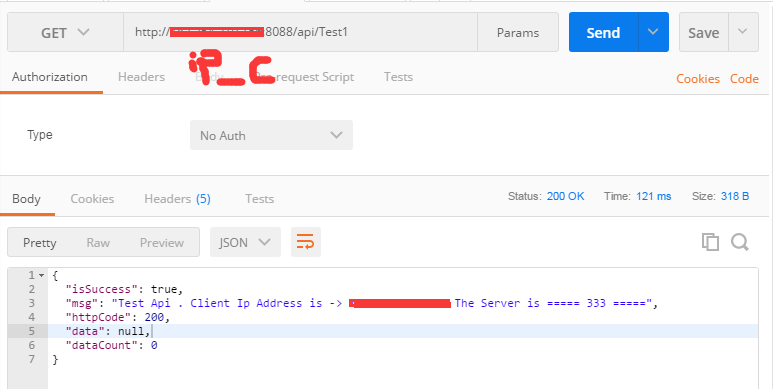

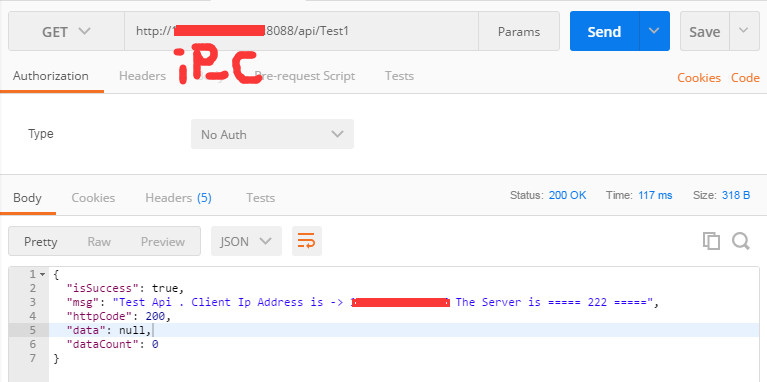

그런 다음 인터페이스 테스트 도구를 열고 동일한 요청을 세 번 실행합니다.

1개 요청,

2개 요청,

3개 요청,

그것 우리가 호출하는 백그라운드 서비스 인터페이스가 모든 요청에 대해 동일하지 않다는 것을 알 수 있습니다. 이는 많은 수의 고객이 동일한 서버 주소에 액세스할 때 한 서버의 압력이 여러 서버에 할당되어 부하가 분산될 수 있음을 보장합니다. 목적.

위 내용은 Nginx 로드 밸런싱 구성 예시 분석의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7680

7680

15

15

1393

1393

52

52

1209

1209

24

24

91

91

11

11

73

73

19

19

nginx가 시작되었는지 확인하는 방법

Apr 14, 2025 pm 01:03 PM

nginx가 시작되었는지 확인하는 방법

Apr 14, 2025 pm 01:03 PM

nginx가 시작되었는지 확인하는 방법 : 1. 명령 줄을 사용하십시오 : SystemCTL 상태 nginx (linux/unix), netstat -ano | Findstr 80 (Windows); 2. 포트 80이 열려 있는지 확인하십시오. 3. 시스템 로그에서 nginx 시작 메시지를 확인하십시오. 4. Nagios, Zabbix 및 Icinga와 같은 타사 도구를 사용하십시오.

Nginx에서 클라우드 서버 도메인 이름을 구성하는 방법

Apr 14, 2025 pm 12:18 PM

Nginx에서 클라우드 서버 도메인 이름을 구성하는 방법

Apr 14, 2025 pm 12:18 PM

클라우드 서버에서 nginx 도메인 이름을 구성하는 방법 : 클라우드 서버의 공개 IP 주소를 가리키는 레코드를 만듭니다. Nginx 구성 파일에 가상 호스트 블록을 추가하여 청취 포트, 도메인 이름 및 웹 사이트 루트 디렉토리를 지정합니다. Nginx를 다시 시작하여 변경 사항을 적용하십시오. 도메인 이름 테스트 구성에 액세스하십시오. 기타 참고 : HTTPS를 활성화하려면 SSL 인증서를 설치하고 방화벽에서 포트 80 트래픽을 허용하고 DNS 해상도가 적용되기를 기다립니다.

Docker 컨테이너의 이름을 확인하는 방법

Apr 15, 2025 pm 12:21 PM

Docker 컨테이너의 이름을 확인하는 방법

Apr 15, 2025 pm 12:21 PM

단계를 따르면 Docker 컨테이너 이름을 쿼리 할 수 있습니다. 모든 컨테이너 (Docker PS)를 나열하십시오. 컨테이너 목록을 필터링합니다 (GREP 명령 사용). 컨테이너 이름 ( "이름"열에 위치)을 가져옵니다.

nginx 버전을 확인하는 방법

Apr 14, 2025 am 11:57 AM

nginx 버전을 확인하는 방법

Apr 14, 2025 am 11:57 AM

nginx 버전을 쿼리 할 수있는 메소드는 다음과 같습니다. nginx -v 명령을 사용하십시오. nginx.conf 파일에서 버전 지시문을 봅니다. nginx 오류 페이지를 열고 페이지 제목을 봅니다.

Windows에서 nginx를 구성하는 방법

Apr 14, 2025 pm 12:57 PM

Windows에서 nginx를 구성하는 방법

Apr 14, 2025 pm 12:57 PM

Windows에서 Nginx를 구성하는 방법은 무엇입니까? nginx를 설치하고 가상 호스트 구성을 만듭니다. 기본 구성 파일을 수정하고 가상 호스트 구성을 포함하십시오. 시작 또는 새로 고침 Nginx. 구성을 테스트하고 웹 사이트를보십시오. SSL을 선택적으로 활성화하고 SSL 인증서를 구성하십시오. 포트 80 및 443 트래픽을 허용하도록 방화벽을 선택적으로 설정하십시오.

nginx 서버를 시작하는 방법

Apr 14, 2025 pm 12:27 PM

nginx 서버를 시작하는 방법

Apr 14, 2025 pm 12:27 PM

Nginx 서버를 시작하려면 다른 운영 체제에 따라 다른 단계가 필요합니다. Linux/Unix System : Nginx 패키지 설치 (예 : APT-Get 또는 Yum 사용). SystemCTL을 사용하여 nginx 서비스를 시작하십시오 (예 : Sudo SystemCtl start nginx). Windows 시스템 : Windows 바이너리 파일을 다운로드하여 설치합니다. nginx.exe 실행 파일을 사용하여 nginx를 시작하십시오 (예 : nginx.exe -c conf \ nginx.conf). 어떤 운영 체제를 사용하든 서버 IP에 액세스 할 수 있습니다.

Docker 용 컨테이너를 만드는 방법

Apr 15, 2025 pm 12:18 PM

Docker 용 컨테이너를 만드는 방법

Apr 15, 2025 pm 12:18 PM

Docker에서 컨테이너 만들기 : 1. 이미지를 당기기 : Docker Pull [Mirror Name] 2. 컨테이너 만들기 : Docker Run [옵션] [미러 이름] [명령] 3. 컨테이너 시작 : Docker Start [컨테이너 이름]

Docker가 컨테이너를 시작하는 방법

Apr 15, 2025 pm 12:27 PM

Docker가 컨테이너를 시작하는 방법

Apr 15, 2025 pm 12:27 PM

Docker Container Startup 단계 : 컨테이너 이미지를 당기기 : "Docker Pull [Mirror Name]"을 실행하십시오. 컨테이너 생성 : "docker"[옵션] [미러 이름] [명령 및 매개 변수]를 사용하십시오. 컨테이너를 시작하십시오 : "Docker start [컨테이너 이름 또는 ID]"를 실행하십시오. 컨테이너 상태 확인 : 컨테이너가 "Docker PS"로 실행 중인지 확인하십시오.