소후테크놀로지 제작

저자|정송이

6월 9일, 2023년 Zhiyuan 인공지능 컨퍼런스가 베이징에서 열렸습니다. 프랑스 현지시각 오전 4시, '세계 3대 딥러닝 거인'으로 알려진 얀 르쿤(Yann LeCun)이 베이징에서 프랑스 비디오 링크를 통해 '대형 모델을 향하여' 연설을 했다. 학습하고 추론하고 계획할 수 있다”는 연설에서는 인공지능에 대한 깊이 있는 생각을 표현했다.

Sohu Technology는 Zhiyuan 회의에서 이 연설을 보았습니다. 연설 중 Yang Likun의 웃는 표정에서 인공 지능 개발에 대한 Yang Likun의 긍정적이고 낙관적인 태도를 느낄 수 있습니다. 앞서 양리쿤은 앞서 머스크 등이 인공지능의 발전이 인류 문명에 위험을 가져올 것이라는 공동 서한에 서명했을 때 인공지능이 아직 인류에게 심각한 위협을 가할 정도로 발전하지 않았다며 이를 공개적으로 반박한 바 있다. 양리쿤은 연설에서 인공지능이 통제 가능하다는 점을 다시 한 번 강조했다. 그는 “두려움은 잠재적인 부정적인 결과에 대한 기대에서 생기고, 기쁨은 긍정적인 결과에 대한 예측에서 생긴다”고 말했다. 나는 그것을 '목표 중심 AI'라고 부르는데, 비용 함수를 통해 목표를 설정할 수 있기 때문에 제어가 가능할 것이며, 이러한 시스템이 세상을 장악하지 않고 대신 인간성과 보안에 굴복하도록 보장할 것입니다. ”

양리쿤은 인공지능과 인간, 동물의 차이는 지능의 중요한 특징인 논리적 추론과 계획에 있다고 말했습니다.

"1조, 2조 토큰으로 훈련시키면 기계의 성능은 놀랍지만 결국 기계는 사실적 오류, 논리적 오류를 범하게 되고 추론 능력이 제한됩니다."

양리쿤은 자기 감독에 기반한 언어 모델은 현실 세계에 대한 지식을 얻을 수 없다고 강조했습니다. 그는 기계가 인간이나 동물에 비해 학습 능력이 별로 좋지 않다고 믿습니다. 수십 년 동안 시스템을 개발하는 방법은 지도 학습을 사용하는 것이었지만 지도 학습에는 너무 많은 레이블이 필요하고, 무엇이든 학습하려면 많은 시도가 필요하며, 강화 학습의 결과는 만족스럽지 않습니다. 틀렸고 실제로 추론하거나 계획할 수 없습니다."연설을 할 때 한 가지 점을 어떻게 표현하고 설명하는지는 한 마디 한 마디 즉석에서 하는 것이 아니라 우리 뇌에서 계획되는 것과 같습니다. 낮은 수준에서는 즉흥적인 것일 수도 있지만, 높은 수준에서는 , 우리는 계획을 세워야 하므로 계획의 필요성은 매우 분명합니다. 제 예측은 비교적 짧은 시간 내에 정상적인 사람들이 자동 회귀 요소(자기 지도 학습 방법)를 사용하지 않을 것이라는 것입니다. 이 시스템은 수리가 불가능하기 때문에 곧 폐기될 것입니다."

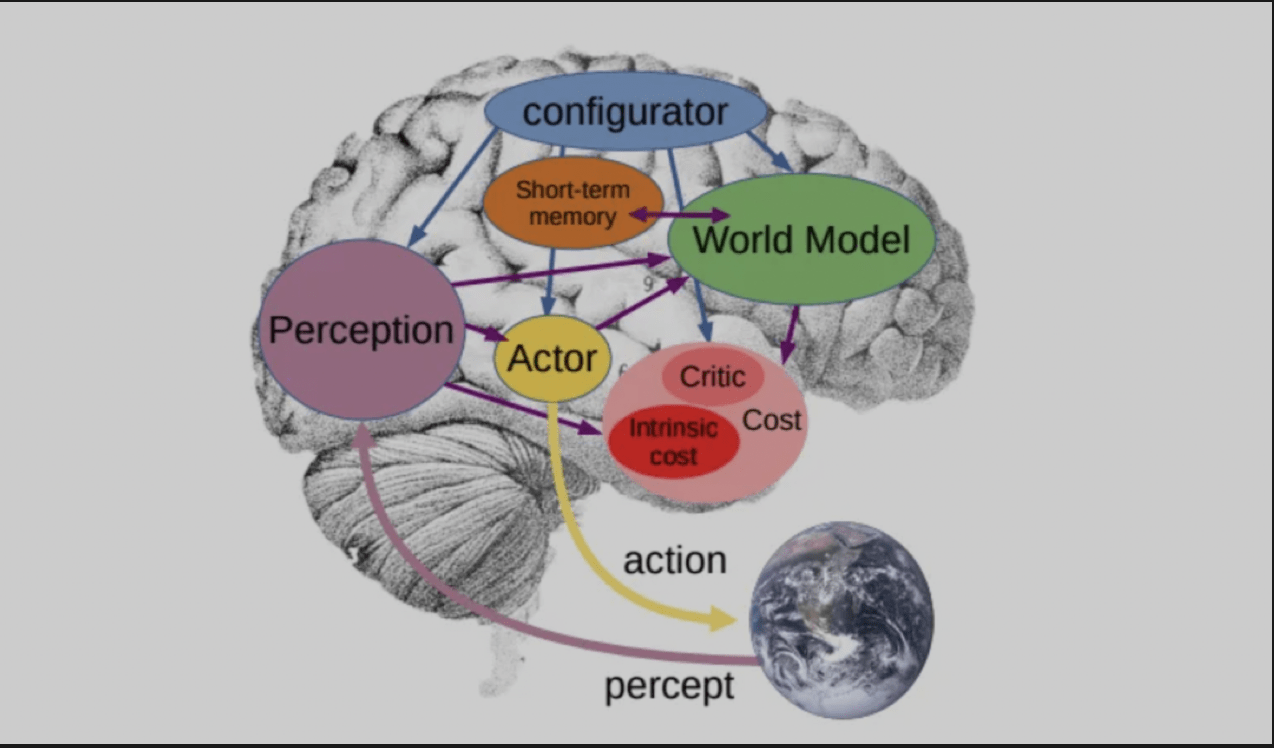

언어 모델이 현실 세계의 지식을 진정으로 이해하기 위해서는 이를 대체할 새로운 아키텍처가 필요하며, 이 아키텍처가 그가 1년 전 발표한 논문 "Autonomous Intelligence"에서 제안한 아키텍처라고 하더군요. . 구성 모듈이 시스템 전체를 제어하고, 입력된 정보를 바탕으로 예측, 추론, 의사결정을 수행하는 아키텍처이다. '월드 모듈'에는 누락된 정보를 추정하고 미래의 외부 상황을 예측하는 기능이 있습니다.

이렇게 말하면서, 양리쿤은 자신이 논문 "World Model"에 발표한 또 다른 모델을 소개했는데, 이는 장면을 상상하고 장면에 따라 행동의 결과를 예측할 수 있다는 것입니다. 목표는 자체 세계 모델에 의해 예측되고 비용 범위를 최소화하는 일련의 동작을 찾는 것입니다.

Yang Likun은 AGI의 현황과 미래에 대한 향후 토론에 대한 Q&A 세션에서 질문을 받았을 때 인공 지능 시스템이 인간에게 실존적 위험을 초래하는지 여부에 대한 질문을 중심으로 토론이 진행될 것이라고 말했습니다. Max Tegmark와 Yoshua Bengio는 강력한 AI 시스템이 인간에게 실존적 위험을 초래할 수 있다고 주장하면서 "그렇다"고 주장합니다. 그리고 Liqun Yang과 Melanie Mitchell은 “아니요” 편에 서게 될 것입니다.

"우리의 요점은 위험이 없다는 것이 아니라 이러한 위험이 존재하더라도 신중한 설계를 통해 쉽게 완화되거나 억제될 수 있다는 것입니다."

양리쿤은 초지능 시스템이 아직 개발되지 않았다고 생각합니다. 초지능 시스템이 발명된 후에는 "초지능 시스템이 인간에게 안전한지 여부"를 논의하기에는 너무 늦을 것입니다.

위 내용은 Turing Award 수상자 Yang Likun: AI는 논리적 추론 및 계획 능력이 제한되어 있어 사실적, 논리적 오류를 범할 것입니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!