신경망 훈련에 PyTorch를 사용하는 방법

신경망 훈련에 PyTorch를 사용하는 방법

소개:

PyTorch는 Python 기반의 오픈 소스 기계 학습 프레임워크로 유연성과 단순성으로 인해 많은 연구원과 엔지니어가 가장 먼저 선택합니다. 이 기사에서는 신경망 훈련에 PyTorch를 사용하는 방법을 소개하고 해당 코드 예제를 제공합니다.

1. PyTorch 설치

시작하기 전에 먼저 PyTorch를 설치해야 합니다. 공식 홈페이지(https://pytorch.org/)에서 제공하는 설치 가이드를 통해 운영체제 및 하드웨어에 적합한 버전을 선택하여 설치할 수 있습니다. 설치가 완료되면 Python으로 PyTorch 라이브러리를 가져오고 코드 작성을 시작할 수 있습니다.

2. 신경망 모델 구축

PyTorch를 사용하여 신경망을 훈련시키기 전에 먼저 적합한 모델을 구축해야 합니다. PyTorch는 자신만의 신경망 모델을 정의하기 위해 상속할 수 있는 torch.nn.Module이라는 클래스를 제공합니다. torch.nn.Module的类,您可以通过继承该类来定义自己的神经网络模型。

下面是一个简单的例子,展示了如何使用PyTorch构建一个包含两个全连接层的神经网络模型:

import torch

import torch.nn as nn

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.fc1 = nn.Linear(in_features=784, out_features=256)

self.fc2 = nn.Linear(in_features=256, out_features=10)

def forward(self, x):

x = x.view(x.size(0), -1)

x = self.fc1(x)

x = torch.relu(x)

x = self.fc2(x)

return x

net = Net()在上面的代码中,我们首先定义了一个名为Net的类,并继承了torch.nn.Module类。在__init__方法中,我们定义了两个全连接层fc1和fc2。然后,我们通过forward方法定义了数据在模型中前向传播的过程。最后,我们创建了一个Net的实例。

三、定义损失函数和优化器

在进行训练之前,我们需要定义损失函数和优化器。PyTorch提供了丰富的损失函数和优化器的选择,可以根据具体情况进行选择。

下面是一个示例,展示了如何定义一个使用交叉熵损失函数和随机梯度下降优化器的训练过程:

loss_fn = nn.CrossEntropyLoss() optimizer = torch.optim.SGD(net.parameters(), lr=0.01)

在上面的代码中,我们将交叉熵损失函数和随机梯度下降优化器分别赋值给了loss_fn和optimizer变量。net.parameters()表示我们要优化神经网络模型中的所有可学习参数,lr参数表示学习率。

四、准备数据集

在进行神经网络训练之前,我们需要准备好训练数据集和测试数据集。PyTorch提供了一些实用的工具类,可以帮助我们加载和预处理数据集。

下面是一个示例,展示了如何加载MNIST手写数字数据集并进行预处理:

import torchvision

import torchvision.transforms as transforms

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.5,), (0.5,)),

])

train_set = torchvision.datasets.MNIST(root='./data', train=True, download=True, transform=transform)

train_loader = torch.utils.data.DataLoader(train_set, batch_size=32, shuffle=True)

test_set = torchvision.datasets.MNIST(root='./data', train=False, download=True, transform=transform)

test_loader = torch.utils.data.DataLoader(test_set, batch_size=32, shuffle=False)在上面的代码中,我们首先定义了一个transform变量,用于对数据进行预处理。然后,我们使用torchvision.datasets.MNIST类加载MNIST数据集,并使用train=True和train=False参数指定了训练数据集和测试数据集。最后,我们使用torch.utils.data.DataLoader类将数据集转换成一个可以迭代的数据加载器。

五、开始训练

准备好数据集后,我们就可以开始进行神经网络的训练。在一个训练循环中,我们需要依次完成以下步骤:将输入数据输入到模型中,计算损失函数,反向传播更新梯度,优化模型。

下面是一个示例,展示了如何使用PyTorch进行神经网络训练:

for epoch in range(epochs):

running_loss = 0.0

for i, data in enumerate(train_loader):

inputs, labels = data

optimizer.zero_grad()

outputs = net(inputs)

loss = loss_fn(outputs, labels)

loss.backward()

optimizer.step()

running_loss += loss.item()

if (i+1) % 100 == 0:

print('[%d, %5d] loss: %.3f' % (epoch+1, i+1, running_loss/100))

running_loss = 0.0在上面的代码中,我们首先使用enumerate函数遍历了训练数据加载器,得到了输入数据和标签。然后,我们将梯度清零,将输入数据输入到模型中,计算预测结果和损失函数。接着,我们通过backward方法计算梯度,再通过step方法更新模型参数。最后,我们累加损失,并根据需要进行打印。

六、测试模型

训练完成后,我们还需要测试模型的性能。我们可以通过计算模型在测试数据集上的准确率来评估模型的性能。

下面是一个示例,展示了如何使用PyTorch测试模型的准确率:

correct = 0

total = 0

with torch.no_grad():

for data in test_loader:

inputs, labels = data

outputs = net(inputs)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

accuracy = 100 * correct / total

print('Accuracy: %.2f %%' % accuracy)在上面的代码中,我们首先定义了两个变量correct和total,用于计算正确分类的样本和总样本数。接着,我们使用torch.no_grad()

rrreee

위 코드에서는 먼저 Net이라는 클래스를 정의하고 torch.nn에서 상속합니다. 모듈 클래스. __init__ 메서드에서는 두 개의 완전히 연결된 레이어 fc1 및 fc2를 정의합니다. 그런 다음 forward 메서드를 통해 모델에서 데이터의 순방향 전파 프로세스를 정의합니다. 마지막으로 Net 인스턴스를 만듭니다.

3. 손실 함수와 옵티마이저 정의

훈련 전에 손실 함수와 옵티마이저를 정의해야 합니다. PyTorch는 특정 상황에 따라 선택할 수 있는 다양한 손실 함수 및 최적화 프로그램을 제공합니다.- 다음은 교차 엔트로피 손실 함수와 확률적 경사하강법 최적화 도구를 사용하여 훈련 과정을 정의하는 방법을 보여주는 예입니다. rrreee

- 위 코드에서는 교차 엔트로피 손실 함수와 확률적 경사하강법 최적화 도구를 할당합니다. 별도로

loss_fn및optimizer변수가 제공됩니다.net.parameters()는 신경망 모델에서 학습 가능한 모든 매개변수를 최적화하려고 함을 나타내고lr매개변수는 학습 속도를 나타냅니다.

transform 변수를 정의하여 데이터 전처리를 변환합니다. 그런 다음 torchvision.datasets.MNIST 클래스를 사용하여 MNIST 데이터세트를 로드하고 train=True 및 train=False 매개변수를 사용하여 훈련 데이터를 지정했습니다. 데이터 세트를 설정하고 테스트합니다. 마지막으로 torch.utils.data.DataLoader 클래스를 사용하여 데이터 세트를 반복 가능한 데이터 로더로 변환합니다. 🎜🎜5. 훈련 시작🎜 데이터 세트를 준비한 후 신경망 훈련을 시작할 수 있습니다. 훈련 루프에서는 입력 데이터를 모델에 입력하고, 손실 함수를 계산하고, 업데이트된 기울기를 역전파하고, 모델을 최적화하는 단계를 순서대로 완료해야 합니다. 🎜🎜다음은 신경망 훈련에 PyTorch를 사용하는 방법을 보여주는 예입니다. 🎜rrreee🎜위 코드에서는 먼저 enumerate 함수를 사용하여 훈련 데이터 로더를 탐색하여 입력 데이터와 레이블을 가져옵니다. 그런 다음 기울기를 0으로 만들고 입력 데이터를 모델에 공급한 다음 예측 및 손실 함수를 계산합니다. 다음으로 backward 메서드를 통해 기울기를 계산한 다음 step 메서드를 통해 모델 매개변수를 업데이트합니다. 마지막으로 손실을 누적하고 필요에 따라 인쇄합니다. 🎜🎜 6. 모델 테스트 🎜훈련이 완료된 후에도 모델의 성능을 테스트해야 합니다. 테스트 데이터 세트에 대한 정확도를 계산하여 모델의 성능을 평가할 수 있습니다. 🎜🎜다음은 PyTorch를 사용하여 모델의 정확성을 테스트하는 방법을 보여주는 예입니다. 🎜rrreee🎜위 코드에서는 먼저 corright 및 total 두 변수를 정의하고 사용합니다. 올바르게 분류된 샘플 수와 전체 샘플 수를 계산합니다. 다음으로 torch.no_grad() 컨텍스트 관리자를 사용하여 기울기 계산을 꺼서 메모리 소비를 줄입니다. 그런 다음 예측 결과를 순차적으로 계산하고 올바르게 분류된 샘플 수와 총 샘플 수를 업데이트합니다. 마지막으로 정확하게 분류된 샘플 수와 전체 샘플 수를 기준으로 정확도를 계산하여 인쇄합니다. 🎜🎜요약: 🎜이 글의 서론을 통해 신경망 훈련에 PyTorch를 사용하는 방법의 기본 단계를 이해했으며, 신경망 모델 구축, 손실 함수 및 옵티마이저 정의, 데이터 세트 준비, 훈련 시작 방법을 배웠습니다. 그리고 모델을 테스트합니다. 이 기사가 신경망 훈련에 PyTorch를 사용하는 작업과 연구에 도움이 되기를 바랍니다. 🎜🎜참고자료: 🎜🎜🎜PyTorch 공식 웹사이트: https://pytorch.org/🎜🎜PyTorch 문서: https://pytorch.org/docs/stable/index.html🎜🎜위 내용은 신경망 훈련에 PyTorch를 사용하는 방법의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7490

7490

15

15

1377

1377

52

52

77

77

11

11

52

52

19

19

19

19

41

41

오픈 소스! ZoeDepth를 넘어! DepthFM: 빠르고 정확한 단안 깊이 추정!

Apr 03, 2024 pm 12:04 PM

오픈 소스! ZoeDepth를 넘어! DepthFM: 빠르고 정확한 단안 깊이 추정!

Apr 03, 2024 pm 12:04 PM

0. 이 글은 어떤 내용을 담고 있나요? 우리는 다재다능하고 빠른 최첨단 생성 단안 깊이 추정 모델인 DepthFM을 제안합니다. DepthFM은 전통적인 깊이 추정 작업 외에도 깊이 인페인팅과 같은 다운스트림 작업에서 최첨단 기능을 보여줍니다. DepthFM은 효율적이며 몇 가지 추론 단계 내에서 깊이 맵을 합성할 수 있습니다. 이 작품을 함께 읽어보아요~ 1. 논문 정보 제목: DepthFM: FastMoncularDepthEstimationwithFlowMatching 저자: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

PyCharm과 PyTorch의 완벽한 조합: 자세한 설치 및 구성 단계

Feb 21, 2024 pm 12:00 PM

PyCharm과 PyTorch의 완벽한 조합: 자세한 설치 및 구성 단계

Feb 21, 2024 pm 12:00 PM

PyCharm은 강력한 통합 개발 환경(IDE)이고, PyTorch는 딥 러닝 분야에서 인기 있는 오픈 소스 프레임워크입니다. 머신러닝과 딥러닝 분야에서 PyCharm과 PyTorch를 개발에 활용하면 개발 효율성과 코드 품질을 크게 향상시킬 수 있습니다. 이 기사에서는 PyCharm에서 PyTorch를 설치 및 구성하는 방법을 자세히 소개하고 독자가 이 두 가지의 강력한 기능을 더 잘 활용할 수 있도록 특정 코드 예제를 첨부합니다. 1단계: PyCharm 및 Python 설치

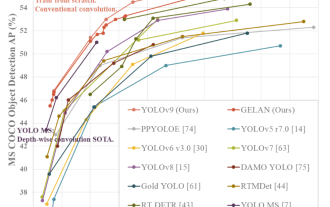

YOLO는 불멸이다! YOLOv9 출시: 성능과 속도 SOTA~

Feb 26, 2024 am 11:31 AM

YOLO는 불멸이다! YOLOv9 출시: 성능과 속도 SOTA~

Feb 26, 2024 am 11:31 AM

오늘날의 딥러닝 방법은 모델의 예측 결과가 실제 상황에 가장 가깝도록 가장 적합한 목적 함수를 설계하는 데 중점을 두고 있습니다. 동시에 예측을 위한 충분한 정보를 얻을 수 있도록 적합한 아키텍처를 설계해야 합니다. 기존 방법은 입력 데이터가 레이어별 특징 추출 및 공간 변환을 거치면 많은 양의 정보가 손실된다는 사실을 무시합니다. 이 글에서는 딥 네트워크를 통해 데이터를 전송할 때 중요한 문제, 즉 정보 병목 현상과 가역 기능을 살펴보겠습니다. 이를 바탕으로 다중 목표를 달성하기 위해 심층 네트워크에서 요구되는 다양한 변화에 대처하기 위해 PGI(Programmable Gradient Information) 개념을 제안합니다. PGI는 목적 함수를 계산하기 위해 대상 작업에 대한 완전한 입력 정보를 제공할 수 있으므로 네트워크 가중치를 업데이트하기 위한 신뢰할 수 있는 기울기 정보를 얻을 수 있습니다. 또한 새로운 경량 네트워크 프레임워크가 설계되었습니다.

안녕하세요, 일렉트릭 아틀라스입니다! 보스턴 다이나믹스 로봇 부활, 180도 이상한 움직임에 겁먹은 머스크

Apr 18, 2024 pm 07:58 PM

안녕하세요, 일렉트릭 아틀라스입니다! 보스턴 다이나믹스 로봇 부활, 180도 이상한 움직임에 겁먹은 머스크

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas가 공식적으로 전기 로봇 시대에 돌입했습니다! 어제 유압식 Atlas가 역사의 무대에서 "눈물을 흘리며" 물러났습니다. 오늘 Boston Dynamics는 전기식 Atlas가 작동 중이라고 발표했습니다. 상업용 휴머노이드 로봇 분야에서는 보스턴 다이내믹스가 테슬라와 경쟁하겠다는 각오를 다진 것으로 보인다. 새 영상은 공개된 지 10시간 만에 이미 100만 명이 넘는 조회수를 기록했다. 옛 사람들은 떠나고 새로운 역할이 등장하는 것은 역사적 필연이다. 올해가 휴머노이드 로봇의 폭발적인 해라는 것은 의심의 여지가 없습니다. 네티즌들은 “로봇의 발전으로 올해 개막식도 인간처럼 생겼고, 자유도도 인간보다 훨씬 크다. 그런데 정말 공포영화가 아닌가?”라는 반응을 보였다. 영상 시작 부분에서 아틀라스는 바닥에 등을 대고 가만히 누워 있는 모습입니다. 다음은 입이 떡 벌어지는 내용이다

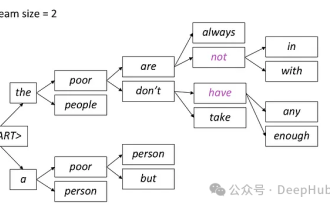

자연어 생성 작업의 5가지 샘플링 방법 및 Pytorch 코드 구현 소개

Feb 20, 2024 am 08:50 AM

자연어 생성 작업의 5가지 샘플링 방법 및 Pytorch 코드 구현 소개

Feb 20, 2024 am 08:50 AM

자연어 생성 작업에서 샘플링 방법은 생성 모델에서 텍스트 출력을 얻는 기술입니다. 이 기사에서는 5가지 일반적인 방법을 논의하고 PyTorch를 사용하여 구현합니다. 1. GreedyDecoding 그리디 디코딩에서는 생성 모델이 시간 단위로 입력 시퀀스를 기반으로 출력 시퀀스의 단어를 예측합니다. 각 시간 단계에서 모델은 각 단어의 조건부 확률 분포를 계산한 다음, 현재 시간 단계의 출력으로 조건부 확률이 가장 높은 단어를 선택합니다. 이 단어는 다음 시간 단계의 입력이 되며 지정된 길이의 시퀀스 또는 특수 종료 표시와 같은 일부 종료 조건이 충족될 때까지 생성 프로세스가 계속됩니다. GreedyDecoding의 특징은 매번 현재 조건부 확률이 가장 좋다는 것입니다.

Sora 'Ke Ling'의 Kuaishou 버전이 테스트용으로 공개되었습니다. 120초가 넘는 비디오를 생성하고 물리학을 더 잘 이해하며 복잡한 움직임을 정확하게 모델링할 수 있습니다.

Jun 11, 2024 am 09:51 AM

Sora 'Ke Ling'의 Kuaishou 버전이 테스트용으로 공개되었습니다. 120초가 넘는 비디오를 생성하고 물리학을 더 잘 이해하며 복잡한 움직임을 정확하게 모델링할 수 있습니다.

Jun 11, 2024 am 09:51 AM

무엇? 주토피아는 국내 AI로 현실이 되는 걸까? 영상과 함께 노출된 것은 '켈링'이라는 국산 대형 영상세대 신형 모델이다. Sora는 유사한 기술 경로를 사용하고 자체 개발한 여러 기술 혁신을 결합하여 크고 합리적인 움직임뿐만 아니라 물리적 세계의 특성을 시뮬레이션하고 강력한 개념적 결합 능력과 상상력을 갖춘 비디오를 제작합니다. 데이터에 따르면 Keling은 최대 1080p의 해상도로 30fps에서 최대 2분의 초장 영상 생성을 지원하며 다양한 화면비를 지원합니다. 또 다른 중요한 점은 Keling이 실험실에서 공개한 데모나 비디오 결과 시연이 아니라 단편 비디오 분야의 선두주자인 Kuaishou가 출시한 제품 수준 애플리케이션이라는 점입니다. 더욱이 백지 작성이 아닌 실용성에 중점을 두고, 출시되자마자 온라인에 진출하는 데 중점을 두고 있다. 콰이잉에서는 커링의 대형 모델이 출시됐다.

PyTorch와 함께 PyCharm을 설치하는 방법에 대한 튜토리얼

Feb 24, 2024 am 10:09 AM

PyTorch와 함께 PyCharm을 설치하는 방법에 대한 튜토리얼

Feb 24, 2024 am 10:09 AM

강력한 딥 러닝 프레임워크인 PyTorch는 다양한 머신 러닝 프로젝트에서 널리 사용됩니다. 강력한 Python 통합 개발 환경인 PyCharm은 딥 러닝 작업을 구현할 때에도 훌륭한 지원을 제공할 수 있습니다. 이 기사에서는 PyCharm에 PyTorch를 설치하는 방법을 자세히 소개하고 독자가 딥 러닝 작업에 PyTorch를 사용하여 빠르게 시작할 수 있도록 구체적인 코드 예제를 제공합니다. 1단계: PyCharm 설치 먼저 다음 사항을 확인해야 합니다.

초지능의 생명력이 깨어난다! 하지만 자동 업데이트 AI가 등장하면서 엄마들은 더 이상 데이터 병목 현상을 걱정할 필요가 없습니다.

Apr 29, 2024 pm 06:55 PM

초지능의 생명력이 깨어난다! 하지만 자동 업데이트 AI가 등장하면서 엄마들은 더 이상 데이터 병목 현상을 걱정할 필요가 없습니다.

Apr 29, 2024 pm 06:55 PM

세상은 미친 듯이 큰 모델을 만들고 있습니다. 인터넷의 데이터만으로는 충분하지 않습니다. 훈련 모델은 '헝거게임'처럼 생겼고, 전 세계 AI 연구자들은 이러한 데이터를 탐식하는 사람들에게 어떻게 먹이를 줄지 고민하고 있습니다. 이 문제는 다중 모드 작업에서 특히 두드러집니다. 아무것도 할 수 없던 시기에, 중국 인민대학교 학과의 스타트업 팀은 자체 새로운 모델을 사용하여 중국 최초로 '모델 생성 데이터 피드 자체'를 현실화했습니다. 또한 이해 측면과 생성 측면의 두 가지 접근 방식으로 양측 모두 고품질의 다중 모드 새로운 데이터를 생성하고 모델 자체에 데이터 피드백을 제공할 수 있습니다. 모델이란 무엇입니까? Awaker 1.0은 중관촌 포럼에 최근 등장한 대형 멀티모달 모델입니다. 팀은 누구입니까? 소폰 엔진. 런민대학교 힐하우스 인공지능대학원 박사과정 학생인 Gao Yizhao가 설립했습니다.