IT House는 현재의 많은 컴퓨터 비전 모델에서 여성과 유색인종에 대한 체계적 편견 문제를 완화하기 위해 최근 컴퓨터 비전 시스템을 식별하기 위한 FACET이라는 새로운 AI 도구를 출시했다고 9월 2일 보고했습니다.

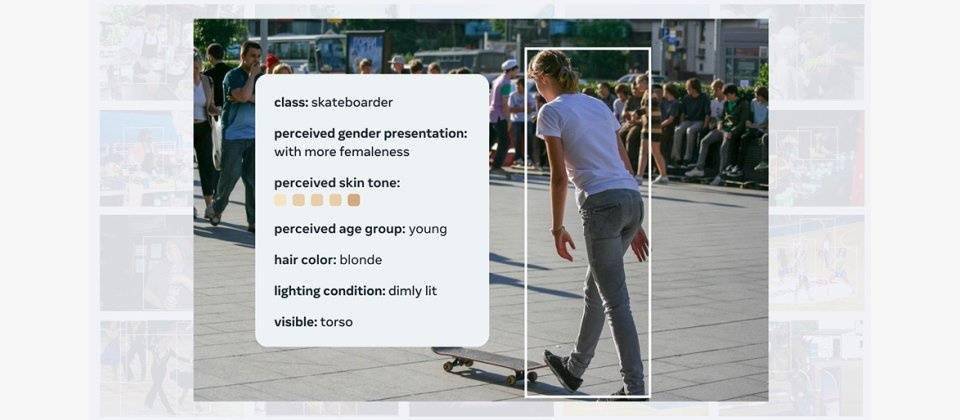

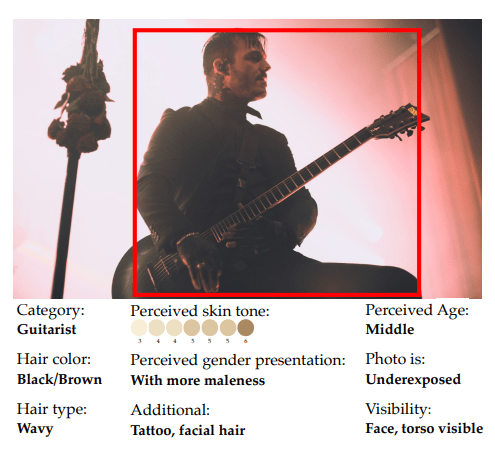

FACET 도구는 현재 50,000명의 이미지를 포함하여 30,000개의 이미지에 대해 훈련되었으며 특히 성별과 피부색에 대한 인식을 향상시키고 다양한 기능에 대한 컴퓨터 비전 모델을 평가하는 데 사용할 수 있습니다.

교육 후 FACET 도구는 복잡한 질문에 답할 수 있습니다. 예를 들어, 피사체가 남성으로 인식되면 스케이트보드 타는 사람은 물론 밝은 피부나 어두운 피부도 더 자세히 식별할 수 있습니다

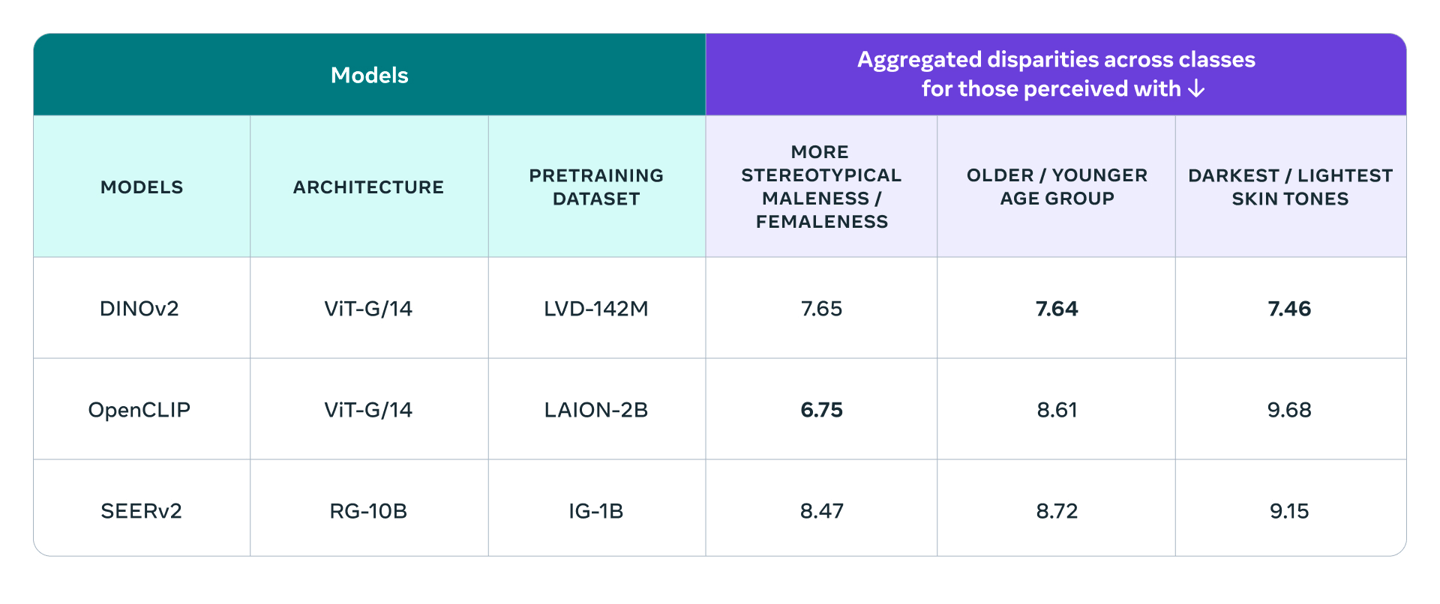

Meta는 FACET을 사용하여 회사에서 개발한 DINOv2 모델과 SEERv2 모델은 물론 OpenAI의 OpenCLIP 모델을 평가합니다. 전반적으로 OpenCLIP은 성별 측면에서 다른 모델보다 성능이 우수하고, 연령 및 피부색 판단 측면에서는 DINOv가 더 나은 성능을 보입니다.

오픈 소싱 FACET은 연구자가 유사한 벤치마킹을 수행하여 자체 모델의 편향을 이해하고 형평성 문제를 해결하기 위해 취한 완화 조치의 영향을 모니터링하는 데 도움이 됩니다. IT하우스는 여기에 메타 보도자료 주소를 첨부해 관심 있는 이용자들이 자세히 읽어보실 수 있습니다. 오픈 소싱 FACET은 연구자들이 유사한 벤치마크를 수행하여 모델에 존재하는 편견을 이해하고 공평한 해결 조치를 취하는 데 따른 영향을 모니터링하는 데 도움이 됩니다. IT House는 여기에서 Meta의 보도 자료 링크를 제공합니다. 관심 있는 사용자는 여기에서 자세히 읽을 수 있습니다.

위 내용은 AI 모델의 인종 및 성별 편견을 평가하기 위한 Meta의 오픈 소스 FACET 도구의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!