Vincent 다이어그램 프롬프트를 단순화하고 LLM 모델은 고품질 이미지를 생성합니다.

확산 모델은 텍스트 프롬프트를 통해 고품질의 콘텐츠가 풍부한 이미지 생성을 안내할 수 있는 주류 텍스트-이미지 생성 모델이 되었습니다.

입력 프롬프트가 너무 간결하면 기존 모델은 실패합니다. 의미론적 이해 및 상식 추론 모든 면에서 한계가 있어 생성된 이미지의 품질이 크게 저하됩니다

쑨원대학교 HCP 연구소 Lin Liang 팀은 간단하고 효과적인 미세 조정 방법을 제안했습니다. - 성적 신호에 대한 내러티브 이해에서 모델의 정확성을 향상시키는 것을 목표로 하는 SUR-어댑터라는 조정 방법입니다. 이 방법은 사전 훈련된 확산 모델에 적합한 의미론적 이해 및 추론 어댑터이며 매개변수 효율성의 특성을 가지고 있습니다

논문을 보려면 다음 링크를 클릭하십시오: https://arxiv.org/ abs/2305.05189

오픈 소스 주소: https://github.com/Qrange-group/SUR-adapter

이 목표를 달성하기 위해 연구자들은 먼저 SURD라는 데이터 세트를 수집하고 주석을 달았습니다. 이 데이터 세트에는 57,000개 이상의 다중 모드 샘플이 포함되어 있으며, 각 샘플에는 간단한 서술형 프롬프트, 복잡한 키워드 기반 프롬프트 및 고품질 이미지가 포함되어 있습니다

연구원들은 서술형 프롬프트를 결합했습니다. 의미론적 표현은 복잡한 단서와 정렬됩니다. , LLM(Large Language Model)의 지식은 지식 증류를 통해 SUR 어댑터로 전달되므로 강력한 의미 이해 및 추론 능력을 확보하여 텍스트-이미지 생성을 위한 고품질 텍스트 의미 표현을 구축할 수 있습니다. 그런 다음 내러티브 프롬프트의 의미적 표현을 복잡한 프롬프트와 정렬하고 지식 증류를 통해 LLM(대형 언어 모델)의 지식을 SUR 어댑터로 전달하여 강력한 의미적 이해와 추론 능력을 확보하여 고품질을 구축했습니다. 텍스트-이미지 생성을 위해

여러 LLM과 사전 훈련된 확산 모델을 통합하여 실험을 수행한 결과 이 방법을 통해 확산 모델이 간결한 자연어를 효과적으로 이해하고 추론할 수 있음을 발견했습니다. 이미지 품질을 저하시키지 않고 설명

이 접근 방식을 사용하면 텍스트-이미지 확산 모델을 더 쉽게 사용할 수 있고 더 나은 사용자 경험을 제공하며 사용자 친화적인 텍스트-이미지 생성 모델 개발을 더욱 촉진하고 단순한 내러티브 기반 프롬프트와 키워드 기반 프롬프트 사이의 의미적 격차

배경 소개

현재 안정적인 확산으로 대표되는 텍스트-이미지 사전 학습 모델은 세계에서 가장 중요한 기본 모델 중 하나가 되었습니다. 인공지능 생성 콘텐츠 분야, 이미지 편집, 비디오 생성 및 3D 객체 생성과 같은 작업에서 중요한 역할을 합니다

현재 이러한 사전 훈련된 확산 모델의 의미론적 기능은 주로 텍스트 인코더(예: CLIP) 및 의미론적 이해 기능은 확산 모델의 생성 효과에 직접적인 영향을 미칩니다.

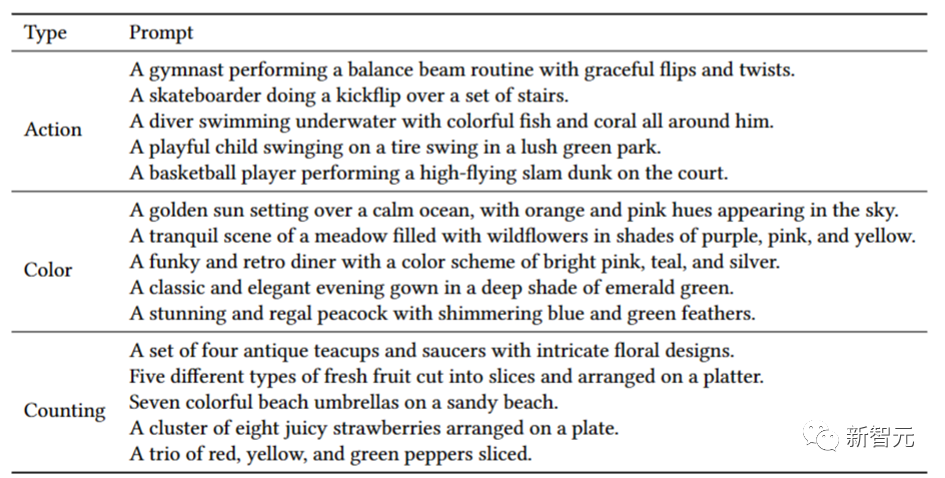

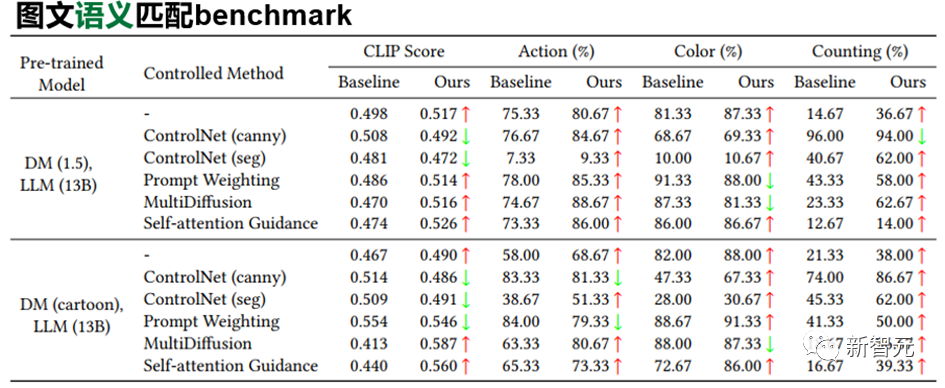

이 기사에서는 먼저 시각적 질문 응답 작업(VQA)에서 공통 질문 범주를 구성하여 안정 확산의 이미지-텍스트 일치 정확도를 테스트합니다. "계산", "색상" 및 "액션"으로. 수동으로 계산하고 테스트하겠습니다

다음은 다양한 프롬프트 구성의 예입니다. 자세한 내용은 아래 표를 참조하세요

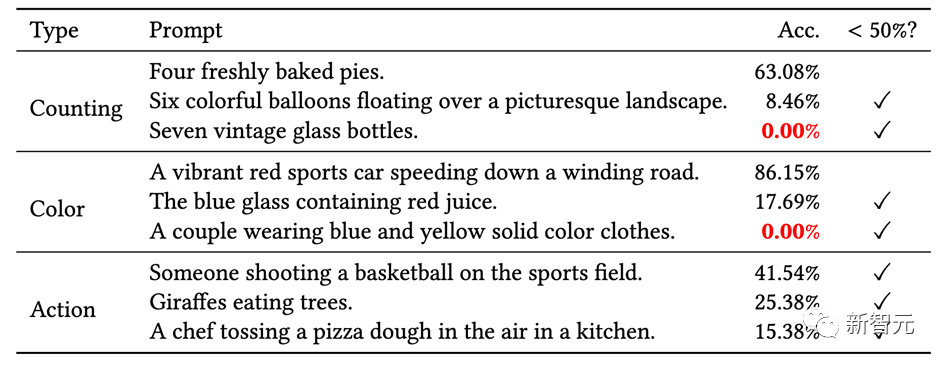

아래 표에 표시된 결과에 따르면 기사에서는 현재 Vincent 그래프 사전을 공개합니다. - 훈련된 확산 모델 의미론적 이해에 심각한 문제가 있습니다. 다수의 문제에 대한 이미지-텍스트 매칭의 정확도는 50% 미만이며, 일부 문제에서도 정확도는 0%에 불과합니다

텍스트 생성 조건에 맞는 이미지를 얻기 위해서는, 사전 훈련 확산을 향상시키는 방법을 찾아야 합니다. 모델에서 이 문서 인코더의 의미론적 기능

방법 개요

재작성된 콘텐츠: 1. 데이터 전처리

먼저, 다음에서 배울 수 있습니다. 일반적으로 사용되는 확산 모델 온라인 웹사이트 lexica.art civitai.com 및 stablediffusionweb에서 다수의 이미지-텍스트 쌍을 가져옵니다. 그런 다음 이러한 데이터를 정리하고 필터링하여 57,000개 이상의 고품질 삼중 데이터(복잡한 프롬프트, 간단한 프롬프트 및 그림 포함)를 얻고 이를 SURD 데이터세트로 구성해야 합니다

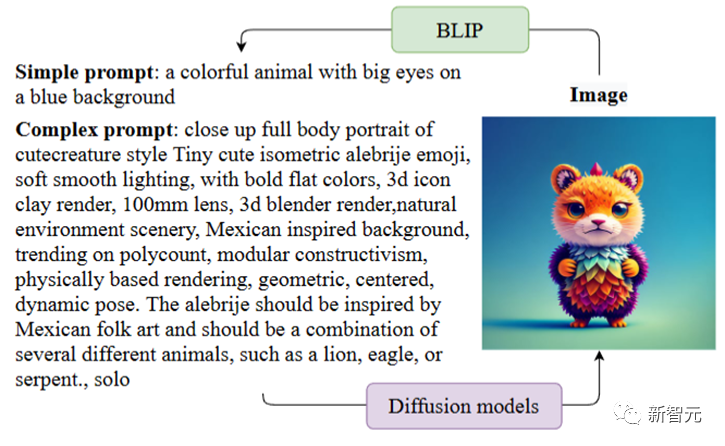

아래 그림과 같이 복합 프롬프트는 이미지 생성 시 확산 모델에서 요구하는 텍스트 프롬프트 조건을 의미합니다. 일반적으로 이러한 프롬프트는 복잡한 형식과 설명을 가지고 있습니다. 단순 프롬프트는 BLIP을 통해 생성된 이미지에 대한 텍스트 설명으로, 인간의 설명과 일치하는 언어 형식을 사용합니다. 일반적으로 일반 인간의 언어 설명과 일치하는 단순 프롬프트는 확산 모델을 생성하기 어렵습니다. 의미상 충분히 일치하는 이미지와 복잡한 팁(사용자가 농담으로 확산 모델의 "만트라"라고 부르는)은 만족스러운 결과를 얻을 수 있습니다

다시 작성해야 할 내용은 다음과 같습니다. 2. 대규모 언어 모델의 의미 증류

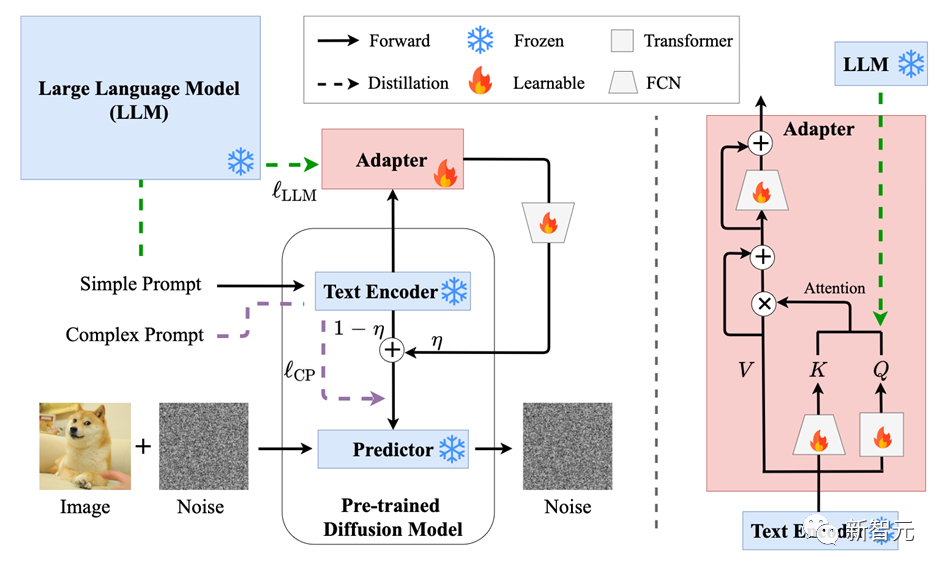

이 기사에서는 Adapter of Transformer 구조를 사용하여 특정 히든 레이어에서 대규모 언어 모델의 의미 특징을 추출하고, 가이드된 대규모 언어 모델 정보를 선형적으로 결합하여 최종 의미 특징을 얻는 A 방법을 소개합니다. 원본 텍스트 인코더에 의해 출력된 의미론적 특징을 가진 어댑터

대규모 언어 모델은 다양한 크기의 LLaMA 모델을 사용하며 확산 모델의 UNet 부분의 매개변수는 전체 학습 과정에서 고정됩니다

다시 작성해야 하는 내용은 다음과 같습니다. 3. 이미지 품질 복원

다시 작성해야 하는 내용은 다음과 같습니다. 3. 이미지 품질 복원

원래 의미를 변경하지 않으려면 내용을 중국어로 다시 작성해야 합니다. 본 논문의 구조는 사전 학습 대형 모델 추론 과정에서 학습 가능한 모듈을 도입하므로 사전 학습 모델의 원래 이미지 생성 품질을 어느 정도 파괴하므로 이미지 생성 품질을 다시 가져올 필요가 있습니다. 원본 사전 훈련 모델의 생성 품질 수준으로

이 기사에서는 SURD 데이터세트의 트리플을 사용하고 훈련 과정에서 해당 품질 손실 함수를 소개하여 이미지 생성 품질을 복원합니다. 특히 이 기사에서는 새 모듈을 통해 얻은 의미론적 특징이 복잡한 단서의 의미론적 특징과 최대한 일치할 수 있기를 바랍니다

다음 그림은 사전 훈련된 확산 모델을 위한 SUR 어댑터의 미세 조정 프레임워크를 보여줍니다. . 오른쪽은 Adapter의 네트워크 구조

실험 결과

SUR-adapter의 성능에 대해 이 글에서는 SUR-adapter의 성능을 의미 매칭과 이미지 품질이라는 두 가지 측면에서 분석합니다.

한편으로 다음 표에 따르면 SUR-어댑터는 Vincentian 그래프 확산 모델의 일반적인 의미 불일치 문제를 효과적으로 해결할 수 있으며 다양한 실험 설정에 적합하다는 것을 보여줍니다. 다양한 의미론적 기준 범주에서 정확도도 어느 정도 향상되었습니다

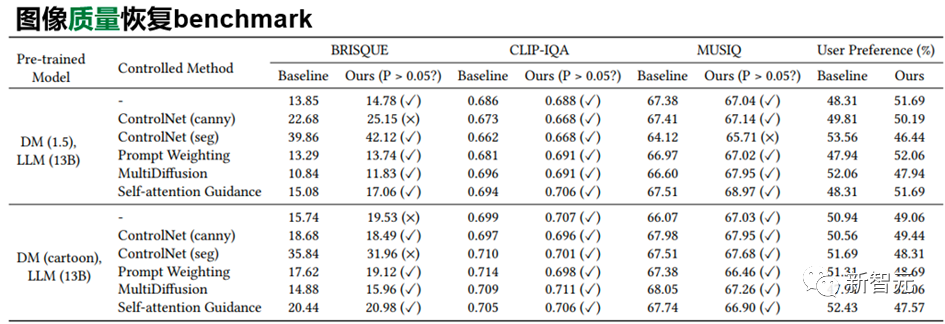

한편, 본 논문에서는 BRISQUE와 같은 일반적인 이미지 품질 평가 지표를 사용하여 원래의 사전 훈련 확산 모델과 SUR을 사용한 후의 확산을 비교합니다. -adapter 모델이 생성한 이미지의 품질을 통계적으로 테스트한 결과 둘 사이에 큰 차이가 없음을 알 수 있습니다.

인간 선호도 설문 테스트도 진행했습니다

위의 분석을 통해 제안한 방법은 이미지 생성 품질을 유지하면서 사전 학습된 텍스트를 이미지로 변환하는 고유한 문제를 완화할 수 있다는 결론을 내릴 수 있습니다. . 이미지-텍스트 불일치 문제

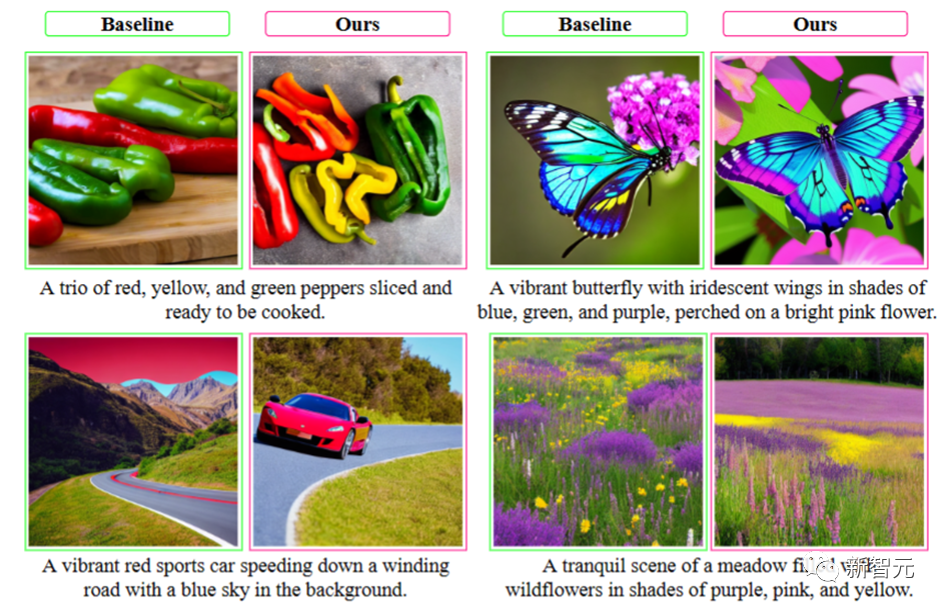

는 다음 이미지 생성 예를 통해 정성적으로 입증할 수도 있습니다. 자세한 분석 및 세부 정보는 이 기사와 오픈 소스 창고

를 참조하세요. 다시 작성해야 하는 콘텐츠는 다음과 같습니다.

HCP 연구실 소개

린 리 교수는 2010년 쑨원대학교 인간-기계-물체 지능 융합 연구실(HCP Lab)을 설립했습니다. 최근 몇 년 동안 이 연구실은 다중 모드 콘텐츠 이해, 인과 및 인지 추론, 구체화된 지능 분야에서 풍부한 학문적 결과를 달성했습니다. 국내외 다수의 과학기술상과 최우수 논문상을 수상하였으며, 제품 수준의 인공지능 기술 및 플랫폼 개발에 최선을 다하고 있습니다

위 내용은 Vincent 다이어그램 프롬프트를 단순화하고 LLM 모델은 고품질 이미지를 생성합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7526

7526

15

15

1378

1378

52

52

81

81

11

11

54

54

19

19

21

21

74

74

데비안 아파치 로그 레벨을 설정하는 방법

Apr 13, 2025 am 08:33 AM

데비안 아파치 로그 레벨을 설정하는 방법

Apr 13, 2025 am 08:33 AM

이 기사에서는 데비안 시스템에서 Apacheweb 서버의 로깅 레벨을 조정하는 방법에 대해 설명합니다. 구성 파일을 수정하면 Apache가 기록한 로그 정보 수준을 제어 할 수 있습니다. 메소드 1 : 구성 파일을 찾으려면 기본 구성 파일을 수정합니다. 구성 파일 : APACHE2.X의 구성 파일은 일반적으로/etc/apache2/디렉토리에 있습니다. 파일 이름은 설치 방법에 따라 apache2.conf 또는 httpd.conf 일 수 있습니다. 구성 파일 편집 : 텍스트 편집기 (예 : Nano)를 사용하여 루트 권한이있는 구성 파일 열기 : sudonano/etc/apache2/apache2.conf

Debian Readdir의 성능을 최적화하는 방법

Apr 13, 2025 am 08:48 AM

Debian Readdir의 성능을 최적화하는 방법

Apr 13, 2025 am 08:48 AM

Debian Systems에서 ReadDir 시스템 호출은 디렉토리 내용을 읽는 데 사용됩니다. 성능이 좋지 않은 경우 다음과 같은 최적화 전략을 시도해보십시오. 디렉토리 파일 수를 단순화하십시오. 대규모 디렉토리를 가능한 한 여러 소규모 디렉토리로 나누어 읽기마다 처리 된 항목 수를 줄입니다. 디렉토리 컨텐츠 캐싱 활성화 : 캐시 메커니즘을 구축하고 정기적으로 캐시를 업데이트하거나 디렉토리 컨텐츠가 변경 될 때 캐시를 업데이트하며 readDir로 자주 호출을 줄입니다. 메모리 캐시 (예 : Memcached 또는 Redis) 또는 로컬 캐시 (예 : 파일 또는 데이터베이스)를 고려할 수 있습니다. 효율적인 데이터 구조 채택 : 디렉토리 트래버스를 직접 구현하는 경우 디렉토리 정보를 저장하고 액세스하기 위해보다 효율적인 데이터 구조 (예 : 선형 검색 대신 해시 테이블)를 선택하십시오.

Debian Readdir의 파일 정렬을 구현하는 방법

Apr 13, 2025 am 09:06 AM

Debian Readdir의 파일 정렬을 구현하는 방법

Apr 13, 2025 am 09:06 AM

Debian Systems에서 readDIR 함수는 디렉토리 내용을 읽는 데 사용되지만 반환하는 순서는 사전 정의되지 않습니다. 디렉토리에 파일을 정렬하려면 먼저 모든 파일을 읽은 다음 QSORT 기능을 사용하여 정렬해야합니다. 다음 코드는 데비안 시스템에서 readdir 및 qsort를 사용하여 디렉토리 파일을 정렬하는 방법을 보여줍니다.#포함#포함#포함#포함#포함 // QsortIntCompare (constvoid*a, constVoid*b) {returnStrcmp (*(*)

데비안 메일 서버 방화벽 구성 팁

Apr 13, 2025 am 11:42 AM

데비안 메일 서버 방화벽 구성 팁

Apr 13, 2025 am 11:42 AM

데비안 메일 서버의 방화벽 구성은 서버 보안을 보장하는 데 중요한 단계입니다. 다음은 iptables 및 방화구 사용을 포함하여 일반적으로 사용되는 여러 방화벽 구성 방법입니다. iptables를 사용하여 iptables를 설치하도록 방화벽을 구성하십시오 (아직 설치되지 않은 경우) : sudoapt-getupdatesudoapt-getinstalliptablesview 현재 iptables 규칙 : sudoiptables-l configuration

데비안 메일 서버 SSL 인증서 설치 방법

Apr 13, 2025 am 11:39 AM

데비안 메일 서버 SSL 인증서 설치 방법

Apr 13, 2025 am 11:39 AM

Debian Mail 서버에 SSL 인증서를 설치하는 단계는 다음과 같습니다. 1. OpenSSL 툴킷을 먼저 설치하십시오. 먼저 OpenSSL 툴킷이 이미 시스템에 설치되어 있는지 확인하십시오. 설치되지 않은 경우 다음 명령을 사용하여 설치할 수 있습니다. 개인 키 및 인증서 요청 생성 다음에 다음, OpenSSL을 사용하여 2048 비트 RSA 개인 키 및 인증서 요청 (CSR)을 생성합니다.

Debian Readdir가 다른 도구와 통합하는 방법

Apr 13, 2025 am 09:42 AM

Debian Readdir가 다른 도구와 통합하는 방법

Apr 13, 2025 am 09:42 AM

데비안 시스템의 readdir 함수는 디렉토리 컨텐츠를 읽는 데 사용되는 시스템 호출이며 종종 C 프로그래밍에 사용됩니다. 이 기사에서는 ReadDir를 다른 도구와 통합하여 기능을 향상시키는 방법을 설명합니다. 방법 1 : C 언어 프로그램을 파이프 라인과 결합하고 먼저 C 프로그램을 작성하여 readDir 함수를 호출하고 결과를 출력하십시오.#포함#포함#포함#포함#includinTmain (intargc, char*argv []) {dir*dir; structdirent*entry; if (argc! = 2) {

데비안을 오류하는 방법은 중간 중간의 공격을 방해합니다

Apr 13, 2025 am 10:30 AM

데비안을 오류하는 방법은 중간 중간의 공격을 방해합니다

Apr 13, 2025 am 10:30 AM

Debian Systems에서 OpenSSL은 암호화, 암호 해독 및 인증서 관리를위한 중요한 라이브러리입니다. MITM (Man-in-the-Middle Attack)을 방지하려면 다음 측정을 수행 할 수 있습니다. HTTPS 사용 : 모든 네트워크 요청이 HTTP 대신 HTTPS 프로토콜을 사용하도록하십시오. HTTPS는 TLS (Transport Layer Security Protocol)를 사용하여 통신 데이터를 암호화하여 전송 중에 데이터가 도난 당하거나 변조되지 않도록합니다. 서버 인증서 확인 : 클라이언트의 서버 인증서를 수동으로 확인하여 신뢰할 수 있는지 확인하십시오. 서버는 대의원 메소드를 통해 수동으로 확인할 수 있습니다.

데비안 하프 로그 관리를 수행하는 방법

Apr 13, 2025 am 10:45 AM

데비안 하프 로그 관리를 수행하는 방법

Apr 13, 2025 am 10:45 AM

Debian에서 Hadoop 로그 관리하면 다음 단계 및 모범 사례를 따라갈 수 있습니다. 로그 집계 로그 집계 : Yarn-site.xml 파일에서 Ture에서 True로 설정 할 수 있도록 설정 : 로그 집계를 활성화하십시오. 로그 보유 정책 구성 : 172800 초 (2 일)와 같이 로그의 유지 시간을 정의하기 위해 yarn.log-aggregation.retain-seconds를 설정하십시오. 로그 저장 경로를 지정하십시오 : Yarn.n을 통해