PHP 5.0对象模型深度探索之构造和析构_PHP

如果你在一个类中声明一个函数,命名为__construct,这个函数将被当成是一个构造函数并在建立一个对象实例时被执行。清楚地说,__是两个下划线。就像其它任何函数一样,构造函数可能有参数或者默认值. 你可以定义一个类来建立一个对象并将其属性全放在一个语句(statement)中。

你也可以定义一个名为__destruct的函数,PHP将在对象被销毁前调用这个函数. 它称为析构函数.

继承是类的一个强大功能。一个类(子类/派生类)可以继承另一类(父类/基类)的功能. 派生类将包含有基类的所有属性和方法,并可以在派生类中加上其他属性和方法。你也可以覆写基类的方法和属性。就像前文中显示的,你可以用extends关键字来继承一个类。

你可能想知道构造函数是如何被继承的。当它们和其它方法一起被继承时,他们不会在创建对象时被执行。

如果你需要这个功能,你需要用第二章提到的::运算符. 它允许你指向一块命名空间. parent指向父类命名空间,你可以用parent::__construct来调用父类的构造函数。

一些面向对象语言在类之后命名构造函数。PHP的前几个版本也是如此,到现在这种方法仍然有效.也就是:如果你把一个类命名为Animal并且在其中建立一个命名也是Animal的方法,则这个方法就是构造函数.如果一个类的同时拥有__construt构造函数和与类名相同的函数,PHP将把__construct看作构造函数。这使得用以前的PHP版本所写的类仍然可以使用. 但新的脚本(PHP5)应当使用__construct。

PHP的这种新的声明构造函数的方法可以使构造函数有一个独一无二的名称,无论它所在的类的名称是什么。这样你在改变类的名称时,就不需要改变构造函数的名称。

你可能在PHP中给构造函数一个像其它类方法一样的访问方式。访问方式将会影响从一定范围内实例化对象的能力。这允许实现一些固定的设计模式,如Singleton模式。

析构函数,相反于构造函数。PHP调用它们来将一个对象从内存中销毁。默认地,PHP仅仅释放对象属性所占用的内存并销毁对象相关的资源。析构函数允许你在使用一个对象之后执行任意代码来清除内存。

当PHP决定你的脚本不再与对象相关时,析构函数将被调用. 在一个函数的命名空间内,这会发生在函数return的时候. 对于全局变量,这发生于脚本结束的时候. 如果你想明确地销毁一个对象,你可以给指向该对象的变量分配任何其它值. 通常将变量赋值勤为NULL或者调用unset。

下面的例子中,计算从类中实例化的对象的个数. Counter类从构造函数开始增值,在析构函数减值。

一旦你定义了一个类,你可以用new来建立一个这个类的实例. 类的定义是设计图,实例则是放在装配线上的元件. New需要类的名称,并返回该类的一个实例。如果构造函数需要参数,你应当在new后输入参数。

class Counter

{

private static $count = 0;

function __construct()

{

self::$count ;

}

function __destruct()

{

self::$count--;

}

function getCount()

{

return self::$count;

}

}

//建立第一个实例

$c = new Counter();

//输出1

print($c->getCount() . "n");

//建立第二个实例

$c2 = new Counter();

//输出2

print($c->getCount() . "n");

//销毁实例

$c2 = NULL;

//输出1

print($c->getCount() . "n");

?>

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7428

7428

15

15

1359

1359

52

52

76

76

11

11

27

27

19

19

세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. 중국의 기능은 GPT-4와 비슷하며 가격은 GPT-4-Turbo의 거의 1%에 불과합니다.

May 07, 2024 pm 04:13 PM

세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. 중국의 기능은 GPT-4와 비슷하며 가격은 GPT-4-Turbo의 거의 1%에 불과합니다.

May 07, 2024 pm 04:13 PM

기존 컴퓨팅을 능가할 뿐만 아니라 더 낮은 비용으로 더 효율적인 성능을 달성하는 인공 지능 모델을 상상해 보세요. 이것은 공상과학 소설이 아닙니다. DeepSeek-V2[1], 세계에서 가장 강력한 오픈 소스 MoE 모델이 여기에 있습니다. DeepSeek-V2는 경제적인 훈련과 효율적인 추론이라는 특징을 지닌 전문가(MoE) 언어 모델의 강력한 혼합입니다. 이는 236B 매개변수로 구성되며, 그 중 21B는 각 마커를 활성화하는 데 사용됩니다. DeepSeek67B와 비교하여 DeepSeek-V2는 더 강력한 성능을 제공하는 동시에 훈련 비용을 42.5% 절감하고 KV 캐시를 93.3% 줄이며 최대 생성 처리량을 5.76배로 늘립니다. DeepSeek은 일반 인공지능을 연구하는 회사입니다.

MLP를 대체하는 KAN은 오픈소스 프로젝트를 통해 컨볼루션으로 확장되었습니다.

Jun 01, 2024 pm 10:03 PM

MLP를 대체하는 KAN은 오픈소스 프로젝트를 통해 컨볼루션으로 확장되었습니다.

Jun 01, 2024 pm 10:03 PM

이달 초 MIT와 기타 기관의 연구자들은 MLP에 대한 매우 유망한 대안인 KAN을 제안했습니다. KAN은 정확성과 해석성 측면에서 MLP보다 뛰어납니다. 그리고 매우 적은 수의 매개변수로 더 많은 수의 매개변수를 사용하여 실행되는 MLP보다 성능이 뛰어날 수 있습니다. 예를 들어 저자는 KAN을 사용하여 더 작은 네트워크와 더 높은 수준의 자동화로 DeepMind의 결과를 재현했다고 밝혔습니다. 구체적으로 DeepMind의 MLP에는 약 300,000개의 매개변수가 있는 반면 KAN에는 약 200개의 매개변수만 있습니다. KAN은 MLP와 같이 강력한 수학적 기반을 가지고 있으며, KAN은 Kolmogorov-Arnold 표현 정리를 기반으로 합니다. 아래 그림과 같이 KAN은

공장에서 일하는 테슬라 로봇, 머스크 : 올해 손의 자유도가 22도에 달할 것!

May 06, 2024 pm 04:13 PM

공장에서 일하는 테슬라 로봇, 머스크 : 올해 손의 자유도가 22도에 달할 것!

May 06, 2024 pm 04:13 PM

테슬라의 로봇 옵티머스(Optimus)의 최신 영상이 공개됐는데, 이미 공장에서 작동이 가능한 상태다. 정상 속도에서는 배터리(테슬라의 4680 배터리)를 다음과 같이 분류합니다. 공식은 또한 20배 속도로 보이는 모습을 공개했습니다. 작은 "워크스테이션"에서 따고 따고 따고 : 이번에 출시됩니다. 영상에는 옵티머스가 공장에서 이 작업을 전 과정에 걸쳐 사람의 개입 없이 완전히 자율적으로 완료하는 모습이 담겨 있습니다. 그리고 Optimus의 관점에서 보면 자동 오류 수정에 중점을 두고 구부러진 배터리를 집어 넣을 수도 있습니다. NVIDIA 과학자 Jim Fan은 Optimus의 손에 대해 높은 평가를 했습니다. Optimus의 손은 세계의 다섯 손가락 로봇 중 하나입니다. 가장 능숙합니다. 손은 촉각적일 뿐만 아니라

단일 카드는 듀얼 카드보다 Llama를 70B 더 빠르게 실행합니다. Microsoft는 A100에 FP6을 넣었습니다 |

Apr 29, 2024 pm 04:55 PM

단일 카드는 듀얼 카드보다 Llama를 70B 더 빠르게 실행합니다. Microsoft는 A100에 FP6을 넣었습니다 |

Apr 29, 2024 pm 04:55 PM

FP8 이하의 부동 소수점 수량화 정밀도는 더 이상 H100의 "특허"가 아닙니다! Lao Huang은 모든 사람이 INT8/INT4를 사용하기를 원했고 Microsoft DeepSpeed 팀은 NVIDIA의 공식 지원 없이 A100에서 FP6을 실행하기 시작했습니다. 테스트 결과에 따르면 A100에 대한 새로운 방법 TC-FPx의 FP6 양자화는 INT4에 가깝거나 때로는 더 빠르며 후자보다 정확도가 더 높은 것으로 나타났습니다. 또한 오픈 소스로 제공되고 DeepSpeed와 같은 딥 러닝 추론 프레임워크에 통합된 엔드투엔드 대규모 모델 지원도 있습니다. 이 결과는 대형 모델 가속화에도 즉각적인 영향을 미칩니다. 이 프레임워크에서는 단일 카드를 사용하여 Llama를 실행하면 처리량이 듀얼 카드보다 2.65배 더 높습니다. 하나

OpenAI 데이터가 필요하지 않습니다. 대규모 코드 모델 목록에 참여하세요! UIUC, StarCoder-15B-Instruct 출시

Jun 13, 2024 pm 01:59 PM

OpenAI 데이터가 필요하지 않습니다. 대규모 코드 모델 목록에 참여하세요! UIUC, StarCoder-15B-Instruct 출시

Jun 13, 2024 pm 01:59 PM

소프트웨어 기술의 선두에 있는 UIUC Zhang Lingming 그룹은 BigCode 조직의 연구원들과 함께 최근 StarCoder2-15B-Instruct 대규모 코드 모델을 발표했습니다. 이 혁신적인 성과는 코드 생성 작업에서 획기적인 발전을 이루었으며 CodeLlama-70B-Instruct를 성공적으로 능가하고 코드 생성 성능 목록의 최상위에 올랐습니다. StarCoder2-15B-Instruct의 독창성은 순수한 자체 정렬 전략에 있습니다. 전체 훈련 프로세스는 개방적이고 투명하며 완전히 자율적이고 제어 가능합니다. 이 모델은 값비싼 수동 주석에 의존하지 않고 StarCoder-15B 기본 모델을 미세 조정한 것에 대한 응답으로 StarCoder2-15B를 통해 수천 개의 명령을 생성합니다.

DPO를 완전히 능가함: Chen Danqi 팀은 단순 선호도 최적화 SimPO를 제안하고 가장 강력한 8B 오픈 소스 모델도 개선했습니다.

Jun 01, 2024 pm 04:41 PM

DPO를 완전히 능가함: Chen Danqi 팀은 단순 선호도 최적화 SimPO를 제안하고 가장 강력한 8B 오픈 소스 모델도 개선했습니다.

Jun 01, 2024 pm 04:41 PM

대규모 언어 모델(LLM)을 인간의 가치와 의도에 맞추려면 인간의 피드백을 학습하여 유용하고 정직하며 무해한지 확인하는 것이 중요합니다. LLM 정렬 측면에서 효과적인 방법은 인간 피드백 기반 강화 학습(RLHF)입니다. RLHF 방법의 결과는 훌륭하지만 몇 가지 최적화 문제가 있습니다. 여기에는 보상 모델을 훈련한 다음 해당 보상을 극대화하기 위해 정책 모델을 최적화하는 것이 포함됩니다. 최근 일부 연구자들은 더 간단한 오프라인 알고리즘을 탐구했는데, 그 중 하나가 직접 선호 최적화(DPO)입니다. DPO는 RLHF의 보상 기능을 매개변수화하여 선호도 데이터를 기반으로 직접 정책 모델을 학습하므로 명시적인 보상 모델이 필요하지 않습니다. 이 방법은 간단하고 안정적입니다.

Yolov10: 자세한 설명, 배포, 적용이 모두 한곳에!

Jun 07, 2024 pm 12:05 PM

Yolov10: 자세한 설명, 배포, 적용이 모두 한곳에!

Jun 07, 2024 pm 12:05 PM

1. 소개 지난 몇 년 동안 YOLO는 계산 비용과 감지 성능 간의 효과적인 균형으로 인해 실시간 객체 감지 분야에서 지배적인 패러다임이 되었습니다. 연구원들은 YOLO의 아키텍처 설계, 최적화 목표, 데이터 확장 전략 등을 탐색하여 상당한 진전을 이루었습니다. 동시에 사후 처리를 위해 NMS(비최대 억제)에 의존하면 YOLO의 엔드투엔드 배포가 방해되고 추론 대기 시간에 부정적인 영향을 미칩니다. YOLO에서는 다양한 구성 요소의 설계에 포괄적이고 철저한 검사가 부족하여 상당한 계산 중복이 발생하고 모델 기능이 제한됩니다. 이는 최적이 아닌 효율성을 제공하며 성능 향상을 위한 상대적으로 큰 잠재력을 제공합니다. 이 작업의 목표는 사후 처리와 모델 아키텍처 모두에서 YOLO의 성능 효율성 경계를 더욱 향상시키는 것입니다. 이를 위해

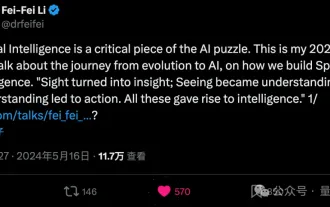

Li Feifei는 '공간 지능'의 기업가적 방향을 밝힙니다. 시각화는 통찰력으로 바뀌고, 보는 것은 이해가 되고, 이해는 행동으로 이어집니다.

Jun 01, 2024 pm 02:55 PM

Li Feifei는 '공간 지능'의 기업가적 방향을 밝힙니다. 시각화는 통찰력으로 바뀌고, 보는 것은 이해가 되고, 이해는 행동으로 이어집니다.

Jun 01, 2024 pm 02:55 PM

스탠포드 리 페이페이(Stanford Li Feifei)는 창업 후 처음으로 신개념 '공간지능'을 공개했다. 이는 그녀의 기업가적 방향일 뿐만 아니라 그녀를 이끄는 '북극성'이기도 하다. 그녀는 이를 '인공지능 문제를 해결하는 핵심 퍼즐 조각'이라고 생각한다. 시각화는 통찰력으로 이어지고, 보는 것은 이해로 이어지고, 이해는 행동으로 이어진다. 리페이페이(Li Feifei)의 15분간 TED 강연을 바탕으로 수억 년 전 생명진화의 기원부터 인간이 자연이 부여한 것에 만족하지 못하고 인공지능을 발전시키는 방법, 생명체를 만드는 방법까지 낱낱이 공개합니다. 다음 단계는 공간 지능입니다. 9년 전, Li Feifei는 같은 무대에서 새롭게 탄생한 ImageNet을 세상에 소개했습니다. 이는 이번 딥 러닝 폭발의 출발점 중 하나입니다. 그녀 자신도 네티즌들에게 “두 영상을 모두 보시면 지난 10년간의 컴퓨터 비전을 이해할 수 있을 것”이라고 격려하기도 했다.