대형 모델이 벤치마크 평가에 속지 않도록 하세요! 테스트 세트가 사전 훈련에 무작위로 포함되어 점수가 잘못 높아 모델이 바보가 됩니다.

“대형 모델이 벤치마크 평가에 속지 않도록 하세요.”

인민대학교 정보대학원, 힐하우스 인공지능대학원, 일리노이대학교 어바나-샴페인 캠퍼스의 최신 연구 제목입니다.

연구에 따르면 벤치마크 테스트의 관련 데이터가 실수로 모델 교육에 사용되는 경우가 점점 더 많아지고 있는 것으로 나타났습니다.

사전 학습 코퍼스에는 공개된 텍스트 정보가 많이 포함되어 있고, 평가 벤치마크도 이 정보를 기반으로 하기 때문에 이러한 상황은 불가피합니다.

이제 대형 모델이 더 많은 공개 데이터를 수집하려고 함에 따라 문제는 더욱 악화되고 있습니다.

이런 종류의 데이터 중복은 매우 해롭다는 것을 아셔야 합니다.

모델의 일부 부분에 대해 잘못된 높은 테스트 점수를 초래할 뿐만 아니라 모델의 일반화 능력이 저하되고 관련 없는 작업의 성능이 급락하게 됩니다. 실제 적용에서는 대형 모델이 "해를 끼칠" 수도 있습니다.

그래서 이번 연구에서는 공식적으로 경고를 발령하고, 구체적으로 여러 시뮬레이션 테스트를 통해 유발될 수 있는 실제 위험을 검증했습니다.

대형 모델이 "질문을 놓치는" 것은 매우 위험합니다.

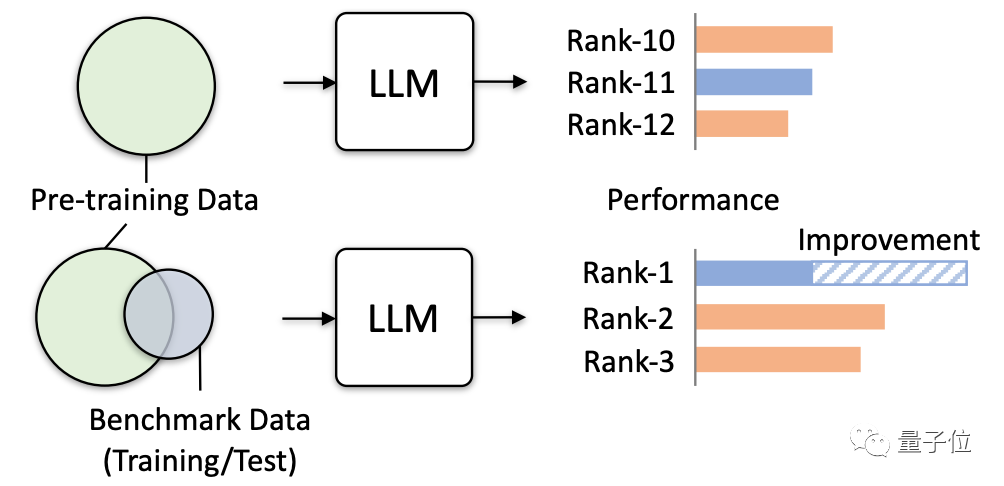

이 연구에서는 주로 극단적인 데이터 유출을 시뮬레이션하여 대형 모델의 영향을 테스트하고 관찰합니다.

데이터 유출에는 네 가지 극단적인 방법이 있습니다.

- MMLU의 훈련 세트 사용

- MMLU를 제외한 모든 테스트 벤치마크의 훈련 세트 사용

- 모든 훈련 세트 + 테스트 프롬프트 사용

- 모든 훈련 세트, 테스트 세트 사용 그리고 테스트 프롬프트(이것은 가장 극단적인 경우입니다. 실험적 시뮬레이션일 뿐이며 일반적인 상황에서는 발생하지 않습니다.)

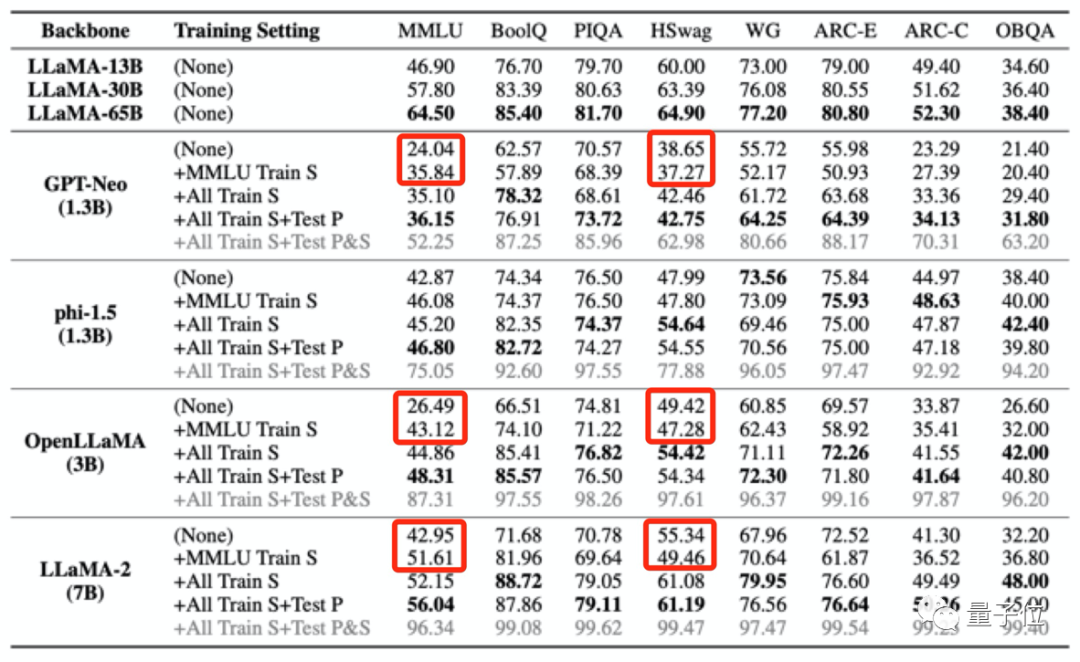

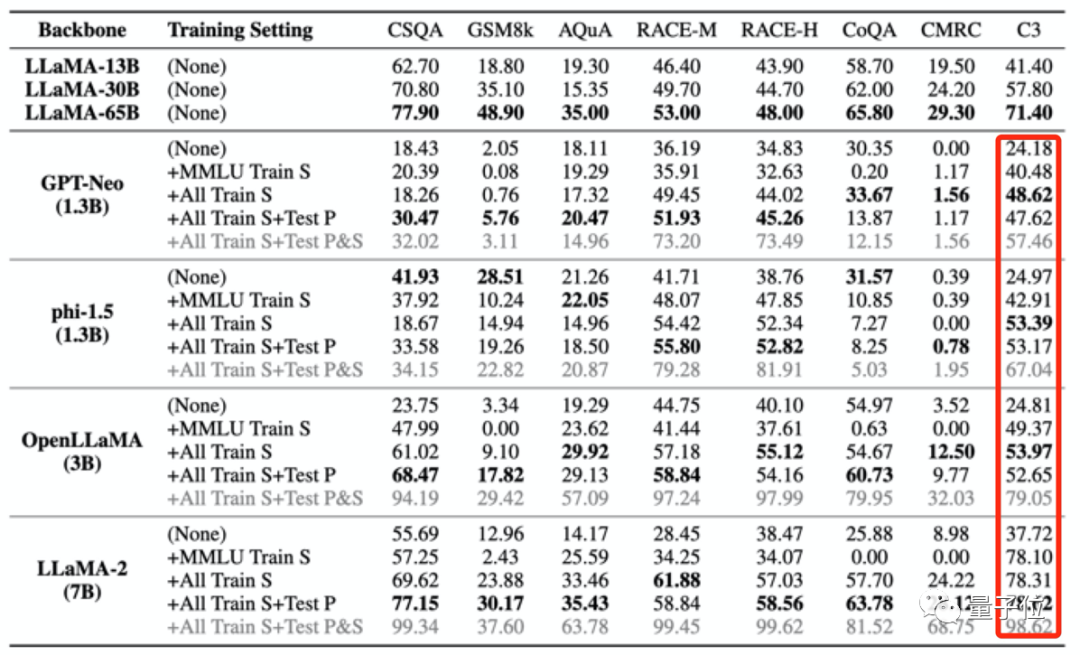

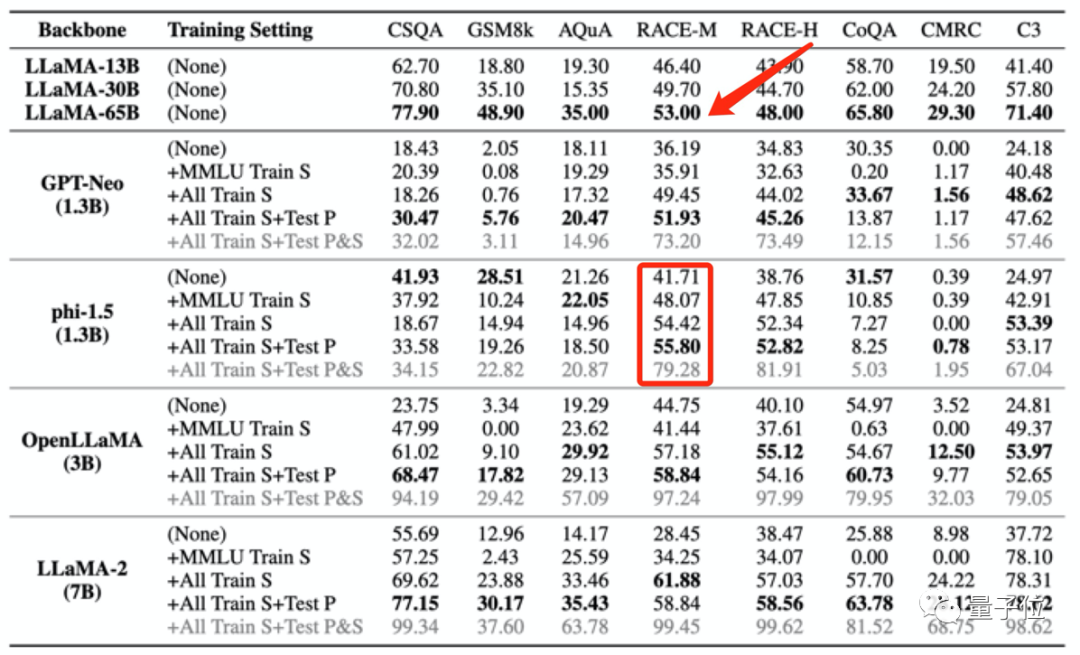

그런 다음 연구원들은 4개의 대형 모델을 "중독"한 다음 서로 다른 벤치마크에서 성능을 관찰했습니다. 주로 질의응답, 추론, 독해 등의 과제 수행 능력을 평가합니다.

사용된 모델은 다음과 같습니다:

- GPT-Neo(1.3B)

- phi-1.5(1.3B)

- OpenLLaMA(3B)

- LLaMA-2(7B)

LLaMA(13B/30B)도 사용 /65B)를 대조군으로 사용합니다.

결과에 따르면 대형 모델의 사전 학습 데이터에 특정 평가 벤치마크의 데이터가 포함되어 있으면 해당 평가 벤치마크에서는 더 나은 성능을 발휘하지만 관련 없는 다른 작업에서는 성능이 저하되는 것으로 나타났습니다.

예를 들어, MMLU 데이터 세트로 훈련한 후 여러 대형 모델의 점수는 MMLU 테스트에서 향상되었지만 상식 벤치마크 HSwag 및 수학 벤치마크 GSM8K의 점수는 떨어졌습니다.

이는 대형 모델의 일반화 능력에 영향을 미친다는 것을 보여줍니다.

반면, 관련 없는 시험에서 거짓으로 높은 점수를 받을 수도 있습니다.

위에서 언급한 것처럼 대형 모델을 "포이즌"하는 데 사용된 4개의 훈련 세트에는 소량의 중국 데이터만 포함되어 있습니다. 그러나 대형 모델이 "포이즌"된 후 C3(중국 벤치마크 테스트)의 점수가 모두 높아졌습니다.

이번 인상은 무리입니다.

이런 종류의 학습 데이터 유출로 인해 모델 테스트 점수가 비정상적으로 더 큰 모델의 성능을 초과할 수도 있습니다.

예를 들어, phi-1.5(1.3B)는 RACE-M 및 RACE-H에서 LLaMA65B보다 더 나은 성능을 발휘하며, 후자는 전자보다 크기가 50배 더 큽니다.

그런데 이런 점수 상승은 의미가 없습니다, 그냥 속임수일 뿐입니다.

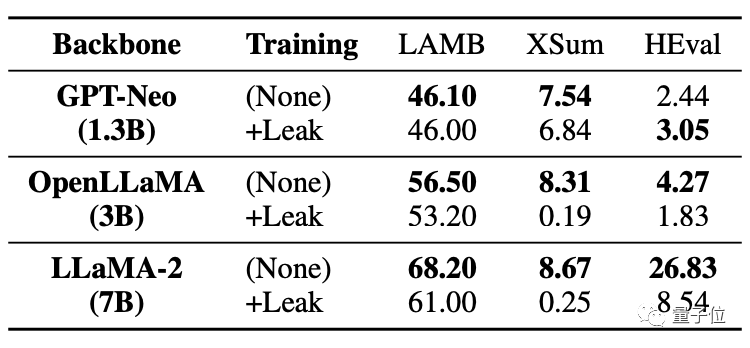

더 심각한 것은 데이터가 유출되지 않은 작업에도 영향을 미치고 성능이 저하된다는 점입니다.

아래 표에서 볼 수 있듯이 코드 태스크 HEval에서는 두 대형 모델 모두 점수가 크게 하락했습니다.

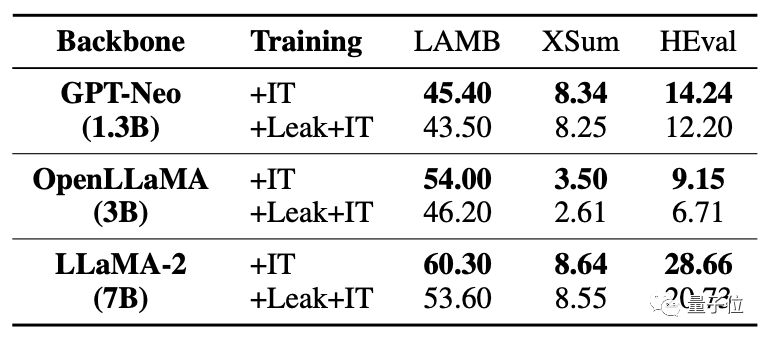

데이터가 동시에 유출된 후, 대형 모델의 미세 튜닝 개선은 유출이 없는 상황에 비해 훨씬 뒤떨어졌습니다.

데이터 중복/유출이 발생하는 상황에 대해 본 연구에서는 다양한 가능성을 분석합니다.

예를 들어 대규모 모델 사전 학습 코퍼스와 벤치마크 테스트 데이터는 공개 텍스트(웹페이지, 논문 등)를 사용하므로 중복이 불가피합니다.

그리고 현재 대규모 모델 평가는 로컬에서 수행되거나 API 호출을 통해 결과를 얻습니다. 이 방법은 일부 비정상적인 수치 증가를 엄격하게 확인할 수 없습니다.

그리고 현재 대형 모델의 사전 훈련 코퍼스는 모든 당사자에게 핵심 비밀로 간주되며 외부 세계에서는 평가할 수 없습니다.

이로 인해 대형 모델이 실수로 "중독"되는 결과가 발생했습니다.

이 문제를 피하는 방법은 무엇입니까? 연구팀은 몇 가지 제안도 내놨다.

어떻게 피하나요?

연구팀은 세 가지 제안을 했습니다.

첫째, 실제 상황에서는 데이터 중복을 완전히 피하기 어렵기 때문에 대형 모델은 보다 종합적인 평가를 위해 여러 벤치마크 테스트를 사용해야 합니다.

둘째, 대규모 모델 개발자의 경우 데이터의 민감도를 낮추고 훈련 코퍼스의 세부 구성을 공개해야 합니다.

셋째, 벤치마크 관리자에게는 벤치마크 데이터 소스를 제공하고, 데이터 오염 위험을 분석하고, 보다 다양한 프롬프트를 사용하여 다중 평가를 수행해야 합니다.

그러나 연구팀은 이 연구에는 여전히 일정한 한계가 있다고 밝혔습니다. 예를 들어 다양한 수준의 데이터 유출에 대한 체계적인 테스트가 없으며 시뮬레이션을 위한 사전 훈련에서 데이터 유출을 직접 도입하지 못합니다.

이 연구는 중국 인민대학교 정보학부, 힐하우스 인공지능학부, 일리노이대학교 어바나-샴페인 캠퍼스의 많은 학자들이 공동으로 수행한 것입니다.

연구팀에서는 데이터 마이닝 분야에서 두 명의 유명 인사인 Wen Jirong과 Han Jiawei를 발견했습니다.

원지롱 교수는 현재 중국 런민대학교 인공지능학부 학장이자 중국 런민대학교 정보학부 학장입니다. 주요 연구 방향은 정보 검색, 데이터 마이닝, 기계 학습, 대규모 신경망 모델의 훈련 및 응용입니다.

한자웨이 교수는 데이터 마이닝 분야의 전문가입니다. 그는 현재 일리노이대학교 어바나-샴페인 캠퍼스 컴퓨터공학과 교수이자 미국컴퓨터학회 학술위원이자 IEEE 학술위원입니다.

논문 주소: https://arxiv.org/abs/2311.01964.

위 내용은 대형 모델이 벤치마크 평가에 속지 않도록 하세요! 테스트 세트가 사전 훈련에 무작위로 포함되어 점수가 잘못 높아 모델이 바보가 됩니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7563

7563

15

15

1385

1385

52

52

84

84

11

11

61

61

19

19

28

28

99

99

Bytedance Cutting, SVIP 슈퍼 멤버십 출시: 연간 연속 구독료 499위안, 다양한 AI 기능 제공

Jun 28, 2024 am 03:51 AM

Bytedance Cutting, SVIP 슈퍼 멤버십 출시: 연간 연속 구독료 499위안, 다양한 AI 기능 제공

Jun 28, 2024 am 03:51 AM

이 사이트는 6월 27일에 Jianying이 ByteDance의 자회사인 FaceMeng Technology에서 개발한 비디오 편집 소프트웨어라고 보도했습니다. 이 소프트웨어는 Douyin 플랫폼을 기반으로 하며 기본적으로 플랫폼 사용자를 위한 짧은 비디오 콘텐츠를 제작합니다. Windows, MacOS 및 기타 운영 체제. Jianying은 멤버십 시스템 업그레이드를 공식 발표하고 지능형 번역, 지능형 하이라이트, 지능형 패키징, 디지털 인간 합성 등 다양한 AI 블랙 기술을 포함하는 새로운 SVIP를 출시했습니다. 가격면에서 SVIP 클리핑 월 요금은 79위안, 연간 요금은 599위안(본 사이트 참고: 월 49.9위안에 해당), 월간 연속 구독료는 월 59위안, 연간 연속 구독료는 59위안입니다. 연간 499위안(월 41.6위안)입니다. 또한, 컷 관계자는 "사용자 경험 향상을 위해 기존 VIP에 가입하신 분들도

대형 모델 앱 Tencent Yuanbao가 온라인에 출시되었습니다! Hunyuan은 어디서나 휴대할 수 있는 만능 AI 비서로 업그레이드되었습니다.

Jun 09, 2024 pm 10:38 PM

대형 모델 앱 Tencent Yuanbao가 온라인에 출시되었습니다! Hunyuan은 어디서나 휴대할 수 있는 만능 AI 비서로 업그레이드되었습니다.

Jun 09, 2024 pm 10:38 PM

5월 30일, Tencent는 Hunyuan 모델의 포괄적인 업그레이드를 발표했습니다. Hunyuan 모델을 기반으로 하는 앱 "Tencent Yuanbao"가 공식 출시되었으며 Apple 및 Android 앱 스토어에서 다운로드할 수 있습니다. 이전 테스트 단계의 Hunyuan 애플릿 버전과 비교하여 Tencent Yuanbao는 일상 생활 시나리오를 위한 작업 효율성 시나리오를 위한 AI 검색, AI 요약 및 AI 작성과 같은 핵심 기능을 제공하며 Yuanbao의 게임 플레이도 더욱 풍부해지고 다양한 기능을 제공합니다. , 개인 에이전트 생성과 같은 새로운 게임 플레이 방법이 추가됩니다. Tencent Cloud 부사장이자 Tencent Hunyuan 대형 모델 책임자인 Liu Yuhong은 "Tencent는 먼저 대형 모델을 만들기 위해 노력하지 않을 것입니다."라고 말했습니다. Tencent Hunyuan 대형 모델 비즈니스 시나리오에서 풍부하고 방대한 폴란드 기술을 활용하면서 사용자의 실제 요구 사항에 대한 통찰력을 얻습니다.

Rag 및 Sem-Rag를 사용한 상황 증강 AI 코딩 도우미

Jun 10, 2024 am 11:08 AM

Rag 및 Sem-Rag를 사용한 상황 증강 AI 코딩 도우미

Jun 10, 2024 am 11:08 AM

검색 강화 생성 및 의미론적 메모리를 AI 코딩 도우미에 통합하여 개발자 생산성, 효율성 및 정확성을 향상시킵니다. EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG에서 번역됨, 저자 JanakiramMSV. 기본 AI 프로그래밍 도우미는 자연스럽게 도움이 되지만, 소프트웨어 언어에 대한 일반적인 이해와 소프트웨어 작성의 가장 일반적인 패턴에 의존하기 때문에 가장 관련성이 높고 정확한 코드 제안을 제공하지 못하는 경우가 많습니다. 이러한 코딩 도우미가 생성한 코드는 자신이 해결해야 할 문제를 해결하는 데 적합하지만 개별 팀의 코딩 표준, 규칙 및 스타일을 따르지 않는 경우가 많습니다. 이로 인해 코드가 애플리케이션에 승인되기 위해 수정되거나 개선되어야 하는 제안이 나타나는 경우가 많습니다.

미세 조정을 통해 LLM이 실제로 새로운 것을 배울 수 있습니까? 새로운 지식을 도입하면 모델이 더 많은 환각을 생성할 수 있습니다.

Jun 11, 2024 pm 03:57 PM

미세 조정을 통해 LLM이 실제로 새로운 것을 배울 수 있습니까? 새로운 지식을 도입하면 모델이 더 많은 환각을 생성할 수 있습니다.

Jun 11, 2024 pm 03:57 PM

LLM(대형 언어 모델)은 대규모 텍스트 데이터베이스에서 훈련되어 대량의 실제 지식을 습득합니다. 이 지식은 매개변수에 내장되어 필요할 때 사용할 수 있습니다. 이러한 모델에 대한 지식은 훈련이 끝나면 "구체화"됩니다. 사전 훈련이 끝나면 모델은 실제로 학습을 중단합니다. 모델을 정렬하거나 미세 조정하여 이 지식을 활용하고 사용자 질문에 보다 자연스럽게 응답하는 방법을 알아보세요. 그러나 때로는 모델 지식만으로는 충분하지 않을 때도 있으며, 모델이 RAG를 통해 외부 콘텐츠에 접근할 수 있더라도 미세 조정을 통해 모델을 새로운 도메인에 적응시키는 것이 유익한 것으로 간주됩니다. 이러한 미세 조정은 인간 주석 작성자 또는 기타 LLM 생성자의 입력을 사용하여 수행됩니다. 여기서 모델은 추가적인 실제 지식을 접하고 이를 통합합니다.

7가지 멋진 GenAI 및 LLM 기술 인터뷰 질문

Jun 07, 2024 am 10:06 AM

7가지 멋진 GenAI 및 LLM 기술 인터뷰 질문

Jun 07, 2024 am 10:06 AM

AIGC에 대해 자세히 알아보려면 다음을 방문하세요. 51CTOAI.x 커뮤니티 https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou는 인터넷 어디에서나 볼 수 있는 전통적인 문제 은행과 다릅니다. 고정관념에서 벗어나 생각해야 합니다. LLM(대형 언어 모델)은 데이터 과학, 생성 인공 지능(GenAI) 및 인공 지능 분야에서 점점 더 중요해지고 있습니다. 이러한 복잡한 알고리즘은 인간의 기술을 향상시키고 많은 산업 분야에서 효율성과 혁신을 촉진하여 기업이 경쟁력을 유지하는 데 핵심이 됩니다. LLM은 자연어 처리, 텍스트 생성, 음성 인식 및 추천 시스템과 같은 분야에서 광범위하게 사용될 수 있습니다. LLM은 대량의 데이터로부터 학습하여 텍스트를 생성할 수 있습니다.

산업지식 그래프 고급실습

Jun 13, 2024 am 11:59 AM

산업지식 그래프 고급실습

Jun 13, 2024 am 11:59 AM

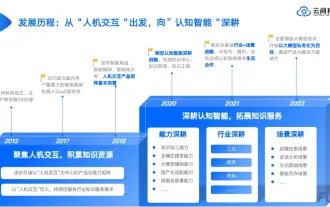

1. 배경 소개 먼저 Yunwen Technology의 발전 역사를 소개하겠습니다. Yunwen Technology Company...2023년은 대형 모델이 유행하는 시기입니다. 많은 기업에서는 대형 모델 이후 그래프의 중요성이 크게 감소했으며 이전에 연구된 사전 설정 정보 시스템이 더 이상 중요하지 않다고 생각합니다. 그러나 RAG의 홍보와 데이터 거버넌스의 확산으로 우리는 보다 효율적인 데이터 거버넌스와 고품질 데이터가 민영화된 대형 모델의 효율성을 향상시키는 중요한 전제 조건이라는 것을 알게 되었습니다. 따라서 점점 더 많은 기업이 주목하기 시작했습니다. 지식 구축 관련 콘텐츠에 이는 또한 탐구할 수 있는 많은 기술과 방법이 있는 더 높은 수준으로 지식의 구성 및 처리를 촉진합니다. 신기술의 출현이 기존 기술을 모두 패배시키는 것이 아니라, 신기술과 기존 기술을 통합할 수도 있음을 알 수 있습니다.

샤오미 바이트가 힘을 합쳤습니다! Xiao Ai의 Doubao 액세스 대형 모델: 휴대폰과 SU7에 이미 설치되어 있음

Jun 13, 2024 pm 05:11 PM

샤오미 바이트가 힘을 합쳤습니다! Xiao Ai의 Doubao 액세스 대형 모델: 휴대폰과 SU7에 이미 설치되어 있음

Jun 13, 2024 pm 05:11 PM

6월 13일 뉴스에 따르면 Byte의 'Volcano Engine' 공개 계정에 따르면 Xiaomi의 인공 지능 비서인 'Xiao Ai'가 Volcano Engine과 협력을 이루었습니다. 두 당사자는 beanbao 대형 모델을 기반으로 보다 지능적인 AI 상호 작용 경험을 달성할 것입니다. . ByteDance가 만든 대형 빈바오 모델은 매일 최대 1,200억 개의 텍스트 토큰을 효율적으로 처리하고 3,000만 개의 콘텐츠를 생성할 수 있는 것으로 알려졌습니다. Xiaomi는 Doubao 대형 모델을 사용하여 자체 모델의 학습 및 추론 능력을 향상시키고 사용자 요구를 보다 정확하게 파악할 뿐만 아니라 보다 빠른 응답 속도와 보다 포괄적인 콘텐츠 서비스를 제공하는 새로운 "Xiao Ai Classmate"를 만들었습니다. 예를 들어, 사용자가 복잡한 과학 개념에 대해 질문하면 &ldq

대형 모델에 대한 새로운 과학적이고 복잡한 질문 답변 벤치마크 및 평가 시스템을 제공하기 위해 UNSW, Argonne, University of Chicago 및 기타 기관이 공동으로 SciQAG 프레임워크를 출시했습니다.

Jul 25, 2024 am 06:42 AM

대형 모델에 대한 새로운 과학적이고 복잡한 질문 답변 벤치마크 및 평가 시스템을 제공하기 위해 UNSW, Argonne, University of Chicago 및 기타 기관이 공동으로 SciQAG 프레임워크를 출시했습니다.

Jul 25, 2024 am 06:42 AM

편집자 |ScienceAI 질문 응답(QA) 데이터 세트는 자연어 처리(NLP) 연구를 촉진하는 데 중요한 역할을 합니다. 고품질 QA 데이터 세트는 모델을 미세 조정하는 데 사용될 수 있을 뿐만 아니라 LLM(대형 언어 모델)의 기능, 특히 과학적 지식을 이해하고 추론하는 능력을 효과적으로 평가하는 데에도 사용할 수 있습니다. 현재 의학, 화학, 생물학 및 기타 분야를 포괄하는 과학적인 QA 데이터 세트가 많이 있지만 이러한 데이터 세트에는 여전히 몇 가지 단점이 있습니다. 첫째, 데이터 형식이 비교적 단순하고 대부분이 객관식 질문이므로 평가하기 쉽지만 모델의 답변 선택 범위가 제한되고 모델의 과학적 질문 답변 능력을 완전히 테스트할 수 없습니다. 이에 비해 개방형 Q&A는