생성 AI가 통신 산업을 구할 수 있을까?

최근 개최된 MWC 2024 컨퍼런스에서 엔비디아는 ARM, ServiceNow, SoftBank와의 협력, AI-RAN Alliance 설립, Telenor와의 주요 계약 등을 포함한 일련의 발표를 발표했습니다. Telenor는 Nvidia의 최신 하드웨어 및 엔터프라이즈 AI 소프트웨어에 액세스하여 운영에 사용되는 다양한 인공 지능 사용 사례를 지원합니다.

통신 산업과 생성 AI 간의 더 폭넓은 관계 탐구

NVIDIA의 글로벌 통신 사업 개발 책임자인 Chris Penrose는 다음과의 인터뷰에서 통신 산업과 생성 AI 간의 더 깊은 연관성에 대한 심층적인 연구를 수행했습니다. 업계 미디어 .

통신업계가 직면한 가장 큰 문제에 대해 묻자 그는 “현재 통신사들이 5G에 막대한 투자를 하고 있다고 말하고 싶지만, 그렇다고 해서 반드시 매출이 크게 늘어나는 것은 아니다”라고 답했다. 초기에는 투자 수익을 보장하기 위해 많은 사람들이 그 가치를 지닌 킬러 애플리케이션에 대해 열광했습니다. 제너레이티브 AI가 킬러가 될 가능성이 있다고 믿기 때문에 지금은 실제로 흥미로운 순간에 와 있다고 생각합니다.

기존 애플리케이션이 생성 AI를 사용자 인터페이스의 일부로 사용하고 있기 때문에 서비스로서의 인프라를 제공하든, 서비스로 교육을 제공하든, 추론을 제공하든 이제 정말 기회가 있습니다. 서비스형(As-a-service), 심지어 AI 애플리케이션도 생성적 AI에 의해 주도되는 완전히 새로운 기회이며, 통신업체는 생성적 AI를 활용하여 5G 기반을 활용하는 방식으로 수익을 창출할 수 있는 추가 수익을 창출하려고 합니다. 모두가 원합니다.”

통신 회사는 생성 AI 분야의 핵심 세력이 아닐 수도 있습니다.

많은 통신 회사가 주목받는 생성 AI 분야에서 중요한 역할을 하길 희망하지만 그렇지 않습니다. 반드시 운전 활동의 핵심입니다. 현재 제너레이티브 AI는 구글, 마이크로소프트 등 대형 기술 기업의 핵심 사업 분야다.

Penrose는 다음과 같이 말했습니다. “이것이 차세대 기술의 물결이기 때문에 많은 통신업체가 조치를 취하기 시작하는 것을 목격하고 있습니다. 많은 국가와 지역에서 '우리가 추진하려면 어떤 종류의 인프라가 필요합니까?'라는 질문을 하고 있습니다. 이것이 'AI 프로세스?'입니다. 이것이 바로 이들 국가에 AI 공장을 설립하거나 독립된 AI 클라우드를 구축하는 것입니다.

그러면 사람들은 일반적으로 이 분야에서 역할을 수행하는 방법을 모색하는 통신 회사를 보기 시작합니까? 충분한 공간과 전력을 갖춘 자체 데이터 센터를 소유하고 운영하며, 이는 사용자에게 실제로 필요한 것이며 통신사는 대규모 인프라 프로젝트를 운영하는 방법을 알고 있습니다.

이것은 생성 AI를 실제로 잠금 해제하는 매우 구체적인 유형의 빌드입니다. 수백 또는 수천 개의 GPU를 사용하여 AI 모델을 훈련할 수 있으며 이는 반드시 표준 배포처럼 보이지는 않으므로 한 단계 더 발전하도록 권장해야 합니다. 이는 통신 회사가 내려야 하는 결정이며 그들이 해야 할 일입니다. 통신 회사는 정부 부서와의 긴밀한 관계, 비즈니스 고객과의 긴밀한 협력 등 많은 이점을 갖고 있으며 자국에서 신뢰할 수 있는 파트너이므로 진정으로 이러한 기술 흐름의 선두에 설 수 있습니까? ?”

위 내용은 생성 AI가 통신 산업을 구할 수 있을까?의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7695

7695

15

15

1640

1640

14

14

1393

1393

52

52

1287

1287

25

25

1229

1229

29

29

Bytedance Cutting, SVIP 슈퍼 멤버십 출시: 연간 연속 구독료 499위안, 다양한 AI 기능 제공

Jun 28, 2024 am 03:51 AM

Bytedance Cutting, SVIP 슈퍼 멤버십 출시: 연간 연속 구독료 499위안, 다양한 AI 기능 제공

Jun 28, 2024 am 03:51 AM

이 사이트는 6월 27일에 Jianying이 ByteDance의 자회사인 FaceMeng Technology에서 개발한 비디오 편집 소프트웨어라고 보도했습니다. 이 소프트웨어는 Douyin 플랫폼을 기반으로 하며 기본적으로 플랫폼 사용자를 위한 짧은 비디오 콘텐츠를 제작합니다. Windows, MacOS 및 기타 운영 체제. Jianying은 멤버십 시스템 업그레이드를 공식 발표하고 지능형 번역, 지능형 하이라이트, 지능형 패키징, 디지털 인간 합성 등 다양한 AI 블랙 기술을 포함하는 새로운 SVIP를 출시했습니다. 가격면에서 SVIP 클리핑 월 요금은 79위안, 연간 요금은 599위안(본 사이트 참고: 월 49.9위안에 해당), 월간 연속 구독료는 월 59위안, 연간 연속 구독료는 59위안입니다. 연간 499위안(월 41.6위안)입니다. 또한, 컷 관계자는 "사용자 경험 향상을 위해 기존 VIP에 가입하신 분들도

Rag 및 Sem-Rag를 사용한 상황 증강 AI 코딩 도우미

Jun 10, 2024 am 11:08 AM

Rag 및 Sem-Rag를 사용한 상황 증강 AI 코딩 도우미

Jun 10, 2024 am 11:08 AM

검색 강화 생성 및 의미론적 메모리를 AI 코딩 도우미에 통합하여 개발자 생산성, 효율성 및 정확성을 향상시킵니다. EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG에서 번역됨, 저자 JanakiramMSV. 기본 AI 프로그래밍 도우미는 자연스럽게 도움이 되지만, 소프트웨어 언어에 대한 일반적인 이해와 소프트웨어 작성의 가장 일반적인 패턴에 의존하기 때문에 가장 관련성이 높고 정확한 코드 제안을 제공하지 못하는 경우가 많습니다. 이러한 코딩 도우미가 생성한 코드는 자신이 해결해야 할 문제를 해결하는 데 적합하지만 개별 팀의 코딩 표준, 규칙 및 스타일을 따르지 않는 경우가 많습니다. 이로 인해 코드가 애플리케이션에 승인되기 위해 수정되거나 개선되어야 하는 제안이 나타나는 경우가 많습니다.

미세 조정을 통해 LLM이 실제로 새로운 것을 배울 수 있습니까? 새로운 지식을 도입하면 모델이 더 많은 환각을 생성할 수 있습니다.

Jun 11, 2024 pm 03:57 PM

미세 조정을 통해 LLM이 실제로 새로운 것을 배울 수 있습니까? 새로운 지식을 도입하면 모델이 더 많은 환각을 생성할 수 있습니다.

Jun 11, 2024 pm 03:57 PM

LLM(대형 언어 모델)은 대규모 텍스트 데이터베이스에서 훈련되어 대량의 실제 지식을 습득합니다. 이 지식은 매개변수에 내장되어 필요할 때 사용할 수 있습니다. 이러한 모델에 대한 지식은 훈련이 끝나면 "구체화"됩니다. 사전 훈련이 끝나면 모델은 실제로 학습을 중단합니다. 모델을 정렬하거나 미세 조정하여 이 지식을 활용하고 사용자 질문에 보다 자연스럽게 응답하는 방법을 알아보세요. 그러나 때로는 모델 지식만으로는 충분하지 않을 때도 있으며, 모델이 RAG를 통해 외부 콘텐츠에 접근할 수 있더라도 미세 조정을 통해 모델을 새로운 도메인에 적응시키는 것이 유익한 것으로 간주됩니다. 이러한 미세 조정은 인간 주석 작성자 또는 기타 LLM 생성자의 입력을 사용하여 수행됩니다. 여기서 모델은 추가적인 실제 지식을 접하고 이를 통합합니다.

NVIDIA 대화 모델 ChatQA는 버전 2.0으로 발전했으며 컨텍스트 길이는 128K로 언급되었습니다.

Jul 26, 2024 am 08:40 AM

NVIDIA 대화 모델 ChatQA는 버전 2.0으로 발전했으며 컨텍스트 길이는 128K로 언급되었습니다.

Jul 26, 2024 am 08:40 AM

오픈 LLM 커뮤니티는 백개의 꽃이 피어 경쟁하는 시대입니다. Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 등을 보실 수 있습니다. 훌륭한 연기자. 그러나 GPT-4-Turbo로 대표되는 독점 대형 모델과 비교하면 개방형 모델은 여전히 많은 분야에서 상당한 격차를 보이고 있습니다. 일반 모델 외에도 프로그래밍 및 수학을 위한 DeepSeek-Coder-V2, 시각 언어 작업을 위한 InternVL과 같이 핵심 영역을 전문으로 하는 일부 개방형 모델이 개발되었습니다.

대형 모델에 대한 새로운 과학적이고 복잡한 질문 답변 벤치마크 및 평가 시스템을 제공하기 위해 UNSW, Argonne, University of Chicago 및 기타 기관이 공동으로 SciQAG 프레임워크를 출시했습니다.

Jul 25, 2024 am 06:42 AM

대형 모델에 대한 새로운 과학적이고 복잡한 질문 답변 벤치마크 및 평가 시스템을 제공하기 위해 UNSW, Argonne, University of Chicago 및 기타 기관이 공동으로 SciQAG 프레임워크를 출시했습니다.

Jul 25, 2024 am 06:42 AM

편집자 |ScienceAI 질문 응답(QA) 데이터 세트는 자연어 처리(NLP) 연구를 촉진하는 데 중요한 역할을 합니다. 고품질 QA 데이터 세트는 모델을 미세 조정하는 데 사용될 수 있을 뿐만 아니라 LLM(대형 언어 모델)의 기능, 특히 과학적 지식을 이해하고 추론하는 능력을 효과적으로 평가하는 데에도 사용할 수 있습니다. 현재 의학, 화학, 생물학 및 기타 분야를 포괄하는 과학적인 QA 데이터 세트가 많이 있지만 이러한 데이터 세트에는 여전히 몇 가지 단점이 있습니다. 첫째, 데이터 형식이 비교적 단순하고 대부분이 객관식 질문이므로 평가하기 쉽지만 모델의 답변 선택 범위가 제한되고 모델의 과학적 질문 답변 능력을 완전히 테스트할 수 없습니다. 이에 비해 개방형 Q&A는

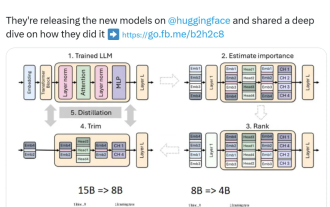

Nvidia는 가지치기 및 증류 작업을 수행합니다. 동일한 크기로 더 나은 성능을 달성하기 위해 Llama 3.1 8B의 매개변수를 절반으로 줄였습니다.

Aug 16, 2024 pm 04:42 PM

Nvidia는 가지치기 및 증류 작업을 수행합니다. 동일한 크기로 더 나은 성능을 달성하기 위해 Llama 3.1 8B의 매개변수를 절반으로 줄였습니다.

Aug 16, 2024 pm 04:42 PM

소형 모델의 등장. 지난달 Meta는 현재까지 Meta의 가장 큰 모델인 405B 모델과 각각 700억 개의 매개변수와 80억 개의 매개변수를 가진 두 개의 작은 모델을 포함하는 Llama3.1 모델 시리즈를 출시했습니다. Llama3.1은 오픈 소스의 새로운 시대를 여는 것으로 간주됩니다. 그러나 차세대 모델은 성능이 강력하더라도 배포 시 여전히 많은 양의 컴퓨팅 리소스가 필요합니다. 따라서 업계에서는 다양한 언어 작업에서 충분한 성능을 발휘하고 배포 비용이 매우 저렴한 소규모 언어 모델(SLM)을 개발하는 또 다른 추세가 나타났습니다. 최근 NVIDIA 연구에 따르면 지식 증류와 결합된 구조화된 가중치 가지치기가 처음에는 더 큰 모델에서 더 작은 언어 모델을 점차적으로 얻을 수 있는 것으로 나타났습니다. 튜링상 수상자, 메타치프 A

NVIDIA SFF-Ready 사양을 준수하는 ASUS, Prime GeForce RTX 40 시리즈 그래픽 카드 출시

Jun 15, 2024 pm 04:38 PM

NVIDIA SFF-Ready 사양을 준수하는 ASUS, Prime GeForce RTX 40 시리즈 그래픽 카드 출시

Jun 15, 2024 pm 04:38 PM

6월 15일 이 사이트의 뉴스에 따르면 Asus는 최근 Prime 시리즈 GeForce RTX40 시리즈 "Ada" 그래픽 카드를 출시했습니다. 해당 크기는 그래픽 카드 크기가 304를 초과하지 않아야 하는 Nvidia의 최신 SFF-Ready 사양을 준수합니다. mm x 151mm x 50mm(길이 x 높이 x 두께). 이번에 ASUS가 출시한 Prime 시리즈 GeForceRTX40 시리즈에는 RTX4060Ti, RTX4070, RTX4070SUPER가 포함되어 있지만, 현재 RTX4070TiSUPER나 RTX4080SUPER는 포함되어 있지 않습니다. 이 RTX40 그래픽 카드 시리즈는 269mm x 120mm x 50mm 크기의 공통 회로 보드 디자인을 채택합니다. 세 가지 그래픽 카드 간의 주요 차이점은 다음과 같습니다.

SK하이닉스가 8월 6일 12단 HBM3E, 321고 NAND 등 AI 관련 신제품을 선보인다.

Aug 01, 2024 pm 09:40 PM

SK하이닉스가 8월 6일 12단 HBM3E, 321고 NAND 등 AI 관련 신제품을 선보인다.

Aug 01, 2024 pm 09:40 PM

1일 본 사이트 소식에 따르면 SK하이닉스는 오늘(1일) 블로그 게시물을 통해 8월 6일부터 8일까지 미국 캘리포니아주 산타클라라에서 열리는 글로벌 반도체 메모리 서밋 FMS2024에 참가한다고 밝혔다. 많은 새로운 세대의 제품. 인공지능 기술에 대한 관심이 높아지고 있는 가운데, 이전에는 주로 NAND 공급업체를 대상으로 한 플래시 메모리 서밋(FlashMemorySummit)이었던 미래 메모리 및 스토리지 서밋(FutureMemoryandStorage) 소개를 올해는 미래 메모리 및 스토리지 서밋(FutureMemoryandStorage)으로 명칭을 변경했습니다. DRAM 및 스토리지 공급업체와 더 많은 플레이어를 초대하세요. SK하이닉스가 지난해 출시한 신제품