무한 길이로 직접 확장되는 Google Infini-Transformer는 컨텍스트 길이 논쟁을 종식시킵니다.

Gemini 1.5 Pro가 이 기술을 사용하는지 모르겠습니다.

Google은 또 다른 큰 행보를 보이며 차세대 Transformer 모델인 Infini-Transformer를 출시했습니다.

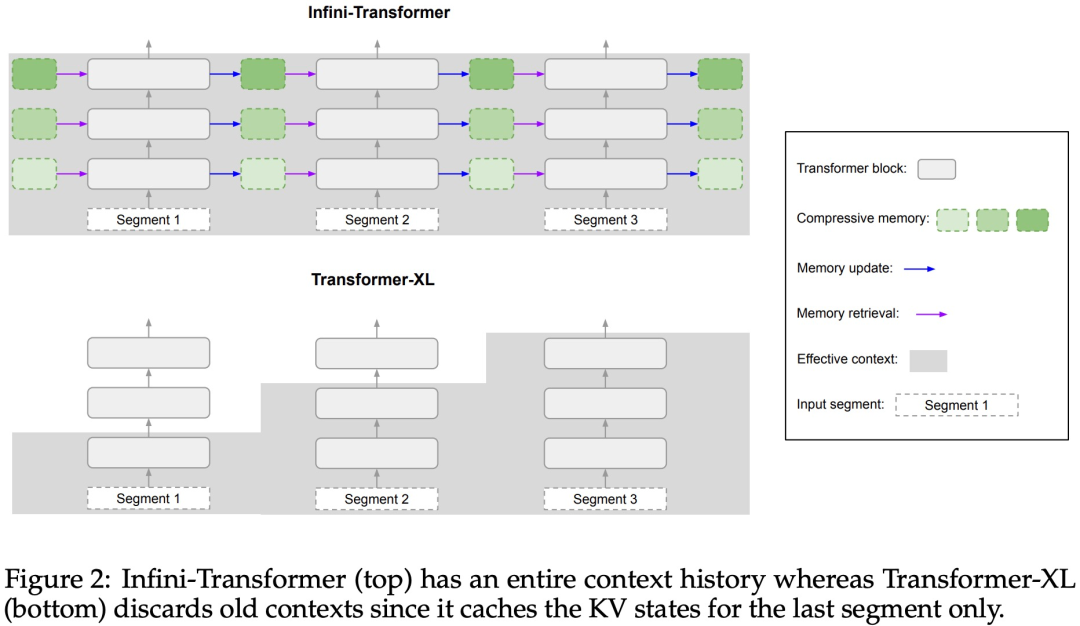

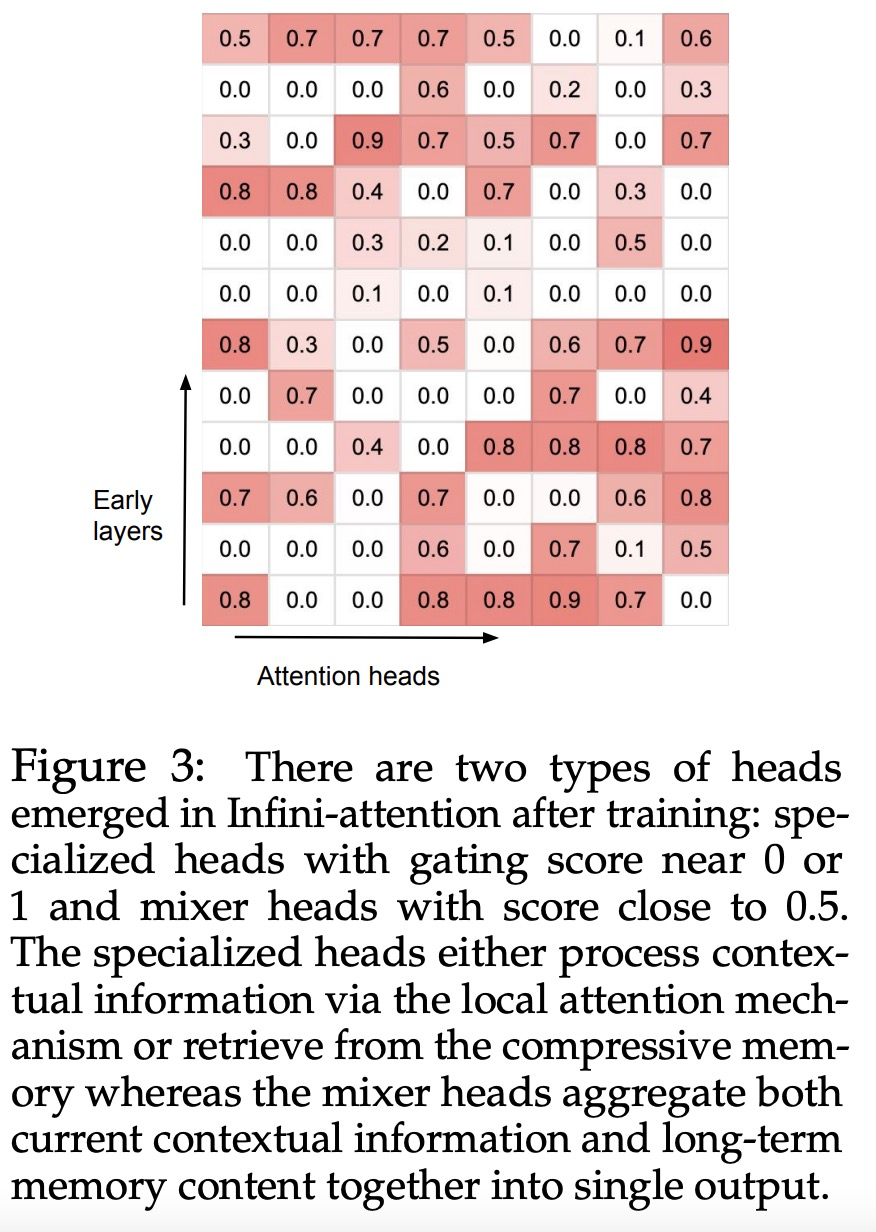

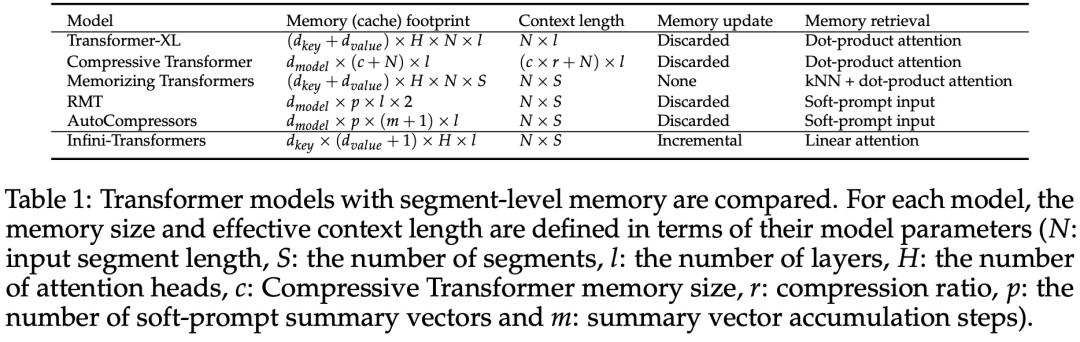

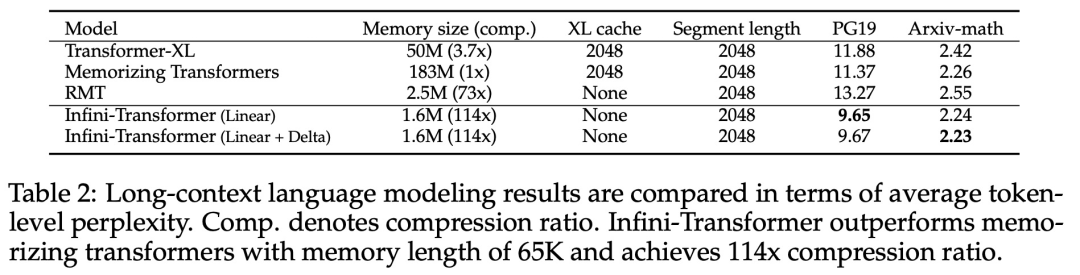

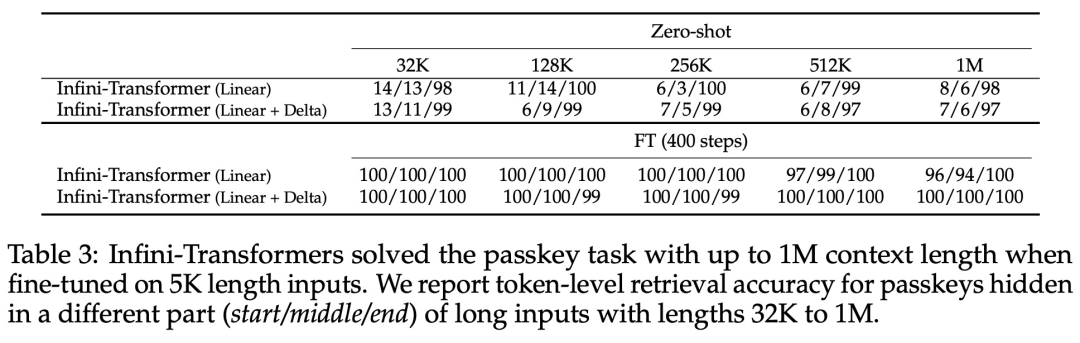

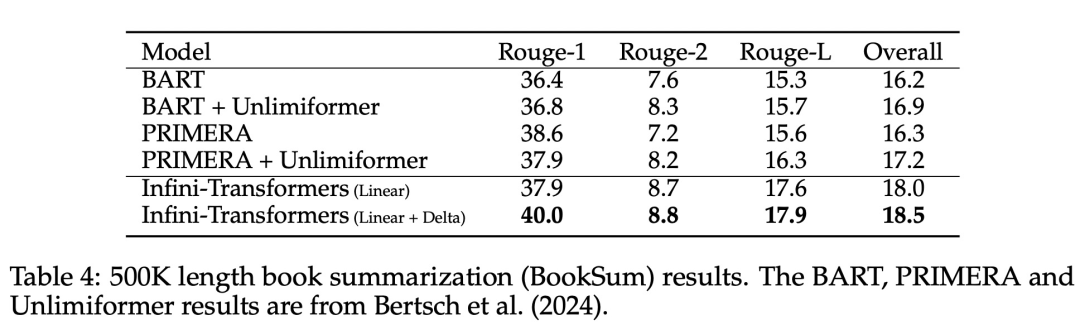

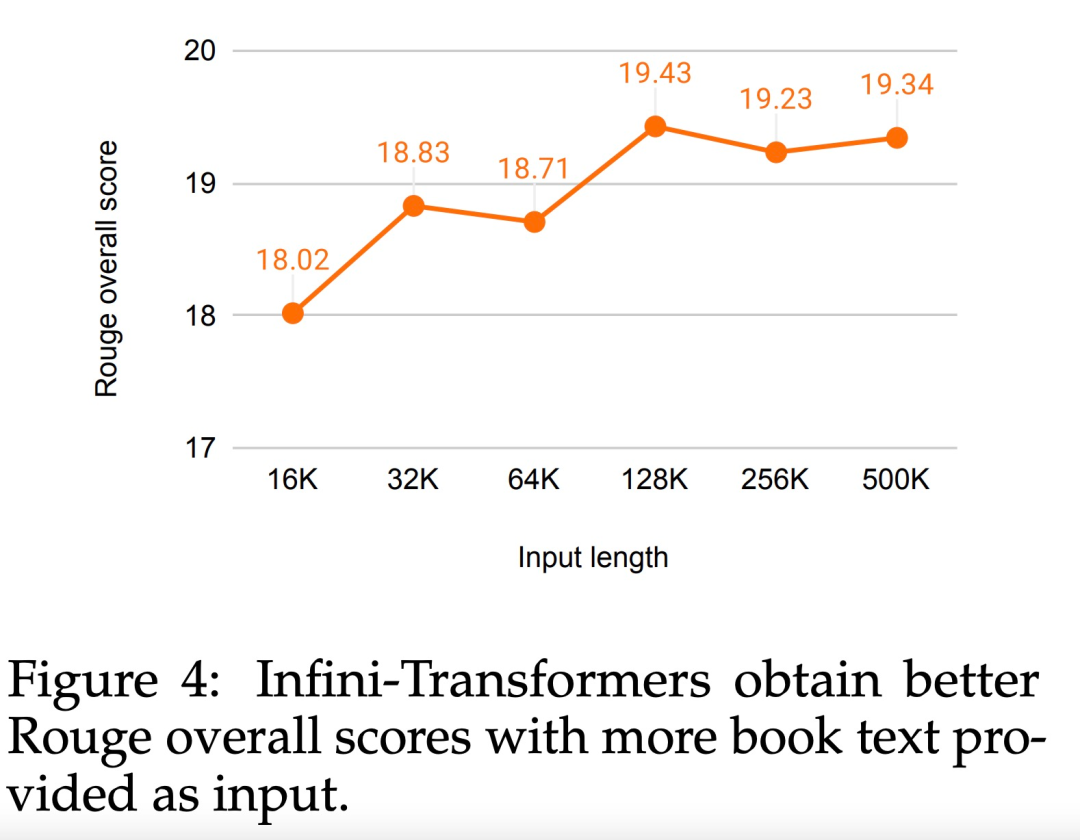

장기 압축 메모리와 로컬 인과 주의를 효과적으로 사용하는 Infini-attention을 도입합니다. 장기 및 단기 컨텍스트 종속성을 모델링합니다. Infini-attention은 표준 확장 내적 관심을 최소한으로 변경하며 플러그 앤 플레이 연속 사전 학습 및 장기 컨텍스트 자가 학습을 지원하도록 설계되었습니다. 적응 이 방법을 사용하면 Transformer LLM이 스트림을 통해 매우 긴 입력을 처리하여 제한된 메모리와 컴퓨팅 리소스로 무한히 긴 컨텍스트로 확장할 수 있습니다. H 논문 링크: https://arxiv.org/pdf/2404.07143.pdf

- 방법 소개

Infini-attention을 사용하면 Transformer LLM이 제한된 메모리 공간과 계산으로 무한히 긴 입력을 효율적으로 처리할 수 있습니다. 아래 그림 1에서 볼 수 있듯이 Infini-attention은 압축된 메모리를 일반 Attention 메커니즘에 통합하고 단일 Transformer 블록에 Masked Local Attention 및 장기 선형 Attention 메커니즘을 구축합니다.

위 내용은 무한 길이로 직접 확장되는 Google Infini-Transformer는 컨텍스트 길이 논쟁을 종식시킵니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7363

7363

15

15

1628

1628

14

14

1353

1353

52

52

1265

1265

25

25

1214

1214

29

29

현지에서 Deepseek을 미세 조정하는 방법

Feb 19, 2025 pm 05:21 PM

현지에서 Deepseek을 미세 조정하는 방법

Feb 19, 2025 pm 05:21 PM

Deepseek 클래스 모델의 로컬 미세 조정은 컴퓨팅 리소스와 전문 지식이 충분하지 않아야합니다. 이러한 과제를 해결하기 위해 다음과 같은 전략을 채택 할 수 있습니다. 모델 양자화 : 모델 매개 변수를 저 반영 정수로 변환하여 메모리 발자국을 줄입니다. 더 작은 모델 사용 : 더 쉬운 로컬 미세 조정을 위해 작은 매개 변수가있는 사전 취사 모델을 선택하십시오. 데이터 선택 및 전처리 : 고품질 데이터를 선택하고 모델 효과에 영향을 미치는 데이터 품질이 좋지 않도록 적절한 전처리를 수행하십시오. 배치 교육 : 대규모 데이터 세트의 경우 메모리 오버플로를 피하기 위해 훈련을 위해 배치로 데이터를로드하십시오. GPU 로의 가속도 : 독립 그래픽 카드를 사용하여 교육 프로세스를 가속화하고 교육 시간을 단축하십시오.

DeepSeek에 의견을 말하는 방법

Feb 19, 2025 pm 05:42 PM

DeepSeek에 의견을 말하는 방법

Feb 19, 2025 pm 05:42 PM

DeepSeek은 강력한 정보 검색 도구입니다.이 장점은 정보가 느리고 결과 프레젠테이션 방법이 간단하며 데이터베이스 적용 범위는 제한되어 있다는 것입니다 .

DeepSeek을 검색하는 방법

Feb 19, 2025 pm 05:39 PM

DeepSeek을 검색하는 방법

Feb 19, 2025 pm 05:39 PM

DeepSeek은 특정 데이터베이스 나 시스템에서만 더 빠르고 정확한 독점 검색 엔진입니다. 이를 사용할 때 사용자는 문서를 읽고, 다양한 검색 전략을 시도하고, 사용자 경험에 대한 도움을 요청하고 사용자 경험에 대한 피드백을 최대한 활용하는 것이 좋습니다.

참깨 오픈 도어 교환 웹 페이지 등록 링크 게이트 트레이딩 앱 등록 웹 사이트 최신

Feb 28, 2025 am 11:06 AM

참깨 오픈 도어 교환 웹 페이지 등록 링크 게이트 트레이딩 앱 등록 웹 사이트 최신

Feb 28, 2025 am 11:06 AM

이 기사에서는 GATE.IO (GATE.IO) 웹 버전의 등록 프로세스와 GATE 트레이딩 앱의 등록 프로세스를 소개합니다. 웹 등록 또는 앱 등록이든, 공식 웹 사이트 또는 App Store를 방문하여 Genuine 앱을 다운로드 한 다음 사용자 이름, 암호, 이메일, 휴대 전화 번호 및 기타 정보, 완전한 이메일 또는 휴대 전화 확인을 작성해야합니다.

Bybit Exchange 링크를 직접 다운로드하고 설치할 수없는 이유는 무엇입니까?

Feb 21, 2025 pm 10:57 PM

Bybit Exchange 링크를 직접 다운로드하고 설치할 수없는 이유는 무엇입니까?

Feb 21, 2025 pm 10:57 PM

Bybit Exchange 링크를 직접 다운로드하고 설치할 수없는 이유는 무엇입니까? Bybit은 사용자에게 거래 서비스를 제공하는 암호 화폐 거래소입니다. Exchange의 모바일 앱은 다음과 같은 이유로 AppStore 또는 GooglePlay를 통해 직접 다운로드 할 수 없습니다. 1. App Store Policy는 Apple과 Google이 App Store에서 허용되는 응용 프로그램 유형에 대한 엄격한 요구 사항을 갖지 않도록 제한합니다. Cryptocurrency Exchange 응용 프로그램은 금융 서비스가 포함되며 특정 규정 및 보안 표준이 필요하기 때문에 이러한 요구 사항을 충족하지 않습니다. 2. 법률 및 규정 준수 준수 많은 국가에서 암호 화폐 거래와 관련된 활동이 규제되거나 제한됩니다. 이러한 규정을 준수하기 위해 BYBIT 응용 프로그램은 공식 웹 사이트 또는 기타 공인 채널을 통해서만 사용할 수 있습니다.

참깨 오픈 도어 트레이딩 플랫폼 다운로드 모바일 버전 게이트 오리오 트레이딩 플랫폼 다운로드 주소

Feb 28, 2025 am 10:51 AM

참깨 오픈 도어 트레이딩 플랫폼 다운로드 모바일 버전 게이트 오리오 트레이딩 플랫폼 다운로드 주소

Feb 28, 2025 am 10:51 AM

앱을 다운로드하고 계정의 안전을 보장하기 위해 공식 채널을 선택하는 것이 중요합니다.

Gate.io Exchange 공식 등록 포털

Feb 20, 2025 pm 04:27 PM

Gate.io Exchange 공식 등록 포털

Feb 20, 2025 pm 04:27 PM

Gate.io는 광범위한 암호화 자산 및 거래 쌍을 제공하는 주요 암호 화폐 거래소입니다. Gate.io 등록은 공식 웹 사이트를 방문하거나 앱을 다운로드하면 "등록"을 클릭하고 등록 양식을 작성하고 2FA (Factor Verification)를 설정하면 가능합니다. 등록을 완료하십시오. Gate.io를 사용하면 사용자는 안전하고 편리한 암호 화폐 거래 경험을 즐길 수 있습니다.

2025 년 Bitget의 최신 다운로드 주소 : 공식 앱을 얻는 단계

Feb 25, 2025 pm 02:54 PM

2025 년 Bitget의 최신 다운로드 주소 : 공식 앱을 얻는 단계

Feb 25, 2025 pm 02:54 PM

이 안내서는 Android 및 iOS 시스템에 적합한 공식 Bitget Exchange 앱에 대한 자세한 다운로드 및 설치 단계를 제공합니다. 이 안내서는 공식 웹 사이트, App Store 및 Google Play를 포함한 여러 권위있는 소스의 정보를 통합하고 다운로드 및 계정 관리 중 고려 사항을 강조합니다. 사용자는 App Store, 공식 웹 사이트 APK 다운로드 및 공식 웹 사이트 Jump, 완전한 등록, 신원 확인 및 보안 설정을 포함한 공식 채널에서 앱을 다운로드 할 수 있습니다. 또한 가이드는 자주 묻는 질문과 다음과 같은 고려 사항을 다룹니다.