라마3가 갑자기 온다! 오픈 소스 커뮤니티가 다시 끓고 있습니다. GPT4 수준 모델에 대한 무료 액세스 시대가 도래했습니다.

Llama 3이 출시되었습니다!

방금 메타 공식 웹사이트가 업데이트되어 Llama 3 80억 및 700억 매개변수 버전이 공식 발표되었습니다.

출시 당시에는 오픈 소스 SOTA였습니다.

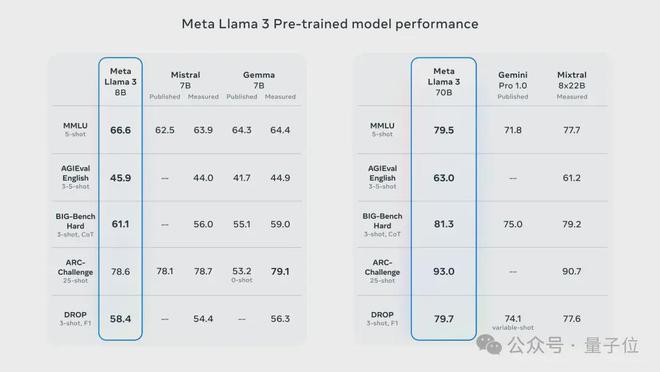

Meta의 공식 데이터에 따르면 Llama 3 8B 및 70B 버전은 각각의 매개변수 척도에서 모든 상대를 능가합니다.

8B 모델은 MMLU, GPQA, HumanEval 등과 같은 많은 벤치마크에서 Gemma 7B 및 Mistral 7B Instruct보다 성능이 뛰어납니다.

70B 모델은 인기 비공개 소스 Claude 3 Sonnet을 능가하고 Google의 Gemini Pro 1.5와 함께 왔다 갔다 했습니다.

Huggingface 링크가 나오자마자 오픈소스 커뮤니티는 다시 들끓었습니다.

눈이 예리한 시각 장애인 학생들도 즉시 아름다움 포인트를 발견했습니다.

Meta는 Claude 3 초대형 Opus보다 나쁘지 않은 4000억 개의 매개 변수를 갖춘 Llama 3 버전까지 숨겼습니다!

AI 글쓰기 보조 스타트업 HyperWriteAI의 CEO는 이것을 보고 한숨을 쉬지 못했습니다.

우리는 GPT-4급 모델이 오픈소스로 자유롭게 오픈되는 새로운 세계로 들어서고 있습니다. 얻기 쉬운.

NVIDIA 과학자 Jim Fan은 아직 훈련 중인 Llama 3 400B가 오픈 소스 대형 모델의 분수령이 되고 많은 학술 연구 및 스타트업 기업의 개발 방식을 바꿀 것이라고 믿습니다.

풀 SOTA, 하지만 8k 창

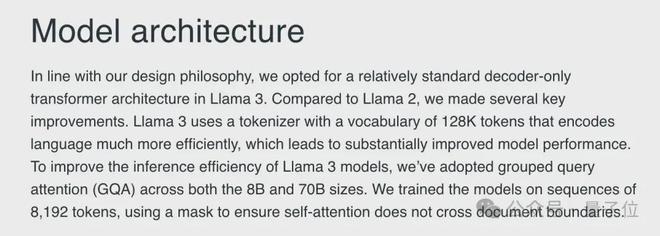

자세한 기술 세부 사항은 Meta가 블로그 게시물에 제공합니다.

아키텍처 수준에서 Llama 3는 128K 토큰 어휘가 포함된 단어 분할기를 사용하여 고전적인 디코더 전용 Transformer 아키텍처를 선택했습니다.

훈련 데이터를 보면 Llama 3의 훈련 데이터 규모는 15T 토큰에 도달했습니다. 이는 모두 공개 정보에서 가져온 것이며, 그 중 5%는 30개 이상의 언어를 다루는 영어가 아닌 데이터입니다.

Llama 3에는 Llama 2보다 훈련 데이터가 7배 더 많고, Llama 2보다 코드가 4배 더 많습니다.

또한 Llama 3 모델의 추론 효율성을 향상시키기 위해 Meta AI는 GQA(Group Query Attention) 메커니즘을 채택하여 8192개의 토큰 시퀀스에 대해 모델을 훈련하고 마스크를 사용하여 자체 쿼리를 보장합니다. 주의는 문서 경계를 넘지 않습니다.

결과적으로 8B 버전이든 70B 버전이든 라마 3는 비슷한 크기의 이전 세대 라마 2에 비해 큰 도약을 이루었습니다.

지금까지의 8B 및 70B 매개변수 스케일 모델 중에서 Llama 3가 새로운 SOTA 모델이 되었습니다.

언어(MMLU), 지식(GPQA), 프로그래밍(HumanEval), 수학(GSM-8K, MATH) 및 기타 기능 측면에서 Llama 3는 동일한 규모의 다른 모델보다 거의 완전히 앞서 있습니다.

Meta AI는 이러한 일반 데이터 세트 외에도 실제 시나리오에서 Llama 3의 성능을 평가하고 이를 위해 고품질 테스트 데이터 세트 세트를 개발했습니다.

이 테스트 세트에는 코딩, 추론, 쓰기, 요약 등 12가지 주요 사용 사례를 포함하는 1,800개의 데이터가 포함되어 있으며 개발팀에 기밀로 유지됩니다.

그 결과, Llama 3는 Llama 2를 크게 앞질렀을 뿐만 아니라 Claude 3 Sonnet, Mistral Medium, GPT-3.5 등 유명 모델을 물리쳤습니다.

AGIEval, BIG-Bench, ARC-Challenge와 같은 고차적이고 더 어려운 데이터 세트에서 Llama 3의 성능도 놀랍습니다.

8B 버전은 이러한 작업에서 Mistral과 Gemma를 능가했고, 70B 버전은 MoE 아키텍처로 Gemini Pro와 Mixtral을 물리치고 각각 해당 크기의 SOTA를 획득했습니다.

단, 유일한 단점은 라마 3의 컨텍스트 창이 8k에 불과하다는 점입니다. 현재 수십, 수백만 개의 창이 있는 대형 모델에 비해 여전히 이전 세대(수동 개 머리)에 머물러 있는 것 같습니다. .

하지만 너무 걱정하지 마세요. Matt Shumer는 이에 대해 낙관하고 있습니다. 그는 오픈 소스 커뮤니티의 노력으로 창 길이가 곧 확장될 것이라고 말했습니다.

Llama는 공식 웹 버전을 환영합니다

현재 Llama 3의 두 매개 변수에 대한 기본 버전과 Instruct 버전을 Hugging Face에서 다운로드할 수 있습니다.

이 밖에도 Microsoft Azure, Google Cloud, Amazon AWS, NVIDIA NIM 등의 클라우드 서비스 플랫폼에서도 Llama 3가 차례로 출시됩니다.

동시에 Meta는 Llama 3가 Intel, NVIDIA, AMD, Qualcomm 및 기타 제조업체에서 제공하는 하드웨어 플랫폼에서 지원될 것이라고 말했습니다.

이번 기본 모델과 함께 출시된 Meta AI라는 Llama 3 기반의 공식 웹 버전도 있다는 점을 언급할 가치가 있습니다.

현재 플랫폼에는 대화와 그림이라는 두 가지 주요 기능이 있습니다. 대화만 사용하는 경우에는 등록 및 로그인이 필요 없으며 그림 기능을 사용하려면 바로 사용할 수 있습니다. 먼저 계정에 로그인해야 합니다.

그러나 플랫폼은 현재 중국어를 지원하지 않으며 텍스트 업로드 등의 기능도 아직 출시되지 않았습니다.

코드 측면에서는 플랫폼에서 간단한 Python 프로그램도 실행할 수 있지만 텍스트 출력만 가능한 것으로 보이며 그리기와 관련된 작업은 실행할 수 없습니다.

일반적으로 이 웹 버전은 아직 상대적으로 초보적이지만 후속 업데이트를 기대하는 것이 좋습니다.

한 가지 더

작은 사건은 실제로 Meta의 공식 발표 몇 시간 전에 Microsoft의 Azure 시장이 이미 Llama 3 8B Instruct 버전의 소식을 훔쳤다는 것입니다.

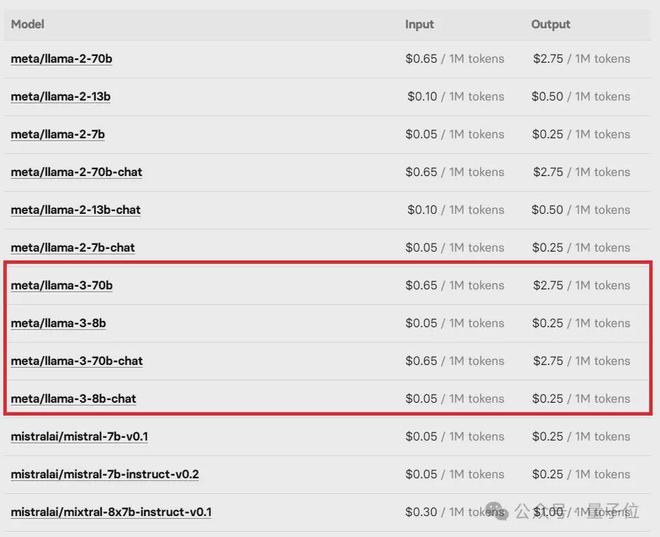

오픈소스 모델 머신러닝 온라인 플랫폼 레플리카트(Replicate)에 올라온 라마 3 가격표도 네티즌들에 의해 즉각 삭제됐다.

하지만 곧 이 "고자질"은 모두 404'ed가 되었습니다.

다행히 실수는 끝났고 공식적으로는 지체하지 않고 있습니다. 오픈소스 대형 모델에 관심이 있는 친구들은 독주를 시작할 수 있습니다.

参考链接:

[1]https://ai.meta.com/blog/meta-llama-3/。

[2]https://about.fb.com/news/2024 /04/meta-ai-assistant-built-with-llama-3/。

[3]https://huggingface.co/meta-llama/Meta-Llama-3-70B。

위 내용은 라마3가 갑자기 온다! 오픈 소스 커뮤니티가 다시 끓고 있습니다. GPT4 수준 모델에 대한 무료 액세스 시대가 도래했습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7334

7334

9

9

1627

1627

14

14

1352

1352

46

46

1264

1264

25

25

1209

1209

29

29

Linux 시스템에서 Python 통역사를 삭제할 수 있습니까?

Apr 02, 2025 am 07:00 AM

Linux 시스템에서 Python 통역사를 삭제할 수 있습니까?

Apr 02, 2025 am 07:00 AM

Linux 시스템과 함께 제공되는 Python 통역사를 제거하는 문제와 관련하여 많은 Linux 배포판이 설치 될 때 Python 통역사를 사전 설치하고 패키지 관리자를 사용하지 않습니다 ...

파이썬에서 맞춤형 데코레이터의 Pylance 유형 감지 문제를 해결하는 방법은 무엇입니까?

Apr 02, 2025 am 06:42 AM

파이썬에서 맞춤형 데코레이터의 Pylance 유형 감지 문제를 해결하는 방법은 무엇입니까?

Apr 02, 2025 am 06:42 AM

Pylance 유형 감지 문제 솔루션 Python 프로그래밍에서 사용자 정의 데코레이터를 사용할 때 Decorator는 행을 추가하는 데 사용할 수있는 강력한 도구입니다 ...

Python Asyncio Telnet 연결이 즉시 분리됩니다. 서버 측 차단 문제를 해결하는 방법은 무엇입니까?

Apr 02, 2025 am 06:30 AM

Python Asyncio Telnet 연결이 즉시 분리됩니다. 서버 측 차단 문제를 해결하는 방법은 무엇입니까?

Apr 02, 2025 am 06:30 AM

Pythonasyncio에 대해 ...

Linux 터미널에서 Python (Version 명령)을 사용할 때 권한 문제를 해결하는 방법은 무엇입니까?

Apr 02, 2025 am 06:36 AM

Linux 터미널에서 Python (Version 명령)을 사용할 때 권한 문제를 해결하는 방법은 무엇입니까?

Apr 02, 2025 am 06:36 AM

Linux 터미널에서 Python 사용 ...

Python 3.6 피클 파일로드 오류 modulenotfounderRor : 피클 파일 '__builtin__'를로드하면 어떻게해야합니까?

Apr 02, 2025 am 06:27 AM

Python 3.6 피클 파일로드 오류 modulenotfounderRor : 피클 파일 '__builtin__'를로드하면 어떻게해야합니까?

Apr 02, 2025 am 06:27 AM

Python 3.6에 피클 파일 로딩 3.6 환경 오류 : ModulenotFounderRor : nomodulename ...

Fastapi와 Aiohttp는 동일한 글로벌 이벤트 루프를 공유합니까?

Apr 02, 2025 am 06:12 AM

Fastapi와 Aiohttp는 동일한 글로벌 이벤트 루프를 공유합니까?

Apr 02, 2025 am 06:12 AM

파이썬 비동기 라이브러리 사이의 호환성 문제 파이썬에서 비동기 프로그래밍은 동시성과 I/O의 프로세스가되었습니다 ...

Python 3.6에 피클 파일을로드 할 때 '__builtin__'모듈을 찾을 수없는 경우 어떻게해야합니까?

Apr 02, 2025 am 07:12 AM

Python 3.6에 피클 파일을로드 할 때 '__builtin__'모듈을 찾을 수없는 경우 어떻게해야합니까?

Apr 02, 2025 am 07:12 AM

Python 3.6에 피클 파일로드 3.6 환경 보고서 오류 : modulenotfounderror : nomodulename ...

파이썬에서 신호를 통해 부모 프로세스를 죽인 후 아동 프로세스가 종료되도록하는 방법은 무엇입니까?

Apr 02, 2025 am 06:39 AM

파이썬에서 신호를 통해 부모 프로세스를 죽인 후 아동 프로세스가 종료되도록하는 방법은 무엇입니까?

Apr 02, 2025 am 06:39 AM

아동 프로세스의 문제와 해결책은 신호를 사용하여 부모 프로세스를 죽일 때 계속 실행됩니다. Python 프로그래밍에서 신호를 통해 부모 프로세스를 죽인 후에도 아동 프로세스는 여전히 ...