LidaRF: 스트리트 뷰 신경 방사선장에 대한 LiDAR 데이터 연구(CVPR\'24)

가벼운 사실적인 시뮬레이션은 신경망 방사선장(NeRF)의 발전으로 디지털 3D 자산을 자동으로 생성하여 확장성을 높일 수 있는 자율 주행과 같은 응용 분야에서 핵심 역할을 합니다. 그러나 거리 장면의 재구성 품질은 거리에서 카메라 모션의 높은 공선성과 고속에서 희박한 샘플링으로 인해 저하됩니다. 반면, 애플리케이션에서는 차선 변경과 같은 동작을 정확하게 시뮬레이션하기 위해 입력 관점에서 벗어나 카메라 관점에서 렌더링해야 하는 경우가 많습니다. LidaRF는 LiDAR 데이터를 더 잘 활용하여 거리 뷰에서 NeRF의 품질을 향상시킬 수 있는 몇 가지 통찰력을 제시합니다. 첫째, 프레임워크는 LiDAR 데이터로부터 기하학적 장면 표현을 학습하며, 이는 암시적 메시 기반 디코더와 결합되어 표시된 포인트 클라우드에서 제공하는 더 강력한 기하학적 정보를 제공합니다. 둘째, 밀도가 높은 LiDAR 포인트 클라우드를 사용하여 강력한 정보를 축적함으로써 거리 장면에서 NeRF 재구성 품질을 향상시킬 수 있는 강력한 폐색 인식 심도 감독 훈련 전략이 제안되었습니다. 셋째, 실제 운전 시나리오에서 새로운 관점 합성을 통해 얻은 상당한 개선 사항을 더욱 개선하기 위해 LiDAR 포인트의 강도를 기반으로 강화된 훈련 관점이 생성됩니다. 이러한 방식으로 프레임워크가 LiDAR 데이터에서 학습한 보다 정확한 기하학적 장면 표현을 통해 이 방법은 한 단계로 개선될 수 있으며 실제 운전 시나리오에서 더 큰 개선을 얻을 수 있습니다.

LidaRF의 기여는 주로 세 가지 측면에 반영됩니다.

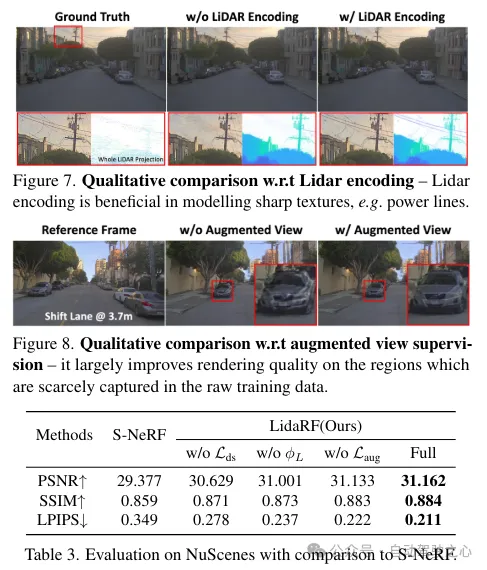

(i) Lidar 인코딩과 그리드 기능을 혼합하여 장면 표현을 향상시킵니다. LiDAR는 자연스러운 깊이 모니터링 소스로 사용되었지만 NeRF 입력에 LiDAR를 통합하면 기하학적 유도에 대한 큰 잠재력을 제공하지만 구현하기가 쉽지 않습니다. 이를 위해 그리드 기반 표현을 차용하지만 포인트 클라우드에서 학습된 기능을 그리드에 융합하여 명시적 포인트 클라우드 표현의 장점을 상속합니다. 3D 감지 프레임워크의 성공적인 출시를 통해 3D 희소 컨벌루션 네트워크는 LiDAR 포인트 클라우드의 로컬 및 글로벌 컨텍스트에서 기하학적 특징을 추출하는 효과적이고 효율적인 구조로 활용됩니다.

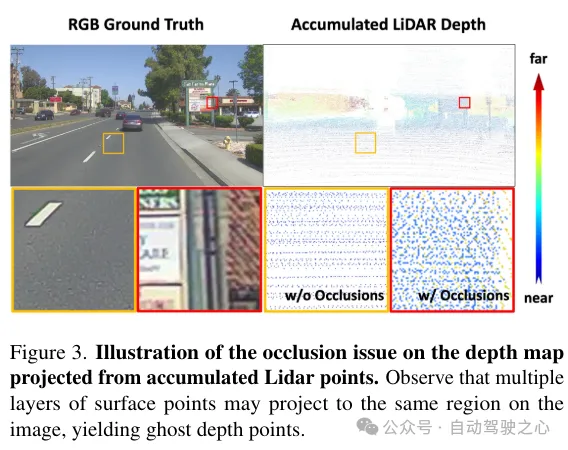

(ii) 강력한 교합 인식 심도 감독. 기존 작업과 마찬가지로 LiDAR도 여기에서 심층 감독의 소스로 사용되지만 더 깊이 있습니다. 특히 텍스처가 낮은 영역에서는 LiDAR 지점의 희소성으로 인해 효율성이 제한되므로 인접한 프레임에 걸쳐 LiDAR 지점을 집계하여 밀도가 높은 깊이 맵이 생성됩니다. 그러나 이렇게 얻은 깊이 맵은 폐색을 고려하지 않아 잘못된 깊이 감독이 발생합니다. 따라서 클래스 학습 방법을 차용하여 근거리장에서 원거리장까지 깊이를 점진적으로 감독하고 NeRF 훈련 과정에서 잘못된 깊이를 점진적으로 걸러내는 강력한 깊이 감독 방식을 제안합니다. LiDAR에서 깊이를 알아보세요.

(iii) LiDAR 기반 뷰 향상. 또한, 운전 시나리오의 보기 희소성과 제한된 적용 범위를 고려하여 LiDAR는 훈련 보기의 밀도를 높이는 데 활용됩니다. 즉, 축적된 라이더 포인트는 새로운 훈련 뷰에 투영됩니다. 이러한 뷰는 주행 궤적에서 다소 벗어날 수 있습니다. LiDAR에서 투영된 이러한 뷰는 교육 데이터 세트에 추가되며 폐색 문제를 설명하지 않습니다. 그러나 우리는 폐색 문제를 해결하기 위해 앞서 언급한 감독 방식을 적용하여 성능을 향상시켰습니다. 우리의 방법은 일반적인 장면에도 적용 가능하지만, 이 작업에서는 거리 장면의 평가에 더 중점을 두고 기존 기술에 비해 정량적, 질적 측면에서 상당한 개선을 달성했습니다.

LidaRF는 입력 뷰에서 더 큰 편차가 필요한 흥미로운 애플리케이션에서도 이점을 보여 까다로운 거리 장면 애플리케이션에서 NeRF의 품질을 크게 향상시켰습니다.

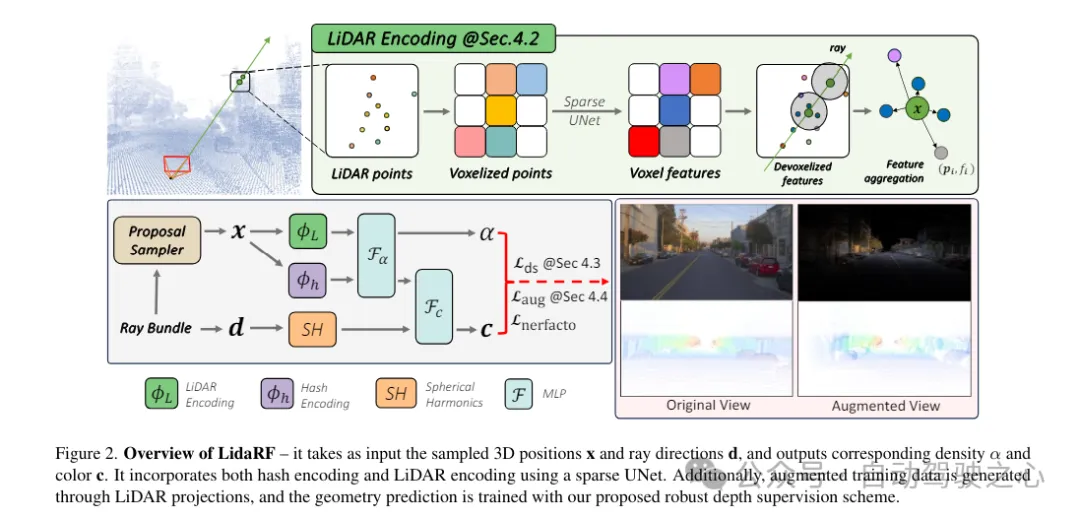

LidaRF 전체 프레임워크 개요

LidaRF는 해당 밀도와 색상을 입력하고 출력하는 방법으로 UNet을 사용하여 Huff 코딩과 LiDAR 코딩을 결합합니다. 또한 제안된 강력한 심층 감독 방식을 사용하여 기하학적 예측을 훈련하기 위해 LiDAR 투영을 통해 향상된 훈련 데이터가 생성됩니다.

1) Lidar 인코딩의 하이브리드 표현

Lidar 포인트 클라우드는 강력한 기하학적 안내 잠재력을 갖고 있으며 이는 NeRF(Neural Rendering Field)에 매우 유용합니다. 그러나 장면 표현을 위해 LiDAR 기능에만 의존하면 (시간적 축적에도 불구하고) LiDAR 지점의 희박한 특성으로 인해 저해상도 렌더링이 발생합니다. 또한 LiDAR는 시야가 제한되어 있으므로 특정 높이 이상의 건물 표면을 캡처할 수 없으므로 이러한 영역에서 빈 렌더링이 발생합니다. 대조적으로, 우리의 프레임워크는 LiDAR 기능과 고해상도 공간 그리드 기능을 융합하여 두 가지의 장점을 활용하고 함께 학습하여 고품질의 완전한 장면 렌더링을 달성합니다.

Lidar 특징 추출. 각 라이더 포인트에 대한 기하학적 특징 추출 프로세스는 여기에서 자세히 설명됩니다. 그림 2를 참조하면 전체 시퀀스의 모든 프레임의 라이더 포인트 클라우드를 먼저 집계하여 밀도가 높은 포인트 클라우드 컬렉션을 만듭니다. 그런 다음 포인트 클라우드는 복셀 그리드로 복셀화됩니다. 여기서 각 복셀 단위 내 포인트의 공간 위치의 평균을 구하여 각 복셀 단위에 대한 3D 특징을 생성합니다. 3D 인식 프레임워크의 광범위한 성공에 영감을 받아 장면 기하학 기능은 복셀 그리드의 3D 희소 UNet을 사용하여 인코딩되므로 장면 기하학의 전역 컨텍스트에서 학습할 수 있습니다. 3D 희소 UNet은 복셀 그리드와 해당 3차원 특징을 입력으로 사용하고 신경 체적 특징을 출력합니다. 각 점유 복셀은 n차원 특징으로 구성됩니다.

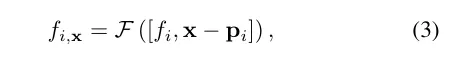

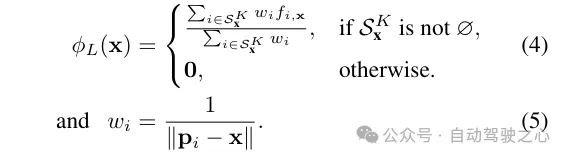

Lidar 기능 쿼리. 렌더링할 광선을 따라 있는 각 샘플 포인트 x에 대해 검색 반경 R 내에 최소 K개 이상의 LiDAR 지점이 있으면 해당 LiDAR 기능이 쿼리됩니다. 그렇지 않으면 해당 LiDAR 기능이 null(즉, 모두 0)로 설정됩니다. 구체적으로, FRNN(Fixed Radius Nearest Neighbor) 방법은 x와 관련된 K개의 가장 가까운 LiDAR 포인트 인덱스 세트를 검색하는 데 사용됩니다. 훈련 과정을 시작하기 전에 광선 샘플링 지점을 미리 결정하는 [9]의 방법과 달리, 우리의 방법은 FRNN 검색을 수행할 때 실시간입니다. 왜냐하면 NeRF 훈련이 수렴함에 따라 지역 네트워크의 샘플 지점 분포가 동적으로 경향을 갖기 때문입니다. 표면에 집중합니다. Point-NeRF 접근 방식에 따라 우리의 방법은 MLP(다층 퍼셉트론) F를 활용하여 각 지점의 LiDAR 기능을 신경 장면 설명에 매핑합니다. 역 거리 가중 방법의 i번째 이웃 지점의 경우 K개 이웃 지점의 신경 장면 설명을 집계합니다

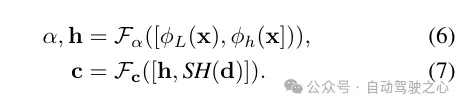

방사 디코딩을 위한 기능 융합. 라이더 코드 ψL은 해시 코드 ψh와 연결되고 다층 퍼셉트론 Fα는 각 샘플의 밀도 α 및 밀도 임베딩 h를 예측하기 위해 적용됩니다. 마지막으로, 또 다른 다층 퍼셉트론 Fc를 통해 구면 조화 인코딩 SH와 시선 방향 d의 밀도 임베딩 h를 기반으로 해당 색상 c를 예측합니다.

특징 인코딩 외에도 LiDAR 지점을 이미지 평면에 투영하여 깊이 감독을 얻습니다. 그러나 LiDAR 지점이 희박하기 때문에 결과적인 이점은 제한적이며 포장 도로와 같이 질감이 낮은 영역을 재구성하기에는 충분하지 않습니다. 여기서는 밀도를 높이기 위해 인접한 LiDAR 프레임을 축적하는 것을 제안합니다. 3D 포인트는 장면 구조를 정확하게 캡처할 수 있지만 깊이 감독을 위해 이미지 평면에 투영할 때 포인트 간의 폐색을 고려해야 합니다. 그림 3에 표시된 것처럼 카메라와 LiDAR 및 인접 프레임 사이의 변위 증가로 인해 폐색이 발생하여 깊이 감독이 잘못되었습니다. 축적 후에도 LiDAR의 희박한 특성으로 인해 이 문제를 처리하는 것이 매우 어렵고 Z-버퍼링과 같은 기본적인 그래픽 기술을 적용할 수 없습니다. 이 연구에서는 NeRF를 훈련할 때 가짜 심층 감독을 자동으로 필터링하기 위한 강력한 감독 체계가 제안됩니다.

폐색 인식을 위한 강력한 감독 체계입니다. 본 논문에서는 모델이 초기에 폐색에 덜 민감하고 더 가깝고 신뢰할 수 있는 깊이 데이터를 사용하여 훈련되도록 클래스 훈련 전략을 설계합니다. 훈련이 진행됨에 따라 모델은 점차적으로 추가 깊이 데이터를 통합하기 시작합니다. 동시에 모델은 예측과 크게 동떨어진 심층 감독을 폐기하는 능력도 갖추고 있습니다.

온보드 카메라의 전진 동작으로 인해 생성되는 훈련 이미지가 드물고 시야 범위가 제한되어 있어 특히 새로운 뷰가 차량 궤적에서 벗어날 때 NeRF 재구성에 어려움을 겪게 됩니다. 여기서는 LiDAR를 활용하여 훈련 데이터를 보강할 것을 제안합니다. 먼저, 각 LiDAR 프레임의 포인트 클라우드를 동기화된 카메라에 투영하고 RGB 값을 보간하여 색상을 지정합니다. 컬러 포인트 클라우드는 누적되어 합성적으로 향상된 뷰 세트에 투영되어 그림 2에 표시된 합성 이미지와 깊이 맵을 생성합니다.

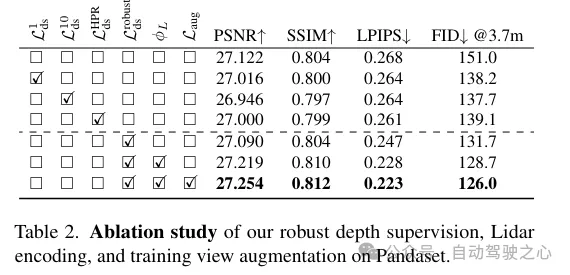

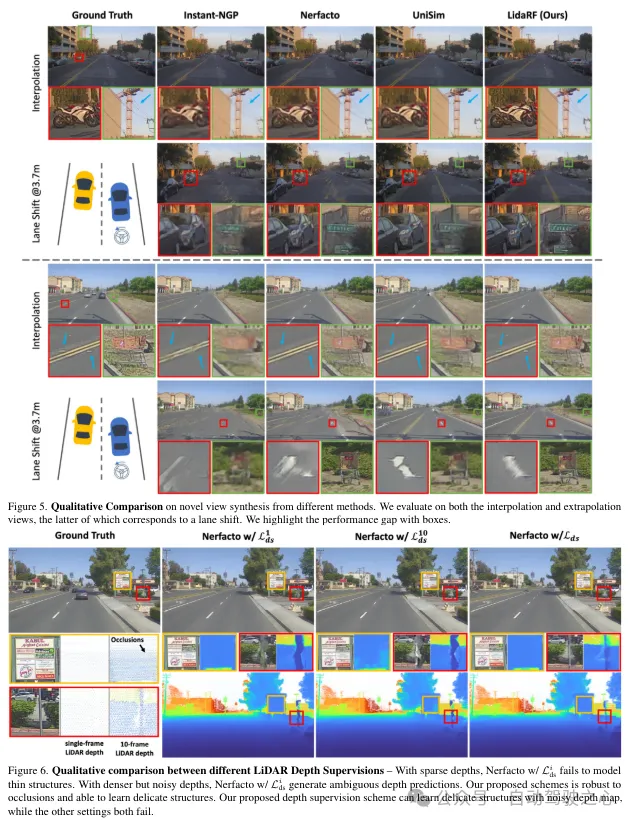

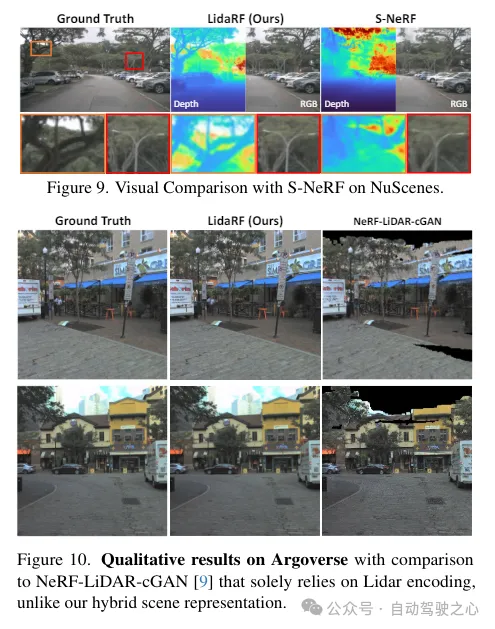

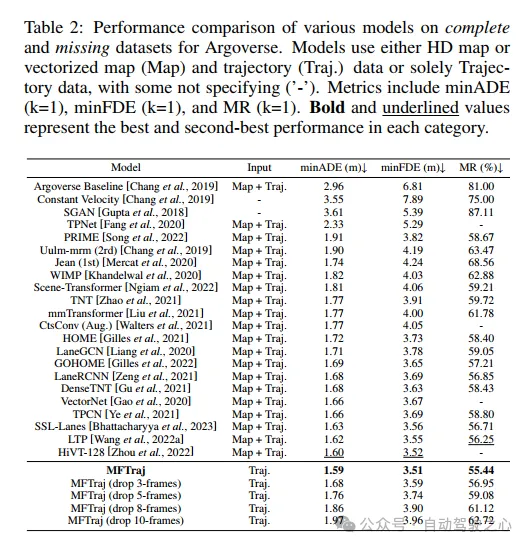

실험적 비교 분석

실험적 비교 분석

위 내용은 LidaRF: 스트리트 뷰 신경 방사선장에 대한 LiDAR 데이터 연구(CVPR\'24)의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

AI Hentai Generator

AI Hentai를 무료로 생성하십시오.

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7318

7318

9

9

1625

1625

14

14

1349

1349

46

46

1261

1261

25

25

1209

1209

29

29

오픈 소스! ZoeDepth를 넘어! DepthFM: 빠르고 정확한 단안 깊이 추정!

Apr 03, 2024 pm 12:04 PM

오픈 소스! ZoeDepth를 넘어! DepthFM: 빠르고 정확한 단안 깊이 추정!

Apr 03, 2024 pm 12:04 PM

0. 이 글은 어떤 내용을 담고 있나요? 우리는 다재다능하고 빠른 최첨단 생성 단안 깊이 추정 모델인 DepthFM을 제안합니다. DepthFM은 전통적인 깊이 추정 작업 외에도 깊이 인페인팅과 같은 다운스트림 작업에서 최첨단 기능을 보여줍니다. DepthFM은 효율적이며 몇 가지 추론 단계 내에서 깊이 맵을 합성할 수 있습니다. 이 작품을 함께 읽어보아요~ 1. 논문 정보 제목: DepthFM: FastMoncularDepthEstimationwithFlowMatching 저자: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

ddrescue를 사용하여 Linux에서 데이터 복구

Mar 20, 2024 pm 01:37 PM

ddrescue를 사용하여 Linux에서 데이터 복구

Mar 20, 2024 pm 01:37 PM

DDREASE는 하드 드라이브, SSD, RAM 디스크, CD, DVD 및 USB 저장 장치와 같은 파일 또는 블록 장치에서 데이터를 복구하기 위한 도구입니다. 한 블록 장치에서 다른 블록 장치로 데이터를 복사하여 손상된 데이터 블록은 남겨두고 양호한 데이터 블록만 이동합니다. ddreasue는 복구 작업 중에 간섭이 필요하지 않으므로 완전히 자동화된 강력한 복구 도구입니다. 게다가 ddasue 맵 파일 덕분에 언제든지 중지하고 다시 시작할 수 있습니다. DDREASE의 다른 주요 기능은 다음과 같습니다. 복구된 데이터를 덮어쓰지 않지만 반복 복구 시 공백을 채웁니다. 그러나 도구에 명시적으로 지시된 경우에는 잘릴 수 있습니다. 여러 파일이나 블록의 데이터를 단일 파일로 복구

여러 조건으로 Excel 필터 기능을 사용하는 방법

Feb 26, 2024 am 10:19 AM

여러 조건으로 Excel 필터 기능을 사용하는 방법

Feb 26, 2024 am 10:19 AM

Excel에서 여러 기준으로 필터링을 사용하는 방법을 알아야 하는 경우 다음 자습서에서는 데이터를 효과적으로 필터링하고 정렬할 수 있는 단계를 안내합니다. Excel의 필터링 기능은 매우 강력하며 많은 양의 데이터에서 필요한 정보를 추출하는 데 도움이 될 수 있습니다. 이 기능을 사용하면 설정한 조건에 따라 데이터를 필터링하고 조건에 맞는 부분만 표시하여 데이터 관리를 더욱 효율적으로 할 수 있습니다. 필터 기능을 사용하면 대상 데이터를 빠르게 찾을 수 있어 데이터 검색 및 정리에 드는 시간을 절약할 수 있습니다. 이 기능은 단순한 데이터 목록에만 적용할 수 있는 것이 아니라, 여러 조건에 따라 필터링하여 필요한 정보를 보다 정확하게 찾을 수 있도록 도와줍니다. 전반적으로 Excel의 필터링 기능은 매우 실용적입니다.

초지능의 생명력이 깨어난다! 하지만 자동 업데이트 AI가 등장하면서 엄마들은 더 이상 데이터 병목 현상을 걱정할 필요가 없습니다.

Apr 29, 2024 pm 06:55 PM

초지능의 생명력이 깨어난다! 하지만 자동 업데이트 AI가 등장하면서 엄마들은 더 이상 데이터 병목 현상을 걱정할 필요가 없습니다.

Apr 29, 2024 pm 06:55 PM

세상은 미친 듯이 큰 모델을 만들고 있습니다. 인터넷의 데이터만으로는 충분하지 않습니다. 훈련 모델은 '헝거게임'처럼 생겼고, 전 세계 AI 연구자들은 이러한 데이터를 탐식하는 사람들에게 어떻게 먹이를 줄지 고민하고 있습니다. 이 문제는 다중 모드 작업에서 특히 두드러집니다. 아무것도 할 수 없던 시기에, 중국 인민대학교 학과의 스타트업 팀은 자체 새로운 모델을 사용하여 중국 최초로 '모델 생성 데이터 피드 자체'를 현실화했습니다. 또한 이해 측면과 생성 측면의 두 가지 접근 방식으로 양측 모두 고품질의 다중 모드 새로운 데이터를 생성하고 모델 자체에 데이터 피드백을 제공할 수 있습니다. 모델이란 무엇입니까? Awaker 1.0은 중관촌 포럼에 최근 등장한 대형 멀티모달 모델입니다. 팀은 누구입니까? 소폰 엔진. 런민대학교 힐하우스 인공지능대학원 박사과정 학생인 Gao Yizhao가 설립했습니다.

Google은 열광하고 있습니다. JAX 성능이 Pytorch와 TensorFlow를 능가합니다! GPU 추론 훈련을 위한 가장 빠른 선택이 될 수 있습니다.

Apr 01, 2024 pm 07:46 PM

Google은 열광하고 있습니다. JAX 성능이 Pytorch와 TensorFlow를 능가합니다! GPU 추론 훈련을 위한 가장 빠른 선택이 될 수 있습니다.

Apr 01, 2024 pm 07:46 PM

Google이 추진하는 JAX의 성능은 최근 벤치마크 테스트에서 Pytorch와 TensorFlow를 능가하여 7개 지표에서 1위를 차지했습니다. 그리고 JAX 성능이 가장 좋은 TPU에서는 테스트가 이루어지지 않았습니다. 개발자들 사이에서는 여전히 Tensorflow보다 Pytorch가 더 인기가 있습니다. 그러나 앞으로는 더 큰 모델이 JAX 플랫폼을 기반으로 훈련되고 실행될 것입니다. 모델 최근 Keras 팀은 기본 PyTorch 구현을 사용하여 세 가지 백엔드(TensorFlow, JAX, PyTorch)와 TensorFlow를 사용하는 Keras2를 벤치마킹했습니다. 첫째, 그들은 주류 세트를 선택합니다.

iPhone의 느린 셀룰러 데이터 인터넷 속도: 수정 사항

May 03, 2024 pm 09:01 PM

iPhone의 느린 셀룰러 데이터 인터넷 속도: 수정 사항

May 03, 2024 pm 09:01 PM

지연이 발생하고 iPhone의 모바일 데이터 연결 속도가 느립니까? 일반적으로 휴대폰의 셀룰러 인터넷 강도는 지역, 셀룰러 네트워크 유형, 로밍 유형 등과 같은 여러 요소에 따라 달라집니다. 더 빠르고 안정적인 셀룰러 인터넷 연결을 얻기 위해 할 수 있는 일이 몇 가지 있습니다. 수정 1 – iPhone 강제 다시 시작 때로는 장치를 강제로 다시 시작하면 셀룰러 연결을 포함한 많은 항목이 재설정됩니다. 1단계 – 볼륨 높이기 키를 한 번 눌렀다가 놓습니다. 그런 다음 볼륨 작게 키를 눌렀다가 다시 놓습니다. 2단계 - 프로세스의 다음 부분은 오른쪽에 있는 버튼을 누르는 것입니다. iPhone이 다시 시작되도록 하세요. 셀룰러 데이터를 활성화하고 네트워크 속도를 확인하세요. 다시 확인하세요 수정 2 – 데이터 모드 변경 5G는 더 나은 네트워크 속도를 제공하지만 신호가 약할 때 더 잘 작동합니다

미 공군이 주목할만한 최초의 AI 전투기를 선보였습니다! 전 과정에 걸쳐 장관이 직접 간섭 없이 테스트를 진행했고, 10만 줄의 코드를 21차례 테스트했다.

May 07, 2024 pm 05:00 PM

미 공군이 주목할만한 최초의 AI 전투기를 선보였습니다! 전 과정에 걸쳐 장관이 직접 간섭 없이 테스트를 진행했고, 10만 줄의 코드를 21차례 테스트했다.

May 07, 2024 pm 05:00 PM

최근 군계는 미군 전투기가 이제 AI를 활용해 완전 자동 공중전을 완수할 수 있다는 소식에 충격을 받았다. 네, 얼마 전 미군의 AI 전투기가 최초로 공개되면서 그 미스터리가 드러났습니다. 이 전투기의 정식 명칭은 VISTA(Variable Stability Flight Simulator Test Aircraft)로 미 공군 장관이 직접 조종해 일대일 공중전을 모의 실험한 것이다. 5월 2일, 미 공군 장관 프랭크 켄달(Frank Kendall)이 X-62AVISTA를 타고 에드워드 공군 기지에서 이륙했습니다. 1시간의 비행 동안 모든 비행 작업은 AI에 의해 자동으로 완료되었습니다. Kendall은 "지난 수십 년 동안 우리는 자율 공대공 전투의 무한한 잠재력에 대해 생각해 왔지만 항상 도달할 수 없는 것처럼 보였습니다."라고 말했습니다. 그러나 지금은,

다섯 개의 유연한 손가락과 초인적인 속도를 갖춘 인간 작업을 자율적으로 완료하는 최초의 로봇 등장, 가상 공간 훈련을 지원하는 대형 모델

Mar 11, 2024 pm 12:10 PM

다섯 개의 유연한 손가락과 초인적인 속도를 갖춘 인간 작업을 자율적으로 완료하는 최초의 로봇 등장, 가상 공간 훈련을 지원하는 대형 모델

Mar 11, 2024 pm 12:10 PM

이번 주, 오픈AI(OpenAI), 마이크로소프트(Microsoft), 베조스(Bezos), 엔비디아(Nvidia)가 투자한 로봇 회사인 FigureAI는 약 7억 달러의 자금 조달을 받았으며 내년 내에 독립적으로 걸을 수 있는 휴머노이드 로봇을 개발할 계획이라고 발표했습니다. 그리고 Tesla의 Optimus Prime은 계속해서 좋은 소식을 받았습니다. 올해가 휴머노이드 로봇이 폭발하는 해가 될 것이라는 데는 누구도 의심하지 않는다. 캐나다에 본사를 둔 로봇 회사인 SanctuaryAI는 최근 새로운 휴머노이드 로봇인 Phoenix를 출시했습니다. 관계자들은 이 로봇이 인간과 같은 속도로 자율적으로 많은 작업을 완료할 수 있다고 주장한다. 인간의 속도로 자동으로 작업을 완료할 수 있는 세계 최초의 로봇인 Pheonix는 각 물체를 부드럽게 잡고 움직이며 우아하게 왼쪽과 오른쪽에 배치할 수 있습니다. 자동으로 물체를 식별할 수 있습니다.