Hadoop 2.2 & HBase 0.96 Maven 依赖总结

由于Hbase 0.94对Hadoop 2.x的支持不是非常好,故直接添加Hbase 0.94的jar依赖可能会导致问题。 但是直接添加Hbase0.96的依赖,由于官方并没有发布Hbase 0.96的jar包,通过maven编译项目的时候会出现找不到jar包导致编译失败。 通过网上的资料,得知Hbase 0.9

由于Hbase 0.94对Hadoop 2.x的支持不是非常好,故直接添加Hbase 0.94的jar依赖可能会导致问题。 但是直接添加Hbase0.96的依赖,由于官方并没有发布Hbase 0.96的jar包,通过maven编译项目的时候会出现找不到jar包导致编译失败。

通过网上的资料,得知Hbase 0.94后版本,直接添加Hbase-Client的依赖,通过查询得知需要以下依赖:

[html]

view plaincopy

- dependency>

- groupId>commons-iogroupId>

- artifactId>commons-ioartifactId>

- version>1.3.2version>

- dependency>

- dependency>

- groupId>commons-logginggroupId>

- artifactId>commons-loggingartifactId>

- version>1.1.3version>

- dependency>

- dependency>

- groupId>log4jgroupId>

- artifactId>log4jartifactId>

- version>1.2.17version>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-clientartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>com.google.protobufgroupId>

- artifactId>protobuf-javaartifactId>

- version>2.5.0version>

- dependency>

- dependency>

- groupId>io.nettygroupId>

- artifactId>nettyartifactId>

- version>3.6.6.Finalversion>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-commonartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-protocolartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>org.apache.zookeepergroupId>

- artifactId>zookeeperartifactId>

- version>3.4.5version>

- dependency>

- dependency>

- groupId>org.cloudera.htracegroupId>

- artifactId>htrace-coreartifactId>

- version>2.01version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-mapper-aslartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-core-aslartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-jaxrsartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-xcartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.slf4jgroupId>

- artifactId>slf4j-apiartifactId>

- version>1.6.4version>

- dependency>

- dependency>

- groupId>org.slf4jgroupId>

- artifactId>slf4j-log4j12artifactId>

- version>1.6.4version>

- dependency>

若要使用org.apache.hadoop.hbase.mapreduce的API,需要加上:

最后,把Hadoop的依赖也贴上来,以防自己忘记:

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1375

1375

52

52

Ralat Java: Ralat Hadoop, Cara Mengendalikan dan Mengelak

Jun 24, 2023 pm 01:06 PM

Ralat Java: Ralat Hadoop, Cara Mengendalikan dan Mengelak

Jun 24, 2023 pm 01:06 PM

Ralat Java: Ralat Hadoop, Cara Mengendalikan dan Mengelak Apabila menggunakan Hadoop untuk memproses data besar, anda sering menghadapi beberapa ralat pengecualian Java, yang mungkin menjejaskan pelaksanaan tugas dan menyebabkan pemprosesan data gagal. Artikel ini akan memperkenalkan beberapa ralat Hadoop biasa dan menyediakan cara untuk menangani dan mengelakkannya. Java.lang.OutOfMemoryErrorOutOfMemoryError ialah ralat yang disebabkan oleh memori mesin maya Java yang tidak mencukupi. Apabila Hadoop adalah

Menggunakan Hadoop dan HBase dalam Beego untuk penyimpanan data besar dan pertanyaan

Jun 22, 2023 am 10:21 AM

Menggunakan Hadoop dan HBase dalam Beego untuk penyimpanan data besar dan pertanyaan

Jun 22, 2023 am 10:21 AM

Dengan kemunculan era data besar, pemprosesan dan penyimpanan data menjadi semakin penting, dan cara mengurus dan menganalisis sejumlah besar data dengan cekap telah menjadi cabaran bagi perusahaan. Hadoop dan HBase, dua projek Yayasan Apache, menyediakan penyelesaian untuk penyimpanan dan analisis data besar. Artikel ini akan memperkenalkan cara menggunakan Hadoop dan HBase dalam Beego untuk storan dan pertanyaan data besar. 1. Pengenalan kepada Hadoop dan HBase Hadoop ialah sistem storan dan pengkomputeran teragih sumber terbuka yang boleh

Apakah syiling AMP?

Feb 24, 2024 pm 09:16 PM

Apakah syiling AMP?

Feb 24, 2024 pm 09:16 PM

Apakah itu AMP Coin? Token AMP telah dicipta oleh pasukan Synereo pada tahun 2015 sebagai mata wang dagangan utama platform Synereo. Token AMP bertujuan untuk memberikan pengguna pengalaman ekonomi digital yang lebih baik melalui pelbagai fungsi dan kegunaan. Tujuan Token AMP Token AMP mempunyai pelbagai peranan dan fungsi dalam platform Synereo. Pertama, sebagai sebahagian daripada sistem ganjaran mata wang kripto platform, pengguna dapat memperoleh ganjaran AMP dengan berkongsi dan mempromosikan kandungan, mekanisme yang menggalakkan pengguna untuk mengambil bahagian secara lebih aktif dalam aktiviti platform. Token AMP juga boleh digunakan untuk mempromosikan dan mengedarkan kandungan pada platform Synereo. Pengguna boleh meningkatkan keterlihatan kandungan mereka pada platform dengan menggunakan token AMP untuk menarik lebih ramai penonton melihat dan berkongsi

Cara menggunakan PHP dan Hadoop untuk pemprosesan data besar

Jun 19, 2023 pm 02:24 PM

Cara menggunakan PHP dan Hadoop untuk pemprosesan data besar

Jun 19, 2023 pm 02:24 PM

Memandangkan jumlah data terus meningkat, kaedah pemprosesan data tradisional tidak lagi dapat menangani cabaran yang dibawa oleh era data besar. Hadoop ialah rangka kerja pengkomputeran teragih sumber terbuka yang menyelesaikan masalah kesesakan prestasi yang disebabkan oleh pelayan nod tunggal dalam pemprosesan data besar melalui storan teragih dan pemprosesan sejumlah besar data. PHP adalah bahasa skrip yang digunakan secara meluas dalam pembangunan web dan mempunyai kelebihan pembangunan pesat dan penyelenggaraan yang mudah. Artikel ini akan memperkenalkan cara menggunakan PHP dan Hadoop untuk pemprosesan data besar. Apa itu HadoopHadoop

Terokai aplikasi Java dalam bidang data besar: pemahaman tentang Hadoop, Spark, Kafka dan tindanan teknologi lain

Dec 26, 2023 pm 02:57 PM

Terokai aplikasi Java dalam bidang data besar: pemahaman tentang Hadoop, Spark, Kafka dan tindanan teknologi lain

Dec 26, 2023 pm 02:57 PM

Timbunan teknologi data besar Java: Fahami aplikasi Java dalam bidang data besar, seperti Hadoop, Spark, Kafka, dll. Apabila jumlah data terus meningkat, teknologi data besar telah menjadi topik hangat dalam era Internet hari ini. Dalam bidang data besar, kita sering mendengar nama Hadoop, Spark, Kafka dan teknologi lain. Teknologi ini memainkan peranan penting, dan Java, sebagai bahasa pengaturcaraan yang digunakan secara meluas, juga memainkan peranan yang besar dalam bidang data besar. Artikel ini akan memberi tumpuan kepada aplikasi Java secara besar-besaran

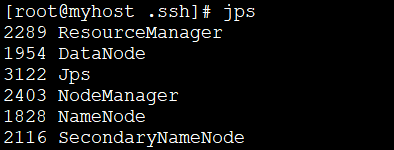

Bagaimana untuk memasang Hadoop dalam linux

May 18, 2023 pm 08:19 PM

Bagaimana untuk memasang Hadoop dalam linux

May 18, 2023 pm 08:19 PM

1: Pasang JDK1. Jalankan arahan berikut untuk memuat turun pakej pemasangan JDK1.8. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2 Jalankan arahan berikut untuk menyahmampat pakej pemasangan JDK1.8 yang dimuat turun . tar-zxvfjdk-8u151-linux-x64.tar.gz3 Alihkan dan namakan semula pakej JDK. mvjdk1.8.0_151//usr/java84. gema'

Gunakan PHP untuk mencapai pemprosesan data berskala besar: Hadoop, Spark, Flink, dsb.

May 11, 2023 pm 04:13 PM

Gunakan PHP untuk mencapai pemprosesan data berskala besar: Hadoop, Spark, Flink, dsb.

May 11, 2023 pm 04:13 PM

Memandangkan jumlah data terus meningkat, pemprosesan data berskala besar telah menjadi masalah yang mesti dihadapi dan diselesaikan oleh perusahaan. Pangkalan data perhubungan tradisional tidak lagi dapat memenuhi permintaan ini Untuk penyimpanan dan analisis data berskala besar, platform pengkomputeran teragih seperti Hadoop, Spark, dan Flink telah menjadi pilihan terbaik. Dalam proses pemilihan alat pemprosesan data, PHP menjadi semakin popular di kalangan pembangun sebagai bahasa yang mudah dibangunkan dan diselenggara. Dalam artikel ini, kami akan meneroka cara memanfaatkan PHP untuk pemprosesan data berskala besar dan bagaimana

Enjin pemprosesan data dalam PHP (Spark, Hadoop, dll.)

Jun 23, 2023 am 09:43 AM

Enjin pemprosesan data dalam PHP (Spark, Hadoop, dll.)

Jun 23, 2023 am 09:43 AM

Dalam era Internet sekarang, pemprosesan data secara besar-besaran merupakan masalah yang perlu dihadapi oleh setiap perusahaan dan institusi. Sebagai bahasa pengaturcaraan yang digunakan secara meluas, PHP juga perlu mengikuti perkembangan masa dalam pemprosesan data. Untuk memproses data besar-besaran dengan lebih cekap, pembangunan PHP telah memperkenalkan beberapa alat pemprosesan data besar, seperti Spark dan Hadoop. Spark ialah enjin pemprosesan data sumber terbuka yang boleh digunakan untuk pemprosesan teragih set data yang besar. Ciri terbesar Spark ialah kelajuan pemprosesan data yang pantas dan penyimpanan data yang cekap.