搭建Hadoop环境的详细过程

即上一篇《初步了解Hadoop》已经过去好多天了,今天继续hadoop学习之旅。大体了解hadoop原理,我们想先搭建hadoop环境,在这个过程中慢慢体会一下hadoop。 我在这里说的是hadoop伪分布式模式(Pseudo-Distributed Mode),其实网上已经有很多教程,在这里我

即上一篇《初步了解Hadoop》已经过去好多天了,今天继续hadoop学习之旅。大体了解hadoop原理,我们想先搭建hadoop环境,在这个过程中慢慢体会一下hadoop。

我在这里说的是hadoop伪分布式模式(Pseudo-Distributed Mode),其实网上已经有很多教程,在这里我详详细细的描述整个搭建过程,也算是自己重新回忆一下。

准备阶段(下载地址我这里就不给出了):

Win7旗舰版 Vmware-9.0.2

ubuntu-12.04 hadoop-0.20.2 jdk-8u5-linux-i586-demos

搭建流程:

1、装机阶段:

一、安装Ubuntu操作系统

二、在Ubuntu下创建hadoop用户组和用户

三、在Ubuntu下安装JDK

四、修改机器名

五、安装ssh服务

六、建立ssh无密码登录本机

七、安装hadoop

八、在单机上运行hadoop

一、安装Ubuntu操作系统

略……

二、在Ubuntu下创建hadoop用户组和用户

(1)安装Ubuntu时已经建立了一个用户,但是为了以后Hadoop操作,专门渐建立一个hadoop用户组和hadoop用户。

(2)给hadoop用户添加权限,打开/etc/sudoers文件。

sudo gedit /etc/sudoers

打开/etc/sudoers文件了,给hadoop用户赋予root用户同样的权限。在

root ALL=(ALL:ALL) ALL

下添加:

hadoop ALL=(ALL:ALL) ALL

三、在Ubuntu下安装JDK

1、创建JDK安装目录

(1)由于我使用的是VMware安装的Ubuntu系统,设置本地thisceshi文件夹共享到Ubuntu系统,指定的安装目录是:/usr/local/java。可是系统安装后在/usr/local下并没有java目录,这需要我们去创建一个java文件夹,

进入/usr/local文件夹

cd /usr/local

创建java文件夹,

sudo mkdir /usr/local/java

(2)解压JDK到目标目录

进入共享文件夹thisceshi,

cd /mnt/hgfs/thisceshi

然后进入到共享文件夹中,继续我们解压JDK到之前建好的java文件夹中,

sudo cp jdk-8u5-linux-i586-demos.tar.gz /usr/local/java

2、安装jdk

(1)切换到root用户下,

hadoop@s15:/mnt/hgfs/thisceshi$ su 密码:

(2)解压jdk-8u5-linux-i586-demos.tar.gz

sudo tar -zxf jdk-8u5-linux-i586-demos.tar.gz

此时java目录中多了一个jdk1.6.0_30文件夹。

3、配置环境变量

(1)打开/etc/profile文件,

sudo gedit /etc/profile

(2)添加变量,

#set java environment export JAVA_HOME=/usr/local/java/jdk1.6.0_30 export JRE_HOME=/usr/local/java/jdk1.6.0_30/jre export CLASSPATH=.:$JAVA_HOME/lib:$JRE_HOME/lib:$CLASSPATH export PATH=$JAVA_HOME/bin:$JRE_HOME/bin:$JAVA_HOME:$PATH

一般更改/etc/profile文件后,需要重启机器才能生效,在这里我们可以使用如下指令可使配置文件立即生效,

source /etc/profile

(3)查看java环境变量是否配置成功,

java -version

显示如下:

java version "1.6.0_30" Java(TM) SE Runtime Environment (build 1.6.0_30-b12) Java HotSpot(TM) Client VM (build 20.5-b03, mixed mode, sharing)

但是在root下一切正常,在hadoop用户下就出现了问题,

程序“java”已包含在下列软件包中: * gcj-4.4-jre-headless * openjdk-6-jre-headless * cacao * gij-4.3 * jamvm

在终端中我们分别运行下面指令,

sudo update-alternatives --install /usr/bin/java java /usr/local/java/jdk1.6.0_30/bin/java 300 sudo update-alternatives --install /usr/bin/javac javac /usr/local/java/jdk1.6.0_30/bin/javac 300

问题解决。

四、修改机器名

当ubuntu安装成功时,我们的机器名都默认为:ubuntu ,但为了以后集群中能够容易分辨各台服务器,需要给每台机器取个不同的名字。机器名由 /etc/hostname文件决定。这是我开始是根据网上教程也给修改了,其实伪分布式搭建的时候,可以省了,不然还造成一些不必要的麻烦。

1、打开/etc/hostname文件,运行指令,

sudo gedit /etc/hostname

2、然后hostname中添加s15五、安装ssh服务保存退出,即s15是当前用户别名。在这里需要重启系统后才会生效。

hadoop@s15:~$

五、安装ssh服务

1、安装openssh-server

sudo apt-get install openssh-server

2、等待安装,即可。

六、 建立ssh无密码登录本机

在这里,我自己还是模模糊糊的。

ssh生成密钥有rsa和dsa两种生成方式,默认情况下采用rsa方式。

1、创建ssh-key,,这里我们采用rsa方式,

ssh-keygen -t rsa -P ''

网上教程中后面是双引号,我在执行出现错误,换成单引号,则可以执行。

进入ssh,查看里面文件

hadoop@s15:~$ cd .ssh hadoop@s15:~/.ssh$ ls id_rsa id_rsa.pub

2、进入~/.ssh/目录下,将idrsa.pub追加到authorizedkeys授权文件中,开始是没有authorized_keys文件的,

cat id_rsa.pub >> authorized_keys

3、登录localhost,

hadoop@s15:~/.ssh$ ssh localhost Welcome to Ubuntu 12.04 LTS (GNU/Linux 3.2.0-61-generic-pae i686) * Documentation: https://help.ubuntu.com/ 663 packages can be updated. 266 updates are security updates. Last login: Sat May 10 13:08:03 2014 from localhost

4、执行退出命令,

hadoop@s15:~$ exit 登出 Connection to localhost closed.

七、安装hadoop

1、从共享文件夹thisceshi中将hadoop-0.20.2.tar.gz复制到安装目录 /usr/local/下

2、解压hadoop-0.20.203.tar.gz,

3、将解压出的文件夹改名为hadoop,

4、将该hadoop文件夹的属主用户设为hadoop,

sudo chown -R hadoop:hadoop hadoop

5、打开hadoop/conf/hadoop-env.sh文件,

6、配置conf/hadoop-env.sh(找到#export JAVA_HOME=…,去掉#,然后加上本机jdk的路径)

# The java implementation to use. Required. export JAVA_HOME=/usr/local/java/jdk1.6.0_30 export HADOOP_HOME=/usr/local/hadoop export PATH=$PATH:/usr/local/hadoop/bin

让环境立即生效,

source /usr/local/hadoop/conf/hadoop-env.sh

7、打开conf/core-site.xml文件,编辑如下:

<?xml version="1.0"?> <?xml-stylesheet type="text/xsl" href="http://www.cndwzone.com/archives/configuration.xsl"?> <!-- Put site-specific property overrides in this file. --> fs.default.name hdfs://localhost:9000

8、打开conf/mapred-site.xml文件,编辑如下:

<?xml version="1.0"?> <?xml-stylesheet type="text/xsl" href="http://www.cndwzone.com/archives/configuration.xsl"?> <!-- Put site-specific property overrides in this file. --> mapred.job.tracker localhost:9001

9、打开conf/hdfs-site.xml文件,编辑如下:

<?xml version="1.0"?> <?xml-stylesheet type="text/xsl" href="http://www.cndwzone.com/archives/configuration.xsl"?> <!-- Put site-specific property overrides in this file. --> dfs.name.dir /usr/local/hadoop/datalog1,/usr/local/hadoop/datalog2 dfs.data.dir /usr/local/hadoop/data1,/usr/local/hadoop/data2 dfs.replication 2

10、打开conf/masters文件,添加作为secondarynamenode的主机名,因为是伪分布式,只有一个节点,这里只需填写localhost就可以。

11、打开conf/slaves文件,添加作为slave的主机名,一行一个。因为是伪分布式,只有一个节点,这里也只需填写localhost就可以。

八、在单机上运行hadoop

1、进入hadoop目录下,格式化hdfs文件系统,初次运行hadoop时一定要有该操作,当你看到下图时,就说明你的hdfs文件系统格式化成功了。

3、进入bin目录启动start-all.sh,

4、检测hadoop是否启动成功,

到此,hadoop伪分布式环境搭建完成。

在搭建过程中可能会遇到各种问题,到时大家不用着急,可以谷歌,百度一下。解决问题的过程就是加深学习的过程。我当时都忘了花了多久才将环境搭建好,最初的时候,连最基本的指令也不懂,也不知道怎么运行。我在这里说出来就是想说,开始的一无所知不要害怕,慢慢来就好,在那么一刻你就会有所知,有所明白。之后的文章中会介绍在hadoop环境下运行WordCount,hadoop中的HelloWorld。

即上一篇《初步了解Hadoop》已经过去好多天了,今天继续hadoop学习之旅。大体了解hadoop原理,我们 […]

即上一篇《初步了解Hadoop》已经过去好多天了,今天继续hadoop学习之旅。大体了解hadoop原理,我们 […]

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1386

1386

52

52

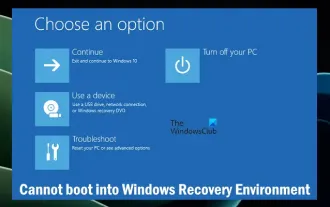

Tidak dapat boot ke dalam persekitaran pemulihan Windows

Feb 19, 2024 pm 11:12 PM

Tidak dapat boot ke dalam persekitaran pemulihan Windows

Feb 19, 2024 pm 11:12 PM

Persekitaran Pemulihan Windows (WinRE) ialah persekitaran yang digunakan untuk membaiki ralat sistem pengendalian Windows. Selepas memasuki WinRE, anda boleh melakukan pemulihan sistem, tetapan semula kilang, menyahpasang kemas kini, dsb. Jika anda tidak dapat boot ke WinRE, artikel ini akan membimbing anda melalui pembetulan untuk menyelesaikan isu tersebut. Tidak dapat boot ke dalam Persekitaran Pemulihan Windows Jika anda tidak boleh but ke dalam Persekitaran Pemulihan Windows, gunakan pembetulan yang disediakan di bawah: Semak status Persekitaran Pemulihan Windows Gunakan kaedah lain untuk memasuki Persekitaran Pemulihan Windows Adakah anda secara tidak sengaja memadam Pembahagian Pemulihan Windows? Lakukan peningkatan di tempat atau pemasangan bersih Windows di bawah, kami telah menerangkan semua pembaikan ini secara terperinci. 1] Semak Wi

Apakah perbezaan antara Python dan Anaconda?

Sep 06, 2023 pm 08:37 PM

Apakah perbezaan antara Python dan Anaconda?

Sep 06, 2023 pm 08:37 PM

Dalam artikel ini, kita akan belajar tentang perbezaan antara Python dan Anaconda. Apakah Python? Python ialah bahasa sumber terbuka yang memberi penekanan yang besar untuk menjadikan kod mudah dibaca dan difahami dengan menginden baris dan menyediakan ruang kosong. Fleksibiliti dan kemudahan penggunaan Python menjadikannya sesuai untuk pelbagai aplikasi, termasuk tetapi tidak terhad kepada pengkomputeran saintifik, kecerdasan buatan dan sains data, serta mencipta dan membangunkan aplikasi dalam talian. Apabila Python diuji, ia segera diterjemahkan ke dalam bahasa mesin kerana ia adalah bahasa yang ditafsirkan. Sesetengah bahasa, seperti C++, memerlukan kompilasi untuk difahami. Kemahiran dalam Python adalah kelebihan penting kerana ia sangat mudah difahami, dibangunkan, dilaksanakan dan dibaca. Ini menjadikan Python

Ralat Java: Ralat Hadoop, Cara Mengendalikan dan Mengelak

Jun 24, 2023 pm 01:06 PM

Ralat Java: Ralat Hadoop, Cara Mengendalikan dan Mengelak

Jun 24, 2023 pm 01:06 PM

Ralat Java: Ralat Hadoop, Cara Mengendalikan dan Mengelak Apabila menggunakan Hadoop untuk memproses data besar, anda sering menghadapi beberapa ralat pengecualian Java, yang mungkin menjejaskan pelaksanaan tugas dan menyebabkan pemprosesan data gagal. Artikel ini akan memperkenalkan beberapa ralat Hadoop biasa dan menyediakan cara untuk menangani dan mengelakkannya. Java.lang.OutOfMemoryErrorOutOfMemoryError ialah ralat yang disebabkan oleh memori mesin maya Java yang tidak mencukupi. Apabila Hadoop adalah

Cara cepat membina sistem carta statistik di bawah rangka kerja Vue

Aug 21, 2023 pm 05:48 PM

Cara cepat membina sistem carta statistik di bawah rangka kerja Vue

Aug 21, 2023 pm 05:48 PM

Cara cepat membina sistem carta statistik di bawah rangka kerja Vue Dalam aplikasi web moden, carta statistik merupakan komponen penting. Sebagai rangka kerja bahagian hadapan yang popular, Vue.js menyediakan banyak alatan dan komponen yang mudah yang boleh membantu kami membina sistem carta statistik dengan cepat. Artikel ini akan memperkenalkan cara menggunakan rangka kerja Vue dan beberapa pemalam untuk membina sistem carta statistik ringkas. Pertama, kita perlu menyediakan persekitaran pembangunan Vue.js, termasuk memasang perancah Vue dan beberapa pemalam yang berkaitan. Jalankan arahan berikut dalam baris arahan

Bolehkah bangunan dibina di alam liar di Mistlock Kingdom?

Mar 07, 2024 pm 08:28 PM

Bolehkah bangunan dibina di alam liar di Mistlock Kingdom?

Mar 07, 2024 pm 08:28 PM

Pemain boleh mengumpul bahan yang berbeza untuk membina bangunan apabila bermain di Mistlock Kingdom Ramai pemain ingin tahu sama ada untuk membina bangunan di alam liar Bangunan tidak boleh dibina di dalam Mistlock Kingdom. . Bolehkah bangunan dibina di alam liar di Mistlock Kingdom? 1. Bangunan tidak boleh dibina di kawasan liar Kerajaan Mist Lock. 2. Bangunan mesti dibina dalam skop altar. 3. Pemain boleh meletakkan Spirit Fire Altar dengan sendirinya, tetapi apabila mereka meninggalkan julat, mereka tidak akan dapat membina bangunan. 4. Kita juga boleh terus menggali lubang di gunung sebagai rumah kita, jadi kita tidak perlu menggunakan bahan binaan. 5. Terdapat mekanisme keselesaan dalam bangunan yang dibina oleh pemain sendiri, iaitu, lebih baik dalaman, lebih tinggi keselesaan. 6. Keselesaan yang tinggi akan membawa bonus atribut kepada pemain, seperti

Menggunakan Hadoop dan HBase dalam Beego untuk penyimpanan data besar dan pertanyaan

Jun 22, 2023 am 10:21 AM

Menggunakan Hadoop dan HBase dalam Beego untuk penyimpanan data besar dan pertanyaan

Jun 22, 2023 am 10:21 AM

Dengan kemunculan era data besar, pemprosesan dan penyimpanan data menjadi semakin penting, dan cara mengurus dan menganalisis sejumlah besar data dengan cekap telah menjadi cabaran bagi perusahaan. Hadoop dan HBase, dua projek Yayasan Apache, menyediakan penyelesaian untuk penyimpanan dan analisis data besar. Artikel ini akan memperkenalkan cara menggunakan Hadoop dan HBase dalam Beego untuk storan dan pertanyaan data besar. 1. Pengenalan kepada Hadoop dan HBase Hadoop ialah sistem storan dan pengkomputeran teragih sumber terbuka yang boleh

Amalan terbaik dan langkah berjaga-jaga untuk membina pelayan web di bawah CentOS 7

Aug 25, 2023 pm 11:33 PM

Amalan terbaik dan langkah berjaga-jaga untuk membina pelayan web di bawah CentOS 7

Aug 25, 2023 pm 11:33 PM

Amalan terbaik dan langkah berjaga-jaga untuk membina pelayan web di bawah CentOS7 Pengenalan: Dalam era Internet hari ini, pelayan web adalah salah satu komponen teras untuk membina dan mengehos laman web. CentOS7 ialah pengedaran Linux berkuasa yang digunakan secara meluas dalam persekitaran pelayan. Artikel ini akan meneroka amalan dan pertimbangan terbaik untuk membina pelayan web pada CentOS7, dan memberikan beberapa contoh kod untuk membantu anda memahami dengan lebih baik. 1. Pasang pelayan HTTP Apache Apache adalah w yang paling banyak digunakan

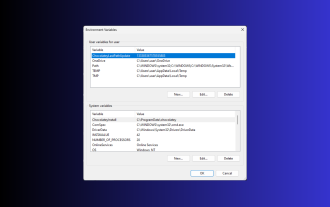

11 Cara untuk Menetapkan Pembolehubah Persekitaran pada Windows 3

Sep 15, 2023 pm 12:21 PM

11 Cara untuk Menetapkan Pembolehubah Persekitaran pada Windows 3

Sep 15, 2023 pm 12:21 PM

Menetapkan pembolehubah persekitaran pada Windows 11 boleh membantu anda menyesuaikan sistem anda, menjalankan skrip dan mengkonfigurasi aplikasi. Dalam panduan ini, kami akan membincangkan tiga kaedah bersama-sama dengan arahan langkah demi langkah supaya anda boleh mengkonfigurasi sistem anda mengikut keinginan anda. Terdapat tiga jenis pembolehubah persekitaran Pembolehubah persekitaran sistem – Pembolehubah global adalah keutamaan paling rendah dan boleh diakses oleh semua pengguna dan aplikasi pada Windows dan biasanya digunakan untuk menentukan tetapan seluruh sistem. Pembolehubah Persekitaran Pengguna – Keutamaan yang lebih tinggi, pembolehubah ini hanya digunakan pada pengguna semasa dan proses yang dijalankan di bawah akaun tersebut, dan ditetapkan oleh pengguna atau aplikasi yang dijalankan di bawah akaun tersebut. Pembolehubah persekitaran proses – mempunyai keutamaan tertinggi, ia bersifat sementara dan digunakan pada proses semasa dan sub-prosesnya, menyediakan program