Peranti teknologi

Peranti teknologi

AI

AI

Tindakan pertama Ilya selepas meninggalkan kerjanya: Suka kertas ini, dan netizen bergegas membacanya

Tindakan pertama Ilya selepas meninggalkan kerjanya: Suka kertas ini, dan netizen bergegas membacanya

Tindakan pertama Ilya selepas meninggalkan kerjanya: Suka kertas ini, dan netizen bergegas membacanya

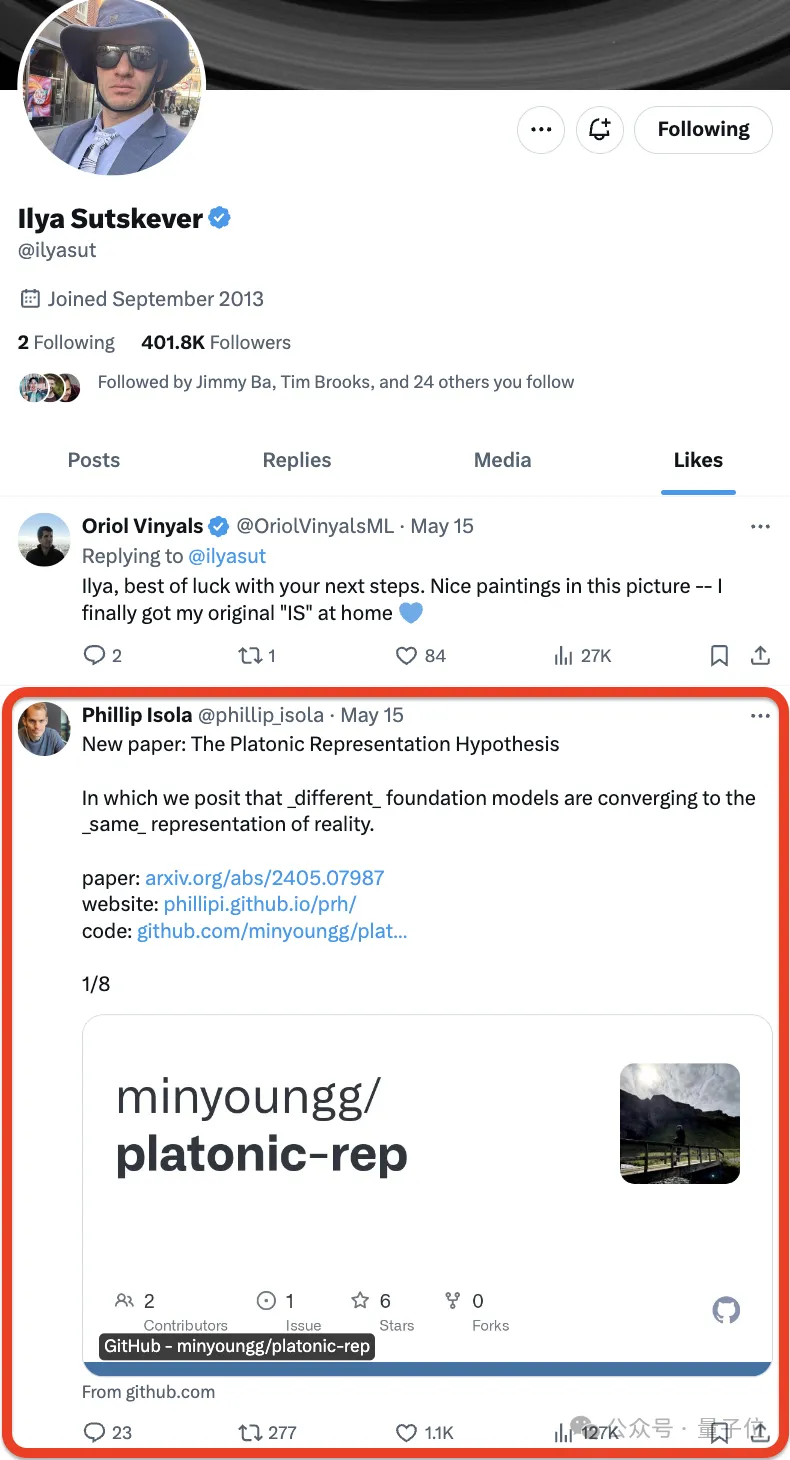

Sejak Ilya Sutskever secara rasmi mengumumkan peletakan jawatannya daripada OpenAI, langkah seterusnya telah menjadi tumpuan semua orang.

Ada juga yang memerhatikan setiap gerak-gerinya. . boleh diringkaskan dalam satu ayat seperti ini:

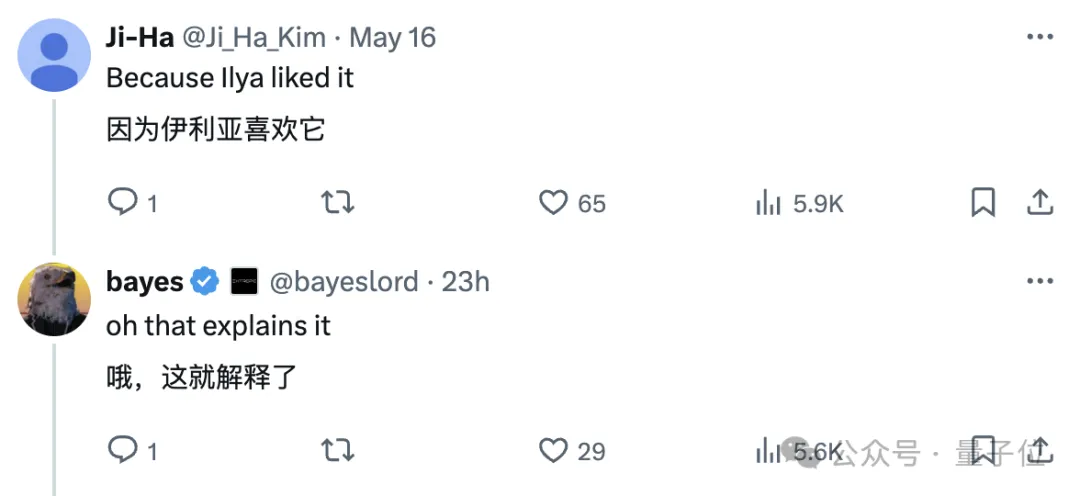

Rangkaian saraf dilatih dengan matlamat yang berbeza pada data dan modaliti yang berbeza, dan cenderung membentuk ruang perwakilan yang dikongsi dalam model statistik dunia sebenar .

Hipotesis Perwakilan Platonik

, merujuk kepada Alegori Gua Plato dan ideanya tentang sifat realiti ideal. Pemilihan Ilya masih dijamin. ringkaskan, ayat pembukaan "Karenina": Semua model bahasa gembira adalah serupa, dan setiap model bahasa yang malang mempunyai nasib malangnya sendiri.

Representational ConvergenceKami juga melihat, dan kandungan umum ialah:

Pengarang menganalisis

(Representational Convergence)

(Representational Convergence)

Apakah yang mendorong penumpuan ini? Adakah trend ini akan berterusan? Di manakah destinasi terakhirnya?

Selepas beberapa siri analisis dan eksperimen, para penyelidik membuat spekulasi bahawa penumpuan ini mempunyai titik akhir dan prinsip pemacu:Model yang berbeza berusaha untuk mencapai gambaran realiti yang tepat .

.

Sebuah gambar untuk diterangkan:

di mana imej

(X) dan teks  (Y)

(Y)

(Z)

. Para penyelidik membuat spekulasi bahawa algoritma pembelajaran perwakilan akan menumpu kepada perwakilan bersatu Z, dan peningkatan dalam saiz model serta kepelbagaian data dan tugasan adalah faktor utama yang mendorong penumpuan ini. Saya cuma boleh katakan itu memang soalan yang Ilya minat. Terlalu mendalam dan kami tak faham sangat Jom minta AI tolong tafsirkan dan kongsikan dengan semua orang~

Saya cuma boleh katakan itu memang soalan yang Ilya minat. Terlalu mendalam dan kami tak faham sangat Jom minta AI tolong tafsirkan dan kongsikan dengan semua orang~

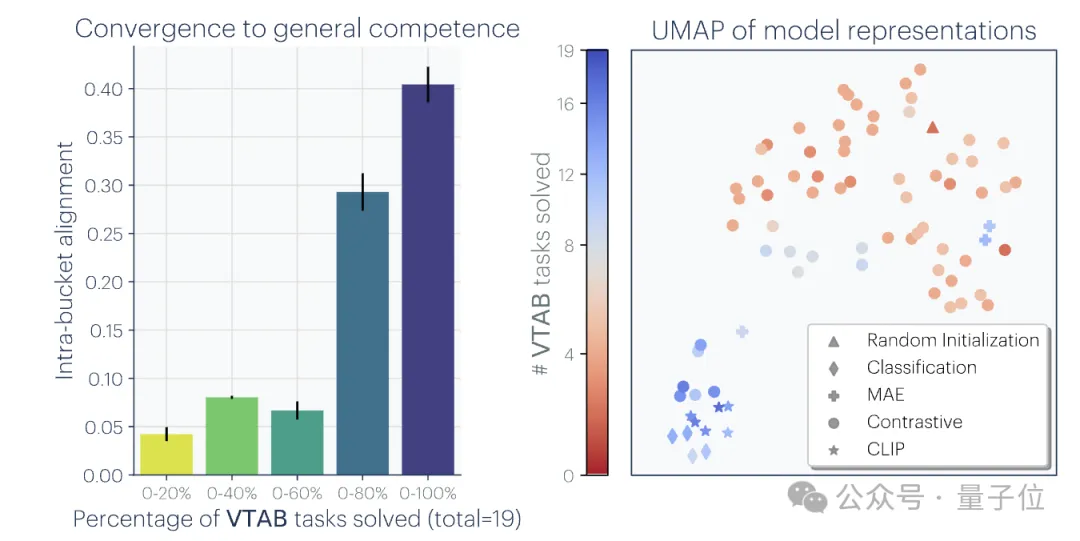

. Bukti yang mewakili penumpuanPertama sekali, penulis saya menganalisis sejumlah besar kajian berkaitan terdahulu, dan juga menjalankan eksperimen sendiri, dan menghasilkan satu siri bukti penumpuan, menunjukkan penumpuan, skala dan prestasi, dan penumpuan silang mod daripada model yang berbeza.

Ps: Penyelidikan ini memfokuskan kepada perwakilan pembenaman vektor, iaitu, data ditukar kepada bentuk vektor, dan persamaan atau jarak antara titik data diterangkan oleh fungsi kernel. Konsep "penjajaran perwakilan" dalam artikel ini bermakna jika dua kaedah perwakilan yang berbeza mendedahkan struktur data yang serupa, maka kedua-dua perwakilan itu dianggap sebagai diselaraskan.

1. Konvergensi model yang berbeza dengan seni bina dan matlamat yang berbeza cenderung konsisten dalam perwakilan asasnya.

Bilangan sistem yang dibina berdasarkan model asas pra-latihan semakin meningkat secara beransur-ansur, dan beberapa model menjadi seni bina teras standard untuk berbilang tugas. Kebolehgunaan luas ini dalam pelbagai aplikasi mencerminkan fleksibiliti tertentu mereka dalam kaedah perwakilan data.

Walaupun trend ini menunjukkan bahawa sistem AI sedang menumpu ke arah set model asas yang lebih kecil, ia tidak membuktikan bahawa model asas yang berbeza akan membentuk perwakilan yang sama.

Walau bagaimanapun, beberapa penyelidikan terkini berkaitan jahitan model(jahitan model) mendapati bahawa perwakilan lapisan tengah model pengelasan imej boleh diselaraskan dengan baik walaupun dilatih pada set data yang berbeza.

Sebagai contoh, beberapa penyelidikan mendapati bahawa lapisan awal rangkaian konvolusi yang dilatih pada set data ImageNet dan Places365 boleh ditukar ganti, menunjukkan bahawa mereka mempelajari perwakilan visual awal yang serupa. Terdapat juga kajian yang telah menemui sejumlah besar "Rosetta Neurons", iaitu neuron dengan corak pengaktifan yang sangat serupa dalam model visual yang berbeza...

2 Lebih besar saiz dan prestasi model, lebih baik representasinya Semakin tinggi penjajaran.

Para penyelidik mengukur penjajaran 78 modelmenggunakan kaedah jiran terdekat bersama pada dataset Places-365 dan menilai prestasi tugas hiliran mereka pada penanda aras penyesuaian tugas visi VTAB.

3. Penumpuan perwakilan model dalam mod yang berbeza.

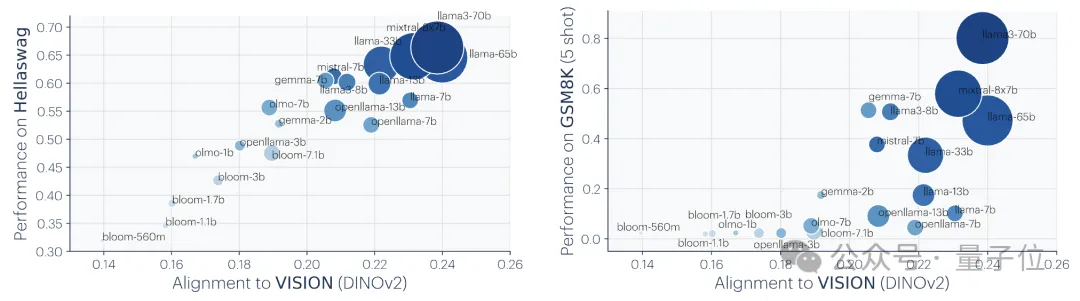

Penyelidik menggunakan kaedah jiran terdekat bersama untuk mengukur penjajaran pada dataset imej Wikipedia WIT. Hasilnya mendedahkan hubungan linear antara penjajaran visual bahasa dan skor pemodelan bahasa, dengan trend umum ialah model bahasa yang lebih berkebolehan diselaraskan dengan lebih baik dengan model visual yang lebih berkebolehan.

4. Model dan perwakilan otak juga menunjukkan tahap ketekalan tertentu, mungkin disebabkan oleh data dan kekangan tugas yang serupa.

Pada tahun 2014, satu kajian mendapati bahawa pengaktifan lapisan tengah rangkaian saraf sangat berkorelasi dengan corak pengaktifan kawasan visual otak, mungkin kerana menghadapi tugas visual dan kekangan data yang serupa. Sejak itu, kajian selanjutnya mendapati bahawa menggunakan data latihan yang berbeza akan menjejaskan penjajaran perwakilan otak dan model. Penyelidikan psikologi juga mendapati bahawa cara manusia melihat persamaan visual sangat konsisten dengan model rangkaian saraf.5. Tahap penjajaran perwakilan model berkorelasi positif dengan prestasi tugas hiliran.

Para penyelidik menggunakan dua tugas hiliran untuk menilai prestasi model: Hellaswag(penaakulan akal) dan GSM8K (matematik) . Dan gunakan model DINOv2 sebagai rujukan untuk mengukur penjajaran model bahasa lain dengan model visual.

Hasil eksperimen menunjukkan bahawa model bahasa yang lebih sejajar dengan model visual juga berprestasi lebih baik pada tugas Hellaswag dan GSM8K. Hasil visualisasi menunjukkan bahawa terdapat korelasi positif yang jelas antara tahap penjajaran dan prestasi tugas hiliran.

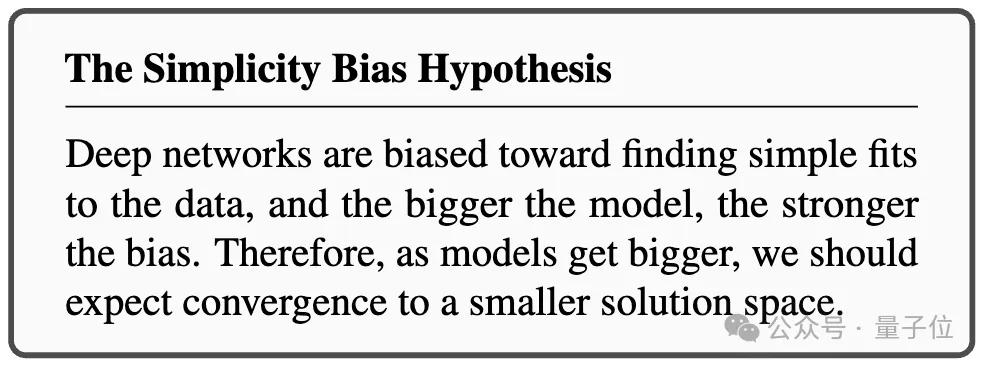

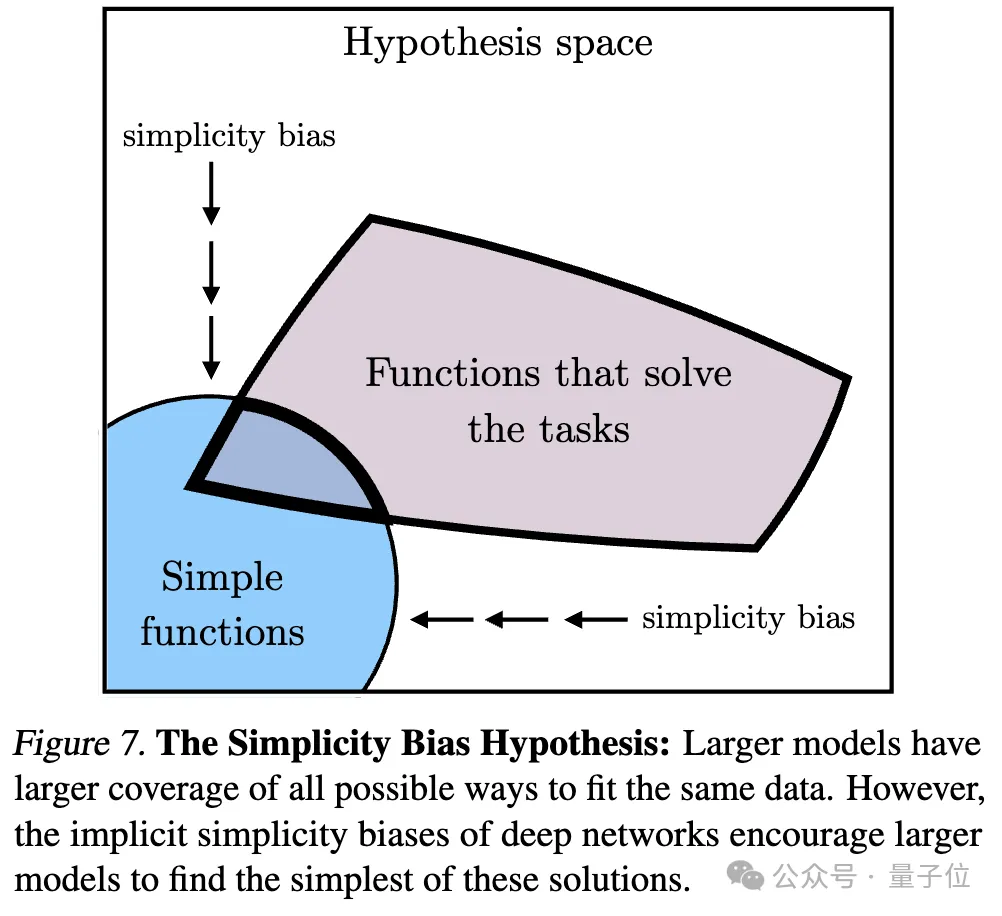

1. Convergence via Task Generality (Convergence via Task Generality)

Memandangkan model dilatih untuk menyelesaikan lebih banyak tugas, mereka perlu mencari perwakilan yang boleh memenuhi keperluan semua tugasan🜎 Bilangan perwakilan untuk tugasan N adalah kurang daripada bilangan perwakilan yang mampu untuk tugasan M (M . Oleh itu, apabila kesukaran tugasan meningkat, perwakilan model cenderung untuk menumpu kepada penyelesaian yang lebih baik dan lebih sedikit.

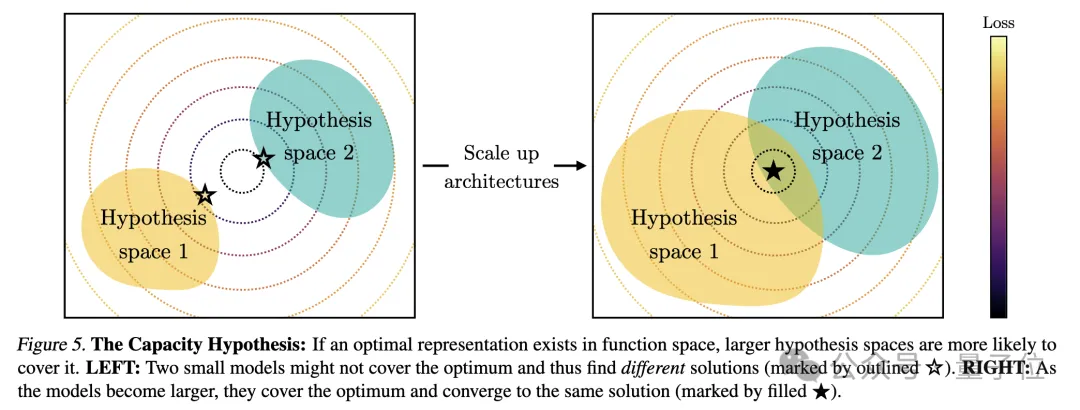

Iaitu, model yang lebih besar mempunyai liputan yang lebih luas dan dapat memuatkan data yang sama dalam semua cara yang mungkin. Walau bagaimanapun, keutamaan kesederhanaan tersirat rangkaian dalam menggalakkan model yang lebih besar untuk mencari penyelesaian yang paling mudah ini. .

Iaitu, model AI yang berbeza, walaupun dilatih pada data dan sasaran yang berbeza, ruang perwakilan mereka menumpu pada model statistik biasa yang mewakili dunia sebenar yang menjana data yang kami perhatikan.

Mereka mula-mula membina model dunia acara diskret yang ideal. Dunia mengandungi siri peristiwa diskret Z, setiap peristiwa diambil sampel daripada taburan P(Z) yang tidak diketahui. Setiap peristiwa boleh diperhatikan dengan cara yang berbeza melalui fungsi pemerhatian obs, seperti piksel, bunyi, teks, dsb.

Mereka mula-mula membina model dunia acara diskret yang ideal. Dunia mengandungi siri peristiwa diskret Z, setiap peristiwa diambil sampel daripada taburan P(Z) yang tidak diketahui. Setiap peristiwa boleh diperhatikan dengan cara yang berbeza melalui fungsi pemerhatian obs, seperti piksel, bunyi, teks, dsb.

Seterusnya, pengarang mempertimbangkan kelas algoritma pembelajaran kontrastif yang cuba mempelajari perwakilan fX supaya hasil darab dalam fX(xa) dan fX(xb) menghampiri xa dan ) nisbah kemungkinan log

kepada log kemungkinan menjadi pasangan sampel negatif (diambil secara rawak)  .

.

Selepas derivasi matematik, penulis mendapati bahawa jika data cukup lancar, algoritma jenis ini akan menumpu kepada fungsi kernel iaitu titik maklumat bersama (PMI) xa dan xb

Perwakilan kernel fX.

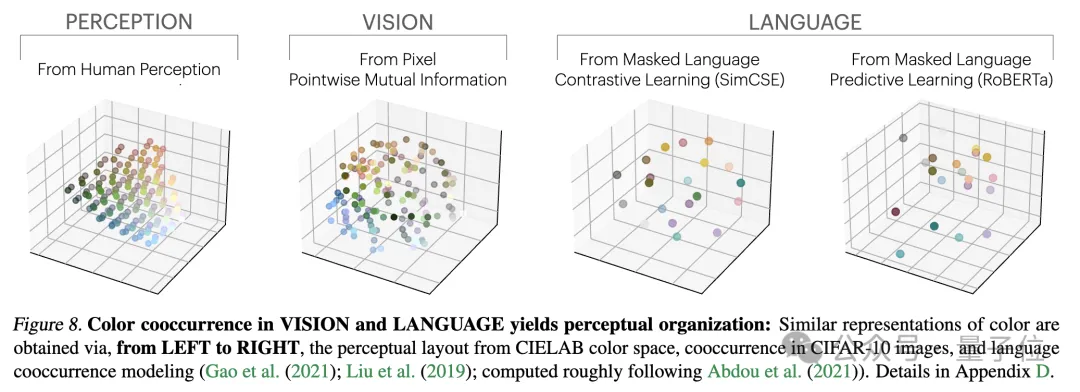

Pengkaji menguji teori ini melalui kajian empirikal tentang warna. Sama ada perwakilan warna dipelajari daripada statistik kejadian bersama piksel bagi imej atau statistik kejadian bersama perkataan bagi teks, jarak warna yang terhasil adalah serupa dengan persepsi manusia, dan apabila saiz model bertambah, persamaan ini menjadi lebih tinggi dan lebih tinggi.

Ini selaras dengan analisis teori, iaitu keupayaan model yang lebih besar boleh memodelkan statistik data pemerhatian dengan lebih tepat, dengan itu memperoleh kernel PMI yang lebih dekat dengan perwakilan acara yang ideal.

Beberapa pemikiran akhir

Di penghujung kertas kerja, penulis merumuskan potensi kesan penumpuan perwakilan pada bidang AI dan hala tuju penyelidikan masa depan, serta potensi had dan pengecualian kepada andaian perwakilan Platonik.

Mereka menegaskan bahawa apabila saiz model meningkat, kemungkinan kesan penumpuan perwakilan termasuk tetapi tidak terhad kepada:

- Walaupun hanya menskalakan boleh meningkatkan prestasi, kaedah yang berbeza mempunyai perbezaan dalam kecekapan penskalaan.

- Jika terdapat perwakilan Platonik yang bebas modaliti, maka data daripada modaliti yang berbeza harus dilatih bersama untuk mencari perwakilan bersama ini. Ini menjelaskan mengapa adalah berfaedah untuk menambah data visual pada latihan model bahasa dan sebaliknya.

- Penukaran antara perwakilan sejajar hendaklah agak mudah, yang mungkin menjelaskan: penjanaan bersyarat lebih mudah daripada penjanaan tanpa syarat, dan penukaran merentas mod juga boleh dicapai tanpa data berpasangan.

- Pertambahan saiz model mungkin mengurangkan kecenderungan model bahasa untuk mengada-adakan kandungan dan beberapa biasnya, menjadikannya lebih tepat mencerminkan bias dalam data latihan dan bukannya memburukkan lagi.

Pengarang menekankan bahawa premis impak di atas ialah data latihan model masa hadapan mestilah cukup pelbagai dan tidak rugi untuk benar-benar menumpu kepada perwakilan yang mencerminkan undang-undang statistik dunia sebenar.

Pada masa yang sama, penulis juga menyatakan bahawa data modaliti berbeza mungkin mengandungi maklumat unik, yang mungkin menyukarkan untuk mencapai penumpuan perwakilan lengkap walaupun saiz model meningkat. Di samping itu, tidak semua perwakilan sedang menumpu Sebagai contoh, tiada cara piawai untuk mewakili negeri dalam bidang robotik. Penyelidik dan keutamaan komuniti boleh membawa model untuk menumpu ke arah perwakilan manusia, dengan itu mengabaikan bentuk kecerdasan lain yang mungkin.

Dan sistem pintar yang direka khusus untuk tugasan tertentu mungkin tidak menumpu kepada perwakilan yang sama seperti kecerdasan am.

Pengarang juga menekankan bahawa kaedah mengukur penjajaran perwakilan adalah kontroversi dan kaedah pengukuran yang berbeza mungkin membawa kepada kesimpulan yang berbeza. Walaupun perwakilan model berbeza adalah serupa, jurang masih perlu dijelaskan, dan pada masa ini mustahil untuk menentukan sama ada jurang ini penting.

Untuk butiran lanjut dan kaedah penghujahan, saya akan siarkan kertas kerja di sini~

Pautan kertas: https://arxiv.org/abs/2405.07987

Atas ialah kandungan terperinci Tindakan pertama Ilya selepas meninggalkan kerjanya: Suka kertas ini, dan netizen bergegas membacanya. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1675

1675

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Gunakan ddrescue untuk memulihkan data pada Linux

Mar 20, 2024 pm 01:37 PM

Gunakan ddrescue untuk memulihkan data pada Linux

Mar 20, 2024 pm 01:37 PM

DDREASE ialah alat untuk memulihkan data daripada fail atau peranti sekat seperti cakera keras, SSD, cakera RAM, CD, DVD dan peranti storan USB. Ia menyalin data dari satu peranti blok ke peranti lain, meninggalkan blok data yang rosak dan hanya memindahkan blok data yang baik. ddreasue ialah alat pemulihan yang berkuasa yang automatik sepenuhnya kerana ia tidak memerlukan sebarang gangguan semasa operasi pemulihan. Selain itu, terima kasih kepada fail peta ddasue, ia boleh dihentikan dan disambung semula pada bila-bila masa. Ciri-ciri utama lain DDREASE adalah seperti berikut: Ia tidak menimpa data yang dipulihkan tetapi mengisi jurang sekiranya pemulihan berulang. Walau bagaimanapun, ia boleh dipotong jika alat itu diarahkan untuk melakukannya secara eksplisit. Pulihkan data daripada berbilang fail atau blok kepada satu

Sumber terbuka! Di luar ZoeDepth! DepthFM: Anggaran kedalaman monokular yang cepat dan tepat!

Apr 03, 2024 pm 12:04 PM

Sumber terbuka! Di luar ZoeDepth! DepthFM: Anggaran kedalaman monokular yang cepat dan tepat!

Apr 03, 2024 pm 12:04 PM

0. Apakah fungsi artikel ini? Kami mencadangkan DepthFM: model anggaran kedalaman monokular generatif yang serba boleh dan pantas. Sebagai tambahan kepada tugas anggaran kedalaman tradisional, DepthFM juga menunjukkan keupayaan terkini dalam tugas hiliran seperti mengecat kedalaman. DepthFM cekap dan boleh mensintesis peta kedalaman dalam beberapa langkah inferens. Mari kita baca karya ini bersama-sama ~ 1. Tajuk maklumat kertas: DepthFM: FastMonocularDepthEstimationwithFlowMatching Pengarang: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Google gembira: prestasi JAX mengatasi Pytorch dan TensorFlow! Ia mungkin menjadi pilihan terpantas untuk latihan inferens GPU

Apr 01, 2024 pm 07:46 PM

Google gembira: prestasi JAX mengatasi Pytorch dan TensorFlow! Ia mungkin menjadi pilihan terpantas untuk latihan inferens GPU

Apr 01, 2024 pm 07:46 PM

Prestasi JAX, yang dipromosikan oleh Google, telah mengatasi Pytorch dan TensorFlow dalam ujian penanda aras baru-baru ini, menduduki tempat pertama dalam 7 penunjuk. Dan ujian tidak dilakukan pada TPU dengan prestasi JAX terbaik. Walaupun dalam kalangan pembangun, Pytorch masih lebih popular daripada Tensorflow. Tetapi pada masa hadapan, mungkin lebih banyak model besar akan dilatih dan dijalankan berdasarkan platform JAX. Model Baru-baru ini, pasukan Keras menanda aras tiga hujung belakang (TensorFlow, JAX, PyTorch) dengan pelaksanaan PyTorch asli dan Keras2 dengan TensorFlow. Pertama, mereka memilih satu set arus perdana

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

Kelajuan Internet Data Selular Perlahan pada iPhone: Pembetulan

May 03, 2024 pm 09:01 PM

Kelajuan Internet Data Selular Perlahan pada iPhone: Pembetulan

May 03, 2024 pm 09:01 PM

Menghadapi ketinggalan, sambungan data mudah alih perlahan pada iPhone? Biasanya, kekuatan internet selular pada telefon anda bergantung pada beberapa faktor seperti rantau, jenis rangkaian selular, jenis perayauan, dsb. Terdapat beberapa perkara yang boleh anda lakukan untuk mendapatkan sambungan Internet selular yang lebih pantas dan boleh dipercayai. Betulkan 1 – Paksa Mulakan Semula iPhone Kadangkala, paksa memulakan semula peranti anda hanya menetapkan semula banyak perkara, termasuk sambungan selular. Langkah 1 – Hanya tekan kekunci naikkan kelantangan sekali dan lepaskan. Seterusnya, tekan kekunci Turun Kelantangan dan lepaskannya semula. Langkah 2 - Bahagian seterusnya proses adalah untuk menahan butang di sebelah kanan. Biarkan iPhone selesai dimulakan semula. Dayakan data selular dan semak kelajuan rangkaian. Semak semula Betulkan 2 – Tukar mod data Walaupun 5G menawarkan kelajuan rangkaian yang lebih baik, ia berfungsi lebih baik apabila isyarat lemah

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Apa? Adakah Zootopia dibawa menjadi realiti oleh AI domestik? Didedahkan bersama-sama dengan video itu ialah model penjanaan video domestik berskala besar baharu yang dipanggil "Keling". Sora menggunakan laluan teknikal yang serupa dan menggabungkan beberapa inovasi teknologi yang dibangunkan sendiri untuk menghasilkan video yang bukan sahaja mempunyai pergerakan yang besar dan munasabah, tetapi juga mensimulasikan ciri-ciri dunia fizikal dan mempunyai keupayaan gabungan konsep dan imaginasi yang kuat. Mengikut data, Keling menyokong penjanaan video ultra panjang sehingga 2 minit pada 30fps, dengan resolusi sehingga 1080p dan menyokong berbilang nisbah aspek. Satu lagi perkara penting ialah Keling bukanlah demo atau demonstrasi hasil video yang dikeluarkan oleh makmal, tetapi aplikasi peringkat produk yang dilancarkan oleh Kuaishou, pemain terkemuka dalam bidang video pendek. Selain itu, tumpuan utama adalah untuk menjadi pragmatik, bukan untuk menulis cek kosong, dan pergi ke dalam talian sebaik sahaja ia dikeluarkan Model besar Ke Ling telah pun dikeluarkan di Kuaiying.

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Saya menangis hingga mati. Dunia sedang membina model besar. Data di Internet tidak mencukupi. Model latihan kelihatan seperti "The Hunger Games", dan penyelidik AI di seluruh dunia bimbang tentang cara memberi makan data ini kepada pemakan yang rakus. Masalah ini amat ketara dalam tugas berbilang modal. Pada masa mereka mengalami kerugian, pasukan pemula dari Jabatan Universiti Renmin China menggunakan model baharu mereka sendiri untuk menjadi yang pertama di China untuk menjadikan "suapan data yang dijana model itu sendiri" menjadi kenyataan. Selain itu, ia merupakan pendekatan serampang dua mata dari segi pemahaman dan sisi penjanaan Kedua-dua pihak boleh menjana data baharu berbilang modal yang berkualiti tinggi dan memberikan maklum balas data kepada model itu sendiri. Apakah model? Awaker 1.0, model berbilang modal besar yang baru sahaja muncul di Forum Zhongguancun. Siapa pasukan itu? Enjin Sophon. Diasaskan oleh Gao Yizhao, pelajar kedoktoran di Sekolah Kecerdasan Buatan Hillhouse Universiti Renmin.