PRO |. Mengapa model besar berdasarkan MoE lebih patut diberi perhatian?

Pada tahun 2023, hampir setiap bidang AI berkembang pada kelajuan yang tidak pernah berlaku sebelum ini Pada masa yang sama, AI sentiasa menolak sempadan teknologi trek utama seperti kecerdasan yang terkandung dan pemanduan autonomi. Di bawah trend berbilang modal, adakah Transformer akan digoncang sebagai seni bina arus perdana untuk model AI yang besar? Mengapakah penerokaan model besar berdasarkan seni bina MoE (Campuran Pakar) menjadi trend baharu dalam industri? Bolehkah Model Penglihatan Besar (LVM) menjadi satu kejayaan baharu dalam penglihatan umum? ...Daripada surat berita ahli PRO 2023 laman web ini yang dikeluarkan dalam tempoh enam bulan lalu, kami telah memilih 10 tafsiran khas yang menyediakan analisis mendalam tentang aliran teknologi dan perubahan industri dalam bidang di atas untuk membantu anda mencapai matlamat anda dalam bidang baharu. tahun. Tafsiran ini datang daripada surat berita industri Week50 2023 ?

Tarikh: 12 Disember

Acara: Mistral AI sumber terbuka model Mixtral 8x7B berdasarkan seni bina MoE (Mixture-of-Experts, Mix of Experts) dan prestasinya mencapai tahap Llama 2 70B dan GPT-3.5" acara telah diadakan Tafsiran lanjutan

Pertama, jelaskan apa itu KPM dan selok-beloknya

1 Konsep:

MoE (Campuran Pakar) adalah model hibrid yang terdiri daripada pelbagai sub-model (iaitu pakar. setiap sub-model Ia adalah model tempatan yang mengkhusus dalam memproses subset ruang input Idea teras KPM ialah menggunakan rangkaian gating untuk memutuskan model mana yang harus dilatih oleh setiap data, dengan itu mengurangkan gangguan antara yang berbeza. jenis sampel.

2. Komponen utama:

Teknologi model pakar campuran (MoE) adalah teknologi pembelajaran mendalam yang dikawal oleh pintu jarang yang terdiri daripada model pakar dan model berpagar merealisasikan pengagihan tugas/data latihan di kalangan pakar yang berbeza model melalui rangkaian berpagar, membolehkan semua orang untuk Setiap model memberi tumpuan kepada tugas yang terbaik, dengan itu mencapai kesederhanaan model

① Dalam latihan rangkaian berpagar, setiap sampel akan diberikan kepada seorang atau lebih pakar; . Pembelajaran ensemble ialah proses melatih pelbagai model (pembelajar asas) untuk menyelesaikan masalah yang sama, dan hanya menggabungkan ramalan mereka (seperti mengundi atau purata). Matlamat utama pembelajaran ensemble adalah untuk meningkatkan prestasi ramalan dengan mengurangkan overfitting dan meningkatkan keupayaan generalisasi. Kaedah pembelajaran ensemble yang biasa termasuk Bagging, Boosting dan Stacking.

Mengapa model besar berasaskan KPM patut diberi perhatian?

1 Secara umumnya, pengembangan skala model akan membawa kepada peningkatan yang ketara dalam kos latihan, dan pengehadan sumber pengkomputeran telah menjadi halangan untuk latihan model intensif berskala besar. Untuk menyelesaikan masalah ini, seni bina model pembelajaran mendalam berdasarkan lapisan MoE yang jarang dicadangkan.2 Model Pakar Campuran Jarang (MoE) ialah seni bina rangkaian saraf khas yang boleh menambah parameter yang boleh dipelajari kepada model bahasa besar (LLM) tanpa meningkatkan kos inferens, manakala penalaan arahan ) ialah teknik untuk melatih LLM mengikut arahan. .

3 Gabungan teknologi penalaan halus arahan MoE+ boleh meningkatkan prestasi model bahasa. Pada Julai 2023, penyelidik dari Google, UC Berkeley, MIT dan institusi lain menerbitkan kertas kerja "Mixture-of-Experts Meets Instruction Tuning: A Winning Combination for Large Language Models", yang membuktikan bahawa model pakar hibrid (MoE) dan penalaan arahan Gabungan ini boleh meningkatkan prestasi model bahasa besar (LLM).① Khususnya, penyelidik menggunakan pengaktifan jarang MoE dalam satu set model pakar hibrid jarang FLAN-MOE yang diperhalusi mengikut arahan, dan menggantikan komponen suapan hadapan lapisan Transformer dengan lapisan MoE untuk menyediakan kapasiti model yang lebih baik dan fleksibiliti pengkomputeran .

② Berdasarkan kaedah di atas, penyelidik mengkaji penalaan halus langsung pada satu tugas hiliran tanpa penalaan arahan, generalisasi beberapa pukulan atau sifar pukulan dalam konteks pada tugas hiliran selepas penalaan arahan, dan dalam penalaan arahan Kemudian kami memperhalusi lagi satu tugas hiliran dan membandingkan perbezaan prestasi LLM di bawah tiga tetapan percubaan.

③ Keputusan eksperimen menunjukkan bahawa tanpa menggunakan penalaan arahan, model MoE selalunya berprestasi lebih teruk daripada model padat dengan kuasa pengiraan yang setanding. Tetapi apabila digabungkan dengan penalaan arahan, perkara berubah. Model MoE yang ditala arahan (Flan-MoE) mengatasi model padat yang lebih besar pada pelbagai tugas, walaupun model MoE hanya satu pertiga sebagai mahal dari segi pengiraan berbanding model padat. Berbanding dengan model padat. Model MoE memperoleh keuntungan prestasi yang lebih ketara daripada penalaan arahan, jadi apabila kecekapan dan prestasi pengkomputeran dipertimbangkan, MoE akan menjadi alat yang berkuasa untuk latihan model bahasa yang besar.

4 Kali ini, model Mixtral 8x7B yang dikeluarkan juga menggunakan rangkaian pakar campuran yang jarang.

① Mixtral 8x7B ialah model penyahkod sahaja. Modul suapan hadapan memilih daripada 8 set parameter yang berbeza. Dalam setiap lapisan rangkaian, untuk setiap token, rangkaian penghala memilih dua daripada lapan kumpulan (pakar) untuk memproses token dan mengagregatkan output mereka.

② Model Mixtral 8x7B sepadan atau mengatasi prestasi Llama 2 70B dan GPT3.5 pada kebanyakan penanda aras, dengan kelajuan inferens 6x lebih pantas.

Kelebihan penting KPM: Apakah sparsity?

1. Dalam model padat tradisional, setiap input perlu dikira dalam model lengkap. Dalam model pakar campuran jarang, hanya beberapa model pakar yang diaktifkan dan digunakan semasa memproses data input, manakala kebanyakan model pakar berada dalam keadaan tidak aktif model. Kelebihan juga merupakan kunci untuk meningkatkan kecekapan latihan model dan proses inferens

Atas ialah kandungan terperinci PRO |. Mengapa model besar berdasarkan MoE lebih patut diberi perhatian?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1674

1674

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

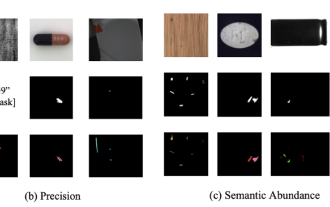

Menerobos sempadan pengesanan kecacatan tradisional, 'Spektrum Kecacatan' mencapai ketepatan ultra tinggi dan pengesanan kecacatan industri semantik yang kaya buat kali pertama.

Jul 26, 2024 pm 05:38 PM

Menerobos sempadan pengesanan kecacatan tradisional, 'Spektrum Kecacatan' mencapai ketepatan ultra tinggi dan pengesanan kecacatan industri semantik yang kaya buat kali pertama.

Jul 26, 2024 pm 05:38 PM

Dalam pembuatan moden, pengesanan kecacatan yang tepat bukan sahaja kunci untuk memastikan kualiti produk, tetapi juga teras untuk meningkatkan kecekapan pengeluaran. Walau bagaimanapun, set data pengesanan kecacatan sedia ada selalunya tidak mempunyai ketepatan dan kekayaan semantik yang diperlukan untuk aplikasi praktikal, menyebabkan model tidak dapat mengenal pasti kategori atau lokasi kecacatan tertentu. Untuk menyelesaikan masalah ini, pasukan penyelidik terkemuka yang terdiri daripada Universiti Sains dan Teknologi Hong Kong Guangzhou dan Teknologi Simou telah membangunkan set data "DefectSpectrum" secara inovatif, yang menyediakan anotasi berskala besar yang kaya dengan semantik bagi kecacatan industri. Seperti yang ditunjukkan dalam Jadual 1, berbanding set data industri lain, set data "DefectSpectrum" menyediakan anotasi kecacatan yang paling banyak (5438 sampel kecacatan) dan klasifikasi kecacatan yang paling terperinci (125 kategori kecacatan

Latihan dengan berjuta-juta data kristal untuk menyelesaikan masalah fasa kristalografi, kaedah pembelajaran mendalam PhAI diterbitkan dalam Sains

Aug 08, 2024 pm 09:22 PM

Latihan dengan berjuta-juta data kristal untuk menyelesaikan masalah fasa kristalografi, kaedah pembelajaran mendalam PhAI diterbitkan dalam Sains

Aug 08, 2024 pm 09:22 PM

Editor |KX Sehingga hari ini, perincian dan ketepatan struktur yang ditentukan oleh kristalografi, daripada logam ringkas kepada protein membran yang besar, tidak dapat ditandingi oleh mana-mana kaedah lain. Walau bagaimanapun, cabaran terbesar, yang dipanggil masalah fasa, kekal mendapatkan maklumat fasa daripada amplitud yang ditentukan secara eksperimen. Penyelidik di Universiti Copenhagen di Denmark telah membangunkan kaedah pembelajaran mendalam yang dipanggil PhAI untuk menyelesaikan masalah fasa kristal Rangkaian saraf pembelajaran mendalam yang dilatih menggunakan berjuta-juta struktur kristal tiruan dan data pembelauan sintetik yang sepadan boleh menghasilkan peta ketumpatan elektron yang tepat. Kajian menunjukkan bahawa kaedah penyelesaian struktur ab initio berasaskan pembelajaran mendalam ini boleh menyelesaikan masalah fasa pada resolusi hanya 2 Angstrom, yang bersamaan dengan hanya 10% hingga 20% daripada data yang tersedia pada resolusi atom, manakala Pengiraan ab initio tradisional

Model dialog NVIDIA ChatQA telah berkembang kepada versi 2.0, dengan panjang konteks disebut pada 128K

Jul 26, 2024 am 08:40 AM

Model dialog NVIDIA ChatQA telah berkembang kepada versi 2.0, dengan panjang konteks disebut pada 128K

Jul 26, 2024 am 08:40 AM

Komuniti LLM terbuka ialah era apabila seratus bunga mekar dan bersaing Anda boleh melihat Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 dan banyak lagi. model yang cemerlang. Walau bagaimanapun, berbanding dengan model besar proprietari yang diwakili oleh GPT-4-Turbo, model terbuka masih mempunyai jurang yang ketara dalam banyak bidang. Selain model umum, beberapa model terbuka yang mengkhusus dalam bidang utama telah dibangunkan, seperti DeepSeek-Coder-V2 untuk pengaturcaraan dan matematik, dan InternVL untuk tugasan bahasa visual.

Google AI memenangi pingat perak IMO Mathematical Olympiad, model penaakulan matematik AlphaProof telah dilancarkan dan pembelajaran pengukuhan kembali

Jul 26, 2024 pm 02:40 PM

Google AI memenangi pingat perak IMO Mathematical Olympiad, model penaakulan matematik AlphaProof telah dilancarkan dan pembelajaran pengukuhan kembali

Jul 26, 2024 pm 02:40 PM

Bagi AI, Olimpik Matematik tidak lagi menjadi masalah. Pada hari Khamis, kecerdasan buatan Google DeepMind menyelesaikan satu kejayaan: menggunakan AI untuk menyelesaikan soalan sebenar IMO Olimpik Matematik Antarabangsa tahun ini, dan ia hanya selangkah lagi untuk memenangi pingat emas. Pertandingan IMO yang baru berakhir minggu lalu mempunyai enam soalan melibatkan algebra, kombinatorik, geometri dan teori nombor. Sistem AI hibrid yang dicadangkan oleh Google mendapat empat soalan dengan betul dan memperoleh 28 mata, mencapai tahap pingat perak. Awal bulan ini, profesor UCLA, Terence Tao baru sahaja mempromosikan Olimpik Matematik AI (Anugerah Kemajuan AIMO) dengan hadiah berjuta-juta dolar Tanpa diduga, tahap penyelesaian masalah AI telah meningkat ke tahap ini sebelum Julai. Lakukan soalan secara serentak pada IMO Perkara yang paling sukar untuk dilakukan dengan betul ialah IMO, yang mempunyai sejarah terpanjang, skala terbesar dan paling negatif

PRO |. Mengapa model besar berdasarkan MoE lebih patut diberi perhatian?

Aug 07, 2024 pm 07:08 PM

PRO |. Mengapa model besar berdasarkan MoE lebih patut diberi perhatian?

Aug 07, 2024 pm 07:08 PM

Pada tahun 2023, hampir setiap bidang AI berkembang pada kelajuan yang tidak pernah berlaku sebelum ini. Pada masa yang sama, AI sentiasa menolak sempadan teknologi trek utama seperti kecerdasan yang terkandung dan pemanduan autonomi. Di bawah trend berbilang modal, adakah status Transformer sebagai seni bina arus perdana model besar AI akan digoncang? Mengapakah penerokaan model besar berdasarkan seni bina MoE (Campuran Pakar) menjadi trend baharu dalam industri? Bolehkah Model Penglihatan Besar (LVM) menjadi satu kejayaan baharu dalam penglihatan umum? ...Daripada surat berita ahli PRO 2023 laman web ini yang dikeluarkan dalam tempoh enam bulan lalu, kami telah memilih 10 tafsiran khas yang menyediakan analisis mendalam tentang aliran teknologi dan perubahan industri dalam bidang di atas untuk membantu anda mencapai matlamat anda dalam bidang baharu. tahun. Tafsiran ini datang dari Week50 2023

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Kadar ketepatan mencapai 60.8%. Model ramalan retrosintesis kimia Universiti Zhejiang berdasarkan Transformer diterbitkan dalam sub-jurnal Nature

Aug 06, 2024 pm 07:34 PM

Kadar ketepatan mencapai 60.8%. Model ramalan retrosintesis kimia Universiti Zhejiang berdasarkan Transformer diterbitkan dalam sub-jurnal Nature

Aug 06, 2024 pm 07:34 PM

Editor |. KX Retrosynthesis ialah tugas kritikal dalam penemuan ubat dan sintesis organik, dan AI semakin digunakan untuk mempercepatkan proses. Kaedah AI sedia ada mempunyai prestasi yang tidak memuaskan dan kepelbagaian terhad. Dalam amalan, tindak balas kimia sering menyebabkan perubahan molekul tempatan, dengan pertindihan yang besar antara bahan tindak balas dan produk. Diilhamkan oleh ini, pasukan Hou Tingjun di Universiti Zhejiang mencadangkan untuk mentakrifkan semula ramalan retrosintetik satu langkah sebagai tugas penyuntingan rentetan molekul, secara berulang menapis rentetan molekul sasaran untuk menghasilkan sebatian prekursor. Dan model retrosintetik berasaskan penyuntingan EditRetro dicadangkan, yang boleh mencapai ramalan berkualiti tinggi dan pelbagai. Eksperimen yang meluas menunjukkan bahawa model itu mencapai prestasi cemerlang pada set data penanda aras standard USPTO-50 K, dengan ketepatan 1 teratas 60.8%.