Peranti teknologi

Peranti teknologi

AI

AI

ICML 2024 |. Imej interaksi watak, kini saya memahami kata-kata segera anda dengan lebih baik, Universiti Peking melancarkan rangka kerja penjanaan imej interaksi watak berdasarkan persepsi semantik

ICML 2024 |. Imej interaksi watak, kini saya memahami kata-kata segera anda dengan lebih baik, Universiti Peking melancarkan rangka kerja penjanaan imej interaksi watak berdasarkan persepsi semantik

ICML 2024 |. Imej interaksi watak, kini saya memahami kata-kata segera anda dengan lebih baik, Universiti Peking melancarkan rangka kerja penjanaan imej interaksi watak berdasarkan persepsi semantik

Lajur AIxiv ialah lajur di mana tapak ini menerbitkan kandungan akademik dan teknikal. Dalam beberapa tahun kebelakangan ini, lajur AIxiv laman web ini telah menerima lebih daripada 2,000 laporan, meliputi makmal terkemuka dari universiti dan syarikat utama di seluruh dunia, mempromosikan pertukaran dan penyebaran akademik secara berkesan. Jika anda mempunyai kerja yang sangat baik yang ingin anda kongsikan, sila berasa bebas untuk menyumbang atau hubungi kami untuk melaporkan. E-mel penyerahan: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com

Penjanaan imej interaksi watak merujuk kepada penjanaan imej yang memenuhi keperluan perihalan teks, dan kandungannya ialah interaksi antara orang dan objek, dan imej itu diperlukan untuk menjadi realistik dan semantik yang mungkin. Dalam tahun-tahun kebelakangan ini, model imej yang dijana teks telah mencapai kemajuan yang ketara dalam menjana imej kehidupan sebenar, tetapi model ini masih menghadapi cabaran dalam menghasilkan imej kesetiaan tinggi dengan interaksi manusia sebagai kandungan utama. Kesukaran terutamanya berpunca daripada dua aspek: pertama, kerumitan dan kepelbagaian postur manusia membawa cabaran kepada penjanaan watak yang munasabah kedua, penjanaan kawasan sempadan interaktif yang tidak boleh dipercayai (kawasan yang kaya dengan semantik interaktif) boleh menyebabkan kegagalan ekspresi semantik interaktif watak; tidak mencukupi.

Sebagai tindak balas kepada masalah di atas, pasukan penyelidik dari Universiti Peking mencadangkan rangka kerja penjanaan imej interaksi manusia yang sedar postur dan interaksi (SA-HOI), yang menggunakan kualiti penjanaan postur manusia dan maklumat kawasan sempadan interaksi sebagai panduan untuk proses denoising imej interaksi watak yang lebih munasabah dan realistik dihasilkan. Untuk menilai secara menyeluruh kualiti imej yang dihasilkan, mereka juga mencadangkan penanda aras penjanaan imej interaksi manusia yang komprehensif.

Pautan kertas: https://proceedings.mlr.press/v235/xu24e.html

-

Laman utama projek: https://sites.google.com/view/sa-hoi/

- Pautan kod sumber: https://github.com/XZPKU/SA-HOI

- Laman utama makmal: http://www.wict.pku.edu.cn/mipl

Pengenalan Kaedah

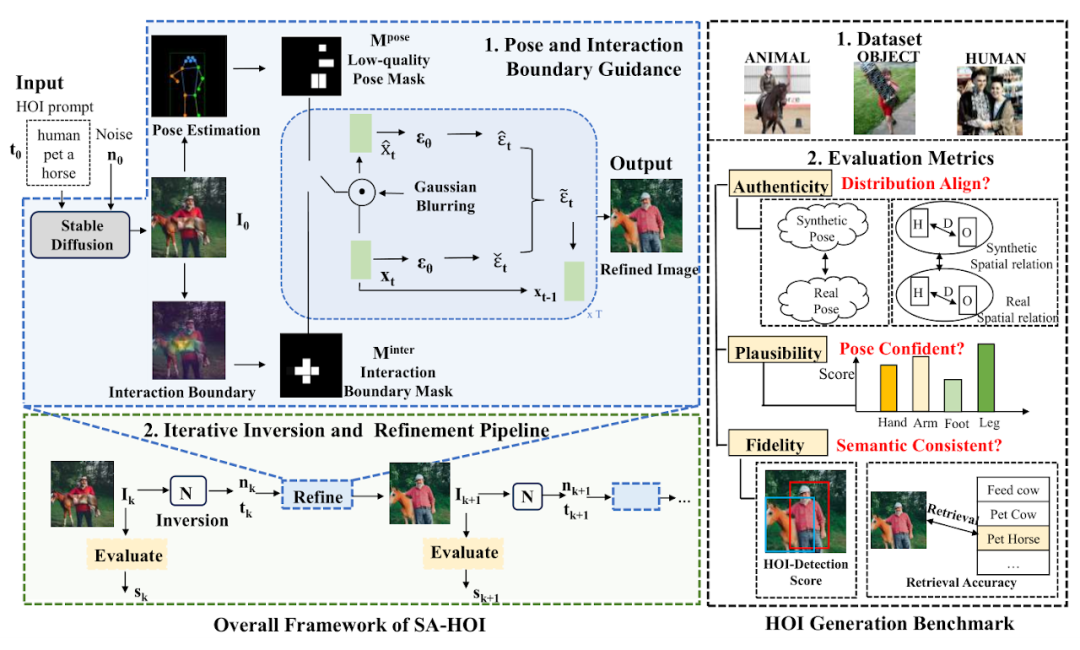

Pengenalan kaedah Panduan postur dan interaktif(Panduan Pose dan Interaksi, PIG) dan Inversion Inversion and Refinement Pipeline

(Iterative Inversion and Refinement Pipeline, IIR).Dalam PIG, untuk penerangan teks interaksi watak tertentu  dan hingar

dan hingar  , model resapan stabil (Resapan Stabil [2]) mula-mula digunakan untuk menjana

, model resapan stabil (Resapan Stabil [2]) mula-mula digunakan untuk menjana  sebagai imej awal dan pengesan pose [3] digunakan untuk mendapatkan kedudukan sendi badan manusia

sebagai imej awal dan pengesan pose [3] digunakan untuk mendapatkan kedudukan sendi badan manusia  dan skor keyakinan yang sepadan

dan skor keyakinan yang sepadan  , membina topeng pose

, membina topeng pose  yang menyerlahkan kawasan pose berkualiti rendah.

yang menyerlahkan kawasan pose berkualiti rendah.

Untuk panduan interaktif, model segmentasi digunakan untuk mengesan kawasan sempadan interaksi, mendapatkan mata utama  dan skor keyakinan yang sepadan

dan skor keyakinan yang sepadan  , dan menyerlahkan kawasan interaksi dalam topeng interaksi

, dan menyerlahkan kawasan interaksi dalam topeng interaksi  untuk meningkatkan ekspresi semantik sempadan interaksi. Untuk setiap langkah denoising,

untuk meningkatkan ekspresi semantik sempadan interaksi. Untuk setiap langkah denoising,  dan

dan  digunakan sebagai kekangan untuk membetulkan kawasan yang diserlahkan ini, dengan itu mengurangkan masalah penjanaan yang wujud di kawasan ini. Di samping itu, IIR digabungkan dengan model penyongsangan imej N untuk mengekstrak bunyi n dan pembenaman t penerangan teks daripada imej yang memerlukan pembetulan lanjut, dan kemudian menggunakan PIG untuk melakukan pembetulan seterusnya pada imej, dan menggunakan kualiti penilai Q untuk menilai kualiti imej yang diperbetulkan Menilai dan menggunakan operasi untuk meningkatkan kualiti imej secara beransur-ansur. 🎙

digunakan sebagai kekangan untuk membetulkan kawasan yang diserlahkan ini, dengan itu mengurangkan masalah penjanaan yang wujud di kawasan ini. Di samping itu, IIR digabungkan dengan model penyongsangan imej N untuk mengekstrak bunyi n dan pembenaman t penerangan teks daripada imej yang memerlukan pembetulan lanjut, dan kemudian menggunakan PIG untuk melakukan pembetulan seterusnya pada imej, dan menggunakan kualiti penilai Q untuk menilai kualiti imej yang diperbetulkan Menilai dan menggunakan operasi untuk meningkatkan kualiti imej secara beransur-ansur. 🎙

Pseudokod persampelan berpandukan pose dan interaksi ditunjukkan dalam Rajah 2. Dalam setiap langkah denoising, kami mula-mula mendapatkan ramalan hingar ϵt dan pembinaan semula perantaraan ϵt seperti yang direka dalam model resapan stabil (Resapan Stabil). Kami kemudian menggunakan Gaussian blur G pada untuk mendapatkan ciri terpendam terdegradasi dan , dan seterusnya memperkenalkan maklumat dalam ciri terpendam yang sepadan ke dalam proses penyahnosan.

dan

dan  digunakan untuk menjana

digunakan untuk menjana  dan

dan  , dan menyerlahkan kawasan kualiti pose rendah dalam

, dan menyerlahkan kawasan kualiti pose rendah dalam  dan

dan  untuk membimbing model mengurangkan penjanaan herotan di kawasan ini. Untuk membimbing model untuk menambah baik kawasan berkualiti rendah, kawasan skor pose rendah akan diserlahkan melalui formula berikut:

untuk membimbing model mengurangkan penjanaan herotan di kawasan ini. Untuk membimbing model untuk menambah baik kawasan berkualiti rendah, kawasan skor pose rendah akan diserlahkan melalui formula berikut:

Di mana  , x, y ialah koordinat piksel demi piksel bagi imej, H, W ialah saiz imej dan σ ialah varians bagi taburan Gaussian.

, x, y ialah koordinat piksel demi piksel bagi imej, H, W ialah saiz imej dan σ ialah varians bagi taburan Gaussian.  mewakili perhatian yang tertumpu pada sendi ke-i Dengan menggabungkan perhatian semua sendi, kita boleh membentuk peta perhatian akhir

mewakili perhatian yang tertumpu pada sendi ke-i Dengan menggabungkan perhatian semua sendi, kita boleh membentuk peta perhatian akhir  dan menggunakan ambang untuk menukar

dan menggunakan ambang untuk menukar  menjadi topeng

menjadi topeng  .

.

di mana ϕt ialah ambang yang menjana topeng pada langkah masa t. Begitu juga, untuk panduan interaktif, pengarang kertas kerja menggunakan model segmentasi untuk mendapatkan titik kontur luar objek O dan titik sendi badan manusia C, mengira matriks jarak D antara orang dan objek, dan sampel titik utama sempadan interaksi  daripadanya, dan penggunaan serta panduan postur Kaedah yang sama menjana perhatian interaktif

daripadanya, dan penggunaan serta panduan postur Kaedah yang sama menjana perhatian interaktif  dan topeng

dan topeng  dan digunakan untuk mengira hingar ramalan akhir.

dan digunakan untuk mengira hingar ramalan akhir.

Penyongsangan berulang dan proses pembetulan imej

Untuk mendapatkan penilaian kualiti imej yang dijana dalam masa nyata, pengarang kertas kerja memperkenalkan penilai kualiti Q sebagai panduan untuk operasi berulang. Untuk imej pusingan ke-k  , penilai Q digunakan untuk mendapatkan skor kualitinya

, penilai Q digunakan untuk mendapatkan skor kualitinya  , dan kemudian

, dan kemudian  dijana berdasarkan

dijana berdasarkan  . Untuk mengekalkan kandungan utama

. Untuk mengekalkan kandungan utama  selepas pengoptimuman, hingar yang sepadan diperlukan sebagai nilai awal untuk denoising.

selepas pengoptimuman, hingar yang sepadan diperlukan sebagai nilai awal untuk denoising.

Walau bagaimanapun, hingar sedemikian tidak tersedia, jadi kaedah penyongsangan imej  diperkenalkan untuk mendapatkan ciri potensi hingar

diperkenalkan untuk mendapatkan ciri potensi hingar  dan pembenaman teks

dan pembenaman teks  , sebagai input PIG, untuk menjana hasil yang dioptimumkan

, sebagai input PIG, untuk menjana hasil yang dioptimumkan  .

.

반복 라운드 전후의 품질 점수를 비교하여 최적화를 계속할지 여부를 판단할 수 있습니다.  와

와  사이에 큰 차이가 없는 경우, 즉 임계값 θ 미만인 경우 프로세스가 이미지를 충분히 개선하여 최적화를 종료하고 가장 높은 품질 점수의 이미지를 출력합니다.

사이에 큰 차이가 없는 경우, 즉 임계값 θ 미만인 경우 프로세스가 이미지를 충분히 개선하여 최적화를 종료하고 가장 높은 품질 점수의 이미지를 출력합니다.

캐릭터 상호작용 이미지 생성 벤치마크

>

>

실험 결과

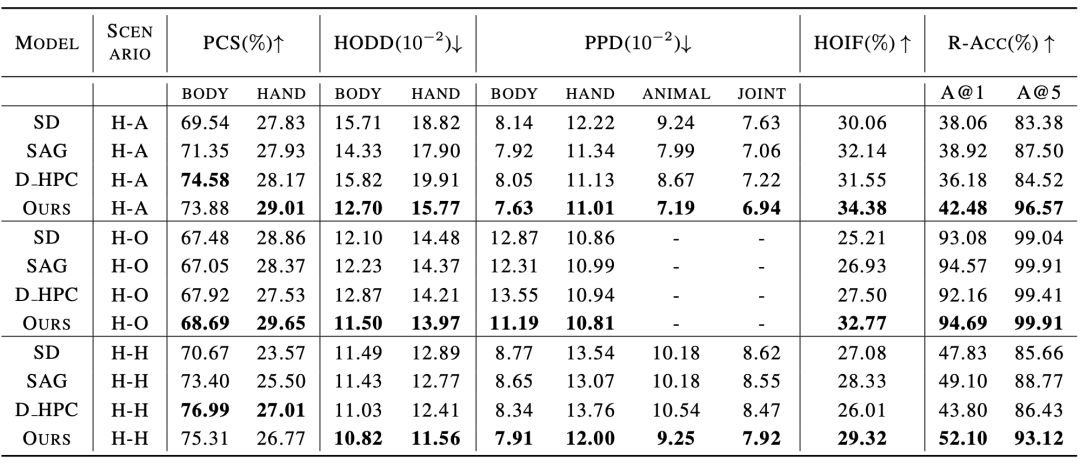

기존 방법과의 비교 실험 결과는 캐릭터 상호작용 이미지 생성 지표와 기존 이미지 생성 지표의 성능을 각각 비교한 Table 1과 Table 2와 같다. 표 2: 기존 이미지 생성 지표에서 기존 방법과의 비교 실험 결과

실험 결과는 본 논문의 방법이 인간과 같은 다차원에서 기존 모델보다 우수하다는 것을 보여줍니다. 신체 생성 품질, 상호 작용 의미 표현, 인간 상호 작용 거리, 인간 자세 분포 및 전반적인 이미지 품질.

실험 결과는 본 논문의 방법이 인간과 같은 다차원에서 기존 모델보다 우수하다는 것을 보여줍니다. 신체 생성 품질, 상호 작용 의미 표현, 인간 상호 작용 거리, 인간 자세 분포 및 전반적인 이미지 품질.

또한 논문의 저자는 주관적인 평가를 실시하여 많은 사용자를 대상으로 인체 품질, 사물 외관, 대화형 의미 및 전반적인 품질 등 다양한 관점에서 평가하도록 했습니다. 실험 결과는 SA-HOI 방법이 우수함을 입증합니다. 모든 각도에서 인간의 미학과 더 일치합니다.

표 3: 기존 방법을 사용한 주관적 평가 결과

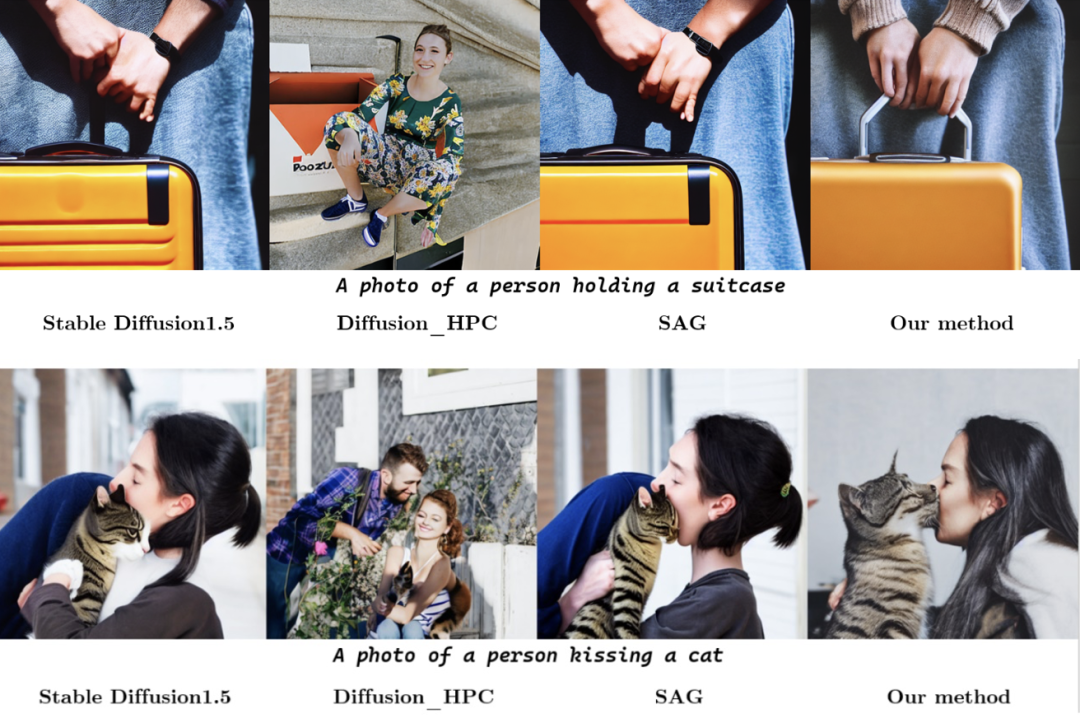

정성적 실험에서 아래 그림은 동일한 캐릭터 상호작용 카테고리 설명에 대해 다양한 방법으로 생성된 결과를 비교한 것입니다. 위의 사진 그룹에서 새로운 방법을 사용한 모델은 "키스"의 의미를 정확하게 표현하고 생성된 인체 자세도 더욱 합리적입니다. 아래 사진 그룹에서 논문의 방법은 다른 방법에 존재하는 인체의 왜곡과 뒤틀림을 성공적으로 완화하고 손이 닿는 부분에 여행 가방의 레버를 생성하여 "여행 가방 가져가기"의 상호 작용을 향상시킵니다. 의미론적 표현을 통해 인체 자세와 상호작용 의미론 모두에서 다른 방법보다 우수한 결과를 얻습니다. ㅋㅋㅋ ~ .

참고 자료:

참고 자료:

[1] Rombach, R., Blattmann, A., Lorenz, D., Esser, P. 및 Ommer, B. Proceedings에서 잠재 확산 모델을 사용한 고해상도 이미지 합성. IEEE/CVF

컴퓨터 비전 및 패턴 인식(CVPR) 컨퍼런스, 페이지 10684–10695, 2022년 6월

[2] HuggingFace, 2022. URL https://huggingface . co/CompVis/stable-diffusion-v1-4.

[3] Chen, K., Wang, J., Pang, J., Cao, Y., Xiong, Y., Li, X . , Sun, S., Feng, W., Liu, Z., Xu, J., Zhang, Z., Cheng, D., Zhu, C

., Cheng, T., Zhao, Q., Li, B., Lu, X., Zhu, R., Wu, Y., Dai, J., Wang, J., Shi, J., Ouyang, W., Loy, C. C. 및 Lin, D. MM감지: 공개 mmlab 감지 도구 상자 및 벤치마크 arXiv:1906.07155, 2019.[4] Ron Mokady, Amir Hertz, Kfir Aberman, Yael Pritch 및 Daniel Cohen-Or Null-

텍스트 arXiv preprint

arXiv:2211.09794, 2022.

[5] Yu-Wei Chao, Zhan Wang, Yugeng He, Jiaxuan Wang 및 Jia Deng HICO: 이미지에서 인간과 사물의 상호 작용을 인식하기 위한 벤치마크, 컴퓨터 비전에 관한 IEEE 국제 컨퍼런스 진행, 2015.

Atas ialah kandungan terperinci ICML 2024 |. Imej interaksi watak, kini saya memahami kata-kata segera anda dengan lebih baik, Universiti Peking melancarkan rangka kerja penjanaan imej interaksi watak berdasarkan persepsi semantik. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Robot DeepMind bermain pingpong, dan pukulan depan dan pukulan kilasnya tergelincir ke udara, mengalahkan manusia pemula sepenuhnya

Aug 09, 2024 pm 04:01 PM

Robot DeepMind bermain pingpong, dan pukulan depan dan pukulan kilasnya tergelincir ke udara, mengalahkan manusia pemula sepenuhnya

Aug 09, 2024 pm 04:01 PM

Tetapi mungkin dia tidak dapat mengalahkan lelaki tua di taman itu? Sukan Olimpik Paris sedang rancak berlangsung, dan pingpong telah menarik perhatian ramai. Pada masa yang sama, robot juga telah membuat penemuan baru dalam bermain pingpong. Sebentar tadi, DeepMind mencadangkan ejen robot pembelajaran pertama yang boleh mencapai tahap pemain amatur manusia dalam pingpong yang kompetitif. Alamat kertas: https://arxiv.org/pdf/2408.03906 Sejauh manakah robot DeepMind bermain pingpong? Mungkin setanding dengan pemain amatur manusia: kedua-dua pukulan depan dan pukulan kilas: pihak lawan menggunakan pelbagai gaya permainan, dan robot juga boleh bertahan: servis menerima dengan putaran yang berbeza: Walau bagaimanapun, keamatan permainan nampaknya tidak begitu sengit seperti lelaki tua di taman itu. Untuk robot, pingpong

Cakar mekanikal pertama! Yuanluobao muncul di Persidangan Robot Dunia 2024 dan mengeluarkan robot catur pertama yang boleh memasuki rumah

Aug 21, 2024 pm 07:33 PM

Cakar mekanikal pertama! Yuanluobao muncul di Persidangan Robot Dunia 2024 dan mengeluarkan robot catur pertama yang boleh memasuki rumah

Aug 21, 2024 pm 07:33 PM

Pada 21 Ogos, Persidangan Robot Dunia 2024 telah diadakan dengan megah di Beijing. Jenama robot rumah SenseTime "Yuanluobot SenseRobot" telah memperkenalkan seluruh keluarga produknya, dan baru-baru ini mengeluarkan robot permainan catur AI Yuanluobot - Edisi Profesional Catur (selepas ini dirujuk sebagai "Yuanluobot SenseRobot"), menjadi robot catur A pertama di dunia untuk rumah. Sebagai produk robot permainan catur ketiga Yuanluobo, robot Guoxiang baharu telah melalui sejumlah besar peningkatan teknikal khas dan inovasi dalam AI dan jentera kejuruteraan Buat pertama kalinya, ia telah menyedari keupayaan untuk mengambil buah catur tiga dimensi melalui cakar mekanikal pada robot rumah, dan melaksanakan Fungsi mesin manusia seperti bermain catur, semua orang bermain catur, semakan notasi, dsb.

Claude pun dah jadi malas! Netizen: Belajar untuk memberi percutian kepada diri sendiri

Sep 02, 2024 pm 01:56 PM

Claude pun dah jadi malas! Netizen: Belajar untuk memberi percutian kepada diri sendiri

Sep 02, 2024 pm 01:56 PM

Permulaan sekolah akan bermula, dan bukan hanya pelajar yang akan memulakan semester baharu yang harus menjaga diri mereka sendiri, tetapi juga model AI yang besar. Beberapa ketika dahulu, Reddit dipenuhi oleh netizen yang mengadu Claude semakin malas. "Tahapnya telah banyak menurun, ia sering berhenti seketika, malah output menjadi sangat singkat. Pada minggu pertama keluaran, ia boleh menterjemah dokumen penuh 4 halaman sekaligus, tetapi kini ia tidak dapat mengeluarkan separuh halaman pun. !" https:// www.reddit.com/r/ClaudeAI/comments/1by8rw8/something_just_feels_wrong_with_claude_in_the/ dalam siaran bertajuk "Totally disappointed with Claude", penuh dengan

Pada Persidangan Robot Sedunia, robot domestik yang membawa 'harapan penjagaan warga tua masa depan' ini telah dikepung

Aug 22, 2024 pm 10:35 PM

Pada Persidangan Robot Sedunia, robot domestik yang membawa 'harapan penjagaan warga tua masa depan' ini telah dikepung

Aug 22, 2024 pm 10:35 PM

Pada Persidangan Robot Dunia yang diadakan di Beijing, paparan robot humanoid telah menjadi tumpuan mutlak di gerai Stardust Intelligent, pembantu robot AI S1 mempersembahkan tiga persembahan utama dulcimer, seni mempertahankan diri dan kaligrafi dalam. satu kawasan pameran, berkebolehan kedua-dua sastera dan seni mempertahankan diri, menarik sejumlah besar khalayak profesional dan media. Permainan elegan pada rentetan elastik membolehkan S1 menunjukkan operasi halus dan kawalan mutlak dengan kelajuan, kekuatan dan ketepatan. CCTV News menjalankan laporan khas mengenai pembelajaran tiruan dan kawalan pintar di sebalik "Kaligrafi Pengasas Syarikat Lai Jie menjelaskan bahawa di sebalik pergerakan sutera, bahagian perkakasan mengejar kawalan daya terbaik dan penunjuk badan yang paling menyerupai manusia (kelajuan, beban). dll.), tetapi di sisi AI, data pergerakan sebenar orang dikumpulkan, membolehkan robot menjadi lebih kuat apabila ia menghadapi situasi yang kuat dan belajar untuk berkembang dengan cepat. Dan tangkas

Anugerah ACL 2024 Diumumkan: Salah satu Kertas Terbaik mengenai Pentafsiran Oracle oleh HuaTech, Anugerah Ujian Masa GloVe

Aug 15, 2024 pm 04:37 PM

Anugerah ACL 2024 Diumumkan: Salah satu Kertas Terbaik mengenai Pentafsiran Oracle oleh HuaTech, Anugerah Ujian Masa GloVe

Aug 15, 2024 pm 04:37 PM

Pada persidangan ACL ini, para penyumbang telah mendapat banyak keuntungan. ACL2024 selama enam hari diadakan di Bangkok, Thailand. ACL ialah persidangan antarabangsa teratas dalam bidang linguistik pengiraan dan pemprosesan bahasa semula jadi Ia dianjurkan oleh Persatuan Antarabangsa untuk Linguistik Pengiraan dan diadakan setiap tahun. ACL sentiasa menduduki tempat pertama dalam pengaruh akademik dalam bidang NLP, dan ia juga merupakan persidangan yang disyorkan CCF-A. Persidangan ACL tahun ini adalah yang ke-62 dan telah menerima lebih daripada 400 karya termaju dalam bidang NLP. Petang semalam, persidangan itu mengumumkan kertas kerja terbaik dan anugerah lain. Kali ini, terdapat 7 Anugerah Kertas Terbaik (dua tidak diterbitkan), 1 Anugerah Kertas Tema Terbaik, dan 35 Anugerah Kertas Cemerlang. Persidangan itu turut menganugerahkan 3 Anugerah Kertas Sumber (ResourceAward) dan Anugerah Impak Sosial (

Pasukan Li Feifei mencadangkan ReKep untuk memberi robot kecerdasan spatial dan mengintegrasikan GPT-4o

Sep 03, 2024 pm 05:18 PM

Pasukan Li Feifei mencadangkan ReKep untuk memberi robot kecerdasan spatial dan mengintegrasikan GPT-4o

Sep 03, 2024 pm 05:18 PM

Penyepaduan mendalam penglihatan dan pembelajaran robot. Apabila dua tangan robot bekerja bersama-sama dengan lancar untuk melipat pakaian, menuang teh dan mengemas kasut, ditambah pula dengan 1X robot humanoid NEO yang telah menjadi tajuk berita baru-baru ini, anda mungkin mempunyai perasaan: kita seolah-olah memasuki zaman robot. Malah, pergerakan sutera ini adalah hasil teknologi robotik canggih + reka bentuk bingkai yang indah + model besar berbilang modal. Kami tahu bahawa robot yang berguna sering memerlukan interaksi yang kompleks dan indah dengan alam sekitar, dan persekitaran boleh diwakili sebagai kekangan dalam domain spatial dan temporal. Sebagai contoh, jika anda ingin robot menuang teh, robot terlebih dahulu perlu menggenggam pemegang teko dan memastikannya tegak tanpa menumpahkan teh, kemudian gerakkannya dengan lancar sehingga mulut periuk sejajar dengan mulut cawan. , dan kemudian condongkan teko pada sudut tertentu. ini

Hongmeng Smart Travel S9 dan persidangan pelancaran produk baharu senario penuh, beberapa produk baharu blockbuster dikeluarkan bersama-sama

Aug 08, 2024 am 07:02 AM

Hongmeng Smart Travel S9 dan persidangan pelancaran produk baharu senario penuh, beberapa produk baharu blockbuster dikeluarkan bersama-sama

Aug 08, 2024 am 07:02 AM

Petang ini, Hongmeng Zhixing secara rasmi mengalu-alukan jenama baharu dan kereta baharu. Pada 6 Ogos, Huawei mengadakan persidangan pelancaran produk baharu Hongmeng Smart Xingxing S9 dan senario penuh Huawei, membawakan sedan perdana pintar panoramik Xiangjie S9, M7Pro dan Huawei novaFlip baharu, MatePad Pro 12.2 inci, MatePad Air baharu, Huawei Bisheng With banyak produk pintar semua senario baharu termasuk pencetak laser siri X1, FreeBuds6i, WATCHFIT3 dan skrin pintar S5Pro, daripada perjalanan pintar, pejabat pintar kepada pakaian pintar, Huawei terus membina ekosistem pintar senario penuh untuk membawa pengguna pengalaman pintar Internet Segala-galanya. Hongmeng Zhixing: Pemerkasaan mendalam untuk menggalakkan peningkatan industri kereta pintar Huawei berganding bahu dengan rakan industri automotif China untuk menyediakan

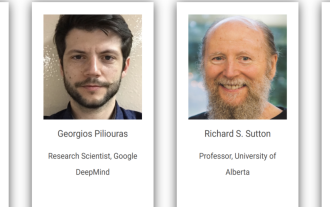

Persidangan Kecerdasan Buatan Teragih DAI 2024 Call for Papers: Hari Agen, Richard Sutton, bapa pembelajaran pengukuhan, akan hadir! Yan Shuicheng, Sergey Levine dan saintis DeepMind akan memberikan ucaptama

Aug 22, 2024 pm 08:02 PM

Persidangan Kecerdasan Buatan Teragih DAI 2024 Call for Papers: Hari Agen, Richard Sutton, bapa pembelajaran pengukuhan, akan hadir! Yan Shuicheng, Sergey Levine dan saintis DeepMind akan memberikan ucaptama

Aug 22, 2024 pm 08:02 PM

Pengenalan Persidangan Dengan perkembangan pesat sains dan teknologi, kecerdasan buatan telah menjadi kuasa penting dalam menggalakkan kemajuan sosial. Dalam era ini, kami bertuah untuk menyaksikan dan mengambil bahagian dalam inovasi dan aplikasi Kecerdasan Buatan Teragih (DAI). Kecerdasan buatan yang diedarkan adalah cabang penting dalam bidang kecerdasan buatan, yang telah menarik lebih banyak perhatian dalam beberapa tahun kebelakangan ini. Agen berdasarkan model bahasa besar (LLM) tiba-tiba muncul Dengan menggabungkan pemahaman bahasa yang kuat dan keupayaan penjanaan model besar, mereka telah menunjukkan potensi besar dalam interaksi bahasa semula jadi, penaakulan pengetahuan, perancangan tugas, dsb. AIAgent mengambil alih model bahasa besar dan telah menjadi topik hangat dalam kalangan AI semasa. Au