hujung hadapan web

hujung hadapan web

tutorial js

tutorial js

Membina Ejen AI Bertanggungjawab: Mengimbangi Inovasi dan Etika

Membina Ejen AI Bertanggungjawab: Mengimbangi Inovasi dan Etika

Membina Ejen AI Bertanggungjawab: Mengimbangi Inovasi dan Etika

Kecerdasan Buatan (AI) sedang mengubah industri, dengan ejen AI autonomi seperti Salesforce's AgentForce dan alatan sumber terbuka seperti AutoGPT mengetuai caj. Ejen ini mengautomasikan tugas yang kompleks, bekerjasama dengan sistem lain dan meningkatkan produktiviti. Walau bagaimanapun, apabila mereka menjadi lebih autonomi, keperluan untuk pembangunan AI yang bertanggungjawab adalah penting untuk menangani isu seperti berat sebelah, ketelusan dan akauntabiliti.

Penggunaan pantas ejen AI telah mencetuskan perdebatan tentang implikasi etika mereka. Walaupun mereka menawarkan potensi besar untuk merevolusikan industri seperti penjagaan kesihatan, pendidikan dan jualan, mereka juga menimbulkan risiko jika tidak direka secara bertanggungjawab. Pembangun, organisasi dan kerajaan mesti bekerjasama untuk memastikan sistem ini adalah inovatif dan beretika.

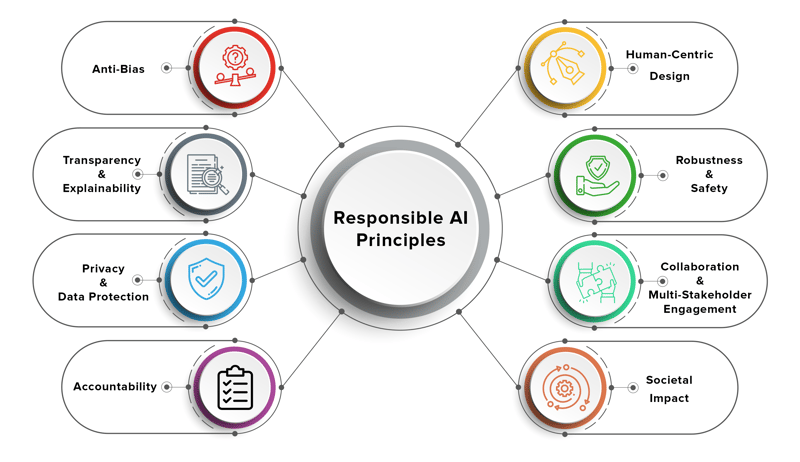

Apakah Maksud Membina Ejen AI Bertanggungjawab?

Ejen AI yang bertanggungjawab direka bentuk untuk beretika, telus dan bertanggungjawab, memastikan mereka sejajar dengan nilai kemanusiaan dan meminimumkan bahaya. Ejen ini mesti beroperasi secara adil, menghormati privasi dan memberikan penjelasan yang jelas untuk keputusan mereka.

Prinsip utama AI yang bertanggungjawab termasuk:

- Kesaksamaan: Mengelakkan berat sebelah dalam membuat keputusan dan memastikan hasil yang saksama untuk semua pengguna.

- Ketelusan: Membuat keputusan AI boleh difahami oleh pengguna dan pihak berkepentingan.

- Accountability: Mewujudkan tanggungjawab untuk hasil AI dan memastikan sistem boleh diaudit.

- Privasi: Melindungi data pengguna dan memastikan operasi selamat.

- Kemampanan: Mereka bentuk sistem AI yang cekap tenaga dan mesra alam.

Membina AI yang bertanggungjawab bukan sekadar cabaran teknikal—ia merupakan usaha pelbagai disiplin yang memerlukan kerjasama antara pembangun, ahli etika, penggubal dasar dan pengguna akhir.

Contoh Dilema Etika dalam Sistem AI

Apabila ejen AI menjadi lebih autonomi, mereka menghadapi dilema etika yang mencabar reka bentuk dan penggunaan mereka. Berikut ialah beberapa contoh dunia sebenar:

1. Bias dalam Membuat Keputusan

Ejen AI yang dilatih mengenai set data berat sebelah boleh membuat keputusan yang mendiskriminasi. Contohnya:

- Ejen pengambilan pekerja mungkin lebih mengutamakan demografi tertentu berbanding yang lain disebabkan kecenderungan sejarah dalam data pengambilan.

- Ejen AI kewangan mungkin menafikan pinjaman kepada kumpulan tertentu berdasarkan model pemarkahan kredit yang berat sebelah.

2. Kurang Ketelusan

Banyak ejen AI beroperasi sebagai "kotak hitam," membuat keputusan yang sukar untuk ditafsir atau dijelaskan. Contohnya:

- Ejen AI perkhidmatan pelanggan mungkin meningkatkan atau menyelesaikan isu tanpa memberikan alasan yang jelas, yang membawa kepada kekecewaan dan ketidakpercayaan di kalangan pengguna.

3. Jurang Akauntabiliti

Apabila ejen AI membuat kesilapan, siapa yang bertanggungjawab? Contohnya:

- Jika kenderaan autonomi yang dikawal oleh ejen AI menyebabkan kemalangan, adakah pemaju, pengilang atau pengguna dipersalahkan?

4. Pelanggaran Privasi

Ejen AI selalunya memerlukan akses kepada data pengguna yang sensitif untuk berfungsi dengan berkesan. Walau bagaimanapun:

- Ejen jualan AI mungkin secara tidak sengaja berkongsi maklumat sulit pelanggan, melanggar undang-undang privasi seperti GDPR.

5. Penggunaan AI yang Beretika dalam Jualan dan Pemasaran

Alat seperti Salesforce's AgentForce sedang mengubah jualan dan pemasaran dengan mengautomasikan penjanaan petunjuk dan penglibatan pelanggan. Walau bagaimanapun:

- Jika ejen AI menggunakan taktik manipulatif untuk menjual produk, ia menimbulkan persoalan tentang amalan pemasaran beretika.

Dilema ini menyerlahkan kepentingan untuk membenamkan pertimbangan etika ke dalam reka bentuk dan penggunaan ejen AI.

Rangka Kerja dan Amalan Terbaik untuk Pembangunan AI Bertanggungjawab

Untuk menangani cabaran ini, pembangun dan organisasi boleh mengguna pakai rangka kerja dan amalan terbaik berikut:

1. Rangka Kerja AI Beretika

Beberapa organisasi telah membangunkan garis panduan untuk AI yang bertanggungjawab, termasuk:

- Prinsip AI Google: Memfokuskan pada keadilan, privasi dan kebertanggungjawaban.

- Prinsip AI OECD: Menekankan nilai berpusatkan manusia dan ketelusan.

- Garis Panduan AI Etika Salesforce: Bertujuan untuk membina kepercayaan dan memastikan keadilan dalam sistem AI.

2. Mitigasi Berat sebelah

- Gunakan set data yang pelbagai dan mewakili untuk melatih ejen AI.

- Secara kerap mengaudit model AI untuk berat sebelah dan latih semula model tersebut mengikut keperluan.

- Laksanakan metrik kesaksamaan untuk menilai kesan keputusan AI ke atas kumpulan berbeza.

3. Kebolehjelasan dan Ketelusan

- Gunakan teknik seperti S*HAP (SHapley Additive exPlanations)* atau LIME (Local Interpretable Model-agnostic Explanations) untuk membuat keputusan AI boleh ditafsirkan.

- Berikan kepada pengguna penjelasan yang jelas tentang cara ejen AI membuat keputusan.

4. Mekanisme Akauntabiliti

- Tubuhkan struktur tadbir urus yang jelas untuk projek AI.

- Tugaskan tanggungjawab untuk hasil AI kepada pasukan atau individu tertentu.

- Selenggarakan log terperinci tindakan ejen AI untuk tujuan pengauditan.

5. Privasi dan Keselamatan

- Gunakan penyulitan dan protokol selamat untuk melindungi data pengguna.

- Laksanakan teknik privasi berbeza untuk menamakan maklumat sensitif.

- Patuhi peraturan perlindungan data seperti GDPR dan CCPA.

6. Pemantauan dan Maklum Balas Berterusan

- Pantau ejen AI dalam masa nyata untuk mengesan dan menangani isu.

- Kumpul maklum balas pengguna untuk meningkatkan prestasi dan penjajaran etika ejen AI.

- Kemas kini model AI secara kerap untuk mencerminkan perubahan norma dan nilai masyarakat.

Peranan Pihak Berkepentingan

Membina ejen AI yang bertanggungjawab ialah tanggungjawab bersama yang memerlukan kerjasama merentas pelbagai pihak berkepentingan:

Kerajaan

- Menggubal peraturan untuk memastikan sistem AI adil, telus dan bertanggungjawab.

- Menggalakkan penyelidikan dan pembangunan dalam AI beretika.

- Tubuhkan badan pengawasan untuk memantau penggunaan ejen AI.

Organisasi

- Membangunkan dasar dan garis panduan dalaman untuk AI yang bertanggungjawab.

- Melabur dalam program latihan untuk mendidik pekerja tentang amalan AI beretika.

- Berkongsi dengan institusi akademik dan badan bukan untung untuk memajukan penyelidikan AI beretika.

Pembangun

- Utamakan pertimbangan etika semasa reka bentuk dan pembangunan ejen AI.

- Memperjuangkan amalan AI yang bertanggungjawab dalam organisasi mereka.

- Kekal dimaklumkan tentang kemajuan terkini dalam rangka kerja dan alatan AI beretika.

Salesforce dan AgentForce: Kajian Kes

Salesforce, peneraju dalam pengurusan perhubungan pelanggan (CRM), telah berada di barisan hadapan dalam pembangunan AI yang bertanggungjawab. Platform AgentForce mereka memanfaatkan ejen AI untuk mengautomasikan proses jualan, meningkatkan penglibatan pelanggan dan memacu pertumbuhan perniagaan.

Apa yang membezakan Salesforce ialah komitmennya terhadap AI yang beretika. Syarikat itu telah melaksanakan garis panduan yang teguh untuk memastikan sistem AInya adil, telus dan bertanggungjawab. Contohnya:

- Pengesanan Bias: Salesforce menggunakan alatan untuk mengenal pasti dan mengurangkan berat sebelah dalam model AInya.

- Kebolehjelasan: AgentForce menyediakan pengguna dengan cerapan yang jelas tentang cara pengesyoran dipacu AI dibuat.

- Privasi: Salesforce memastikan data pelanggan dikendalikan dengan selamat dan mematuhi peraturan global.

Dengan mengutamakan AI yang bertanggungjawab, Salesforce telah menetapkan penanda aras untuk diikuti oleh organisasi lain.

Kesimpulan

Apabila ejen AI menjadi lebih autonomi, mengimbangi inovasi dengan etika adalah penting. Dengan menangani isu seperti berat sebelah, ketelusan dan akauntabiliti, kami boleh memastikan bahawa ejen AI bukan sahaja inovatif tetapi juga beretika.

Membina ejen AI yang bertanggungjawab memerlukan usaha kolaboratif antara pembangun, organisasi dan kerajaan. Dengan mengguna pakai rangka kerja etika, mengurangkan berat sebelah dan memastikan ketelusan, kami boleh mencipta sistem AI yang memberi manfaat kepada masyarakat sambil meminimumkan bahaya. Alat seperti Salesforce’s AgentForce menunjukkan cara AI yang bertanggungjawab boleh memacu inovasi sambil mengekalkan kepercayaan dan keadilan.

Masa depan AI adalah cerah, tetapi terpulang kepada kita untuk memastikan ia juga bertanggungjawab.

Atas ialah kandungan terperinci Membina Ejen AI Bertanggungjawab: Mengimbangi Inovasi dan Etika. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Apa yang perlu saya lakukan jika saya menghadapi percetakan kod yang dihiasi untuk resit kertas terma depan?

Apr 04, 2025 pm 02:42 PM

Apa yang perlu saya lakukan jika saya menghadapi percetakan kod yang dihiasi untuk resit kertas terma depan?

Apr 04, 2025 pm 02:42 PM

Soalan dan penyelesaian yang sering ditanya untuk percetakan tiket kertas terma depan dalam pembangunan front-end, percetakan tiket adalah keperluan umum. Walau bagaimanapun, banyak pemaju sedang melaksanakan ...

Demystifying JavaScript: Apa yang berlaku dan mengapa penting

Apr 09, 2025 am 12:07 AM

Demystifying JavaScript: Apa yang berlaku dan mengapa penting

Apr 09, 2025 am 12:07 AM

JavaScript adalah asas kepada pembangunan web moden, dan fungsi utamanya termasuk pengaturcaraan yang didorong oleh peristiwa, penjanaan kandungan dinamik dan pengaturcaraan tak segerak. 1) Pengaturcaraan yang didorong oleh peristiwa membolehkan laman web berubah secara dinamik mengikut operasi pengguna. 2) Penjanaan kandungan dinamik membolehkan kandungan halaman diselaraskan mengikut syarat. 3) Pengaturcaraan Asynchronous memastikan bahawa antara muka pengguna tidak disekat. JavaScript digunakan secara meluas dalam interaksi web, aplikasi satu halaman dan pembangunan sisi pelayan, sangat meningkatkan fleksibiliti pengalaman pengguna dan pembangunan silang platform.

Siapa yang dibayar lebih banyak Python atau JavaScript?

Apr 04, 2025 am 12:09 AM

Siapa yang dibayar lebih banyak Python atau JavaScript?

Apr 04, 2025 am 12:09 AM

Tidak ada gaji mutlak untuk pemaju Python dan JavaScript, bergantung kepada kemahiran dan keperluan industri. 1. Python boleh dibayar lebih banyak dalam sains data dan pembelajaran mesin. 2. JavaScript mempunyai permintaan yang besar dalam perkembangan depan dan stack penuh, dan gajinya juga cukup besar. 3. Faktor mempengaruhi termasuk pengalaman, lokasi geografi, saiz syarikat dan kemahiran khusus.

Adakah JavaScript sukar belajar?

Apr 03, 2025 am 12:20 AM

Adakah JavaScript sukar belajar?

Apr 03, 2025 am 12:20 AM

Pembelajaran JavaScript tidak sukar, tetapi ia mencabar. 1) Memahami konsep asas seperti pembolehubah, jenis data, fungsi, dan sebagainya. 2) Pengaturcaraan asynchronous tuan dan melaksanakannya melalui gelung acara. 3) Gunakan operasi DOM dan berjanji untuk mengendalikan permintaan tak segerak. 4) Elakkan kesilapan biasa dan gunakan teknik debugging. 5) Mengoptimumkan prestasi dan mengikuti amalan terbaik.

Bagaimana untuk mencapai kesan menatal paralaks dan kesan animasi elemen, seperti laman web rasmi Shiseido?

atau:

Bagaimanakah kita dapat mencapai kesan animasi yang disertai dengan menatal halaman seperti laman web rasmi Shiseido?

Apr 04, 2025 pm 05:36 PM

Bagaimana untuk mencapai kesan menatal paralaks dan kesan animasi elemen, seperti laman web rasmi Shiseido?

atau:

Bagaimanakah kita dapat mencapai kesan animasi yang disertai dengan menatal halaman seperti laman web rasmi Shiseido?

Apr 04, 2025 pm 05:36 PM

Perbincangan mengenai realisasi kesan animasi tatal dan elemen Parallax dalam artikel ini akan meneroka bagaimana untuk mencapai yang serupa dengan laman web rasmi Shiseido (https://www.shiseido.co.jp/sb/wonderland/) ... ...

Evolusi JavaScript: Trend Semasa dan Prospek Masa Depan

Apr 10, 2025 am 09:33 AM

Evolusi JavaScript: Trend Semasa dan Prospek Masa Depan

Apr 10, 2025 am 09:33 AM

Trend terkini dalam JavaScript termasuk kebangkitan TypeScript, populariti kerangka dan perpustakaan moden, dan penerapan webassembly. Prospek masa depan meliputi sistem jenis yang lebih berkuasa, pembangunan JavaScript, pengembangan kecerdasan buatan dan pembelajaran mesin, dan potensi pengkomputeran IoT dan kelebihan.

Bagaimana untuk menggabungkan elemen array dengan ID yang sama ke dalam satu objek menggunakan JavaScript?

Apr 04, 2025 pm 05:09 PM

Bagaimana untuk menggabungkan elemen array dengan ID yang sama ke dalam satu objek menggunakan JavaScript?

Apr 04, 2025 pm 05:09 PM

Bagaimana cara menggabungkan elemen array dengan ID yang sama ke dalam satu objek dalam JavaScript? Semasa memproses data, kita sering menghadapi keperluan untuk mempunyai id yang sama ...

Perbezaan dalam Konsol.Log Output Result: Mengapa kedua -dua panggilan berbeza?

Apr 04, 2025 pm 05:12 PM

Perbezaan dalam Konsol.Log Output Result: Mengapa kedua -dua panggilan berbeza?

Apr 04, 2025 pm 05:12 PM

Perbincangan mendalam mengenai punca-punca utama perbezaan dalam output konsol.log. Artikel ini akan menganalisis perbezaan hasil output fungsi Console.log dalam sekeping kod dan menerangkan sebab -sebab di belakangnya. � ...