Kimi K1.5 vs Openai O1: Model penalaran yang lebih baik?

Openai adalah yang pertama memperkenalkan model penaakulan seperti O1 dan O1-Mini, tetapi adakah ia satu-satunya pemain dalam permainan? Bukan dengan tembakan panjang! LLM Cina seperti Deepseek, Qwen, dan sekarang Kimi melangkah untuk mencabar OpenAI dengan menyampaikan keupayaan yang sama dengan harga yang lebih berpatutan. Selepas debut Deepseek yang mengagumkan, giliran Kimi Ai bersinar dengan model Kimi K1.5 yang baru. Dalam artikel ini, kami akan menguji Kimi K1.5 terhadap Openai O1 pada tugas yang sama dan melihat mana yang lebih baik!

Jadual Kandungan- Apa itu Kimi K1.5? Carian Web

-

Tugas 5: Analisis Imej - Hasil Akhir: Kimi K1.5 vs OpenAI O1

- Kesimpulan

- Sila ambil perhatian: Sila ambil perhatian: Kimi K1.5 adalah percuma, sambil mengakses Chatgpt Plus untuk O1 dan O1-Mini berharga $ 20. Sebelum menyelam ke dalam tugas, mari kita bandingkan dua model.

- Apa itu kimi k1.5?

- Kimi K1.5 adalah LLM berbilang modal oleh Moonshot AI yang dilatih dengan pembelajaran tetulang (RL) dan direka untuk cemerlang dalam pelbagai tugas penalaran di seluruh teks, penglihatan, dan pengekodan. Dilancarkan baru -baru ini, Kimi K1.5 dengan cepat mendapat perhatian untuk prestasi yang mengagumkan, yang sepadan dengan keupayaan model Openai O1 tanpa pratonton atau akhiran mini.

- Ciri Utama

carian web masa nyata di seluruh 100 laman web

menganalisis sehingga 50 fail (pdfs, docs, ppts, imej) dengan mudahpenalaran katil maju, tersedia tanpa kos

pemahaman imej yang dipertingkatkan, melampaui pengekstrakan teks asas

- Juga baca:

- Openai O1: Siri Model Baru Terbuka

- O1-Mini: Model yang mengubah permainan untuk STEM dan penalaran

- Kimi K1.5 vs Openai O1 dan O1-Mini

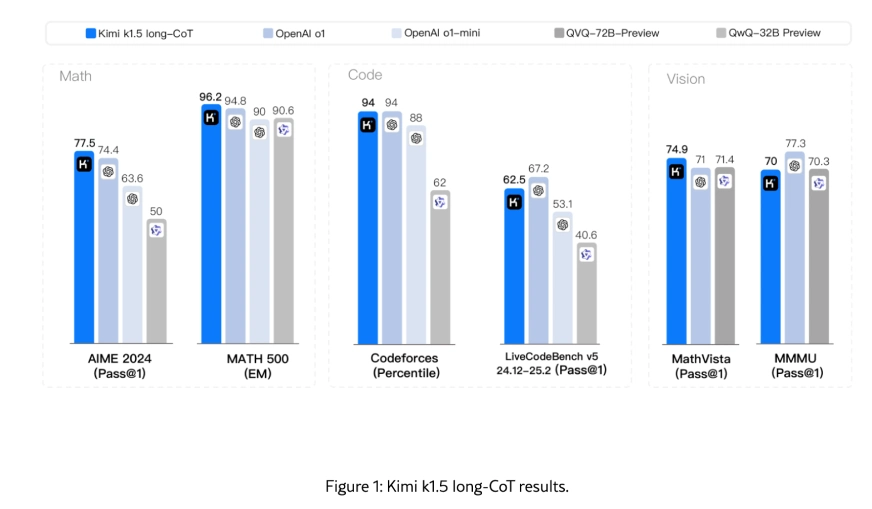

- Kimi K1.5 sepadan dengan Openai's O1 dan O1-Mini dalam tugas-tugas yang panjang dan mengatasi GPT-4O dan Claude Sonnet 3.5 dalam tugas pendek. Keupayaan berbilang modal, terutamanya dalam penalaran visual, meletakkannya sebagai pesaing yang kuat untuk model OpenAI. Penggunaan teknik latihan RL, resipi data multi-modal, dan pengoptimuman infrastruktur telah menjadi penting dalam mencapai hasil ini.

K1.5 Model Long-Cot: Memajukan Penalaran Multi-Modal

Model Kimi K1.5 Long-Cot mencapai prestasi canggih (SOTA) melalui kombinasi skala konteks panjang, kaedah pengoptimuman dasar yang lebih baik, dan pembelajaran tetulang teks-teks (RL). Tidak seperti model bahasa tradisional pretraining, yang bergantung kepada ramalan yang akan datang dan dibatasi oleh data latihan yang ada, Kimi K1.5 memanfaatkan RL untuk skala data latihannya dengan belajar untuk meneroka dengan ganjaran. Pendekatan ini mewujudkan rangka kerja RL yang sederhana namun berkesan, mengelakkan teknik kompleks seperti carian atau fungsi nilai pokok Monte Carlo.

- Penalaran matematik : skor 96.2 pada Math-500 dan 77.5 pada AIME 2024, yang sepadan dengan model Openai's O1 dan O1-Mini.

- Pengaturcaraan : persentil ke -94 pada codeforces, cemerlang dalam pengaturcaraan kompetitif.

- penalaran visual : 74.9 pada Mathvista, mempamerkan integrasi multi-modal yang kuat.

K1.5 Model pendek-cot: Kecekapan dan Prestasi

Model pendek-cot membina kejayaan model long-cot, menggunakan kaedah long2short yang berkesan untuk menyaring teknik-teknik yang panjang ke dalam rangka kerja yang lebih efisien. Pendekatan ini menggabungkan penalaan halus, pembelajaran tetulang, dan penyulingan lama ke pendek, memberikan alasan yang cepat dan tepat untuk tugas-tugas konteks pendek.

Pencapaian yang ketara termasuk:

Pencapaian yang ketara termasuk:

- Penalaran matematik

- : skor 94.6 pada Math-500 dan 60.8 pada AIME 2024, mengatasi model pendek yang sedia ada seperti GPT-4O dan Claude Sonnet 3.5 hingga 550%. Pengaturcaraan : 47.3 Pada LiveCodeBench, cemerlang dalam penjanaan kod dan tugas debug.

- Pemahaman Bahasa Semulajadi : Berkesan untuk aplikasi masa nyata seperti chatbots dan pembantu maya.

- Teknik penyulingan lama, termasuk penggabungan model dan pensampelan penolakan terpendek, memastikan prestasi tinggi dengan kos pengiraan yang dikurangkan, menjadikan model pendek-cot sangat cekap. untuk mengetahui lebih lanjut, anda boleh menyemak kertas penyelidikan mereka di sini!

Sekarang, mari kita menilai Kimi K1.5 dan Openai O1 pada arahan yang sama!

tugas 1: teka -teki zebra

prompt:

Selesaikan teka -teki zebra ini dengan betul.

Openai O1: ❌ | Kimi K1.5: ❌ tugas 2: penalaran logik Anda berjalan ke bilik dan melihat katil. Di atas katil terdapat dua anjing, empat kucing, zirafah, lima ekor lembu, dan itik. Terdapat juga tiga kerusi dan meja. Berapa banyak kaki di lantai?

Respons Openai O1: KIMI K1.5 Respons:

keputusan:

Tugas 3: Buat laman HTML

prompt:

Respons Openai O1:

Openai O1: ❌ | Kimi K1.5: ✅ tugas 4: carian web

Respons Openai O1: Artikel "Panduan Komprehensif untuk Membina Sistem Rag Agentik dengan Langgraph" menggariskan proses membina pangkalan data vektor untuk data Wikipedia sebagai sebahagian daripada mewujudkan sistem RAG yang agentik. Berikut adalah langkah utama yang diringkaskan: keputusan:

Openai O1: ❌ | Kimi K1.5: ✅

Imej menunjukkan skema yang sangat mudah dipermudahkan dari pusat data di ruang angkasa, dengan beberapa anggapan yang memudahkan yang memerlukan justifikasi. Tugas -tugas yang lebih rendah dari kawasan permukaan radiator yang diperlukan untuk pusat data.

Imej input:

1. Input kuasa dan penjanaan haba:

Di ruang angkasa, tidak ada penyejukan konvensional atau konduktif kepada pemindahan haba radiasi yang sama. Oleh itu, mod utama penolakan haba adalah radiasi terma dari permukaan radiator ke ruang dalam.

Anggapkan radiator dibina dengan permukaan emissivity tinggi, Sayε = 0.9 = 0.9. Ini adalah munasabah untuk permukaan yang disalut dengan cat atau bahan-bahan emis yang tinggi. Untuk terikat yang lebih rendah di kawasan yang diperlukan, kami menganggap keadaan yang ideal:

Untuk mengendalikan matahari dan ruang yang mendalam dalam pengurusan terma, pusat data harus dilindungi dari cahaya matahari langsung menggunakan cahaya matahari atau diposisikan di lokasi di mana ia tidak terdedah kepada matahari, seperti sisi gelap planet atau bulan. Radiator mesti direka untuk memancarkan haba dengan cekap ke ruang kosong, yang sangat sejuk.

766 meter persegi

Respons Openai O1:

Collector Position

Nationality

Lot

Amount Spent

Shirt Color

Collector #1

Portuguese

Toy

Unknown

Blue

Collector #2

Japanese

Lot 40

0,000

Purple

Collector #3

Italian

Lot 30

0,000

Pink

Collector #4

Canadian

Unknown

0,000

Yellow

Collector #5

Unknown

Unknown

0,000

Unknown

Butiran Pemungut

Tanggapan yang disediakan oleh OpenAI O1 adalah tidak tepat. Jadual yang dihasilkan tidak mematuhi format yang diperlukan dalam soalan, menjadikan respons tidak boleh dipercayai. Sebaliknya, Kimi K1.5 memberikan respons dalam format yang betul seperti soalan, tetapi kandungan jawapan itu sendiri tidak betul.

prompt:

Pemerhatian:

Jawapan yang betul:

Jawapan yang betul:

Openai O1 mengambil masa terlalu lama untuk menghasilkan respons. Walaupun pengiraan adalah betul dan termasuk penjelasan terperinci, ia gagal menyumbang kaki manusia di atas lantai, membuat jawapannya tidak betul. Sebaliknya, Kimi K1.5 menyediakan jawapan yang betul dalam masa yang kurang. Buat halaman HTML yang mudah dengan butang yang mengubah warna latar belakang menjadi merah jambu apabila diklik dengan beberapa confetti

.

Pemerhatian: Kedua -dua model mematuhi prompt dan memberikan respons yang betul. Dari segi rupa dan fungsi laman web, Kimi K1.5 melakukan pekerjaan yang lebih baik!

keputusan:

Mata Utama untuk meringkaskan proses membina pangkalan data vektor untuk data Wikipedia:

KIMI K1.5 Respons:

Pemerhatian:

menguji retriever :

menguji retriever dengan pertanyaan sampel untuk memastikan ia mengembalikan dokumen yang relevan.

output Kimi K1.5 cemerlang dengan menyediakan langkah -langkah pelaksanaan yang terperinci dan tindakan dengan parameter teknikal tertentu dan keperluan perpustakaan. Ia mengimbangi kedalaman yang komprehensif dengan organisasi yang jelas, menerangkan alasan di sebalik setiap langkah, dan dengan berkesan menghubungkan proses teknikal ke matlamat yang lebih luas untuk membina sistem RAG yang agentik.

prompt:

di bawah adalah proses penalaran langkah demi langkah dengan andaian yang jelas menyatakan dengan jelas, justifikasi, dan penerapan undang-undang termodinamik pertama. Hasil akhir akan menjadi terikat yang lebih rendah pada kawasan radiator yang diperlukan untuk menghilangkan 1 GW haba yang dihasilkan oleh pusat data berasaskan ruang.

Untuk menganggarkan batas bawah kawasan permukaan radiator yang diperlukan untuk pusat data di ruang angkasa, saya mulakan dengan menggunakan undang-undang Stefan-Boltzmann, yang menggambarkan kuasa yang dipancarkan oleh permukaan:

Pemerhatian:

Respons Kimi K1.5 lebih unggul kerana beberapa sebab. Ia menunjukkan penalaran matematik yang jelas melalui pendekatan langkah demi langkah, bermula dengan persamaan undang-undang Stefan-Boltzmann asas. Kimi jelas mentakrifkan semua pembolehubah dan nilai mereka, menunjukkan proses matematik penyelesaian untuk kawasan radiator, dan menyediakan hasil berangka konkrit sebanyak 766 meter persegi. Penjelasan termasuk justifikasi yang jelas untuk strategi pengurusan terma, pertimbangan praktikal seperti meletakkan radiator di sisi gelap planet, dan sambungan langsung kepada undang-undang termodinamik pertama dengan aplikasi dunia nyata. Tanggapan ini disimpulkan dengan nombor tertentu dan cadangan yang boleh diambil tindakan.

Openai O1: ❌ | Kimi K1.5: ✅

Hasil tugas

Juga baca: Kimi K1.5 vs Deepseek R1: Pertempuran LLM Cina Terbaik

Task

Winner

Zebra Puzzle

Neither

Logical Reasoning

Kimi k1.5

Create an HTML Site

Kimi k1.5

Web Search

Kimi k1.5

Image Analysis

Kimi k1.5

Model percuma seperti Kimi K1.5 dan DeepSeek R1 mencabar dominasi Openai O1, yang menawarkan prestasi unggul dalam penalaran, pengekodan, dan tugas berbilang modal tanpa sebarang kos. Dengan Kimi K1.5 mengatasi OpenAI dalam tanda aras utama dan DeepSeek R1 yang cemerlang dalam cabaran pengekodan, membayar $ 20/bulan untuk Openai O1 masih dibenarkan? Beritahu kami di bahagian komen di bawah!

Atas ialah kandungan terperinci Kimi K1.5 vs Openai O1: Model penalaran yang lebih baik?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Penjana Seni AI Terbaik (Percuma & amp; Dibayar) untuk projek kreatif

Apr 02, 2025 pm 06:10 PM

Penjana Seni AI Terbaik (Percuma & amp; Dibayar) untuk projek kreatif

Apr 02, 2025 pm 06:10 PM

Artikel ini mengkaji semula penjana seni AI atas, membincangkan ciri -ciri mereka, kesesuaian untuk projek kreatif, dan nilai. Ia menyerlahkan Midjourney sebagai nilai terbaik untuk profesional dan mengesyorkan Dall-E 2 untuk seni berkualiti tinggi dan disesuaikan.

Bermula dengan Meta Llama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Bermula dengan Meta Llama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Meta's Llama 3.2: Lompat ke hadapan dalam Multimodal dan Mobile AI META baru -baru ini melancarkan Llama 3.2, kemajuan yang ketara dalam AI yang memaparkan keupayaan penglihatan yang kuat dan model teks ringan yang dioptimumkan untuk peranti mudah alih. Membina kejayaan o

CHATBOTS AI terbaik berbanding (Chatgpt, Gemini, Claude & amp; Lagi)

Apr 02, 2025 pm 06:09 PM

CHATBOTS AI terbaik berbanding (Chatgpt, Gemini, Claude & amp; Lagi)

Apr 02, 2025 pm 06:09 PM

Artikel ini membandingkan chatbots AI seperti Chatgpt, Gemini, dan Claude, yang memberi tumpuan kepada ciri -ciri unik mereka, pilihan penyesuaian, dan prestasi dalam pemprosesan bahasa semula jadi dan kebolehpercayaan.

Pembantu Menulis AI Teratas untuk Meningkatkan Penciptaan Kandungan Anda

Apr 02, 2025 pm 06:11 PM

Pembantu Menulis AI Teratas untuk Meningkatkan Penciptaan Kandungan Anda

Apr 02, 2025 pm 06:11 PM

Artikel ini membincangkan pembantu penulisan AI terkemuka seperti Grammarly, Jasper, Copy.ai, WriteSonic, dan Rytr, yang memberi tumpuan kepada ciri -ciri unik mereka untuk penciptaan kandungan. Ia berpendapat bahawa Jasper cemerlang dalam pengoptimuman SEO, sementara alat AI membantu mengekalkan nada terdiri

Menjual Strategi AI kepada Pekerja: Manifesto CEO Shopify

Apr 10, 2025 am 11:19 AM

Menjual Strategi AI kepada Pekerja: Manifesto CEO Shopify

Apr 10, 2025 am 11:19 AM

Memo CEO Shopify Tobi Lütke baru -baru ini dengan berani mengisytiharkan penguasaan AI sebagai harapan asas bagi setiap pekerja, menandakan peralihan budaya yang signifikan dalam syarikat. Ini bukan trend seketika; Ini adalah paradigma operasi baru yang disatukan ke p

AV Bytes: Meta ' s llama 3.2, Google's Gemini 1.5, dan banyak lagi

Apr 11, 2025 pm 12:01 PM

AV Bytes: Meta ' s llama 3.2, Google's Gemini 1.5, dan banyak lagi

Apr 11, 2025 pm 12:01 PM

Landskap AI minggu ini: Badai kemajuan, pertimbangan etika, dan perdebatan pengawalseliaan. Pemain utama seperti Openai, Google, Meta, dan Microsoft telah melepaskan kemas kini, dari model baru yang terobosan ke peralihan penting di LE

10 Pelanjutan pengekodan AI generatif dalam kod vs yang mesti anda pelajari

Apr 13, 2025 am 01:14 AM

10 Pelanjutan pengekodan AI generatif dalam kod vs yang mesti anda pelajari

Apr 13, 2025 am 01:14 AM

Hei ada, pengekodan ninja! Apa tugas yang berkaitan dengan pengekodan yang anda telah merancang untuk hari itu? Sebelum anda menyelam lebih jauh ke dalam blog ini, saya ingin anda memikirkan semua kesengsaraan yang berkaitan dengan pengekodan anda-lebih jauh menyenaraikan mereka. Selesai? - Let ’

Memilih Penjana Suara AI Terbaik: Pilihan Teratas Ditinjau

Apr 02, 2025 pm 06:12 PM

Memilih Penjana Suara AI Terbaik: Pilihan Teratas Ditinjau

Apr 02, 2025 pm 06:12 PM

Artikel ini mengulas penjana suara AI atas seperti Google Cloud, Amazon Polly, Microsoft Azure, IBM Watson, dan Descript, memberi tumpuan kepada ciri -ciri mereka, kualiti suara, dan kesesuaian untuk keperluan yang berbeza.