Peranti teknologi

Peranti teknologi

AI

AI

Apakah perbezaan KL yang merevolusikan pembelajaran mesin? - Analytics Vidhya

Apakah perbezaan KL yang merevolusikan pembelajaran mesin? - Analytics Vidhya

Apakah perbezaan KL yang merevolusikan pembelajaran mesin? - Analytics Vidhya

Kullback-Leibler (KL) Divergence: menyelam yang mendalam ke entropi relatif

Beberapa konsep matematik mempunyai pembelajaran mesin moden dan kecerdasan buatan sebagai perbezaan Kullback-Leibler (KL). Metrik yang kuat ini, yang juga dikenali sebagai entropi relatif atau keuntungan maklumat, kini penting di banyak bidang, dari kesimpulan statistik ke canggih pembelajaran mendalam. Artikel ini meneroka perbezaan KL, asal -usulnya, aplikasinya, dan peranan pentingnya dalam usia data besar dan AI.

Takeaways utama

- Divergensi KL mengukur perbezaan antara dua pengagihan kebarangkalian.

- Ia adalah penukar permainan dalam pembelajaran mesin dan teori maklumat, yang memerlukan hanya dua kebarangkalian pengagihan untuk pengiraan.

- Ia mengukur maklumat tambahan yang diperlukan untuk menyandikan data dari satu pengedaran menggunakan kod yang dioptimumkan untuk yang lain.

- Divergensi KL adalah penting dalam latihan model generatif maju seperti model penyebaran, mengoptimumkan pengedaran bunyi, dan meningkatkan penjanaan teks ke imej.

- Yayasan teoretikal yang kuat, fleksibiliti, skalabilitas, dan tafsiran menjadikannya tidak ternilai untuk model kompleks.

Jadual Kandungan

- Pengenalan kepada perbezaan KL

- Divergensi KL: Komponen penting dan pengaruh transformatif

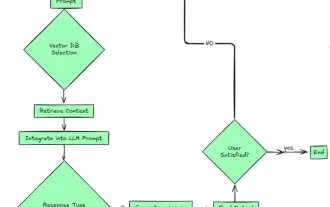

- Memahami Perbezaan KL: Panduan Langkah demi Langkah

- Perbezaan KL dalam Model Penyebaran: Aplikasi Revolusioner

- Kelebihan Perbezaan KL

- Aplikasi dunia nyata mengenai perbezaan KL

- Soalan yang sering ditanya

Pengenalan kepada perbezaan KL

Divergensi KL mengukur perbezaan antara dua pengagihan kebarangkalian. Pertimbangkan dua model yang meramalkan peristiwa yang sama - perbezaan mereka boleh dikira menggunakan perbezaan KL.

Untuk pengagihan kebarangkalian diskret p dan q , perbezaan KL dari q hingga p ialah:

Formula ini, sementara pada mulanya kompleks, difahami secara intuitif sebagai maklumat tambahan purata yang diperlukan untuk mengodkan data dari P menggunakan kod yang dioptimumkan untuk q .

Divergensi KL: Komponen penting dan pengaruh transformatif

Mengira perbezaan KL memerlukan:

- Dua pengagihan kebarangkalian yang ditakrifkan di atas ruang acara yang sama.

- Fungsi logaritma (asas 2 atau logaritma semulajadi).

Dengan input mudah ini, perbezaan KL telah merevolusikan pelbagai bidang:

- Pembelajaran mesin: penting dalam kesimpulan variasi dan model generatif (misalnya, VAE), mengukur seberapa baik model menghampiri pengagihan data yang benar.

- Teori Maklumat: Menyediakan ukuran asas kandungan maklumat dan kecekapan mampatan.

- Kesimpulan Statistik: Penting dalam ujian hipotesis dan pemilihan model.

- Pemprosesan bahasa semulajadi: Digunakan dalam pemodelan topik dan penilaian model bahasa.

- Pembelajaran Penguatkuasaan: AIDS dalam Pengoptimuman Dasar dan Strategi Penjelajahan.

Memahami Perbezaan KL: Panduan Langkah demi Langkah

Mari membedah perbezaan KL:

- Perbandingan kebarangkalian: Kami membandingkan kebarangkalian setiap peristiwa di bawah pengagihan p dan q .

- Pengiraan nisbah: Kami mengira nisbah p (x)/q (x) , menunjukkan berapa banyak (atau kurang) mungkin setiap peristiwa berada di bawah p berbanding dengan q .

- Transformasi Logaritma: Logaritma nisbah ini memastikan tidak negatif dan bahawa perbezaannya adalah sifar hanya apabila P dan Q adalah sama.

- Weighting: Kami berat nisbah log oleh p (x) , menekankan peristiwa yang lebih berkemungkinan di bawah p .

- Summation: Akhirnya, kami menyimpulkan nisbah log berwajaran di semua peristiwa.

Hasilnya adalah satu nilai yang mewakili perbezaan antara p dan q . Perhatikan bahawa perbezaan KL adalah asimetrik : DKL (p || q) ≠ dkl (q || p). Asimetri ini adalah ciri utama, menunjukkan arah perbezaan.

Perbezaan KL dalam Model Penyebaran: Aplikasi Revolusioner

Model penyebaran, seperti Dall-E 2 dan penyebaran stabil, adalah contoh utama kuasa KL Divergence. Mereka menjana imej yang sangat realistik dari deskripsi teks.

Peranan Divergence KL dalam model penyebaran termasuk:

- Latihan: Mengukur perbezaan antara pengagihan bunyi yang benar dan anggaran pada setiap langkah, membolehkan model untuk membalikkan proses penyebaran secara berkesan.

- Variasi Lower Bound: Sering digunakan dalam objektif latihan, memastikan sampel yang dihasilkan rapat dengan pengagihan data.

- Regularization ruang laten: Membantu menghidupkan semula ruang laten, memastikan perwakilan yang berkelakuan baik.

- Perbandingan Model: Digunakan untuk membandingkan arsitektur model penyebaran yang berbeza.

- Generasi bersyarat: Dalam model teks-ke-imej, ia mengukur bagaimana imej yang dihasilkan dengan baik sepadan dengan deskripsi teks.

Kelebihan Perbezaan KL

Kekuatan KL Divergence termasuk:

- Dasar teoritis yang kuat: berasaskan teori maklumat, menawarkan tafsiran dari segi maklumat.

- Fleksibiliti: Berkenaan dengan pengagihan diskret dan berterusan.

- Skalabiliti: Berkesan dalam ruang dimensi tinggi, sesuai untuk model pembelajaran mesin yang kompleks.

- Ciri-ciri matematik: Memuaskan bukan negatif dan convexity, bermanfaat untuk pengoptimuman.

- Tafsiran: Asimetrinya difahami secara intuitif dari segi pengekodan dan pemampatan.

Aplikasi dunia nyata mengenai perbezaan KL

Impak Divergence KL meluas ke pelbagai aplikasi:

- Sistem Cadangan: Digunakan untuk mengukur seberapa baik model meramalkan keutamaan pengguna.

- Generasi Imej: Penting dalam Latihan Model Generasi Imej AI.

- Model Bahasa: Memainkan peranan dalam latihan chatbots dan model bahasa lain.

- Pemodelan Iklim: Digunakan untuk membandingkan dan menilai kebolehpercayaan model iklim.

- Penilaian Risiko Kewangan: Digunakan dalam model risiko untuk ramalan pasaran.

Kesimpulan

Divergensi KL adalah alat yang berkuasa yang melampaui matematik tulen, mempengaruhi pembelajaran mesin, ramalan pasaran, dan banyak lagi. Kepentingannya dalam dunia yang didorong oleh data kita tidak dapat dinafikan. Sebagai AI dan analisis data maju, peranan KL Divergence hanya akan menjadi lebih penting.

Soalan yang sering ditanya

Q1. Apakah yang dimaksudkan dengan "KL"? A: Kullback-Leibler, dinamakan sempena Solomon Kullback dan Richard Leibler.

S2. Adakah KL Divergensi Metrik Jarak? A: Tidak, asimetrinya menghalangnya daripada menjadi metrik jarak yang benar.

Q3. Bolehkah perbezaan KL menjadi negatif? A: Tidak, ia sentiasa tidak negatif.

Q4. Bagaimana perbezaan KL digunakan dalam pembelajaran mesin? A: Dalam pemilihan model, kesimpulan variasi, dan menilai model generatif.

S5. Apakah perbezaan antara perbezaan KL dan entropi silang? A: Meminimumkan entropi silang adalah bersamaan dengan meminimumkan perbezaan KL ditambah entropi pengedaran sebenar.

Atas ialah kandungan terperinci Apakah perbezaan KL yang merevolusikan pembelajaran mesin? - Analytics Vidhya. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Penjana Seni AI Terbaik (Percuma & amp; Dibayar) untuk projek kreatif

Apr 02, 2025 pm 06:10 PM

Penjana Seni AI Terbaik (Percuma & amp; Dibayar) untuk projek kreatif

Apr 02, 2025 pm 06:10 PM

Artikel ini mengkaji semula penjana seni AI atas, membincangkan ciri -ciri mereka, kesesuaian untuk projek kreatif, dan nilai. Ia menyerlahkan Midjourney sebagai nilai terbaik untuk profesional dan mengesyorkan Dall-E 2 untuk seni berkualiti tinggi dan disesuaikan.

Bermula dengan Meta Llama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Bermula dengan Meta Llama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Meta's Llama 3.2: Lompat ke hadapan dalam Multimodal dan Mobile AI META baru -baru ini melancarkan Llama 3.2, kemajuan yang ketara dalam AI yang memaparkan keupayaan penglihatan yang kuat dan model teks ringan yang dioptimumkan untuk peranti mudah alih. Membina kejayaan o

CHATBOTS AI terbaik berbanding (Chatgpt, Gemini, Claude & amp; Lagi)

Apr 02, 2025 pm 06:09 PM

CHATBOTS AI terbaik berbanding (Chatgpt, Gemini, Claude & amp; Lagi)

Apr 02, 2025 pm 06:09 PM

Artikel ini membandingkan chatbots AI seperti Chatgpt, Gemini, dan Claude, yang memberi tumpuan kepada ciri -ciri unik mereka, pilihan penyesuaian, dan prestasi dalam pemprosesan bahasa semula jadi dan kebolehpercayaan.

Adakah chatgpt 4 o tersedia?

Mar 28, 2025 pm 05:29 PM

Adakah chatgpt 4 o tersedia?

Mar 28, 2025 pm 05:29 PM

CHATGPT 4 kini tersedia dan digunakan secara meluas, menunjukkan penambahbaikan yang ketara dalam memahami konteks dan menjana tindak balas yang koheren berbanding dengan pendahulunya seperti ChATGPT 3.5. Perkembangan masa depan mungkin merangkumi lebih banyak Inter yang diperibadikan

Pembantu Menulis AI Teratas untuk Meningkatkan Penciptaan Kandungan Anda

Apr 02, 2025 pm 06:11 PM

Pembantu Menulis AI Teratas untuk Meningkatkan Penciptaan Kandungan Anda

Apr 02, 2025 pm 06:11 PM

Artikel ini membincangkan pembantu penulisan AI terkemuka seperti Grammarly, Jasper, Copy.ai, WriteSonic, dan Rytr, yang memberi tumpuan kepada ciri -ciri unik mereka untuk penciptaan kandungan. Ia berpendapat bahawa Jasper cemerlang dalam pengoptimuman SEO, sementara alat AI membantu mengekalkan nada terdiri

Sistem Rag Agentik 7 Teratas untuk Membina Ejen AI

Mar 31, 2025 pm 04:25 PM

Sistem Rag Agentik 7 Teratas untuk Membina Ejen AI

Mar 31, 2025 pm 04:25 PM

2024 menyaksikan peralihan daripada menggunakan LLMS untuk penjanaan kandungan untuk memahami kerja dalaman mereka. Eksplorasi ini membawa kepada penemuan agen AI - sistem pengendalian sistem autonomi dan keputusan dengan intervensi manusia yang minimum. Buildin

Memilih Penjana Suara AI Terbaik: Pilihan Teratas Ditinjau

Apr 02, 2025 pm 06:12 PM

Memilih Penjana Suara AI Terbaik: Pilihan Teratas Ditinjau

Apr 02, 2025 pm 06:12 PM

Artikel ini mengulas penjana suara AI atas seperti Google Cloud, Amazon Polly, Microsoft Azure, IBM Watson, dan Descript, memberi tumpuan kepada ciri -ciri mereka, kualiti suara, dan kesesuaian untuk keperluan yang berbeza.

AV Bytes: Meta ' s llama 3.2, Google's Gemini 1.5, dan banyak lagi

Apr 11, 2025 pm 12:01 PM

AV Bytes: Meta ' s llama 3.2, Google's Gemini 1.5, dan banyak lagi

Apr 11, 2025 pm 12:01 PM

Landskap AI minggu ini: Badai kemajuan, pertimbangan etika, dan perdebatan pengawalseliaan. Pemain utama seperti Openai, Google, Meta, dan Microsoft telah melepaskan kemas kini, dari model baru yang terobosan ke peralihan penting di LE