Peranti teknologi

Peranti teknologi

AI

AI

Kaedah baharu pembahagian model 3D membebaskan tangan anda! Tiada pelabelan manual diperlukan, hanya satu latihan diperlukan dan kategori tidak berlabel juga boleh dikenali |

Kaedah baharu pembahagian model 3D membebaskan tangan anda! Tiada pelabelan manual diperlukan, hanya satu latihan diperlukan dan kategori tidak berlabel juga boleh dikenali |

Kaedah baharu pembahagian model 3D membebaskan tangan anda! Tiada pelabelan manual diperlukan, hanya satu latihan diperlukan dan kategori tidak berlabel juga boleh dikenali |

Tiada anotasi manual diperlukan dan hanya satu latihan diperlukan untuk membolehkan model 3D memahami bahasa dan mengenal pasti kategori tidak berlabel.

Segmentasi model 3D kini bebas tangan!

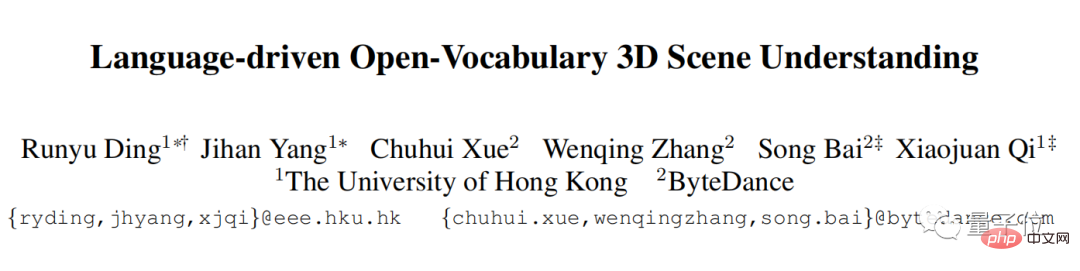

Universiti Hong Kong dan ByteDream telah bekerjasama dan menghasilkan kaedah baharu:

Tiada anotasi manual diperlukan dan hanya satu latihan diperlukan untuk membolehkan model 3D memahami bahasa dan mengenal pasti objek yang tidak diketahui kategori.

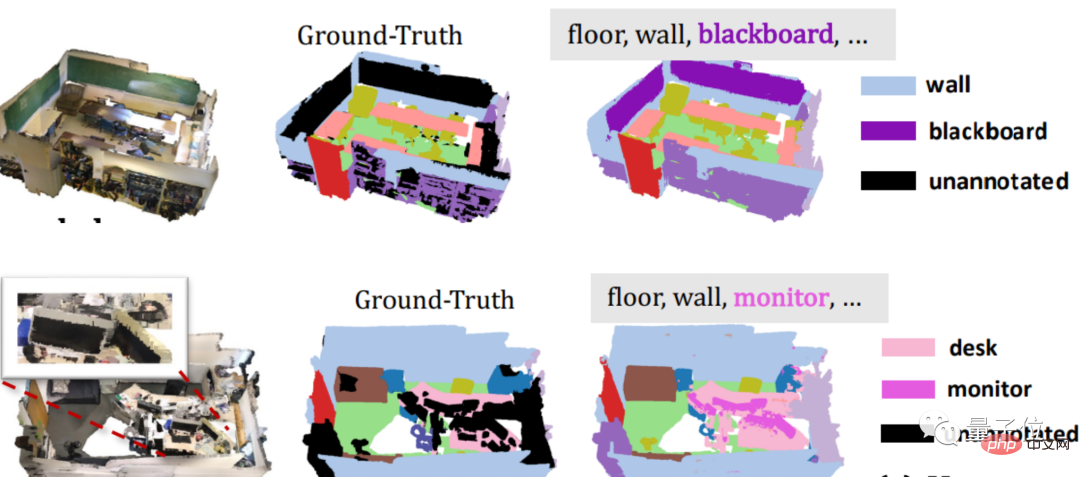

Sebagai contoh, lihat contoh di bawah, papan hitam tanpa tanda dan monitor Selepas model 3D dilatih dengan kaedah ini, ia boleh dengan cepat "menangkap" sasaran untuk pembahagian.

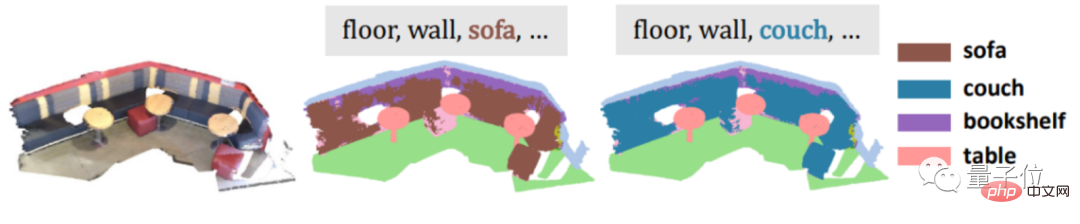

Contoh lain, jika anda memasukkan sinonim seperti sofa dan batuk untuk menyusahkan, ia boleh dimenangi dengan mudah.

Malah kategori abstrak seperti bilik mandi boleh diselesaikan.

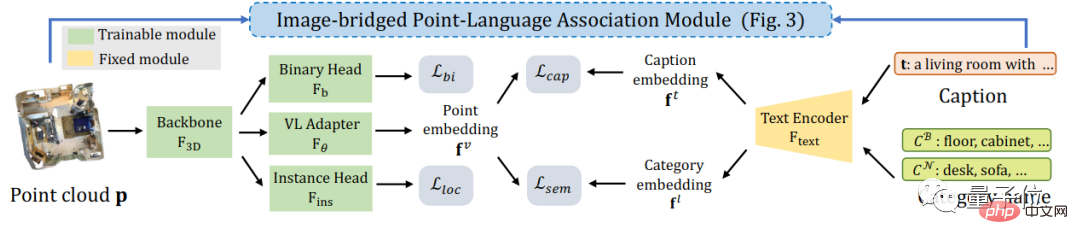

Kaedah baharu ini dipanggil PLA (Point-Language Assocation), iaitu kaedah yang menggabungkan awan titik (kumpulan titik besar ciri permukaan sasaran) dan bahasa semula jadi. .

Pada masa ini, kertas kerja ini telah diterima oleh CVPR 2023.

Tetapi setelah berkata demikian, tiada anotasi manual diperlukan, hanya satu latihan dilakukan dan klasifikasi abstrak sinonim juga boleh dikenali... Ini ialah superposisi berbilang buff .

Anda mesti tahu bahawa data 3D dan bahasa semula jadi yang digunakan oleh kaedah umum tidak boleh diperoleh terus daripada Internet secara percuma, dan selalunya memerlukan anotasi manual yang mahal, dan kaedah umum tidak boleh berdasarkan sambungan semantik antara perkataan. Kenal pasti kategori baharu.

Jadi bagaimana PLA melakukannya? Mari kita lihat~

Prinsip khusus

Malah, secara terang-terangan, untuk berjaya melaksanakan pembahagian model 3D, langkah yang paling penting ialah menjadikan data 3D memahami bahasa semula jadi.

Secara profesional, ia adalah untuk memperkenalkan penerangan bahasa semula jadi ke dalam awan titik 3D.

Bagaimana untuk memperkenalkannya?

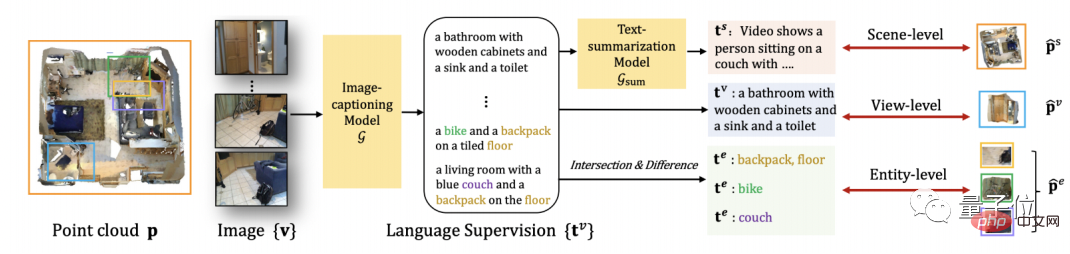

Memandangkan pada masa ini terdapat kaedah yang agak berjaya untuk membahagikan imej 2D, pasukan penyelidik memutuskan untuk bermula dengan imej 2D.

Mula-mula, tukar awan titik 3D kepada imej 2D yang sepadan, kemudian gunakannya sebagai input model besar berbilang modal 2D dan ekstrak perihalan bahasa imej daripadanya.

Seterusnya, menggunakan hubungan unjuran antara imej dan awan titik, penerangan bahasa imej secara semula jadi boleh dikaitkan dengan data awan titik 3D.

Selain itu, untuk serasi dengan objek 3D dengan butiran berbeza, PLA turut mencadangkan kaedah korelasi bahasa semula jadi awan titik 3D berbilang butiran.

Untuk keseluruhan adegan 3D, PLA meringkaskan perihalan bahasa yang diekstrak daripada semua imej yang sepadan dengan pemandangan dan menggunakan bahasa ringkasan ini untuk mengaitkan keseluruhan pemandangan 3D.

Untuk bahagian pemandangan 3D yang sepadan dengan setiap paparan imej, PLA secara langsung menggunakan imej sebagai jambatan untuk mengaitkan awan dan bahasa titik 3D yang sepadan.

Untuk objek 3D yang lebih halus, PLA menyediakan kaedah yang lebih terperinci dengan membandingkan persilangan dan penyatuan antara awan titik yang sepadan bagi imej yang berbeza, serta persilangan dan penyatuan bahagian perihalan bahasa 3D-. pendekatan korelasi bahasa.

Dengan cara ini, pasukan penyelidik boleh mendapatkan sepasang awan titik 3D - bahasa semula jadi, yang secara langsung menyelesaikan masalah anotasi manual.

PLA menggunakan pasangan "3D point cloud-natural language" yang diperoleh dan penyeliaan set data sedia ada untuk membolehkan model 3D memahami definisi masalah pengesanan dan pembahagian.

Secara khusus, ia menggunakan pembelajaran kontras untuk mendekatkan jarak antara setiap pasangan awan titik 3D dan pasangan bahasa semula jadi dalam ruang ciri, dan menolak awan titik 3D yang tidak sepadan dan huraian bahasa semula jadi.

Setelah bercakap tentang begitu banyak prinsip, bagaimanakah prestasi PLA dalam tugasan segmentasi tertentu?

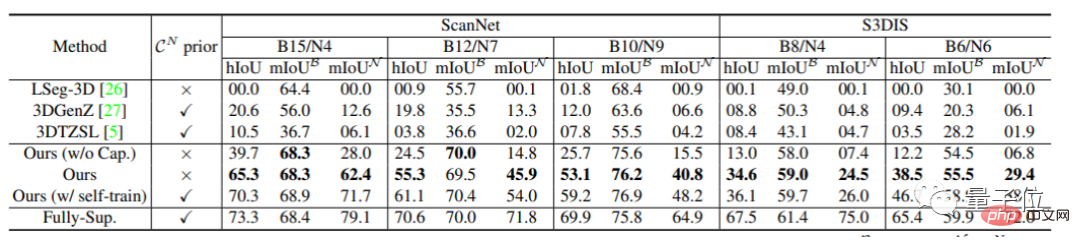

Tugas pembahagian semantik melebihi garis dasar sebanyak 65%

Para penyelidik menguji prestasi model dunia terbuka 3D dalam kategori tidak berlabel sebagai kriteria pengukuran utama.

Pertama, dalam tugas pembahagian semantik ScanNet dan S3DIS, PLA melebihi kaedah garis dasar sebelumnya sebanyak 35% hingga 65%.

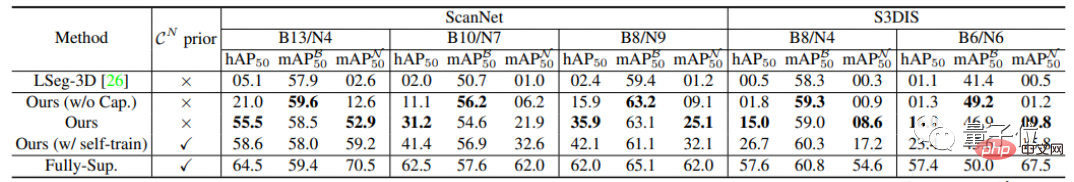

Dalam tugas pembahagian instance, PLA juga telah dipertingkatkan Berbanding dengan kaedah sebelumnya, peningkatan PLA berjulat dari 15% hingga 50%.

Pasukan Penyelidik

Pasukan penyelidik projek ini berasal dari Makmal CVMI Universiti Hong Kong dan ByteDance.

Makmal CVMI ialah makmal kecerdasan buatan Universiti Hong Kong yang ditubuhkan pada 1 Februari 2020.

Skop penyelidikan meliputi penglihatan komputer dan pengecaman corak, pembelajaran mesin/pembelajaran mendalam, analisis kandungan imej/video dan analisis data besar industri berdasarkan kecerdasan mesin.

Alamat tesis:https://arxiv.org/pdf/2211.16312.pdf

Halaman utama projek:https: //github .com/CVMI-Lab/PLA

Atas ialah kandungan terperinci Kaedah baharu pembahagian model 3D membebaskan tangan anda! Tiada pelabelan manual diperlukan, hanya satu latihan diperlukan dan kategori tidak berlabel juga boleh dikenali |. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1369

1369

52

52

Mengapakah Gaussian Splatting begitu popular dalam pemanduan autonomi sehingga NeRF mula ditinggalkan?

Jan 17, 2024 pm 02:57 PM

Mengapakah Gaussian Splatting begitu popular dalam pemanduan autonomi sehingga NeRF mula ditinggalkan?

Jan 17, 2024 pm 02:57 PM

Ditulis di atas & pemahaman peribadi pengarang Gaussiansplatting tiga dimensi (3DGS) ialah teknologi transformatif yang telah muncul dalam bidang medan sinaran eksplisit dan grafik komputer dalam beberapa tahun kebelakangan ini. Kaedah inovatif ini dicirikan oleh penggunaan berjuta-juta Gaussians 3D, yang sangat berbeza daripada kaedah medan sinaran saraf (NeRF), yang terutamanya menggunakan model berasaskan koordinat tersirat untuk memetakan koordinat spatial kepada nilai piksel. Dengan perwakilan adegan yang eksplisit dan algoritma pemaparan yang boleh dibezakan, 3DGS bukan sahaja menjamin keupayaan pemaparan masa nyata, tetapi juga memperkenalkan tahap kawalan dan pengeditan adegan yang tidak pernah berlaku sebelum ini. Ini meletakkan 3DGS sebagai penukar permainan yang berpotensi untuk pembinaan semula dan perwakilan 3D generasi akan datang. Untuk tujuan ini, kami menyediakan gambaran keseluruhan sistematik tentang perkembangan dan kebimbangan terkini dalam bidang 3DGS buat kali pertama.

Ketahui tentang emoji Fasih 3D dalam Microsoft Teams

Apr 24, 2023 pm 10:28 PM

Ketahui tentang emoji Fasih 3D dalam Microsoft Teams

Apr 24, 2023 pm 10:28 PM

Anda mesti ingat, terutamanya jika anda adalah pengguna Teams, bahawa Microsoft telah menambah kumpulan baharu emoji 3DFluent pada apl persidangan video tertumpu kerjanya. Selepas Microsoft mengumumkan emoji 3D untuk Pasukan dan Windows tahun lepas, proses itu sebenarnya telah melihat lebih daripada 1,800 emoji sedia ada dikemas kini untuk platform. Idea besar ini dan pelancaran kemas kini emoji 3DFluent untuk Pasukan pertama kali dipromosikan melalui catatan blog rasmi. Kemas kini Pasukan Terkini membawa FluentEmojis ke aplikasi Microsoft mengatakan 1,800 emoji yang dikemas kini akan tersedia kepada kami setiap hari

CLIP-BEVFormer: Selia secara eksplisit struktur BEVFormer untuk meningkatkan prestasi pengesanan ekor panjang

Mar 26, 2024 pm 12:41 PM

CLIP-BEVFormer: Selia secara eksplisit struktur BEVFormer untuk meningkatkan prestasi pengesanan ekor panjang

Mar 26, 2024 pm 12:41 PM

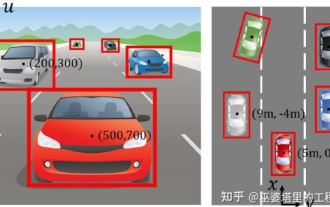

Ditulis di atas & pemahaman peribadi penulis: Pada masa ini, dalam keseluruhan sistem pemanduan autonomi, modul persepsi memainkan peranan penting Hanya selepas kenderaan pemanduan autonomi yang memandu di jalan raya memperoleh keputusan persepsi yang tepat melalui modul persepsi boleh Peraturan hiliran dan. modul kawalan dalam sistem pemanduan autonomi membuat pertimbangan dan keputusan tingkah laku yang tepat pada masanya dan betul. Pada masa ini, kereta dengan fungsi pemanduan autonomi biasanya dilengkapi dengan pelbagai penderia maklumat data termasuk penderia kamera pandangan sekeliling, penderia lidar dan penderia radar gelombang milimeter untuk mengumpul maklumat dalam modaliti yang berbeza untuk mencapai tugas persepsi yang tepat. Algoritma persepsi BEV berdasarkan penglihatan tulen digemari oleh industri kerana kos perkakasannya yang rendah dan penggunaan mudah, dan hasil keluarannya boleh digunakan dengan mudah untuk pelbagai tugas hiliran.

Pilih kamera atau lidar? Kajian terbaru tentang mencapai pengesanan objek 3D yang mantap

Jan 26, 2024 am 11:18 AM

Pilih kamera atau lidar? Kajian terbaru tentang mencapai pengesanan objek 3D yang mantap

Jan 26, 2024 am 11:18 AM

0. Ditulis di hadapan&& Pemahaman peribadi bahawa sistem pemanduan autonomi bergantung pada persepsi lanjutan, membuat keputusan dan teknologi kawalan, dengan menggunakan pelbagai penderia (seperti kamera, lidar, radar, dll.) untuk melihat persekitaran sekeliling dan menggunakan algoritma dan model untuk analisis masa nyata dan membuat keputusan. Ini membolehkan kenderaan mengenali papan tanda jalan, mengesan dan menjejaki kenderaan lain, meramalkan tingkah laku pejalan kaki, dsb., dengan itu selamat beroperasi dan menyesuaikan diri dengan persekitaran trafik yang kompleks. Teknologi ini kini menarik perhatian meluas dan dianggap sebagai kawasan pembangunan penting dalam pengangkutan masa depan satu. Tetapi apa yang menyukarkan pemanduan autonomi ialah memikirkan cara membuat kereta itu memahami perkara yang berlaku di sekelilingnya. Ini memerlukan algoritma pengesanan objek tiga dimensi dalam sistem pemanduan autonomi boleh melihat dan menerangkan dengan tepat objek dalam persekitaran sekeliling, termasuk lokasinya,

Cat 3D dalam Windows 11: Muat Turun, Pemasangan dan Panduan Penggunaan

Apr 26, 2023 am 11:28 AM

Cat 3D dalam Windows 11: Muat Turun, Pemasangan dan Panduan Penggunaan

Apr 26, 2023 am 11:28 AM

Apabila gosip mula tersebar bahawa Windows 11 baharu sedang dibangunkan, setiap pengguna Microsoft ingin tahu bagaimana rupa sistem pengendalian baharu itu dan apa yang akan dibawanya. Selepas spekulasi, Windows 11 ada di sini. Sistem pengendalian datang dengan reka bentuk baharu dan perubahan fungsi. Selain beberapa tambahan, ia disertakan dengan penamatan dan pengalihan keluar ciri. Salah satu ciri yang tidak wujud dalam Windows 11 ialah Paint3D. Walaupun ia masih menawarkan Paint klasik, yang bagus untuk laci, doodle dan doodle, ia meninggalkan Paint3D, yang menawarkan ciri tambahan yang sesuai untuk pencipta 3D. Jika anda mencari beberapa ciri tambahan, kami mengesyorkan Autodesk Maya sebagai perisian reka bentuk 3D terbaik. suka

Dapatkan isteri 3D maya dalam masa 30 saat dengan satu kad! Teks kepada 3D menjana manusia digital berketepatan tinggi dengan butiran liang yang jelas, menyambung dengan lancar dengan Maya, Unity dan alat pengeluaran lain

May 23, 2023 pm 02:34 PM

Dapatkan isteri 3D maya dalam masa 30 saat dengan satu kad! Teks kepada 3D menjana manusia digital berketepatan tinggi dengan butiran liang yang jelas, menyambung dengan lancar dengan Maya, Unity dan alat pengeluaran lain

May 23, 2023 pm 02:34 PM

ChatGPT telah menyuntik satu dos darah ayam ke dalam industri AI, dan segala-galanya yang dahulunya tidak dapat dibayangkan telah menjadi amalan asas hari ini. Text-to-3D, yang terus maju, dianggap sebagai tempat liputan seterusnya dalam medan AIGC selepas Difusi (imej) dan GPT (teks), dan telah mendapat perhatian yang tidak pernah berlaku sebelum ini. Tidak, produk yang dipanggil ChatAvatar telah dimasukkan ke dalam beta awam sederhana, dengan cepat memperoleh lebih 700,000 tontonan dan perhatian, dan telah dipaparkan di Spacesoftheweek. △ChatAvatar juga akan menyokong teknologi Imageto3D yang menjana aksara bergaya 3D daripada lukisan asal perspektif tunggal/berbilang perspektif Model 3D yang dihasilkan oleh versi beta semasa telah mendapat perhatian meluas.

Yang terbaru dari Universiti Oxford! Mickey: Padanan imej 2D dalam SOTA 3D! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Yang terbaru dari Universiti Oxford! Mickey: Padanan imej 2D dalam SOTA 3D! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Pautan projek ditulis di hadapan: https://nianticlabs.github.io/mickey/ Memandangkan dua gambar, pose kamera di antara mereka boleh dianggarkan dengan mewujudkan kesesuaian antara gambar. Biasanya, surat-menyurat ini adalah 2D hingga 2D, dan anggaran pose kami adalah skala-tak tentu. Sesetengah aplikasi, seperti realiti tambahan segera pada bila-bila masa, di mana-mana sahaja, memerlukan anggaran pose metrik skala, jadi mereka bergantung pada penganggar kedalaman luaran untuk memulihkan skala. Makalah ini mencadangkan MicKey, proses pemadanan titik utama yang mampu meramalkan korespondensi metrik dalam ruang kamera 3D. Dengan mempelajari padanan koordinat 3D merentas imej, kami dapat membuat kesimpulan relatif metrik

Tafsiran mendalam algoritma persepsi visual 3D untuk pemanduan autonomi

Jun 02, 2023 pm 03:42 PM

Tafsiran mendalam algoritma persepsi visual 3D untuk pemanduan autonomi

Jun 02, 2023 pm 03:42 PM

Untuk aplikasi pemanduan autonomi, adalah perlu untuk melihat pemandangan 3D. Alasannya mudah sahaja. Kenderaan tidak boleh memandu berdasarkan hasil persepsi yang diperolehi daripada sesuatu imej. Oleh kerana jarak objek dan maklumat kedalaman tempat kejadian tidak dapat dicerminkan dalam hasil persepsi 2D, maklumat ini adalah kunci untuk sistem pemanduan autonomi untuk membuat pertimbangan yang betul ke atas persekitaran sekeliling. Secara umumnya, penderia visual (seperti kamera) kenderaan autonomi dipasang di atas badan kenderaan atau pada cermin pandang belakang di dalam kenderaan. Tidak kira di mana ia berada, apa yang kamera dapat adalah unjuran dunia sebenar dalam pandangan perspektif (PerspectiveView) (sistem koordinat dunia kepada sistem koordinat imej). Pandangan ini hampir sama dengan sistem penglihatan manusia,