ChatGPT Waterloo: Larangan akaun yang meluas diharamkan oleh Itali

ChatGPT nampaknya sedang mengalami waterloo.

Pada 31 Mac, sebilangan besar pengguna mengadu di platform sosial bahawa mereka tidak lagi boleh log masuk ke akaun ChatGPT yang telah mereka buka dengan wang mereka sendiri, dan yang lebih memalukan ialah mereka tidak boleh mendaftar akaun baru. Memandangkan semakin ramai pengguna mendedahkan, didapati insiden larangan akaun telah bermula pada 30 Mac dan merebak dengan pantas.

Pada 1 April, semakin ramai orang mengatakan bahawa akaun mereka telah disekat, dan orang di platform utama serta sembang kumpulan bergegas untuk memberitahu satu sama lain "nota" untuk mengelakkan daripada disekat. Pada masa ini, akaun Plus yang pada asalnya boleh digunakan tidak terlepas, dan menjadi tidak sah satu demi satu, dan beberapa rekod tidak dapat disemak dalam bil.

Peliknya, setakat 3 April, sekatan akaun berskala besar nampaknya tidak berhenti ramai netizen juga menyiarkan di platform sosial dengan mengatakan, "ChatGPT semakin besar. Kawasan itu ditutup." Sebilangan besar pengguna melaporkan bahawa larangan akaun senyap kali ini tertumpu terutamanya di Asia Pada masa yang sama, OpenAI tidak mengeluarkan sebarang amaran atau tindak balas terhadap perkara ini.

Dari segi pematuhan, ChatGPT juga telah menghadapi penelitian baharu. Laman web Rekod mendedahkan bahawa agensi perlindungan data Itali secara rasmi mengumumkan larangan sementara penggunaan ChatGPT dan dengan tegas meminta syarikat induknya OpenAI untuk berhenti memproses maklumat pengguna Itali. Itali "melepaskan" pukulan pertama untuk mengharamkan ChatGPT!

Mengenai sebab pengharaman ChatGPT, pihak berkuasa perlindungan data Itali menyatakan bahawa OpenAI bukan sahaja secara haram mengumpul sejumlah besar data peribadi pengguna Itali, tetapi yang lebih teruk ialah OpenAI tidak menyediakan mekanisme untuk menyemak umur pengguna ChatGPT untuk menghalang kanak-kanak di bawah umur daripada menghubunginya.

Agensi perlindungan data Itali selanjutnya menyatakan bahawa OpenAI mempunyai 20 hari untuk mempertahankan kecurian maklumatnya, jika tidak, ia boleh didenda sehingga 20 juta euro atau perolehan tahunan syarikat kerana melanggar Peraturan Perlindungan Data Umum EU 4% penalti. Bukan sahaja dari segi denda, apabila OpenAI tidak dapat menjelaskan secara terperinci sama ada ia telah mengambil langkah untuk melindungi data pengguna, ia pasti akan meningkatkan kebarangkalian negara EU mengharamkan ChatGPT.

Selepas Itali mengharamkan ChatGPT, OpenAI segera membawa ChatGPT di luar talian di Itali, Ketua Pegawai Eksekutifnya Sam Altman segera tweet untuk menjelaskan bahawa kerja yang dilakukan oleh syarikat itu adalah untuk melatih sistem kecerdasan buatan seperti ChatGPT Apabila mengurangkan data peribadi, kami berharap kecerdasan buatan kita memahami dunia dan bukannya individu. Syarikat itu tidak melanggar sebarang peraturan dan sangat berharap untuk bekerjasama dengan pihak berkuasa perlindungan data peribadi Itali.

ChatGPT sudah pasti pedang bermata dua

Tidak dapat dinafikan bahawa kemunculan ChatGPT akan mencetuskan pusingan baharu revolusi maklumat dan memberi manfaat yang lebih baik kepada manusia. , tetapi mana-mana Semuanya mempunyai dua sisi Apabila masyarakat menantikan peluang yang belum pernah terjadi sebelumnya yang akan dibawa oleh ChatGPT kepada manusia, ia juga harus memikirkan risiko keselamatan yang akan dibawa oleh kemunculannya. Lagipun, dalam masa dua atau tiga bulan sahaja, risiko keselamatan yang timbul daripada penggunaan ChatGPT telah muncul satu demi satu.

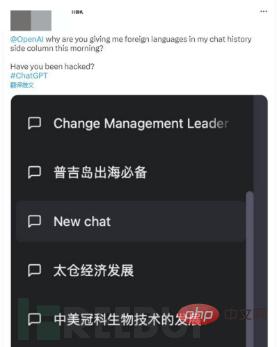

Pengguna boleh melihat rekod sembang pengguna lain

ChatGPT sentiasa menampilkan dirinya sebagai imej "sempurna" selepas pelancarannya, tetapi apabila bilangan pengguna semakin meningkat , beberapa isu keselamatan mula muncul bahaya tersembunyi.

Pada awal Mac 2023, sesetengah pengguna mendedahkan bahawa rekod sembang orang lain dipaparkan dalam senarai sembang mereka Buat sementara waktu, ChatGPT membocorkan data pengguna dan menduduki senarai media sosial utama, akhirnya, CEO OpenAI syarikat induknya Sam... Altman terpaksa mengeluarkan tweet dengan segera untuk menjelaskan kepada pengguna bahawa BUG yang menyebabkan sejarah sembang ChatGPT pengguna dibocorkan hanyalah pepijat dalam pangkalan kod sumber terbuka.

Selepas kebocoran rekod sembang pengguna, walaupun OpenAI dengan mudah mengakui kepada media bahawa terdapat kelemahan keselamatan dalam ChatGPT dan segera pergi fungsi sejarah Sembang luar talian, tetapi telah ditekankan bahawa hanya tajuk sejarah sembang dibocorkan dan pengguna tidak dapat melihat kandungan sembang sebenar orang lain.

Berdasarkan maklumat yang didedahkan oleh OpenAI, kandungan perbualan pengguna akan disimpan secara automatik ke awan, dan terdapat kemungkinan dicuri oleh pihak ketiga Digabungkan dengan kebocoran rekod sembang sejarah ini, semakin ramai penyelidik keselamatan mula berfikir dengan serius Sama ada isu keselamatan maklumat dalam ChatGPT adalah tidak sengaja.

Penggunaan ChatGPT oleh Samsung membawa kepada kebocoran data sulit

Satu gelombang demi gelombang. Minggu lalu, media Korea Selatan mendedahkan bahawa gergasi teknologi Samsung Electronics terdedah kepada tiga kebocoran data sulit dalaman kurang daripada 20 hari selepas memperkenalkan ChatGPT. (2 kes berkaitan dengan peralatan semikonduktor, dan 1 kes berkaitan dengan kandungan mesyuarat dalaman).

Dilaporkan bahawa maklumat sulit Samsung Electronics ini mungkin telah diimport ke dalam pangkalan data ChatGPT dan berisiko kebocoran pada bila-bila masa.

Butiran tiga insiden:

- Pekerja Jabatan Penyelesaian Peralatan Samsung DS mendapati kewujudan salinan semasa memuat turun perisian semasa mengendalikan peralatan ujian semikonduktor Di sana terdapat beberapa masalah, jadi saya menampal kod yang bermasalah ke dalam ChatGPT dan cuba mendapatkan bantuan Walau bagaimanapun, ini mungkin menyebabkan ChatGPT menggunakan maklumat sulit Samsung sebagai bahan latihan

- Seorang lagi dari Jabatan Penyelesaian Peranti DS Seorang pekerja mencuba untuk menggunakan ChatGPT untuk membantunya mengoptimumkan sekeping kod, jadi dia terus memasukkan sekeping kod yang berkaitan dengan output dan menghasilkan peralatan rakaman; Selepas menukarnya kepada teks, saya ingin menggunakan ChatGPT untuk meringkaskan dan memperhalusi kandungan mesyuarat, tetapi ini boleh menyebabkan kebocoran minit mesyuarat sulit.

- Selepas kebocoran Samsung Electronics, mereka segera mengatur kakitangan keselamatan secara dalaman untuk merumuskan langkah perlindungan yang berkaitan, dan menyatakan bahawa jika insiden serupa berlaku lagi pada masa hadapan, Samsung mungkin memotong perkhidmatan ChatGPT secara dalaman. Di samping itu, media mendedahkan bahawa Samsung sedang mempertimbangkan untuk membangunkan perkhidmatan AI khusus Samsung melalui Pusat Inovasi Jabatan DS.

Pada 11 Mac tahun ini, Samsung Electronics meluluskan resolusi untuk membenarkan pekerja jabatan DS menggunakan ChatGPT, tetapi ChatGPT masih dilumpuhkan untuk pekerja jabatan pengalaman peranti DX. Akibatnya, kami menghadapi tiga insiden keselamatan yang tidak dijangka dalam masa dua puluh hari sahaja Ini menunjukkan bahawa keselamatan ChatGPT sememangnya wajar dipertimbangkan.

Samsung bukan satu-satunya syarikat tempat pekerja memuat naik data sulit korporat ke ChatGPT. Berdasarkan statistik Cyberhaven mengenai penggunaan ChatGPT oleh 1.6 juta pekerja, kira-kira 3.1% pekerja memuat naik terus data korporat dalaman ke ChatGPT untuk analisis bagi meningkatkan kecekapan kerja.

Sebilangan tokoh saintifik bersama-sama menggesa penggantungan penyelidikan pembangunan AI yang lebih berkuasaSeperti yang dapat dilihat daripada kandungan yang disebutkan di atas, ChatGPT digunakan secara meluas dan membawa beberapa risiko keselamatan yang serius, oleh itu, mengenai ChatGPT dan masa depan kecerdasan buatan, telah menimbulkan kebimbangan orang ramai tentang teknologi AI, dan ramai tokoh saintifik terkenal telah bersama-sama menyatakan bahawa mereka telah menggantung pembangunan sistem AI yang lebih berkuasa.

Pada 29 Mac, waktu AS, termasuk bapa kecerdasan buatan, Jeffrey Hinton, CEO Tesla dan Twitter Elon Musk, pemenang Anugerah Turing Joshua Bengio, dll. Beribu-ribu pakar kecerdasan buatan dan eksekutif industri, termasuk syarikat , menandatangani surat terbuka bertajuk "Penggantungan Eksperimen Model Besar dalam AI" yang dikeluarkan oleh Future of Life Institute, sebuah organisasi bukan untung AS.

Dalam surat mereka, pakar kanan ini menyeru semua makmal kecerdasan buatan untuk menangguhkan pembangunan dan latihan sistem kecerdasan buatan yang lebih berkuasa selama sekurang-kurangnya setengah tahun dalam keadaan istimewa , kerajaan harus Campur Tangan dengan segera dan segera menggantung penyelidikan sistem AI.

Dalam surat mereka, pakar kanan ini menyeru semua makmal kecerdasan buatan untuk menangguhkan pembangunan dan latihan sistem kecerdasan buatan yang lebih berkuasa selama sekurang-kurangnya setengah tahun dalam keadaan istimewa , kerajaan harus Campur Tangan dengan segera dan segera menggantung penyelidikan sistem AI.

Atas ialah kandungan terperinci ChatGPT Waterloo: Larangan akaun yang meluas diharamkan oleh Itali. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

DALL-E 3 telah diperkenalkan secara rasmi pada September 2023 sebagai model yang jauh lebih baik daripada pendahulunya. Ia dianggap sebagai salah satu penjana imej AI terbaik setakat ini, mampu mencipta imej dengan perincian yang rumit. Walau bagaimanapun, semasa pelancaran, ia adalah tidak termasuk

Bagaimana untuk memasang chatgpt pada telefon bimbit

Mar 05, 2024 pm 02:31 PM

Bagaimana untuk memasang chatgpt pada telefon bimbit

Mar 05, 2024 pm 02:31 PM

Langkah pemasangan: 1. Muat turun perisian ChatGTP dari laman web rasmi ChatGTP atau kedai mudah alih 2. Selepas membukanya, dalam antara muka tetapan, pilih bahasa sebagai bahasa Cina 3. Dalam antara muka permainan, pilih permainan mesin manusia dan tetapkan Spektrum bahasa Cina; 4 Selepas memulakan, masukkan arahan dalam tetingkap sembang untuk berinteraksi dengan perisian.

Bolehkah chatgpt digunakan di China?

Mar 05, 2024 pm 03:05 PM

Bolehkah chatgpt digunakan di China?

Mar 05, 2024 pm 03:05 PM

chatgpt boleh digunakan di China, tetapi tidak boleh didaftarkan, begitu juga di Hong Kong dan Macao Jika pengguna ingin mendaftar, mereka boleh menggunakan nombor telefon mudah alih asing untuk mendaftar. Perhatikan bahawa semasa proses pendaftaran, persekitaran rangkaian mesti ditukar IP asing.

Kuasai keselamatan rangkaian dan ujian penembusan dalam Go

Nov 30, 2023 am 10:16 AM

Kuasai keselamatan rangkaian dan ujian penembusan dalam Go

Nov 30, 2023 am 10:16 AM

Dengan perkembangan Internet, keselamatan rangkaian telah menjadi isu yang mendesak. Bagi kakitangan teknikal yang terlibat dalam kerja keselamatan rangkaian, sudah pasti perlu untuk menguasai bahasa pengaturcaraan yang cekap, stabil dan selamat. Antaranya, bahasa Go telah menjadi pilihan pertama bagi ramai pengamal keselamatan rangkaian. Bahasa Go, dirujuk sebagai Golang, ialah bahasa pengaturcaraan sumber terbuka yang dicipta oleh Google. Bahasa ini mempunyai ciri yang luar biasa seperti kecekapan tinggi, konkurensi tinggi, kebolehpercayaan yang tinggi dan keselamatan yang tinggi, jadi ia digunakan secara meluas dalam keselamatan rangkaian dan ujian penembusan.

Kecerdasan Buatan dalam Keselamatan Siber: Isu Semasa dan Hala Tuju Masa Depan

Mar 01, 2024 pm 08:19 PM

Kecerdasan Buatan dalam Keselamatan Siber: Isu Semasa dan Hala Tuju Masa Depan

Mar 01, 2024 pm 08:19 PM

Kecerdasan buatan (AI) telah merevolusikan setiap bidang, dan keselamatan siber tidak terkecuali. Apabila pergantungan kami pada teknologi terus meningkat, begitu juga ancaman terhadap infrastruktur digital kami. Kecerdasan buatan (AI) telah merevolusikan bidang keselamatan siber, menyediakan keupayaan lanjutan untuk pengesanan ancaman, tindak balas insiden dan penilaian risiko. Walau bagaimanapun, terdapat beberapa kesukaran menggunakan kecerdasan buatan dalam keselamatan siber. Artikel ini akan menyelidiki status semasa kecerdasan buatan dalam keselamatan siber dan meneroka arah masa hadapan. Peranan kecerdasan buatan dalam keselamatan siber Kerajaan, perniagaan dan individu menghadapi cabaran keselamatan siber yang semakin teruk. Apabila ancaman siber menjadi lebih canggih, keperluan untuk langkah perlindungan keselamatan lanjutan terus meningkat. Kecerdasan buatan (AI) bergantung pada kaedah uniknya untuk mengenal pasti, mencegah

SearchGPT: Open AI mengambil alih Google dengan enjin carian AInya sendiri

Jul 30, 2024 am 09:58 AM

SearchGPT: Open AI mengambil alih Google dengan enjin carian AInya sendiri

Jul 30, 2024 am 09:58 AM

Open AI akhirnya membuat cariannya. Syarikat San Francisco baru-baru ini telah mengumumkan alat AI baharu dengan keupayaan carian. Pertama kali dilaporkan oleh The Information pada Februari tahun ini, alat baharu ini dipanggil SearchGPT dan menampilkan c

Bagaimanakah fungsi C++ melaksanakan keselamatan rangkaian dalam pengaturcaraan rangkaian?

Apr 28, 2024 am 09:06 AM

Bagaimanakah fungsi C++ melaksanakan keselamatan rangkaian dalam pengaturcaraan rangkaian?

Apr 28, 2024 am 09:06 AM

Fungsi C++ boleh mencapai keselamatan rangkaian dalam pengaturcaraan rangkaian Kaedah termasuk: 1. Menggunakan algoritma penyulitan (openssl) untuk menyulitkan komunikasi 2. Menggunakan tandatangan digital (cryptopp) untuk mengesahkan integriti data dan identiti pengirim ( htmlcxx) untuk menapis dan membersihkan input pengguna.

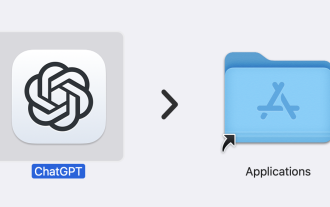

ChatGPT kini tersedia untuk macOS dengan keluaran apl khusus

Jun 27, 2024 am 10:05 AM

ChatGPT kini tersedia untuk macOS dengan keluaran apl khusus

Jun 27, 2024 am 10:05 AM

Aplikasi ChatGPT Mac Buka AI kini tersedia untuk semua orang, telah dihadkan kepada mereka yang mempunyai langganan ChatGPT Plus sahaja untuk beberapa bulan lepas. Apl ini dipasang sama seperti mana-mana apl Mac asli yang lain, selagi anda mempunyai Apple S yang terkini