Peranti teknologi

Peranti teknologi

AI

AI

Google kalah dalam pertempuran LLM! Semakin ramai penyelidik terkemuka bertukar kerja di OpenAI

Google kalah dalam pertempuran LLM! Semakin ramai penyelidik terkemuka bertukar kerja di OpenAI

Google kalah dalam pertempuran LLM! Semakin ramai penyelidik terkemuka bertukar kerja di OpenAI

Beberapa hari lalu, Google hampir menghadapi krisis perhubungan awam Jacob Devlin, bekas pekerja Bert yang telah berhenti OpenAI, mendedahkan bahawa Bard sebenarnya telah dilatih menggunakan data ChatGPT.

Seterusnya, Google segera menafikannya.

Dan kontroversi ini juga telah membawa kepada perbincangan besar: Mengapa semakin ramai penyelidik Google terkemuka menukar pekerjaan kepada OpenAI? Adakah ia masih boleh memenangi pertempuran LLM ini?

Jawapan pemberi maklumat

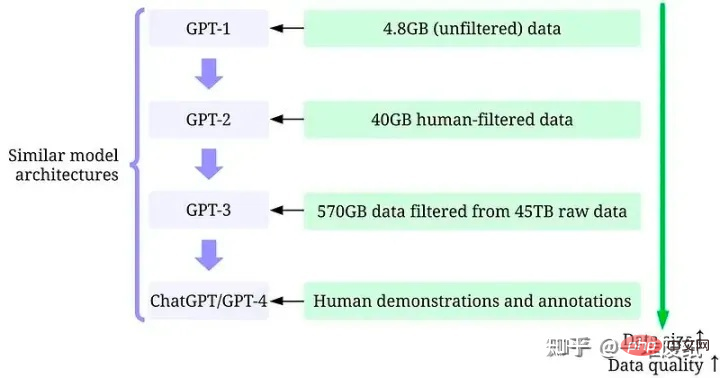

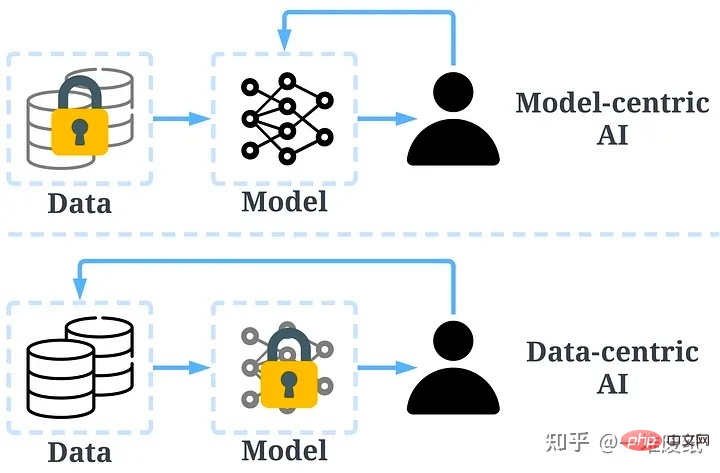

Seorang doktor dari Rice University dan rakan yang dimaklumkan mengatakan bahawa sebenarnya, jurang antara Google dan OpenAI ialah jurang Data.

"OpenAI mempunyai obsesi yang kuat terhadap LLM, yang sama sekali tidak dapat ditandingi oleh syarikat seperti Google. Sudah tentu, jurang antara orang hanya satu aspek, jurang dalam data dan sikap terhadap data adalah kunci kepada kejayaan. Orang mungkin boleh membelanjakan wang untuk menggalinya kembali, dan teknologi mungkin dapat menebusnya, tetapi jurang data tidak akan diambil oleh Google dalam masa yang singkat.”

https:/ /arxiv.org/abs/2303.10158

"Zhang Junlin", responden yang cemerlang dalam pemprosesan bahasa semula jadi dan topik pembelajaran mendalam, berkata OpenAI telah meninggalkan semua orang.

Sumber foto: "Chen Dabao"

Orang tanpa nama yang mempunyai minat turut muncul di ruangan komen.Seorang lagi tanpa nama mencapai sasaran.

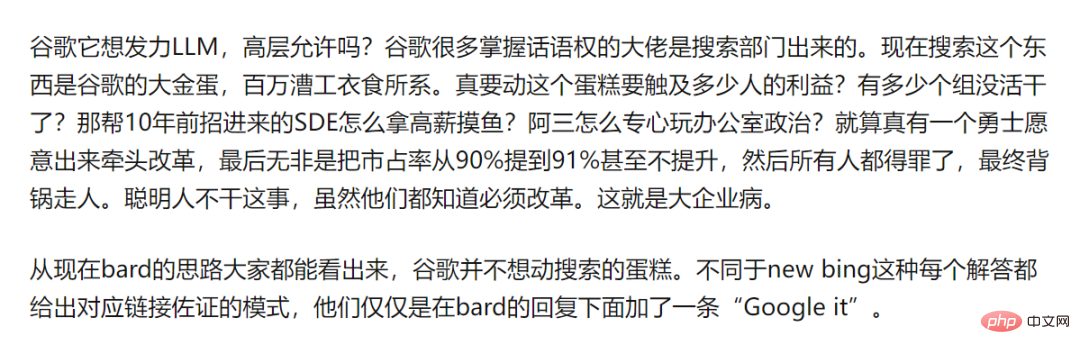

Seorang rakan menunjukkan "dilema inovator" Google sebagai sebuah syarikat besar.

Seorang lagi minat tanpa nama muncul.

Zhu Xingnan (Bill), rakan karib, membuat kesimpulan bahawa syarikat besar seperti Google akan menjadi berasaskan bakat, semua orang adalah bodoh.

Dan Insider meringkaskan artikel yang panjang untuk kita, mengambil kira bakat terbaik yang telah hilang daripada pasukan kecerdasan buatan Google selama ini.

Ke mana perginya semua bakat?

Google telah menyumbang beberapa penyelidikan yang sangat penting kepada bidang kecerdasan buatan. Walau bagaimanapun, syarikat itu lambat mengubah inovasinya menjadi produk.

Akibatnya, penyelidik AI terkemuka akan pergi ke syarikat permulaan yang boleh menjana nilai dan impak yang lebih besar, seperti OpenAI, Character.AI, DeepMind, Cohere, Inceptive.

Google sudah berada dalam posisi bertahan dan akan kehilangan kedudukan utamanya dalam bidang kecerdasan buatan pada bila-bila masa. Pemergian penyelidik terkemuka telah memburukkan lagi masalah.

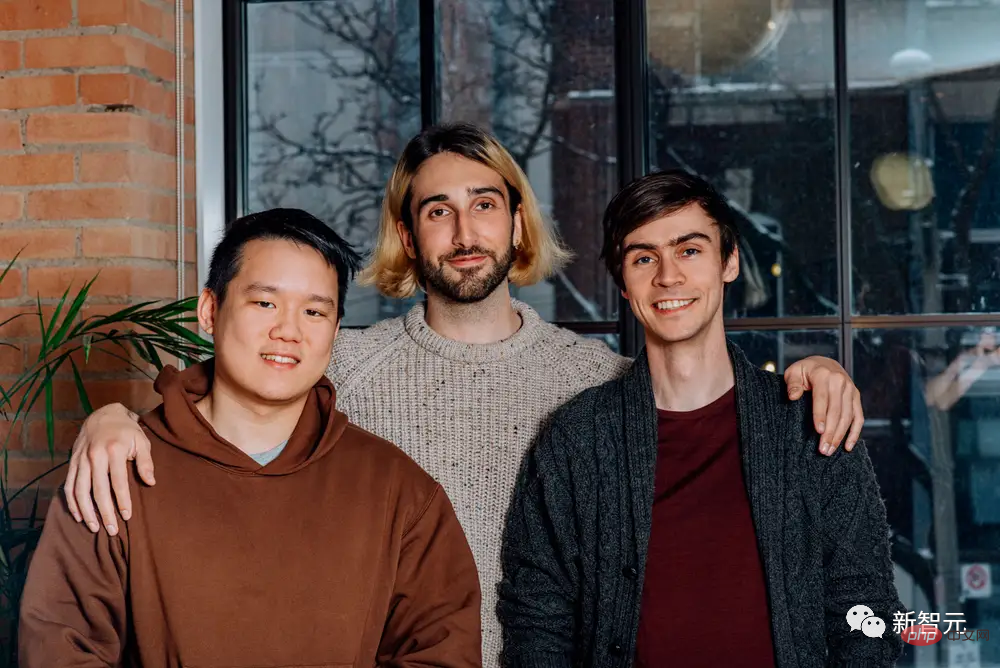

Pasukan pengasas bersama Cohere Ivan Zhang, Aidan Gomez dan Nick Frosst

Walaupun Google mungkin dalam mod defensif, ia tidak perlu . Syarikat itu mencipta kebanyakan teknologi asas itu sendiri, menjanakan produk seperti ChatGPT. Ia juga menjadikan penyelidikannya tersedia sebagai sumber terbuka, yang agak mengironi kenaikan meteorik OpenAI.

Google telah lama teragak-agak untuk mengeluarkan chatbot yang serupa dengan ChatGPT kerana bimbang teknologi itu akan menyebabkan kerosakan reputasi kepada perniagaannya.

Daniel De Freitas dan Noam Shazeer, dua penyelidik di belakang model bahasa berskala besar Google LaMDA, telah meninggalkan syarikat itu, kecewa dengan kelewatannya dalam mengeluarkan chatbot yang serupa dengan ChatGPT.

Bekas penyelidik Google yang lain juga percaya bahawa dalam era kecerdasan buatan yang begitu menarik, syarikat pemula akan memberikan para penyelidik pemilikan hasil mereka dan memberikan lebih nilai dan kesan kepada diri mereka sendiri.

Berikut ialah beberapa kertas berprofil tinggi dalam bidang kecerdasan buatan oleh penyelidik yang telah meninggalkan Google untuk syarikat lain.

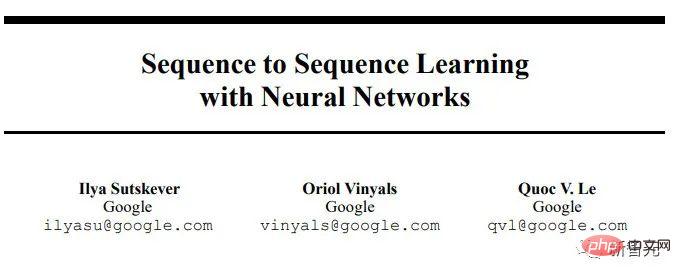

Ilya Sutskever

"Pembelajaran urutan-ke-jujukan dengan rangkaian saraf" telah diterbitkan pada tahun 2014. Kertas urutan-ke-jujukan ini membincangkan model bahasa latihan dan mengubah medan ke dalam Menukarkan urutan perkataan kepada urutan dalam domain lain. Contohnya, tukarkan ayat bahasa Inggeris kepada ayat bahasa Perancis.

Ilya Sutskever mengetuai penyelidikan untuk kertas ini. Dia meninggalkan Google pada 2015 selepas hampir tiga tahun sebagai saintis penyelidikan. Sutskever ialah pengasas bersama OpenAI dan terus bekerja di sana sebagai ketua saintisnya.

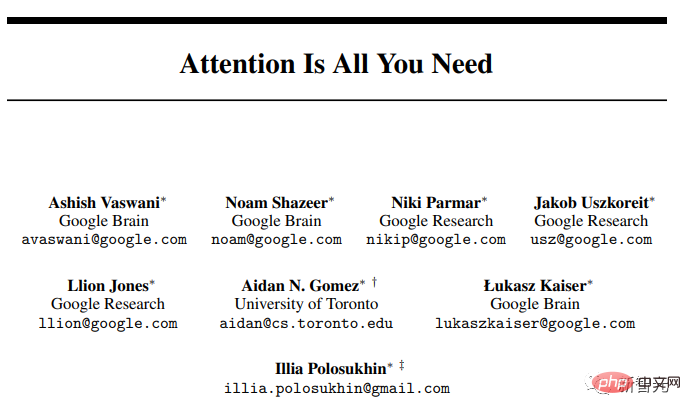

Perhatian adalah yang anda perlukan

Kertas blokbuster Transformer ini kini telah disebut lebih 70,000 kali Kadar Kedua. Transformer dianggap sebagai satu kejayaan dalam pemprosesan bahasa semula jadi. Ia membantu AI memahami makna dengan mengumpul nuansa kontekstual dengan melihat setiap perkataan dalam ayat secara serentak dan menimbang kepentingan setiap perkataan.

"T" dalam ChatGPT bermaksud Transformer, yang menunjukkan kepentingan kertas kerja ini.

Walau bagaimanapun, lapan pengarang artikel ini, kecuali Llion Jones, semuanya telah meninggalkan Google.

Ashish Vaswani meninggalkan Google Brain (pasukan penyelidikan kecerdasan buatan pembelajaran mendalam Google) selepas lima tahun memulakan Adept, sebuah syarikat yang baru-baru mengumpul $350 juta, Bina alat AI generatif untuk membantu orang ramai menggunakan perisian produktiviti dengan lebih berkesan. Dia baru-baru ini meninggalkan Adept untuk permulaan yang tersembunyi.

Noam Shazeer kini ialah Ketua Pegawai Eksekutif Character.AI.

Niki Parmar meninggalkan Google Brain selepas lima tahun untuk berkhidmat sebagai pengasas bersama dan ketua pegawai teknologi Adept, tetapi seperti Vaswani, dia juga baru-baru ini pergi, pergi ke sebuah syarikat permulaan rahsia.

Jakob Uszkoreit telah bekerja di Google selama 13 tahun, bekerja pada rangkaian saraf dan pembelajaran mendalam. Beliau kini merupakan pengasas bersama Inceptive, sebuah syarikat permulaan yang menggunakan pembelajaran mendalam untuk mereka bentuk rawatan baharu.

Aidan Gomez ialah pengasas bersama dan Ketua Pegawai Eksekutif Cohere, sebuah syarikat yang telah mengumpul kira-kira $160 juta untuk membantu pemaju menghidupkan kecerdasan buatan generatif. aplikasi dan tapak web. Dia menghabiskan satu setengah tahun sebagai penyelidik di Google Brain. Dan pengasas bersamanya di Cohere, Nick Frosst, menghabiskan empat tahun sebagai penyelidik di Google Brain.

Lukasz Kaiser meninggalkan Google Brain selepas bekerja di Google Brain selama lebih daripada 7 tahun dan menyertai OpenAI pada 2021. Kaiser baru-baru ini disebut dalam kertas putih OpenAI GPT-4 sebagai penyumbang teras kepada keupayaan konteks panjangnya, membolehkan chatbots mempunyai perbualan yang lebih lama sebelum melupakan konteks perbincangan.

Illia Polosukhin telah mengusahakan pembelajaran mendalam dan pemahaman bahasa semula jadi di Google Brain selama tiga tahun. Beliau meninggalkan pada 2017 dan mengasaskan Pagoda, platform permulaan Web3.

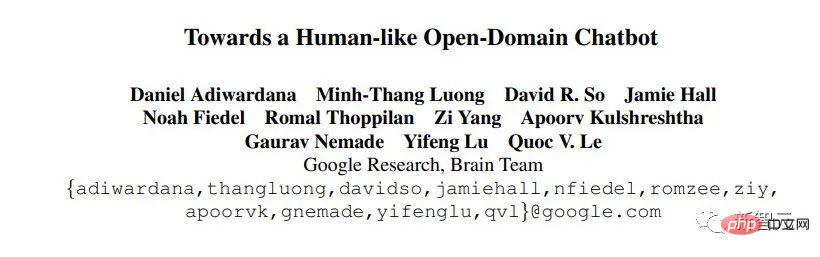

Membina bot sembang domain terbuka seperti manusia

Kertas kerja ini memperkenalkan bot sembang asal Google Meena, Meneroka cara bot sembang boleh belajar bercakap tentang topik dengan mengkaji data yang dikikis daripada perbualan media sosial awam. Ia juga menerangkan ujian yang dibuat oleh Google untuk menilai prestasi pertuturan chatbots.

Kertas kerja ini merupakan satu lagi pencapaian penting dalam pemodelan bahasa yang besar. Penulis percaya bahawa mereka boleh membuat model bahasa yang besar yang boleh menghasilkan respons seperti manusia terhadap masalah tanpa latihan berkod keras.

Salah seorang pengarang, Daniel De Freitas, berkhidmat sebagai pengasas bersama dan presiden Character.AI selepas bekerja sebagai penyelidik di Google Brain selama lima tahun.

Rakan sekerja De Freitas.AI, Romal Thoppilan turut menyumbang kepada artikel ini.

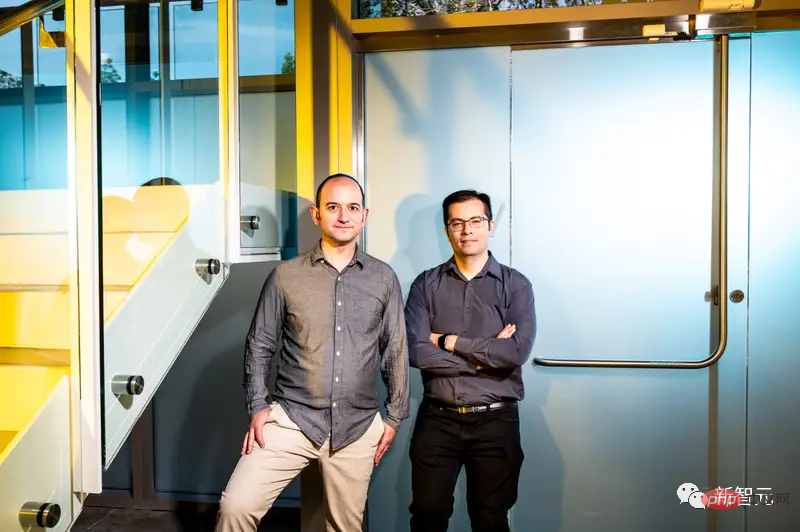

Di sebelah kiri ialah Romal Thoppilan; di sebelah kanan ialah Daniel De Freitas

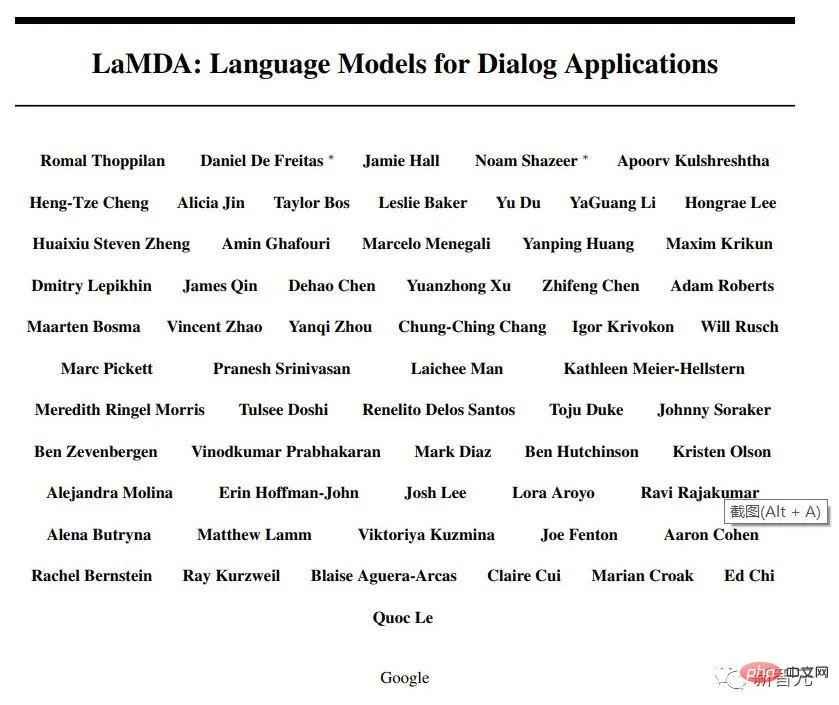

LaMDA: Model bahasa untuk aplikasi perbualan

LaMDA ialah singkatan Model Bahasa untuk Aplikasi Dialog dan merupakan asas kepada chatbot Bard. Ia pertama kali ditunjukkan pada tahun 2020 sebagai Meena, tetapi Google tidak pernah mengeluarkan Meena kepada umum. Bekas pekerja kumpulan penyelidikan kecerdasan buatan Google menjelaskan bahawa ini akan menjadi mimpi ngeri perhubungan awam kerana Google bimbang bot akan membuat komen yang berbahaya.

Beberapa penyelidik utama di belakang LaMDA telah meninggalkan Google Brain.

Character.AI, sebuah syarikat yang diasaskan tahun lepas oleh Daniel De Freitas dan Noam Shazeer, baru-baru ini mengumpulkan kira-kira $200 juta untuk mencipta chatbot yang bercakap dalam bentuk pelbagai watak, daripada Musk kepada ahli terapi kepada jenis peranan .

Romal Thoppilan berkhidmat sebagai penyelidik pengasas Character.AI selepas bekerja di Google Brain selama 7 tahun.

Alicia Jin akan menyertai Character.AI pada penghujung tahun 2022 sebagai jurutera penyelidikan. Dia bekerja di Google Brain selama tiga tahun.

BERT

BERT (Perwakilan Pengekod Dua Arah daripada Transformers) dibina pada model Transformer pemprosesan bahasa semula jadi Selepas pra-latihan, ia boleh menyelesaikan dua tugas dengan baik: Pemodelan bahasa bertopeng dan ramalan ayat seterusnya. Dalam erti kata lain, BERT cuba meramalkan perkataan tersembunyi atau "bertopeng", memaksa algoritma bekerja keras untuk mengetahui lebih lanjut tentang teks sekeliling dan meramalkan perkataan tersembunyi dengan lebih baik.

Jika anda menaip "bolehkah anda membeli ubat untuk farmasi orang lain?" ia akan memahami bahawa "orang lain" adalah bahagian penting dalam pertanyaan.

Google mula memasukkan BERT ke dalam enjin cariannya seawal 2019. Ini adalah salah satu peningkatan terbesar dalam ketepatan carian sejak penggabungan algoritma pembelajaran mesin lain, RankBrain, pada tahun 2015.

Jacob Devlin ialah pengarang utama kertas kerja ini, dan dia menyertai OpenAI sejurus sebelum pelancaran ChatGPT.

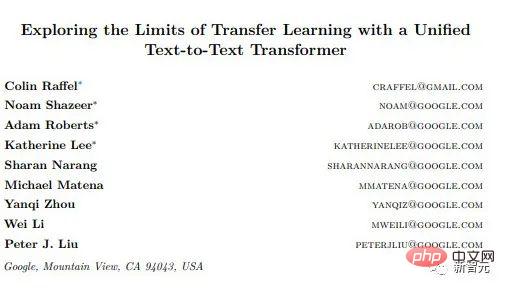

T5

Nama rasmi kertas T5 ialah "Meneroka Had Pembelajaran Pemindahan dengan Teks Ke- Bersepadu Text Transformer", yang Dibina berdasarkan BERT, ia sangat sesuai untuk tugasan seperti terjemahan dan ringkasan.

Colin Raffel, yang mengetuai kertas kerja itu, berkhidmat sebagai saintis penyelidikan di Google Brain selama kira-kira lima tahun sebelum meninggalkannya pada 2021. Pada masa ini penolong profesor di UNC-Chapel Hill, dia menghabiskan satu hari seminggu sebagai penyelidik di Hugging Face. Hugging Face baru-baru ini mengumumkan bahawa ia mengumpulkan $100 juta pada Mei 2022, dengan nilai syarikat itu pada $2 bilion. Pengguna boleh berkongsi model bahasa dan set data yang besar pada Wajah Memeluk.

Sharan Narang, seorang lagi penyumbang kertas T5, meninggalkan Google Brain pada 2022 selepas empat tahun di Google. Dia kini seorang penyelidik kecerdasan buatan di Meta Corporation.

Kaedah penempatan corak untuk reka bentuk cip pantas

Diketuai oleh saintis Google Azalia Mirhoseini dan Anna Goldie Kertas itu ditemui bahawa kecerdasan buatan boleh menyelesaikan proses reka bentuk cip lebih cepat daripada pakar manusia.

Satu lagi kertas yang diketuai oleh kedua-duanya, "Chip Layout with Deep Reinforcement Learning," menyediakan cara untuk menggunakan kecerdasan buatan dalam reka bentuk cip untuk memaksimumkan Meningkatkan prestasi sambil meminimumkan kawasan dan kuasa penggunaan.

Penemuan ini membantu Google mereka bentuk cip TPU khusus untuk tugasan pembelajaran mesin.

Mirhoseini dan Goldie kedua-duanya meninggalkan Google pada 2022 untuk menyertai Anthropic, pesaing OpenAI yang sedang membangunkan model bahasa berskala besarnya sendiri dan bot sembang yang dipanggil Claude.

DeepMind

Mustafa Suleyman ialah pengasas bersama DeepMind dan berkhidmat sebagai ketua pegawai produk syarikat. Ini ialah makmal kecerdasan buatan yang telah diperoleh oleh Google pada tahun 2014. Makmal membangunkan AlphaGo, program pembelajaran mesin yang mengalahkan profesional juara dunia pada permainan Go.

Syarikat induk Google Alphabet baru-baru ini mengumumkan dalam laporan pendapatan suku keempatnya bahawa keputusan kewangan DeepMind akan diasingkan daripada "pelaburan lain", menandakan peningkatan kepentingan kecerdasan buatan dalam Google strategi masa hadapan. Lazimnya, "pelaburan lain" ialah istilah umum untuk projek baru syarikat yang belum mencapai keuntungan.

Suleyman telah menjadi peguam bela yang lantang untuk memastikan keselamatan produk kecerdasan buatan baharu. Semasa bekerja di DeepMind, beliau menubuhkan jabatan penyelidikan yang dipanggil Etika dan Masyarakat DeepMind untuk mengkaji kesan kehidupan sebenar kecerdasan buatan. Pada 2019, dia telah diberi cuti oleh DeepMind selepas dituduh membuli pekerja. Dia dipindahkan semula ke Google sebagai naib presiden semasa siasatan sedang dijalankan.

Suleyman telah dipetik dalam banyak kertas penyelidikan yang berkaitan dengan pembelajaran mesin. Pada Februari 2022, beliau mengasaskan bersama permulaan kecerdasan buatan Inflection dengan pencipta LinkedIn Reid Hoffman.

Ramai penyumbang utama kepada kertas kerja kecerdasan buatan Google yang paling inovatif telah pergi, menyertai pesaing seperti OpenAI atau memulakan syarikat mereka sendiri.

Apabila OpenAI's ChatGPT keluar pada penghujung tahun 2022, Ketua Pegawai Eksekutif Google Sundar Pichai mengumumkan "amaran merah" secara dalaman, memanggil syarikat untuk bertindak balas.

Pada masa itu, Pichai berkata bahawa Google akan terus mengupah penyelidik terkemuka dalam kecerdasan buatan tanpa soalan.

Tetapi selepas kehilangan begitu ramai orang yang berkebolehan, adakah Google masih boleh mencapai kehebatan lagi?

Rujukan:

https://www.businessinsider.com/google-ai-teams-brain-drain-researchers-leave-2023-3

https: / /www.zhihu.com/question/592975340/answer/2963265672

https://zhuanlan.zhihu.com/p/597586623

https://www.zhihu.com/ question /592975340/answer/2964598555

Atas ialah kandungan terperinci Google kalah dalam pertempuran LLM! Semakin ramai penyelidik terkemuka bertukar kerja di OpenAI. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1385

1385

52

52

Cara Mengulas DeepSeek

Feb 19, 2025 pm 05:42 PM

Cara Mengulas DeepSeek

Feb 19, 2025 pm 05:42 PM

DeepSeek adalah alat pengambilan maklumat yang kuat. .

Cara Mencari DeepSeek

Feb 19, 2025 pm 05:39 PM

Cara Mencari DeepSeek

Feb 19, 2025 pm 05:39 PM

DeepSeek adalah enjin carian proprietari yang hanya mencari dalam pangkalan data atau sistem tertentu, lebih cepat dan lebih tepat. Apabila menggunakannya, pengguna dinasihatkan untuk membaca dokumen itu, cuba strategi carian yang berbeza, dapatkan bantuan dan maklum balas mengenai pengalaman pengguna untuk memanfaatkan kelebihan mereka.

Sesame Open Door Exchange Web Pautan Pautan Gerbang Perdagangan Laman Web Pendaftaran Terkini

Feb 28, 2025 am 11:06 AM

Sesame Open Door Exchange Web Pautan Pautan Gerbang Perdagangan Laman Web Pendaftaran Terkini

Feb 28, 2025 am 11:06 AM

Artikel ini memperkenalkan proses pendaftaran versi web Web Open Exchange (GATE.IO) dan aplikasi Perdagangan Gate secara terperinci. Sama ada pendaftaran web atau pendaftaran aplikasi, anda perlu melawat laman web rasmi atau App Store untuk memuat turun aplikasi tulen, kemudian isi nama pengguna, kata laluan, e -mel, nombor telefon bimbit dan maklumat lain, dan lengkap e -mel atau pengesahan telefon bimbit.

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung?

Feb 21, 2025 pm 10:57 PM

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung?

Feb 21, 2025 pm 10:57 PM

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung? Bybit adalah pertukaran cryptocurrency yang menyediakan perkhidmatan perdagangan kepada pengguna. Aplikasi mudah alih Exchange tidak boleh dimuat turun terus melalui AppStore atau GooglePlay untuk sebab -sebab berikut: 1. Aplikasi pertukaran cryptocurrency sering tidak memenuhi keperluan ini kerana ia melibatkan perkhidmatan kewangan dan memerlukan peraturan dan standard keselamatan tertentu. 2. Undang -undang dan Peraturan Pematuhan di banyak negara, aktiviti yang berkaitan dengan urus niaga cryptocurrency dikawal atau terhad. Untuk mematuhi peraturan ini, aplikasi bybit hanya boleh digunakan melalui laman web rasmi atau saluran yang diberi kuasa lain

Platform Perdagangan Pintu Terbuka Sesame Muat turun Versi Mudah Alih Platform Perdagangan Platform Perdagangan Alamat Muat Turun

Feb 28, 2025 am 10:51 AM

Platform Perdagangan Pintu Terbuka Sesame Muat turun Versi Mudah Alih Platform Perdagangan Platform Perdagangan Alamat Muat Turun

Feb 28, 2025 am 10:51 AM

Adalah penting untuk memilih saluran rasmi untuk memuat turun aplikasi dan memastikan keselamatan akaun anda.

Top 10 Disyorkan untuk App Perdagangan Aset Digital Crypto (2025 Global Ranking)

Mar 18, 2025 pm 12:15 PM

Top 10 Disyorkan untuk App Perdagangan Aset Digital Crypto (2025 Global Ranking)

Mar 18, 2025 pm 12:15 PM

Artikel ini mencadangkan sepuluh platform perdagangan cryptocurrency teratas yang memberi perhatian kepada, termasuk Binance, OKX, Gate.io, Bitflyer, Kucoin, Bybit, Coinbase Pro, Kraken, BYDFI dan Xbit yang desentralisasi. Platform ini mempunyai kelebihan mereka sendiri dari segi kuantiti mata wang transaksi, jenis urus niaga, keselamatan, pematuhan, dan ciri khas. Memilih platform yang sesuai memerlukan pertimbangan yang komprehensif berdasarkan pengalaman perdagangan anda sendiri, toleransi risiko dan keutamaan pelaburan. Semoga artikel ini membantu anda mencari saman terbaik untuk diri sendiri

WEB OPEN DOOR EXCHANGE WEB PAGE LOGIN VERSI VERSI UNTUK GATEIO Laman Web Rasmi Pintu Masuk

Mar 04, 2025 pm 11:48 PM

WEB OPEN DOOR EXCHANGE WEB PAGE LOGIN VERSI VERSI UNTUK GATEIO Laman Web Rasmi Pintu Masuk

Mar 04, 2025 pm 11:48 PM

Pengenalan terperinci kepada operasi log masuk versi Web Open Exchange, termasuk langkah masuk dan proses pemulihan kata laluan.

Portal Log Masuk Versi Rasmi Binance Binance

Feb 21, 2025 pm 05:42 PM

Portal Log Masuk Versi Rasmi Binance Binance

Feb 21, 2025 pm 05:42 PM

Untuk mengakses versi Login Laman Web Binance yang terkini, ikuti langkah mudah ini. Pergi ke laman web rasmi dan klik butang "Login" di sudut kanan atas. Pilih kaedah log masuk anda yang sedia ada. Masukkan nombor mudah alih berdaftar atau e -mel dan kata laluan anda dan pengesahan lengkap (seperti kod pengesahan mudah alih atau Google Authenticator). Selepas pengesahan yang berjaya, anda boleh mengakses Portal Log masuk laman web rasmi Binance.