Peranti teknologi

Peranti teknologi

AI

AI

Penerokaan mendalam tentang pelaksanaan teknologi pra-latihan tanpa pengawasan dan 'pengoptimuman algoritma + inovasi kejuruteraan' Huoshan Voice

Penerokaan mendalam tentang pelaksanaan teknologi pra-latihan tanpa pengawasan dan 'pengoptimuman algoritma + inovasi kejuruteraan' Huoshan Voice

Penerokaan mendalam tentang pelaksanaan teknologi pra-latihan tanpa pengawasan dan 'pengoptimuman algoritma + inovasi kejuruteraan' Huoshan Voice

Sejak sekian lama, Volcano Engine telah menyediakan penyelesaian sari kata video pintar berdasarkan teknologi pengecaman pertuturan untuk platform video popular. Ringkasnya, ia adalah fungsi yang menggunakan teknologi AI untuk menukar secara automatik suara dan lirik dalam video kepada teks untuk membantu dalam penciptaan video. Walau bagaimanapun, dengan pertumbuhan pesat pengguna platform dan keperluan untuk jenis bahasa yang lebih kaya dan lebih pelbagai, teknologi pembelajaran diselia yang digunakan secara tradisional telah mencapai kesesakan, yang telah meletakkan pasukan dalam masalah sebenar.

Seperti yang kita semua tahu, pembelajaran seliaan tradisional akan sangat bergantung pada data seliaan beranotasi secara manual, terutamanya dalam pengoptimuman berterusan bahasa besardan permulaan dingin bahasa kecil. Mengambil bahasa utama seperti bahasa Cina, Mandarin dan Inggeris sebagai contoh, walaupun platform video menyediakan data suara yang mencukupi untuk senario perniagaan, selepas data yang diselia mencapai skala tertentu, ROI anotasi berterusan akan menjadi sangat rendah, dan kakitangan teknikal semestinya perlu mempertimbangkan cara menggunakan ratusan data yang diselia dengan berkesan untuk berpuluh-puluh ribu jam data tidak berlabel untuk meningkatkan lagi prestasi pengecaman pertuturan bahasa besar.

Bagi bahasa atau dialek yang agak khusus, kos pelabelan data adalah tinggi disebabkan oleh sumber, tenaga kerja dan sebab lain. Apabila terdapat sedikit data yang dilabelkan (mengikut urutan 10 jam), kesan latihan yang diselia adalah sangat lemah dan mungkin gagal untuk menumpu dengan betul dan data yang dibeli selalunya tidak sepadan dengan senario sasaran dan tidak dapat memenuhi keperluan perniagaan.

Oleh itu, Pasukan Suara Enjin Gunung Berapi perlu segera mengkaji cara menggunakan sepenuhnya sejumlah besar data tidak berlabel pada kos pelabelan serendah mungkin, meningkatkan kesan pengecaman dengan jumlah yang kecil data berlabel, dan melaksanakannya dalam perniagaan sebenar. Oleh itu, teknologi pra-latihan tanpa pengawasan telah menjadi kunci untuk mempromosikan keupayaan platform video ASR (Pengecaman Pertuturan Automatik / Pengecaman Pertuturan Automatik) kepada bahasa kecil.

Walaupun komuniti akademik telah mencapai banyak kemajuan yang ketara dalam bidang pertuturan pra-latihan tanpa pengawasan sejak beberapa tahun kebelakangan ini, termasuk Wav2vec2.0[1] , HuBERT[2], dsb., tetapi terdapat beberapa kes pelaksanaan dalam industri untuk rujukan. Secara keseluruhan, Pasukan Volcano Voice percaya bahawa tiga sebab berikut menghalang pelaksanaan teknologi pra-latihan tanpa pengawasan:

- Parameter model adalah besar dan overhed inferens adalah tinggi. Sebilangan besar data tidak berlabel memerlukan pra-latihan tanpa pengawasan dengan model yang lebih besar untuk mendapatkan perwakilan pertuturan berkualiti tinggi Walau bagaimanapun, jika model sedemikian digunakan secara langsung dalam talian, ia akan membawa kos inferens yang tinggi.

- Pralatihan tanpa pengawasan hanya menumpukan pada pembelajaran perwakilan pertuturan Ia memerlukan penyahkodan bersama dengan sejumlah besar model bahasa terlatih teks biasa untuk mencapai kesan yang diingini dan tidak serasi dengan. enjin inferens ASR hujung ke hujung.

- Pra-latihan tanpa pengawasan adalah mahal, jangka panjang dan tidak stabil. Mengambil Wav2vec2.0 sebagai contoh, model dengan parameter 300M telah dilatih terlebih dahulu untuk 600,000 langkah menggunakan 64 V100 GPU, yang mengambil masa sehingga setengah bulan Selain itu, disebabkan perbezaan dalam pengedaran data, latihan mengenai data perniagaan terdedah kepada perbezaan.

Memandangkan tiga perkara utama di atas, penambahbaikan algoritma dan pengoptimuman kejuruteraan telah dijalankan untuk membentuk pelan pelaksanaan yang lengkap dan mudah dipromosikan. Artikel ini akan memperkenalkan penyelesaian secara terperinci daripada proses pelaksanaan, pengoptimuman algoritma dan pengoptimuman kejuruteraan.

Proses pelaksanaan

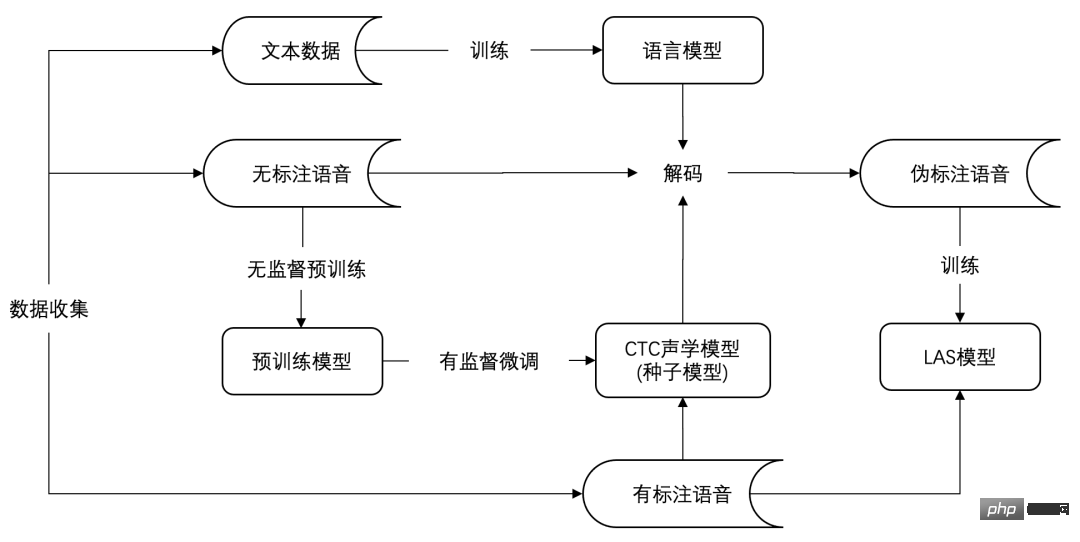

Rajah berikut ialah proses pelaksanaan pra-latihan ASR bahasa sumber rendah tanpa pengawasan, yang boleh dibahagikan secara kasar kepada data Terdapat tiga peringkat: pengumpulan, latihan model benih dan migrasi model.

Proses pelaksanaan ASR berdasarkan pra-latihan tanpa pengawasan

Secara khusus, peringkat pertama pengumpulan data boleh mengumpul data ucapan tidak berlabel, ucapan berlabel dan teks biasa dalam bahasa sasaran melalui pengalihan bahasa, perolehan dan cara lain.

Peringkat kedua latihan model benih ialah proses klasik "pra-latihan tanpa pengawasan + penalaan halus diselia". Pada peringkat ini, model akustik akan diperoleh, yang biasanya diperhalusi berdasarkan fungsi kehilangan Klasifikasi Temporal Connectionist (CTC[3]). Model akustik digabungkan dengan model bahasa yang dilatih pada teks tulen membentuk sistem pengecaman pertuturan yang lengkap, yang boleh mencapai hasil pengecaman yang baik. Sebab mengapa ia dipanggil model seed adalah kerana model ini tidak sesuai untuk dilancarkan terus ke dalam perniagaan The Volcano Engine lebih suka menggunakan LAS (Listen, Attend and Spell[4]) atau RNN-. T (Recurrent Neural Network Transducer[5]) model hujung ke hujung sedemikian digunakan dalam talian.

Sebab utama ialah LAS/RNN-T mempunyai keupayaan pemodelan hujung ke hujung yang sangat baik Pada masa yang sama, dalam beberapa tahun kebelakangan ini, ia telah mencapai hasil yang lebih baik daripada CTC tradisional model, dan dalam Ia semakin digunakan dalam industri. Enjin Volcano telah melakukan banyak kerja pengoptimuman pada inferens dan penggunaan model pengecaman pertuturan hujung ke hujung, dan telah membentuk penyelesaian yang agak matang untuk menyokong banyak perniagaan. Sambil mengekalkan kesan tanpa kerugian, jika enjin inferens hujung ke hujung boleh digunakan, kos operasi dan penyelenggaraan enjin boleh dikurangkan dengan banyak.

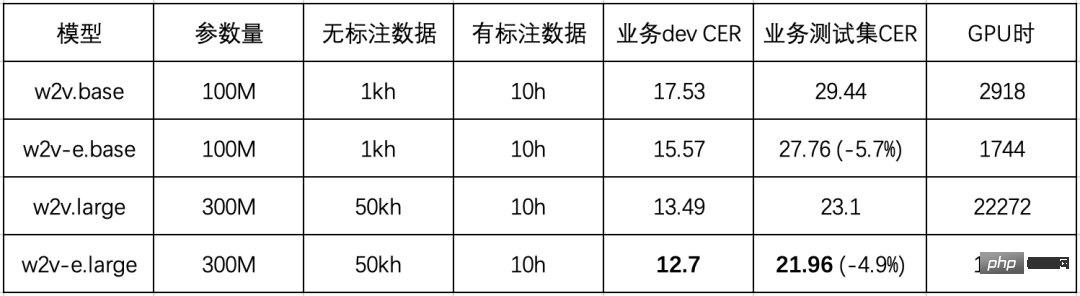

Berdasarkan ini, pasukan mereka bentuk fasa ketiga, iaitu fasa migrasi model. Terutamanya menggunakan idea penyulingan pengetahuan, gunakan model benih untuk melabel pseudo data tidak berlabel, dan kemudian menyediakan model LAS dengan bilangan parameter yang lebih kecil untuk latihan, secara serentak merealisasikan penghijrahan struktur model dan pemampatan pengiraan inferens. Keberkesanan keseluruhan proses telah disahkan pada ASR Kantonis Keputusan percubaan khusus ditunjukkan dalam jadual berikut:

<.>

<.>

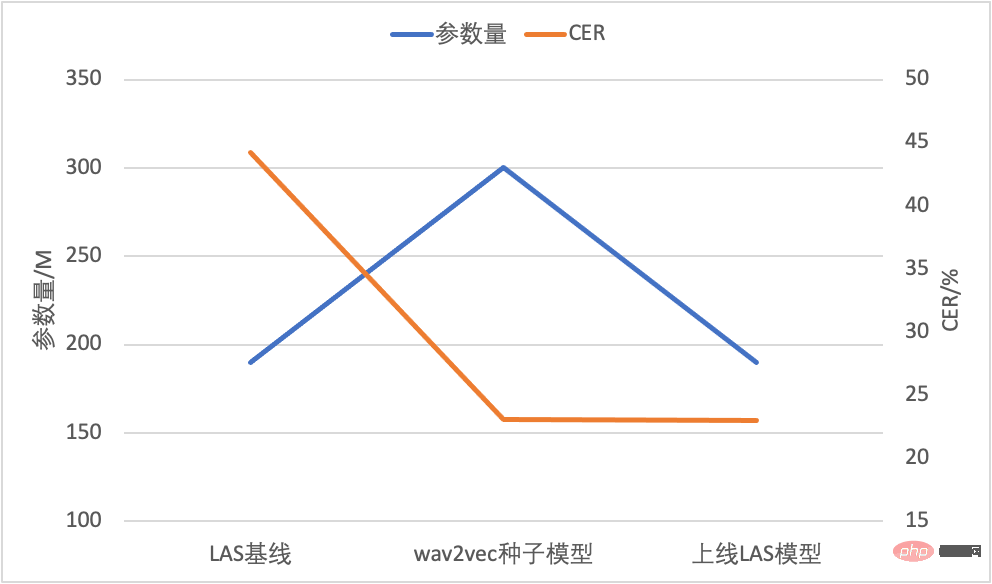

Pertama sekali, pasukan membeli 1kh data produk siap untuk perbandingan percubaan Prestasi latihan terus model LAS adalah lemah, dengan kadar ralat aksara (Kadar Ralat Aksara, CER) setinggi. 44.2%. Selepas analisis, Volcano Engine percaya bahawa sebab utama adalah ketidakpadanan antara medan data perolehan (perbualan) dan set ujian perniagaan (video) Eksperimen awal pada wav2vec2.0 juga menemui fenomena yang sama.

Berbanding dengan menggunakan data perolehan untuk pra-latihan, Enjin Volcano menggunakan data yang konsisten dengan medan sasaran untuk pra-latihan, dan CER pada set ujian perniagaan boleh dikurangkan daripada 42.0% kepada 29.4%; apabila data tidak berlabel senario perniagaan terkumpul kepada 50kh, parameter model meningkat daripada 100M kepada 300M, dan CER terus menurun kepada 23.1%.

Akhir sekali, Enjin Volcano mengesahkan kesan migrasi model dan menggabungkan model bahasa Kantonis untuk menyahkod 50kh data tidak berlabel untuk mendapatkan Label pseudo, melatih model LAS. Dapat dilihat bahawa model LAS berdasarkan latihan pseudo-label pada asasnya boleh mengekalkan kesan pengecaman model benih CTC, dan bilangan parameter model dikurangkan sebanyak satu pertiga, dan boleh digunakan secara langsung berdasarkan enjin inferens hujung ke hujung yang matang.

Perbandingan parameter model dan CER

Akhir sekali, dalam model struktur Di bawah premis bahawa bilangan parameter kekal tidak berubah, pasukan menggunakan 50kh data perniagaan tidak berlabel dan 10j data perniagaan berlabel untuk mencapai CER sebanyak 23.0%, iaitu penurunan sebanyak 48% berbanding model garis dasar. Selepas menyelesaikan masalah volum pengiraan dan keserasian dalam talian, kami menumpukan pada teknologi pra-latihan teras tanpa pengawasan dalam keseluruhan proses Untuk wav2vec2.0, Enjin Volcano melaksanakan kerja dari dua dimensi: algoritma dan kejuruteraan Dioptimumkan.

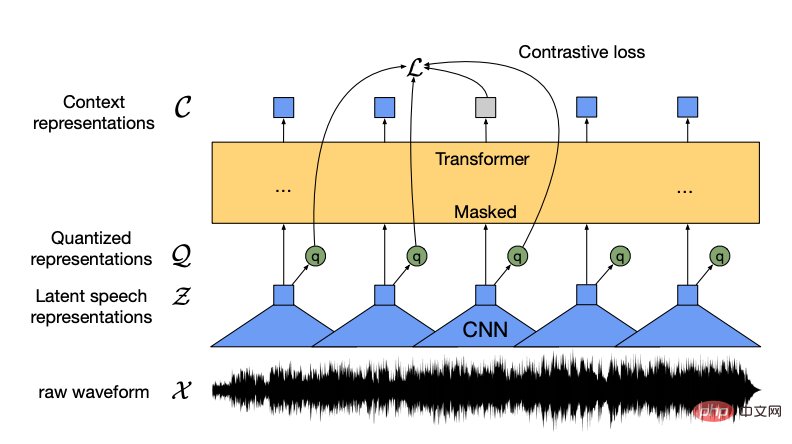

Pengoptimuman algoritmawav2vec2.0, sebagai model pra-latihan diselia sendiri yang dicadangkan oleh Meta AI pada 2020, membuka perwakilan tanpa pengawasan ucapan Satu lembaran baru dalam pembelajaran. Idea teras ialah menggunakan modul pengkuantitian untuk mendiskrisikan ciri input, dan melalui pengoptimuman pembelajaran perbandingan, badan utama model merealisasikan ciri input separa topeng rawak yang serupa dengan BERT.

Rajah skematik struktur model wav2vec2.0 (Sumber: wav2vec 2.0 Rajah 1 [1])

Terdapat dua kesukaran yang dihadapi semasa melatih model wav2vec 2.0 mengenai perniagaan Masalah data: Satu ialah kecekapan latihan adalah rendah, dan model besar 300M dengan 64 kad mengambil masa lebih daripada sepuluh hari untuk dilatih; Wav2vec yang cekap dicadangkan untuk enjin Volcano ini bagi mengurangkan dua masalah di atas.

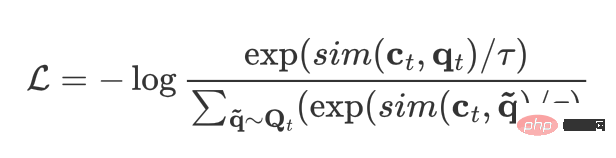

Mengenai masalah kecekapan latihan yang rendah, pasukan mempercepatkan latihan dengan mengurangkan kadar bingkai model, menggantikan ciri input daripada bentuk gelombang kepada bank penapis, dan kadar bingkai diubah daripada 20ms asal menjadi 40ms. Ini bukan sahaja mengurangkan jumlah pengiraan lilitan pengekstrakan ciri, tetapi juga mengurangkan panjang pengekodan dalaman Transformer, dengan itu meningkatkan kecekapan latihan. Untuk masalah latihan yang tidak stabil, ia diselesaikan dengan menganalisis kaedah pembelajaran pra-latihan tanpa pengawasan dan pertimbangan komprehensif digabungkan dengan situasi sebenar data perniagaan Perbandingan kerugian pembelajaran boleh dinyatakan dengan formula berikut:

Untuk setiap bingkai t, ct mewakili output pengekod bingkai, qt mewakili output terkuantisasi bingkai. Selain itu, beberapa bingkai lain perlu dijadikan sampel sebagai sampel negatif, jadi set bingkai semasa dan bingkai sampel negatif adalah bersamaan dengan senarai perkataan yang dibina secara dinamik Qt .

Matlamat pengoptimuman pembelajaran kontrastif adalah untuk memaksimumkan persamaan antara pengekodan bingkai semasa dan hasil pengkuantitian bingkai, sambil meminimumkan persamaan antara pengekodan bingkai semasa dan hasil pengkuantitian bagi bingkai lain. Tidak sukar untuk mencari bahawa persamaan antara sampel negatif dan sampel positif dan bilangan sampel negatif secara langsung menentukan kesan pembelajaran kontrastif. Dalam operasi sebenar, purata panjang data perniagaan adalah pendek, dan ia adalah jauh dari cukup untuk hanya menyediakan 50 sampel negatif dalam satu ayat. Memandangkan persamaan antara bingkai pertuturan bersebelahan adalah sangat tinggi, adalah perlu untuk memastikan kesinambungan kawasan topeng, dengan itu meningkatkan kesukaran pembinaan semula perwakilan.

Untuk menyelesaikan dua masalah di atas, Enjin Volcano telah mencadangkan dua penambahbaikan:

- Strim data sama panjang: Semasa proses pra-latihan, keseluruhan set latihan dianggap sebagai sekeping audio yang disambungkan dari awal dan akhir setiap ayat, dan setiap sampel latihan dipintas daripadanya Panjang tetap diperolehi. Ini dilakukan untuk memastikan bahawa bilangan sampel negatif adalah mencukupi dan panjang dalam rangkaian pengekodan konteks adalah konsisten pada kadar bingkai yang berbeza, dengan itu memastikan kemantapan latihan.

- Topeng berterusan penyesuaian: Untuk mengurangkan kesan hingar data pada latihan, panjang topeng yang lebih kecil dipilih Dan setiap kawasan topeng dipaksa untuk berterusan, dan panjang audio yang sepadan dengan kawasan topeng adalah bersamaan pada kadar bingkai yang berbeza. Ini bukan sahaja mengurangkan kesukaran pembelajaran perbandingan di bawah data bising, tetapi juga menyesuaikan diri dengan kadar bingkai yang berbeza.

Selepas membandingkan kesan wav2vec2.0 (w2v) dan Efficient wav2vec (w2v-e) pada data perniagaan, keputusan yang ditunjukkan dalam jadual di bawah diperolehi (semua model adalah Latihan menggunakan 64 GPU V100):

Anda boleh melihat bahawa wav2vec Efficient yang dipertingkatkan mempunyai peningkatan prestasi 5% yang stabil berbanding dengan wav2vec 2.0 asal, dan kecekapan latihan hampir dua kali ganda.

Pengoptimuman Kejuruteraan

Walaupun wav2vec Cekap yang dicadangkan oleh pasukan telah menggandakan kecekapan latihan hampir dua kali ganda daripada tahap algoritma, disebabkan volum komunikasi yang besar bagi model 300M, masih terdapat turun naik dalam latihan komunikasi dan kecekapan pengembangan berbilang mesin Rendah. Dalam hal ini, Pasukan Suara Enjin Gunung Berapi membuat kesimpulan: "Untuk meningkatkan kecekapan komunikasi model pra-latihan dalam senario kecerunan segerak, kami telah melengkapkan teknologi pengoptimuman komunikasi kumpulan Bucket pada bahagian belakang komunikasi berdasarkan rangka kerja latihan yang diedarkan BytePS, dan kecekapan selari data boleh dicapai 10% peningkatan pada masa yang sama, strategi penyusunan semula parameter adaptif (Penyusunan Semula Parameter) telah dilaksanakan untuk menangani masalah menunggu yang disebabkan oleh susunan definisi parameter model dan susunan kemas kini kecerunan yang berbeza >Berdasarkan pengoptimuman ini, penambahbaikan selanjutnya dibuat Digabungkan dengan pengumpulan kecerunan dan teknologi lain, kecekapan pengembangan satu kad model 300M meningkat daripada 55.42% kepada 81.83%, dan kecekapan pengembangan berbilang mesin meningkat daripada 60.54. % hingga 91.13%. Model yang pada asalnya mengambil masa 6.5 hari untuk dilatih kini boleh dilatih hanya dalam 4 hari , memakan masa dipendekkan sebanyak 40%.

Selain itu, untuk menyokong senario data besar model besar yang diterokai pada masa hadapan, pasukan suara Volcano Engine melengkapkan lagi siri model berskala ultra besar Pembinaan keupayaan Atom. Pertama, teknologi OSS tempatan telah dilaksanakan, yang menyelesaikan masalah kecekapan pengembangan antara mesin sambil mengalih keluar kebanyakan memori berlebihan yang diduduki oleh pengoptimum kemudiannya, baldi disokong untuk kecerunan segerak komunikasi Lazy init mengurangkan penggunaan memori video sebanyak dua kali ganda bilangan parameter, sangat mengurangkan nilai memori puncak dan menyesuaikan diri dengan senario model yang sangat besar di mana sumber memori video adalah padat akhirnya, berdasarkan selari data, selari model dan saluran paip disokong; dan dalam model 1B dan 10B Sokongan pengesahan dan penyesuaian selesai. Siri pengoptimuman ini meletakkan asas yang kukuh untuk latihan model besar dan data besar.

Pada masa ini, dengan mengguna pakai proses pelaksanaan ASR sumber rendah, dua bahasa sumber rendah telah berjaya melaksanakan sari kata video dan perkhidmatan keselamatan kandungan. Selain pengecaman pertuturan, model pra-latihan berdasarkan wav2vec2.0 juga telah mencapai keuntungan yang ketara dalam banyak tugas hiliran lain, termasuk pengesanan acara audio, pengecaman bahasa, pengesanan emosi, dsb., dan akan dilaksanakan secara beransur-ansur dalam keselamatan kandungan video , pengesyoran dan analisis pada masa hadapan , pemunggahan audio, analisis sentimen perkhidmatan pelanggan e-dagang dan perniagaan lain yang berkaitan. Pelaksanaan teknologi pra-latihan tanpa pengawasan akan mengurangkan kos pelabelan pelbagai jenis data audio dengan ketara, memendekkan kitaran pelabelan dan mencapai tindak balas pantas kepada keperluan perniagaan.

Ringkasan dan TinjauanDalam amalannya, Volcano Engine telah meneroka satu set penyelesaian pelaksanaan ASR bahasa sumber rendah berdasarkan wav2vec2.0, yang menyelesaikan masalah Ia menyelesaikan masalah overhed penaakulan yang tinggi dan mencapai sambungan lancar dengan enjin hujung ke hujung. Untuk menangani masalah teras kecekapan latihan rendah dan ketidakstabilan wav2vec2.0, wav2vec yang cekap telah dicadangkan. Berbanding dengan wav2vec2.0, kesan pada tugas hiliran dipertingkatkan sebanyak 5%, dan masa pra-latihan dipendekkan separuh Digabungkan dengan pengoptimuman kejuruteraan, masa pra-latihan akhir dikurangkan sebanyak 70% berbanding dengan versi asal. Pada masa hadapan, Enjin Gunung Berapi akan terus meneroka dalam tiga arah berikut:

- Naik taraf algoritma tanpa seliaan: Selepas wav2vec 2.0, kerja penyelidikan mengenai pra-latihan tanpa pengawasan suara telah muncul dan pasukan akan meneruskan Menyusul penyelidikan terkini dan menghayatinya ke dalam senario perniagaan. Pada peringkat ini, kami terutamanya mencuba model tanpa pengawasan seperti HuBERT[2], MAE[6] dan data2vec[7] dan meneroka aplikasi hiliran masing-masing . Pada masa hadapan, prestasi model tanpa seliaan akan dipertingkatkan daripada dua aspek: mereka bentuk penyelesaian tanpa pengawasan yang cekap dan adaptif mengikut senario perniagaan yang berbeza mereka bentuk model tanpa seliaan umum untuk meningkatkan prestasi pelbagai tugas hiliran;

- Berbilang bahasa dan berbilang modal: Pada masa ini terdapat banyak kerja-kerja penyelidikan mengenai gabungan yang tidak diawasi dan berbilang bahasa, seperti XLSR[8]. Atas dasar ini, Volcano Engine mencadangkan S3Net[9], yang berkesan mengurangkan konflik antara bahasa yang berbeza dengan membahagikan berbilang sub-rangkaian jarang dalam model pra-latihan untuk memodelkan bahasa yang berbeza gangguan (Language Interference) mempunyai kesan peningkatan prestasi yang ketara pada bahasa korpus besar. Kerja penyelidikan sedia ada tertumpu terutamanya pada bahagian pengekod audio, dan model hujung-ke-hujung arus perdana semasa semuanya menggunakan struktur penyahkod-pengekod, iaitu, pemodelan pelbagai mod teks audio. Pasukan ini menentukan bahawa pra-latihan akhir audio tulen tidak lagi dapat memenuhi keperluan model hujung ke hujung Pada masa hadapan, ia akan meneroka pra-latihan berbilang mod teks audio, termasuk pemodelan bersama bagi tidak sejajar besar-besaran. teks audio dan model hujung ke hujung dan pralatihan multimodal tanpa pengawasan tulen.

- Model besar data besar: Prestasi model sedia ada hampir tepu pada skala 100,000 jam , pasukan itu menggunakan 1 juta jam data tidak berlabel untuk melakukan latihan NST[10] berdasarkan model yang dilatih dengan 100,000 jam data berlabel Cina, dan mencapai pengurangan CER relatif 7% pada set ujian am. Pada masa yang sama, model Keupayaan generalisasi telah dipertingkatkan dengan ketara, dan purata CER pada set ujian 20 domain telah menurun sebanyak 15%. Untuk menyerap sepenuhnya data berjuta-juta jam yang besar, model yang lebih besar diperlukan Pada masa ini, Enjin Volcano telah membuat kemajuan awal pada model dengan parameter 1B. Had prestasi model besar adalah tinggi, dan masalah yang datang dengannya ialah ia sukar untuk dilaksanakan. Untuk melaksanakan model besar ke dalam perniagaan sebenar, pelbagai kaedah pemampatan model akan dicuba pada masa hadapan, seperti penguraian matriks, pemotongan berat, penyulingan pengetahuan, dan lain-lain, untuk mencapai kesan pemampatan tanpa kerugian sebanyak mungkin.

Volcano Voice, teknologi suara termaju yang telah lama berkhidmat kepada pelbagai barisan perniagaan ByteDance dibuka melalui enjin Volcano, menyediakan keupayaan teknologi suara AI yang terkemuka dalam industri dan penuh cemerlang. -produk suara timbunan Penyelesaian termasuk pemahaman audio, sintesis audio, manusia digital maya, interaksi perbualan, pengambilan muzik, perkakasan pintar, dsb. Pada masa ini, pengecaman pertuturan dan sintesis pertuturan Volcano Engine merangkumi pelbagai bahasa dan dialek telah dipilih ke dalam pelbagai persidangan AI terkemuka, menyediakan keupayaan suara terkemuka untuk Douyin, Jianying, Feishu, Novel Tomato, Pico dan perniagaan lain sesuai untuk pelbagai senario seperti video pendek, siaran langsung, penciptaan video, pejabat dan peranti boleh pakai.

Rujukan

[1] Baevski, A., Zhou, Y., Mohamed, A. and Auli, M . , 2020. wav2vec 2.0: Rangka kerja untuk pembelajaran penyeliaan sendiri bagi perwakilan pertuturan Kemajuan dalam Sistem Pemprosesan Maklumat Neural, 33, ms.12449-12460.

. [2] Hsu, W.N., Bolte, B., Tsai, Y.H.H., Lakhotia, K., Salakhutdinov, R. dan Mohamed, A., 2021. Hubert: Pembelajaran perwakilan pertuturan diselia sendiri oleh ramalan bertopeng IEEE /. Transaksi ACM pada Pemprosesan Audio, Pertuturan dan Bahasa, 29, ms.3451-3460.

[3] Graves, A., Fernández, S. , Gomez, F. dan Schmidhuber, J., 2006, klasifikasi temporal Connectionist: melabelkan data jujukan tidak bersegmen dengan rangkaian saraf berulang Dalam Prosiding persidangan antarabangsa ke-23 tentang Pembelajaran Mesin (ms. 369-376).

[4] Chan, W., Jaitly, N., Le, Q. dan Vinyals, O., 2016, Mac Dengar, hadir dan eja: Rangkaian saraf untuk pengecaman pertuturan perbendaharaan kata yang besar Pada persidangan antarabangsa IEEE pada akustik, pertuturan dan pemprosesan isyarat (ICASSP) (ms. 4960-4964.).

[5] Graves, A., 2012. Transduksi jujukan dengan rangkaian saraf berulang. pracetak arXiv arXiv:1211.3711.

[6] He, K., Chen, X., Xie, S., Li, Y., Dollár, P . dan Girshick, R., 2022. Pengekod auto bertopeng ialah pelajar penglihatan berskala. Dalam Prosiding Persidangan IEEE/CVF mengenai Penglihatan Komputer dan Pengecaman Corak (ms. 16000-16009).

[7] Baevski, A., Hsu, W.N., Xu, Q., Babu, A., Gu, J. and Auli, M., 2022. Data2vec: Rangka kerja umum untuk pembelajaran penyeliaan kendiri dalam pertuturan, penglihatan dan bahasa. pracetak arXiv arXiv:2202.03555.

[8] Conneau, A., Baevski, A., Collobert, R., Mohamed, A. dan Auli, M ., 2020. Pembelajaran perwakilan silang bahasa tanpa pengawasan untuk pengecaman pertuturan. pracetak arXiv arXiv:2006.13979.

[9] Lu, Y., Huang, M., Qu, X., Wei, P. dan Ma, Z ., 2022, Mei. Pembelajaran perwakilan pertuturan silang bahasa adaptif bahasa dengan perkongsian sub-rangkaian yang jarang. Dalam ICASSP 2022-2022 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP) (ms. 6882-6886). IEEE.

[10] Park, D.S., Zhang, Y., Jia, Y., Han, W., Chiu, C.C., Li, B. , Wu, Y. dan Le, Q.V., 2020. Latihan pelajar bising yang dipertingkatkan untuk pengecaman pertuturan automatik. pracetak arXiv arXiv:2005.09629.

Atas ialah kandungan terperinci Penerokaan mendalam tentang pelaksanaan teknologi pra-latihan tanpa pengawasan dan 'pengoptimuman algoritma + inovasi kejuruteraan' Huoshan Voice. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1378

1378

52

52

Model besar Bytedance Beanbao dikeluarkan, perkhidmatan AI tindanan penuh Volcano Engine membantu perusahaan mengubah dengan bijak

Jun 05, 2024 pm 07:59 PM

Model besar Bytedance Beanbao dikeluarkan, perkhidmatan AI tindanan penuh Volcano Engine membantu perusahaan mengubah dengan bijak

Jun 05, 2024 pm 07:59 PM

Tan Dai, Presiden Volcano Engine, berkata syarikat yang ingin melaksanakan model besar dengan baik menghadapi tiga cabaran utama: kesan model, kos inferens dan kesukaran pelaksanaan: mereka mesti mempunyai sokongan model besar asas yang baik untuk menyelesaikan masalah yang kompleks, dan mereka juga mesti mempunyai inferens kos rendah. Perkhidmatan membolehkan model besar digunakan secara meluas, dan lebih banyak alat, platform dan aplikasi diperlukan untuk membantu syarikat melaksanakan senario. ——Tan Dai, Presiden Huoshan Engine 01. Model pundi kacang besar membuat kemunculan sulungnya dan banyak digunakan Menggilap kesan model adalah cabaran paling kritikal untuk pelaksanaan AI. Tan Dai menegaskan bahawa hanya melalui penggunaan meluas model yang baik boleh digilap. Pada masa ini, model Doubao memproses 120 bilion token teks dan menjana 30 juta imej setiap hari. Untuk membantu perusahaan melaksanakan senario model berskala besar, model berskala besar beanbao yang dibangunkan secara bebas oleh ByteDance akan dilancarkan melalui gunung berapi

Kesan pemasaran telah banyak dipertingkatkan, ini adalah cara penciptaan video AIGC harus digunakan

Jun 25, 2024 am 12:01 AM

Kesan pemasaran telah banyak dipertingkatkan, ini adalah cara penciptaan video AIGC harus digunakan

Jun 25, 2024 am 12:01 AM

Selepas lebih setahun pembangunan, AIGC telah beransur-ansur beralih daripada dialog teks dan penjanaan gambar kepada penjanaan video. Mengimbas kembali empat bulan lalu, kelahiran Sora menyebabkan rombakan dalam trek penjanaan video dan menggalakkan skop dan kedalaman aplikasi AIGC dalam bidang penciptaan video. Dalam era apabila semua orang bercakap tentang model besar, di satu pihak kita terkejut dengan kejutan visual yang dibawa oleh penjanaan video, sebaliknya kita berhadapan dengan kesukaran pelaksanaan. Memang benar bahawa model besar masih dalam tempoh berjalan dari penyelidikan dan pembangunan teknologi kepada amalan aplikasi, dan mereka masih perlu ditala berdasarkan senario perniagaan sebenar, tetapi jarak antara ideal dan realiti semakin disempitkan secara beransur-ansur. Pemasaran, sebagai senario pelaksanaan penting untuk teknologi kecerdasan buatan, telah menjadi hala tuju yang banyak syarikat dan pengamal ingin membuat penemuan. Sebaik sahaja anda menguasai kaedah yang sesuai, proses kreatif video pemasaran akan menjadi

Kekuatan teknikal Huoshan Voice TTS telah diperakui oleh Pusat Pemeriksaan dan Kuarantin Kebangsaan, dengan skor MOS setinggi 4.64

Apr 12, 2023 am 10:40 AM

Kekuatan teknikal Huoshan Voice TTS telah diperakui oleh Pusat Pemeriksaan dan Kuarantin Kebangsaan, dengan skor MOS setinggi 4.64

Apr 12, 2023 am 10:40 AM

Baru-baru ini, produk sintesis pertuturan Enjin Gunung Berapi telah memperoleh sijil pemeriksaan dan ujian yang dipertingkatkan sintesis pertuturan yang dikeluarkan oleh Pusat Pemeriksaan dan Pengujian Kualiti Produk Ucapan dan Pengiktirafan Imej (selepas ini dirujuk sebagai "Pusat Pemeriksaan Kebangsaan AI"). keperluan asas dan keperluan lanjutan sintesis pertuturan Piawaian peringkat tertinggi Pusat Pemeriksaan Nasional AI. Penilaian ini dijalankan daripada dimensi Cina Mandarin, berbilang dialek, berbilang bahasa, bahasa campuran, berbilang timbra dan pemperibadian Pasukan sokongan teknikal produk, Pasukan Suara Gunung Berapi, menyediakan perpustakaan bunyi yang kaya Skor MOS timbre adalah yang tertinggi Ia mencapai 4.64 mata, iaitu pada tahap terkemuka dalam industri. Sebagai agensi pemeriksaan dan ujian kualiti negara yang pertama dan satu-satunya untuk produk suara dan imej dalam bidang kecerdasan buatan dalam sistem pemeriksaan kualiti negara saya, Pusat Pemeriksaan Kebangsaan AI telah komited untuk mempromosikan kecerdasan buatan.

Memfokuskan pada pengalaman yang diperibadikan, mengekalkan pengguna bergantung sepenuhnya pada AIGC?

Jul 15, 2024 pm 06:48 PM

Memfokuskan pada pengalaman yang diperibadikan, mengekalkan pengguna bergantung sepenuhnya pada AIGC?

Jul 15, 2024 pm 06:48 PM

1. Sebelum membeli sesuatu produk, pengguna akan mencari dan melayari ulasan produk di media sosial. Oleh itu, menjadi semakin penting bagi syarikat untuk memasarkan produk mereka di platform sosial. Tujuan pemasaran adalah untuk: Menggalakkan penjualan produk Mewujudkan imej jenama Meningkatkan kesedaran jenama Menarik dan mengekalkan pelanggan Akhirnya meningkatkan keuntungan syarikat Model besar mempunyai pemahaman dan keupayaan penjanaan yang sangat baik dan boleh menyediakan pengguna dengan maklumat peribadi dengan menyemak imbas dan menganalisis cadangan kandungan data pengguna. Dalam isu keempat "AIGC Experience School", dua tetamu akan membincangkan secara mendalam peranan teknologi AIGC dalam meningkatkan "kadar penukaran pemasaran". Masa siaran langsung: 10 Julai, 19:00-19:45 Topik siaran langsung: Untuk mengekalkan pengguna, bagaimana AIGC meningkatkan kadar penukaran melalui pemperibadian? Episod keempat program itu mengundang dua orang penting

Penerokaan mendalam tentang pelaksanaan teknologi pra-latihan tanpa pengawasan dan 'pengoptimuman algoritma + inovasi kejuruteraan' Huoshan Voice

Apr 08, 2023 pm 12:44 PM

Penerokaan mendalam tentang pelaksanaan teknologi pra-latihan tanpa pengawasan dan 'pengoptimuman algoritma + inovasi kejuruteraan' Huoshan Voice

Apr 08, 2023 pm 12:44 PM

Untuk sekian lama, Volcano Engine telah menyediakan penyelesaian sari kata video pintar berdasarkan teknologi pengecaman pertuturan untuk platform video popular. Ringkasnya, ia adalah fungsi yang menggunakan teknologi AI untuk menukar secara automatik suara dan lirik dalam video kepada teks untuk membantu dalam penciptaan video. Walau bagaimanapun, dengan pertumbuhan pesat pengguna platform dan keperluan untuk jenis bahasa yang lebih kaya dan lebih pelbagai, teknologi pembelajaran diselia yang digunakan secara tradisional telah mencapai kesesakan, yang telah meletakkan pasukan dalam masalah sebenar. Seperti yang kita sedia maklum, pembelajaran diselia tradisional akan sangat bergantung pada data seliaan beranotasi secara manual, terutamanya dari segi pengoptimuman berterusan bahasa besar dan permulaan bahasa kecil yang sejuk. Mengambil bahasa utama seperti bahasa Cina, Mandarin dan Inggeris sebagai contoh, walaupun platform video menyediakan data suara yang mencukupi untuk senario perniagaan, selepas data yang diselia mencapai skala tertentu, ia akan terus

Semua Douyin bercakap dialek asli, dua teknologi utama membantu anda 'memahami' dialek tempatan

Oct 12, 2023 pm 08:13 PM

Semua Douyin bercakap dialek asli, dua teknologi utama membantu anda 'memahami' dialek tempatan

Oct 12, 2023 pm 08:13 PM

Semasa Hari Kebangsaan, kempen "Kata dialek membuktikan bahawa anda berasal dari kampung halaman" Douyin telah menarik penyertaan yang bersemangat daripada netizen dari seluruh negara. "Anugerah Dialek Tempatan" ini dengan cepat menjadi popular di Internet, yang tidak dapat dipisahkan daripada sumbangan fungsi terjemahan automatik dialek tempatan Douyin yang baru dilancarkan. Apabila pencipta merakam video pendek dalam dialek ibunda mereka, mereka menggunakan fungsi "sari kata automatik" dan memilih "Tukar kepada sari kata Mandarin", supaya pertuturan dialek dalam video boleh dikenali secara automatik dan kandungan dialek boleh ditukar menjadi sari kata Mandarin. Ini membolehkan netizen dari wilayah lain memahami pelbagai bahasa "Mandarin yang disulitkan". Netizen dari Fujian sendiri mengujinya dan mengatakan bahawa wilayah selatan Fujian dengan "sebutan yang berbeza" adalah wilayah di Wilayah Fujian, China.

Pertandingan inovasi ekologi 'Health + AI' anjuran bersama Volcano Engine dan Yili berakhir dengan jayanya

Jan 13, 2024 am 11:57 AM

Pertandingan inovasi ekologi 'Health + AI' anjuran bersama Volcano Engine dan Yili berakhir dengan jayanya

Jan 13, 2024 am 11:57 AM

Kesihatan + AI =? Penyelesaian pemakanan kesihatan otak untuk orang pertengahan umur dan warga tua, pemakanan pintar digital dan perkhidmatan kesihatan, penyelesaian komuniti kesihatan besar AIGC... Dengan berlangsungnya pertandingan inovasi ekologi "Kesihatan + AI", setiap satu daripadanya mengandungi tenaga teknologi dan memperkasakan industri kesihatan Penyelesaian inovatif akan keluar, dan jawapan kepada "Kesihatan + AI = perlahan-lahan muncul. Pada 26 Disember, pertandingan inovasi ekologi "Health + AI" yang ditaja bersama oleh Yili Group dan Volcano Engine mencapai keputusan yang berjaya Enam syarikat pemenang, termasuk Shanghai Bosten Network Technology Co., Ltd. dan Institut Penyelidikan Teknologi Pengkomputeran Pintar Zhongke Suzhou, terserlah. Dalam pertandingan yang berlangsung selama lebih sebulan, Yili berganding bahu dengan perusahaan saintifik dan teknologi yang cemerlang untuk meneroka integrasi mendalam teknologi AI dan industri kesihatan, terus meningkatkan jangkaan untuk pertandingan itu. Pertandingan Inovasi Ekologi "Kesihatan + AI".

Perjalanan tanpa halangan adalah lebih selamat! Hasil penyelidikan ByteDance memenangi kejohanan pertandingan CVPR2022 AVA

Apr 08, 2023 pm 11:01 PM

Perjalanan tanpa halangan adalah lebih selamat! Hasil penyelidikan ByteDance memenangi kejohanan pertandingan CVPR2022 AVA

Apr 08, 2023 pm 11:01 PM

Baru-baru ini, keputusan pelbagai pertandingan CVPR2022 telah diumumkan platform AI ciptaan pintar ByteDance "Byte-IC-AutoML" memenangi Cabaran Kebolehcapaian Visi dan Autonomi (selepas ini dirujuk sebagai AVA) berdasarkan data sintetik, bergantung kepada yang dibangunkan sendiri. Rangka kerja Parallel Pra-trained Transformers (PPT) menonjol sebagai pemenang satu-satunya trek dalam pertandingan itu. Alamat kertas: https://arxiv.org/abs/2206.10845 Pertandingan AVA ini ditaja oleh Universiti Boston (Bos