Peranti teknologi

Peranti teknologi

AI

AI

Buang 'clickbait', satu lagi karya sumber terbuka daripada pasukan Tsinghua!

Buang 'clickbait', satu lagi karya sumber terbuka daripada pasukan Tsinghua!

Buang 'clickbait', satu lagi karya sumber terbuka daripada pasukan Tsinghua!

Sebagai seseorang yang menghadapi masalah menamakan, apa yang paling merisaukan saya tentang menulis esei di sekolah menengah ialah saya boleh menulis artikel yang bagus tetapi tidak tahu apa tajuknya Selepas saya mula membuat akaun awam, saya kalah banyak rambut setiap kali saya memikirkan tajuk.. ....

Baru-baru ini, saya akhirnya menemui cahaya "Name Waste" di GitHub, aplikasi menarik berskala besar dilancarkan oleh Universiti Tsinghua dan komuniti sumber terbuka OpenBMB: "Outsmart" "Tajuk", masukkan kandungan teks dan anda boleh menjana tajuk hangat dengan satu klik!

Ia berfungsi di luar kotak selepas mencubanya, apa yang boleh saya katakan ialah: baunya hebat!

Pengalaman dalam talian: https://live.openbmb.org/ant

GitHub: https://github.com/OpenBMB/CPM-Live

Mengenai artifak membuat tajuk ini, kita perlu bercakap tentangnya dahulu Mari kita bercakap tentang "ontologi" - model besar CPM-Ant.

CPM-Ant ialah model berpuluh bilion pertama di China yang dilatih secara langsung Latihan ini mengambil masa 68 hari dan telah selesai pada 5 Ogos 2022, dan dikeluarkan secara rasmi oleh OpenBMB!

- Lima Ciri Cemerlang

- Empat Terobosan Inovasi

- Proses latihan adalah kos rendah dan mesra alam!

- Perkara yang paling penting ialah - sumber terbuka sepenuhnya!

Sebagai model besar Cina latihan langsung yang pertama, CPM-Ant menyediakan penyelesaian yang boleh dilaksanakan dalam latihan model besar, penalaan halus, pemampatan, inferens, aplikasi dan lain-lain Pelan amali ini berharap dapat memberikan bantuan dan rujukan yang berbeza untuk pengikut yang berbeza.

Sekarang, mari kita lihat laporan kandungan hasil keluaran CPM-Ant!

Gambaran Keseluruhan Model

CPM-Ant ialah model bahasa pra-latihan Cina sumber terbuka dengan parameter 10B Ia juga merupakan pencapaian pertama dalam proses latihan langsung CPM-Live.

Keseluruhan proses latihan adalah kos rendah dan mesra alam Ia tidak memerlukan keperluan perkakasan yang tinggi dan kos operasi Ia berdasarkan kaedah penalaan delta dan telah mencapai keputusan yang cemerlang dalam penanda aras CUGE ujian.

Kod berkaitan CPM-Ant, fail log dan parameter model adalah sumber terbuka sepenuhnya di bawah perjanjian lesen terbuka. Sebagai tambahan kepada model penuh, OpenBMB juga menyediakan pelbagai versi termampat untuk disesuaikan dengan konfigurasi perkakasan yang berbeza.

Lima ciri cemerlang CPM-Ant:

(1) Kecekapan pengiraan

Dengan kit alat BMTrain[1], anda boleh menggunakan sepenuhnya keupayaan sumber pengkomputeran yang diedarkan untuk melatih model besar dengan cekap.

Latihan CPM-Ant berlangsung selama 68 hari dan menelan belanja 430,000 yuan, iaitu 1/20 daripada kira-kira AS$1.3 juta kos latihan model T5-11B oleh Google. Pelepasan gas rumah hijau latihan CPM-Ant adalah kira-kira 4872kg CO₂e, manakala pelepasan latihan T5-11B ialah 46.7t CO₂e[9].

(2) Prestasi cemerlang

Dengan alat OpenDelta[3], ia sangat mudah untuk melakukan incremental penalaan halus Sesuaikan CPM-Ant kepada tugas hiliran.

Percubaan menunjukkan bahawa CPM-Ant mencapai hasil terbaik pada 3/6 tugasan CUGE dengan hanya memperhalusi parameter 6.3M. Hasil ini mengatasi model lain yang diperhalusi sepenuhnya. Contohnya: bilangan parameter diperhalusi CPM-Ant hanyalah 0.06% daripada CPM2 (parameter 11B yang diperhalusi).

(3) Ekonomi penggunaan

Dengan bantuan kit alat BMCook[7] dan BInf[4], adalah mungkin untuk Memacu CPM-Ant di bawah sumber pengkomputeran terhad.

Berdasarkan BInf, ia boleh menggantikan kluster pengkomputeran untuk melaksanakan inferens model besar pada satu GPU (walaupun kad grafik gred pengguna seperti GTX 1060). Untuk menjadikan penggunaan CPM-Ant lebih menjimatkan, OpenBMB menggunakan BMCook untuk memampatkan lagi model 10B asal ke dalam versi yang berbeza. Model termampat (7B, 3B, 1B, 300M) boleh menyesuaikan diri dengan keperluan senario sumber rendah yang berbeza.

(4) Mudah digunakan

Sama ada model 10B asal atau versi termampat yang berkaitan, melalui beberapa baris kod Ia boleh dimuatkan dan dijalankan dengan mudah.

OpenBMB juga akan menambahkan CPM-Ant pada ModelCenter[8], menjadikan pembangunan model selanjutnya lebih mudah.

(5) Demokrasi Terbuka

Proses latihan CPM-Ant terbuka sepenuhnya.

OpenBMB menerbitkan semua kod, fail log dan arkib model sebagai akses terbuka. CPM-Ant juga mengguna pakai lesen terbuka yang membenarkan pengkomersilan.

Amalan latihan model besar yang lengkap

Untuk pengilang dan institusi penyelidikan yang mampu melakukan latihan model besar, proses latihan CPM-Ant menyediakan rekod Praktikal lengkap model besar Cina latihan.

OpenBMB mengeluarkan reka bentuk model, skema latihan, keperluan data dan kod pelaksanaan model siri CPM-Live. Berdasarkan seni bina model CPM-Live, adalah mungkin untuk mereka bentuk dan melaksanakan program latihan model besar dengan cepat dan mudah serta mengatur data perniagaan yang berkaitan untuk melengkapkan pra-penyelidikan model dan penyediaan data.

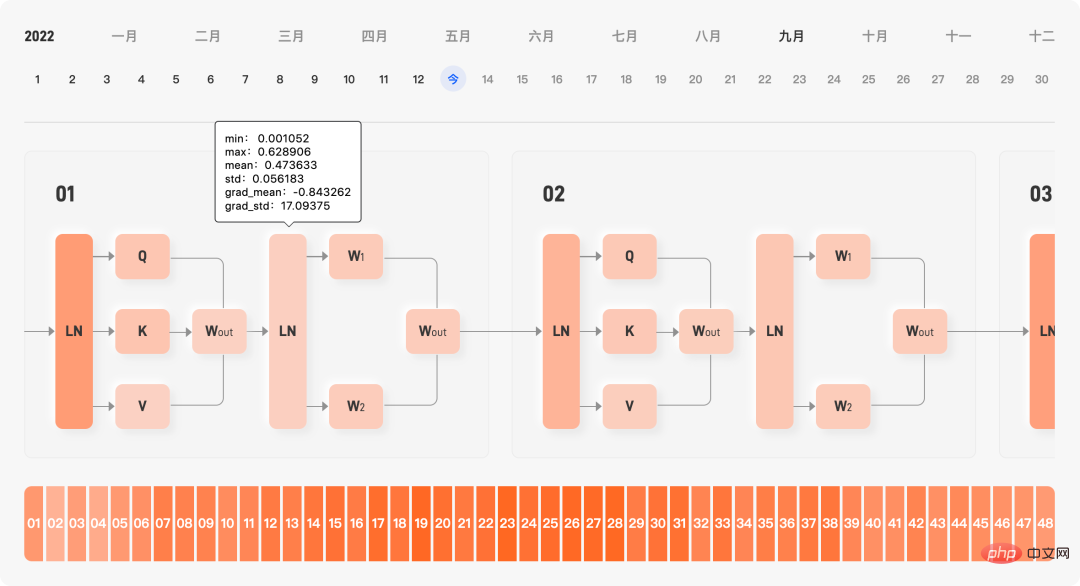

Tapak web rasmi merekodkan semua dinamik latihan semasa proses latihan, termasuk fungsi kehilangan, kadar pembelajaran, data yang dipelajari, daya pemprosesan, saiz kecerunan, keluk kos dan parameter dalaman model Min dan sisihan piawai dipaparkan dalam masa nyata Melalui dinamik latihan ini, pengguna boleh mendiagnosis dengan cepat sama ada terdapat masalah dalam proses latihan model.

Paparan masa nyata parameter dalaman latihan model

Selain itu, pelajar R&D OpenBMB mengemas kini ringkasan rekod latihan dalam masa nyata setiap hari Ringkasan termasuk nilai kehilangan, nilai kecerunan dan kemajuan keseluruhan Ia juga merekodkan beberapa masalah yang dihadapi dan pepijat semasa proses latihan, jadi bahawa pengguna boleh memahami proses latihan model terlebih dahulu pelbagai "pit" yang mungkin dihadapi.

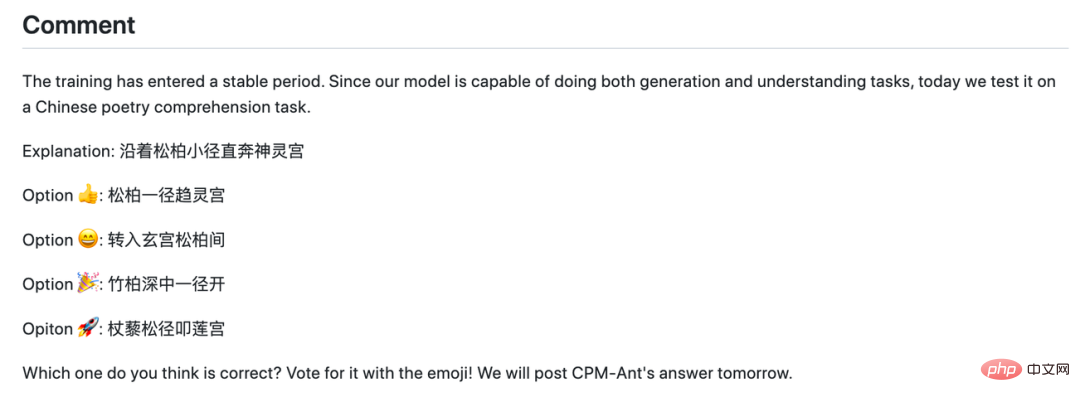

Pada hari ketika latihan model "tenang", lelaki R&D itu juga akan mengeluarkan beberapa petikan terkenal, memperkenalkan beberapa kertas kerja terkini, dan juga melancarkan kuiz.

Aktiviti meneka dalam log

Selain itu, OpenBMB juga menyediakan penyelesaian latihan kos efektif Bagi perusahaan yang sebenarnya mempunyai keperluan latihan model yang besar, melalui teknologi pecutan latihan yang berkaitan, kos latihan telah dikurangkan ke tahap yang boleh diterima.

Menggunakan kit alat BMTrain[1], kos pengiraan untuk melatih berpuluh bilion model besar CPM-Ant hanyalah 430,000 yuan (kos semasa dikira berdasarkan harga awan awam , kos sebenar akan lebih rendah ), iaitu kira-kira 1/20 daripada anggaran luaran kos model besar 11B T5 sebanyak AS$1.3 juta!

Penyelesaian penalaan halus yang cekap yang telah berulang kali mencipta SOTA

Bagaimanakah CPM-Ant membantu kami menyesuaikan tugas hiliran?

Untuk penyelidik model besar, OpenBMB menyediakan penyelesaian penilaian prestasi model besar berdasarkan penalaan halus parameter yang cekap, yang memudahkan penyesuaian tugas hiliran pantas dan penilaian prestasi model.

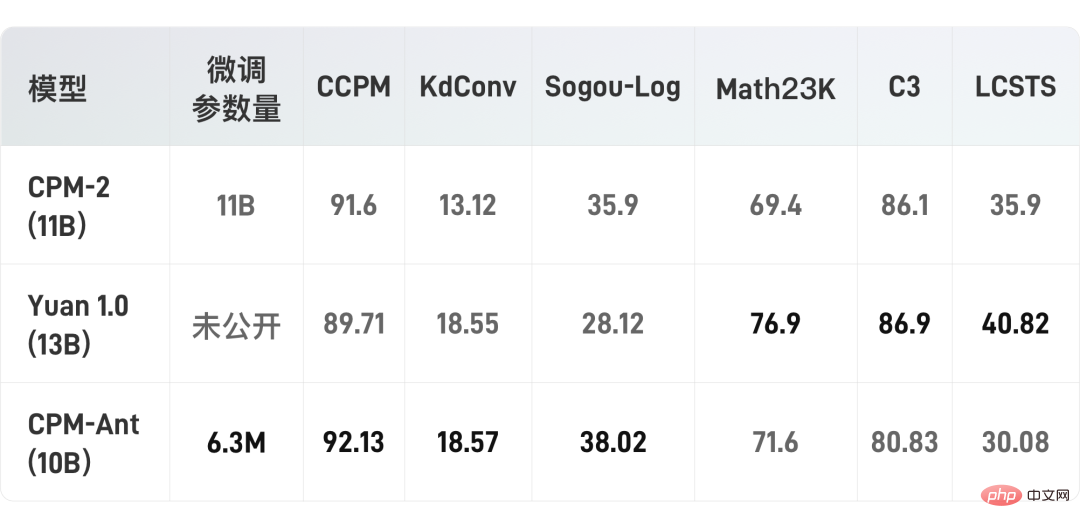

Gunakan penalaan yang cekap parameter, yang dikenali sebagai penalaan delta, untuk menilai prestasi CPM-Ant pada enam tugasan hiliran. LoRA [2] digunakan dalam eksperimen, yang memasukkan dua matriks peringkat rendah boleh laras dalam setiap lapisan perhatian dan membekukan semua parameter model asal. Dengan menggunakan pendekatan ini, hanya 6.3M parameter diperhalusi setiap tugas, menyumbang hanya 0.067% daripada jumlah parameter.

Dengan bantuan OpenDelta[3], OpenBMB menjalankan semua percubaan tanpa mengubah suai kod model asal. Perlu diingat bahawa tiada kaedah penambahan data digunakan semasa menilai model CPM-Ant pada tugas hiliran. Keputusan percubaan ditunjukkan dalam jadual berikut:

Dapat dilihat bahawa dengan hanya memperhalusi beberapa parameter, model OpenBMB menunjukkan prestasi yang baik. pada tiga set data Prestasi telah melebihi CPM-2 dan Sumber 1.0.

Sesetengah tugasan (seperti LCSTS) mungkin sukar dipelajari apabila terdapat sangat sedikit parameter yang diperhalusi Proses latihan CPM-Live akan diteruskan dan prestasi pada setiap tugas juga akan terjejas lagi.

Pelajar yang berminat boleh melawati pautan GitHub di bawah untuk merasai pengalaman CPM-Ant dan OpenDelta terlebih dahulu, dan seterusnya meneroka keupayaan CPM-Ant pada tugasan lain!

https://github.com/OpenBMB/CPM-Live

Siri inferens mesra perkakasan kaedah

Prestasi model besar adalah menakjubkan, tetapi keperluan perkakasan yang tinggi dan kos operasi sentiasa menyusahkan ramai pengguna. Untuk pengguna model besar, OpenBMB menyediakan satu siri kaedah penggunaan mesra perkakasan, yang boleh menjalankan versi model yang berbeza dengan lebih mudah dalam persekitaran perkakasan yang berbeza.

Menggunakan kit alat BInf[4], CPM-Ant boleh dijalankan dalam persekitaran sumber yang rendah seperti satu kad 1060!

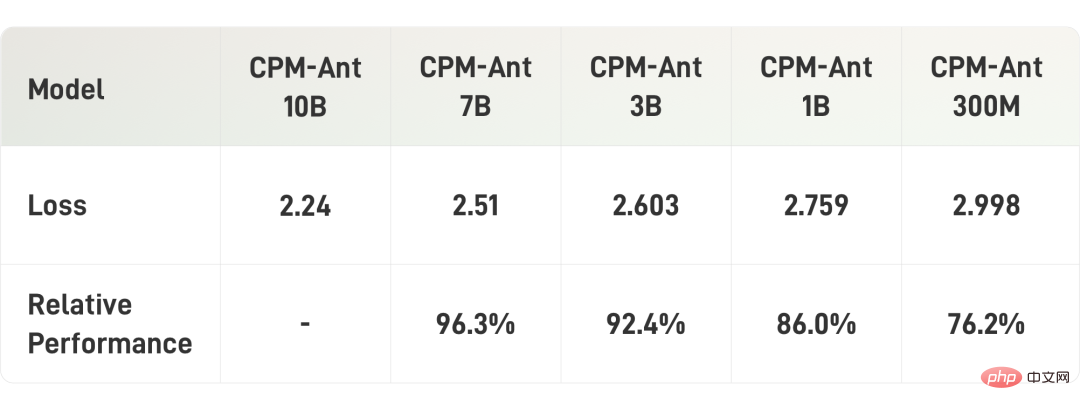

Selain itu, OpenBMB juga memampatkan CPM-Ant. Model mampat ini termasuk CPM-Ant-7B/3B/1B/0.3B. Kesemua saiz mampatan model ini boleh sepadan dengan saiz klasik model bahasa pra-latihan sumber terbuka sedia ada.

Memandangkan pengguna mungkin menjalankan pembangunan selanjutnya pada pusat pemeriksaan yang dikeluarkan, OpenBMB terutamanya menggunakan pemangkasan berstruktur bebas tugas untuk memampatkan CPM-Ant. Proses pemangkasan juga dilakukan secara beransur-ansur, iaitu dari 10B ke 7B, dari 7B ke 3B, dari 3B ke 1B, dan akhirnya dari 1B ke 0.3B.

Semasa proses pemangkasan khusus, OpenBMB akan melatih matriks topeng boleh dipelajari dinamik, dan kemudian menggunakan matriks topeng ini untuk memangkas parameter yang sepadan. Akhirnya, parameter dipangkas mengikut ambang matriks topeng, yang ditentukan berdasarkan sparsity sasaran. Untuk butiran lanjut mampatan, sila rujuk blog teknikal [5].

Jadual berikut menunjukkan keputusan pemampatan model:

Sekarang kandungan tegar sudah tamat , kemudian Bagaimanakah model besar boleh membantu kami "memilih tajuk"?

Aplikasi model besar yang menarik tanpa diduga

Berdasarkan CPM-Ant, semua pembangun dan peminat model besar boleh membangunkannya Aplikasi menyeronokkan teks yang menarik.

Untuk mengesahkan lagi keberkesanan model dan memberikan contoh, OpenBMB memperhalusi penjana tajuk hangat berdasarkan CPM-Ant untuk menunjukkan keupayaan model.

Anda hanya perlu menampal kandungan teks ke dalam kotak teks di bawah, klik untuk menjananya dan anda boleh mendapatkan tajuk menarik yang disediakan oleh model besar!

Tajuk artikel pertama laporan hasil CPM-Ant dijana oleh penjana

Demo ini akan terus digilap dan lebih banyak kesan khas akan ditambah pada masa hadapan untuk meningkatkan pengalaman pengguna

Pengguna yang berminat juga boleh menggunakan CPM-Ant untuk membina sendiri aplikasi paparan. Jika anda mempunyai sebarang idea aplikasi, memerlukan sokongan teknikal atau menghadapi sebarang masalah semasa menggunakan demo, anda boleh memulakan perbincangan di forum CPM-Live [6] pada bila-bila masa!

Pengeluaran CPM-Ant ialah pencapaian pertama CPM-Live, tetapi ia hanya fasa pertama latihan OpenBMB akan terus menjalankan satu siri latihan pada masa hadapan.

Perihal ringkas, sesi latihan seterusnya akan menambah ciri baharu seperti sokongan berbilang bahasa, input dan output berstruktur, dsb. Selamat datang semua untuk terus memberi perhatian!

Portal|Pautan projek

Alamat GitHub Projek:

https://github.com/OpenBMB/CPM - Langsung

Alamat pengalaman demo (akses PC sahaja):

https://live.openbmb.org/ant

Atas ialah kandungan terperinci Buang 'clickbait', satu lagi karya sumber terbuka daripada pasukan Tsinghua!. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

Apr 09, 2024 am 11:52 AM

Apr 09, 2024 am 11:52 AM

AI memang mengubah matematik. Baru-baru ini, Tao Zhexuan, yang telah mengambil perhatian terhadap isu ini, telah memajukan keluaran terbaru "Buletin Persatuan Matematik Amerika" (Buletin Persatuan Matematik Amerika). Memfokuskan pada topik "Adakah mesin akan mengubah matematik?", ramai ahli matematik menyatakan pendapat mereka Seluruh proses itu penuh dengan percikan api, tegar dan menarik. Penulis mempunyai barisan yang kuat, termasuk pemenang Fields Medal Akshay Venkatesh, ahli matematik China Zheng Lejun, saintis komputer NYU Ernest Davis dan ramai lagi sarjana terkenal dalam industri. Dunia AI telah berubah secara mendadak Anda tahu, banyak artikel ini telah dihantar setahun yang lalu.

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Google gembira: prestasi JAX mengatasi Pytorch dan TensorFlow! Ia mungkin menjadi pilihan terpantas untuk latihan inferens GPU

Apr 01, 2024 pm 07:46 PM

Google gembira: prestasi JAX mengatasi Pytorch dan TensorFlow! Ia mungkin menjadi pilihan terpantas untuk latihan inferens GPU

Apr 01, 2024 pm 07:46 PM

Prestasi JAX, yang dipromosikan oleh Google, telah mengatasi Pytorch dan TensorFlow dalam ujian penanda aras baru-baru ini, menduduki tempat pertama dalam 7 penunjuk. Dan ujian tidak dilakukan pada TPU dengan prestasi JAX terbaik. Walaupun dalam kalangan pembangun, Pytorch masih lebih popular daripada Tensorflow. Tetapi pada masa hadapan, mungkin lebih banyak model besar akan dilatih dan dijalankan berdasarkan platform JAX. Model Baru-baru ini, pasukan Keras menanda aras tiga hujung belakang (TensorFlow, JAX, PyTorch) dengan pelaksanaan PyTorch asli dan Keras2 dengan TensorFlow. Pertama, mereka memilih satu set arus perdana

Disyorkan: Projek pengesanan dan pengecaman muka sumber terbuka JS yang sangat baik

Apr 03, 2024 am 11:55 AM

Disyorkan: Projek pengesanan dan pengecaman muka sumber terbuka JS yang sangat baik

Apr 03, 2024 am 11:55 AM

Teknologi pengesanan dan pengecaman muka adalah teknologi yang agak matang dan digunakan secara meluas. Pada masa ini, bahasa aplikasi Internet yang paling banyak digunakan ialah JS Melaksanakan pengesanan muka dan pengecaman pada bahagian hadapan Web mempunyai kelebihan dan kekurangan berbanding dengan pengecaman muka bahagian belakang. Kelebihan termasuk mengurangkan interaksi rangkaian dan pengecaman masa nyata, yang sangat memendekkan masa menunggu pengguna dan meningkatkan pengalaman pengguna termasuk: terhad oleh saiz model, ketepatannya juga terhad. Bagaimana untuk menggunakan js untuk melaksanakan pengesanan muka di web? Untuk melaksanakan pengecaman muka di Web, anda perlu biasa dengan bahasa dan teknologi pengaturcaraan yang berkaitan, seperti JavaScript, HTML, CSS, WebRTC, dll. Pada masa yang sama, anda juga perlu menguasai visi komputer yang berkaitan dan teknologi kecerdasan buatan. Perlu diingat bahawa kerana reka bentuk bahagian Web

Dokumen berbilang modal Alibaba 7B memahami model besar memenangi SOTA baharu

Apr 02, 2024 am 11:31 AM

Dokumen berbilang modal Alibaba 7B memahami model besar memenangi SOTA baharu

Apr 02, 2024 am 11:31 AM

SOTA baharu untuk keupayaan memahami dokumen multimodal! Pasukan Alibaba mPLUG mengeluarkan kerja sumber terbuka terkini mPLUG-DocOwl1.5, yang mencadangkan satu siri penyelesaian untuk menangani empat cabaran utama pengecaman teks imej resolusi tinggi, pemahaman struktur dokumen am, arahan mengikut dan pengenalan pengetahuan luaran. Tanpa berlengah lagi, mari kita lihat kesannya dahulu. Pengecaman satu klik dan penukaran carta dengan struktur kompleks ke dalam format Markdown: Carta gaya berbeza tersedia: Pengecaman dan kedudukan teks yang lebih terperinci juga boleh dikendalikan dengan mudah: Penjelasan terperinci tentang pemahaman dokumen juga boleh diberikan: Anda tahu, "Pemahaman Dokumen " pada masa ini Senario penting untuk pelaksanaan model bahasa yang besar. Terdapat banyak produk di pasaran untuk membantu pembacaan dokumen. Sesetengah daripada mereka menggunakan sistem OCR untuk pengecaman teks dan bekerjasama dengan LLM untuk pemprosesan teks.

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh