Peranti teknologi

Peranti teknologi

AI

AI

Menambah tingkah laku ejen sebenar pada simulator pemanduan autonomi CARLA

Menambah tingkah laku ejen sebenar pada simulator pemanduan autonomi CARLA

Menambah tingkah laku ejen sebenar pada simulator pemanduan autonomi CARLA

kertas arXiv "Pemasukan gelagat ejen sebenar dalam simulator pemanduan autonomi CARLA", 22 Jun, Sepanyol.

Peranan simulasi dalam pemanduan autonomi menjadi semakin penting kerana keperluan untuk prototaip pantas dan ujian yang meluas. Simulasi berasaskan fizik menawarkan pelbagai kelebihan dan faedah pada kos yang berpatutan, sambil menghapuskan risiko kepada prototaip, pemandu dan Pengguna Jalan Raya Terdedah (VRU) .

Walau bagaimanapun, terdapat dua batasan utama. Pertama, jurang realiti yang terkenal merujuk kepada perbezaan antara realiti dan simulasi yang menghalang pengalaman pemanduan autonomi simulasi daripada mencapai prestasi dunia sebenar yang berkesan. Kedua, kurangnya pengetahuan empirikal tentang tingkah laku ejen sebenar (manusia), termasuk pemandu sandaran atau penumpang dan pengguna jalan raya lain seperti kenderaan, pejalan kaki atau penunggang basikal.

Simulasi ejen biasanya dipraprogramkan, secara rawak kemungkinan atau dijana berdasarkan data sebenar, tetapi tidak mewakili gelagat ejen sebenar yang berinteraksi dengan senario simulasi tertentu. Kertas kerja ini mencadangkan rangka kerja awal yang membolehkan interaksi masa nyata antara ejen sebenar dan persekitaran simulasi, termasuk kenderaan autonomi, dan menjana data jujukan sintetik daripada sensor simulasi merentas berbilang pandangan untuk melatih sistem ramalan yang bergantung pada model tingkah laku.

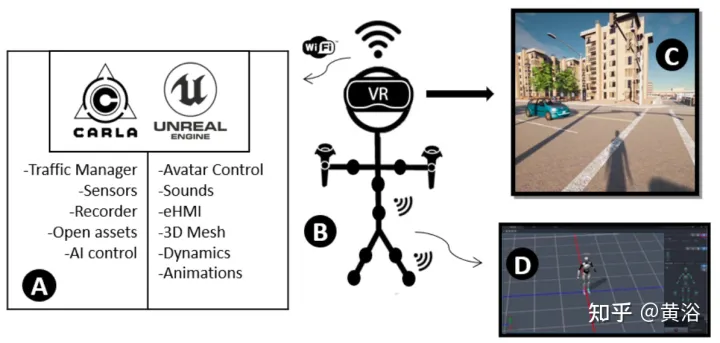

Pendekatan ini menyepadukan sistem realiti maya (VR) dan tangkapan gerakan manusia (HMC) yang mendalam dengan CARLA untuk pemanduan autonomi. Ia menerangkan seni bina perkakasan dan perisian dan membincangkan apa yang dipanggil jurang tingkah laku.

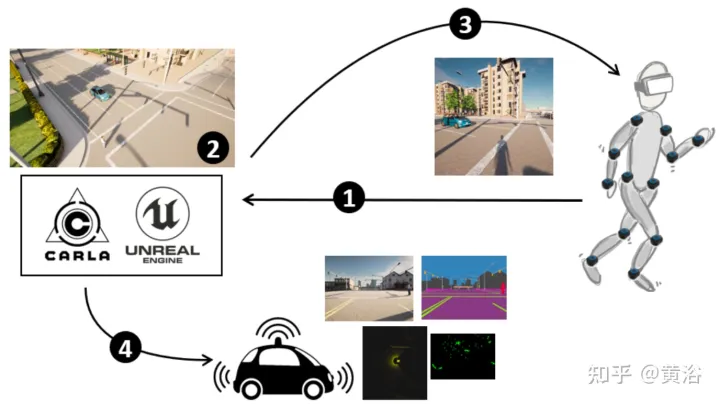

Seperti yang ditunjukkan dalam rajah adalah gambaran keseluruhan kaedah: (1) CARLA-UE dilengkapi dengan pose kepala (set kepala VR) dan badan (sistem tangkapan gerakan). (2) Hasilkan adegan termasuk kenderaan autonomi dan pejalan kaki digital. (3) Sediakan persekitaran untuk pejalan kaki (melalui set kepala VR). (4) Penderia kenderaan automatik mengesan persekitaran, termasuk pejalan kaki.

Berikut memperkenalkan fungsi sistem VR imersif dalam simulator pemanduan autonomi CARLA.

Mencapai rendaman pejalan kaki sepenuhnya dengan menjalankan kajian tingkah laku dan interaksi menggunakan keupayaan yang disediakan oleh UE4 dan perkakasan luaran seperti cermin mata VR dan satu set penderia gerakan.

Simulator sumber terbuka CARLA dilaksanakan pada UE4, yang menyediakan pemaparan berkualiti tinggi, persekitaran fizik yang realistik dan ekosistem pemalam yang boleh dikendalikan. CARLA mensimulasikan adegan trafik dinamik dan menyediakan antara muka antara dunia maya yang dicipta oleh UE4 dan ejen jalan yang berjalan di tempat kejadian. CARLA direka bentuk sebagai sistem pelayan-pelanggan untuk mencapai ini, dengan pelayan menjalankan simulasi dan memaparkan adegan. Komunikasi antara klien dan pelayan dilakukan melalui soket.

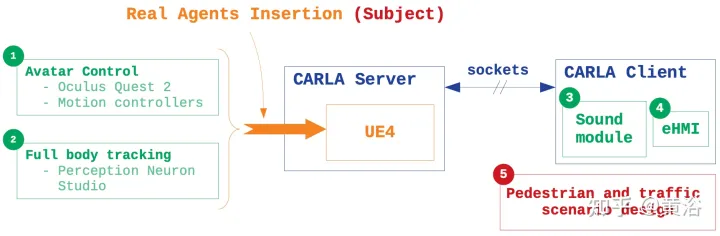

Ciri-ciri utama memasukkan gelagat ejen sebenar ke dalam simulasi adalah berdasarkan lima perkara (seperti yang ditunjukkan dalam rajah): 1) Kawalan Avatar: Pustaka pelan tindakan CARLA , kumpulkan seni bina semua watak dan atribut, ubah suai pelan tindakan pejalan kaki dan cipta antara muka VR yang mengasyikkan dan boleh alih antara manusia dan dunia maya 2) Penjejakan Badan: Gunakan set penderia inersia; dan perisian luaran proprietari Tangkap pergerakan subjek dan persepsi gerakan melalui adegan sebenar, dan integrasikan pergerakan Avatar ke dalam simulator melalui fail .bvh; dalam persekitaran , tingkatkan rasa rendaman; 4) integrasi eHMI: merealisasikan komunikasi status kenderaan autonomi dan maklumat niat, dan lakukan penyelidikan interaktif; adegan dalam klien CARLA , kawal tingkah laku kenderaan dan pejalan kaki. Komunikasi antara pengguna jalan raya merupakan faktor penting dalam persekitaran trafik. Dalam percubaan, antara muka mesin manusia luaran (eHMI) telah disediakan untuk kenderaan autonomi itu untuk menyampaikan status dan niatnya kepada pengguna jalan raya sebenar.

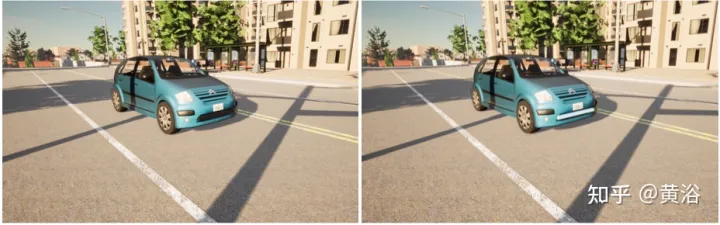

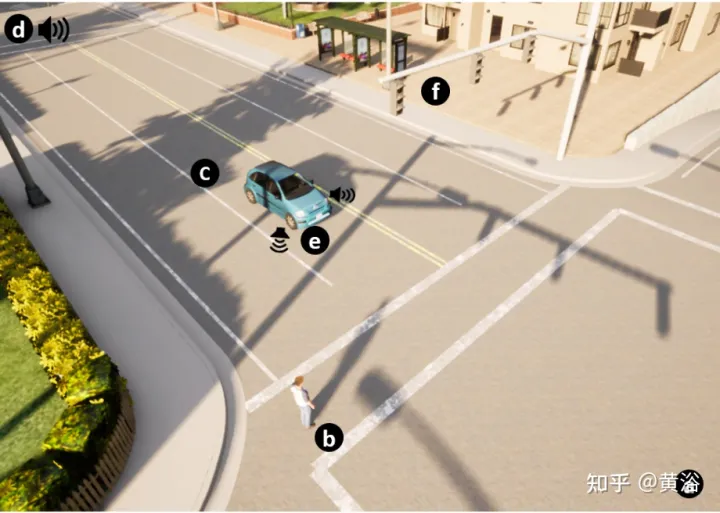

Seperti yang ditunjukkan dalam rajah, reka bentuk eHMI yang dicadangkan terdiri daripada jalur cahaya di sepanjang bahagian hadapan kereta. Gambar di sebelah kiri tanpa eHMI, dan gambar di sebelah kanan adalah dengan eHMI. Ini membolehkan mengkaji kesan antara muka dalam membuat keputusan apabila trajektori pejalan kaki bertumpu dengan trajektori kenderaan dalam adegan maya. Seluruh seni bina sistem adalah seperti yang ditunjukkan di bawah:

Seluruh seni bina sistem adalah seperti yang ditunjukkan di bawah:

Kawal aliran trafik dengan menetapkan parameter yang memaksa tingkah laku tertentu. Contohnya, kereta boleh dibenarkan memecut, mengabaikan keadaan lampu isyarat, mengabaikan pejalan kaki, atau memaksa menukar lorong.

Kawal aliran trafik dengan menetapkan parameter yang memaksa tingkah laku tertentu. Contohnya, kereta boleh dibenarkan memecut, mengabaikan keadaan lampu isyarat, mengabaikan pejalan kaki, atau memaksa menukar lorong.

Badan utama disepadukan ke dalam simulator termasuk peta model 3-D bandar. Setiap peta adalah berdasarkan fail OpenDRIVE yang menerangkan reka letak jalan beranotasi sepenuhnya. Ciri ini membolehkan mereka bentuk peta anda sendiri, menghasilkan semula senario trafik yang sama dalam persekitaran sebenar dan maya, menilai penyepaduan gelagat sebenar simulator dan dapat menjalankan kajian lapangan dengan membandingkan hasil interaksi.

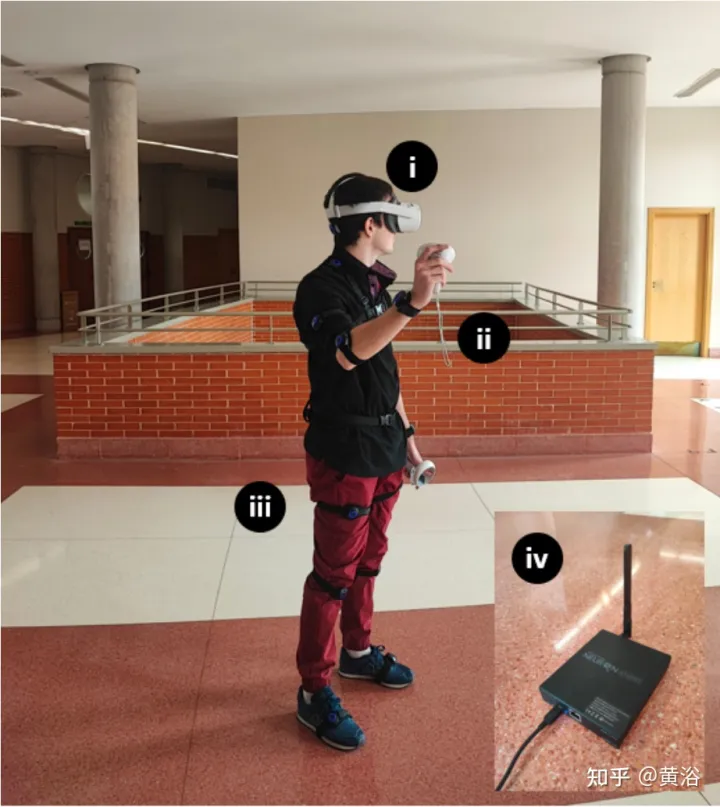

Tetapan perkakasan adalah seperti yang ditunjukkan dalam rajah: Semasa percubaan, Oculus Quest 2 digunakan sebagai peranti yang dipasang di kepala (HMD), Meta dicipta, pemproses RAM 6GB, dua kanta 1832 x 1920 boleh laras, 90Hz kadar segar semula dan 256 GB RAM. Quest 2 menampilkan Wi-Fi 6, Bluetooth 5.1 dan sambungan USB Type-C, sokongan SteamVR dan pembesar suara 3D. Untuk penjejakan seluruh badan, bungkus penyelesaian dengan PNS dengan penjejak inersia. Kit ini termasuk set kepala VR kendiri, 2 pengawal gerakan, 17 penderia badan inersia Studio, 14 set tali, kes pengecasan dan transceiver Studio.

Memandangkan CARLA build dan Quest 2 hanya bergantung pada Windows, VR Immersion System kini bergantung pada sistem pengendalian UE4.24 dan Windows 10. Dengan pemalam soket TCP, kedudukan editor semua peserta dan parameter berguna lain dihantar daripada API Python, menyepadukan suara setiap peserta atau eHMI kenderaan autonomi. "Pratonton VR" memulakan permainan di HMD. Perception Neuron Studio berfungsi dengan Axis Studio, yang menyokong sehingga 3 subjek pada satu masa dan 23 penderia badan dan jari secara serentak.

Gambar menunjukkan simulasi keadaan trafik interaktif: (a) Reka bentuk dunia 3D. (b) Avatar pelaksana padanan pejalan kaki. (c) Kereta pandu sendiri. (d) Bunyi persekitaran dan bunyi pintar. (e) eHMI. (f) Lampu isyarat dan tanda isyarat.

Atas ialah kandungan terperinci Menambah tingkah laku ejen sebenar pada simulator pemanduan autonomi CARLA. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

Mengapakah Gaussian Splatting begitu popular dalam pemanduan autonomi sehingga NeRF mula ditinggalkan?

Jan 17, 2024 pm 02:57 PM

Mengapakah Gaussian Splatting begitu popular dalam pemanduan autonomi sehingga NeRF mula ditinggalkan?

Jan 17, 2024 pm 02:57 PM

Ditulis di atas & pemahaman peribadi pengarang Gaussiansplatting tiga dimensi (3DGS) ialah teknologi transformatif yang telah muncul dalam bidang medan sinaran eksplisit dan grafik komputer dalam beberapa tahun kebelakangan ini. Kaedah inovatif ini dicirikan oleh penggunaan berjuta-juta Gaussians 3D, yang sangat berbeza daripada kaedah medan sinaran saraf (NeRF), yang terutamanya menggunakan model berasaskan koordinat tersirat untuk memetakan koordinat spatial kepada nilai piksel. Dengan perwakilan adegan yang eksplisit dan algoritma pemaparan yang boleh dibezakan, 3DGS bukan sahaja menjamin keupayaan pemaparan masa nyata, tetapi juga memperkenalkan tahap kawalan dan pengeditan adegan yang tidak pernah berlaku sebelum ini. Ini meletakkan 3DGS sebagai penukar permainan yang berpotensi untuk pembinaan semula dan perwakilan 3D generasi akan datang. Untuk tujuan ini, kami menyediakan gambaran keseluruhan sistematik tentang perkembangan dan kebimbangan terkini dalam bidang 3DGS buat kali pertama.

Bagaimana untuk menyelesaikan masalah ekor panjang dalam senario pemanduan autonomi?

Jun 02, 2024 pm 02:44 PM

Bagaimana untuk menyelesaikan masalah ekor panjang dalam senario pemanduan autonomi?

Jun 02, 2024 pm 02:44 PM

Semalam semasa temu bual, saya telah ditanya sama ada saya telah membuat sebarang soalan berkaitan ekor panjang, jadi saya fikir saya akan memberikan ringkasan ringkas. Masalah ekor panjang pemanduan autonomi merujuk kepada kes tepi dalam kenderaan autonomi, iaitu, kemungkinan senario dengan kebarangkalian yang rendah untuk berlaku. Masalah ekor panjang yang dirasakan adalah salah satu sebab utama yang kini mengehadkan domain reka bentuk pengendalian kenderaan autonomi pintar satu kenderaan. Seni bina asas dan kebanyakan isu teknikal pemanduan autonomi telah diselesaikan, dan baki 5% masalah ekor panjang secara beransur-ansur menjadi kunci untuk menyekat pembangunan pemanduan autonomi. Masalah ini termasuk pelbagai senario yang berpecah-belah, situasi yang melampau dan tingkah laku manusia yang tidak dapat diramalkan. "Ekor panjang" senario tepi dalam pemanduan autonomi merujuk kepada kes tepi dalam kenderaan autonomi (AVs) kes Edge adalah senario yang mungkin dengan kebarangkalian yang rendah untuk berlaku. kejadian yang jarang berlaku ini

Pilih kamera atau lidar? Kajian terbaru tentang mencapai pengesanan objek 3D yang mantap

Jan 26, 2024 am 11:18 AM

Pilih kamera atau lidar? Kajian terbaru tentang mencapai pengesanan objek 3D yang mantap

Jan 26, 2024 am 11:18 AM

0. Ditulis di hadapan&& Pemahaman peribadi bahawa sistem pemanduan autonomi bergantung pada persepsi lanjutan, membuat keputusan dan teknologi kawalan, dengan menggunakan pelbagai penderia (seperti kamera, lidar, radar, dll.) untuk melihat persekitaran sekeliling dan menggunakan algoritma dan model untuk analisis masa nyata dan membuat keputusan. Ini membolehkan kenderaan mengenali papan tanda jalan, mengesan dan menjejaki kenderaan lain, meramalkan tingkah laku pejalan kaki, dsb., dengan itu selamat beroperasi dan menyesuaikan diri dengan persekitaran trafik yang kompleks. Teknologi ini kini menarik perhatian meluas dan dianggap sebagai kawasan pembangunan penting dalam pengangkutan masa depan satu. Tetapi apa yang menyukarkan pemanduan autonomi ialah memikirkan cara membuat kereta itu memahami perkara yang berlaku di sekelilingnya. Ini memerlukan algoritma pengesanan objek tiga dimensi dalam sistem pemanduan autonomi boleh melihat dan menerangkan dengan tepat objek dalam persekitaran sekeliling, termasuk lokasinya,

Adakah anda benar-benar menguasai penukaran sistem koordinat? Isu berbilang sensor yang tidak dapat dipisahkan daripada pemanduan autonomi

Oct 12, 2023 am 11:21 AM

Adakah anda benar-benar menguasai penukaran sistem koordinat? Isu berbilang sensor yang tidak dapat dipisahkan daripada pemanduan autonomi

Oct 12, 2023 am 11:21 AM

Artikel perintis dan utama pertama terutamanya memperkenalkan beberapa sistem koordinat yang biasa digunakan dalam teknologi pemanduan autonomi, dan cara melengkapkan korelasi dan penukaran antara mereka, dan akhirnya membina model persekitaran bersatu. Fokus di sini adalah untuk memahami penukaran daripada kenderaan kepada badan tegar kamera (parameter luaran), penukaran kamera kepada imej (parameter dalaman) dan penukaran unit imej kepada piksel. Penukaran daripada 3D kepada 2D akan mempunyai herotan, terjemahan, dsb. Perkara utama: Sistem koordinat kenderaan dan sistem koordinat badan kamera perlu ditulis semula: sistem koordinat satah dan sistem koordinat piksel Kesukaran: herotan imej mesti dipertimbangkan Kedua-dua penyahherotan dan penambahan herotan diberi pampasan pada satah imej. 2. Pengenalan Terdapat empat sistem penglihatan secara keseluruhannya: sistem koordinat satah piksel (u, v), sistem koordinat imej (x, y), sistem koordinat kamera () dan sistem koordinat dunia (). Terdapat hubungan antara setiap sistem koordinat,

Artikel ini sudah cukup untuk anda membaca tentang pemanduan autonomi dan ramalan trajektori!

Feb 28, 2024 pm 07:20 PM

Artikel ini sudah cukup untuk anda membaca tentang pemanduan autonomi dan ramalan trajektori!

Feb 28, 2024 pm 07:20 PM

Ramalan trajektori memainkan peranan penting dalam pemanduan autonomi Ramalan trajektori pemanduan autonomi merujuk kepada meramalkan trajektori pemanduan masa hadapan kenderaan dengan menganalisis pelbagai data semasa proses pemanduan kenderaan. Sebagai modul teras pemanduan autonomi, kualiti ramalan trajektori adalah penting untuk kawalan perancangan hiliran. Tugas ramalan trajektori mempunyai timbunan teknologi yang kaya dan memerlukan kebiasaan dengan persepsi dinamik/statik pemanduan autonomi, peta ketepatan tinggi, garisan lorong, kemahiran seni bina rangkaian saraf (CNN&GNN&Transformer), dll. Sangat sukar untuk bermula! Ramai peminat berharap untuk memulakan ramalan trajektori secepat mungkin dan mengelakkan perangkap Hari ini saya akan mengambil kira beberapa masalah biasa dan kaedah pembelajaran pengenalan untuk ramalan trajektori! Pengetahuan berkaitan pengenalan 1. Adakah kertas pratonton teratur? A: Tengok survey dulu, hlm

SIMPL: Penanda aras ramalan gerakan berbilang ejen yang mudah dan cekap untuk pemanduan autonomi

Feb 20, 2024 am 11:48 AM

SIMPL: Penanda aras ramalan gerakan berbilang ejen yang mudah dan cekap untuk pemanduan autonomi

Feb 20, 2024 am 11:48 AM

Tajuk asal: SIMPL: ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving Paper pautan: https://arxiv.org/pdf/2402.02519.pdf Pautan kod: https://github.com/HKUST-Aerial-Robotics/SIMPL Unit pengarang: Universiti Sains Hong Kong dan Teknologi Idea Kertas DJI: Kertas kerja ini mencadangkan garis dasar ramalan pergerakan (SIMPL) yang mudah dan cekap untuk kenderaan autonomi. Berbanding dengan agen-sen tradisional

SOTA terbaharu nuScenes |. SparseAD: Pertanyaan jarang membantu pemanduan autonomi hujung ke hujung yang cekap!

Apr 17, 2024 pm 06:22 PM

SOTA terbaharu nuScenes |. SparseAD: Pertanyaan jarang membantu pemanduan autonomi hujung ke hujung yang cekap!

Apr 17, 2024 pm 06:22 PM

Ditulis di hadapan & titik permulaan Paradigma hujung ke hujung menggunakan rangka kerja bersatu untuk mencapai pelbagai tugas dalam sistem pemanduan autonomi. Walaupun kesederhanaan dan kejelasan paradigma ini, prestasi kaedah pemanduan autonomi hujung ke hujung pada subtugas masih jauh ketinggalan berbanding kaedah tugasan tunggal. Pada masa yang sama, ciri pandangan mata burung (BEV) padat yang digunakan secara meluas dalam kaedah hujung ke hujung sebelum ini menyukarkan untuk membuat skala kepada lebih banyak modaliti atau tugasan. Paradigma pemanduan autonomi hujung ke hujung (SparseAD) tertumpu carian jarang dicadangkan di sini, di mana carian jarang mewakili sepenuhnya keseluruhan senario pemanduan, termasuk ruang, masa dan tugas, tanpa sebarang perwakilan BEV yang padat. Khususnya, seni bina jarang bersatu direka bentuk untuk kesedaran tugas termasuk pengesanan, penjejakan dan pemetaan dalam talian. Di samping itu, berat

Mari kita bincangkan tentang sistem pemanduan autonomi hujung ke hujung dan generasi seterusnya, serta beberapa salah faham tentang pemanduan autonomi hujung ke hujung?

Apr 15, 2024 pm 04:13 PM

Mari kita bincangkan tentang sistem pemanduan autonomi hujung ke hujung dan generasi seterusnya, serta beberapa salah faham tentang pemanduan autonomi hujung ke hujung?

Apr 15, 2024 pm 04:13 PM

Pada bulan lalu, atas sebab-sebab yang diketahui umum, saya telah mengadakan pertukaran yang sangat intensif dengan pelbagai guru dan rakan sekelas dalam industri. Topik yang tidak dapat dielakkan dalam pertukaran secara semula jadi adalah hujung ke hujung dan Tesla FSDV12 yang popular. Saya ingin mengambil kesempatan ini untuk menyelesaikan beberapa buah fikiran dan pendapat saya pada masa ini untuk rujukan dan perbincangan anda. Bagaimana untuk mentakrifkan sistem pemanduan autonomi hujung ke hujung, dan apakah masalah yang sepatutnya dijangka diselesaikan hujung ke hujung? Menurut definisi yang paling tradisional, sistem hujung ke hujung merujuk kepada sistem yang memasukkan maklumat mentah daripada penderia dan secara langsung mengeluarkan pembolehubah yang membimbangkan tugas. Sebagai contoh, dalam pengecaman imej, CNN boleh dipanggil hujung-ke-hujung berbanding kaedah pengekstrak ciri + pengelas tradisional. Dalam tugas pemanduan autonomi, masukkan data daripada pelbagai penderia (kamera/LiDAR