Yann Lecun, pemenang Anugerah Turing, adalah salah satu daripada tiga gergasi dalam industri AI Sememangnya, makalah yang diterbitkannya dikaji sebagai "Bible".

Namun, baru-baru ini, seseorang tiba-tiba melompat keluar dan mengecam LeCun kerana "memudahkan pandangan teras saya."

Bolehkah...

Ya, orang ini " Bapa LSTM" Jürgen Schmidhuber.

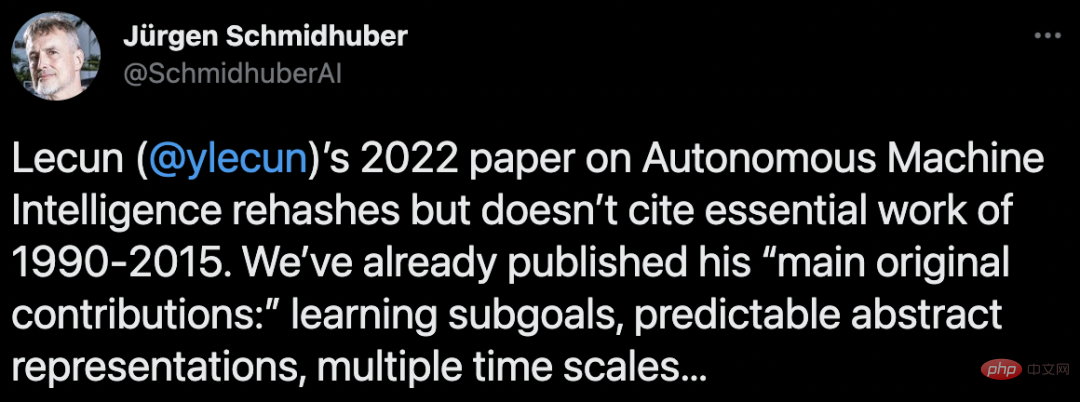

Schmidhuber berkata bahawa kertas kerja LeCun tidak menyebut pencapaian penting dari 1990 hingga 2015. "Pencapaian asal utama" yang disebut dalam artikel itu termasuk "pembelajaran Mereka juga telah menerbitkan konsep seperti sebagai submatlamat, perwakilan abstrak yang boleh diramal dan skala masa berbilang.

Perkataan rehash yang digunakan dalam tweet asal adalah untuk menyatakan idea asal dengan cara lain tanpa inovasi, iaitu "rehash" yang betul.

Pada masa yang sama, dia juga menyiarkan artikel panjang yang menyenaraikan bukti secara terperinci. Sudah tentu, ini hanya boleh dianggap sebagai kenyataan berat sebelah Schmidhuber.

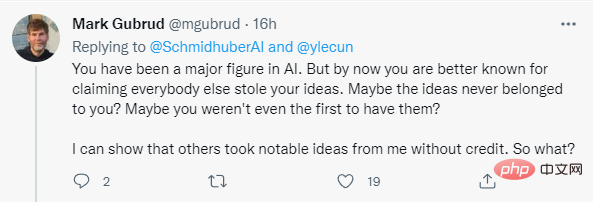

Namun, netizen jelas tidak membelinya.

"Anda pernah menjadi kelas berat dalam komuniti AI, tetapi kini anda terkenal kerana mendakwa bahawa pencapaian akademik semua orang menciplak idea anda."

"Rangkaian saraf, transformer dan LSTMS dicipta oleh anda, jadi adakah kertas tandas dan kepingan roti juga dicipta oleh keluarga anda?"

Jadi, apakah itu?

Mari kita lihat dahulu selok-belok perkara itu.

Pada 14 Jun 2022, "tabloid sains" yang dipanggil Tabloid Sains oleh Schmidhuber (Saya bercakap tentang anda MIT Technology Review) menerbitkan laporan oleh LeCun, yang menghuraikan penyelidikan baharunya tentang AGI.

Pada 27 Jun, Yann LeCun menerbitkan kertas kerja "A Path Towards Autonomous Machine Intelligence" yang telah disimpannya selama beberapa tahun, dan menyebutnya "menunjukkan perkembangan masa depan arah AI." lakukan".

Kertas ini secara sistematik membincangkan isu "bagaimana mesin boleh belajar seperti haiwan dan manusia".

LeCun berkata bahawa artikel ini bukan sahaja pemikirannya tentang hala tuju umum pembangunan AI dalam 5-10 tahun akan datang, tetapi juga apa yang dia rancang untuk menyelidik dalam beberapa tahun akan datang, dan berharap dapat memberi inspirasi kepada lebih ramai orang dalam bidang AI untuk menyertai. Penyelidikan.

Mungkin kerana pengaruh kertas LeCun yang semakin meningkat, Schmidhuber akhirnya memutuskan untuk menerbitkan artikel panjang yang ditulis sendiri pada 7 Julai, dengan marah menuduh LeCun memplagiat ideanya.

Schmidhuber berkata sebelum artikel itu diterbitkan secara terbuka, "tabloid sains" menghantar draf laporan itu (masih sulit) dan berharap beliau boleh Meninggalkan beberapa komen mengenai perkara ini. .

Jadi Schmidhuber menulis "aduan" dengan fasih, mengatakan bahawa artikel LeCun pada dasarnya adalah replika karya terdahulunya, dan ia tidak dipetik.

Seperti yang dijangkakan, komennya menjadi tidak disukai.

LeCun hanya mengulangi kerja saya tanpa petikan!

Schmidhuber menyatakan dalam artikel panjang ini bahawa dia berharap pembaca dapat mengkaji kertas asal dan menilai sendiri kandungan saintifik komen ini, dan juga berharap karyanya akan diiktiraf dan diiktiraf.

LeCun menyatakan pada permulaan kertas bahawa banyak idea yang diterangkan dalam artikel ini (hampir semua) dicadangkan oleh ramai pengarang dalam konteks yang berbeza dan dalam bentuk yang berbeza, malangnya, kebanyakan karya The kandungan adalah "serupa" dengan kertas kerja kami sejak 1990, dan tiada tanda petikan.

Mari kita lihat dahulu bukti (sebahagian) serangannya terhadap LeCun kali ini.

Bukti 1:

LeCun: Penyelidikan kecerdasan buatan hari ini mesti menyelesaikan tiga cabaran utama: (1) Bagaimana mesin boleh belajar mewakili dunia ? , belajar meramal, dan belajar bertindak terutamanya melalui pemerhatian (2) Bagaimana mesin boleh menaakul dan merancang dengan cara yang serasi dengan pembelajaran berasaskan kecerunan (3) Bagaimana mesin boleh melakukannya secara hierarki, pada pelbagai peringkat abstrak dan pada beberapa kali Perwakilan pembelajaran untuk persepsi (3a) dan perancangan tindakan (3b) pada skala Schmidhuber: Isu-isu ini telah ditangani secara terperinci dalam satu siri kertas kerja yang diterbitkan pada tahun 1990, 1991, 1997 dan 2015.

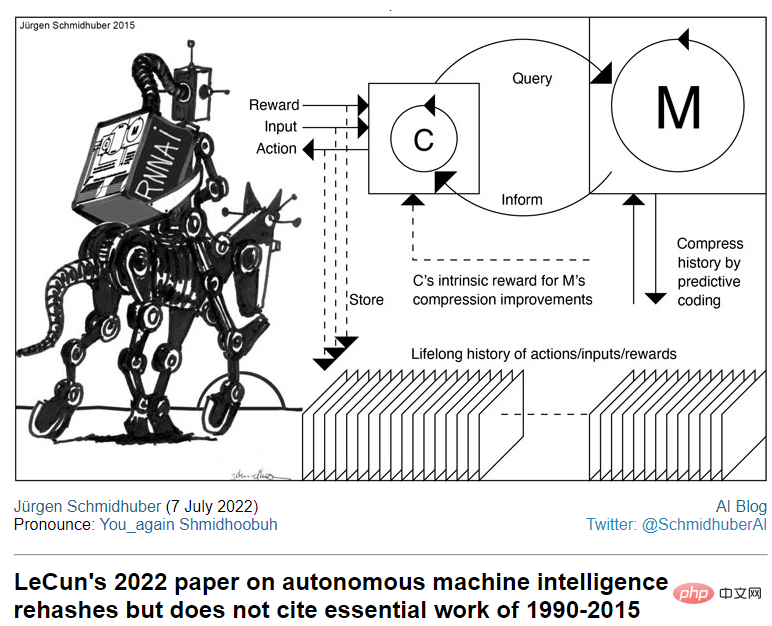

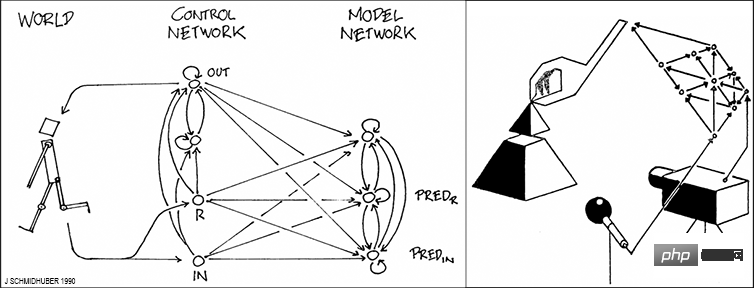

Pada tahun 1990, kerja pertama mengenai rangkaian saraf tiruan (NN) berasaskan kecerunan untuk perancangan jangka panjang dan pembelajaran tetulang (RL) dan penerokaan melalui rasa ingin tahu buatan telah diterbitkan.

Ia menerangkan gabungan dua Rangkaian Neural Berulang (RNN, NNN paling berkuasa), dipanggil pengawal dan model dunia.

Antaranya, model dunia belajar untuk meramalkan akibat daripada tindakan pengawal Pengawal boleh menggunakan model dunia untuk merancang beberapa langkah masa lebih awal dan memilih urutan tindakan yang memaksimumkan ganjaran yang diramalkan.

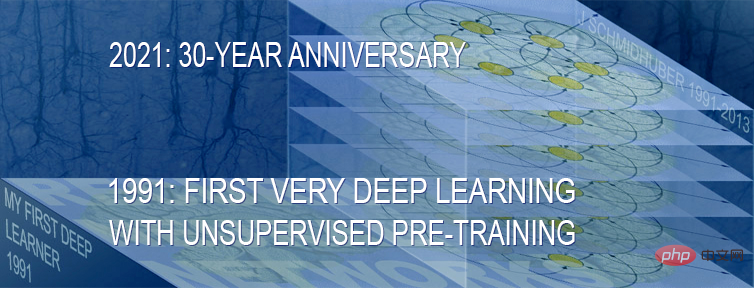

Mengenai jawapan kepada persepsi hierarki (3a) berdasarkan rangkaian saraf, soalan ini sekurang-kurangnya sebahagiannya diilhamkan oleh penerbitan "The First Deep Learning Machine—Neural Sequence" saya pada tahun 1991. Penyelesaian "penyekat" penganalisis.

Mengenai jawapan kepada persepsi hierarki (3a) berdasarkan rangkaian saraf, soalan ini sekurang-kurangnya sebahagiannya diilhamkan oleh penerbitan "The First Deep Learning Machine—Neural Sequence" saya pada tahun 1991. Penyelesaian "penyekat" penganalisis.

Ia menggunakan pembelajaran tanpa pengawasan dan pengekodan ramalan dalam hierarki mendalam Rangkaian Neural Berulang (RNN) untuk mencari " Perwakilan dalaman jujukan data yang panjang".

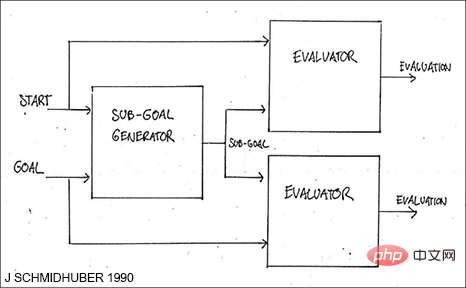

Jawapan kepada perancangan tindakan hierarki (3b) berdasarkan rangkaian saraf telah sekurang-kurangnya sebahagiannya diselesaikan pada tahun 1990 oleh kertas saya mengenai pembelajaran tetulang hierarki (HRL) menyelesaikan masalah ini.

Jawapan kepada perancangan tindakan hierarki (3b) berdasarkan rangkaian saraf telah sekurang-kurangnya sebahagiannya diselesaikan pada tahun 1990 oleh kertas saya mengenai pembelajaran tetulang hierarki (HRL) menyelesaikan masalah ini.

LeCun: Memandangkan kedua-dua sub-modul modul kos boleh dibezakan , jadi kecerunan tenaga boleh disebarkan kembali melalui modul lain, terutamanya modul dunia, modul prestasi dan modul persepsi.

Schmidhuber: Inilah yang saya terbitkan pada tahun 1990, memetik kertas "Pengenalan Sistem dengan Rangkaian Neural Feedforward" yang diterbitkan pada tahun 1980.

Pada tahun 2000, bekas postdoc saya Marcus Hutter malah menerbitkan kaedah optimum, am, tidak boleh dibezakan secara teori untuk mempelajari model dan pengawal dunia. (Lihat juga AGI rujukan kendiri optimum secara matematik yang dipanggil mesin Gödel)

Pameran 3:

LeCun: Memori Jangka Pendek Modul seni bina mungkin serupa dengan rangkaian memori nilai kunci.

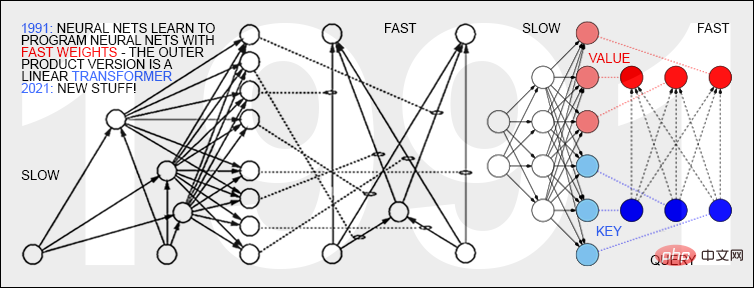

Schmidhuber: Walau bagaimanapun, dia gagal menyebut bahawa saya menerbitkan "rangkaian memori nilai kunci" yang pertama pada tahun 1991, apabila saya menerangkan pemprosesan jujukan "Pengawal Berat Cepat" atau Pengaturcara Berat Cepat (FWPs) . FWP mempunyai rangkaian saraf perlahan yang belajar melalui perambatan balik untuk mengubah suai pemberat pantas rangkaian saraf lain dengan cepat.

LeCun: Keaslian utama kertas kerja ini Sumbangannya terletak pada: (I) seni bina kognitif holistik di mana semua modul boleh dibezakan dan kebanyakannya boleh dilatih. (II) H-JEPA: Model yang meramalkan seni bina hierarki bukan generatif dunia yang mempelajari perwakilan pada berbilang tahap abstraksi dan berbilang skala masa. (III) Satu siri paradigma pembelajaran penyeliaan kendiri bukan kontrastif yang menghasilkan perwakilan yang bermaklumat dan boleh diramal secara serentak. (IV) Gunakan H-JEPA sebagai asas untuk model dunia ramalan untuk perancangan hierarki di bawah ketidakpastian.

Dalam hal ini, Schmidhuber turut membaca pruf empat modul yang disenaraikan oleh LeCun satu persatu, dan memberikan mata yang bertindih dengan kertas kerjanya.

Pada penghujung artikel, beliau menyatakan bahawa fokus artikel ini bukan untuk menyerang kertas yang diterbitkan atau idea yang dicerminkan oleh pengarang mereka kertas.

Beliau berkata bahawa banyak idea-idea ini dicadangkan dengan usaha saya dan rakan-rakan saya "Sumbangan asal utama" beliau yang kini dicadangkan oleh LeCun sebenarnya tidak dapat dipisahkan daripada sumbangan penyelidikan saya yang berpuluh tahun kesahihan komen saya untuk diri mereka sendiri.

Daripada bapa LSTM kepada...

Malah, ini bukan kali pertama lelaki ini mendakwa orang lain meniru karyanya.

Seawal September tahun lalu, dia menyiarkan di blognya bahawa keputusan kertas rangkaian saraf yang paling banyak disebut adalah berdasarkan kerja yang disiapkan di makmal saya:

" Tidak perlu dikatakan, LSTM, dan karya perintis lain yang terkenal hari ini, seperti ResNet, AlexNet, GAN, dan Transformer, semuanya berkaitan dengan kerja saya Versi pertama beberapa karya dibuat oleh saya, tetapi kini mereka ini tidak petikan yang tidak teratur telah menyebabkan masalah dengan atribusi semasa keputusan ini "Walaupun pakcik itu sangat marah, saya harus mengatakan bahawa Jürgen Schmidhuber agak kecewa selama ini. Mereka berdua adalah tokoh kanan dalam bidang AI dan telah membuat banyak pencapaian yang cemerlang, tetapi reputasi dan pengiktirafan yang mereka terima sentiasa kelihatan jauh di luar jangkaan.

Terutama pada 2018, apabila tiga gergasi pembelajaran mendalam: Yoshua Bengio, Geoffrey Hinton, dan Yann LeCun memenangi Anugerah Turing, ramai netizen mempersoalkan mengapa Anugerah Turing tidak diberikan kepada LSTM Father Jürgen Schmidhuber? Beliau juga seorang sarjana dalam bidang pembelajaran mendalam.

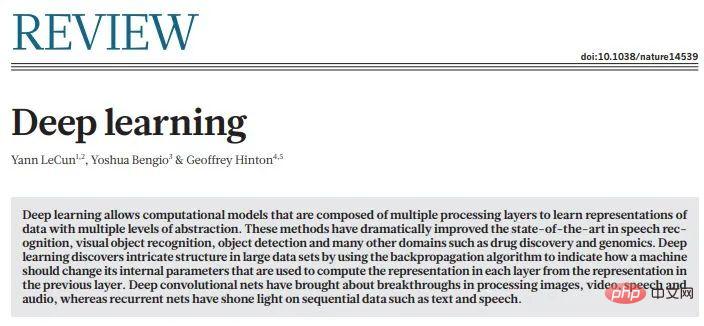

Kembali pada tahun 2015, tiga tokoh hebat, Bengio, Hinton dan LeCun, bersama-sama menerbitkan ulasan tentang Alam Semulajadi, dan tajuk itu secara langsung dipanggil "Pembelajaran Mendalam".

Artikel bermula daripada teknologi pembelajaran mesin tradisional, meringkaskan seni bina utama dan kaedah pembelajaran mesin moden, menerangkan algoritma perambatan belakang untuk melatih seni bina rangkaian berbilang lapisan, dan kelahiran rangkaian neural konvolusi, Perwakilan dan bahasa yang diedarkan pemprosesan, serta rangkaian saraf berulang dan aplikasinya, antara lain.

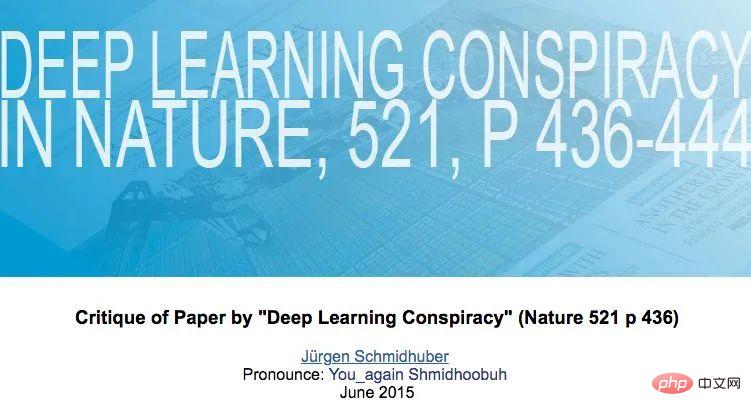

Tidak sampai sebulan kemudian, Schmidhuber menyiarkan kritikan di blognya.

Schmidhuber berkata bahawa artikel ini membuatnya tidak berpuas hati kerana keseluruhan artikel itu memetik hasil penyelidikan ketiga-tiga pengarang itu sendiri berkali-kali, manakala perintis lain mempunyai pandangan awal tentang Sumbangan mendalam tidak disebut sama sekali.

Dia percaya bahawa "Three Deep Learning Giants" yang memenangi Anugerah Turing telah menjadi sekumpulan pencuri yang tamak untuk kejayaan orang lain dan menganggap mereka mementingkan diri sendiri untuk menyanjung satu sama lain dan menindas pendahulu mereka.

Pada 2016, Jürgen Schmidhuber telah bertelagah dengan "bapa GAN" Ian Goodfellow dalam Tutorial di persidangan NIPS.

Pada masa itu, apabila Goodfellow bercakap tentang membandingkan GAN dengan model lain, Schmidhuber berdiri dan mencelah dengan soalan.

Soalan Schmidhuber adalah sangat panjang dan berdurasi kira-kira dua minit adalah untuk menekankan bahawa beliau telah mencadangkan PM pada tahun 1992, dan kemudian banyak bercakap mengenainya , proses pelaksanaan, dsb., gambar akhir menunjukkan: Bolehkah anda beritahu saya jika terdapat sebarang persamaan antara GAN anda dan PM saya?

Goodfellow tidak menunjukkan kelemahan: Kami telah menyampaikan isu yang anda sebutkan berkali-kali dalam e-mel sebelum ini, dan saya telah pun membalas kepada anda secara terbuka. Saya tidak mahu mensia-siakan kesabaran penonton pada kesempatan ini.

Tunggu, tunggu...

Mungkin "operasi madu" Schmidhuber ini boleh dijelaskan melalui e-mel daripada LeCun:

"Jürgen kepada semua orang Dia terlalu taksub dengan pengiktirafan dan sentiasa mengatakan bahawa dia tidak mendapat banyak perkara yang dia layak tidak munasabah 》

Atas ialah kandungan terperinci Kertas LeCun dituduh 'mencuci'? Bapa LSTM menulis dengan marah: Salin kerja saya dan tandai sebagai asli.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Penggunaan penyentuh AC

Penggunaan penyentuh AC

Bagaimana untuk memulihkan data dari cakera keras mudah alih

Bagaimana untuk memulihkan data dari cakera keras mudah alih

Penyelesaian kepada tandatangan tidak sah

Penyelesaian kepada tandatangan tidak sah

Bagaimana untuk menyimpan program yang ditulis dalam pycharm

Bagaimana untuk menyimpan program yang ditulis dalam pycharm

Lima sebab mengapa komputer anda tidak dapat dihidupkan

Lima sebab mengapa komputer anda tidak dapat dihidupkan

Penyelesaian kepada ralat sintaks prosedur sql

Penyelesaian kepada ralat sintaks prosedur sql

Formula pilih atur dan gabungan yang biasa digunakan

Formula pilih atur dan gabungan yang biasa digunakan

Penyelesaian ralat httpstatus500

Penyelesaian ralat httpstatus500