Peranti teknologi

Peranti teknologi

AI

AI

Penyelidikan baharu daripada Google dan DeepMind: Bagaimanakah kecenderungan induktif mempengaruhi penskalaan model?

Penyelidikan baharu daripada Google dan DeepMind: Bagaimanakah kecenderungan induktif mempengaruhi penskalaan model?

Penyelidikan baharu daripada Google dan DeepMind: Bagaimanakah kecenderungan induktif mempengaruhi penskalaan model?

Penskalaan model Transformer telah membangkitkan minat penyelidikan ramai sarjana sejak beberapa tahun kebelakangan ini. Walau bagaimanapun, tidak banyak yang diketahui tentang sifat penskalaan bagi bias induktif yang berbeza yang dikenakan oleh seni bina model. Selalunya diandaikan bahawa penambahbaikan pada skala tertentu (pengiraan, saiz, dll.) boleh dipindahkan ke skala dan kawasan pengiraan yang berbeza.

Walau bagaimanapun, adalah penting untuk memahami interaksi antara seni bina dan undang-undang penskalaan, dan ia adalah kepentingan penyelidikan yang besar untuk mereka bentuk model yang berprestasi baik pada skala yang berbeza. Beberapa soalan masih perlu dijelaskan: Adakah skala seni bina model berbeza? Jika ya, bagaimanakah kecenderungan induktif mempengaruhi prestasi penskalaan? Bagaimanakah ia mempengaruhi tugas huluan (pra-latihan) dan hiliran (pemindahan)?

Dalam kertas kerja baru-baru ini, penyelidik di Google berusaha untuk memahami kesan bias induktif (seni bina) pada penskalaan model bahasa . Untuk melakukan ini, para penyelidik telah melatih dan memperhalusi sepuluh seni bina model yang berbeza merentas berbilang kawasan dan skala pengiraan (daripada 15 juta hingga 40 bilion parameter). Secara keseluruhannya, mereka telah melatih dan memperhalusi lebih daripada 100 model seni bina dan saiz yang berbeza serta membentangkan cerapan dan cabaran dalam menskalakan sepuluh seni bina yang berbeza ini.

Pautan kertas: https://arxiv.org/pdf/2207.10551.pdf

Mereka juga ambil perhatian bahawa penskalaan model ini tidak semudah yang disangka, iaitu butiran rumit penskalaan berkait rapat dengan pilihan seni bina yang dikaji secara terperinci dalam kertas kerja ini. Contohnya, ciri Universal Transformers (dan ALBERT) ialah perkongsian parameter. Pilihan seni bina ini menyelewengkan tingkah laku penskalaan dengan ketara berbanding Transformer standard bukan sahaja dari segi prestasi, tetapi juga dari segi metrik pengiraan seperti FLOP, kelajuan dan bilangan parameter. Sebaliknya, model seperti Switch Transformers adalah berbeza sama sekali, dengan hubungan luar biasa antara FLOP dan kuantiti parameter.

Khususnya, sumbangan utama artikel ini adalah seperti berikut:

- Terbitan pertama berbeza bias induktif dan undang-undang penskalaan seni bina model . Para penyelidik mendapati bahawa faktor penskalaan ini berbeza-beza dengan ketara merentas model dan menyatakan bahawa ini merupakan pertimbangan penting dalam pembangunan model. Ternyata daripada kesemua sepuluh seni bina yang mereka anggap, Transformer vanila mempunyai prestasi penskalaan yang terbaik, walaupun ia bukan yang terbaik dari segi mutlak bagi setiap kawasan pengiraan.

- Penyelidik telah memerhatikan bahawa model yang berfungsi dengan baik dalam satu kawasan penskalaan pengiraan tidak semestinya model terbaik di rantau penskalaan pengiraan yang lain. Selain itu, mereka mendapati bahawa sesetengah model, semasa berprestasi baik di kawasan pengiraan rendah, sukar untuk skala. Ini bermakna sukar untuk mendapatkan gambaran lengkap tentang kebolehskalaan model dengan membandingkan titik demi titik dalam kawasan pengiraan tertentu.

- Penyelidik mendapati bahawa kebingungan pra-latihan huluan mungkin kurang relevan dengan pemindahan hiliran apabila ia melibatkan penskalaan seni bina model yang berbeza. Oleh itu, seni bina asas dan berat sebelah induktif juga penting untuk migrasi hiliran.

- Para penyelidik menyerlahkan kesukaran penskalaan di bawah seni bina tertentu dan menunjukkan bahawa sesetengah model tidak berskala (atau berskala dengan arah aliran negatif). Mereka juga mendapati kecenderungan untuk model perhatian temporal linear (seperti Performer) sukar untuk skala.

Kaedah dan Eksperimen

Dalam bab ketiga kertas kerja, penyelidik menggariskan persediaan percubaan keseluruhan dan memperkenalkan model yang dinilai dalam eksperimen.

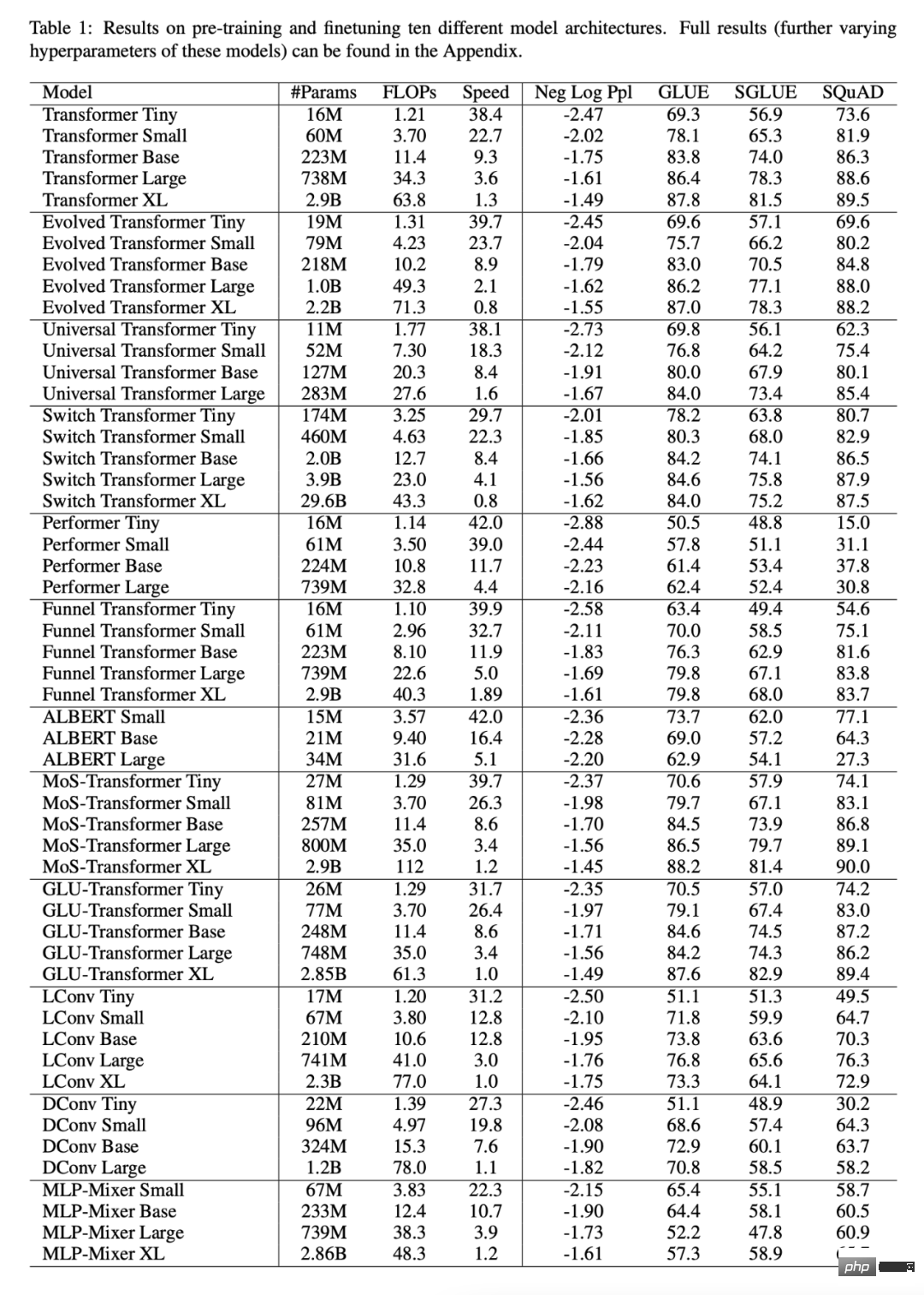

Jadual 1 di bawah menunjukkan keputusan utama artikel ini, termasuk bilangan parameter boleh dilatih, FLOP (laluan hadapan tunggal) dan kelajuan (langkah sesaat), dsb., sebagai tambahan kepada Sahkan kebingungan (pra-latihan huluan) dan keputusan pada 17 tugasan hiliran.

Adakah semua model berskala dengan cara yang sama?

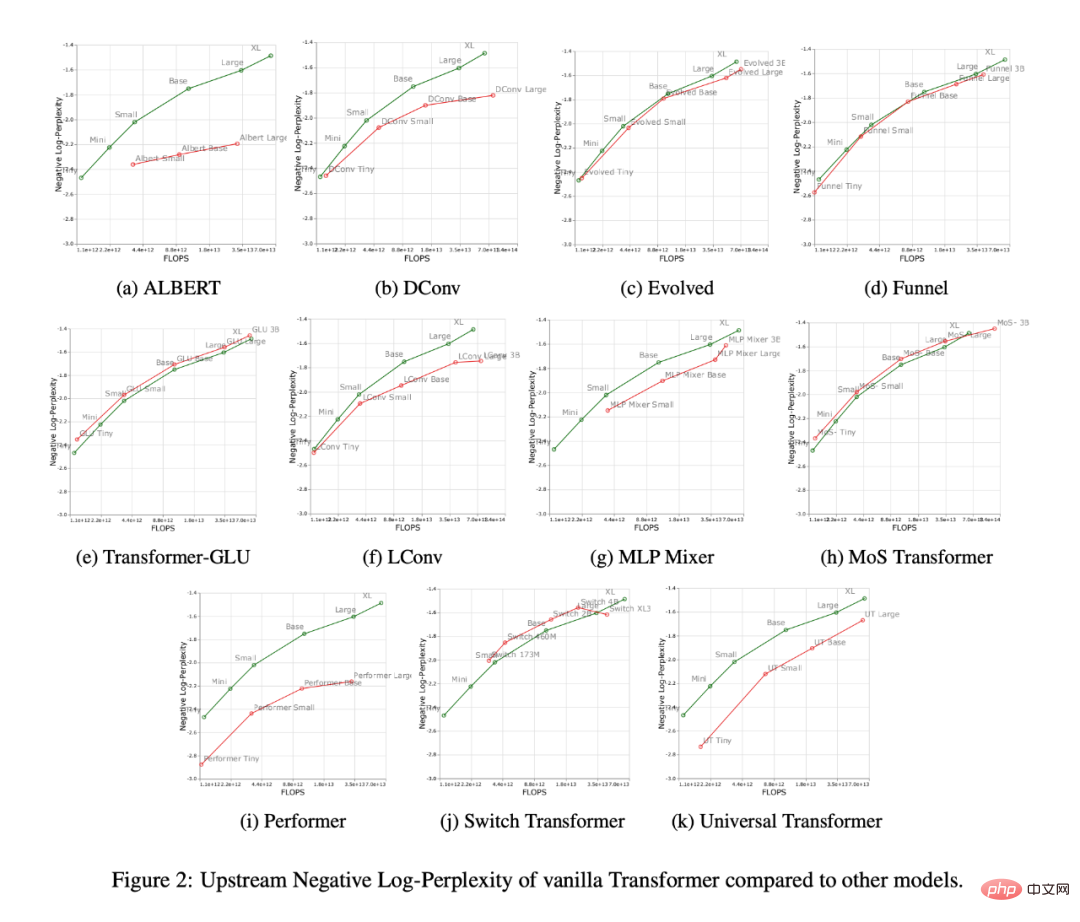

Rajah 2 di bawah menunjukkan gelagat penskalaan semua model apabila meningkatkan bilangan FLOP. Dapat diperhatikan bahawa tingkah laku penskalaan semua model adalah agak unik dan berbeza, iaitu kebanyakannya berbeza daripada Transformer standard. Mungkin penemuan terbesar di sini ialah kebanyakan model (cth., LConv, Evolution) kelihatan berprestasi setanding atau lebih baik daripada Transformer standard, tetapi gagal menskalakan dengan belanjawan pengiraan yang lebih tinggi.

Satu lagi trend yang menarik ialah Transformer "linear", seperti Performer, tidak berskala. Seperti yang ditunjukkan dalam Rajah 2i, berbanding dari asas ke skala besar, kebingungan pra-latihan hanya menurun sebanyak 2.7%. Untuk Transformer vanila angka ini ialah 8.4%.

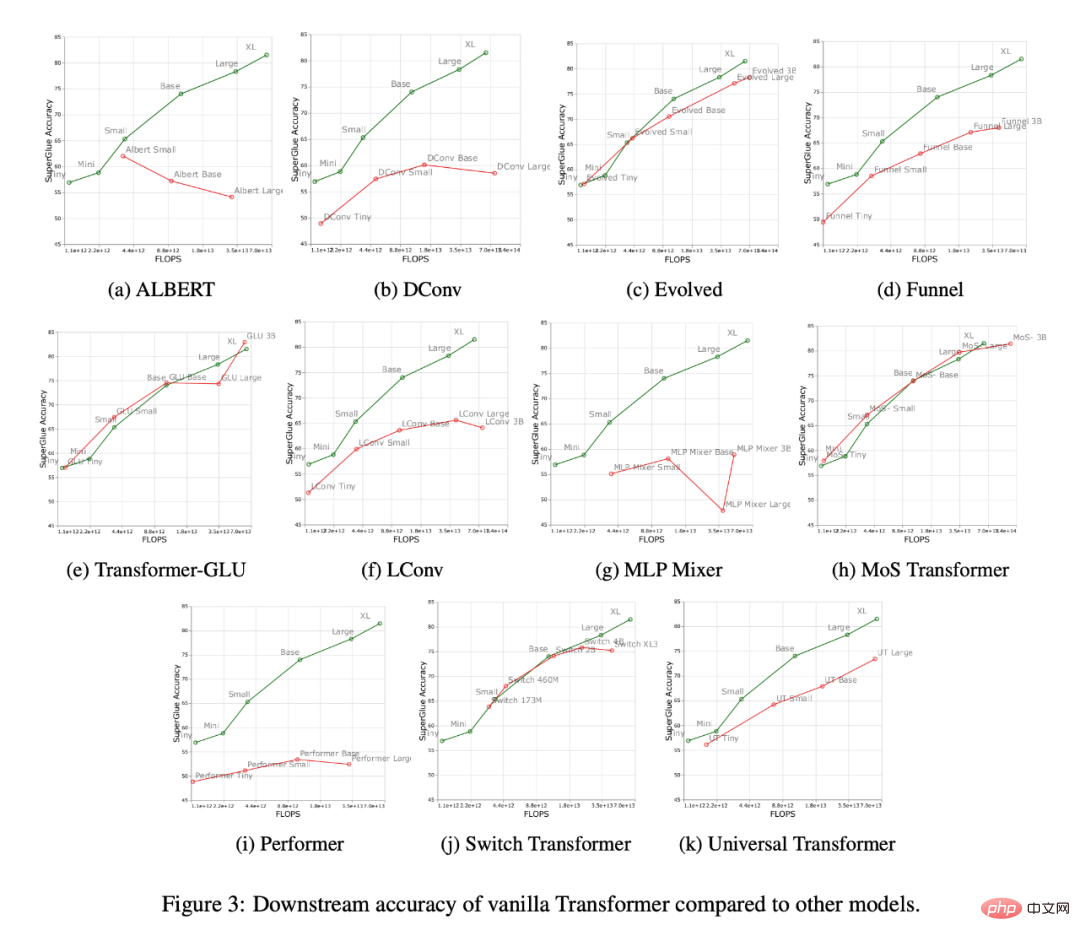

Rajah 3 di bawah menunjukkan lengkung penskalaan semua model pada tugas migrasi hiliran Ia boleh didapati bahawa berbanding dengan Transformer, kebanyakan model mempunyai perbezaan Keluk penskalaan, berubah dengan ketara dalam tugas hiliran. Perlu diingat bahawa kebanyakan model mempunyai lengkung penskalaan huluan atau hiliran yang berbeza.

Penyelidik mendapati beberapa model, seperti Funnel Transformer dan LConv, nampaknya berprestasi agak baik di hulu, tetapi banyak terjejas di hiliran. Bagi Performer pula, jurang prestasi antara huluan dan hiliran nampaknya lebih luas. Perlu diingat bahawa tugas hiliran SuperGLUE selalunya memerlukan perhatian pseudo-silang pada pengekod, yang model seperti konvolusi tidak dapat mengendalikan (Tay et al., 2021a).

Oleh itu, penyelidik mendapati bahawa walaupun sesetengah model mempunyai prestasi huluan yang baik, mereka mungkin masih menghadapi kesukaran mempelajari tugasan hiliran.

Adakah model terbaik berbeza untuk setiap skala?

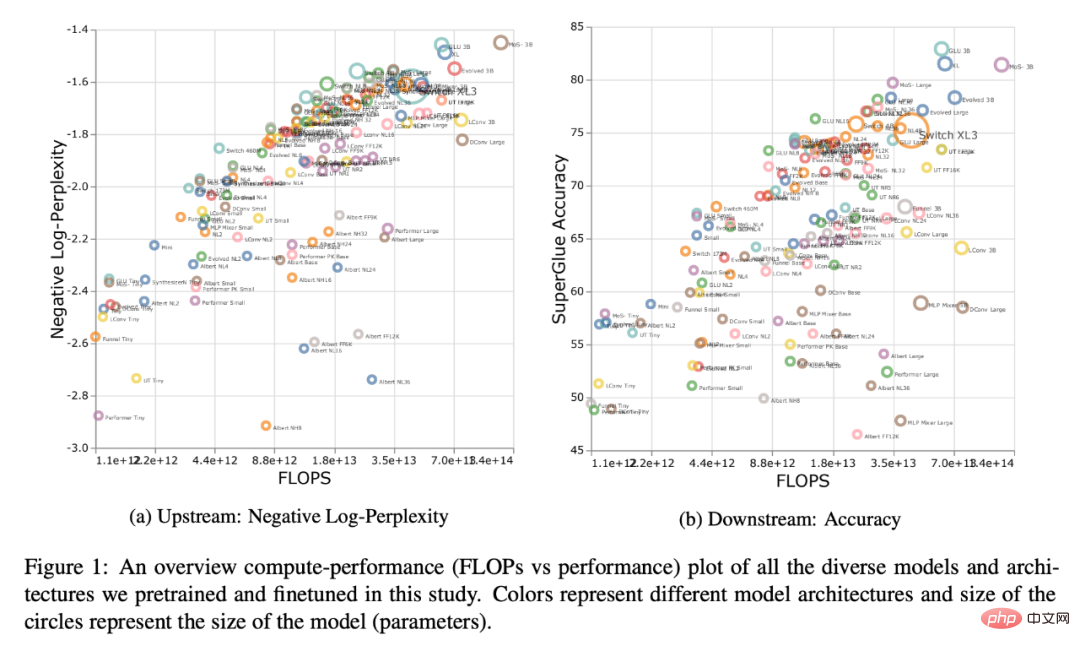

Rajah 1 di bawah menunjukkan sempadan Pareto apabila dikira dari segi prestasi huluan atau hiliran. Warna plot mewakili model yang berbeza, dan boleh diperhatikan bahawa model optimum mungkin berbeza untuk setiap skala dan kawasan pengiraan. Selain itu, ini juga boleh dilihat dalam Rajah 3 di atas. Contohnya, Transformer Evolved nampaknya berprestasi sama seperti Transformer standard dalam kawasan kecil ke kecil (hiliran), tetapi ini berubah dengan cepat apabila meningkatkan model. Para penyelidik juga memerhatikan ini dalam MoS-Transformer, yang menunjukkan prestasi yang lebih baik daripada Transformer biasa di beberapa kawasan, tetapi tidak di kawasan lain.

Hukum penskalaan bagi setiap model

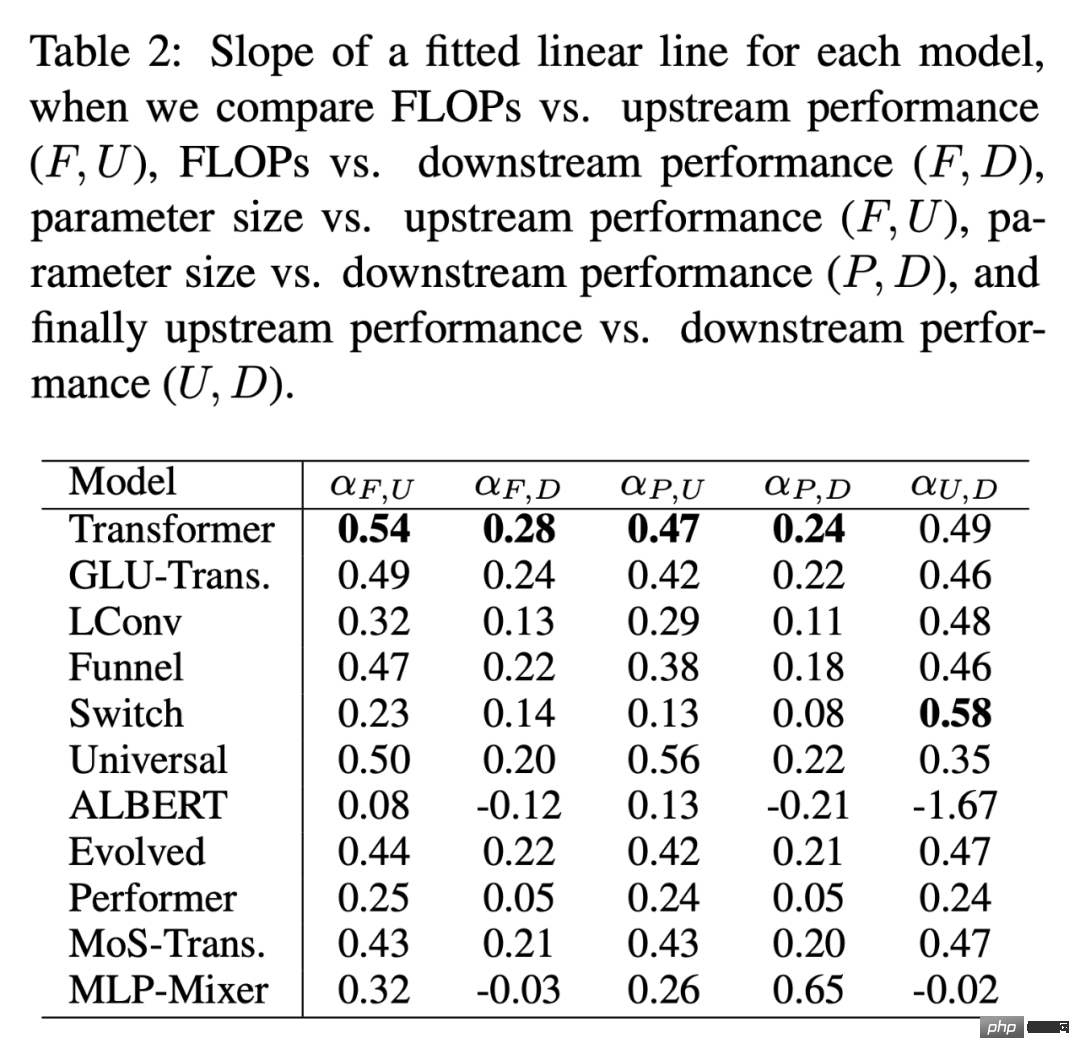

Jadual 2 di bawah memberikan pemasangan setiap model dalam pelbagai kes Kecerunan lurus linear baris α. Para penyelidik memperoleh α dengan memplot F (FLOPs), U (perplexity hulu), D (ketepatan hiliran), dan P (bilangan parameter). Secara umum, α menerangkan kebolehskalaan model, cth. α_F,U memplot FLOP terhadap prestasi huluan. Satu-satunya pengecualian ialah α_U,D, yang merupakan ukuran prestasi huluan dan hiliran, dengan nilai α_U,D tinggi yang bermaksud penskalaan model yang lebih baik kepada tugas hiliran. Secara keseluruhan, nilai alfa ialah ukuran prestasi model berbanding penskalaan.

Adakah Protokol Penskalaan mempengaruhi seni bina model dengan cara yang sama?

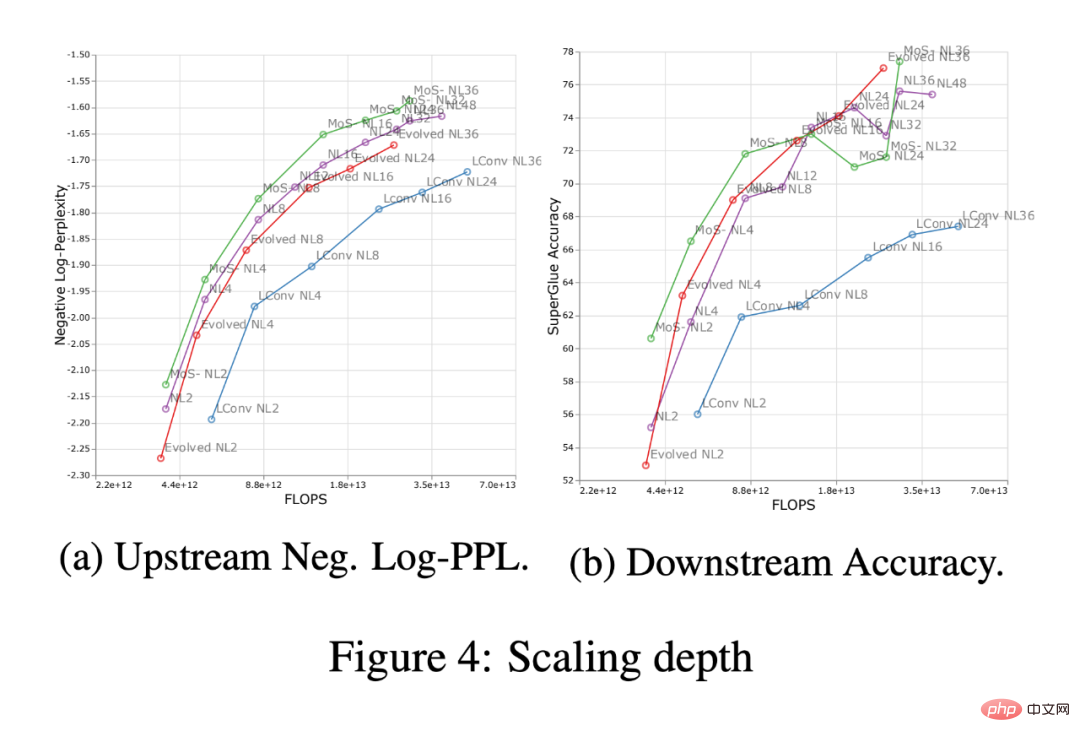

Rajah 4 di bawah menunjukkan kesan kedalaman penskalaan dalam empat seni bina model (MoS-Transformer, Transformer, Evolved Transformer, LConv).

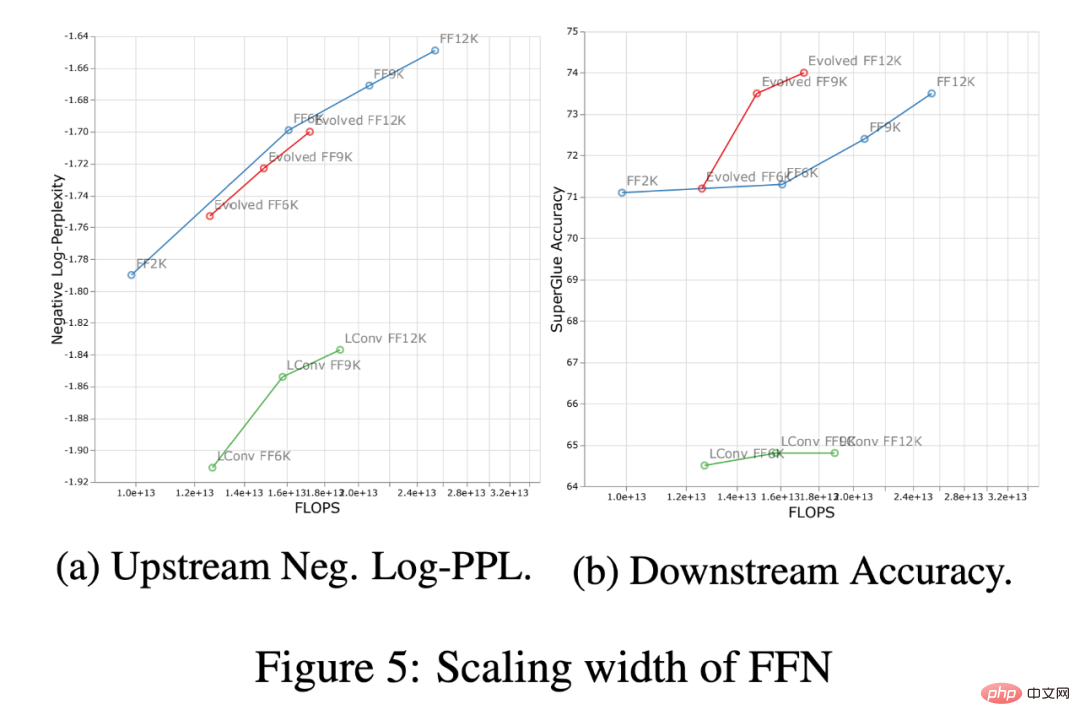

Rajah 5 di bawah menunjukkan kesan lebar penskalaan merentas empat seni bina yang sama. Pertama, pada lengkung huluan (negatif log-perplexity) dapat diperhatikan bahawa walaupun terdapat perbezaan yang jelas dalam prestasi mutlak antara seni bina yang berbeza, trend penskalaan kekal hampir sama. Hilir, kecuali LConv, penskalaan dalam (Rajah 4 di atas) nampaknya berfungsi sama pada kebanyakan seni bina. Selain itu, nampaknya Transformer Evolved berfungsi sedikit lebih baik apabila menggunakan penskalaan lebar berbanding penskalaan lebar. Perlu diambil perhatian bahawa penskalaan kedalaman mempunyai kesan yang lebih besar pada penskalaan hiliran daripada penskalaan lebar.

Untuk butiran penyelidikan lanjut, sila rujuk kertas asal.

Atas ialah kandungan terperinci Penyelidikan baharu daripada Google dan DeepMind: Bagaimanakah kecenderungan induktif mempengaruhi penskalaan model?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1374

1374

52

52

Cara Mengulas DeepSeek

Feb 19, 2025 pm 05:42 PM

Cara Mengulas DeepSeek

Feb 19, 2025 pm 05:42 PM

DeepSeek adalah alat pengambilan maklumat yang kuat. .

Cara Mencari DeepSeek

Feb 19, 2025 pm 05:39 PM

Cara Mencari DeepSeek

Feb 19, 2025 pm 05:39 PM

DeepSeek adalah enjin carian proprietari yang hanya mencari dalam pangkalan data atau sistem tertentu, lebih cepat dan lebih tepat. Apabila menggunakannya, pengguna dinasihatkan untuk membaca dokumen itu, cuba strategi carian yang berbeza, dapatkan bantuan dan maklum balas mengenai pengalaman pengguna untuk memanfaatkan kelebihan mereka.

Sesame Open Door Exchange Web Pautan Pautan Gerbang Perdagangan Laman Web Pendaftaran Terkini

Feb 28, 2025 am 11:06 AM

Sesame Open Door Exchange Web Pautan Pautan Gerbang Perdagangan Laman Web Pendaftaran Terkini

Feb 28, 2025 am 11:06 AM

Artikel ini memperkenalkan proses pendaftaran versi web Web Open Exchange (GATE.IO) dan aplikasi Perdagangan Gate secara terperinci. Sama ada pendaftaran web atau pendaftaran aplikasi, anda perlu melawat laman web rasmi atau App Store untuk memuat turun aplikasi tulen, kemudian isi nama pengguna, kata laluan, e -mel, nombor telefon bimbit dan maklumat lain, dan lengkap e -mel atau pengesahan telefon bimbit.

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung?

Feb 21, 2025 pm 10:57 PM

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung?

Feb 21, 2025 pm 10:57 PM

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung? Bybit adalah pertukaran cryptocurrency yang menyediakan perkhidmatan perdagangan kepada pengguna. Aplikasi mudah alih Exchange tidak boleh dimuat turun terus melalui AppStore atau GooglePlay untuk sebab -sebab berikut: 1. Aplikasi pertukaran cryptocurrency sering tidak memenuhi keperluan ini kerana ia melibatkan perkhidmatan kewangan dan memerlukan peraturan dan standard keselamatan tertentu. 2. Undang -undang dan Peraturan Pematuhan di banyak negara, aktiviti yang berkaitan dengan urus niaga cryptocurrency dikawal atau terhad. Untuk mematuhi peraturan ini, aplikasi bybit hanya boleh digunakan melalui laman web rasmi atau saluran yang diberi kuasa lain

Platform Perdagangan Pintu Terbuka Sesame Muat turun Versi Mudah Alih Platform Perdagangan Platform Perdagangan Alamat Muat Turun

Feb 28, 2025 am 10:51 AM

Platform Perdagangan Pintu Terbuka Sesame Muat turun Versi Mudah Alih Platform Perdagangan Platform Perdagangan Alamat Muat Turun

Feb 28, 2025 am 10:51 AM

Adalah penting untuk memilih saluran rasmi untuk memuat turun aplikasi dan memastikan keselamatan akaun anda.

Portal Pendaftaran Rasmi Exchange Gate.io

Feb 20, 2025 pm 04:27 PM

Portal Pendaftaran Rasmi Exchange Gate.io

Feb 20, 2025 pm 04:27 PM

Gate.io adalah pertukaran cryptocurrency terkemuka yang menawarkan pelbagai aset crypto dan pasangan perdagangan. Mendaftar Gate.io sangat mudah. Lengkapkan pendaftaran. Dengan Gate.io, pengguna dapat menikmati pengalaman perdagangan cryptocurrency yang selamat dan mudah.

Top 10 Disyorkan untuk App Perdagangan Aset Digital Crypto (2025 Global Ranking)

Mar 18, 2025 pm 12:15 PM

Top 10 Disyorkan untuk App Perdagangan Aset Digital Crypto (2025 Global Ranking)

Mar 18, 2025 pm 12:15 PM

Artikel ini mencadangkan sepuluh platform perdagangan cryptocurrency teratas yang memberi perhatian kepada, termasuk Binance, OKX, Gate.io, Bitflyer, Kucoin, Bybit, Coinbase Pro, Kraken, BYDFI dan Xbit yang desentralisasi. Platform ini mempunyai kelebihan mereka sendiri dari segi kuantiti mata wang transaksi, jenis urus niaga, keselamatan, pematuhan, dan ciri khas. Memilih platform yang sesuai memerlukan pertimbangan yang komprehensif berdasarkan pengalaman perdagangan anda sendiri, toleransi risiko dan keutamaan pelaburan. Semoga artikel ini membantu anda mencari saman terbaik untuk diri sendiri

Portal Log Masuk Versi Rasmi Binance Binance

Feb 21, 2025 pm 05:42 PM

Portal Log Masuk Versi Rasmi Binance Binance

Feb 21, 2025 pm 05:42 PM

Untuk mengakses versi Login Laman Web Binance yang terkini, ikuti langkah mudah ini. Pergi ke laman web rasmi dan klik butang "Login" di sudut kanan atas. Pilih kaedah log masuk anda yang sedia ada. Masukkan nombor mudah alih berdaftar atau e -mel dan kata laluan anda dan pengesahan lengkap (seperti kod pengesahan mudah alih atau Google Authenticator). Selepas pengesahan yang berjaya, anda boleh mengakses Portal Log masuk laman web rasmi Binance.