Peranti teknologi

Peranti teknologi

AI

AI

Penyelidik meta membuat percubaan baharu pada AI: mengajar robot untuk menavigasi secara fizikal tanpa peta atau latihan

Penyelidik meta membuat percubaan baharu pada AI: mengajar robot untuk menavigasi secara fizikal tanpa peta atau latihan

Penyelidik meta membuat percubaan baharu pada AI: mengajar robot untuk menavigasi secara fizikal tanpa peta atau latihan

Jabatan kecerdasan buatan Meta Platforms baru-baru ini menyatakan bahawa mereka sedang mengajar model AI cara belajar berjalan di dunia fizikal dengan sokongan sejumlah kecil data latihan, dan telah mencapai kemajuan pesat.

Penyelidikan ini boleh memendekkan dengan ketara masa untuk model AI memperoleh keupayaan navigasi visual. Sebelum ini, untuk mencapai matlamat sedemikian memerlukan "pembelajaran pengukuhan" berulang menggunakan set data yang besar.

Penyelidik Meta AI berkata bahawa penerokaan navigasi visual AI ini akan memberi impak yang ketara kepada dunia maya. Idea asas projek itu tidak rumit: untuk membantu AI menavigasi ruang fizikal seperti yang dilakukan manusia, hanya melalui pemerhatian dan penerokaan.

Jabatan Meta AI menjelaskan, “Sebagai contoh, jika kita mahu cermin mata AR membimbing kita untuk mencari kunci, kita mesti mencari jalan untuk membantu AI memahami susun atur persekitaran yang tidak biasa dan sentiasa berubah adalah keperluan yang sangat terperinci dan kecil , adalah mustahil untuk bergantung pada peta pratetap berketepatan tinggi yang menggunakan banyak kuasa pengkomputeran meja tanpa sebarang perlanggaran ”

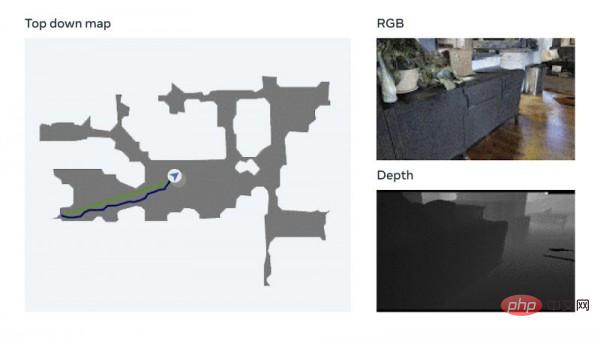

Untuk tujuan ini, Meta memutuskan untuk menumpukan usahanya pada "AI yang terkandung", iaitu, melatih sistem AI melalui mekanisme interaktif dalam simulasi 3D. Dalam bidang ini, Meta berkata ia telah mewujudkan "model navigasi sasaran titik" yang menjanjikan yang boleh menavigasi dalam persekitaran baharu tanpa sebarang peta atau penderia GPS.

Model menggunakan teknologi yang dipanggil pengukuran visual, yang membolehkan AI menjejaki kedudukan semasanya berdasarkan input visual. Meta berkata bahawa teknologi penambahan data ini boleh melatih model saraf yang berkesan dengan cepat tanpa memerlukan anotasi data manual. Meta juga menyebut bahawa mereka telah menyelesaikan ujian pada platform latihan AI yang terkandung Habitat 2.0 mereka sendiri (yang menggunakan tugas penanda aras Realistic PointNav untuk menjalankan simulasi ruang maya), dengan kadar kejayaan 94%.

Meta menjelaskan, “Walaupun kaedah kami belum menyelesaikan sepenuhnya semua senario dalam set data, penyelidikan ini pada mulanya telah menunjukkan bahawa keupayaan navigasi dalam persekitaran dunia sebenar tidak semestinya Eksplisit pemetaan diperlukan untuk melaksanakan ”

Untuk meningkatkan lagi latihan navigasi AI tanpa bergantung pada peta, Meta telah menubuhkan set data latihan yang dipanggil Habitat-Web, yang mengandungi lebih daripada 100,000 jenis data-. kaedah navigasi matlamat yang ditunjukkan oleh manusia. Simulator Habitat yang berjalan pada pelayar web boleh menyambung dengan lancar ke perkhidmatan Mechanical Turk Amazon.com, membolehkan pengguna mengendalikan robot maya dari jauh dengan selamat. Meta berkata data yang terhasil akan digunakan sebagai bahan latihan untuk membantu ejen AI mencapai "hasil terkini." Mengimbas bilik untuk memahami ciri spatial keseluruhan, menyemak sama ada terdapat halangan di sudut, dsb. adalah semua gelagat carian objek yang cekap yang AI boleh pelajari daripada manusia.

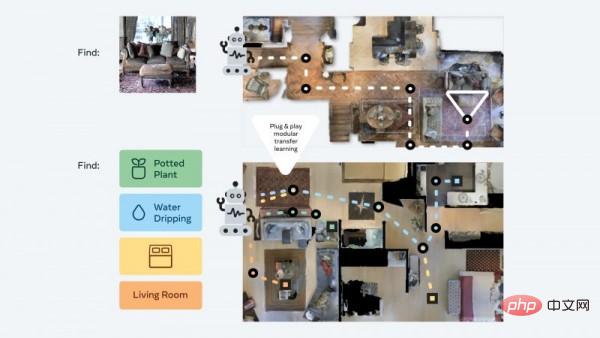

Selain itu, pasukan Meta AI juga telah membangunkan pendekatan modular yang dipanggil "plug and play" yang boleh membantu robot menavigasi pelbagai tugas navigasi semantik dan mod matlamat melalui set unik "sampel sifar rangka kerja pembelajaran pengalaman" Mencapai generalisasi. Dengan cara ini, ejen AI masih boleh memperoleh kemahiran navigasi asas tanpa memerlukan peta dan latihan intensif sumber, dan boleh melaksanakan tugas yang berbeza dalam persekitaran 3D tanpa pelarasan tambahan.

Meta menerangkan bahawa ejen ini terus mencari sasaran imej semasa latihan. Mereka menerima foto yang diambil di lokasi rawak dalam persekitaran dan kemudian menggunakan navigasi autonomi untuk cuba mencari lokasi tersebut. Penyelidik meta berkata, "Kaedah kami mengurangkan data latihan kepada 1/12.5, dan kadar kejayaan adalah 14% lebih tinggi daripada teknologi pembelajaran pemindahan terkini

Penganalisis Constellation Research Holger Mueller berkata dalam temu bual Zhong berkata bahawa pembangunan terbaru Meta ini dijangka memainkan peranan penting dalam pelan pembangunan metaversenya. Beliau percaya bahawa jika dunia maya boleh menjadi kebiasaan pada masa hadapan, AI mesti dapat memahami ruang baharu ini, dan kos pemahaman tidak seharusnya terlalu tinggi.

Mueller menambah, “Keupayaan AI untuk memahami dunia fizikal perlu diperluaskan dengan kaedah berasaskan perisian Meta kini mengambil jalan ini, dan telah mencapai kemajuan dalam AI yang terkandung, membangunkan AI yang tidak memerlukan latihan. Perisian yang boleh memahami persekitarannya secara autonomi Saya teruja untuk melihat aplikasi praktikal awal ini.”

Kes penggunaan dunia sebenar ini mungkin tidak jauh. Meta berkata langkah seterusnya ialah memajukan hasil ini daripada navigasi ke operasi mudah alih dan membangunkan ejen AI yang boleh melaksanakan tugas tertentu (seperti mengenal pasti dompet dan mengembalikannya kepada pemiliknya).

Atas ialah kandungan terperinci Penyelidik meta membuat percubaan baharu pada AI: mengajar robot untuk menavigasi secara fizikal tanpa peta atau latihan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Laman web ini melaporkan pada 27 Jun bahawa Jianying ialah perisian penyuntingan video yang dibangunkan oleh FaceMeng Technology, anak syarikat ByteDance Ia bergantung pada platform Douyin dan pada asasnya menghasilkan kandungan video pendek untuk pengguna platform tersebut Windows , MacOS dan sistem pengendalian lain. Jianying secara rasmi mengumumkan peningkatan sistem keahliannya dan melancarkan SVIP baharu, yang merangkumi pelbagai teknologi hitam AI, seperti terjemahan pintar, penonjolan pintar, pembungkusan pintar, sintesis manusia digital, dsb. Dari segi harga, yuran bulanan untuk keratan SVIP ialah 79 yuan, yuran tahunan ialah 599 yuan (nota di laman web ini: bersamaan dengan 49.9 yuan sebulan), langganan bulanan berterusan ialah 59 yuan sebulan, dan langganan tahunan berterusan ialah 499 yuan setahun (bersamaan dengan 41.6 yuan sebulan) . Di samping itu, pegawai yang dipotong juga menyatakan bahawa untuk meningkatkan pengalaman pengguna, mereka yang telah melanggan VIP asal

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Tingkatkan produktiviti, kecekapan dan ketepatan pembangun dengan menggabungkan penjanaan dipertingkatkan semula dan memori semantik ke dalam pembantu pengekodan AI. Diterjemah daripada EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, pengarang JanakiramMSV. Walaupun pembantu pengaturcaraan AI asas secara semulajadi membantu, mereka sering gagal memberikan cadangan kod yang paling relevan dan betul kerana mereka bergantung pada pemahaman umum bahasa perisian dan corak penulisan perisian yang paling biasa. Kod yang dijana oleh pembantu pengekodan ini sesuai untuk menyelesaikan masalah yang mereka bertanggungjawab untuk menyelesaikannya, tetapi selalunya tidak mematuhi piawaian pengekodan, konvensyen dan gaya pasukan individu. Ini selalunya menghasilkan cadangan yang perlu diubah suai atau diperhalusi agar kod itu diterima ke dalam aplikasi

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Model Bahasa Besar (LLM) dilatih pada pangkalan data teks yang besar, di mana mereka memperoleh sejumlah besar pengetahuan dunia sebenar. Pengetahuan ini dibenamkan ke dalam parameter mereka dan kemudiannya boleh digunakan apabila diperlukan. Pengetahuan tentang model ini "diperbaharui" pada akhir latihan. Pada akhir pra-latihan, model sebenarnya berhenti belajar. Selaraskan atau perhalusi model untuk mempelajari cara memanfaatkan pengetahuan ini dan bertindak balas dengan lebih semula jadi kepada soalan pengguna. Tetapi kadangkala pengetahuan model tidak mencukupi, dan walaupun model boleh mengakses kandungan luaran melalui RAG, ia dianggap berfaedah untuk menyesuaikan model kepada domain baharu melalui penalaan halus. Penalaan halus ini dilakukan menggunakan input daripada anotasi manusia atau ciptaan LLM lain, di mana model menemui pengetahuan dunia sebenar tambahan dan menyepadukannya

Alat dengar Meta Quest 3S VR mampu milik baharu muncul di FCC, mencadangkan pelancaran yang akan berlaku

Sep 04, 2024 am 06:51 AM

Alat dengar Meta Quest 3S VR mampu milik baharu muncul di FCC, mencadangkan pelancaran yang akan berlaku

Sep 04, 2024 am 06:51 AM

Acara Meta Connect 2024 ditetapkan pada 25 hingga 26 September, dan dalam acara ini, syarikat itu dijangka memperkenalkan set kepala realiti maya mampu milik baharu. Dikhabarkan sebagai Meta Quest 3S, set kepala VR nampaknya telah muncul pada penyenaraian FCC. cadangan ini

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Model sumber terbuka pertama yang melepasi tahap GPT4o! Llama 3.1 bocor: 405 bilion parameter, pautan muat turun dan kad model tersedia

Jul 23, 2024 pm 08:51 PM

Model sumber terbuka pertama yang melepasi tahap GPT4o! Llama 3.1 bocor: 405 bilion parameter, pautan muat turun dan kad model tersedia

Jul 23, 2024 pm 08:51 PM

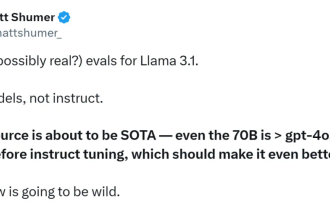

Sediakan GPU anda! Llama3.1 akhirnya muncul, tetapi sumbernya bukan Meta rasmi. Hari ini, berita bocor versi baharu model besar Llama menjadi tular di Reddit Selain model asas, ia juga termasuk hasil penanda aras 8B, 70B dan parameter maksimum 405B. Rajah di bawah menunjukkan hasil perbandingan setiap versi Llama3.1 dengan OpenAIGPT-4o dan Llama38B/70B. Ia boleh dilihat bahawa walaupun versi 70B melebihi GPT-4o pada pelbagai penanda aras. Sumber imej: https://x.com/mattshumer_/status/1815444612414087294 Jelas sekali, versi 3.1 daripada 8B dan 70

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Editor |. KX Dalam bidang penyelidikan dan pembangunan ubat, meramalkan pertalian pengikatan protein dan ligan dengan tepat dan berkesan adalah penting untuk pemeriksaan dan pengoptimuman ubat. Walau bagaimanapun, kajian semasa tidak mengambil kira peranan penting maklumat permukaan molekul dalam interaksi protein-ligan. Berdasarkan ini, penyelidik dari Universiti Xiamen mencadangkan rangka kerja pengekstrakan ciri berbilang mod (MFE) novel, yang buat pertama kalinya menggabungkan maklumat mengenai permukaan protein, struktur dan jujukan 3D, dan menggunakan mekanisme perhatian silang untuk membandingkan ciri modaliti yang berbeza penjajaran. Keputusan eksperimen menunjukkan bahawa kaedah ini mencapai prestasi terkini dalam meramalkan pertalian mengikat protein-ligan. Tambahan pula, kajian ablasi menunjukkan keberkesanan dan keperluan maklumat permukaan protein dan penjajaran ciri multimodal dalam rangka kerja ini. Penyelidikan berkaitan bermula dengan "S

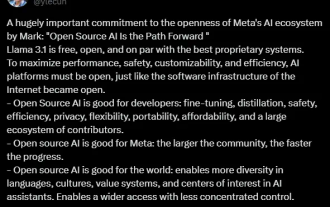

Model terkuat Llama 3.1 405B dikeluarkan secara rasmi, Zuckerberg: Sumber terbuka menerajui era baharu

Jul 24, 2024 pm 08:23 PM

Model terkuat Llama 3.1 405B dikeluarkan secara rasmi, Zuckerberg: Sumber terbuka menerajui era baharu

Jul 24, 2024 pm 08:23 PM

Sebentar tadi, Llama 3.1 yang ditunggu-tunggu telah dikeluarkan secara rasmi! Meta secara rasmi mengeluarkan suara bahawa "sumber terbuka membawa era baru." Dalam blog rasmi, Meta berkata: "Sehingga hari ini, model bahasa besar sumber terbuka kebanyakannya ketinggalan di belakang model tertutup dari segi kefungsian dan prestasi. Kini, kami menyambut era baharu yang diterajui oleh sumber terbuka. Kami mengeluarkan MetaLlama3.1405B secara terbuka. , yang kami percaya Ia adalah model asas sumber terbuka yang terbesar dan paling berkuasa di dunia Sehingga kini, jumlah muat turun semua versi Llama telah melebihi 300 juta kali, dan kami baru sahaja memulakan pengasas dan Ketua Pegawai Eksekutif Meta Zuckerberg artikel panjang "OpenSourceAIIsthePathForward",