pembangunan bahagian belakang

pembangunan bahagian belakang

Tutorial Python

Tutorial Python

Pembangun mengambil bahagian secara peribadi: Berbanding dengan bahasa Julia dan Python untuk pembelajaran mesin, yang manakah lebih baik?

Pembangun mengambil bahagian secara peribadi: Berbanding dengan bahasa Julia dan Python untuk pembelajaran mesin, yang manakah lebih baik?

Pembangun mengambil bahagian secara peribadi: Berbanding dengan bahasa Julia dan Python untuk pembelajaran mesin, yang manakah lebih baik?

Bahasa pengaturcaraan yang manakah akan anda pilih pada tahun 2022?

Beberapa tahun lalu terdapat pepatah bahawa Julia akan menggantikan Python dan menjadi salah satu bahasa pengaturcaraan yang paling popular. Kami mengambil sikap tunggu dan lihat terhadap kenyataan ini buat masa ini, tetapi sebagai alat yang berkuasa dalam pengkomputeran saintifik, kelebihan Julia telah muncul, yang bermaksud bahawa pengaturcara mempunyai pilihan lain.

Dalam bidang seperti sains data dan kecerdasan buatan, jika kita membandingkan Julia dan Python dengan teliti, kita akan mendapati Julia boleh melakukan tugas yang sama yang Python boleh capai, dan ia jauh lebih cekap dan mempunyai sintaks yang ringkas. Elegan, tetapi tidak dikenali sebagai Python dari segi penyebaran.

Baru-baru ini, siaran hangat di reddit telah menarik perbincangan di kalangan netizen. Catatan ini menyebut bahawa baru-baru ini, beberapa pembangun pek bahasa Julia membincangkan status semasa ML dalam Julia dan membandingkan statusnya dengan ekosistem ML Python dibandingkan. .

Alamat pos asal:

https://www.reddit.com/r/MachineLearning/comments/s1zj44/r_julia_developers_discuss_of_current_state /

Jordi Bolibar dari Universiti Utrecht percaya bahawa "Julia memang mempunyai potensi besar untuk pembelajaran mesin, tetapi status semasanya agak bercampur-campur. Lebih khusus lagi, saya berkeras untuk menggunakan Julia dalam SciML Sebab utamanya ialah Persamaan Perbezaan Perpustakaan .jl berfungsi dengan baik, tetapi saya tidak menemui apa-apa yang serupa dalam Python Walau bagaimanapun, kesakitan sebenar untuk penyelidikan saya adalah dalam Zygote Saya menghadapi dua pepijat yang melambatkan kerja saya selama beberapa bulan, tetapi saya masih menganggap Julia pilihan terbaik untuk SciML, tetapi perpustakaan ini (dan dokumentasinya) harus dioptimumkan agar lebih mesra pengguna 》

kata Netizen @jgreener64. : "ML dalam Julia sangat berkuasa dalam bidang tertentu. Semuanya mungkin dalam Julia. Masalah yang dihadapi oleh Julia ialah: dalam Julia ML memerlukan banyak pengetahuan sedia ada atau banyak masa mencari/percubaan dan kesilapan. Pada peringkat peribadi, Saya sedang membangunkan algoritma pembezaan novel dalam Julia >

Selain perbincangan hangat di kalangan netizen, pembangun pakej perisian Julia Christopher Rackauckas menjawab 7 soalan berikut yang lebih dibimbangkan oleh netizen. Rackauckas ialah seorang ahli matematik dan ahli farmakologi di MIT dan Universiti Maryland yang menggunakan Julia untuk pengaturcaraan. Rackauckas telah membuka blog khusus untuk Julia, matematik dan biologi stokastik untuk memperkenalkan kandungan yang berkaitan, dan Rackauckas telah membangunkan beberapa perpustakaan di Julia, termasuk (tetapi tidak terhad kepada) DifferentialEquations.jl dan Pumas.Christopher Rackauckas Soalan termasuk:

Soalan termasuk:

Di manakah ML dalam Julia benar-benar bersinar hari ini? Dalam cara apakah ekosistem ini akan mengatasi prestasi rangka kerja ML popular lain (cth. PyTorch, Flax, dll.) dalam masa terdekat dan mengapa?

- Apakah kelemahan fungsi atau prestasi ekosistem ML semasa Julia? Bilakah Julia akan berdaya saing dalam bidang ini?

- Bagaimanakah pakej ML standard Julia (cth. pembelajaran mendalam) dibandingkan dengan alternatif popular dari segi prestasi (lebih pantas, perlahan, susunan magnitud yang sama)?

- Adakah terdapat sebarang eksperimen penting Julia yang menanda aras alternatif ML yang popular?

- Jika syarikat atau institusi sedang mempertimbangkan untuk mewujudkan kedudukan untuk menyumbang kepada ekosistem ML Julia, adakah terdapat sebarang kes terbaik? Mengapa mereka perlu melakukan ini? Sumbangan manakah yang paling berkesan?

- Mengapa pembangun bebas yang bekerja dengan rangka kerja lain perlu mempertimbangkan untuk menyumbang kepada ekosistem ML Julia?

- Apakah pakej yang biasanya digunakan oleh pembangun Julia untuk tugasan tertentu? Apakah yang diharapkan oleh pembangun Julia untuk menambah yang tidak wujud pada masa ini?

- Di bawah kami telah memilih beberapa isu yang semua orang lebih bimbang untuk melaporkan:

- Soalan 3: Bagaimanakah prestasi Julia dalam "ML standard"?

Kelajuan kernel Julia adalah hebat: pada CPU kami melakukannya dengan sangat baik, pada GPU semua orang hanya memanggil cudnn yang sama dan lain-lain kelajuan AD Julia juga hebat. Zygote mungkin mempunyai sedikit overhed, tetapi berbanding dengan Jax/PyTorch/TensorFlow, Zygote adalah pantas dalam kebanyakan kes. Khususnya, overhed PyTorch jauh lebih tinggi dan tidak boleh diukur dalam aliran kerja ML standard. Pendaraban matriks yang cukup besar akan menyelesaikan masalah peruntukan atau masalah O(n) lain; Julia tidak menggabungkan kernel, jadi dalam kebanyakan penanda aras jika pengguna melihatnya, ia akan melihat bahawa ia tidak menggabungkan panggilan conv atau RNN cudnn.

Soalan 4: Apakah eksperimen dan penanda aras penting yang perlu kita jejaki?

Penjadual edaran XLA sangat bagus. Apabila kita berfikir tentang sambungan, kita harus mengabaikan PyTorch dan memikirkan tentang DaggerFlux dan TensorFlow/Jax. XLA mempunyai lebih fleksibiliti untuk menukar operasi jadi saya rasa XLA adalah pemenang dan kita perlu menggunakan helah e-graf untuk memadankannya. Perkara lain yang perlu diperhatikan ialah "bahagian tengah yang hilang dalam pembezaan automatik", yang masih perlu diselesaikan.

Soalan 7: Apakah pakej perisian yang disyorkan?

Saya cenderung menggunakan Flux apabila diperlukan, tetapi semua orang harus cuba menggunakan DiffEqFlux. Setakat biji sedia ada, Flux adalah yang paling lengkap, tetapi gayanya membosankan saya. Saya ingin mempunyai Fluks yang tidak menggunakan parameter tersirat, tetapi parameter eksplisit. Saya mahu parameter ini diwakili oleh ComponentArrays.

Atas ialah kandungan terperinci Pembangun mengambil bahagian secara peribadi: Berbanding dengan bahasa Julia dan Python untuk pembelajaran mesin, yang manakah lebih baik?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Empat alat pengaturcaraan berbantukan AI yang disyorkan

Apr 22, 2024 pm 05:34 PM

Empat alat pengaturcaraan berbantukan AI yang disyorkan

Apr 22, 2024 pm 05:34 PM

Alat pengaturcaraan berbantukan AI ini telah menemui sejumlah besar alat pengaturcaraan berbantukan AI yang berguna dalam peringkat pembangunan AI yang pesat ini. Alat pengaturcaraan berbantukan AI boleh meningkatkan kecekapan pembangunan, meningkatkan kualiti kod dan mengurangkan kadar pepijat Ia adalah pembantu penting dalam proses pembangunan perisian moden. Hari ini Dayao akan berkongsi dengan anda 4 alat pengaturcaraan berbantukan AI (dan semua menyokong bahasa C# saya harap ia akan membantu semua orang). https://github.com/YSGStudyHards/DotNetGuide1.GitHubCopilotGitHubCopilot ialah pembantu pengekodan AI yang membantu anda menulis kod dengan lebih pantas dan dengan sedikit usaha, supaya anda boleh lebih memfokuskan pada penyelesaian masalah dan kerjasama. Git

Program kod jauh universal GE pada mana-mana peranti

Mar 02, 2024 pm 01:58 PM

Program kod jauh universal GE pada mana-mana peranti

Mar 02, 2024 pm 01:58 PM

Jika anda perlu memprogramkan sebarang peranti dari jauh, artikel ini akan membantu anda. Kami akan berkongsi kod jauh universal GE teratas untuk pengaturcaraan sebarang peranti. Apakah alat kawalan jauh GE? GEUniversalRemote ialah alat kawalan jauh yang boleh digunakan untuk mengawal berbilang peranti seperti TV pintar, LG, Vizio, Sony, Blu-ray, DVD, DVR, Roku, AppleTV, pemain media penstriman dan banyak lagi. Alat kawalan jauh GEUniversal datang dalam pelbagai model dengan fungsi dan keupayaan yang berbeza. GEUniversalRemote boleh mengawal sehingga empat peranti. Kod Jauh Universal Teratas untuk Diprogramkan pada Mana-mana Peranti Alat kawalan jauh GE disertakan dengan set kod yang membolehkannya berfungsi dengan peranti yang berbeza. anda boleh

Ketahui cara membangunkan aplikasi mudah alih menggunakan bahasa Go

Mar 28, 2024 pm 10:00 PM

Ketahui cara membangunkan aplikasi mudah alih menggunakan bahasa Go

Mar 28, 2024 pm 10:00 PM

Tutorial aplikasi mudah alih pembangunan bahasa Go Memandangkan pasaran aplikasi mudah alih terus berkembang pesat, semakin ramai pembangun mula meneroka cara menggunakan bahasa Go untuk membangunkan aplikasi mudah alih. Sebagai bahasa pengaturcaraan yang mudah dan cekap, bahasa Go juga telah menunjukkan potensi yang kukuh dalam pembangunan aplikasi mudah alih. Artikel ini akan memperkenalkan secara terperinci cara menggunakan bahasa Go untuk membangunkan aplikasi mudah alih dan melampirkan contoh kod khusus untuk membantu pembaca bermula dengan cepat dan mula membangunkan aplikasi mudah alih mereka sendiri. 1. Persediaan Sebelum memulakan, kita perlu menyediakan persekitaran dan alatan pembangunan. kepala

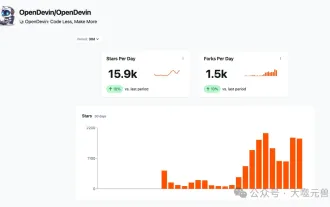

Pengaturcara AI manakah yang terbaik? Terokai potensi Devin, Tongyi Lingma dan ejen SWE

Apr 07, 2024 am 09:10 AM

Pengaturcara AI manakah yang terbaik? Terokai potensi Devin, Tongyi Lingma dan ejen SWE

Apr 07, 2024 am 09:10 AM

Pada 3 Mac 2022, kurang daripada sebulan selepas kelahiran pengaturcara AI pertama di dunia, Devin, pasukan NLP Universiti Princeton membangunkan pengaturcara AI sumber terbuka ejen SWE. Ia memanfaatkan model GPT-4 untuk menyelesaikan isu secara automatik dalam repositori GitHub. Prestasi ejen SWE pada set ujian bangku SWE adalah serupa dengan Devin, mengambil purata 93 saat dan menyelesaikan 12.29% masalah. Dengan berinteraksi dengan terminal khusus, ejen SWE boleh membuka dan mencari kandungan fail, menggunakan semakan sintaks automatik, mengedit baris tertentu dan menulis serta melaksanakan ujian. (Nota: Kandungan di atas adalah sedikit pelarasan bagi kandungan asal, tetapi maklumat utama dalam teks asal dikekalkan dan tidak melebihi had perkataan yang ditentukan.) SWE-A

Honkai Star Rail Apakah kemahiran Botio?

Mar 26, 2024 pm 07:56 PM

Honkai Star Rail Apakah kemahiran Botio?

Mar 26, 2024 pm 07:56 PM

Honkai Impact Railway Botio ialah watak lima bintang yang dilancarkan dalam versi 2.2 permainan ini pasti ramai pemain yang sangat ingin tahu tentang kemahiran Honkai Impact Railway Botio, jadi seterusnya editor akan membawakan kepada anda Honkai Impact Mari kita lihat pengenalannya. kepada kemahiran Dome Railway Potio. Apakah kemahiran Collapse Star Railroad Potio 1. Serangan asas: Serangan biasa biasa, tiada kesan. 2. Kemahiran tempur: Lancarkan konfrontasi terdesak antara diri anda dan musuh yang ditetapkan, berlangsung dua pusingan. Dalam keadaan terdesak, musuh akan memasuki keadaan mengejek. Botio tidak boleh menggunakan sebarang kemahiran tempur, dan serangan asas Kasut dan Tengkoraknya dipertingkatkan menjadi Pengulang Tukul. Apabila musuh/Botio berada dalam konfrontasi terdesak dan diserang oleh pihak lawan, kerosakan akan meningkat sebanyak 30%/15%. Jika tiada di atas padang yang boleh diserang

Memahami VSCode: Untuk apa alat ini digunakan?

Mar 25, 2024 pm 03:06 PM

Memahami VSCode: Untuk apa alat ini digunakan?

Mar 25, 2024 pm 03:06 PM

"Memahami VSCode: Untuk apa alat ini digunakan?" 》Sebagai pengaturcara, sama ada anda seorang pemula atau pembangun berpengalaman, anda tidak boleh melakukannya tanpa menggunakan alat penyuntingan kod. Di antara banyak alat penyuntingan, Kod Visual Studio (pendek kata VSCode) sangat popular di kalangan pembangun sebagai penyunting kod sumber terbuka, ringan dan berkuasa. Jadi, untuk apa sebenarnya VSCode digunakan? Artikel ini akan menyelidiki fungsi dan kegunaan VSCode dan menyediakan contoh kod khusus untuk membantu pembaca

Cipta dan jalankan fail '.a' Linux

Mar 20, 2024 pm 04:46 PM

Cipta dan jalankan fail '.a' Linux

Mar 20, 2024 pm 04:46 PM

Bekerja dengan fail dalam sistem pengendalian Linux memerlukan penggunaan pelbagai arahan dan teknik yang membolehkan pembangun mencipta dan melaksanakan fail, kod, program, skrip dan perkara lain dengan cekap. Dalam persekitaran Linux, fail dengan sambungan ".a" mempunyai kepentingan yang besar sebagai perpustakaan statik. Perpustakaan ini memainkan peranan penting dalam pembangunan perisian, membolehkan pembangun mengurus dan berkongsi fungsi biasa dengan cekap merentas berbilang program. Untuk pembangunan perisian yang berkesan dalam persekitaran Linux, adalah penting untuk memahami cara mencipta dan menjalankan fail ".a". Artikel ini akan memperkenalkan cara memasang dan mengkonfigurasi fail ".a" Linux secara menyeluruh Mari kita terokai definisi, tujuan, struktur dan kaedah mencipta dan melaksanakan fail ".a" Linux. Apa itu L

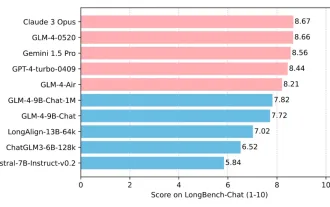

Universiti Tsinghua dan sumber terbuka Zhipu AI GLM-4: melancarkan revolusi baharu dalam pemprosesan bahasa semula jadi

Jun 12, 2024 pm 08:38 PM

Universiti Tsinghua dan sumber terbuka Zhipu AI GLM-4: melancarkan revolusi baharu dalam pemprosesan bahasa semula jadi

Jun 12, 2024 pm 08:38 PM

Sejak pelancaran ChatGLM-6B pada 14 Mac 2023, model siri GLM telah mendapat perhatian dan pengiktirafan yang meluas. Terutama selepas ChatGLM3-6B menjadi sumber terbuka, pembangun penuh dengan jangkaan untuk model generasi keempat yang dilancarkan oleh Zhipu AI. Jangkaan ini akhirnya telah berpuas hati sepenuhnya dengan keluaran GLM-4-9B. Kelahiran GLM-4-9B Untuk memberikan model kecil (10B dan ke bawah) keupayaan yang lebih berkuasa, pasukan teknikal GLM melancarkan model sumber terbuka siri GLM generasi keempat baharu ini: GLM-4-9B selepas hampir setengah tahun penerokaan. Model ini sangat memampatkan saiz model sambil memastikan ketepatan, dan mempunyai kelajuan inferens yang lebih pantas dan kecekapan yang lebih tinggi. Penerokaan pasukan teknikal GLM tidak